Санкт-Петербургский политехнический университет Петра Великого

Институт прикладной математики и механики

Высшая школа прикладной математики и вычислительной

физики

Теория вероятностей. Конспект.

лектор: к.б.н. Н. О. Кадырова

В. Тюльпин, Ю. Камалетдинова

Санкт-Петербург

2019 г.

Содержание

Содержание

1

1 Исчисление вероятностей случайных событий

1.

Соотношение между случайными событиями . . . . . . .

2.

Классическое определение вероятности . . . . . . . . . .

3.

Вероятность и относительная частота . . . . . . . . . . .

4.

Геометрические вероятности . . . . . . . . . . . . . . . . .

5.

Условная вероятность. Теорема умножения вероятностей.

Независимость событий . . . . . . . . . . . . . . . . . . . .

6.

Теорема сложения вероятностей . . . . . . . . . . . . . . .

7.

Формула полной вероятности и формула Байеса . . . . .

8.

Последовательность испытаний Бернулли. Биномиальный закон распределения вероятностей. Закон распределения вероятностей Пуассона . . . . . . . . . . . . . . .

9.

Полиномиальное распределение вероятностей . . . . . . .

10. Вероятностные производящие функции . . . . . . . . . .

3

3

5

5

6

8

11

12

13

15

16

2 Произвольное пространство элементарных событий.

Случайные величины и векторы

1.

Аксиомы теории вероятностей. Вероятностное пространство . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

2.

Свойства вероятности . . . . . . . . . . . . . . . . . . . .

3.

Способы задания вероятностных мер на измеримом пространстве (R1 , B(R1 )) . . . . . . . . . . . . . . . . . . . .

4.

Случайные величины . . . . . . . . . . . . . . . . . . . .

5.

Способы задания вероятности на измеримом пространстве (Rn , B(Rn )) . . . . . . . . . . . . . . . . . . . . . . .

6.

Случайный вектор и его распределение на измеримом

пространстве (Rn , B(Rn )) . . . . . . . . . . . . . . . . . .

7.

Независимость случайных величин . . . . . . . . . . . .

. 38

. 40

3 Числовые характеристики распределения случайных

величин

43

1

18

. 18

. 21

. 24

. 32

. 36

1.

2.

3.

4.

5.

6.

Математическое ожидание случайной величины . . . .

Дисперсия случайной величины . . . . . . . . . . . . . .

Матрица ковариаций случайного вектора . . . . . . . .

Коэффициент корреляции случайной величины . . . .

Моменты случайных величин произвольных порядков .

Законы распределения функций случайных величин . .

4 Характеристические функции. Предельные теоремы

1.

Производящие функции. Факториальные моменты . . .

2.

Характеристические функции случайных величин . . .

3.

Типы сходимости последовательностей случайных величин . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

4.

Закон больших чисел . . . . . . . . . . . . . . . . . . . .

5.

Центральная предельная теорема . . . . . . . . . . . . .

2

.

.

.

.

.

.

43

46

48

50

52

54

61

. 61

. 65

. 71

. 72

. 75

Глава 1

Исчисление вероятностей

случайных событий

§1

Соотношение между случайными событиями

Пусть имеется фиксированный комплекс условий, воспроизводимый

любое количество раз, в том числе и неограниченное.

Определение. Комплекс испытаний будем называть экспериментом.

Определение. Явления в результате испытаний обозначим как события.

Рассмотрим связанную с этим комплексом условий систему событий.

{A, B, C, . . . }, {A1 , A2 , . . . , An }

Соотношения между событиями

1. U — достоверное событие, в результате испытаний происходит

всегда.

2. V — невозможное событие, никогда не происходит.

3. Сумма событий (

n

P

Ai ) — событие, происходящее тогда и толь-

i=1

ко тогда, когда происходит хотя бы одно из связанных событий.

4. Произведение событий (

n

Q

Ai ) — событие, происходящее тогда

i=1

и только тогда, когда происходят все из связанных событий.

5. Событие A — частный случай события B, если с появлением A

появляется и B (A ⊂ B). Если A влечёт B и B влечёт A, то

события A и B равносильны (A = B).

3

Доказательство. A ⊂ B ⇒ A · B = A, A + B = B. B = A ⇒ B + A =

A, A + A = A.

6. Ā — противоположное событие, если оно происходит только

тогда, когда A не происходит.

(

A · Ā = V

A, Ā противоположны ⇔

A + Ā = U

7. События A и B называются несовместными, если их одновременное появление невозможно.

A·B =V

8. Разность событий A и B состоит в том, что A происходит, а B

нет. (A − B).

Свойства событий

Коммутативность. A + B = B + A, A · B = B · A

Ассоциативность. A + (B + C) = (A + B) + C, A · (B · C) = (A · B) · C

Дистрибутивность. (A + B) · C = A · C + B · C, A + B · C = (A + B) ·

(A + C)

Некоторые тождества

1. A + A · B = A

Доказательство. Самостоятельно.

2. A + B = A + Ā · B

Доказательство. Самостоятельно.

3. Формула инверсий (законы Де Моргана).

(A · B) = A + B, можно обобщить до

n

Q

Ai =

i=1

(A + B) = A · B, можно обобщить до

n

P

i=1

n

P

Ai

i=1

Ai =

n

Q

Ai

i=1

События A1 . . . An образуют полную группу событий, если при каждом испытании произойдёт хотя бы одно из них.

4

Пример. A, A — полная группа.

Пример. Событие Ak — событие A произошло k раз в серии из n

испытиание. Тогда A0 , . . . , An — полная группа.

§2

Классическое определение вероятности

Пусть результат испытания — одно из попарно несовместных образующих полную группу равновозможных событий. Такая группа называется элементарной, а её результат — элементарным исходом.

E1 , . . . , En — элементарные события ⇔ Ek ·Ei = V, где i, k = 0, 1, . . . , n,

n

P

i ̸= k, при этом

Ei = U

i=1

Определение. En называется благоприятствующим для некоторого

события A, если En влечёт A.

Определение. Вероятностью появления события A будем называть

отношение числа элементарных благоприятных событий m к числу

исходов n.

m

P(A) =

n

Замечание. При расчёте вероятности события A по формуле (1) выбор системы элементарных событий можно произвести различными

способами.

Следствие. P(U ) = 1, P(V ) = 0.

Следствие. ∀A

§3

0 ⩽ P(A) ⩽ 1.

Вероятность и относительная частота

Определение. Пусть при одних и тех же условиях произведено N

испытаний, в результате которых интересующее событие произошло

M раз.

Относительной частотой появления события A назовём число

M

N

Относительная частота является величиной, рассчитываемой по факту произошедшего эксперимента, и, вообще говоря, не является оценкой вероятности, однако при достаточно большом количестве испытаний относительную частоту можно считать приближённо равной вероятности этого события. Очевидно, что

P̃(A) =

P̃(V ) = P(V ) = 0,

5

P̃(U ) = P(U ) = 1.

Но из равенства P̃(A) = 0 не следует, что P(A) = 0, как и в случае с

P̃(A) = 1.

X

= lim M .

X

P(A) = lim

P̃(A)

X

X N →∞ N

n→∞ X

При увеличении числа опытов отклонения (большие) относительной

частоты P̃(A) от вероятности P(A) будут попадаться реже. На практике относительная частота P̃(A) может быть принята за вероятность

P(A) при достаточно большом количестве испытаний.

§4

Геометрические вероятности

Пусть χ0 — номинальный размер некоторой детали. С учётом погрешности изготовления этой детали реальный размер χ ∈ (χ − 4; χ + 4).

Получено несчётное пространство, и классическое определение вероятности, заданное для счётных пространств событий, не может быть

использовано для вычислений в данном случае.

Геометрический подход

Пусть имеется ограниченное евклидово множество, имеющее объём.

Рассмотрим S — систему подмножеств исходного множества Ω, имеющих объём. Положим

∀A ∈ S

Тройка объектов Ω, S, P

бросают в область Ω.

P(A) =

|A|

|Ω|

служит моделью задач, в которых точку

При этом вероятность того, что некоторая точка попала в область A,

пропорциональна объёму A.

Парадоксы

• Геометрическая вероятность попадания в какую-либо точку отрезка равна нулю. То есть, вероятность невозможного события

равна нулю, однако обратное не является верным.

• Взаимно однозначное преобразование может существенно изменить вероятность.

6

Парадокс Бертрана

Для некоторой окружности случайно выберем хорду. Найдём вероятность того, что хорда длиннее стороны правильного треугольника,

вписанного в эту окружность. A — интересующее нас событие.

Метод «случайного центра». Выберем наудачу произвольную точку внутри круга и построим хорду с центром в выбранной точке. Хорда длиннее стороны равностороннего треугольника, если выбранная

точка находится внутри круга, вписанного в треугольник. Площадь

вписанного круга есть 1/4 от площади большего, значит, исходная

вероятность равна 1/4.

Рисунок 1.1. Случайные хорды, выбранные в случае 1.

2

P(A) =

π R4

1

= .

πR2

4

Метод «случайных концов». Наудачу выберем две точки на окружности и проведём через них хорду. Чтобы посчитать искомую вероятность, представим, что треугольник повёрнут так, что одна из его

вершин совпадает с концом хорды. Заметим, что если другой конец

хорды лежит на дуге между двумя другими вершинами треугольника,

то длина хорды больше стороны треугольника. Длина рассмотренной

дуги равна трети длины окружности, следуя классическому определению, искомая вероятность равна 1/3.

Рисунок 1.2. Случайные хорды, выбранные в случае 2.

P(A) =

2π R3

1

= .

2πR

3

7

Метод «случайного радиуса». Зафиксируем радиус окружности,

наудачу выберем точку на радиусе. Построим хорду, перпендикулярную зафиксированному радиусу, проходящую через выбранную точку. Для нахождения искомой вероятности представим, что треугольник повёрнут так, что одна из его сторон перпендикулярна зафиксированному радиусу. Хорда длиннее стороны треугольника, если её

центр ближе к центру, чем точка пересечения треугольника с зафиксированным радиусом. Сторона треугольника делит пополам радиус,

следовательно вероятность выбрать хорду длиннее стороны треугольника — 1/2.

Рисунок 1.3. Случайные хорды, выбранные в случае 3.

P(A) =

R

2

R

=

1

.

2

Возможны различные выборы равномерным образом, и каждый метод

использует свой выбор.

§5

Условная вероятность. Теорема умножения вероятностей. Независимость событий

Пусть A, B — события, при этом B ̸= V .

Определение. Вероятность A, вычисляемая при условии, что B произошло, называется условной вероятностью A относительно B.

P(A | B)

Если P(A | B) = P(A), то A не зависит от B. В противном случае A

зависит от B.

Теорема умножения вероятностей

Рассмотрим систему n элементарных событий {Ei }i=1,2,...,n . Событию

A благоприятствуют m элементарных событий, событию B — k собы8

тий, A · B — l событий (m, k, l ⩽ n). Тогда

P(A) =

m

k

l

, P(B) = , P(A · B) = .

n

n

n

P(B | A) =

l

=

m

P(A | B) =

l

n

m

n

l

n

k

n

=

P(A × B)

,

P(A)

, то есть

P(A × B) = P(A) · P(B | A) = P(B) · P(A | B)

Установлена теорема умножения двух любых событий, хотя бы одно

из которых является возможным.

Пусть A не зависит от B. Тогда

*

P(A) · P(B | A) = P(B) · P(A) ⇒ B не зависит от A

Независимость событий

Определение. Два события A и B независимы ⇔ P(A · B) = P(A) ·

P(B) (также верно, если одно из событий является невозможным).

Пример. Пусть имеется колода из 36 карт, из неё случайным образом

вытаскиваем одну карту. Пусть событие A – «вытянут A (туз)», событие B – «вытянута карта масти ♦». Тогда событие A · B – вытянута

карта ♦A.

1

9

1

4

= , P(B) =

= ,

P(A) =

36

9

36

4

1

P(A · B) =

36

Приведём теорему об умножении n любых событий, хотя бы одно из

которых возможно

P(A1 · . . . · An ) = P(A1 ) · P(A2 | A1 ) · P(A3 | A1 · A2 ) · . . .

. . . · P(An |

n−1

Y

Ak )

k=1

Доказательство. Самостоятельно.

P(A1 · A2 · A3 ) = P(A1 · A2 ) · P(A3 | A1 · A2 ) =

= P(A1 ) · P(A2 | A1 ) · P(A3 | A1 · A2 )

9

Попарная независимость событий

P(A1 · A2 ) = P(A1 ) · P(A2 )

P(A1 · A3 ) = P(A1 ) · P(A3 )

P(A2 · A3 ) = P(A2 ) · P(A3 )

При независимости событий (в совокупности):

P(A1 · A2 · A3 ) = P(A1 ) · P(A2 ) · P(A3 )

Парадокс Бернштейна

Рассмотрим испытание, в результате которого бросаются две монеты.

Пусть

• событие A – «на первой монете выпал орёл»,

• событие B – «на второй монете выпал орёл»,

• событие C – «только на одной монете выпал орёл».

Установим систему элементарных событий Ω, равную {О–О, Р–Р, Р–

О, О–Р}.

1

P(A) = P(B) = P(C) =

2

1

P(A · B) = = P(A) · P(B),

4

1

P(A · C) = = P(A) · P(C),

4

1

P(B · C) = = P(B) · P(C).

4

P(A · B · C) = 0 ̸= P(A) · P(B) · P(C)

Вывод: попарная независимость (5) ⇒

независимость в совокупности

(5).

События независимы в совокупности ⇔ (5) и (5) выполняются.

Определение. A1 , . . . , An независимы в совокупности, если

P(Ai1 · . . . Aik ) = P(Ai1 ) · . . . · P(Ain ), где

1 ⩽ i1 < i 2 < . . . < i k ⩽ n

2n − Cn1 − Cn0 – число соотношений для проверки независимости событий в совокупности. Если нам заранее известно, что A1 , . . . , An независимы в совокупности, то

P(

n

Y

Ak ) =

n

Y

k=1

k=1

10

P(Ak )

§6

Теорема сложения вероятностей

Рассмотрим события A и B.

• A – m элементарных событий из n,

• B – k элементарных событий из n,

• A · B – l элементарных событий из n.

m+k−l

= P(A) + P(B) − P(A · B)

n

Установлена теорема о сложении двух любых событий.

Для несовместных событий:

P(A + B) =

A · B = V ⇒ P(A + B) = P(A) + P(B)

Если B = A, то

P(A + A) = P(A) + P(A) ⇒ P(A) = 1 − P(A)

| {z }

P(U )=1

По теореме о сложении:

P(A1 + A2 + A3 ) = P(A1 + A2 ) + P(A3 )−

− P((A1 + A2 ) · A3 ) = P(A1 ) + P(A2 ) + P(A3 )−

− P(A1 · A2 ) − P(A1 · A3 ) − P(A2 · A3 )+

+ P(A1 · A2 · A3 )

Обобщённая формула:

P(

n

X

Ak ) =

P(Ak ) −

n−2

X n−1

X

n−1

X

n

X

P(Ak · Aj )+

k=1 j=k+1

k=1

k=1

+

n

X

n

X

P(Ak · Aj · Ai ) − . . .

k=1 j=k+1 i=j+1

. . . + (−1)n−1 · P(

n

Y

Ak )

k=1

Для попарно несовместных событий:

Ai · Aj = V ⇒ P(

i̸=j

n

X

k=1

11

Ak ) =

n

X

k=1

P(Ak )

Если A1 , . . . , An независимы в совокупности, то справедлива следующая формула:

P(

n

X

Ak ) = 1 − P(

k=1

=1−

n

X

Ak ) =

k=1

k=1

n

Y

n

Y

Ak ) = 1 − P(

P(Ak ) = 1 −

k=1

n

Y

(1 − P(Ak )).

k=1

Если вероятности исходных событий не зависят от номеров и определяются только числом сомножителей, то

P(

n

X

Ak ) = Cn1 P(A1 ) − Cn2 P(A1 · A2 )+

k=1

n

Y

+ Cn3 P(A1 · A2 · ·A3 ) − . . . + (−1)n−1 Cnn P(

Ak )

k=1

Доказательство. Самостоятельно.

P(

n

Y

Ak ) =

k=1

+

n−2

X n−1

X

n

X

P(Ak ) −

n−1

X

k=1

n

X

n

X

P(Ak + Aj )+

k=1 j=k+1

P(Ak + Aj + Ai ) − . . . + (−1)n−1 P(

k=1 j=k+1 i=j+1

n

X

Ak )

k=1

Доказательство. Самостоятельно.

§7

Формула полной вероятности и формула Байеса

Формула полной вероятности

Пусть имеется n попарно несовместных событий, составляющих полную группу, H1 , . . . , Hn — назовём их гипотезами.

•

n

P

Hi = U ,

i=1

• Hi · Hj = V, где i, j = 1, 2, . . . , n, при этом i ̸= j.

В силу попарной несовместности

n

n

X

X

P(

Hi ) =

P(Hi ) = 1

i=1

i=1

12

Рассмотрим событие A:

A=U ·A=

n

X

!

Hi

·A=

n

X

i=1

P(A) = P(

n

X

Hi · A) =

i=1

n

X

Hi · A

i=1

P(Hi · A) =

| {z }

i=1 a posteriori

зав. от опыта

n

X

P(Hi ) · P(A | Hi )

i=1

|

{z

a priori

}

не зав. от опыта

Формула полной вероятности.

P(A) =

n

X

P(Hi ) · P(A | Hi )

i=1

Формула Байеса

Получим формулу Байеса:

P(A · Hk ) = P(A) · P(Hk | A) = P(Hk ) · P(A | Hk )

P(Hk | A) =

P(Hk ) · P(A | Hk )

P(Hk ) · P(A | Hk )

= P

n

P(A)

P(Hi ) · P(A | Hi )

i=1

Формула Байеса.

P(Hk ) · P(A | Hk )

P(Hk | A) = P

n

P(Hi ) · P(A | Hi )

i=1

§8

Последовательность испытаний Бернулли. Биномиальный закон распределения вероятностей. Закон распределения вероятностей Пуассона

Последовательность испытаний Бернулли

Пусть производится серия из n испытаний, имеется k исходов. Исходы

образуют полную группу событий и являются попарно независимыми

событиями. В рамках данного параграфа k = 2.

13

Определение. Испытания независимы, если все исходы этих испытаний независимы в совокупности.

Определение. n испытаний образуют последовательность испытаний Бернулли, если

1. Они независимы

2. У каждого из этих испытаний 2 исхода: { A ,

A }

успех неудача

3. Вероятность появления исхода во всех испытаниях не изменяется.

Ai – появление A в i-ом испытании. Тогда

P(Ai ) = p ⇒ P(Ai ) = 1 − p = q

∀i = 1, 2, . . . , n

Пусть имеется n испытаний с k = 2 исходами. Bm — событие A произошло m раз, 0 ⩽ m ⩽ n.

m

}|

{

z

Bm = A1 · A2 · . . . · Am−1 · Am ·Am+1 · . . .

m

z

}|

{

. . . · An + . . . + A1 · A2 · · · · · An−m · An−m+1 · . . . · An .

{z

}

|

n−m

Число

Будем

слагаемых — Cnm .

обозначать P(n)

m =

P(Bm ).

Формула Бернулли

m m n−m

P(n)

m = Cn p q

n

X

n

P(n)

m = (p + q) = 1

m=0

Рассмотрим вероятность того, что в n испытаниях Бернулли событие

A произойдёт не менее m раз.

n

Rm

=

n

X

(n)

Pk

=1−

k=m

m−1

X

(n)

Pk

k=0

Пример. Вероятность того, что при n испытаний A произойдёт хотя

бы 1 раз:

(n)

(n)

R1 = 1 − P0 = 1 − q n

14

Закон распределения вероятностей Пуассона

Рассмотрим последовательность испытаний Бернулли, когда число испытаний n → ∞, при этом p = P(Ai ) → 0, np = a — константа

Pm ≡ lim Cnm pm (1 − p)n−m

n→∞

p=

a

n

n! am (1 − na )n

am −a

=

· e , m = 0, 1, 2, . . .

a

n→∞ (n − m)! m! nm (1 − )m

m!

n

Pm = lim

Закон распределения вероятностей Пуассона

(редких событий)

∞

X

Pm =

m=0

∞

X

am −a

·e =1

m!

m=0

Пример. Пусть n — число атомов в веществе, время распада — 1

секунда. Тогда p ≈ 10−12 .

§9

Полиномиальное распределение вероятностей

Пусть имеется n испытаний с k ⩾ 2 исходами. A1 , . . . , Ak — исходы.

• Ai · Aj = V , где i ̸= j, i, j = 1, 2, . . . , k

•

k

P

Ai = U

i=1

• p1 , . . . , pk — вероятности исходов. От испытания к испытанию не

k

P

изменяются,

pi = 1, где ∀i pi ≥ 0

i=1

Через P(n)

m1 ,...,mk обозначим вероятность того, что события A1 , . . . , Ak

будут происходить соответственно m1 , . . . , mk раз,

k

X

mi = n,

mi ⩾ 0,

mi ∈ Z.

i=1

k = 2: P(n)

m1 ,m2 =

m1

n!

m1 ! m2 ! p1

2

· pm

2

mk

m1

m2

n!

k ⩾ 2: P(n)

m1 ,...,mk = m1 !...mk ! · p1 · p2 · . . . · pk

Любое событие представимо в виде суммы несовместных. Пусть

Ak = A’k + A’k+1 , A’k · A’k+1 = V

15

p’k + p’k+1 = pk ,

m’k + m’k+1 = mk ,

m′

k+1

P ’km’k · P ’k+1

=1

m’k

Cm

k

}|

{

z

mk !

m’

=

· C k+1

mk − m’k

m’k ! m’k+1 !

| {z }

m’k+1

k

P

Тогда ∀i : mi ⩾ 0, mi ∈ Z;

mi = 0 :

i=1

Полиномиальный закон распределения вероятностей

P(n)

m1 ,...,mk =

§10

n!

m’k+1

m’k

2

· pm1 · pm

· p’k+1

2 · · · · · p’k

m1 ! . . . m’k ! m’k+1 ! 1

Вероятностные производящие функции

Производящие функции можно определить для любой числовой последовательности (имея в виду счётный набор).

Определение. Производящей функцией числовой последовательности называется сумма ряда:

∞

X

ak uk , где a0 , . . . , ak — числовой ряд, u ∈ R

k=0

если такой ряд сходится.

{pi }i=0,1,... : pi ⩾ 0, ∀i :

∞

X

pi = 1

i=0

Производящая функция:

G(u) =

∞

X

pi ui

i=0

1 di G(u)

pi = ·

i!

dui

u=0

Между соотношениями закона распределения (10) и (10) устанавливают взаимно однозначное соответствие.

Пример. B[n, p] — биномиальное распределение.

n

P

G(u) =

Cnm · pm · q n−m · um = (pu + q)m .

m=0

16

Пример. P [a] — закон Пуассона.

∞

P

am e−a m

au

G(u) =

· e−a .

m! u = e

m=0

Пусть имеется n испытаний, k > 2 исходов

X

mk

m1

Gn (u1 , . . . , uk ) =

P(n)

m1 ,...,mk · u1 · . . . · uk

ui ∈R

m1 ,...,mk :

k

P

mi =n

i=1

mi ⩾0,mi ∈Z

Если имеется n1 + n2 = n испытаний, то выполняется мультипликативное свойство

Gn1 +n2 (u) = Gn1 (u) · Gn2 (u).

Пример. B[n, p] — биномиальный закон распределения вероятностей.

G1 (u) = q + pu, Gn (u) = (q + pu)n

G(u) =

n

Y

(pi u + qi )

i=1

Пусть p1 , . . . , pn — все разные, qi = 1 − pi . Как определить производящие функции для такой последовательности разных испытаний?

17

Глава 2

Произвольное пространство

элементарных событий.

Случайные величины и

векторы

§1

Аксиомы теории вероятностей. Вероятностное

пространство

Определение. Пусть Ω = {ω}. Набор подмножеств Ω A называется

алгеброй, если

1. Ω ∈ A

A ⊂ Ω, B ⊂ Ω

)

⇒ A + B ∈ A, A · B ∈ A

A ∈ A, B ∈ A

)

A⊂Ω

3.

⇒A∈A

A∈A

2.

Определение. Набор подмножеств исходного множества Ω = {ω} —

F называется σ-алгеброй, если он является алгеброй и:

A1 , A2 , . . . , Ai , . . . Ak ⊂ Ω ∀k,

Ai ∈ F ⇒

∞

X

Ai ∈ F ,

i=1

∞

Y

i=1

Аксиомы Колмогорова

Ω, F, P — измеримое пространство.

18

Ai ∈ F .

1. Аксиома алгебры событий. Заданы множества элементарных

событий Ω = {ω}. На Ω выделена σ-алгебра F, её элементы —

случайные события.

2. Аксиома существования алгебры событий. Любому случайному событию A ∈ F сопоставлено неотрицательное число,

называемое вероятностью этого события, ∀A ∈ F : P(A) ≥ 0.

3. Аксиома нормированности. P(Ω) = 1.

4. Аксиома аддитивности вероятности. Если

A, B ∈ F , A × B = ∅ ⇒ P(A + B) = P(A) + P(B).

Следствие. A1 , . . . , An ∈ F : Ai × Aj ̸= ∅, i ̸= j, i, j = 1, 2, . . . , n

n

n

P

P

⇒ P( Ai ) =

P(Ai ).

i=1

i=1

5. A1 , . . . , An , . . . , Ai ∈ F : Ai Aj = ∅ (попарно несовместны) ⇒

P(

∞

P

i=1

Ai ) =

∞

P

i̸=j,i,j=1,2,...

P(Ai ).

i=1

P – нормированная счётно-аддитивная мера

Рассмотрим монотонную случайную последовательность событий

A1 , . . . , A n , . . .

∀n∈N

A1 ⊂ A2 ⊂ · · · ⊂ An ⊂ . . . , An ⊂ An+1

∀n∈N

A1 ⊃ A2 ⊃ · · · ⊃ An ⊃ . . . , An ⊃ An+1

Тогда

A=

∞

X

Ai = lim An — предел (1).

n→∞

i=1

A=

∞

Y

Ai = lim An — предел (1).

i=1

n→∞

Определение. Функция событий Q(A) называется непрерывной, если для любой монотонной последовательности случайных событий выполняется равенство

lim Q(An ) = Q( lim An )

n→∞

n→∞

5′ . Аксиома непрерывности. Пусть An — монотонно убывающая

последовательность случайных событий.

19

[An ↓ ∅] ⇔ An+1 ⊂ An , n = 1, 2, . . . (

n

Q

Ai = ∅ — предел невозмо-

i=1

жен). Тогда

lim P(An ) = 0.

n→∞

Теорема. Вероятность является непрерывной функцией событий.

Доказательство. Из аксиомы (5) ⇒ (5’)

Пусть Bn ↓ ∅, An = Bn · Bn+1 , где n = 1, 2, . . .

B1 =

∞

X

Ak , B n =

k=1

Ak ,

k=n

P(B1 ) = P(

∞

X

Ak ) =

k=1

P(Bn ) = P(

∞

X

∞

X

Ak ) =

k=n

∞

X

P(Ak )

k=1

∞

X

k=n

|

P(Ak ) → 0

{z

n→∞

}

lim P(Bn ) = 0

n→∞

Из аксиомы (5’) ⇒ (5)

Пусть имеется множество попарно несовместных

{An }n=1,2,... .

∞

∞

X

X

Bn =

Ak , A =

Ak

k=n+1

событий

k=1

A = A1 + . . . + An + B n

P(A) =

n

X

k=1

P(Ak ) + P(Bn )

| {z }

→0

Bn+1 ⊂ Bn

Bn ⇒ Ai , i > n ⇒ Ai+1 не наступило ⇒ не наступило Bi , . . .

∞

Y

Bi = 0

i=1

20

§2

Свойства вероятности

1. Вероятность невозможного события P(∅) = 0

Доказательство. ∅ + Ω = Ω

1 = P(Ω) = P(∅ + Ω)

(акс. 4)

P(∅) + P(Ω) = 1

| {z }

=

=1

2. P(A) = 1 − P(A)

Доказательство.

1 = P(Ω) = P(A + A)

(акс. 4)

P(A) + P(A) = 1

=

3. A ⊂ B ⇒ P(A) ⩽ P(B)

A⊂B

Доказательство. B = A × B + A × B = A + A × B

P(B) = P(A + A × B)

(акс. 4)

=

P(A) + P(A × B)

4. P(A + B) = P(A) + P(B) − P(A × B)

Доказательство.

A + B = A + A × B, B = A × B + A × B ⇒

P(A + B)

(акс. 4)

=

P(A) + P(A × B)

P(B) = P(A × B) + P(A × B)

5. P(A + B) ⩽ P(A) + P(B)

Также можно показать, что:

P(

n

X

Ak ) ⩽

k=1

P(

∞

X

n

X

P(Ak )

k=1

Ak ) ⩽

∞

X

k=1

k=1

21

P(Ak )

6. A1 , . . . , An :

P(

n

X

Ak ) =

k=1

n

X

P(Ak ) −

k=1

n−1

X

n

X

P(Ak × Aj ) + . . .

k=1 i=k+1

. . . + (−1)n−1 · P(

n

Y

Ak )

k=1

Пусть B =

n+1

P

Ak . Тогда

k=1

n+1

X

P(

Ak ) = P(An+1 +

k=1

n

X

Ak )

k=1

7. Теорема. Пусть имеется n равновозможных попарно

несовместных и составляющих полную группу событий,

n

P

{E1 , . . . , En }Ei ×Ej =∅,i̸=j ,

Ei = Ω. Из них k благоприятствуют

i=1

i,j=0,1,...

событию A. Тогда

P(A) =

Доказательство. A =

k

P

k

n

Eis

s=1

1 = P(

n

X

Ei )

i=1

(акс. 4)

=

n

X

P(Ei ) = n · P(Ei ), P(Ei ) =

i=1

1

n

k

k

X

k

(акс. 4) X

P(Eis ) =

Eis ) =

P(A) = P(

n

s=1

s=1

Ω = {E1 , . . . , En }, F = {A = Ei1 + . . . + Eik }, k ⩽ n

P(A) =

k

n

8. 0 ⩽ P(A) ⩽ 1, A ∈ F

0 ⩽ P(A) = 1 − P(A) ⇒ P(A) ⩽ 1

Для условных вероятностей:

def

P(A|B) =

22

P(A × B)

P(B)

P(B) > 0

P(Ω|B) =

P(Ω × B)

P(B)

=

= 1.

P(B)

P(B)

Аксиома нормированности выполнена.

Пусть A1 , . . . , An , . . . — не более чем счётный набор, Ai × Aj =

∅, i ̸= j; i, j = 1, 2, . . . , n

Пусть также имеется событие B, P(B) > 0.

P

! P((P A ) × B)

P(An × Bn )

n

X

n

An |B =

P

= n

=

P(B)

P(B)

n

(акс. 4,5)

=

X

P(An |B)

n

9. F∗ = {∅, Ω} — наименьшая σ-алгебра, F ∗ = {A : A ⊆ Ω} —

наибольшая σ-алгебра.

Пусть имеется n испытаний в эксперименте с подбрасыванием

монет. Построим измеримое пространство

Ω = {О, Р}, F ∗ : {О}, {Р}, {О + Р}, ∅

Зададим вероятности событий (О — орёл, Р — решка)

P(О) = p, P(Р) = q : p + q = 1.

Создано вероятностное пространство.

В случае несчётного пространства элементарных событий набор всех подмножеств элементарных событий и построенная σалгебра не будет удовлетворять испытанию, чтобы задать вероятность на этом множестве.

Можем основываться на определённом наборе подмножеств Ω.

Определение. Наименьшая σ-алгебра, содержащая заданный

класс подмножеств Ω, называется σ-алгеброй, порождаемой

этим классом.

Пример. Ω = [0, 1]. Пусть σ-алгебра F составляет все подмножества, для которых можно определить длину, {ω} — точки отрезка [0, 1].

A ∈ F : P(A) = µ(A) — длина некоторого отрезка, мера

При не более чем счётном пространстве событий мы говорим о

дискретных пространствах. В противном случае — о непрерывно

измеримых.

23

§3

Способы задания вероятностных мер на измеримом пространстве (R1 , B(R1 ))

R1 = (−∞; +∞) — вещественная прямая. Рассмотрим на R1 интервал

такого вида:

{(a, b] = {x ∈ R1 |a < x ⩽ b}}

−∞ ⩽ a < b < +∞

Рассмотрим множество таких интервалов.

Определение. Наименьшая σ-алгебра, содержащая систему вида

(*), называется борелевской алгеброй множеств вещественной прямой.

Определение. Борелевские множества – элементы B(R1 ). Они же и

являются событиями.

Заметим, что интервалы

(a, b) =

X

(a, b −

n

Отрезки:

[a, b] =

Например, точка a:

{a} =

1

]

n

Y

1

(a − , b]

n

n

Y

(a −

n

1

, a]

n

Остановимся на рассмотрении (a, b], хотя и другие виды ведут к той

же борелевской алгебре.

Построим вероятностное пространство на основе этого измеримого

пространства. Пусть P – вероятность, заданная на борелевском множестве. Возьмём борелевское множество:

B = (−∞, x], x ∈ R1

Положим

F (x) = P{(−∞, x]}

Так определённая функция, оказывается, обладает следующими свойствами:

1. F (x) монотонно не убывает на R1 .

24

Доказательство. Пусть x1 < x2 . Тогда соответствующее событие

(−∞, x1 ] ⊂ (−∞, x2 ] ⇒ P{(−∞, x1 ]} ⩽ P{(−∞, x2 ]}

Итак, функция монотонно неубывающая

F (x1 ) ⩽ F (x2 ), ∀x1 , x2 ∈ R1 , x1 < x2

2. Пусть

lim F (x) = F (−∞),

x→−∞

lim F (x) = F (+∞), тогда

x→+∞

F (−∞) = 0, F (∞) = 1.

Доказательство. В силу монотонности предел функции существует. Докажем, что F (−n) → 0.

n=1,2,... n→∞

Рассмотрим последовательность событий:

{Bn = (−∞, −n]}

Bn+1 ⊂ Bn

Q

Bn ↓ ∅

lim Bn = Bn = ∅

n→∞

n

Для этой последовательности (по акс. непрерывности)

lim P(Bn )

n→∞ | {z }

F (−n)

=0

3. F (x) непрерывна справа и имеет предел слева ∀x ∈ R1

lim F (y) = F (x − 0), lim F (y) = F (x + 0)

y↑x

y↓x

Тогда ∀x ∈ R1 : F (x + 0) = F (x), F (x) − F (x − 0) ⩾ 0.

Доказательство. Рассмотрим монотонную последовательность

xn ↓ x. Введём последовательность событий

{ Bn

n=1,2,...

= (−∞, xn ]}, B = (−∞, x]

Рассмотрим предел {Bn }n=1,2,...

Y

Bn = B

n

25

Перейдём к вероятностям:

lim P(Bn ) = P( lim Bn ) = P(B)

n→∞

n→∞

P(B) = F (x) ⇒ lim F (xn ) = F (x)

n→∞

Определение. Любая функция, удовлетворяющая условиям (1, 2, 3),

называется функцией распределения на вещественной прямой.

Оказывается, что распределение вероятности имеет не более чем счётное количество скачков (разрывов функции). Функция распределения

может иметь не более

• 1 скачка размером 12 ,

• 2 скачков размером 14 ,

• n скачков размером

1

2n .

Функция распределения непрерывна ⇔ вероятность точечного события равна нулю.

∀x ∈ R1 : F (x) непрерывна ⇔ P({x}) = 0

Доказательство.

F (x) − F (x − 0) = lim (F (x) − F (x −

n→∞

1

)) =

n

1

]}]

n

Представим как сумму двух несовместных событий

= lim [{P(−∞, x] − P(−∞, x −

n→∞

(−∞, x −

1

1

] + (x − , x]

n

n

1

1

]} + P{(x − , x]

n

n

Y

1

1

lim P{(x − , x]} = P{ (x − , x]} = P{x}.

n→∞

n

n

n

P{(−∞, x]} = P{(−∞, x −

Итак, F (x) − F (x − 0) = P{x}.

{(a, b]}, −∞ ⩽ a < b < +∞

В зависимости от выбора вида интервала свойства (1, 2, 3) изменяются

подобно изменению интервала.

26

Теорема. Пусть F (x) — некоторая функция распределения. Тогда на

измеримом пространстве (R1 , B(R1 )) ∃ ! вероятностная мера P , такая,

что

P : −∞ ⩽ a < b < +∞

P {(a, b]} = F (b) − F (a)

Соотношения (3) и (3) устанавливают взаимно однозначное соответствие между функцией распределения и вероятностной мерой.

Теорема. (Каратеодори). Пусть имеется вероятностное пространство

в широком смысле (Ω, A, P ). Тогда существует единственная вероятностная мера Q на σ-алгебре F = σ(A) — порождённая A, что:

Q(A) = P (A), A ∈ A.

Следствие. Любое вероятностное пространство в широком смысле

автоматически определяет вероятностное пространство.

Из этого следует, что для определения вероятности достаточно задать

вероятности интервалов.

Рассмотрим алгебру, элементами которой является сумма непересекающихся интервалов.

A:A=

n

X

(ak , bk ], ak < bk

k=1

На этих множествах определим функцию множеств

P0 (A) =

n

X

[F (bk ) − F (ak )] (вероятности интервалов)

k=1

Проверим выполнение аксиом

• Акс. 2, 3, 4 выполняются, что почти очевидно.

• Акс. 5 также выполняется, см [1].

σ(A) = B(R1 )

Итак, для любой функции распределения существует единственная

вероятностная мера. Таким образом строим вероятностное пространство (R1 , B(R1 ), P ).

27

Меры на измеримых пространствах

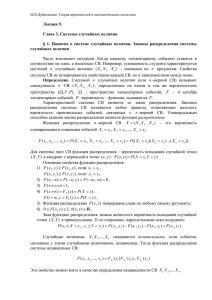

Дискретные вероятностные меры

Пусть F (x) — функция распределения x1 < x2 < . . . < . . .

∆F (x) = F (x) − F (x − 0),

P(xk ) = ∆F (xk ), k = 1, 2, . . .

X

P(xk ) = 1

k

Представим иллюстрацию ситуации

1

F(x)

Pk

P2

P1

{

{

{

x1

x2

x

Рисунок 2.1. Дискретный закон распределения вероятностей.

Такой набор чисел называется дискретным законом распределения вероятностей на вещественной прямой.

Пример. {Pk =

1

N}

— дискретный равномерный закон, k = 1, . . . , N

Пример. {p1 , p2 } : p1 = 1 − p2 — бернуллиевское дискретное распределение (часто обозначают как p, q).

Пример. {P(n)

m }m=0,1,...,n , n — число испытаний, p — вероятность появления успеха в каждом испытании.

m

n−m

m

— биномиальное дискретное распределение.

P(n)

m = Cn · p · (1 − p)

m

Пример. Pm = am! ·e−a , a ∈ R, a > 0, m = 0, 1, . . . — дискретный закон

распределения Пуассона.

28

Абсолютно непрерывные вероятностные меры

Пусть F (x) непрерывна ∀x ∈ R, при этом существует вещественная

неотрицательная кусочно-непрерывная функция плотности распределения вероятностей f (x):

Zx

f (x) ⩾ 0 : F (x) =

f (t)dt

−∞

В этом случае

Zb

P{(a, b]} =

f (x)dx

a

Очевидно, что если x — точка непрерывности f (x), x ∈ R, то

F ′ (x) = f (x)

Плотностью распределения может быть любая кусочно-непрерывная,

вещественнозначная функция f (x), удовлетворяющая условию нормировки

+∞

Z

f (x)dx = 1

−∞

Пример. Равномерное распределение на отрезке [a, b], a < b

f (x) =

1

, a⩽x⩽b

b−a

Если x < a или x > b, тогда

f (x) = 0.

Итак,

1 , a⩽x⩽b

f (x) = b − a

0, x < a или x > b

Пример. Распределение Гаусса (нормальное)

f (x) ∼ N (a, σ), a ∈ R, σ > 0

Тогда

(x−a)2

1

f (x) = √

·e− 2σ2

2πσ

| {z }

норм.

множитель

29

Пример. Γ-распределение

Здесь в нормирующем множителе для плотности участвует Γфункция

0, x ⩽ 0

f (x) =

αλ

· xλ−1 · e−αx , x > 0

Γ(λ)

α — параметр масштаба, λ — параметр формы.

Экспоненциальное (показательное) распределение получаем при λ =

1:

(

αe−αx , x ⩾ 0

f (x) =

0, x < 0

Сингулярные вероятностные меры на R1

Оказывается, F (x) может быть непрерывной, но не иметь плотности.

F (x) — непрерывная функция распределения, функции плотности вероятности f (x) не существует.

Пример. Канторова функция.

(

F (x) =

0, x ⩽ 0

1, x ⩾ 1

Представим, как ведёт себя функция распределения при x ∈ (0, 1)

1

F1 (x)

0.5

0

1/3

2/3

1

x

Рисунок 2.2. F1 (x) — первое приближение Канторовой функции.

30

1

F2 (x)

0.75

0.5

0.25

0

1/9

2/9

1/3

2/3

7/9

8/9

1

x

Рисунок 2.3. F2 (x) — второе приближение Канторовой функции.

Fn (x) → F (x) — Канторова функция.

n→∞

Длина интервалов, на которой Канторова функция должна быть постоянна:

∞ n

4

1 X 2

1 2

+ +

+ ... = ·

= 1.

3 9 27

3 n=0 3

f (x) почти всюду обращается в 0, за исключением, может быть, множеств меры нуль.

Функция называется сингулярной, поскольку она сингулярна по отношению к мере Лебега.

Теорема. (Лебега). Любая функция распределения в таком измеримом пространстве может быть представлена в виде:

F (x) = p1 F1 (x) + p2 F2 (x) + p3 F3 (x)

где pi ⩾ 0,

3

P

pi = 1,

i=1

• F1 (x) — дискретная функция распределения

• F2 (x) — абсолютно непрерывная функция распределения

• F3 (x) — сингулярная функция распределения

31

§4

Случайные величины

Определение. Вещественнозначная функция ξ(ω), определённая на

измеримом пространстве (Ω, F), называется случайной величиной, если

ξ : ξ(ω), ξ : Ω → R1

∀B ∈ B(R1 ) — борелевское множество из σ-алгебр B(R1 )

{ω : ξ(ω) ∈ B} ∈ F — такое множество всех элементов событий, для

которых ξ(ω) ∈ B является событием.

∀B : ξ −1 (B) = {ω : ξ(ω) ∈ B} ∈ F

Определение. Вероятностная мера Pξ на измеримом пространстве

(R1 , B(R1 )) такая, что:

def

Pξ (B) = P{ω : ξ(ω) ∈ B}

называется распределением вероятностей случайной величины ξ на

измеримом пространстве (R1 , B(R1 )).

Эту вероятность далее будем обозначать как

P{ξ ∈ B}.

Определение. ∀x ∈ R определим

Fξ (x) = P{ω : ξ(ω) ⩽ x} = Pξ {(−∞, x]}

Здесь в качестве B выступает интервал (−∞, x].

Fξ (x) — функция распределения случайной величины ξ. Обозначать

далее будем как

Fξ (x) = P{ξ ⩽ x}

Итак, каждая случайная величина порождает своё вероятностное пространство

ξ : Ω → R1 → (R1 , B(R1 ), Pξ )

Оказывается, множество пробных борелевских множеств можно существенно сузить, так как для определения вероятности достаточно

задать вероятности интервалов.

Следовательно, функция распределения случайной величины полностью определяет распределение случайной величины. По Fξ (x) можно

восстановить меру борелевского множества.

Рассмотрим типы случайных величин.

1. Если возможные значения случайной величины образуют не более чем счётное множество, то такая случайная величина называется дискретной случайной величиной.

32

ξ – дискретна, {xj — возможное значение}j=1,2,... , P{ξ = xi } = pi

— вероятности.

Можно вычислить все вероятности, связанные с ξ. B – борелевское множество, B ∈ B(R1 ), тогда

Pξ (B) = P{ξ ∈ B} = P

X

(ξ = xj ) =

j:xj ∈B

X

j:xj ∈B

P(ξ = xj )

pj

В этом случае

Fξ (x) =

X

pj — ст. функция с разрывами в xj

j:xj ⩽x

2. Случайная величина называется непрерывной, если

Zx

∃fξ (x) ⩾ 0 : Fξ (x) =

fξ (t)dt

−∞

3. Случайная величина называется сингулярной, если функция её

распределения Fξ (x) непрерывна, но функция плотности вероятности fξ (x) не существует.

Заметим, что в то время как любая случайная величина однозначно

определяет свою функцию распределения, существует сколько угодно различных случайных величин, имеющих одну и ту же функцию

распределения.

Пример. xi : −1, +1; pi : 12 , 12 ; ξi − ξ = η

33

Fξ (x)

1

0.5

−1

−0.5

0

0.5

1

x

Рисунок 2.4. Пример функции распределения.

0, x < −1

1

Fη = Fξ =

, −1 ⩽ x < 1

2

1, x ⩾ 1

Определение. Вещественнозначная функция g(x), x ∈ R называется

борелевской, если для любого борелевского множества при отображении g его полный прообраз также является борелевским множеством

g : R1 → R1 , B ∈ B(R1 ), g −1 (B) = {x, x ∈ R1 : g(x) ∈ B}

Теорема. Пусть ξ(ω) — случайная величина.

ξ(ω) : Ω → R1

g(x) : R1 → R1 — борелевская функция

Ω = {ω} — значение элементарного события. Тогда η(ω) = g(ξ(ω))

является случайной величиной.

Доказательство. B ∈ B(R1 )

{ω : η(ω) ∈ B} = {ω : g(ξ(ω)) ∈ B} = {ω : ξ(ω) ∈ g −1 (B)} ∈ F

ξ ∼ (Ω, F)

Это означает, что η(ω) — случайная величина.

Также возможно конструировать случайные величины как функции

других случайных величин.

34

Примеры случайных величин

(

• Пусть A — событие, ξ(ω) ≡ IA (ω) =

1, ω ∈ A

0, ω ̸∈ A

Задана функция-индикатор.

• Пусть испытание — бросание игральной кости. Случайная величина — число выпавших на верхней грани очков, всего возможно

6 значений, вероятность каждого – 16 . Можем задать дискретное

распределение с параметром 6.

• Распределение последовательности испытаний Бернулли. Пусть

ξi (ω) — число появления «успеха» в i-ом испытании.

(

ξi (ω) : IAi (ω) =

1, ω ∈ Ai

0, ω ̸∈ Ai

— Бернуллиевская случайная величина

Пусть Ai — в i-ом испытании «успех».

• Рассмотрим серию из n испытаний Бернулли. µn — число появления «успеха» в серии из n испытаний. Пусть p — вероятность

появления успеха в каждом из испытаний.

{P{µn = m} = Cnm pm (1 − p)n−m }m=0,...,n

• Пусть испытание — «бросание» точки в отрезок случайным образом. Ω = {ω}.

(

Ω = [a, b] a < b

F

ξ(ω) = ω

def

Fξ (x) = P{ξ ⩽ x} =

F ′ (x) =

x−a

, a ⩽ x ⩽ b, ξ ∈ [a, x]

b−a

1

, x ∈ [a, b]

b−a

x < a : Fξ (x) = 0, x > b : Fξ (x) = 1

35

Fξ (x)

1

a

b

0

x

Рисунок 2.5. Пример распределения случайной величины.

§5

Способы задания вероятности на измеримом

пространстве (Rn , B(Rn ))

R1 ×. . .×R1 — Rn — прямое произведение n экземпляров вещественных

прямых.

{x = {x1 , . . . , xn }}, ∀i : −∞ < xi < +∞

Определим пространство элементарных событий. Определим прямоугольник (объект) в Rn .

−∞ ⩽ ak < bk < +∞, k = 1, . . . , n

(a1 , b1 ] × . . . × (ak , bk ] × . . . × (an , bn ]

B1 × . . . × Bn , Bi ∈ B(R1 )

σ{(B1 × . . . × Bn )} = B(Rn )

Построим вероятностное пространство на этом измеримом пространстве. Пусть P — вероятностная мера на (Rn , B(Rn )).

Рассмотрим функцию n-мерной точки F : Rn → R1

F (x1 , . . . , xn ) = P{(−∞, x1 ] × . . . × (−∞, xn ]}

Введём разностный оператор.

∆ai bi F (x1 , . . . , xn ) = F (x1 , . . . , xi−1 , bi , xi+1 , . . . , xn )−

−F (x1 , . . . , xi−1 , ai , xi+1 , . . . , xn ), ai < bi , i = 1, . . . , n.

36

Пример. ∆a1 b1 ∆a2 b2 . . . ∆an bn F (x1 , . . . , xn ) = P{(a1 , b1 ]×. . .×(an , bn ]}

Отметим определяющие свойства функции F .

1. ∀k : −∞ ⩽ ak < bk < +∞, k = 1, . . . , n

∆a1 b1 · . . . · ∆an bn F (x1 , . . . , xn ) ⩾ 0

2. Из монотонности вероятности — F монотонно не убывает по любому своему аргументу

Из непрерывности вероятности — F непрерывна справа по совокупности аргументов в каждой точке.

x, x(k) ∈ Rn ⇒ F (x(k) ) → F (x)

k→∞

3. Устремим каждый аргумент функции к +∞:

F (+∞, . . . , +∞) = 1

4. lim F (x1 , . . . , xn ) = 0, y ∈ Rn , yi = −∞.

x↓y

Определение. Любую функцию n аргументов, удовлетворяющую

условиям (1, 2, 3, 4), будем называть функцией распределения в Rn

Пример. n = 2

(

F (x1 , x2 ) =

0, x1 + x2 < 1

1, x1 + x2 ⩾ 1

Очевидно, свойства (2, 3, 4) выполнены. Применим разностный оператор.

a1 = 0, b1 = 1 : ∆a1 b1 F (x1 , x2 ) = F (1, x2 ) − F (0, x2 )

a2 = 0, b2 = 1 : ∆a2 b2 [∆a1 b1 F (x1 , x2 )] = [F (1, 1) − F (0, 1)]−

[F (1, 0) − F (0, 0)] = 1 − 1 − 1 + 0 = −1

Условие (1) не выполнено.

Теорема. Пусть F = F (x1 , . . . , xn ) — функция распределения на Rn .

Тогда на вероятностном пространстве (Rn , B(Rn )) существует единственная вероятностная мера P:

P{(a1 , b1 ] × . . . × (an , bn ]} = ∆a1 b1 . . . ∆an bn F (x1 , . . . , xn )

(1) и (2) говорят о том, что между вероятностью и функцией распределения в Rn установлено взаимно однозначное соответствие.

37

§6

Случайный вектор и его распределение на измеримом пространстве (Rn , B(Rn ))

Определение. Любой упорядоченный набор случайных величин

ξ1 , . . . , ξn , заданный на (Ω, F, P), называется n-мерным вектором.

ξ = (ξ1 , . . . , ξn )

Если для любого B ∈ B(Rn )

{ω : ξ(w) ∈ B} ∈ F — событие, то ξ — случайный вектор.

B = B1 × . . . × Bn , Bi ∈ B(R1 )

{ω : ξ1 (ω) ∈ B1 , . . . , ξn (ω) ∈ Bn }

Определение. Распределением вероятностей n-мерного случайного

вектора называется функция множества Pξ (B) такая, что

def

B ∈ B(Rn ) : Pξ = P{ω : ξ(ω) ∈ B}

Определение. Функцией распределения случайного вектора ξ называется функция n-мерной точки

def

Fξ (x1 , . . . , xn ) = P{ω : ξ1 (ω) ⩽ x1 , . . . , ξn (ω) ⩽ xn }

def

B ∈ B(Rn ) : Pξ = P{ω : ξ(ω) ∈ B} ≡ P{ξ(ω)}

Отметим свойство согласованности функции распределения случайного вида.

1.

2.

lim

Fξ1 ,...,ξn (x1 , . . . , xn ) = Fξ1 ,...,ξn−1 (x1 , . . . , xn−1 )

lim

Fξ1 ,...,ξn (x1 , . . . , xn ) = 0

xn →+∞

xn →−∞

Пусть

(:)(ξi1 , . . . , ξik ), 1 ⩽ i1 < . . . < ik ⩽ n; k < n — подвектор

Лемма. Распределение любого подвектора исходного вектора (:)

полностью определяется распределением исходного вектора ξ. η =

(ξ1 , . . . , ξk ), k < n порождает на (Rk , B(Rk )) вероятностную меру Pη .

B ∈ B(Rk ).

def

Pη (B) = P(η ∈ B) = P((ξ1 , . . . , ξk ) ∈ B) =

P{(ξ1 , . . . , ξk ) ∈ B, (ξk+1 , . . . , ξn ) ∈ Rn−k } =

= P{(ξ1 , . . . , ξn ) ∈ B × Rn−k = Pξ (B × Rn−k )

Обратное не верно.

38

Случайный n-мерный вектор имеет дискретное распределение вероятностей, если он может принимать не более чем счётное число возможных значений.

(j)

(j)

ξ = (ξ1 , . . . , ξn ), x(j) = (x1 , . . . , x(j)

n ), P{ξ = x } = pj ,

n

X

pj = 1

j=1

Pξ (B) = P(ξ ∈ B) =

=

X

...

(j)

j:x1 ∈B

X

X

pj =

j:x(j) ∈B

(j)

P(ξ1 = x1 , . . . , ξn = x(j)

n )

(j)

j:xn ∈B

Fξ (x1 , . . . , xn ) = P{ξ1 ⩽ x1 , . . . , ξn ⩽ xn ) =

X

X

(j)

=

...

P(ξ1 = x1 , . . . , ξn = x(j)

n )

(j)

j:x1 ⩽x1

(j)

j:xn ⩽xn

Будем говорить, что n-мерный случайный вектор имеет абсолютно

непрерывное распределение, если

существует функция плотности веR

роятности fξ (x1 , . . . , xn ) ⩾ 0, fξ (x)dx = 1, такая, что

Rn

def

Z

Pξ (B) = P(ξ ∈ B) =

fξ (x)dx, B ∈ B(Rn )

B

Пример. S ∈ R .

n

1 ,x ∈ S

fξ (x) = |S|

0, x ̸∈ S

Тогда

|B ∩ S|

|S|

Рассмотрим положительно определённую симметричную матрицу R

Pξ = P{ξ ∈ B} =

R = {rij }i=1,...,n , rij = rji

j=1,...,n

∀xi , xj ∈ R1 :

n

X

rij · xi · xj > 0

i,j=1

detR > 0 ⇒ ∃R−1 = B = {bij }i=1,...,n

j=1,...,n

n-мерная невырожденная функция плотности вероятности:

1

1

[detB] 2

f (x1 , . . . , xn ) =

= e− 2 bij (xi −ai )(xj −aj ) , ai , aj ∈ R1

n

2

2π

39

§7

Независимость случайных величин

Пусть имеется упорядоченный набор случайных величин ξ1 , . . . , ξn ,

заданный на вероятностном пространстве (Ω, F, P).

Определение. Будем говорить, что ξ1 , . . . , ξn независимы, если для

любого набора одномерных борелевских множеств {B1 , . . . , Bn }, Bi ∈

B(R1 ) выполняется:

P{ξ1 ∈ B1 , . . . , ξn ∈ Bn } =

n

Y

i=1

P{ξi ∈ Bi }

| {z }

Pξi (Bi )

Pξ (B1 × . . . × Bn ), Bi = (−∞, xi ]

∀x : Fξ1 ,...,ξn (x1 , . . . , xn ) = Fξ1 (x1 ) · . . . · Fξn (xn )

n

Y

∆a b Fξ (xi )

∆a1 b1 . . . ∆an bn (Fξ1 ,...,ξn (x1 , . . . , xn )) =

{z

} i=1 | i i{z i }

|

Pξ {(a1 ,b1 ]×...×(an ,bn ]}

Pξi {(ai ,bi ]}

(1), (2), (3) эквивалентны.

Теорема. Пусть имеется набор дискретных случайных величин

ξ1 , . . . , ξn . Они независимы тогда и только тогда, когда

P{ξ1 = x1 , . . . , ξn = xn } =

n

Y

P{ξi = xi }, ∀{x(j) }j=1,2,...

i=1

Теорема. Пусть имеется набор абсолютно непрерывных случайных

величин ξ1 , . . . , ξn . Они независимы тогда и только тогда, когда

fξ1 ,...,ξn (x1 , . . . , xn ) =

n

Y

fξi (xi ), x ∈ Rn

i=1

Замечание. Пусть имеется набор случайных величин ξ1 , . . . , ξn ,

g1 (x), . . . , gn (x) — набор борелевских функций, x ∈ R1 . Тогда

g1 (ξ1 ), . . . , gn (ξn ) также независимы.

Отступление. Сконструируем интеграл Лебега. Пусть имеется измеримое пространство [a, b], g(x) = y — непрерывная ограниченная

функция.

• A — точка верхней границы g(x),

• B — точка нижней границы g(x).

40

A = y0 < y 1 < . . . < y n = B

Si = {x} : yi−1 < g(x) < yi , x ∈ [a, b]

Тогда

n

X

lim

max(yi −yi−1 )→0

def

Zb

g(x)dx

yi µ(Si ) =

i=1

a

Замечание. Конструкция интеграла Лебега не зависит от того, на

каком измеримом пространстве он задаётся, в отличие от интеграла

Римана, не определяющемся на абстрактном пространстве (Ω, F).

В конструкции Лебега (когда Ω — отрезок вещественной прямой) точки функции группируются согласно близости значений самой функции, а не как в интеграле Римана по близости на самой оси.

Таким образом, интегральные суммы Римана будут иметь предел для

не слишком разрывных функций. Интеграл Лебега имеет смысл для

более широкого класса функций.

Пусть интеграл Римана существует в смысле абсолютной сходимости,

значит, совпадает с интегралом Лебега.

Для любого не более чем счётного набора попарно несовместных событий B1 , . . . , Bn , . . . интеграл Лебега:

Z

XZ

=

...

P

i B

i

Bi

i

Теорема. (Фубини). Рассмотрим специальный класс измеримых пространств с определённой на них вероятностной мерой: (Ω, F, P). Пусть

Ω1 = {ω1 }, Ω2 = {ω2 }

Ω = Ω1 × Ω2 , F = F1 × F2 , P = P1 × P2

A ∈ F1 , B ∈ F2 , A × B ∈ F

P(A × B) = P1 × P2 (A × B) = P1 (A) × P2 (B)

Тогда, если

ZZ

|ξ(ω1 , ω2 )|d(P1 × P2 ) < +∞ — интеграл конечен

Ω1 ×Ω2

Z

То

∃

ξ(ω1 , ω2 )d Pi , i = 1, 2

Ωi

ZZ

Z

ξ(ω1 , ω2 )d(P1 × P2 ) =

Ω1 ×Ω2

Ω1

41

Z

ξ(ω1 , ω2 )d P2 d P1 =

Ω2

Z

=

Ω2

Z

ξ(ω1 , ω2 )d P1 d P2

Ω1

Пример. n = 2.

(ξ, η), (R2 , B(R2 ), Pξ,η ), fξ,η (x, y)

• ξ ∼ x — возможное значение ξ

• η ∼ y — возможное значение η

Пусть B ∈ B(R2 )

ZZ

Pξ,η (B) = P{(ξ, η) ∈ B} =

fξ,η (x, y)dxdy

B

+∞

+∞

Z

Z

fξ (x) =

fξ,η (x, y)dy, fη (y) =

fξ,η (x, y)dx

−∞

−∞

Выведем fξ (x). Пусть B1 ∈ B(R1 ),

Pξ (B) = P{ξ ∈ B} = P{(ξ, η) ∈ B × R1 } =

Z Z

ZZ

(т. Фубини)

fξ,η (x, y)dy dx

=

fξ,η (x, y)dxdy

B×R1

B1

Для fη (x) вывод аналогичен.

42

R1

Глава 3

Числовые характеристики

распределения случайных

величин

§1

Математическое ожидание случайной величины

Определение. Математическим ожиданием случайной величины ξ

на вероятностном пространстве (Ω, F, P) будем называть интеграл Лебега:

Z

Z

Mξ = ξ(ω)d P(ω), при этом, если

|ξ(ω)|d P < +∞

Ω

Ω

T.e. если интеграл конечен. Иначе случайная величина математического ожидания не имеет.

∃Mξ ⇔ M|ξ| < +∞

Z

∃Mξ ⇒ ∀A ∈ F ∃

Z

MIA =

Z

ξ · IA d P = M [ξ · IA ]

ξ(ω)d P =

A

Ω

Z

IA (ω)d P =

Ω

d P = P(A)

A

Свойства математического ожидания

1. Пусть a, b — константы. Тогда Ma = a, M [b · ξ] = b · Mξ

2. |Mξ | ⩽ M|ξ|

43

3. M [ξ + η] = Mξ + Mη

4. ∀ε > 0 : |ξ| ⩽ ε ⇒ |Mξ | ⩽ ε

Доказательство. (Свойство 4)

Z

Z

|Mξ | ⩽ M|ξ| = |ξ|d P ⩽ ε d P = ε · P(Ω) = ε

Ω

Ω

5. Неравенство Чебышёва. Пусть ξ ⩾ 0 — случайная величина,

t > 0, t ∈ R1 . Тогда

Mξ

P{ξ ⩾ t} ⩽

t

Рассмотрим

Z

Z

Z

ξ(ω)

1

Mξ

P{ξ ⩾ t} =

dP ⩽

dP ⩽

ξ(Ω)d P =

t

t

t

{ω:ξ(ω)⩾t}

{ξ⩾t}

Ω

Следствие. g(x) — борелевская функция, x ∈ (0, +∞). g(x) монотонно возрастает, g(x) ⩾ 0, ξ — случайная величина. t > 0 : g(t) ̸= 0

P{|ξ| ⩾ t} ⩽

M[g(|ξ|)]

g(t)

P{|ξ| ⩾ t} = P{g(|ξ|) ⩾ g(t)} ⩽

Mg(|ξ|)

g(t)

Пусть g(x) = x2 . x ∈ (0, +∞):

P{|ξ| ⩽ t} ⩽

Mξ 2

,t > 0

t2

g(x1 , . . . , xn ), g : Rn → R1

∀B ∈ B(R1 ) : g −1 (B) ∈ B(Rn )

g −1 (B) = {x, x ∈ Rn : g(x) ∈ B}

ξ = (ξ1 , . . . , ξn ), g(ξ) : Ω → R1 , ξi : Ω → R1

Теорема. (О вычислении математического ожидания случайной величины.) Пусть задан вектор случайных величин ξ = (ξ1 , . . . , ξn ) на

вероятностном пространстве (Ω, F, P).

44

g(x) : Rn → R1 , x ∈ Rn , g — борелевская функция. Тогда на конкретном вероятностном пространстве задан интеграл Лебега

Z

Mg(ξ) = g(x)dPξ (x), x ∈ Rn

Rn

По определению математического ожидания задан также интеграл

Лебега, но на абстрактном пространстве элементарных событий.

Z

g(ξ(ω))d P(ω)

Ω

Мы понимаем равенство следующим образом: если первый интеграл

существует, то второй интеграл так же существует и ему равен.

Следствие. Пусть задан дискретный вектор случайных величин ξ =

(ξ1 , . . . , ξn ), возможные значения — {x(j) }j=1,2,... , g : Rn → R1 — борелевская функция. Тогда математическое ожидание

X

Mg(ξ) =

g(x(j) ) · P{ξ = x(j) }

x(j) ∈{x(i) }i=1,2,...

Mξ =

X

xj · P{ξ = xj }

j

Следствие. Пусть задан абсолютно непрерывный вектор случайных

величин ξ = (ξ1 , . . . , ξn ), fξ (x1 , . . . , xn ), x ∈ Rn , g — борелевская функ| {z }

x

ция. Определим:

Z

Mg(ξ) =

g(x)fξ (x)dx

Rn

+∞

Z

Mξ =

x · fξ (x)dx

−∞

Пример. Равномерное распределение. ξ ∼ U [a, b].

1 , x ∈ [a, b]

fξ (x) = b − a

0, x ̸∈ [a, b]

Zb

Mξ =

a

a+b

x

dx =

b−a

2

45

Пример. Дискретная случайная величина (бернуллиевская), задающая некоторые распределение.

q = 0, p = 1; p + q = 1, Mξ = p

Рассмотрим биномиальную случайную величину. Пусть µn — число

появления «успеха» в n испытаниях Бернулли. Также пусть ξk — число появления успеха в k-ом испытании Бернулли

µn =

n

X

ξk

k=1

"

Mµn = M

n

X

#

ξk =

k=1

n

X

Mξk = np

k=1

Пример. Распределение вероятностей случайных величин Пуассона.

ξ ∼ P[a], a > 0

Mξ =

∞

X

k=0

∞

k·

X ak−1

ak −a

e = a · e−a

=a

k!

(k − 1) !

k=0

Пример. Распределение вероятностей случайных величин Коши.

a>0

a

fξ (x) =

, x ∈ R1

π(x2 + a2 )

1

x

1

+ arctg

2 π

a

Закон распределения Коши не имеет моментов и математического

ожидания. Рассмотрим M|ξ|

Fξ (x) =

M|ξ|

+∞

Z

=

|x| · fξ (x)dx

−∞

Интеграл расходится. Данное распределение не имеет математического ожидания.

§2

Дисперсия случайной величины

Пусть задана случайная величина ξ на вероятностном пространстве

(Ω, F, P). Определим дисперсию (центральный момент) случайной величины:

+∞

Z

2

2

Dξ = M[(ξ − Mξ ) ] =

(x − Mξ ) dPξ

−∞

46

2

2

M ξ 2 − 2ξ · Mξ + (Mξ )2 = Mξ2 − 2Mξ · Mξ + (Mξ ) = Mξ2 − (Mξ )

2

Dξ = min1 M[(ξ − a) ]

a∈R

Минимум достигается в a = Mξ .

p

Также определим среднеквадратическое отклонение (СКО) — Dξ

Свойства дисперсии

1. Пусть a, b — константы, ξ — случайная величина

D[aξ + b] = a2 Dξ

Доказательство.

2

2

M[((aξ + b) − M[aξ + b]) ] = a2 M[(ξ − Mξ ) ] = a2 Dξ

2. g(x) = x2 , x > 0, g(|η|), η = ξ − Mξ , ε > 0 :

P{|ξ − Mξ | ⩾ ε} ⩽

Dξ

— классическое нер-во Чебышёва

ε2

Теорема. Пусть ξ1 , . . . , ξn — независимые случайные величины.

∀i : ∃Mξi : M[ξ1 · . . . · ξn ] = Mξ1 · . . . · Mξn

Обратное не верно.

ξ, η — независимые случайные величины. ξ ∼ x, η ∼ y, Pξ,η = Pξ × Pη

ZZ

Z

Z

по т. Фубини

M[ξ · η] =

xyd(Pξ,η )

=

xdPξ ydPη = Mξ · Mη

R1 ×R1

R1

R1

Пример. Приведём пример, иллюстрирующий неверность обратного.

Пусть ξ, θ — независимые случайные величины, Mξ = 0, Mθ = 0, η =

ξ·θ

M[ξ · η] = M[ξ 2 · θ]

(по т.1)

=

Mξ2 · Mθ = 0, Mξ · Mη = 0

Теорема. Пусть ξ1 , . . . , ξn — независимые случайные величины, имеющие дисперсию ∀i : Dξi

" n #

n

X

X

D

ξi =

Dξ i

i=1

i=1

47

Доказательство. Пусть ξ, η — независимые.

2

2

D[ξ + η] = M[(ξ + η − M[ξ + η]) ] = M[((ξ − Mξ ) + (η − Mη )) ] =

2

2

= M[(ξ − Mξ ) ] + M[(η − Mη ) ] + 2M[(ξ − Mξ )(η − Mη )]

Mξη − Mξ · Mη + Mξ · Mη − Mξ · Mη = 0

Пример. Пусть µn — число успеха в n испытаний Бернулли, µn =

n

P

ξk

k=1

2

Dξk = Mξk2 − (Mξk )

Распределение ξk2 совпадает с ξk . Тогда

Dξ k = p − p 2 = p · q

Dµn =

n

X

Dξ k = n · p · q

k=1

§3

Матрица ковариаций случайного вектора

Определение. Пусть задан вектор случайных величин ξ =

(ξ1 , . . . , ξn ). Матрицей ковариаций ξ называется матрица, элементами которой являются

M (ξi − Mξi )(ξj − Mξj ) i,j=1,...,n = σij

|

{z

}

cov(ξi ,ξj )

То есть матрица ковариаций:

R = {σij }i,j=1,...,n

Определение. Корелляционным моментом называют величину

kij = cov(ξi , ξj )

Если случайные величины ξi , ξj независимы, то

σij = 0

Обратное не верно.

Определение. Если σij = 0, то ξi , ξj называют некоррелированными

случайными величинами

48

Очевидно, что:

• cov(ξi , ξj ) = cov(ξj , ξi ),

• cov(ξi , ξi ) = Dξi ,

• cov(aξi , ξj ) = a · cov(ξi , ξj ), где a — константа.

Также

D[ξ + η] = Dξ + Dη +2cov(ξ, η)

Можно показать (по индукции), что

" n #

n

n

X

X

X

D

ξi =

Dξi +2

cov(ξi , ξj )

i=1

i=1

i<j

Теорема. Пусть заданы

• вектор случайных величин ξ = (ξ1 , . . . , ξn ),

• матрица C, элементами которой являются константы c: C =

{cij }m×n , вектор a = {ai }i=1,...,m ,

• вектор b = {bj }j=1,...,n

Рассмотрим вектор η:

η = Cξ + a

Тогда матрица ковариаций вектора η:

Rη = C · Rξ · C T

Rξ+b = Rξ

Лемма. Пусть у вектора случайных величин ξ = (ξ1 , . . . , ξn ) существуют все ковариации cov(ξi , ξj ). Тогда при любом наборе вещественных констант {ci }i=1,...,n

D[c1 ξ1 + . . . + cn ξn ] =

n

X

σij ci cj

i,j=1

Доказательство. Пусть ηn = c1 ξ1 + . . . + cn ξn

ηn − Mηn =

n

X

ci (ξi − Mξi )

i=1

2

(ηn − Mηn ) =

n

X

ci cj (ξi − Mξi )(ξj − Mξj )

i,j=1

49

Применим к обеим частям математическое ожидание:

Dηn =

n

X

σij ci cj ⩾ 0

i,j=1

Тогда

det R ⩾ 0

§4

Коэффициент корреляции случайной величины

Рассмотрим ситуацию, когда в векторе случайных величин содержится два элемента: ξ = (ξ1 , ξ2 ). R — матрица ковариаций.

det R =

Dξ 1

cov(ξ1 , ξ2 )

cov(ξ2 , ξ1 )

Dξ 2

Отсюда следует, что

|cov(ξ1 , ξ2 )| ⩽

p

Dξ 1 · Dξ 2

Введём числовую характеристику — степени зависимости двух случайных величин. Назовём её коэффициентом корреляции двух случайных величин:

cov(ξ1 , ξ2 )

ρ(ξ1 , ξ2 ) = p

, где Dξ1 ̸= 0 и Dξ2 ̸= 0

D ξ 1 · Dξ 2

Отсюда следует, что |ρ(ξ1 , ξ2 )| ⩽ 1, ρ — безразмерная числовая характеристика.

Свойства коэффициента корреляции

1. ρ — безразмерная числовая характеристика — |ρ(ξ1 , ξ2 )| ⩽ 1

2. Пусть заданы независимые случайные величины ξ, η. Тогда

ρ(ξ, η) = 0. Обратное в общем случае не верно.

Но! Если ξ, η — нормальные случайные величины то ρ(ξ, η) =

0 ⇒ ξ, η — независимые.

3. ξ, η линейно зависимы ⇔ |ρ(ξ, η)| = 1.

Доказательство. (Свойство [3] — необходимость) Пусть a, b — константы, a ̸= 0.

η = aξ + b, Mη = aMξ + b, Dη = a2 Dξ

cov(ξ, η) = M[(ξ − Mξ )a(ξ − Mξ )] = a Dξ

50

ρ(ξ, η) = p

a Dξ

a

=

= sign a

2

|a|

Dξ a Dξ

Отступление. Для любой случайной величины, имеющей конечную

ненулевую дисперсию, можно рассмотреть такую случайную величину:

ξ − Mξ

ξ1 = p

Dξ

Если

• Mξ1 = 0, то ξ1 — центрированная случайная величина

• Dξ1 = 1, то ξ1 — нормированная случайная величина

• Mξ1 = 0 и Dξ1 = 1, то ξ1 — стандартизованная случайная величина

То есть для любой случайной величины ξ можно сопоставить ξ1 —

стандартизованную случайную величину. Тогда

η − Mη

η : η1 = p

Dη

ρ(ξ, η) = Mξ1 ·η1 ,

где ξ1 , η1 — стандартизованные случайные величины.

Рассмотрим такую дисперсию стандартизованных случайных величин:

2

0 ⩽ D[ξ1 ± η1 ] = M[(ξ1 ± η1 ) ] = 2 ± 2ρ(ξ, η)

Mξ12 = Dξ1 = 1, Mη12 = Dη1 = 1

Доказательство. (Свойство [3] — достаточность). Рассмотрим

ρ(ξ, η) = 1. Тогда

D[ξ1 − η1 ] = 2(1 − ρ(ξ, η)) = 0 ⇒ P{ξ1 − η1 = 0} = 1 ⇒ линейно зав.

Рассмотрим ρ(ξ, η) = −1. Тогда

D[ξ1 + η1 ] = 2(1 + ρ(ξ, η)) = 0 ⇒ P{ξ1 + η1 = 0} = 1 ⇒ линейно зав.

Определение. Две случайные величины называют положительно

коррелированными, если их коэффициент корреляции положительный.

Так же и с отрицательным коэффициентом корреляции — отрицательно коррелированными.

Если коэффициент корреляции случайных величин равен нулю, то

такие случайные величины не коррелированы.

51

§5

Моменты случайных величин произвольных

порядков

Кроме коэффициента корреляции существует немало других характеристик (например, корелляционное отношение).

Определение. Моментом (или начальным моментом) порядка p > 0

случайной величины ξ на вероятностном пространстве (Ω, F, P) назовём Mξp , при этом предполагается, что существует M|ξ|p < +∞. По

теореме о вычислении математического ожидания:

Mξp

+∞

Z

=

xp dPξ (x)

−∞

ξ : Ω → R (R1 , B(R1 ), Pξ )

1

Определение. Центральным моментом порядка p > 0 случайной

величины ξ на вероятностном пространстве (Ω, F, P) назовём

M[(ξ − Mξ )p ]

При этом предполагается, что M|(ξ − Mξ )|p < +∞.

Свойства моментов случайных величин

1. Если существует абсолютный момент порядка p случайной величины, то существуют все абсолютные моменты порядка 0 < q <

p, т.е.

∀q, p : 0 < q < p ∃M|ξ|p ⇒ ∃M|ξ|q

Покажем это. Воспользуемся свойством:

Свойство (*): ξ ⩽ η ⇒ Mξ ⩽ Mη

|x|q ⩽ 1 + |x|p

|ξ|q ⩽ 1 + |ξ|p

Тогда

M|ξ|q ⩽ 1 + M|ξ|p < +∞

2. Неравенство Гёльдера. Пусть p > 1, q > 1,

1 1

+ =1

p q

Также пусть существует M|ξ|p < +∞, M|η|p < +∞. Отсюда существует M|ξ·η|p < +∞. Тогда

1 1

M|ξ·η| ⩽ M|ξ|p p · M|η|q q

52

3. Неравенство Йенсена. Пусть существует Mξ , g(x) — выпуклая

вниз борелевская функция. Тогда

g(Mξ ) ⩽ Mg(ξ)

Доказательство. Так как g(x) выпукла вниз, то

∀y ∈ R1 ∃λ(y) : ∀x ∈ R1 g(x) ⩾ g(y) + (x − y) · λ(y)

Положим x = ξ, y = Mξ . Тогда

g(ξ) ⩾ g(Mξ ) + (ξ − Mξ ) · λ(Mξ )

Воспользуемся свойством *(1):

Mg(ξ) ⩾ g(Mξ )

4. Неравенство Ляпунова. Пусть задана случайная величина ξ,

имеющая математическое ожидание Mξ , а также p > q > 0. Тогда

1

1

M|ξ|p p ⩾ M|ξ|q q

| {z }

ϕ(p)

ϕ(p) монотонно не убывает.

Доказательство. Пусть pq = r > 1. Рассмотрим борелевскую

функцию g(x) = |x|r . r > 0, значит, g(x) выпуклая вниз. Обозначим η = |ξ|q . Запишем неравенство Йенсена:

p

r

[Mη ] ⩽ M|η|r , M|ξ|q q ⩽ M|ξ|p

Возведём в p1 :

1

1

M|ξ|q q ⩽ M|ξ|p p

Определение. Пусть k1 , . . . , kn ⩾ 0 — числа, а ξ1 , . . . , ξn — упорядоченный набор случайных величин. Тогда

1. Смешанным моментом порядка (k1 + . . . + kn ) назовём

M[ξ1k1 · ξ2k2 · . . . · ξnkn ]

2. Центральным смешанным моментом порядка (k1 + . . . + kn ) назовём

M[(ξ1 − Mξ1 )k1 · . . . · (ξn − Mξn )kn ]

Если ξ1 , . . . , ξn независимы, то 1 и 2 представляются произведением соответствующих моментов.

53

§6

Законы распределения функций случайных величин

Пусть определена случайная величина ξ, функция распределения этой

случайной величины Fξ (x), а также, если ξ абсолютно непрерывна, то

функция плотности вероятности fξ (x).

Рассмотрим борелевскую функцию одного аргумента:

g(ξ) = η

Тогда

Fη (y) = P{η ⩽ y} = P{g(ξ) ⩽ y} = P{ξ ∈ g −1 {(−∞, y]}} =

Z

=

dPξ ≡ . . .

g −1 {(−∞,y]}

Замечание. Вероятностная мера Pξ однозначно восстанавливается

по функции распределения Fξ . Поэтому часто интеграл Лебега обозначают

Z

Z

g(x)dPξ = g(x)dFξ — интеграл Лебега-Стилтьеса

R1

R1

Z

... ≡

dFξ (x)

g −1 {(−∞,y]}

Рассмотрим

• η = aξ + b, где a, b — константы

1. a > 0:

y−b

Fη (y) = P{aξ + b ⩽ y} = P ξ ⩽

a

2. a < 0:

• η = ξ2

= Fξ

y−b

a

y−b

=

Fη (y) = P{aξ + b ⩽ y} = P ξ ⩾

a

y−b

y−b

= 1 − Fξ

+P ξ =

a

a

√

√

Fη (y) = P{ξ 2 ⩽ y} = P{− y ⩽ ξ ⩽ y} =

√

√

√

Fξ ( y) − Fξ (− y) + P{ξ = − y}

54

Пусть задана абсолютно непрерывная случайная величина ξ, функция

распределения этой случайной величины Fξ (x) и функция плотности

вероятности fξ (x).

J = (a, b) ⊂ R1 , g(x) — непрерывная дифференцируемая функция,

строго монотонна. x ∈ J, g ′ (x) ̸= 0.

x ∈ J, g ′ (x) ̸= 0 ⇒ ∃g −1 (y), y ∈ g(J)

Рассмотрим случайную величину g(ξ), пусть g(ξ) строго возрастает.

Fg(ξ) (y) = P{g(ξ) ⩽ y} = P{ξ ⩽ g −1 (y)} = Fξ (g −1 (y))

ξ ∼ {x}, g(ξ) ∼ {y}

Если существует функция плотности вероятности, то

h(y)

Z

−1

Fg(ξ) (y) = Fξ (g (y)) =

| {z }

h(y)

fξ (x)dx = [x = h(z), z = g(x)] =

−∞

Zy

=

−∞

fξ (h(z))h′ (z) dz

{z

}

|

fg(ξ) (z)

Пусть g(x) строго убывает

Fg(ξ) (y) = P{ξ ⩾ g −1 (y)} = 1 − Fξ (g −1 (y)) =

| {z }

h(y)

−∞

−∞

Z

Z

=

fξ (x)dx = [x = h(z), z = g(x)] =

fξ (h(z))h′ (z)dz =

y

h(y)

Zy

−

fξ (h(z))h′ (z)dz

−∞

Если g(x) строго монотонна:

f g(ξ) (y) = fξ (g −1 (y)) · [|g −1 (y)′ |]

Рассмотрим область значений

ξ:

n

X

[ak , bk ], Jk = (ak , bk ), g(x), x ∈ Jk

k=1

55

g(x) либо (строго) монотонно возрастает, либо (строго) монотонно

убывает, непрерывно дифференцируема на каждом Jk , g ′ (x) ̸= 0.

Введём обозначение:

hk (y) = g −1 (y), y ∈ g(Jk )

Тогда обобщённая формула имеет вид:

fg(ξ) (y) =

n

X

fξ (hk (y)) · |h′ k (y)| · Ig(Jk ) (y)

k=1

Пример. Пусть η = g(ξ).

1. η = ξ 2 , ξ — абсолютно непрерывная случайная величина.

y ⩽ 0 : fξ2 (y) = 0, y > 0 : g(x) = x2

J1 = (−∞, 0) — g(x) строго монотонно убывает

J2 = (0, +∞) — g(x) строго монотонно возрастает

y = x 2 , x ∈ R1

( √

− y, x < 0

x=

√

y, x ⩾ 0

Вычислим h′ (y)

1

1

h′ (y) = ± √ , |h′ (y)| = √

2 y

2 y

Таким образом

1

√

√

fξ2 (y) = √ · [fξ (− y) + fξ ( y)] , y > 0

2 y

Рассмотрим:

x2

1

ξ ∼ N (0, 1), fξ (x) = √ e− 2

2π

fξ2 (y) = √

y

1

e− 2 , y > 0

2πy

2. Пусть η = |ξ|, g(x) = |x|, y = |x|,

(

−y, x < 0

x=

y, x ⩾ 0

f|ξ| (y) = fξ (−y) + fξ (y), y ⩾ 0

56

3. Пусть η =

p

|ξ|

f√|ξ| (y) = 2y · fξ (y 2 ) + fξ (−y 2 ) , y > 0

4. Рассмотрим пример другого вида. Пусть имеется строго возрастающая функция распределения Fξ (x). Fξ (ξ) — случайная величина. Каков закон распределения?

FFξ (ξ) (x) = P{Fξ (ξ) ⩽ x} = P{ξ ⩽ Fξ−1 (x)} =

= Fξ (Fξ−1 (x)) = x, 0 ⩽ x ⩽ 1

0, x < 0

def

P{Fξ (ξ) ⩽ x} = x, 0 ⩽ x ⩽ 1 = FFξ (ξ) (x)

1, x > 1

Fξ : R1 → [0, 1]

FFξ (ξ) ∼ U[0, 1] — равномерное распределение на отрезке

5. Пусть η ∼ U[0, 1], F (x) — непрерывная функция распределения.

Тогда

FF −1 (η) (x) = P{F −1 (η) ⩽ x} = P{η ⩽ F (x)} = Fη (F (x)) = F (x)

y = F −1 (x), где x ∈ [0, 1].

Строим случайную величину с наперёд заданным распределением, используя случайную величину с равномерным

распределением.

Рассмотрим ситуацию, когда борелевская функция g — функция двух

переменных. Пусть ξ, η — случайные величины, их функция распределения — Fξ,η (x, y), g(ξ, η), z ∈ R1 .

ZZ

Fg(ξ,η) (z) = P{g(ξ, η) ⩽ z} =

dFξ,η (x, y)

{x,y:g(x,y)⩽z}

Также пусть g(x, y) = x + y; ξ, η — независимые случайные величины

ZZ

Fξ+η (z) =

dFξ (x)dFη (y) =

{x,y:x+y⩽z}

ZZ

=

I{x+y⩽z} (x, y)dFξ (x)dFη (y) =

R2

57

По теореме Фубини:

+∞

+∞

+∞

Z

Z

Z

=

dFξ (x)

I{x+y⩽z} (x, y)dFη (y) =

Fη (z − x)dFξ (x)

−∞

−∞

−∞

+∞

Z

Fξ+η (z) =

Fξ (z − y)dFη (y)

−∞

Если имеются функции распределения F, G, то

+∞

+∞

Z

Z

H(z) =

F (z − x)dG(x) =

G(z − y)dF (y)

−∞

|

{z

−∞

свёртка F и G (композ.)

}

Функция распределения суммы двух случайных независимых величин

есть свёртка функций распределения слагаемых.

Пусть существует функция плотности вероятности fξ (x), fη (y). Тогда

+∞ z−y

Z

Z

Fξ+η (z) =

fξ (u)du · fη (y)dy = [ν = u + y] =

−∞

−∞

+∞ Zz

Z

fξ (ν − y)dν · fη (y)dy =

−∞

−∞

По теореме Фубини:

Zz

−∞

+∞

Z

fξ (ν − y)fη (y)dy dν

−∞

Итак:

+∞

+∞

Z

Z

fξ+η (z) =

fξ (z − y)fη (y)dy =

fη (z − x)fξ (x)dx

−∞

−∞

Пусть имеется набор независимых случайных величин ξ1 , . . . , ξn ,

∀i : ξi ∼ N (0, 1).

Составим случайную величину, подчиняющуюся распределению χ2

ξ12 + . . . + ξn2 = χ2n

58

n −1 − x

x 2n · e 2 , x > 0

2 2 · Γ n2

fχ2n (x) =

0, x ⩽ 0

Составим распределение Стьюдента

ξ0

tn = s

1

n

n

P

i=1

ξi2

√

ξ0 n

= p

χ2n

где χn — χ-распределение с n степенями свободы

χn =

p

x2

n−1

· e− 2

2 · x

, x>0

n

χ2n ∼ fχn (x) =

2 2 · Γ n2

0, x ⩽ 0

Можно показать, что

Γ n+1

2

ftn (x) = √

n·π·Γ

n

2

x2

1+

n

− n+1

2

Если n → ∞, то получим функцию плотности вероятности стандартного нормального распределения

1 −x2

ftn (x) → √ e 2

n→∞

2π

Если n = 1, тогда получим функцию плотности вероятности распределения Коши с параметром 1

ftn (x) =

1

π(1 + x2 )

Рассмотрим независимые случайные величины ξ, η

• ξ ∼ {xi }i=1,2,... ,

• η ∼ {yi }i=1,2,... ,

• ξ + η ∼ {zk }k=1,2,...

P{ξ + η = zk } =

=

X

X

P{ξ = xi } P{η = zk − xi } =

i

P{η = yj } P{ξ = zk − yj }

j

59

Тогда функция распределения

ZZ

Fg(ξ,η) (z) =

dFξ,η (x, y)

{(x,y):g(x,y)⩽z}

Рассмотрим произведение этих случайных величин. Пусть также ξ, η

— независимые. Тогда функция плотности вероятности

+∞

Z

z

1

fξ·η (z) =

fξ ( )fη (y) dy

y

|y|

−∞

+∞

+∞

Z

Z

x

1

fξ (x)|x|dx

f ξ (z) =

fξ (zy)fη (y)|y|dy = 2

fη

η

z

z

−∞

−∞

Пусть задан вектор случайных величин с абсолютно непрерывным

распределением

ξ = (ξ1 , . . . , ξn ), fξ (x), x = (x1 , . . . , xn )

Пусть gi — борелевские функции

gi : Rn → R1 , i = 1, . . . , n

Рассмотрим

g : Rn → Rn , g(x) = (g1 (x), . . . , gn (x))

x∈Rn

J(x) =

∂(g1 , . . . , gn )

̸= 0

∂(x1 , . . . , xn )

Сконструируем вектор

η = (η1 , . . . , ηn ), ηi = gi (ξ)

Его распределение описывается следующей функцией плотности вероятности

fη (x) = fξ (g −1 (x)) = |J(g −1 (x))|−1

60

Глава 4

Характеристические

функции. Предельные

теоремы

§1

Производящие функции. Факториальные моменты

Пусть задана дискретная целочисленная неотрицательная случайная

величина ξ, m = 0, 1, 2, . . . – возможные значения. Закон распределения, которому подчиняется ξ:

P{ξ = m} = pm ,

∞

X

pm = 1

m=0

Такой закон удобно исследовать с помощью производящих функций.

Пусть u ∈ R1 . Определим производящую функцию дискретной случайной величины

X

Ψξ (u) = Muξ =

pm · um , |u| ⩽ 1

def