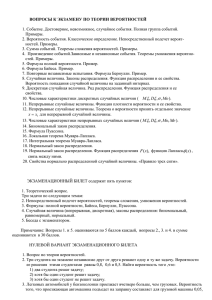

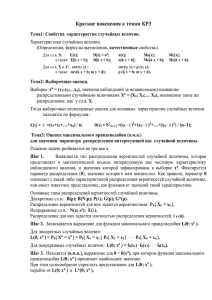

МИНИСТЕРСТВО РОССИЙСКОЙ ФЕДЕРАЦИИ ПО ДЕЛАМ ГРАЖДАНСКОЙ ОБОРОНЫ, ЧРЕЗВЫЧАЙНЫМ СИТУАЦИЯМ И ЛИКВИДАЦИИ ПОСЛЕДСТВИЙ СТИХИЙНЫХ БЕДСТВИЙ САНКТ-ПЕТЕРБУРГСКИЙ УНИВЕРСИТЕТ ГОСУДАРСТВЕННОЙ ПРОТИВОПОЖАРНОЙ СЛУЖБЫ МЕТОДИЧЕСКИЕ МАТЕРИАЛЫ (МЕТОДИЧЕСКИЕ РАЗРАБОТКИ ПО ВСЕМ ВИДАМ ЗАНЯТИЙ) ПО ДИСЦИПЛИНЕ ТЕОРИЯ ВЕРОЯТНОСТЕЙ И МАТЕМАТИЧЕСКАЯ СТАТИСТИКА Направление подготовки 27.03.03 Системный анализ и управление Уровень бакалавриата Санкт-Петербург Раздел 1. Теория вероятностей Очевидно, что в природе, технике, во всех научно-практических областях деятельности человека нет явлений, в которых не присутствовали бы элементы случайности. Существуют два подхода к изучению подобных явлений. Один из них – классический, или «детерминистский», состоит в том, что выделяются основные факторы, определяющие данное явление. При этом влиянием множества остальных, второстепенных, факторов, приводящих к случайным отклонениям его результата, пренебрегают. Так выявляется свойственная данному явлению основная закономерность, позволяющая однозначно предсказать результат по заданным условиям. Этот подход часто используется в естественноматематических («точных») науках. При исследовании многих явлений такой подход неприемлем. В этих явлениях необходимо учитывать не только основные факторы, но и множество второстепенных факторов, которые вносят элемент неопределенности. Принципиально иной подход состоит в исследовании свойственного случайным явлениям элемента неопределенности, что требует специальных методов изучения. Разработкой таких методов, выявлением специфических закономерностей, наблюдаемых в случайных явлениях, и занимается теория вероятностей. ТЕМА № 1. ВВЕДЕНИЕ В ТЕОРИЮ ВЕРОЯТНОСТЕЙ Лекция.1. Элементы комбинаторики История возникновения комбинаторики Область математики, исследующая проблемы, связанные с вычислением возможного числа различных комбинаций, которые можно составить из заданного множества объектов в соответствии с теми или иными условиями, называется комбинаторикой. Как отдельная область знания комбинаторика сложилась в XVI в. В жизни привилегированных слоев общества того времени большое место занимали азартные игры. Исторические факты свидетельствуют, что в карты и кости выигрывались и проигрывались дворцы, имения, породистые кони, дорогие украшения. Первоначально задачи комбинаторики касались в основном азартных игр и были связаны с поиском наиболее эффективных стратегий. Игрокам приходилось опытным путем находить ответы на вопросы, сколькими, например, способами можно выбросить данное число очков, бросая две или три кости, или сколькими способами можно получить двух королей в данной карточной игре. Проблемы азартных игр явились движущей силой для развития комбинаторики, а также для развивающейся одновременно с ней теорией вероятностей. 2 Теоретические исследования вопросов комбинаторики предприняли в XVII в. французские ученые Б. Паскаль (1623–1662) и П. Ферма (1601–1665). Дальнейшее ее развитие связано с именами Я. Бернулли, Г. Лейбница и Л. Эйлера. Однако в работах этих ученых основную роль играли приложения комбинаторики к различным играм. В дальнейшем комбинаторика переживает период бурного развития, что связано с общим повышением интереса к проблемам дискретной математики. Комбинаторные понятия и методы широко используются при решении транспортных задач, в частности задач по составлению расписаний, применяются для составления планов производства и реализации продукции, при составлении и декодировании шифров и решении других проблем теории информации. Для решения комбинаторных задач могут использоваться различные приемы. В простых случаях результат может быть найден путем непосредственного подбора комбинаций, удовлетворяющих условию задачи. Для того чтобы ни одна комбинация не была пропущена, перечисление возможных вариантов удобно связать с построением специального графа, который называется деревом состояний, и наглядно представляет ход рассуждений. Решение многих комбинаторных задач основывается на основных комбинаторных правилах. Наиболее универсальный прием решения связан с использованием формул комбинаторики. Рассмотрим пример комбинаторной задачи, в которой число возможных выборов на каждом этапе зависит от того, какие элементы были выбраны ранее. Пример 1. Сколько различных трехзначных чисел можно записать с помощью трех цифр 3, 5, 7, не повторяя их? Постройте граф (дерево) различных перестановок. Решение. Поиск результата наглядно иллюстрируется с помощью построения специального графа (дерева состояний). I место II место III место 5 7 (357) 7 5 (375) 3 7 (537) 7 3 (573) 3 5 (735) 5 3 (753) 3 Начало 5 7 3 На первое место можно поставить любую из заданных цифр, т. е. выбор осуществляется тремя способами. Для каждого из трех способов составления числа на втором месте можно использовать любую из двух оставшихся цифр, т. е. два способа составления числа. На третье место можем поставить всего одну оставшуюся цифру. Таким образом, всего может быть составлено 6 чисел. Теперь к рассмотренным цифрам прибавим еще одну цифру, например, 8. Тогда исходное множество будет содержать четыре цифры, и задача примет вид: сколько различных четырехзначных чисел можно составить с помощью цифр 3, 5, 7, 8, не повторяя их? Действуя подобным образом, получим 24 числа. Если число объектов (элементов) в рассматриваемом множестве велико, то составление деревьев (графов) оказывается весьма трудоемким и громоздким приемом решения. В связи с этим часто используют основные правила комбинаторики. Правила суммы и произведения Решение многих комбинаторных задач основывается на двух фундаментальных правилах, называемых соответственно правилами суммы и произведения. Правило произведения. Если действие А можно выполнить m способами, и если после каждого возможного выбора действие B можно выполнить n способами, то выполнение пары действий « А и B » в указанной последовательности можно осуществить m n способами. Правило произведения можно обобщить на любое конечное число действий. Пример 2. Сколько существует двухзначных чисел с разными цифрами. Решение. В десятичной системе исчисления десять цифр: 0, 1, 2, 3, 4, 5, 6, 7, 8, 9. На первом месте может стоять любая из девяти цифр (кроме нуля). На втором месте – любая из оставшихся девяти цифр, кроме уже выбранной цифры. По правилу произведения N 9 9 81 двухзначных чисел имеют разные цифры. Пример 3. В сейфах применяют секретные замки, которые открываются, когда набран шифр. Этот шифр набирают с помощью одного или нескольких дисков. Пусть на диск нанесены 10 цифр, а секретный код состоит из 4 цифр. Сколько неудачных попыток может сделать человек, не знающий шифра? Решение. Всего попыток N 10 10 10 10 104 10000 , из которых только одна удачная. Число неудачных попыток находим, вычисляя разность: 10000 1 9999 . Следовательно, 9999 неудачных попыток может сделать человек, не знающий шифра. Правило суммы. Если действие А можно выполнить m способами, а действие B можно выполнить n способами, то выполнение действия « А или B » можно осуществить m n способами. 4 Пример 4. Сколько существует способов выбора одного маркера из коробки, содержащей 3 красных, 7 синих и 5 зеленых маркеров? Решение. По правилу суммы один маркер можно выбрать N 3 7 5 15 способами. Пример 5. Из города X в город Y можно доехать одним из трех видов транспорта (рис. 1): маршрутным такси, троллейбусом, теплоходом, а из города Y в город Z можно добраться автобусом, пассажирским поездом, пригородной электричкой, вертолетом. Кроме того, для путешествия из X в Z можно использовать: самолет, скорый поезд. Сколькими способами можно добраться из города X в город Z? маршрутное такси X троллейбус автобус вертолет поезд Y Z электричка теплоход самолет скорый поезд Рисунок 1 Решение. В этом примере нужно применить и правило произведения, и правило суммы: N = 34+2 = 14 способов. Пример 6. Номер автомобиля состоит из трех букв и трех цифр. Сколько различных номеров можно составить, используя 10 цифр и 28 букв алфавита. Решение. Воспользуемся правилом произведения. Количество всех возможных комбинаций из 10 цифр по 3 равно n 10 10 10 1000 . Количество всех возможных комбинаций из 28 букв по 3 равно m 28 28 28 21952 . Тогда число автомобильных номеров, состоящих из трех букв и трех цифр равно N 1000 21952 21952000 . При решении многих комбинаторных задач удобно пользоваться готовыми формулами, позволяющих вычислить возможное число комбинаций элементов, удовлетворяющих определенным требованиям. Перестановки, размещения и сочетания Среди комбинаций, которые часто встречаются в комбинаторных задачах и которым присвоены специальные термины, следует выделить перестановки, размещения и сочетания. Для вычисления их возможного числа получены фор5 мулы, которые широко применяются в комбинаторике при решении задач различных видов. Перестановки Рассмотрим множество объектов, состоящее из n элементов. Составим из всех элементов данного множества различные комбинации. Предположим, что из цифр 2, 5, 6 необходимо составить трехзначные числа с разными цифрами. Таких трехзначных чисел шесть: 256, 265, 526, 562, 625, 652. Число таких комбинаций будем называть перестановками. Перестановками называют комбинации, состоящие из одних и тех же n элементов и отличающиеся друг от друга только порядком их расположения. Вычисление возможного числа перестановок зависит от того, повторяются в комбинациях элементы заданного множества или нет. В связи с этим различают перестановки без повторений и с повторениями элементов в заданном множестве. Пусть данное множество содержит n различных элементов, тогда для вычисления возможного числа перестановок без повторяющихся элементов, применяется формула: Pn n ! . (1) Известно, что выражение вида n! (читается «эн-факториал») является произведением всех натуральных чисел от 1 до n, т. е. n! = 1·2·3·...·n. При выполнении вычислений, связанных с преобразованием выражений, содержащих символ факториала, оказываются полезными формулы: n! = (n – 1)! n, (n + 1)! = n!(n + 1), (n + 2)! = n!(n + 1)(n + 2). Для пустого множества принимается соглашение: пустое множество можно упорядочить только одним способом, т. е. по определению полагают: 0! = 1. С увеличением п факториалы растут с фантастической скоростью, быстрее, например, многочлена или экспоненциальной функции. Это очевидно иллюстрирует таблица первых десяти значений (табл. 1): Таблица 1 п 1 2 3 4 5 6 7 8 9 10 п! 1 2 6 24 120 720 5040 40320 362880 3628800 Пример 7. Сколько существует способов расстановки 6 книг на полке? 6 Решение. Общее число способов расстановки определяется как число перестановок из 6 различных элементов и равно P6 6! 1 2 3 4 5 6 720 . Рассмотрим теперь случай вычисления возможного числа перестановок с повторениями. Пусть данное множество содержит n элементов, среди которых есть несколько групп одинаковых элементов. Обозначим число элементов первой группы через n1, второй – n2 и т. д. Если всего выделено k групп различных элементов, то п = п1 + п2 + ...+ пk. Возьмем перестановку: аа ...а bb ... b ... vv ... v , п1 п2 пk n в которой выписаны вначале элементы первой группы, затем элементы второй группы, и, наконец, элементы k-й группы. Элементы первой группы можно переставить друг с другом n1! способами. Но так как все эти элементы одинаковы, то такие перестановки в общем размещении ничего не меняют. Точно также ничего не меняют n2! перестановок элементов второй группы и т. д. Поэтому для любой перестановки, исходя из правила произведения, элементы можно переставлять друг с другом n1! n2! ... nk! способами так, что она остается неизменной. Поэтому для вычисления возможного числа перестановок из n элементов с повторениями применяется формула: Pn (n1 , n2 ,..., nk ) n! . n1 !n2 !...nk ! (2) Пример 8. Сколько различных слов, состоящих из 7 букв, можно составить из букв слова «КОРОБОК»? Решение. По условию n 7 . Слово содержит четыре различные буквы, т. е. k 4 . Так как буква «К» повторяется 2 раза, буква «О» – 3 раза, буквы «Р» и «Б» – по одному разу, то n1 2 , n2 3 , n3 1 , n4 1 . Тогда из слова «КОРОБОК» можно составить: P7 2;3;1;1 7! 7! 3! 4 5 6 7 420 различных слов. 2! 3!1!1! 3! 2! 3! 2 Размещения Допустим, что из множества n элементов необходимо составить различные комбинации, в которых участвуют не все, а только определенное количество m элементов. 7 Пусть из цифр 2, 5, 6 необходимо составить двухзначные числа с разными цифрами. Таких двухзначных чисел шесть: 25, 52, 26, 62, 56, 65. Число таких комбинаций будем называть размещениями. Размещениями из n элементов по m называются комбинации, которые составлены из m элементов и отличаются друг от друга или составом элементов, или их порядком. Различают размещения без повторений и с повторениями элементов. Возможное число размещений из m элементов по n без повторений элементов вычисляется по формуле: Anm n! . n m ! (3) Пример 9. В соревнованиях участвуют 10 человек. Сколько существует способов распределения золотой, серебряной и бронзовой медалей между участниками соревнований? Решение. По смыслу задачи для подсчета вариантов следует применить формулу числа размещений, так как важно учесть не только возможность получения медали, но и то, какого именно достоинства медаль будет вручена участнику: A103 10! 10! 8 9 10 720 . 10 3! 7! Пример 10. Из шести книг отбирают две и расставляют на книжной полке. Сколько способов расстановки книг существует? Решение. При расстановке книг важен порядок их размещения на книжной полке. Для подсчета вариантов применим формулу (3) числа размещений из 6 элементов по 2. В результате получим: A62 6! 6! 5 6 30 . 6 2 ! 4! Пример 11. Сколько существует семизначных телефонных номеров, в которых все цифры разные, а номер не может начинаться с нуля? Решение. При решении задачи надо не учитывать те соединения, которые начинаются с нуля. Сначала определим, сколько всего семизначных номеров с разными цифрами можно составить из существующих 10 цифр. Так как при составлении телефонных номеров важен порядок следования цифр, и известно, что цифры не повторяются, то воспользуемся формулой (3) для вычисления числа размещений из 10 элементов по 7 без повторений. Затем от полученного числа A107 вычтем количество номеров, начинающихся с нуля, т. е. A96 – число размещений из 9 элементов по 6 без повторений. В результате получим: A107 A96 10! 9! 10! 9! 4 5 6 7 8 9 10 4 5 6 7 8 9 544320 . 3! 3! 10 7 ! 9 6 ! 8 Для вычисления возможного числа размещений из n элементов по m с повторениями элементов применяется формула: Anm( повт.) nm . (4) Пример 12. Из цифр 1, 2, 3, 4, 5 составляется шифр для кодового замка, содержащий две цифры. Сколько способов существует, если цифры: а) не повторяются; б) могут повторяться? Решение. а) При составлении шифра важен состав выбранных символов и порядок следования цифр. Так как цифры в шифре не повторяются, воспользуемся формулой (3) для подсчета числа размещений из 5 элементов по 2 без повторений: A52 5! 3! 4 5 4 5 20 . 5 2 ! 3! б) Так как цифры в шифре могут повторяться, воспользуемся формулой (4) для вычисления числа размещений из 5 элементов по 2 с повторениями: A52( повт.) 25 32 . Сочетания Если два различных размещения состоят из одинаковых элементов некоторого множества, то они обязательно отличаются порядком входящих в них элементов. Иногда возникает необходимость не учитывать порядок элементов, входящих в размещение. Предположим, что из чисел 2, 5, 6 необходимо составить различные произведения двух чисел. Таких произведений только три, а именно: 2 5 10 , 2 6 12 , 5 6 30 . Это объясняется тем, что произведение вида 2 5 и 5 2 совпадают, так как порядок сомножителей, входящих в произведение, не учитывается. В отличие от размещений комбинации такого вида будем называть сочетаниями. Сочетаниями из n элементов по m называются комбинации, которые содержат m элементов и отличаются друг от друга хотя бы одним элементом. В отличие от размещений, при вычислении возможного числа сочетаний порядок элементов роли не играет, важен только состав образующих комбинацию элементов. Различают сочетания без повторений и с повторениями элементов. Число сочетаний из n элементов по m без повторений элементов вычисляется по формуле: Cnm n! . m ! n m ! (5) Пример 13. Необходимо выбрать в подарок две из шести имеющихся различных книг. Сколько способов выбора существует? Решение. Из смысла задачи следует, что порядок выбора книг не играет роли, так как важен только состав выбранного набора книг. Поэтому применя9 ем формулу (5) для вычисления числа сочетаний из 6 по 2. В результате получим: C62 6! 6! 15 способов. 2! 6 2 ! 2! 4! Из формулы Cnm n! можно получить полезные при выполнении m ! n m ! вычислений равенства: 1 2 3 ... n 1 n n! n; 1! n 1! 1 2 3 ... n 1 n! n! 2) если m n , то Cnn 1; n ! n n ! n ! 0! n! n! 3) если m 0 , то Cn0 1. 0! n 0 ! n ! 1) если m 1 , то Cn1 10 Для числа сочетаний справедливы тождества: Cnm Cnnm , Cnm11 Cnm Cnm1 ; Cn0 Cn1 Cn2 ... Cnn1 Cnn 2n . Последнее равенство иногда формулируется в виде следующей теоремы о конечных множествах. Теорема. Число всех подмножеств данного множества, состоящего из п элементов, равно 2n. Число сочетаний из п элементов по т с повторениями элементов равно числу сочетаний без повторений из (п + т – 1) элементов по т элементов, т. е.: Cnm( повт.) C m nm1 . (6) Пример 14. В кондитерской имеются пирожные четырех разных сортов. Сколькими способами можно выбрать шесть пирожных? Решение. Необходимо выбрать 6 пирожных, но пирожных всего 4 сорта, поэтому какие-то сорта будут повторяться. В соответствии с формулой (6), получим: С4(6 повт.) C4661 C96 98 7 84 . 6 Пример 15. В партии 20 пронумерованных деталей, из которых 5 бракованных. Сколькими способами из партии можно выбрать четыре детали так, чтобы бракованных и стандартных было поровну? Решение. В партии 5 бракованных и 15 стандартных деталей. Необходимо выбрать 2 бракованные и 2 стандартные детали. Набор в этих выборках является существенным, а порядок выбора не существен. Бракованные детали можно выбрать C52 способами, а для выбора стандартных существует C152 способов. Всего различных способов выбора четырех деталей будет равно C52 C152 5! 15! 4 5 14 15 1050 . 2! 3! 2!13! 22 Пример 16. Между шестью сотрудниками отдела распределяют две путевки в санаторий. Сколько способов распределения путевок существует, если путевки: а) одинаковые; б) различные? Решение. а) Так как по условию между сотрудниками распределяются одинаковые путевки, то подсчета вариантов следует применить формулу (5) числа сочетаний из 6 элементов по 2: С62 6! 4! 5 6 5 3 15 способов. 2! 6 2 ! 2 4! б) Так как по условию между сотрудниками распределяются различные путевки, то для подсчета вариантов нужно использовать формулу (3) числа размещений из 6 элементов по 2: A62 6! 6! 5 6 30 способов. 6 2 ! 4! 11 Естественно, что в случае распределения различных путевок вариантов будет больше. ТЕМА № 2. СЛУЧАЙНЫЕ СОБЫТИЯ Исследуя общие закономерности массовых случайных явлений, теория вероятностей сформировала соответствующий понятийный аппарат и разработала специальные методы изучения такого рода явлений. Лекция 2.1. Основные понятия теории вероятностей В настоящее время нет практически ни одной области науки и практики, где бы в той или иной степени не применялись вероятностные понятия и методы. Применение теории вероятностей позволяет осуществлять прогноз в области случайных явлений, контролировать их появление, влиять на ход такого рода явлений и, вследствие этого, ограничивать сферу действия случайности. Предмет теории вероятностей. Понятие случайного события Теорией вероятности называется раздел математики, изучающий общие закономерности случайных явлений. Под случайным явлением понимается такое явление, которое при многократном повторении одного и того же опыта протекает каждый раз с некоторым различием. Приведем примеры случайных явлений: выпадение герба при подбрасывании монеты, выигрыш по приобретенному лотерейному билету, результат измерения какой-либо величины, длительность безотказной работы прибора и т. д. Целью теории вероятностей является осуществление прогноза в области случайных явлений, влияние на ход таких явлений, контроль их, ограничение сферы действия случайности. В теории вероятностей случайные явления рассматриваются в абстрактной форме, независимо от их конкретной природы, изучаются не сами реальные явления, а их упрощенные схемы – математические модели. Предметом теории вероятностей являются математические модели случайных явлений. Начало систематического исследования проблем, относящихся к массовым случайным явлениям, и появление соответствующего математического аппарата относятся к XVII в. В начале XVII в. знаменитый физик Г. Галилей уже пытался подвергнуть научному исследованию ошибки физических измерений, рассматривая их как случайные и оценивая их вероятности. К этому же времени относятся первые попытки создания общей теории страхования, основанной на анализе закономерностей таких массовых случайных явлений, как заболеваемость, смертность, несчастные случаи, чрезвычайные ситуации различных видов и т. д. Необходимость создания математического аппарата, специально приспособленного для анализа случайных явлений, вытекала из по12 требностей обработки и обобщения обширного статистического материала во всех областях научно-практической деятельности. Однако теория вероятностей как математическая наука не могла сформироваться на материале указанных выше практических задач в силу их сложности. В них законы, управляющие случайными явлениями, проступают недостаточно отчетливо и затушеваны многими осложняющими факторами. Необходимо было сначала изучить закономерности случайных явлений на более простом материале. Таким материалом исторически оказались так называемые азартные игры. Эти игры с незапамятных времен создавались рядом поколений именно так, чтобы в них исход опыта был независим от поддающихся наблюдению условий опыта, был чисто случайным. Само слово «азарт» (фр. «le hasard») означает «случай». Схемы азартных игр дают исключительные по простоте и прозрачности модели случайных явлений, позволяющие в наиболее отчетливой форме наблюдать и изучать управляющие ими специфические законы. Возможность неограниченного повторения одного и того же опыта обеспечивает экспериментальную проверку этих законов в условиях действительной массовости явлений. Вплоть до настоящего времени примеры из области азартных игр и аналогичные им задачи на «схему урн» широко употребляются при изучении теории вероятностей в качестве упрощенных моделей случайных явлений, иллюстрирующих в наиболее простом и наглядном виде основные законы и правила теории вероятностей. Возникновение теории вероятностей в современном смысле слова относится к середине XVII в. и связано с исследованиями Б. Паскаля (1623–1662), П. Ферма (1601–1665) и Х. Гюйгенса (1629–1695) в области теории азартных игр. В этих работах постепенно сформировались такие важные понятия, как вероятность и математическое ожидание, были установлены основные свойства этих понятий и разработаны приемы вычисления. Непосредственное практическое применение вероятностные методы нашли, прежде всего, в задачах страхования. Уже с конца XVII в. страхование стало производиться на научной математической основе. С тех пор теория вероятностей находит все более широкое применение в различных областях. Значительный шаг вперед в развитии теории вероятностей связан с работами Я. Бернулли (1654–1705). Ему, в частности, принадлежит первое доказательство одного из важнейших положений теории вероятностей, называемого законом больших чисел. Многие исследователи отмечали как эмпирический факт ту особенность случайных явлений, которую можно назвать «свойством устойчивости частот при большом числе опытов». Было неоднократно подтверждено, что при большом числе опытов, исход каждого из которых является случайным, относительная частота появления каждого возможного исхода имеет тенденцию стабилизироваться, приближаясь к некоторому определенному числу – вероятности этого исхода. Например, если много раз бросать монету, относительная частота появления герба приближается к 13 1 ; при многократном 2 бросании игральной кости частота появления грани, например, с пятью очками приближается к 1 и т. д. 6 Яков Бернулли впервые предложил теоретическое обоснование этому эмпирическому факту. Теорема Бернулли, являясь простейшей формой закона больших чисел, устанавливает связь между вероятностью события и частотой его появления и утверждает, что при достаточно большом числе опытов можно с практической достоверностью ожидать сколь угодно близкого совпадения частоты с вероятностью. Другой важный этап в развитии теории вероятностей связан с именем английского математика А. Муавра (1667–1754). Этот ученый впервые ввел в рассмотрение и для простейшего случая обосновал своеобразный закон, очень часто наблюдаемый в случайных явлениях и называемый нормальным. Нормальный закон играет исключительно важную роль в случайных явлениях. Теоремы, обосновывающие этот закон для тех или иных условий, в теории вероятностей носят общее название «центральной предельной теоремы». Значительный вклад в развитие теории вероятностей внес знаменитый французский математик П. Лаплас (1749–1827). Ему принадлежит первое логически стройное и систематическое изложение основ теории вероятностей, доказательство одной из форм центральной предельной теоремы (теоремы Муавра– Лапласа). В его работах также содержится ряд замечательных приложений теории вероятностей к вопросам практики, в частности, к анализу ошибок наблюдений и измерений. Существенный вклад в развитие научной теории вероятностей внес К. Гаусс (1777–1855), который предложил более общее обоснование нормального закона и разработал метод обработки экспериментальных данных, известный под названием «метод наименьших квадратов». Следует также отметить работы С. Пуассона (1781–1840), доказавшего более общую, чем у Я. Бернулли, форму закона больших чисел, а также впервые применившего теорию вероятностей к задачам стрельбы. С именем Пуассона связан один из законов распределения, играющий значительную роль в теории вероятностей и ее приложениях. Для всего XVIII в. и начала XIX в. характерны бурное развитие теории вероятностей и повсеместное увлечение ею. Теория вероятностей становится «модной» наукой. Ее начинают применять не только там, где это применение правомерно, но и там, где оно ничем не оправдано. Для этого периода характерны многочисленные попытки применить теорию вероятностей к изучению общественных явлений, к так называемым «моральным» или «нравственным» наукам. Во множестве появились работы, посвященные вопросам судопроизводства, истории, политики, даже богословия, в которых применялся аппарат теории вероятностей. Для всех этих псевдонаучных исследований характерен чрезвычайно упрощенный механистический подход к рассматриваемым в них общественным явлениям. В основу рассуждения полагаются некоторые произвольно заданные вероятности (например, при рассмотрении вопросов судопроизводства склонность каждого человека к правде или лжи оценивается некоторой постоянной, одинаковой для всех людей вероятностью), и далее общественная проблема ре14 шается как простая арифметическая задача. Естественно, что все подобные попытки были обречены на неудачу и не могли сыграть положительной роли в развитии науки. Напротив, их косвенным результатом оказалось то, что примерно к середине XIX в. в Западной Европе повсеместное увлечение теорией вероятностей сменилось разочарованием и скептицизмом. На теорию вероятностей стали смотреть как на науку сомнительную, второсортную, род математического развлечения, вряд ли достойную серьезного изучения. Замечательно, что именно в это время в России создается та знаменитая Петербургская математическая школа, трудами которой теория вероятностей была поставлена на прочную логическую и математическую основу и превратилась в надежный, точный и эффективный метод познания. Со времени появления этой школы развитие теории вероятностей уже теснейшим образом связано с работами российских ученых. Среди представителей Петербургской математической школы следует назвать В. Я. Буняковского (1804–1889), который является автором первого курса теории вероятностей на русском языке, создателем современной русской терминологии в теории вероятностей, инициатором оригинальных исследований в области статистики и демографии. Учеником В. Я. Буняковского являлся великий русский математик П. Л. Чебышев (1821–1894), среди обширных и разнообразных математических трудов которого заметное место занимают работы по теории вероятностей. П. Л. Чебышеву принадлежит дальнейшее расширение и обобщение закона больших чисел. Кроме того, П. Л. Чебышев ввел в теорию вероятностей весьма мощный и плодотворный метод моментов. Учеником П. Л. Чебышева был А. А. Марков (1856–1922), также обогативший теорию вероятностей открытиями и методами большой важности. Он существенно расширил область применения закона больших чисел и центральной предельной теоремы, распространив их не только на независимые, но и на зависимые испытания. Важнейшей заслугой А. А. Маркова явилось то, что он заложил основы совершенно новой ветви теории вероятностей – теории случайных, или «стохастических», процессов. Развитие этой теории составляет основное содержание новейшей, современной теории вероятностей. Учеником П. Л. Чебышева был и А. М. Ляпунов (1857–1918), с именем которого связано первое доказательство центральной предельной теоремы при чрезвычайно общих условиях. Для доказательства своей теоремы А. М. Ляпунов разработал специальный метод характеристических функций, широко применяемый в современной теории вероятностей. Характерной особенностью работ Петербургской математической школы является исключительная четкость постановки задач, полная математическая строгость применяемых методов и, наряду с этим, тесная связь теории с непосредственными требованиями практики. Благодаря трудам ученых Петербургской математической школы вырос научный престиж теории вероятностей, которая превратилась в полноценную область точной математической науки. Условия применения ее методов были строго определены, а сами методы доведены до высокой степени совершенства. 15 Современному периоду развития теории вероятностей присущ всеобщий подъем интереса к ней и резкое расширение круга ее практических применений. За последние десятилетия теория вероятностей превратилась в одну из наиболее быстро развивающихся наук, теснейшим образом связанную с потребностями практики и техники. Советская школа теории вероятностей, унаследовав традиции Петербургской математической школы, занимает в мировой науке ведущее место. Отметим некоторых крупнейших советских ученых, труды которых сыграли решающую роль в становлении современной теории вероятностей и развитии ее практических приложений. С. Н. Бернштейн разработал первую законченную аксиоматику теории вероятностей, а также существенно расширил область применения предельных теорем. А. Я. Хинчин известен своими исследованиями в области дальнейшего обобщения и усиления закона больших чисел, трудами в области стационарных случайных процессов. Ряд важнейших основополагающих работ в различных областях теории вероятностей и математической статистики принадлежит А. Н. Колмогорову. Он предложил наиболее совершенное аксиоматическое построение теории вероятностей, связав ее с одним из важнейших разделов современной математики – метрической теорией функций. Особое значение имеют работы А. Н. Колмогорова в области теории случайных функций (стохастических процессов), которые в настоящее время являются основой всех исследований в данной области. Работы А. Н. Колмогорова, относящиеся к оценке эффективности, легли в основу целого нового научного направления в теории стрельбы, переросшего затем в более широкую науку об эффективности боевых действий. Развитие зарубежной теории вероятностей в настоящее время также идет усиленными темпами в связи с настоятельными требованиями практики. Преимущественным вниманием пользуются, как и у нас, вопросы, относящиеся к случайным процессам. Значительные работы в этой области принадлежат, например, Н. Винеру, В. Феллеру, Д. Дубу. Важные работы по теории вероятностей и математической статистике принадлежат Р. Фишеру, Д. Нейману и Г. Крамеру. В последние годы происходит зарождение новых и своеобразных методов прикладной теории вероятностей, появление которых связано со спецификой исследуемых технических проблем. Речь идет, в частности, о таких новых дисциплинах, как «теория информации» и «теория массового обслуживания». Возникшие из непосредственных потребностей практики, эти разделы теории вероятностей приобретают общее теоретическое значение, а круг их приложений быстро увеличивается. Каждая наука при изучении явлений материального мира оперирует теми или иными понятиями, среди которых обязательно имеются основополагающие. Например, в геометрии такую роль играют понятия точки, прямой, плоскости, в математическом анализе – функция и ее предел. Для теории вероятностей основными являются понятия испытания и события. Под событием понимается всякий факт, который может произойти или не произойти в результате некоторого испытания (опыта, наблюдения, эксперимента). 16 Под испытанием в этой трактовке понимается выполнение определенного комплекса условий, при наличии которых может наступить некоторое событие. Таким образом, событие является результатом испытания. Теория вероятностей изучает случайные события. Событие называется случайным, если в результате некоторого испытания оно может произойти или не произойти. Рассмотрим простейшие примеры. 1. Если в качестве испытания проводится подбрасывание монеты, то возможны два различных исхода, т. е. два события: появление «цифры» и появление «герба». 2. Если из коробки с цветными шарами наудачу вынимают один шар, то извлечение шара из коробки есть испытание, а появление шара определенного цвета – событие. 3. Если испытание состоит в том, что два стрелка производят по одному выстрелу по цели, то среди возможных исходов можно выделить четыре события: попадание обоих стрелков, их совместный промах, попадание первого при промахе второго и попадание второго при промахе первого. Случайные события в дальнейшем будем обозначать заглавными буквами латинского алфавита A , B , C , … Следует подчеркнуть, что теория вероятностей не может предсказать, произойдет или не произойдет единичное случайное событие, так как изучает закономерности массовых случайных событий. Классификация случайных событий В результате определенного испытания могут наблюдаться события, которые обязательно произойдут. Например, вынуть красный шар из коробки, в которой находятся только красные шары – событие, которое обязательно произойдет. Событие называется достоверным, если в результате данного испытания оно обязательно произойдет. На практике встречаются события, которые в результате испытания не могут произойти, сколько бы раз мы его ни проводили. Например, вынуть черный шар из коробки, в которой находятся красные шары – событие невозможное. Событие называется невозможным, если в результате данного испытания оно заведомо не произойдет. Итак, по степени возможности появления события подразделяют на: – достоверные; – невозможные; – случайные (возможные). Достоверные события будем обозначить буквой I, а невозможные – символом . Как отмечалось выше, в результате испытания возможно появление того или иного события. Некоторые из возможных в данном испытании событий могут наступить вместе. Кроме этого в результате испытания может возникнуть и 17 другая ситуация, когда появление одного из возможных в данном случае событий обязательно исключает появление определенного другого события. Пусть бросается игральный кубик. В результате этого испытания могут наступить такие события: – A – «на верхней грани четное число очков»; – B – «число очков на верхней грани равно 3»; – C – «на верхней грани 6 очков». Ограничимся этими событиями, хотя их список можно было продолжить. Появление на верхней грани кубика трех очков исключает появление шести очков, поэтому события B и C будем называть несовместными. Событие, состоящее в выпадении четного числа очков, не исключает появление события, согласно которому выпадает число очков, равное шести, поскольку число 6 является четным. Такие события, как A и C , будем называть совместными. События называются несовместными, если в результате данного испытания появление одного из них исключает появление другого. Несовместные события можно наглядно изобразить посредством диаграмм Эйлера (рис. 1). В B A Рисунок 1. Несовместные события События называются совместными, если в результате данного испытания появление одного из них не исключает появление другого. Совместные события также можно представить посредством диаграмм Эйлера (рис. 2). А В Рисунок 2. Совместные события Важным понятием теории вероятностей является понятие полной группы событий. Рассмотрим на примере множество событий, которые могут произойти в результате некоторого испытания. Пусть произведено два выстрела по мишени. Выделим события, которые могут произойти в результате этого испытания: – А – два попадания в мишень; – В – попадание при первом выстреле и промах при втором; – С – попадание при втором выстреле и промах при первом; 18 – D – промах при обоих выстрелах. События A, B, C и D задают полную группу событий, так как других событий при данном испытании быть не может и какое-то одно из них обязательно произойдет. В результате опыта обязательно произойдет хотя бы одно из этих событий, неважно какое, причем любые два события несовместны. На основании рассматриваемого примера сформулируем определение полной группы событий. Если события попарно несовместны и в результате испытания одно из них обязательно происходит, то эти события образуют полную группу событий. Частным случаем событий, образующих полную группу, являются противоположные события. Два несовместных события, образующих полную группу, называются противоположными. Например, «появление герба» и «появление цифры» при однократном подбрасывании монеты, «отсутствие бракованных изделий» и «наличие хотя бы одного бракованного изделия» в партии – события противоположные. Если одно из двух противоположных событий обозначить через A , то другое принято обозначать A (читается «не A »). Предположим, что в коробке находятся десять одинаковых на ощупь шаров, пронумерованных от 1 до 10. Из коробки извлекается один шар. Появление шара, например, под номером 3 не является событием более возможным, чем шара под любым другим номером. Если по условию испытания нет оснований считать, что какое-либо из событий более возможно, чем другое, то данные события называются равновозможными. Классическое определение вероятности В повседневной жизни в разговоре часто используется слово «вероятный» Например, «к вечеру, вероятно, пойдет дождь», «это невероятный случай», «вероятнее всего он опоздает». При употреблении этого слова интуитивно оценивается возможность наступления того или иного события. Можно сказать, что одно событие наступает чаще, чем другое. В этом случае говорят, что оно более возможно, т. е. его наступление более вероятно. Естественно, при такой оценке человеку помогает здравый смысл и жизненный опыт. Пусть, например, в ящике находятся 20 одинаковых на ощупь шаров, среди которых 10 шаров красного цвета и по пять шаров белого и черного цветов. Наудачу вынимается один шар. В данном случае разумно считать события «вынут красный шар» более возможным, чем события «вынут белый шар» или «вынут черный шар», так как шаров красного цвета значительно больше, чем шаров белого или черного цветов. Очевидно, события «вынут белый шар» и «вынут черный шар» имеют одинаковую возможность появления, поскольку количество этих шаров одинаково. Однако в жизни чаще встречаются события, сравнивать или оценить возможности появления которых, основываясь на чисто интуитивных соображениях, трудно. Например, это можно сказать про события ««герб» появился два раза при пятикратном бросании монеты», «во время решения задачи отказал ЭВМ» и т. д. 19 Как видно из приведенных примеров, каждое событие обладает определенной степенью возможности наступления, т. е. определенной оценкой. Такую оценку события принято называть вероятностью события. Вероятность является численной мерой объективной возможности появления события. Существуют различные подходы к определению вероятности случайных событий. Классический подход. Исторически первым и наиболее доступным для понимания является метод непосредственного подсчета вероятности события, в основе которого лежит классическое определение вероятности события. Пусть проводится опыт, в результате которого могут наступить те или иные события. Если эти события образуют полную группу попарно несовместных и равновозможных событий, то говорят, что опыт «сводится к схеме случаев». Случаем называют каждое из событий (исходов), принадлежащих выделенной полной группе. Для опытов, которые сводятся к схеме случаев, применима классическая формула вероятности. Вероятностью события A называют отношение числа исходов, благоприятствующих этому событию, к общему числу всех равновозможных несовместных элементарных исходов, образующих полную группу: P A m , n (1) где m – число исходов, благоприятствующих событию A ; n – общее число равновозможных несовместных элементарных исходов, образующих полную группу. Из определения вероятности непосредственно вытекают следующие ее свойства. Свойство 1. Вероятность достоверного события равна единице. Действительно, если событие достоверно, то каждый элементарный исход испытания благоприятствует событию. В этом случае m n , следовательно, P A m n 1. n n Свойство 2. Вероятность невозможного события равна нулю. Действительно, если событие невозможно, то ни один из элементарных исходов испытания не благоприятствует событию. В этом случае m 0 , следовательно, P A m 0 0. n n Свойство 3. Вероятность случайного события есть положительное число, заключенное между нулем и единицей. Действительно, случайному событию благоприятствует лишь часть из общего числа элементарных исходов испытания. В этом случае 0 m n , значит, 0 m 1 , следовательно, 0 P A 1 . n 20 Итак, вероятность любого события удовлетворяет двойному неравенству 0 P A 1 . Покажем на примерах возможности применения классического определения вероятности события, в которых вероятность случайного события вычисляется по формуле (1). Пример 1. Однократно бросается игральная кость. Найти вероятность, что на верхней грани выпадет 5 очков. Решение. Обозначим событие, вероятность которого следует найти через A . Число всех исходов испытания равно n 6 , число благоприятствующих исходов равно m 1 . В соответствии с классическим определением вероятности получаем: P A m 1 . n 6 В соответствии с классическим определением вероятности получаем P A 5 0,56 . 9 Пример 2. Подбрасываются два игральных кубика, и подсчитывается сумма очков на верхних гранях. Найти вероятность события, состоящего в том, что на верхних гранях кубиков сумма очков равна 7. Решение. Обозначим через A событие, состоящее в том, что на верхних гранях кубиков сумма очков равна 7. Так как подбрасываются два кубика (у каждого кубика 6 граней), то в этом испытании общее число равновозможных элементарных исходов n 6 6 36 . Событию A благоприятствуют 6 исходов: 1;6 , 6;1 , 2;5 , 5; 2 , 3; 4 , 4;3 , т. е. m 6 . В соответствии с классическим определением вероятности: P A 6 1 0,17 . 36 6 Пример 3. Среди изготовленных пятнадцати деталей имеется пять нестандартных. Определить вероятность того, что произвольно взятые три детали окажутся стандартными? Решение. Обозначим через A событие, состоящее в том, что произвольно взятые три детали являются стандартными. Общее число возможных элементарных исходов испытания равно числу способов, которыми можно извлечь 3 детали из 15: n C153 15! 13 14 15 455 . 3!12! 1 2 3 Число исходов, благоприятствующих событию A , равно числу сочетаний из 10 элементов по 3: 21 m C103 10! 8 9 10 120 . 3! 7! 1 2 3 Тогда искомая вероятность равна P A 120 0, 26 . 455 Геометрическая вероятность. Естественно, что рассмотренная простейшая классическая модель вероятности не может быть применена ко всем возникающим в процессе научно-практической деятельности случайным явлениям и процессам. Чтобы преодолеть недостаток классического определения, связанный с тем, что его нельзя применить к испытаниям с бесконечным числом исходов, вводят понятие геометрической вероятности. Рассмотрим еще одну простую модель вероятностного пространства, в некотором смысле аналогичную классической модели, в основе которой лежит пространство элементарных событий, состоящее из бесконечного числа элементов (несчетное множество). Пусть, например, на плоскости имеется некоторая область G и в ней содержится некоторая другая область g G (рис. 3). В области G произвольно выбирается точка. Требуется определить вероятность того, что точка попадет в область g. Уточним смысл поставленной задачи и раскроем сущность используемых терминов. G g g1 x Рисунок 3 Будем говорить, что в области G произвольно выбрана точка, если: 1) отмеченная точка обязательно попадает в область G, причем она может попасть в любую точку этой области; 2) вероятность попасть в некоторую часть g области G пропорциональна мере этой части (длине, площади и т. д.) и не зависит от ее расположения относительно G и формы. Вероятность события А, означающего попадание в область g G при произвольном выборе точки х в область G, определяется по формуле: P А мера g . мера G 22 (2) В частности, если область g1 G такова, что мера g = мера g1, то P( x g ) P( x g1 ) . Описанное выше понятие вероятности носит название геометрической вероятности. Геометрической вероятностью события А называется отношение меры области, благоприятствующей появлению события А, к мере всей области. Для вычисления геометрической вероятности применяется формула (2). Приведем пример задачи, когда число возможных исходов бесконечно, и при нахождении вероятности события применяется понятие геометрической вероятности. Пример 4. На плоскости заданы две концентрические окружности, радиусы которых 5 см и 10 см соответственно. В большом круге произвольно отмечена точка. Найти вероятность того, что эта точка попадет в кольцо, образованное заданными окружностями? Решение. Обозначим через A событие, состоящее в том, что произвольно взятая точка попадет в кольцо, образованное заданными окружностями. Предположим, что вероятность попадания точки в плоскую фигуру пропорциональна площади этой фигуры и не зависит от ее расположения относительно большого круга. Воспользуемся понятием геометрической вероятности и вычислим вероятность события A по формуле (2). По условию фигура g – это кольцо, образованное двумя концентрическими окружностями с радиусами 5 см и 10 см. Площадь кольца вычисляем по формуле: S g (102 52 ) 75 . По условию фигура G – это круг с радиусом 10 см. Площадь большого круга вычисляем по формуле: SG 102 100 . 75 Вычислим искомую вероятность: P А 0,75 . 100 Априорно-частотный подход. Следует признать, что математические модели для классического и геометрического определения вероятностей имеют довольно ограниченное применение. Большинство практически важных случаев исследования случайных явлений не может быть основано на рассмотренных вероятностных пространствах. В реальных опытах не удается выделить равновозможные события. Каждое событие является результатом действия большого числа факторов. Там, где отсутствует полная информация, появляется случайность. В этих случаях вероятность события как степень его объективной возможности математически приходится определять иначе. Для того чтобы выяснить, произойдет или не произойдет некоторое событие при заданных условиях опыта, нужно, прежде всего, осуществить этот опыт. Предсказать результат единичного испытания можно лишь для достоверных или невозможных событий. Случайность же события вообще не видна при единичном испытании. 23 Практика показывает, что события, сами по себе случайные, в условиях массовости при неизменности условий опыта начинают подчиняться некоторым неслучайным закономерностям. Именно такого рода закономерности получили название вероятностных. Таким образом, вероятностные закономерности случайных событий могут проявиться лишь при большом числе испытаний, лишь для массовых событий. Рассмотрим в качестве простейшего примера испытание, состоящее в однократном подбрасывании монеты. Событием пусть будет выпадение герба. Невозможно предсказывать точно, выпадет или не выпадет герб при одном подбрасывании. Исходя из классического определения, вероятность выпадения герба равна 0,5 . Естественно, что многие исследователи предпринимали специальную экспериментальную проверку указанного факта. Так, французский естествоиспытатель Ж. Бюффон в XVIII в. и английский математик, биолог и философ К. Пирсон в XIX в., многократно повторяя опыт по бросанию монеты, получили следующие данные о числе выпадений герба (табл. 1). Таблица 1 Экспериментатор Число бросаний Бюффон К. Пирсон К. Пирсон 4040 12000 24000 Число выпадений герба 2048 6019 12012 Относительная частота 0,5069 0,5016 0,5005 Данные таблицы показывают, что относительная частота (частость) выпадений герба колеблется, приближаясь к числу 0,5, которое, исходя из симметрии монеты, теория дает как вероятность выпадения герба. Относительной частотой события А называется отношение числа испытаний, в которых событие произошло, к числу всех фактически проведенных испытаний. ( A) nA , n (3) где nA – частота (число) появлений события A; n – общее число повторяющихся испытаний; ( A) – относительная частота (частость) события A в рассматриваемой серии испытаний. Отметим, что относительная частота наряду с вероятностью принадлежит к основным понятиям теории вероятностей. Числовая характеристика случайного события, обладающая тем свойством, что для любой достаточно большой серии испытаний относительная частота события лишь незначительно отличается от этой характеристики, называется статистической вероятностью события. Свойства вероятности, вытекающие из классического определения, сохраняются и при статистическом определении вероятности. Отметим, что статистическое определение вероятности является самым широким по числу охватываемых событий. Единственное предъявляемое к со24 бытию требование заключается в принципиальной возможности проведения сколь угодно большого числа испытаний. Таким образом, в основе теории вероятностей лежит предположение о том, что рассматриваемые события обладают свойством статистической устойчивости, или устойчивости частот. Это, в частности, означает, что относительная частота события А стабилизируется при неограниченном возрастании n независимо от того, о какой серии испытаний идет речь. Переводя это утверждение на математический язык, можно записать, что существует предел вида: lim ( A) P( A) , n (4) причем величина Р(А) не зависит от того, к какой конкретно серии испытаний относится ( A) . Это предельное значение, равное величине Р(А), и называется вероятностью события А. Аксиоматический подход. Обобщение свойств частоты случайного события позволило построить теорию вероятностей с позиций аксиоматического метода построения научной теории. Согласно системе аксиом, разработанной А. Н. Колмогоровым, числовая функция P( A) называется вероятностью события A , если она удовлетворяет системе аксиом. Например, в качестве аксиом могут постулироваться следующие четыре утверждения. Аксиома 1 (неотрицательности). Вероятность P( A) является неотрицательным числом, заключенным между нулем и единицей: 0 P( A) 1. Аксиома 2 (нормировки). Вероятность достоверного события равна единице. Аксиома 3 (сложения). Вероятность суммы двух несовместных событий равна сумме вероятностей этих событий, т. е.: Р(А + В) = Р(А) + Р(В). Аксиома 4 (однозначности). Если A B , то P A P B . Эквивалентные события имеют равные вероятности. Заметим, что в классическом случае формула суммы вероятностей доказывается как теорема. При аксиоматическом построении теории эта формула принимается за аксиому. Основным этапом в создании математической модели того или иного эксперимента является построение так называемого вероятностного пространства. Вероятностным пространством называется упорядоченная тройка множеств вида (, S , P) , где – произвольное пространство элементарных событий, S – допустимое множество составных событий (подмножеств ), Р – множество вероятностей элементарных событий. Непосредственной проверкой можно установить, что сформулированные аксиомы 1–4 аналогичны соответствующим свойствам относительной частоты 25 события. Этим подтверждается естественная связь между статистическим, базирующимся на эмпирических данных, и аксиоматическим, отражающим формальную точку зрения, подходами к определению вероятности события. В начальном варианте система аксиом вероятностного пространства была предложена А. Н. Колмогоровым в 1929 г. Заметим, что аксиомы 1–4 в качестве свойств меры были сформулированы еще в 1901 г. французским математиком А. Лебегом. Первая по времени аксиоматика в теории вероятностей была разработана отечественным математиком С. Н. Бернштейном. Лекция 2.2. Теоремы сложения и умножения вероятностей Применение рассмотренных выше прямых методов вычисления вероятностей случайных событий не всегда эффективно, а иногда и просто невозможно. На практике искомую вероятность часто находят косвенными методами, позволяющими по известным вероятностям одних событий находить вероятности других связанных с ними событий. В основе этих косвенных методов лежат основные теоремы теории вероятностей. Операции над событиями Рассмотрим основные действия, которые можно применять к событиям. Сформулируем понятие суммы событий. Суммой нескольких событий называется событие, состоящее в том, что в результате испытания произойдет хотя бы одно из них. Сумму событий, по аналогии с числами, будем обозначать знаком «+». В данном случае знак «+» заменяет союз «или». Если события A и B совместны, то сумма событий A B сводится к появлению или события A , или события B , или A и B вместе. Рассмотрим пример. Пусть событие A – «поражение цели при первом выстреле», событие B – «поражение цели при втором выстреле». Тогда суммой событий A B будет поражение цели либо при первом выстреле, либо при втором, либо при первом и втором выстрелах вместе. Если события A и B несовместны, то возможность появления их вместе отпадает, а поэтому их сумма сводится к появлению либо события A , либо события B . Рассмотрим пример. В коробке красные и черные шары. Вынимается один шар. Возможны следующие события: A – «вынут красный шар», B – «вынут черный шар». События A и B несовместны, поэтому их сумма сводится к появлению шара только одного из имеющихся цветов. Если условимся наступление события обозначать знаком «+», а ненаступление знаком «», то полную характеристику события A B можно представить таблицей (табл. 1). Таблица 1 A B 26 A B + + + + + + + Сформулируем понятие произведения событий. Произведением нескольких событий называется событие, состоящее в совместном появлении всех этих событий в результате испытания. Произведение событий будем обозначать знаком « ». В данном случае знак « » заменяет союз «и». Рассмотрим пример. Пусть заданы следующие события: A – из колоды карт вынута «дама», B – из колоды карт вынута карта бубновой масти. Тогда произведение AB означает событие «вынута бубновая дама». Таблица, характеризующая событие A B , имеет вид (табл. 2). Таблица 2 A B A B + + + + + Сложные события можно представить в виде комбинаций элементарных событий, в которых используются операции над событиями. Рассмотрим алгоритм составления сложного события. Пусть рассматривается опыт и связанное с ним сложное событие A , тогда событие A можно выразить через элементарные события. Для этого нужно: 1) выделить простейшие элементарные события, образующие для данного опыта полную группу: A1 , A2 , …, An ; 2) выразить через элементарные события и противоположные им события с помощью операций сложения, умножения необходимое для решения поставленной задачи сложное событие А. Пример 1. Стрелок произвел 3 выстрела по мишени. Элементарные события: A1 – не попал при 1-м выстреле; A1 – попал при 1-м выстреле; A2 – не попал при 2-м выстреле; A2 – попал при 2-м выстреле; A3 – не попал при 3-м выстреле. A3 – попал при 3-м выстреле; Через элементарные события A1 , A2 , A3 и противоположные им события A1 , A2 , A3 выразим следующие сложные события: а) одно попадание: A A1 A2 A3 A1 A2 A3 A1 A2 A3 ; б) три попадания: B A1 A2 A3 ; в) два попадания: C A1 A2 A3 A1 A2 A3 A1 A2 A3 . 27 Теорема сложения вероятностей Теория вероятностей позволяет определять вероятность события по известным вероятностям других событий, если последние связаны с первым. В этом случае используют теоремы сложения и умножения вероятностей. Эти теоремы дают возможность найти вероятность появления одного или нескольких случайных событий или вероятность совместного наступления двух событий и более. Прежде чем рассматривать теорему сложения вероятностей, рассмотрим следующий пример. Пример 2. В ящике 12 белых, 7 черных и 11 синих одинаковых на ощупь шаров. Наудачу вынимается один шар. Какова вероятность того, что вынутый шар не белый? Решение. Количество всех шаров в ящике равно 30, т. е. число всех исходов испытания, заключающегося в вынимании одного шара, равно n 30 . Если вынутый шар не белый, то это означает, что он либо черный, либо синий. Вынуть либо черный, либо синий шар по правилу сложения можно 7 11 18 способами. Следовательно, число исходов, благоприятствующих событию C , которое состоит в вынимании не белого шара, равно m 18 . Тогда P C m 18 0, 6 . n 30 Пусть теперь событие A – появился черный шар, а событие B – появился синий шар. Найдем вероятности этих событий. 7 11 , P B . Сложив полученные вероятности, получим 30 30 7 11 18 P A P B 0, 6 P C . 30 30 30 Заметим, что событие С является суммой событий A и B , т. е. C A B . Имеем P A Полученный результат обобщим в виде следующей теоремы. Теорема. Вероятность появления одного из двух несовместных событий, безразлично какого, равна сумме вероятностей этих событий, т. е.: P A B P A P B . (1) Доказательство. Введем обозначения: n – общее число возможных элементарных исходов испытания; m1 – число исходов, благоприятствующих событию A ; m2 – число исходов, благоприятствующих событию B . Число элементарных исходов, благоприятствующих наступлению либо соA, B, m1 m2 . бытия либо события равно Следовательно, P A B m1 m2 m1 m2 . n n n 28 Приняв во внимание, что P A P A B P A P B . m1 m , P B 2 , окончательно получим n n Данную теорему можно обобщить на любое конечное число попарно несовместных событий. Теорема. Вероятность появления одного из нескольких попарно несовместных событий равна сумме вероятностей этих событий: P A1 A2 ... An n P A1 P A2 ... P An P Ai . i 1 Рассмотрим следствия из теоремы сложения для несовместных событий. Следствие 1. Если несовместные события A1 , A2 , …, An образуют полную группу, то сумма вероятностей этих событий равна единице: P A1 P A2 ... P An 1 . (2) Следствие 2. Сумма вероятностей противоположных событий равна единице: P A P A 1 . (3) Противоположные события образуют полную группу из двух несовместных событий. Поэтому рассматриваемый случай, т.е. формула (3), является частным случаем первого следствия, т.е. формулы (2). Однако второе следствие часто используют при решении практических задач, когда бывает легче вычислить вероятность противоположного события A , чем вероятность прямого события A . Пример 3. Круговая мишень состоит из трех зон. Вероятность попадания при одном выстреле в первую зону равна 0,1, во вторую 0,35, в третью 0,4. Найти вероятность промаха по мишени. Решение. Обозначим события: A – промах по мишени, A1 – попадание в первую зону, A2 – попадание во вторую зону, A3 – попадание в третью зону. Так как события A , A1 , A2 и A3 несовместные и образуют полную группу, то сумма вероятностей этих событий равна единице, т. е. тогда искомая вероятность равна P A P A1 P A2 P A3 1, P A 1 P A1 P A2 P A3 1 0,1 0,35 0, 4 0,15 . Рассмотренная выше теорема сложения вероятностей при вычислении вероятности суммы событий предусматривала их несовместность. Если же собы- 29 тия совместны, то формула вероятности их суммы будет иной. Убедимся в этом при решении следующего примера. Пример 4. Отдел технического контроля проверяет на стандартность по двум параметрам серию изделий. Было установлено, что у 8 из 25 изделий не выдержан только первый параметр, у 6 изделий – только второй, а у 3 изделий не выдержаны оба параметра. Наудачу берется одно из изделий. Какова вероятность того, что оно не удовлетворяет стандарту? Решение. Рассмотрим следующие события: A – у изделия не выдержан первый параметр, B – у изделия не выдержан второй параметр, C – изделие не удовлетворяет стандарту. Событию AB , состоящему в том, что у взятой детали не выдержаны оба параметра, благоприятствуют три исхода. Событию A благоприятствуют 8 3 11 исходов, а событию B благоприятствуют 6 3 9 исходов. Число нестандартных изделий равно 8 6 3 11 9 3 17 . Следовательно, событию C благоприятствуют 17 исходов. 17 11 9 3 11 9 3 . 25 25 25 25 25 11 9 3 С другой стороны, P A , P B , P AB . Поэтому можно запи25 25 25 сать P C P A P B P AB . Тогда P C Наступление события C означает, что у взятого наудачу изделия либо не выдержан первый параметр, либо второй, либо оба параметра вместе, т. е. C A B . Таким образом, можно записать P A B P A P B P AB 17 . 25 Полученный результат обобщим в виде следующей теоремы. Теорема. Вероятность суммы двух совместных событий равна сумме вероятностей этих событий без вероятности их совместного появления, т. е.: P A B P A P B P AB . (4) Теорему примем без доказательства. Пример 5. Два стрелка независимо друг от друга стреляют по одной цели. Вероятность поражения цели первым стрелком равна 0,8, вторым – 0,7. Какова вероятность поражения цели? Решение. Пусть A событие, состоящее в том, что цель поражена, A1 – цель поражена первым стрелком, A2 – цель поражена вторым стрелком. Событие A можно представить в виде суммы двух событий A1 и A2 , т. е. A A1 A2 . Учитывая, что события A1 и A2 совместные и независимые, то P A P A1 A2 P A1 P A2 P A1 P A2 0,8 0,7 0,8 0,7 0,94 . 30 Рассмотренную выше теорему можно обобщить на любое число совместных в совокупности событий. В частности, вероятность суммы трех совместных событий A , B и C определяется по формуле: P A B C P A P B P C P AB P AC P BC P ABC . (5) При вычислении вероятности суммы совместных событий требуется, как видно из формул, уметь находить вероятность произведений событий. В простейших случаях это не представляет трудности. Однако при решении более сложных задач нахождение вероятности произведения нескольких событий затруднительно. Теорема умножения вероятностей При совместном рассмотрении двух событий A и B часто возникает вопрос: насколько связаны эти события друг с другом, в какой мере наступление одного из них влияет на возможность наступления другого? Рассмотрим простой пример. Пример 6. В коробке 5 шаров, из них два черных и три белых. Из коробки вынимают один за другим два шара (шары в коробку не возвращаются). Определить вероятность того, что при втором извлечении будет белый шар. Решение. Обозначим за A событие, состоящее в том, что первый вынутый шар белый, B – второй вынутый шар белый. Если первый вынутый шар белый, то произошло событие A , тогда в ко2 4 1 2 робке осталось 4 шара, из них 2 белых, поэтому P1 B . Если произошло событие A , т. е. первый извлеченный шар черный, то в коробке осталось 4 ша3 4 ра, из них один черный и три белых, тогда P2 B . Найденные нами вероятности P1 B и P2 B называются условными вероятностями события B . Условной вероятностью P B / A называется вероятность события B , найденная в предположении, что событие A уже произошло. Обозначение условной вероятности события B при условии, что A наступило: P B / A . Условную вероятность будем рассматривать лишь для таких событий A , вероятность наступления которых отлична от нуля. Аналогично определяется условная вероятность P A / B . Сформулируем теорему умножения для зависимых событий. Теорема. Вероятность совместного появления двух событий равна произведению вероятности одного из них на условную вероятность другого, вычисленную в предположении, что первое событие уже наступило: 31 P AB P A P B / A . (6) Теорему примем без доказательства. Данную теорему можно обобщить на случай любого конечного числа событий: вероятность совместного появления нескольких событий равна произведению вероятности одного из них на условные вероятности всех остальных, причем вероятности каждого последующего события вычисляются в предположении, что все предыдущие события уже наступили: P A1 A2 ... An P A1 P A2 / A1 P A3 / A1 A2 ... P An / A1 A2 ...An1 . (7) Естественно предположить, что существуют события, для которых условная вероятность P B / A равна P B . Условие примера 6 можно изменить так, что условная вероятность P B / A станет равна P B . Для того чтобы P B / A P B необходимо, чтобы перед проведением каждого опыта система возвращалась в исходное состояние. Для этого после фиксации результата первого опыта вынутый шар нужно вернуть в коробку. Тогда второе и последующие испытания будут проводиться в одних и тех же начальных условиях. То есть наступление события A не изменяет вероятность наступления события B , что свидетельствует о независимости событий A и B . Два события называются независимыми, если появление любого из них не изменяет вероятность появления другого, т. е. P B P B / A . Сформулируем теорему умножения для независимых событий. Теорема. Вероятность совместного появления двух независимых событий равна произведению их вероятностей: P AB P A P B . (8) Доказательство. Пусть события A и B независимы, тогда должно выполняться равенство P B P B / A . Подставляя это равенство в формулу P AB P A P B / A , получаем P AB P A P B . Замечания. 1. Если наступление события A изменяет вероятность события B , то говорят о зависимости событий A и B , тогда вероятность произведения двух зависимых событий определяют по формуле (6). 32 2. Если наступление события A не изменяет вероятность события B , то говорят о независимости событий A и B , тогда вероятность произведения двух независимых событий определяют по формуле (8). Пример 7. В ящике имеется 15 стандартных и 8 нестандартных деталей. Из ящика вынимают одну за другой две детали (без возвращения). Найти вероятность того, что обе вынутые детали стандартные. Решение. Обозначим события: A – обе детали стандартные; A1 – первая вынутая деталь стандартная, A2 – вторая вынутая деталь стандартная. Выразим сложное событие A через элементарные A1 и A2 : А A1 А2 . События A1 и A2 зависимые, тогда по формуле (6) вероятность того, что две вынутые детали стандартные равна: Р( А) P A1 А2 P A1 P А2 / A1 15 14 0, 42 . 23 22 Пример 8. Курсант разыскивает нужную ему формулу в трех справочниках. Вероятность того, что формула содержится в первом справочнике, равна 0,6, во втором – 0,7, в третьем – 0,8. Найти вероятность того, что формула не содержится ни в одном справочнике. Решение. Обозначим события: A1 – формула находится в первом справочнике, A2 – формула находится во втором справочнике, A3 – формула находится в третьем справочнике. Выразим событие A – формула не содержится ни в одном справочнике через элементарные события A1 , A2 , A3 : A A1 A2 A3 . Учитывая, что события A1 , A2 и A3 независимые, то P A P A1 A2 A3 P A1 P A2 P A3 0, 4 0,3 0, 2 0,024 . Пример 9. Устройство состоит из трех независимо работающих элементов. Вероятность безотказной работы (за время t ) для первого элемента равна 0,6, для второго – 0,8, для третьего – 0,9. Найти вероятность, что за время t безотказно будут работать только два элемента. Решение. Обозначим события: A1 – первый элемент работает безотказно, A2 – второй элемент работает безотказно, A3 – третий элемент работает безотказно. Выразим событие A – за время t безотказно будет работать только один элемент через элементарные события A1 , A2 , A3 и им противоположные: A A1 A2 A3 A1 A2 A3 A1 A2 A3 . Тогда искомая вероятность события A равна: P A 0,6 0,8 1 0,9 0,6 1 0,8 0,9 1 0,6 0,8 0,9 0, 444 . 33 Пример 10. Руководители трех отделов фирмы составляют годовой отчет, вероятности сдачи работы в срок равны соответственно 0,6, 0,7 и 0,8. Найти вероятность того, что вовремя будет сдан только один отчет. Решение. Обозначим события. Пусть A – вовремя будет сдан только один отчет. Данное событие произойдет, если наступит одно из следующих элементарных событий: A1 – руководитель первого отдела сдаст вовремя годовой отчет, A2 – руководитель второго отдела сдаст вовремя годовой отчет, A3 – руководитель третьего отдела сдаст вовремя годовой отчет. Событие A можно представить в виде A A1 A2 A3 A1 A2 A3 A1 A2 A3 . Тогда искомая вероятность равна: P A 0,6 1 0,7 1 0,8 1 0,6 0,7 1 0,8 1 0,6 1 0,8 0,8 0,188 . Лекция 2.3. Формулы полной вероятности и Байеса Формула полной вероятности Одним из эффективных приемов подсчета вероятностей является применение так называемой формулы полной вероятности, с помощью которой решается широкий круг задач. Сначала получим формулу полной вероятности индуктивным методом рассуждений, рассмотрев пример. Пример 1. На объекте используются огнетушители двух заводовпроизводителей по 50 штук от каждого. Вероятность брака для каждого из заводов составляет 0,02, 0,04 соответственно. Найти вероятность того, что взятый наудачу огнетушитель бракованный. Решение. Пусть A – событие, состоящее в том, что взятый наудачу огнетушитель бракованный. Это событие может произойти лишь при условии, что огнетушитель изготовлен на одном из двух заводов: на первом или на втором (заранее неизвестно, на каком именно). Поэтому рассмотрим также события: H1 – огнетушитель изготовлен на первом заводе, H 2 – огнетушитель изготовлен на втором заводе. Событие A может произойти лишь при условии появления одного из несовместных событий H1 и H 2 . Другими словами, появление события A означает осуществление одного, безразлично какого, из несовместных событий: H1 A – огнетушитель, изготовленный на первом заводе бракованный, H 2 A – огнетушитель, изготовленный на втором заводе бракованный. Событие A есть сумма несовместных событий H1 A и H 2 A , тогда на основании теоремы сложения вероятностей получим: P A P H1 A H 2 A P H1 A P H 2 A . Кроме того, событие A зависит от событий H1 , H 2 . Применив к последнему выражению теорему умножения вероятностей, получим: 34 P A P H1 P A / H1 P H 2 P A / H 2 . Вероятность того, что извлеченный огнетушитель изготовлен первым заводом равна P H1 50 0,5 , вторым – P H 2 50 0,5 . Условная вероятность 100 100 того, что бракованный огнетушитель изготовлен на первом заводе, равна P A / H1 0,02 , на втором – P A / H 2 0,04 . Тогда искомая вероятность составляет P A 0,5 0,02 0,5 0,04 0,03 . В ходе решения примера 1 (индуктивным методом) по существу было проведено доказательство формулы полной вероятности (ФПВ). Рассмотрим дедуктивный метод обоснования ФПВ. С этой целью сформулируем и докажем теорему. Теорема. Вероятность события A , которое может наступить лишь при условии появления одного из несовместных событий H1 , H 2 , …, H n , образующих полную группу, равна сумме произведений вероятностей каждого из этих событий на соответствующую условную вероятность события A , т. е.: P A P H1 P A / H1 P H 2 P A / H 2 ... P H n P A / H n . (1) Компактная форма записи формулы полной вероятности: n P( A) P( H i ) P( A / H i ) . (2) i 1 Доказательство. По условию событие A может наступить, если наступит одно из несовместных событий H1 , H 2 , …, H n . Другими словами, появление события A означает осуществление одного, безразлично какого, из несовместных событий H1 A , H 2 A , …, H n A . Пользуясь для вычисления вероятности собыP A P H1 A H 2 A ... H n A A тия теоремой сложения, получим P H1 A P H 2 A ... P H n A . Применяя к событию AH i теорему умножения зависимых событий, получим: P A P H1 P A / H1 P H 2 P A / H 2 ... P H n P A / H n , что и требовалось доказать. Пример 2. На складе 1000 приборов, из которых 300 принадлежат к 1 партии, 200 – ко второй, остальные – к третьей. Для приборов первой партии брак составляет 6%, для второй – 5%, для третьей – 4%. Найти вероятность того, что произвольно выбранный прибор окажется бракованным. Решение. Пусть A – событие, состоящее в том, что произвольно выбранный прибор бракованный, H1 – прибор принадлежит первой партии, H 2 – прибор принадлежит второй партии, H 3 – прибор принадлежит третьей партии. 35 Вероятность того, что извлеченный прибор принадлежит первой партии, равна P H1 300 200 500 0,3 , второй – P H 2 0, 2 , третьей – P H 3 0,5 . 1000 1000 1000 Условная вероятность того, что бракованный прибор принадлежит первой партии, будет равна P A / H1 0,06 , второй партии – P A / H 2 0,05 , третьей – P A / H 3 0,04 . По формуле полной вероятности (1) найдем вероятность того, что выбранный прибор бракованный: P A 0,3 0, 06 0, 2 0, 05 0,5 0, 04 0, 048. Итак, полученная формула полной вероятности, являющаяся следствием теорем сложения и умножения вероятностей, позволяет находить вероятность события, которое может произойти с одним из несовместных событий, образующих полную группу. Формулы Байеса дают возможность переоценить вероятности гипотез после того, как становится известным результат испытания, в итоге которого появилось событие A . Вероятность гипотез. Формула Байеса Пусть событие A может наступить при условии появления одного из несовместных событий H1 , H 2 , …, H n , образующих полную группу. Поскольку заранее не известно, какое именно из этих событий наступит, будем их называть гипотезами. Вероятность появления события A определяется по формуле полной вероятности (1): P A P H1 P A / H1 P H 2 P A / H 2 ... P H n P A / H n . Допустим, что произведено испытание, в результате которого событие A произошло. Поставим задачу определить, как изменились вероятности гипотез в связи с тем, что событие A уже наступило. Другими словами, требуется найти условные вероятности P H1 / A , P H 2 / A , …, P H n / A . Найдем сначала условную вероятность P H1 / A . По теореме умножения имеем P AH1 P A P H1 / A P H1 A P H1 P A / H1 . Поскольку событие AH1 не отличается от события H1 A , то P A P H1 / A P H1 P A / H1 . Отсюда P H1 / A P H1 P A / H1 . P A Заменим P A по формуле 1 . В результате получим: P H1 / A P H1 P A / H1 . P H1 P A / H1 P H 2 P A / H 2 ... P H n P A / H n Аналогично выводятся формулы, определяющие условные вероятности остальных гипотез. Следовательно, условная вероятность любой гипотезы H i i 1, 2,...n может быть вычислена по формуле: 36 P H i / A P Hi P A / Hi . P A (3) Полученные формулы называют формулами Байеса. Формулы Байеса позволяют переоценить вероятности гипотез после того, как становится известным результат испытания, в итоге которого появилось событие A . Заметим, что содержащиеся в формуле (2) вероятности P H1 , P H 2 , …, P H 3 называются априорными вероятностями гипотез и известны до испытания, а искомыми являются P H1 / A , P H 2 / A , …, P H n / A – апостериорные вероятности, получаемые после проведения испытания. Значение формулы Байеса состоит в том, что при появлении события А, т. е. по мере получения новой информации, можно проверять и корректировать выдвинутые до испытания гипотезы (принятые решения, предполагаемые модели), основываясь на переходе от их априорных вероятностей к апостериорным. В этом заключается сущность подхода, называемого байесовским. С середины XX в. подход, разработанный еще в первой половине XVIII в. Т. Байесом, широко используется в самых разных областях научно-практической деятельности, в частности, для прогнозирования чрезвычайных ситуаций, корректировки управленческих решений, в программах обнаружения спама, при разработке искусственного интеллекта и т. д. Историческая справка. Томас Байес родился в 1702 г. в Лондоне, в семье одного из первых шести пресвитерианских священников Англии. По существовавшим среди кальвинистов правилам, как сын духовного лица, Байес получил сугубо домашнее образование. Рано проявив большие способности к математике, он пошел по стопам отца и в 1720-е гг. стал священником пресвитерианского прихода в городке Танбридж Уэллс, находившемся недалеко от Лондона. На духовной службе Байес оставался здесь вплоть до 1752 г., после отставки продолжал жить в это городке, здесь же и закончил свою жизнь 17 апреля 1761 г. Среди современных ему английских ученых Байес был человеком весьма известным и в 1742 г. был избран «в академики», т. е. в члены Лондонского королевского общества, даже несмотря на тот факт, что священником не было опубликовано ни одной работы по математике. Более того, при жизни Байеса под его именем не вышло, строго говоря, вообще ни одной научной работы. Единственная работа отца Байеса, опубликованная им под своим именем (в 1731 г.), носила сугубо теологический характер и имела характерное для той эпохи длинное название «Благость господня, или попытка доказать, что конечной целью божественного провидения и направления является счастье его созданий». Помимо этого, в 1736 г. Байесом анонимно была опубликована статья «Введение в теорию флюксий или в защиту математиков от нападок автора The Analyst (Комментатора)». Здесь Байес защищал ньютоновскую теорию дифференциального исчисления от атаки Джорджа Беркли (несколько позже получившего сан епископа в Клойне), пытавшегося с метафизических позиций раскритиковать «неправильные», на его взгляд, логические основания мощнейшей математической теории. 37 Что же касается фундаментального исследования Байеса в области теории вероятностей, то оно было изложено им в «Эссе о решении проблем в теории случайных событий». Эту работу математика лишь после его смерти обнаружил друг Ричард Прайс, который и переслал статью в академию. В 1764 г. это «Эссе» было опубликовано в «Трудах Лондонского королевского общества», откуда и берет начало мировая слава Т. Байеса. Пример 3. С первого автомата поступает 45% деталей, со второго – 30%, с третьего – 25%. Среди деталей изготовленных первым автоматом 5% негодных, вторым автоматом 10% негодных, третьим автоматом 8% негодных. Поступившая на сборку деталь негодная. Какова вероятность того, что она изготовлена на втором автомате? Решение. Пусть A – событие, состоящее в том, что поступившая на сборку деталь негодная. Предположим гипотезы: H1 – деталь изготовлена на первом автомате, H 2 – деталь изготовлена на втором автомате, H 3 – деталь изготовлена на третьем автомате. Вероятности гипотез равны P H1 0, 45 , P H 2 0,30 , P H3 0, 25 . Условные вероятности соответственно равны P A / H1 0,05 , P A / H 2 0,1 , P A / H 3 0,08 . Вероятность события A по формуле полной вероятности равна P A 0, 45 0,05 0,30 0,1 0, 25 0,08 0,0725 . Вероятность того, что изготовленная на втором автомате деталь негодная, по формуле Байеса P H 2 / A P H2 P A / H2 0,3 0,1 равна P H 2 / A 0, 41 . 0, 0725 P A Формула Байеса позволила переоценить вероятности гипотез после того, как стал известен результат испытания, в итоге которого появилось событие A , т. е. корректировать гипотезы на основе обновленных данных. Лекция 2.4. Повторение испытаний Формула Бернулли Пусть проводится n испытаний, в каждом из которых событие A может произойти или не произойти, причем вероятность события в каждом отдельном испытании постоянна, т. е. не меняется от испытания к испытанию. Несколько испытаний называются независимыми относительно события A , если вероятность события A в каждом из них не зависит от исходов других испытаний. Примером независимых испытаний может служить несколько подбрасываний монеты. Несколько последовательных выниманий из коробки одинаковых на ощупь, но разных по цвету шаров, также являются независимыми испытаниями, например, относительно появление красного шара, если шары каждый раз возвращаются назад и тщательно перемешиваются. Поставим задачу: вычислить вероятность того, что при n испытаниях событие A осуществится ровно m раз. 38 Пример 1. Производится три независимых выстрела по мишени, вероятность попадания в которую при каждом выстреле равна p . Найти вероятность того, что при трех выстрелах мы получим ровно два попадания. Решение. Обозначим события: A1 – попадание при первом выстреле, A2 – попадание при втором выстреле, A3 – попадание при третьем выстреле. Событие A – «стрелок попадет в цель ровно два раза» может произойти, если мишень будет поражена: 1) при первом и втором выстрелах; 2) при первом и третьем выстрелах; 3) при втором и третьем выстрелах. Таким образом, событие можно представить в виде: A A A1 A2 A3 A1 A2 A3 A1 A2 A3 . Применяя теорему сложения для несовместных событий и теорему умножения для независимых событий, имеем^ P A P A1 P A2 P A3 P A1 P A2 P A3 P A1 P A2 P A3 . Учитывая, что при каждом выстреле вероятность попадания равна p , т. е.: P A1 P A2 P A3 p , вероятность промаха по мишени обозначим через P A1 P A2 P A3 q . Тогда P A ppq pqp qpp . Каждое слагаемое в этой сумме отличается одно от другого лишь порядком появления p , что по условиям задачи не имеет значения. Число этих слагаемых равно числу сочетаний из 3 элементов по 2, тогда P A P3 2 C32 p 2q . Таким образом, если производится n независимых выстрелов, в каждом из которых событие A (попадание в мишень) происходит с одной и той же вероятностью p , и не происходит с вероятностью q 1 p , то вероятность того, что в этой серии выстрелов будет ровно m попаданий равна Pn m Cnm p m q nm . В общем случае имеет место теорема. Теорема. Если производится n независимых испытаний, в каждом из которых вероятность появления события A равна p , а вероятность его не появления равна q 1 p , то вероятность того, что событие A произойдет ровно m раз определяется формулой Бернулли: Pn m Cnm p m q nm или Pn m n! p m q nm . m! n m ! (1) Итак, реализация при проведении испытаний схемы Бернулли подразумевают выполнение следующих условий: 39 1) в каждом испытании возможны только два исхода A («успех») и A («неудача»); 2) вероятность «успеха» p в каждом испытании, как и «неудачи» q 1 p , во всех опытах постоянна; 3) испытания должны быть независимыми, т. е. в каждом из этих испытаний наступление (или ненаступление) некоторого события A не зависит от того, произошло ли оно в другом испытании. Пример 2. Вероятность попадания в мишень для стрелка равна 0, 7 . Найти вероятность того, что среди шести произведенных им выстрелов по мишени будет ровно четыре попадания. Решение. Вероятность попадания в мишень для стрелка постоянна и равна p 0,7 . Следовательно, вероятность промаха также постоянна и равна q 1 p 1 0,7 0,3 . Искомую вероятность вычисляем по формуле Бернулли (1): P6 4 C64 0, 74 0,32 6! 0, 7 4 0,32 0,32. 4! 6 4 ! Пример 3. Вероятность изготовления на станке-автомате нестандартной детали равна 0,02. Какова вероятность того, что среди наудачу взятых восьми деталей окажется более шести стандартных. Решение. Согласно условию задачи n 8 , q 0, 02 , p 1 q 0,98 . Появление более шести стандартных деталей означает, что среди взятых восьми деталей семь или восемь стандартных. Так как P8 7 C87 0,987 0,021 8! 0,987 0, 02 0,14 , P8 8 C88 0,988 0,020 0,988 0,85 , тогда искомая ве7! 8 7 ! роятность равна P8 7 P8 8 0,14 0,85 0,99 . Пример 4. Вероятность приема радиосигнала равна 0,9. Какова вероятность того, что при 5-кратной передаче сигнал будет принят хотя бы один раз? Решение. Так как n 5 , p 0,9 , q 1 p 1 0,9 0,1 , то вероятность того, что при 5-кратной передаче сигнал будет хотя бы один раз, равна: P A 1 P5 0 1 C50 0,90 0,15 1 0,15 0,99999 . Формула Бернулли (1), позволяет находить вероятность того, что событие A появится в n испытаниях ровно m раз. Пользоваться формулой Бернулли при больших значениях n достаточно трудно, так как формула требует выполнения действий над громадными числами. Пусть, например, требуется вычислить P300 200 при p 0,89 . В данном случае формула принимает вид 200 P300 200 C300 0,89200 0,11100 . Получить по указанной формуле более или менее точный результат практически невозможно. Естественно возникает вопрос о возможности вычисления интересующей нас вероятности без использования формулы Бернулли. 40 Локальная и интегральная теоремы Лапласа Приближенно найти вероятность появления события ровно m раз в n независимых испытаниях, если число испытаний достаточно велико, дает локальная теорема Лапласа. Теорема (локальная теорема Лапласа). Если вероятность p появления события A в каждом испытании постоянна и отлична от нуля и единицы, то вероятность Pn m того, что событие A появится в n испытаниях ровно m раз, приближенно равна (тем точнее, чем больше n ) значению функции: m np 1 1 x2 1 y e x , при x . npq npq 2 npq Теорему примем без доказательства. 2 2 1 x2 e Функцию x называют функцией Гаусса. Имеются таблицы, в 2 которых помещены значения функции x , соответствующие положительным значениям аргумента х. Для отрицательных значений аргумента пользуются теми же таблицами, так как функция x четна, т. е. x x . Итак, вероятность того, что событие A появится в n независимых испытаниях ровно m раз приближенно равна: 1 m np Pn m x , где x . (2) npq npq Пример 5. Найти вероятность того, что событие A наступит ровно 80 раз в 240 испытаниях, если вероятность появления этого события в каждом испытании равна 0,3. Решение. Согласно условию задачи n 240 , m 80 , p 0,3 , q 1 0,3 0,7 . Найдем значение x : x m np 80 240 0,3 8 1,13 . npq 240 0,3 0, 7 50, 4 По таблице значений функции Гаусса найдем 1,13 0, 2107 . Вероятность того, что событие A наступит ровно 80 раз в 240 испытаниях, равна P240 80 1 0, 2107 0, 03 . 240 0,3 0, 7 Пример 6. На заводе рабочий за смену изготавливает 100 деталей. Вероятность того, что деталь окажется первого сорта равна 0,9. Какова вероятность того, что из 100 деталей сделанных рабочим 96 будут первого сорта? 41 Решение. Согласно условию задачи n 100 , m 96 , p 0,9 , q 1 0,9 0,1 . Найдем значение x : x m np 96 100 0,9 6 2. npq 100 0,9 0,1 3 По таблице значений функции Гаусса найдем 2 0,0540 . Вероятность того, что из 100 деталей сделанных рабочим 96 будут первого сорта, равна P100 96 1 0, 0540 0, 018 . 100 0,9 0,1 Возникает вопрос: как вычислить вероятность того, что событие A появится в n испытаниях не менее m1 и не более m2 раз? На этот вопрос отвечает интегральная теорема Лапласа. Теорема (интегральная теорема Лапласа). Если вероятность p наступления события A в каждом испытании постоянна и отлична от нуля и единицы, то вероятность Pn m1; m2 того, что событие A появится в n испытаниях от m1 до раз, приближенно равна определенному интегралу m2 1 Pn m1 ; m2 2 x2 e z2 2 dz , где x1 x1 m np m1 np , x2 2 . npq npq Теорему примем без доказательства. При решении задач, требующих применения интегральной теоремы Лапласа, пользуются специальными таблицами, так как неопределенный интеx2 грал вида e z2 2 dz не выражается через элементарные функции. x1 Для того чтобы можно было пользоваться таблицей функции Лапласа, 1 преобразуем соотношение Pn m1; m2 2 Pn m1 ; m2 1 2 x2 e 0 z2 2 1 2 0 e z2 2 x1 e e z2 2 z2 2 dz так: x1 dz x1 1 dz 2 x2 1 2 x2 e z2 2 dz 0 dz Ф x2 Ф x1 . 0 Итак, вероятность того, что событие A появится в n независимых испытаниях от m1 до m2 раз равна: Pn m1; m2 Ф x2 Ф x1 , где x1 42 m1 np m np , x2 2 . npq npq (3) Функцию Ф x называют функцией Лапласа. Имеются таблицы, в которых помещены значения функции Ф x , соответствующие положительным значениям аргумента х. Для отрицательных значений аргумента пользуются теми же таблицами, учитывая, что функция Ф x является нечетной, т. е. Ф x Ф x . Приведем пример, иллюстрирующий применение интегральной теоремы Лапласа. Пример 7. Вероятность того, что деталь не прошла проверку ОТК, равна 0,2. Найти вероятность того, что среди 400 случайно отобранных деталей от 70 до 100 деталей не пройдут проверку ОТК. Решение. По условию p 0, 2 , q 1 0, 2 0,8 , n 400 , m1 70 , m2 100 . Вычислим нижний и верхний предел интегрирования: x1 70 400 0, 2 400 0, 2 0,8 100 400 0, 2 20 10 2,5 . 1, 25 , x2 8 400 0, 2 0,8 8 Таким образом, имеем 0, 4938 0,3944 0,8882 . P400 70; 100 Ф 2,5 Ф 1, 25 Ф 2,5 Ф 1, 25 43 ТЕМА № 4. ДИСКРЕТНЫЕ И НЕПРЕРЫВНЫЕ СЛУЧАЙНЫЕ ВЕЛИЧИНЫ Лекция 4.1. Случайные величины Понятие случайной величины. Виды случайных величин Среди решаемых задач теории вероятности много таких задач, в которых исход опыта выражается некоторым числом x . При этом случайный характер исхода опыта влечет за собой случайность числа x . Это означает, что при повторении опыта это число меняется непредвиденным образом. Например, при бросании игрального кубика может появиться одно из чисел: 1, 2, 3, 4, 5, 6. Какое конкретное число появится, предугадать невозможно, так как появление любого из указанных чисел зависит от многих причин, которые полностью не могут быть учтены. Если при первом бросании может появиться 3, то при втором бросании возможно появление 1 или 5, а может вновь появится 3. Таким образом, при повторении опыта число выпавших очков меняется случайным образом. Итак, количество выпавших очков при бросании игрального кубика – величина переменная, характер ее изменения зависит от многих причин, и такая величина является случайной. Случайной называется величина, которая в результате опыта может принять то или иное возможное значение, неизвестное заранее, но обязательно одно. Случайные величины обычно обозначают заглавными буквами латинского алфавита X , Y , Z , ..., а их возможные конкретные значения – соответствующими малыми буквами этого алфавита x , y , z , ... Например, если случайная величина X имеет три возможных значения, то они будут обозначены так: x1 , x2 , x3 . Дискретной (прерывной) называется случайная величина, которая принимает отдельные, изолированные возможные значения с определенной вероятностью. Число возможных значений дискретной случайной величины может быть конечным или бесконечным. Приведем примеры дискретной случайной величины: 1. Число появлений герба при трех бросаниях монеты (возможные значения: 0, 1, 2, 3). 2. Число бракованных изделий в случайно отобранной партии из 10 изделий (возможные значения: 0, 1, 2, 3, …, 10). 3. Число вызовов, поступающих на телефонную станцию в течение часа (возможные значения: 0, 1, 2, 3, …, n ). Заметим, что значения трех указанных выше случайных величин отделены друг от друга промежутками, в которых нет других возможных значений соответствующих величин. Существует случайная величина, одно возможное значение нельзя отделить от другого промежутком, не содержащим возможного значения этой же случайной величины. Приведем пример. Предположим, что расчетная дальность полета снаряда 7000 м. Пусть при первом выстреле дальность полета составила 7020 м, а 44 при втором снаряд пролетел 7040 м. При последующих выстрелах снаряд может пролететь7030 и 6995 м. Другими словами, снаряд может попасть в любую точку некоторого промежутка и невозможно указать какие-либо два возможных значения дальности полета снаряда, между которыми не найдется хотя бы одного возможного значения рассматриваемой случайной величины. Непрерывной называется случайная величина (СВ), которая может принимать любые значения из некоторого конечного или бесконечного промежутка. Очевидно, что число возможных значений непрерывной СВ бесконечно. Приведем примеры непрерывной случайной величины: 1. Время безаварийной работы прибора. 2. Расход горючего на единицу расстояния. 3. Количество осадков, выпавших за сутки. Кроме дискретных и непрерывных случайных величин встречаются и такие, которые наряду с непрерывным заполнением некоторого промежутка могут принимать и отдельные дискретные значения. Такие величины называются случайными величинами смешанного типа. Примером такой случайной величины может служить мгновенное значение напряжения на выходе ограничителя или на выходе выпрямителя. Ряд распределения случайной величины На первый взгляд может показаться, что для задания дискретной случайной величины достаточно перечислить все ее возможные значения. В действительности это не так: случайные величины могут иметь одинаковые перечни возможных значений, а вероятности их – различные. Поэтому для задания дискретной случайной величины недостаточно перечислить все возможные ее значения, нужно еще указать их вероятности. Законом распределения случайной величины называют соответствие между возможными значениями и их вероятностями. Закон распределения дискретной случайной величины может быть задан различными способами: – таблично; – аналитически (в виде формулы); – графически. Рассмотрим табличный и графический способы задания закона распределения дискретной случайной величины. При табличном задании закона распределения дискретной случайной величины первая строка таблицы содержит возможные значения, а вторая – их вероятности: X p x1 x2 p1 p2 … … xi pi … … xn pn Построенная по такому принципу таблица называется рядом распределения. Приняв во внимание, что в одном испытании случайная величина принимает одно и только одно возможное значение, заключаем, что события X x1 , 45 X x2 , …, X xn образуют полную группу, следовательно, сумма вероятностей этих событий, т. е. сумма вероятностей второй строки таблицы равна единицы: p1 p2 ... pn 1 . Если множество возможных значений X бесконечно, то ряд p1 p2 ... сходится и его сумма равна единице. Пример 1. В денежной лотерее выпущено 1000 билетов. Разыгрывается один выигрыш в 5000 руб. и десять выигрышей по 1000 руб. Найти закон распределения случайной величины X – стоимости возможного выигрыша для владельца одного лотерейного билета. Решение. Напишем возможные значения X : x1 0 , x2 1000 , x3 5000 . Вероятности этих возможных значений таковы: p1 0,989 , p2 0,01 , p3 0,989 . Представим в табличной форме искомый закон распределения: X p 0 1000 5000 0,989 0,01 0,001 При графическом задании закона распределения дискретной случайной в прямоугольной декартовой системе координат строят точки xi ; pi и соединяют их последовательно отрезками прямых. Полученную при этом ломаную линию называют многоугольником распределения случайной величины. Пример 2. Дискретная случайная величина X задана рядом распределения: X p 0 1 2 3 0,2 0,3 0,1 0,4 Построить многоугольник распределения. Решение. В прямоугольной системе координат построим точки 0;0, 2 , 1;0,3 , 2;0,1 , 3;0, 4 , соединим их последовательно отрезками прямых (рис. 1). p 0,4 0,3 0,2 0,1 0 1 2 3 4 x Рисунок 1. Многоугольник распределения 46 Заметим, что сумма ординат многоугольника распределения равна единице. Это свойство многоугольника распределения является определяющим. Если в прямоугольной системе координат задана ломаная, обладающая указанным выше свойством, то такая ломаная задает закон распределения некоторой случайной величины. Функция и плотность распределения вероятностей Дискретная случайная величина может быть задана перечнем всех ее возможных значений и соответствующих вероятностей. При задании закона распределения непрерывной случайной величины такой способ уже неприемлем хотя бы потому, что множество ее возможных значений бесконечно и сплошь заполняет некоторый промежуток. В этом случае не представляется возможности перечислить все значения случайной величины и их вероятности в виде таблицы (построить ряд распределения) или отметить их в системе координат (построить многоугольник распределения). С этой целью и вводят понятие функции распределения вероятностей случайной величины. Пусть x – действительное число. Вероятность события, состоящего в том, что случайная величина X примет значение, меньшее x обозначим через функцию F x . Разумеется, если x изменяется, то вообще говоря, изменяется и F x , т. е. F x является функцией от x . Функцией распределения называют функцию F x , определяющую вероятность того, что случайная величина X в результате испытания примет значение, меньшее x , т. е.: F x P X x . Иногда вместо термина «функция распределения» используют термин «интегральная функция». Функция распределения допускает простую геометрическую интерпретацию. Рассмотрим случайную величину X P X x как случайную точку X на оси Ox (рис. 2), которая в результате опыта может занять то или иное положение. x X x Пусть на оси выбрана конкретная точка x , тогда в результате опыта случайРисунок 2 ная точка X может оказаться левее или правее этой точки. Очевидно, вероятность того, что случайная точка X окажется левее точки x , будет зависеть от положения точки x , т. е. являться функцией аргумента x . Для дискретной случайной величины X , которая может принимать значения x1 , x2 , x3 , …, xn функция распределения имеет вид F x P X xi , где xi x 47 неравенство xi x под знаком суммы означает, что суммирование касается всех тех значений xi , величина которых меньше x . Поясним эту формулу исходя из определения функции F x . Предположим, что аргумент x принял какое-то определенное значение, но такое, что выполняется неравенство xi x xi 1 . Тогда левее числа x на числовой оси окажутся только те значения случайной величины, которые имеют индекс 1, 2, 3, ..., i . Поэтому неравенство X x выполняется, если величина X примет значение xk , где k 1, 2, 3, ..., i . Таким образом, событие X x наступит, если наступит любое, неважно какое, из событий X x1 , X x2 , …, X xi . Так как эти события несовместны, то по теореме сложения вероятностей имеем: P X x P X x1 P X x2 ... P X xi P X xi . xi x Прежде чем приступить к дальнейшему изучению функции F x , отметим большую значимость и глубокий смысл равенства F x P X x . В левой части этого равенства находится «обыкновенная» функция действительного аргумента, а в правой – переменная вероятность. Эта формула связывает один из важных разделов математики, изучающий функции действительного аргумента, с теорией вероятностей, где изучаются, в частности, случайные события, которые могут произойти, а могут и не произойти в результате опыта. В отличие от случайного события, наступление которого можно только предвидеть, так же как и появление определенного значения случайной величины, значение функции действительного аргумента всегда можно однозначно определить. Формула F x P X x является своеобразным «мостом» между математическим анализом и теорией вероятностей, между функциями действительного переменного и случайными величинами. Эта формула дает возможность при исследовании в теории вероятностей использовать аппарат математического анализа, без которого было бы трудно получить надежные результаты. Рассмотрим конкретный пример. Пример 3. Дискретная случайная величина X – число попаданий в мишень задана рядом распределения: X p 0 1 2 0,2 0,5 0,3 Найти функцию распределения F x . Найти вероятность события X 1 . 48 Решение. Построим функцию распределения этой случайной величины, воспользовавшись формулой F x P X xi . xi x 1. Если x 0 , то F x 0 , так как в этом промежутке нет ни одного возможного значения случайной величины, удовлетворяющего условию X x . 2. Если 0 x 1 , то F x P X 0 0, 2 . 3. Если 1 x 2 , то F x P X 0 P X 1 0, 2 0,5 0,7 . 4. Если x 2 , то F x P X 0 P X 1 P X 2 0, 2 0,5 0,3 1 . Функция распределения может быть представлена в виде кусочнопостоянной функции: 0, 0, 2, F x 0,7, 1, x0 0 x 1 1 x 2 x2 . Найдем вероятность события X 1 . Это событие равно сумме двух событий X 1 , X 2 . Следовательно, P X 1 P X 1 P X 2 0,5 0,3 0,8 . Рассмотрим свойства функции распределения F x случайной величины: 1. Если F x – функция распределения случайной величины X , то 0 F x 1 для любого x . 2. Функция распределения F x случайной величины X есть неубываю щая функция, и для любых выполняется равенство P X F F . F x 0 , lim F x 1 . 3. Если F x – функция распределения, то xlim x 4. Вероятность любого отдельного значения непрерывной случайной величины равна нулю. Итак, непрерывную случайную величину можно задать с помощью функции распределения. Этот способ задания не является единственным. Непрерывную случайную величину можно также задать, используя другую функцию, которую называют плотностью распределения (плотностью вероятности, дифференциальной функцией). Плотностью распределения вероятностей непрерывной случайной величины X называют функцию f x , которая является первой производной от функции распределения F x : f x F x . Из этого определения следует, что функция распределения является первообразной для плотности распределения. Заметим, что для описания распределения вероятностей дискретной случайной величины плотность распределения неприменима. 49 Рассмотрим основные свойства дифференциальной функции распределения (плотности распределения): 1. Для любых x дифференциальная функция распределения f x неотрицательна, т. е. f x 0 . 2. Для дифференциальной функции распределения имеет место равенство P X f x dx . 3. Для дифференциальной функции распределения имеет место равенство f x dx 1 . 4. Если случайная величина принимает значения только в некотором инb тервале a; b , то f x dx 1 . a 5. Для интегральной и дифференциальной функции распределения имеет место равенство F x x f t dt . Лекция 4.2. Числовые характеристики случайных величин Для решения многих практических задач совсем необязательно знать все возможные значения случайной величины и соответствующие им вероятности, а достаточно указать отдельные числовые параметры, которые позволяют в удобной, компактной форме отразить существенные особенности случайной величины. Эти характеристики случайной величины, являющиеся не функциями, а числами, называют числовыми характеристиками случайной величины. Их значение – в сжатой форме выразить наиболее важные черты распределения. Числовые характеристики дискретных случайных величин Возможные значения случайной величины могут быть сосредоточены вокруг некоторого центра. Этот центр является некоторым средним значением случайной величины, вокруг которого группируются остальные ее значения. Для характеристики такой особенности распределения случайной величины служит математическое ожидание, которое иногда называют центром распределения или средним значением случайной величины. Пусть имеется дискретная случайная величина X , принимающая значения x1 , x2 , …, xn с вероятностями p1 , p2 , …, pn соответственно. Математическим ожиданием M X дискретной случайной величины X называется сумма произведений всех возможных значений случайной величины на соответствующие вероятности этих значений, т. е.: 50 n M X xi pi . (1) i 1 Поясним формулу (1). Пусть проведено n испытаний, в которых случайная величина X приняла значения x1 , x2 , …, xk , причем значение x1 появилось m1 раз, значение x2 появилось m2 раз, …, значение xk появилось mk раз. Очевидно, что m1 m2 ... mk n . Найдем среднее арифметическое всех этих значений и обозначим его X. Имеем X x1m1 x2 m2 ...xk mk x1m1 x2 m2 ...xk mk m1 m2 ... mk n k xm m x1m1 xm 2 2 ... k k xi i . n n n n i 1 m Заметим, что дробь i есть не что иное, как относительная частота появn ления значения xi в n испытаниях, т. е. статистическая вероятность. Обозначим эту дробь pi k mi , запишем теперь среднее арифметическое X в виде X xi pi . n i 1 Таким образом, формула (1) вполне объяснима, только следует помнить, что в этой формуле n – число всех возможных значений случайной величины; k x1 , x2 , …, xn – эти значения, а в формуле X xi pi n – число испытаний или i 1 наблюдений над случайной величиной; x1 , x2 , …, xk – наблюдаемые значения случайной величины. Происхождение термина «математическое ожидание» связано с начальным периодом становления теории вероятностей, когда в ходе азартных игр игрок интересовался средним значением ожидаемого выигрыша. Впервые это понятие было введено X. Гюйгенсом в 1657 г. в сочинении «О расчетах в азартной игре». Пример 1. Найти математическое ожидание дискретной случайной величины X – числа попаданий в мишень, закон распределения которой задан таблицей: X p 0 1 2 0,2 0,5 0,3 n Решение. В соответствии с формулой M X xi pi находим математичеi 1 ское ожидание: M X 0 0, 2 1 0,5 2 0,3 1,1 . Среднее число попаданий в мишень дает возможность сравнить между собой искусство различных стрелков. Рассмотрим свойства математического ожидания. 1. Математическое ожидание постоянной величины равно значению этой постоянной, т. е. M C C . 51 Доказательство. Рассматривая постоянную величину C как дискретную величину, которая принимает только одно это возможное значение с вероятностью 1, получим: M C C 1 C . 2. Постоянный множитель можно выносить за знак математического ожидания, т. е. M CX CM X . Доказательство. Найдем математическое ожидание случайной величины n CX : M CX Cx1 p1 Cx2 p2 ... Cxn pn C x1 p1 x2 p2 ... xn pn C xi pi CM X . i 1 3. Математическое ожидание отклонения случайной величины от ее математического ожидания равно нулю, т. е. M X M X 0 . Доказательство. Найдем математическое ожидание отклонения: M X M X x1 M X p1 x2 M X p2 ... xn M X pn x1 p1 x2 p2 ... xn pn M X p1 p2 ... pn M X M X 1 0 . На практике встречаются случайные величины, имеющие одинаковые математические ожидания, однако принимающие резко отличающиеся значения. У одних из этих величин отклонения значений от математического ожидания небольшие, а у других, наоборот, значительны, т. е. для одних рассеивание значений случайной величины вокруг математического ожидания мало, а для других оно велико. Таким образом, математическое ожидание характеризует поведение случайной величины далеко не полностью. Приведем следующий пример. Пример 2. Пусть дискретные случайные величины X и Y заданы следующими рядами распределения: X p 2 3 4 5 0,1 0,2 0,3 0,4 Y p 0 4 6 8 0,2 0,5 0,2 0,1 Найти математические ожидания дискретных случайных величин. Решение. Математическое ожидание дискретной случайной величины X равно M X 2 0,1 3 0, 2 4 0,3 5 0, 4 4 . Математическое ожидание дискретной случайной величины Y – M Y 0 0, 2 4 0,5 6 0, 2 8 0,1 4 . Отложим значения этих величин на числовых осях с одинаковым масштабом, рис. 1. 52 M X 0 1 0 1 2 2 3 3 4 M Y 4 5 6 7 8 X 5 6 7 8 Y Рисунок 1 Рассматриваемые случайные величины имеют одинаковые математические ожидания, равные 4. Однако рассеивание значений случайной величины X вокруг математического ожидания значительно меньше, чем у величины Y . Приведенные рассуждения и пример свидетельствуют о целесообразности введения такой характеристики случайной величины, которая оценивала бы меру рассеивания значений случайной величины вокруг ее математического ожидания, тем более на практике часто приходится оценивать такое рассеивание. Например, артиллеристам необходимо знать, как кучно лягут снаряды вблизи цели, по которой ведется стрельба. Ранее уже отмечалось, что случайная величина X M X характеризует отклонение значений случайной величины от ее математического ожидания. Однако брать среднее значение (математическое ожидание) этой величины в качестве характеристики рассеивания не имеет смысла, так как оно равно нулю. Последнее объясняется тем, что возможные значения X M X могут иметь как положительные, так и отрицательные знаки. Избежать изменения знаков отклонений xi M X можно, если заменить их абсолютными значениями или возвести в квадрат. Замена отклонений их абсолютными величинами нецелесообразна, так как действия с абсолютными величинами, как правило, вызывает затруднения. Поэтому следует использовать 2 величину X M X (точнее, ее среднее значение) для характеристики рассеивания значений случайной величины. Математическое ожидание квадрата отклонения случайной величины X от ее математического ожидания M X называется дисперсией случайной величины X : D X M X M X . 2 Для дискретной случайной величины дисперсию можно определить по n формуле D X xi2 pi M X . 2 i 1 Случайная величина и математическое ожидание имеют одну и ту же размерность, а дисперсия имеет размерность квадрата случайной величины. Этого недостатка можно избежать, если воспользоваться средним квадратическим отклонением случайной величины, которым является арифметический корень из дисперсии. Таким образом, среднее квадратическое отклонение можно определить по формуле X D X . 53 Пример 3. Случайная величина задана рядом распределения: X p 0 2 5 6 0,2 0,1 0,4 0,3 Найти дисперсию и среднее квадратическое отклонение этой величины. Решение. Математическое ожидание дискретной случайной величины X равно дисперсия составляет M X 0 0, 2 2 0,1 5 0, 4 6 0,3 4 , D X 02 0, 2 22 0,1 52 0, 4 62 0,3 42 5, 2 . Среднее квадратическое отклонение равно X 5, 2 2, 28 . Рассмотрим основные свойства дисперсии. 1. Дисперсия постоянной величины C равна нулю: D C 0 . Доказательство. По определению дисперсии D C M C M C . Пользуясь первым свойством математического ожидания (математическое ожидание постоянной величины равно значению этой постоянной), получим 2 D C M C C M 0 0 . 2 2. Постоянный множитель случайной величины можно выносить за знак дисперсии, предварительно возводя его в квадрат: D CX C 2 D X . Доказательство. По определению дисперсии, имеем 2 D CX M CX M CX . Пользуясь вторым свойством математического ожидания (постоянный множитель можно выносить за знак математического ожидания), получим: 2 2 D CX M CX CM X M C 2 X M X C 2 M X M X CD X . 2 3. Дисперсия случайной величины X равна разности между математическим ожиданием квадрата случайной величины и квадратом ее математическо2 го ожидания D X M X 2 M X . Данное свойство примем без доказательства. Числовые характеристики непрерывных случайных величин Формулу (1) нельзя применять для непрерывной случайной величины. При введении понятия математического ожидания для этого случая воспользуемся понятием элемента вероятности f x x . Пусть непрерывная случайная величина X задана плотностью распределения f x . Допустим, что все возможные значения X принадлежат отрезку 54 a; b . Разобьем этот отрезок точками a x0 x1 x2 ... xn b на n частичных отрезков длиной x1 , x2 , …, xn и выберем в каждом из них произвольную точку hi i 1, 2, 3, ..., n . Нам надо определить математическое ожидание непрерывной величины по аналогии с дискретной; составим сумму произведений возможных значений hi на вероятности попадания их в интервал xi (напомним, что произведение f x x приближенно равно вероятности попадания X в интервал x ): xi f xi xi . Перейдя к пределу при стремлении к нулю длины наибольшего из частичb ных отрезков, получим определенный интеграл x f x dx . a Математическим ожиданием непрерывной случайной величины X , возможные значения которой принадлежат отрезку a; b , называют определенный инb теграл M X x f x dx . a Если возможные значения принадлежат всей оси Ox , то M X x f x dx . Предполагается, что несобственный интеграл сходится абсолютно, т. е. существует интеграл x f x dx . Если бы это требование не выполнялось, то значение интеграла зависело бы от скорости стремления (в отдельности) нижнего предела к , а верхнего к . По аналогии с дисперсией дискретной величины определяется и дисперсия непрерывной величины. Дисперсией непрерывной случайной величины называют математическое ожидание квадрата ее отклонения. Если возможные b значения принадлежат X отрезку a; b , то Ox , то D X x M X f x dx . 2 a Если D X возможные значения принадлежат всей оси x M X f x dx . 2 Замечание. 1. Свойства математического ожидания и дисперсии дискретных случайных величин сохраняются и для непрерывных величин. 2. Дисперсию непрерывной случайной величины можно определить по b формуле D X x 2 f x dx M X . 2 a 55 Пример 4. Плотность вероятности непрерывной случайной величины X 2 3x , x 0; 1 задана следующим выражением: f x . Найти математическое x 0; 1 0, ожидание и дисперсию случайной величины X . Решение. Найдем математическое ожидание: 1 1 3x 4 M X 3x dx 4 0 0 3 3 14 3 04 3 . 4 4 4 1 3 3x5 9 3 15 3 05 9 3 Вычислим дисперсию: D X 3x dx . 5 0 16 5 5 16 80 4 0 2 1 4 РАЗДЕЛ 2. МАТЕМАТИЧЕСКАЯ СТАТИСТИКА ТЕМА № 5. ВЫБОРОЧНЫЙ МЕТОД Лекция 5.1. Элементы математической статистики Цель каждой научной дисциплины заключается в познании некоторых общих закономерностей, позволяющих предвидеть развитие явлений и выбирать рациональные пути поведения в типичных ситуациях. В основе научных знаний лежит проведение опытов, испытаний. Однако единичное испытание может не отражать общей природы рассматриваемого явления. Для обнаружения общей закономерности, которой подчиняется явление, необходимо его многократно наблюдать в одинаковых условиях. Если определенным образом систематизировать результаты большого числа опытов, то окажется, что в их изменении можно увидеть некоторую закономерность. Изучение этой закономерности позволяет предвидеть результат серии измерений. Очевидно, что изучению подлежат только такие случайные явления, которые в принципе можно наблюдать практически неограниченное количество раз. Такие случайные явления называют массовыми. Как организовать сбор результатов испытаний? Сколько должно быть проведено наблюдений? Как обработать результаты наблюдений и сделать обоснованные практические выводы? Ответы на эти вопросы позволяет получить специальный раздел математики – математическая статистика. Основные понятия математической статистики Слово «статистика» имеет латинское происхождение (от status, что означает определенное положение вещей, состояние). В средние века оно использовалось для характеристики политического состояния государства и употреблялось в значении слова «государствоведение». В науку этот термин введен в XVIII в. немецким ученым Г. Ахенвалем, выпустившим книгу о государствоведении. 56 Собственно как наука статистика возникла только в XVII в., когда правительства различных западноевропейских стран стали заниматься сбором разного рода информации о своих гражданах. Однако статистический учет существовал уже в глубокой древности. Развитие статистики схоже с развитием языка, она постепенно развивалась там, где в ней возникала необходимость. Еще за 5 тыс. лет до н. э. проводились переписи населения в Китае, велся учет имущества граждан в Древнем Риме, средние величины в расчетах широко использовались еще при жизни Пифагора. В средние века осуществлялось сравнение военного потенциала разных стран, численности их населения, домашнего имущества, земель. У истоков статистической науки стояли две школы – немецкая описательная и английская школа политических арифметиков. Представители описательной школы считали, что задачей статистики является описание достопримечательностей государства (территории, населения, климата, вероисповедания, ведения хозяйства и т. п.) в словесной форме лишь на момент наблюдения, без цифр и вне динамики. Видными представителями описательной школы были Г. Конринг (1606–1661), Г. Ахенвал (1719–1772) и др. Политические арифметики ставили целью изучать общественные явления с помощью числовых характеристик. Это был принципиально новый подход к развитию статистической науки по сравнению со школой государствоведения, так как от описания явлений и процессов статистика перешла к их измерению, исследованию, оценке и выработке вероятных гипотез будущего развития. Политические арифметики видели основное назначение статистики в изучении массовых общественных явлений, осознавали необходимость учета в статистическом исследовании требований закона больших чисел, поскольку закономерность может проявиться лишь при достаточно большом объеме анализируемой совокупности. Виднейшим представителем и основателем этого направления был В. Петти (1623–1687). Именно школа политических арифметиков стала основообразующей в развитии современной статистики. В XIX в. получило развитие учение бельгийского статистика А. Кетле (1796–1874), который первым применил современные методы сбора данных, его считают основоположником учения о средних величинах. Математическое направление в статистике развивалось в работах английских ученых Ф. Гальтона, К. Пирсона, Р. Фишера, которые внесли значительный вклад в развитие теории корреляции и оказали существенное воздействие на современную статистику. Прогрессу статистической методологии способствовали труды российских статистиков А. А. Чупрова (1874–1926), B. C. Немчинова (1894–1964), С. Г. Струмилина (1877–1974) и др. Математическая статистика – раздел прикладной математики, предметом которого является разработка рациональных приемов и методов сбора, систематизации и обработки опытных данных в целях изучения закономерностей массовых случайных явлений. Статистика занимается сбором информации различного характера, ее упорядочиванием, сопоставлением, анализом и интерпретацией (объяснением) и обладает следующими отличительными особенностями. Во-первых, статистика 57 изучает количественную сторону общественных явлений: величину, размер, объем и имеет числовое значение. Во-вторых, статистика исследует качественную сторону явлений: специфику, внутреннюю особенность, отличающую одно явление от других. Качественная и количественная стороны явления всегда существуют вместе, образуя единство. Все общественные явления и события протекают во времени и в пространстве, и в отношении любого из них всегда можно установить, когда оно возникло и где оно развивается. Таким образом, статистика изучает явления в конкретных условиях места и времени. Изучаемые статистикой явления и процессы общественной жизни находятся в постоянном изменении, развитии. На основе сбора, обработки и анализа массовых данных об изменении изучаемых явлений и процессов выявляется статистическая закономерность. В статистических закономерностях проявляются действия общественных законов, которые определяют существование и развитие социально-экономических отношений в обществе. Предметом математической статистики является изучение случайных величин (или случайных событий) по результатам наблюдений. При помощи статистических показателей данная наука определяет количественную сторону случайного события, наблюдает закономерности перехода количества в качество на примере данного случайного события и на основании этих наблюдений производит анализ данных, полученных в определенных условиях места и времени. Основными задачами математической статистики являются: 1. Разработка методов сбора и обработки статистических сведений для получения практических и научных выводов. 2. Определение по статистическим данным законов распределения случайных величин. 3. Определение по статистическим данным параметров распределения случайных величин. 4. Проверка правдоподобия статистических гипотез о виде неизвестного распределения или о величине параметров распределения. При изучении качественного и количественного признаков, характеризующих множество некоторых однородных объектов, не всегда имеется возможность обследовать каждый объект этого множества. Да и не всегда существует необходимость и целесообразность сплошного обследования. Например, условимся считать, что электрическая лампочка стандартна, если продолжительность ее горения не менее 1200 часов. Требуется определить качество электрических лампочек, выпускаемых заводом. Безусловно, что практически невозможно проверить каждую лампочку на стандартность. Да это и противоречит здравому смыслу. Ведь после испытаний, т. е. когда она перегорит, ее использовать невозможно. Поэтому обследуют только некоторую небольшую часть случайно отобранной продукции и на основании полученных данных делают вывод о качестве всей продукции. Практика подтверждает, что сделанные выводы бывают достаточно объективными. Множество всех объектов, подлежащих изучению, называется генеральной совокупностью. 58 Выборочной совокупностью или просто выборкой называется множество случайно отобранных для исследования объектов. Объемом совокупности (выборочной или генеральной) называют число объектов этой совокупности. Пример 1. Из партии, содержащей 10000 деталей, отобрали случайным образом для проверки 80 деталей. В нашем примере объем генеральной совокупности равен N10000, а объем выборки n 80 . Очевидно, что чем больше объем выборки, тем более полное представление мы будем иметь о генеральной совокупности. Однако из этого не следует, что зависимость прямо пропорциональная. История знает немало примеров, когда выводы оказались правильными при меньшем объеме выборки. В этом отношении показателен следующий пример. Пример 2. В 1936 г. кандидатами в президенты США были Ф. Д. Рузвельт и А. М. Ландон. Американским журналом «Литературное обозрение» и социологами Дж. Геллапом и Э. Роупером были проведены предварительные опросы относительно исхода президентских выборов. Редакция журнала сделала выборку из телефонной книги (выбор адресов) и разослала четырем миллионам адресатов открытки с вопросом: «За кого Вы будете голосовать: за Ф. Рузвельта или за А. Ландона?». Обработав полученные открытки, редакция журнала объявила, что на президентских выборах с большим перевесом победит А. Ландон. В то же самое время социологи Дж. Геллап и Э. Роупер сделали противоположный прогноз, основываясь только на 4000 анкет. Их прогноз оказался верным: с большим перевесом президентом был избран Ф. Д. Рузвельт. Причина ошибочного прогноза заключалась в том, что редакция журнала допустила ошибку в принципе случайного отбора. А именно, в качестве генеральной совокупности были охвачены не все слои общества, а лишь одна часть общества, охватывающая владельцев телефонов, т. е. в то время в основном зажиточные слои. Кроме того, прислали ответы лишь те, кто был уверен в своем мнении и привык отвечать на письма. В значительной части это были представители делового мира, поддерживавшие А. М. Ландона. Что же касается социологов Дж. Гэллапа и Э. Роупера, то они учли, что общество распадается на социальные группы. Каждая социальная группа примерно однородна по отношению к кандидатам в президенты. Поэтому, несмотря на значительно меньшую выборку, их прогноз оказался правильным. Приведенный пример наглядно показывает, что по данным выборки достаточно уверенно можно судить об интересующем признаке генеральной совокупности лишь тогда, когда объекты выборки правильно представляют пропорции генеральной совокупности, т. е. выборка должна быть представительной или, как говорят, репрезентативной (от франц. слова репрезентант – представитель). На практике применяются различные способы отбора. Принципиально эти способы можно подразделить на два вида: 59 1. Отбор, не требующий разделения генеральной совокупности на части (простой случайный бесповторный отбор, простой случайный повторный отбор). 2. Отбор, при котором генеральная совокупность разбивается на части (типический отбор, механический отбор, серийный отбор). Простым случайным называют такой отбор, при котором объекты извлекают по одному из всей генеральной совокупности. Осуществить простой отбор можно различными способами. Например, для извлечения n объектов из генеральной совокупности объема N поступают следующим образом. Выписывают номера от 1 до N на карточках, которые тщательно перемешивают, и наугад вынимают одну карточку; объект, имеющий одинаковый номер с извлеченной карточкой, подвергают обследованию. Затем карточку возвращают в пачку, и процесс повторяют, т. е. карточки перемешивают, наугад вынимают одну из них и т. д. Так поступают n раз, в итоге получая простую случайную повторную выборку объема n. Если извлеченные карточки не возвращать в пачку, то выборка является простой случайной бесповторной. При большом объеме генеральной совокупности описанный процесс оказывается очень трудоемким. В этом случае пользуются готовыми таблицами «случайных чисел», в которых числа расположены в случайном порядке. Для того чтобы отобрать, например, 50 объектов из пронумерованной генеральной совокупности, открывают любую страницу таблицы случайных чисел и выписывают подряд 50 чисел; в выборку попадают те объекты, номера которых совпадают с выписанными случайными числами. Если бы оказалось, что случайное число таблицы превышает число N, то такое случайное число пропускают. При осуществлении бесповторной выборки случайные числа таблицы, уже встречавшиеся ранее, следует также пропустить. Типическим называют отбор, при котором объекты отбираются не из всей генеральной совокупности, а из каждой ее «типической» части. Например, если детали изготовляют на нескольких станках, то отбор производят не из всей совокупности деталей, произведенных всеми станками, а из продукции каждого станка в отдельности. Типическим отбором пользуются тогда, когда обследуемый признак заметно колеблется в различных типических частях генеральной совокупности. Например, если продукция изготовляется на нескольких машинах, среди которых есть более и менее изношенные, то здесь типический отбор целесообразен. Механическим называют отбор, при котором генеральную совокупность «механически» делят на столько групп, сколько объектов должно войти в выборку, а из каждой группы отбирают один объект. Например, если нужно отобрать 20% изготовленных станком деталей, то отбирают каждую пятую деталь; если требуется отобрать 5% деталей, то отбирают каждую двадцатую деталь, и т. д. Следует указать, что иногда механический отбор может не обеспечить репрезентативности выборки. Например, если отбирают каждый двадцатый обтачиваемый валик, причем сразу же после отбора производят замену резца, то отобранными окажутся все валики, обточенные затупленными резцами. В таком случае следует устранить совпадение ритма отбора с ритмом заме60 ны резца, для чего надо отбирать, скажем, каждый десятый валик из двадцати обточенных. Серийным называют отбор, при котором объекты отбирают из генеральной совокупности не по одному, а «сериями», которые подвергаются сплошному обследованию. Например, если изделия изготовляются большой группой станков-автоматов, то подвергают сплошному следованию продукцию только нескольких станков. Серийным отбором пользуются тогда, когда обследуемый признак колеблется в различных сериях незначительно. Подчеркнем, что на практике часто применяется комбинированный отбор, при котором сочетаются указанные выше способы. Например, иногда разбивают генеральную совокупность на серии одинакового объема, затем простым и случайным отбором выбирают несколько серий и, наконец, каждой серии простым случайным отбором извлекают отдельные объекты. Ряды распределения Целью создания выборки является сбор статистических данных – сведений о том, какие значения принял в результате наблюдений интересующий исследователя признак. Изучение статистических данных позволяет оценить параметры (характеристики) генеральной совокупности по данным выборки. Собранные по полученной выборке статистические данные представляют собой исходный числовой материал, подлежащий дальнейшей обработке и анализу. Для изучения этих данных, прежде всего, их необходимо сгруппировать. Расположим наблюдавшиеся значения признака в порядке возрастания. Эта операция называется ранжированием статистических данных. Приведем пример. Пример 3. В результате опроса выясняется квалификация рабочих механического цеха. Получены данные об их тарифных разрядах: 5, 1, 4, 5, 4, 3, 5, 5, 2, 5, 5, 6, 4, 3, 1, 2, 5, 6, 5, 3, 3, 3, 6, 6, 2. Провести ранжирование статистических данных. Решение. Здесь признаком является тарифный разряд, а полученные о нем сведения образуют статистические данные. Расположив приведенные выше данные в порядке неубывания, сгруппировав их, получаем следующий ранжированный ряд данных наблюдения: 1, 1, 2, 2, 2, 3, 3, 3, 3, 3, 4, 4, 4, 5, 5, 5, 5, 5, 5, 5, 5, 6, 6, 6, 6. Из полученного ряда чисел видно, что объем выборки n = 25. Все значения случайной величины разбиты на шесть групп, в пределах каждой из которых все значения случайной величины одинаковы. Таким образом, имеется шесть различных значений случайной величины: 1, 2, 3, 4, 5, 6. Каждое такое значение обычно называют вариантом. Значение случайной величины, соответствующее отдельной группе сгруппированного ряда наблюдаемых данных, называется вариантом, а изменение этого значения – варьированием. 61 Варианты будем обозначать малыми буквами конца латинского алфавита с соответствующими порядковому номеру группы индексами xi , y j , zk , … В приведенном примере четвертая группа данных содержит 3 одинаковых значений случайной величины, равных 4, т. е. x4 4 . Просматривая ряд полученных данных, нетрудно убедиться, что значение случайной величины варьирует (изменяется) от 1 до 6, причем наиболее часто встречается вариант x5 5 . Для каждой группы сгруппированного ряда данных можно подсчитать их численность, т. е. определить число, которое показывает, сколько раз встречается соответствующий вариант в ряде наблюдений. Такие числа называют частотой варианта. Численность отдельной группы сгруппированного ряда наблюдаемых данных называется частотой или весом соответствующего варианта и обозначается ni , где i – индекс варианта. Естественно, что сумма частот по всем вариантам равна объему выборки k n i 1 i n. Например, для варианта x4 частота n4 3 . В ряде случаев представляет практический интерес относительная частота того или иного варианта, называемая частостью. Отношение частоты варианта ni к объему выборки n называется относительной частотой варианта (частостью) и обозначается i , где i – индекс варианта. По определению относительной частоты имеем i ni . n Так как в приведенном примере общая сумма всех частот равна 25, то нетрудно подсчитать, что 5 8 0,32 . Таким образом, относительная частота 25 выражает долю (удельный вес) данного варианта во всей совокупности наблюдаемых значений случайной величины. Заметим, что частость i является статистической вероятностью появления варианта xi . Естественно считать частость i выборочным аналогом (вычисленной по выборочным данным) вероятности pi , появления значения xi случайной величины X , так как частость (статистическая вероятность) i обладает свойством устойчивости, или, иначе, при выполнении определенных условий стремится по вероятности к вероятности pi . Подсчитав частоты и частости для каждого варианта, представим наблюдаемые данные в виде табл. 1, где в первой строке расположены полученные варианты xi , во второй – соответствующие частоты ni , в третьей – соответствующие относительные частоты i . Таблица 1 xi 1 2 3 62 4 5 6 ni 2 3 5 3 8 4 i 0,08 0,12 0,20 0,12 0,32 0,16 Статистическим рядом или статистическим распределением выборки называют перечень вариант и соответствующих им частот или относительных частот. Пусть для дискретной случайной величины X по выборочным данным построен статистический ряд, в котором каждому варианту xi ставится в соответствие его относительная частота i . Тогда, учитывая отмеченную связь между i и pi , естественно считать данный ряд выборочным аналогом ряда распределения упомянутой случайной величины, тем более что k i и i 1 k p i 1 i равны 1. Для проверки правильности составления статистического ряда можно восk пользоваться соотношениями n i 1 i n и k i 1 i 1. Если изучаемая случайная величина является непрерывной или объем выборки n большой, то построение статистического ряда нецелесообразно. В подобных случаях следует построить интервальный ряд распределения. Интервальным рядом распределения называется упорядоченная совокупность интервалов варьирования значений случайной величины с соответствующими частотами или относительными частотами попаданий в каждый из них значений величины. Рассмотрим один из приемов построения интервального ряда, применение которого предполагает реализацию следующих этапов: 1. Определить величину интервала по формуле Стерджесса: h xmax xmin . 1 3,32 lg n (1) Если окажется, что h – дробное число, то за длину интервала удобно выбрать, в частности, ближайшее целое число. 2. Установить полную шкалу интервалов. h 2 Для этого начало первого интервала определить по формуле a1 xmin . Начальные точки следующих интервалов найти по рекуррентному соотношению ai ai 1 h . 3. Сгруппировать результаты наблюдений, представив их таблично. Пример 4. В учебной группе измерили рост курсантов с точностью до 1 см. Результаты измерений таковы: 182, 175, 184, 177, 180, 176, 180, 186, 172, 165, 182, 178, 184, 190, 168, 177, 179, 179, 175, 184, 180, 178, 178, 181, 173, 178, 176, 180, 176, 179. Построить интервальный ряд распределения. 63 Решение. Построим интервальный ряд распределения. Величина интервала равна h 190 165 25 25 4, 23 4 . 1 3,32 lg 30 1 3,32 1, 48 5,90 Установим полную шкалу интервалов, вычислив граничные значения каждого интервала: 4 163 , a2 163 4 167 , a3 167 4 171 , a4 171 4 175 , 2 a5 175 4 179 , a6 179 4 183 , a7 183 4 187 , a8 187 4 191. a1 165 Анализируя результаты наблюдений, определим, сколько значений признака попало в каждый конкретный интервал. При этом в интервал будем включать значения случайной величины, большие нижней границы и меньшие или равные верхней границе, чтобы каждое найденное по выборке значение попадало только в один интервал. В результате построим интервальный ряд распределения, представив его табличной форме (табл. 2): Таблица 2 Интервалы ni i 163;167 167;171 171;175 175;179 179;183 183;187 187;191 1 1 30 1 1 30 4 4 30 12 12 30 7 7 30 4 4 30 1 1 30 Для проверки правильности составления статистического ряда можно воспользоваться соотношениями k ni n , i 1 k i 1 i 1. k Выполним проверку по значениям частот: n i 1 i 1 1 4 12 7 4 1 30 . Это означает, что каждый вариант попал в один из интервалов. Проверка по значениям относительных частот также показывает, что таблица заполнена верно: k i 1 i 1 1 4 12 7 4 1 1. 30 30 30 30 30 30 30 Рассмотрим возможности графического представления статистических рядов, позволяющего в наглядной форме отобразить закономерности изменения значений исследуемого признака. Наиболее часто используются такие виды графического изображения статистических рядов, как полигон, гистограмма, график эмпирической функции распределения. Полигон распределения используется для изображения дискретного статистического ряда. Полигон представляет собой ломаную линию, отрезки которой 64 в прямоугольной декартовой системе координат последовательно соединяют точки с координатами xi ; ni или xi ; i . Для графического изображения интервального ряда распределения применяется гистограмма. Для ее построения в прямоугольной системе координат на оси Ox откладывают отрезки, изображающие частичные интервалы, и на этих отрезках, как на основаниях, строят прямоугольники с высотами, равными частотам или относительным частотам соответствующих интервалов. В результате получают ступенчатую фигуру, состоящую из прямоугольников. Пример 5. В результате тестирования остаточных знаний по высшей математике группа курсантов набрала баллы: 42, 41, 41, 40, 44, 43, 43, 43, 45, 40, 44, 42, 41, 41, 43, 43, 42, 44, 43, 43, 43, 41, 42, 43, 41, 41, 42, 44, 43, 41. На основе анализа статистических данных: 1) задать таблично статистический ряд распределения частот; 2) построить полигон распределения частот; Решение. 1) Построим статистический ряд (табл. 3). В первой строке таблицы расположены варианты xi , во второй – соответствующие частоты ni , в третьей – относительные частоты i . Таблица 3 xi 40 41 42 43 44 45 ni 2 2 30 8 8 30 5 5 30 10 10 30 4 4 30 1 1 30 i Проверяем правильность составления статистического ряда: k ni 2 8 5 10 4 1 30 , i 1 k i 1 i 2 8 5 10 4 1 1. 30 30 30 30 30 30 2) По данным табл. 3 построим полигон распределения частот (рис. 3). ni 1 2 1 0 8 6 4 2 0 0 4 1 4 2 4 3 4 4 4 5 4 Рисунок 3. Полигон распределения частот 65 xi Пример 6. По данным табл. 2 (пример 4) построить гистограмму распределения. Решение. По первой и второй строкам табл. 2 построим гистограмму, рис. 4. ni 12 11 10 9 8 7 6 5 4 3 2 1 0 163 167 171 175 179 183 187 191 Рисунок 4. Гистограмма распределения Из курса теории вероятностей известно, что полную (исчерпывающую) информацию о распределении содержит функция распределения, которая по определению задается равенством: F x P X x . По аналогии сформулируем понятие эмпирической функции распределения, которая может быть найдена по выборке. Эмпирической функцией распределения F * x называется относительная частота того, что признак (случайная величина X ) примет значение, меньшее заданного х, т. е. F * x X x . Эта функция является статистическим аналогом функции распределения F x . В математической статистике предполагается, что распределение на всей генеральной совокупности происходит в соответствии с F x , называемой теоретической функцией распределения. Пример 7. По данным табл. 3 (пример 5): 1) задать таблично эмпирическую функцию распределения; 2) построить график эмпирической функции распределения. 66 Решение. 1) По данным табл. 3 построим эмпирическую функцию распределения, значения которой представлены в табл. 4. Таблица 4 Интервалы ; 40 40; 41 41; 42 42; 43 43; 44 44; 45 45; F* x 0 2 30 10 30 15 30 25 30 29 30 1 Значения эмпирической функции распределения показывают, как накапливалась относительная частота. 2) График эмпирической функции распределения представлен на рис. 5. F * ( x) 1 29 25 15 10 2 30 30 30 30 30 0 0 4 1 4 2 4 3 4 4 4 5 4 xi Рисунок 5. Эмпирическая функция распределения График эмпирической функции распределения представляет собой ступенчатую функцию, которая в точках, соответствующих значениям исследуемого признака, имеет разрывы второго рода. Отметим, что наблюдаемый в точке разрыва скачек функции равен соответствующему значению относительной частоты. ТЕМА № 6. ТОЧЕЧНЫЕ И ИНТЕРВАЛЬНЫЕ ОЦЕНКИ ПАРАМЕТРОВ РАСПРЕДЕЛЕНИЯ Лекция 6.1. Статистические оценки параметров распределения Построив вариационный ряд и изобразив его графически, можно получить первоначальное представление о закономерностях, имеющих место в выборочной совокупности. Однако на практике зачастую этого недостаточно. Такая ситуация возникает, когда следует уточнить те или иные сведения о ряде распре67 деления или имеется необходимость сравнить два ряда и более. При этом следует сравнивать однотипные вариационные ряды, т. е. такие ряды, которые получены при обработке сравнимых статистических данных. Например, можно сравнить распределения длины втулок, изготовленных на двух однотипных станках-автоматах, или распределения количества отказов определенных электронных устройств, выпускаемых разными заводами. Обычно графики таких распределений имеют почти одинаковый вид. Сравниваемые распределения могут существенно отличаться друг от друга. Они могут иметь различные средние значения случайной величины, вокруг которых в основном группируются остальные значения, или различаться рассеиванием данных наблюдений вокруг указанных значений и т. д. Поэтому для дальнейшего изучения значений случайной величины используют числовые характеристики вариационных рядов. Поскольку эти характеристики вычисляются по статистическим данным (по данным, полученным в результате наблюдений), их обычно называют статистическими характеристиками или оценками. Статистические оценки и их виды Пусть требуется изучить количественный признак генеральной совокупности. Допустим, что из теоретических соображений удалось установить, какое именно распределение имеет признак. Естественно возникает задача оценки параметров, которыми определяется это распределение. Например, если наперед известно, что изучаемый признак распределен в генеральной совокупности нормально, то необходимо оценить математическое ожидание и среднее квадратическое отклонение, так как эти два параметра полностью определяют нормальное распределение. Обычно в распоряжении исследователя имеются лишь данные выборки, например значения количественного признака x1 , x2 , x3 , …, xn , полученные в результате n наблюдений. Через эти данные и выражают оцениваемый параметр. Рассматривая x1 , x2 , x3 , …, xn как независимые случайные величины X 1 , X 2 , X 3 , …, X n , можно сказать, что найти статистическую оценку неизвестного параметра теоретического распределения – это значит найти функцию от наблюдаемых случайных величин, которая и дает приближенное значение оцениваемого параметра. Итак, статистической оценкой неизвестного параметра теоретического распределения называют функцию от наблюдаемых случайных величин. Пусть собранный и обработанный статистический материал представлен в виде вариационного или статистического ряда. Далее необходимо исследовать числовые характеристики распределения: а) характеристики положения (средняя арифметическая, мода, медиана); б) характеристики рассеивания (дисперсия, среднее квадратическое отклонение); в) характеристики меры скошенности (коэффициент асимметрии) и островершинности (эксцесс). Рассмотрим некоторые числовые характеристики вариационных рядов. 68 Под средней арифметической понимается такое значение признака, которое имела бы каждая единица совокупности, если бы общий итог всех значений признака был распределен равномерно между всеми единицами совокупности. Модой M 0 вариационного ряда называется вариант, которому соответствует наибольшая частота. Особенность моды как меры центральной тенденции заключается в том, что она не изменяется при изменении крайних членов ряда, т. е. обладает определенной устойчивостью к вариации признака. Медианой M e вариационного ряда называется значение признака, приходящееся на середину ранжированного ряда наблюдений. Достоинство медианы как меры центральной тенденции заключается в том, что на нее не влияет изменение крайних элементов вариационного ряда, если любой из них, меньший медианы, остается меньше ее, а любой, больший медианы, продолжает быть больше ее. Медиана предпочтительнее средней арифметической для ряда, у которого крайние варианты по сравнению с остальными оказались чрезмерно большими или малыми. Как известно, дисперсия случайной величины является мерой рассеивания ее возможных значений вокруг математического ожидания. Так как среднее арифметическое является выборочным аналогом математического ожидания, то подобную характеристику рассматривают и для вариационных рядов. Итак, дисперсией вариационного ряда называется средняя арифметическая квадратов отклонений вариантов от их средней арифметической. В качестве меры вариации (рассеивания) желательно иметь характеристику, выраженную в тех же единицах, что и значения признака. Такой характеристикой является среднее квадратическое отклонение – арифметическое значение корня квадратного из дисперсии. Выборочная средняя и выборочная дисперсия Средней арифметической вариационного ряда называется частное от деления суммы всех вариантов на их число, т. е.: n xi x1 x2 ... xn i 1 x . n n (1) Пример 1. Имеются данные о диаметре валиков после шлифовки: 6,71; 6,73; 6,74; 6,75; 6,76; 6,78; 6,79; 6,80; 6,81; 6,83. Найти среднее значение диаметра валика. Решение. Задан вариационный ряд. Тогда по формуле (1) средний размер диаметра валика составляет: x 6, 71 6, 73 6, 74 6, 75 6, 76 6, 78 6, 79 6,80 6,81 6,83 6, 77 . 10 69 Если данные наблюдений представлены в виде статистического ряда, где x1 , x2 , …, xk – наблюдаемые варианты, а n1 , n2 , …, nk – соответствующие им чаk стоты, причем k ni n , то x i 1 xi ni x1n1 x2 n2 ... xk nk . i 1 n1 n2 ... nk n Средней арифметической статистического ряда называется отношение суммы произведений вариантов на соответствующие частоты к объему выборочной совокупности: k x xn i i i 1 (2) . n Пример 2. Имеются данные о выработке 50 рабочих механического цеха: xi 90 100 110 120 130 140 ni 1 3 6 7 21 12 Найти среднюю выработку рабочего механического цеха. Решение. Задан статистический ряд. Тогда по формуле (2) средняя выработка рабочего механического цеха составляет: x 90 1 100 3 110 6 120 7 130 21 140 12 126 . 50 Отметим основные свойства средней арифметической, аналогичные свойствам математического ожидания случайной величины. 1. Средняя арифметическая постоянной равна самой постоянной. 2. Если все варианты увеличить (уменьшить) в одно и то же число раз, то средняя арифметическая увеличится (уменьшится) во столько же раз: cx cx k или cxi ni i 1 n k c xn i i i 1 n . 3. Если все варианты увеличить (уменьшить) на одно и то же число, средняя арифметическая увеличится (уменьшится) на то же число: x c x c или k k xi c ni xi ni i 1 n i 1 n c. 4. Средняя арифметическая отклонений вариантов от средней арифметической равна нулю: x x 0 или x x n k i 1 i i 0. 5. Средняя арифметическая алгебраической суммы нескольких признаков равна такой же сумме средних арифметических этих признаков: x y x y . 70 Выборочной дисперсий D вариационного ряда называется средняя арифметическая квадратов отклонений вариантов от их средней арифметической: x x n D 2 i i 1 n (3) . Если данные наблюдений представлены в виде статистического ряда, то выборочную дисперсию определяют по формуле: x x k D i 1 2 i n ni (4) . Пример 3. Для условия примера 1 найти выборочную дисперсию. Решение. Учитываем, что средний размер диаметра валика составляет x 6, 77 . Тогда по формуле (3): 6, 71 6, 77 6, 73 6, 77 6, 74 6, 77 D 2 2 2 ... 6,83 6, 77 10 2 0, 01 . Пример 4. Для условия примера 2 вычислить выборочную дисперсию распределения рабочих по выработке. Решение. В примере 2 определена средняя выработка рабочего механического цеха x 126 . Дисперсию определим по формуле (4), промежуточные результаты вычислений представим в табл. 1: ni xi x x x 90 1 -36 1296 1296 100 3 -26 676 2028 110 6 -16 256 1536 120 7 -6 36 252 130 21 4 16 336 140 12 14 196 2352 i x x Таблица 1 xi 2 2 i ni 7800 Выборочная дисперсия распределения рабочих по выработке равна: D 7800 156 . 50 Отметим основные свойства дисперсии, аналогичные свойствам дисперсии случайной величины. 71 1. Дисперсия постоянной равна нулю. 2. Если все варианты увеличить (уменьшить) в одно и то же число c раз, то дисперсия увеличится (уменьшится) в раз: или Dcx c 2 Dx c2 x c xc k i 1 i n 2 x x k ni c 2 i 1 i n 2 ni . 3. Если все варианты увеличить (уменьшить) на одно и то же число, то x c x c k дисперсия не изменится: Dk c Dx D или i i 1 n x x k 2 ni i 1 i 2 ni . n 4. Дисперсия равна разности между средней арифметической квадратов k 2 вариантов и квадратом средней арифметической: D x2 x , где x 2 x n i 1 2 i i n . Рассмотрим некоторые специальные характеристики, которые позволяют оценить отличие эмпирических распределений от нормального распределения. 26.1.3. Асимметрия и эксцесс При изучении распределений, отличных от нормального, возникает необходимость качественно оценить это различие. С этой целью вводят специальные характеристики, в частности, асимметрию и эксцесс. Для нормального распределения эти характеристики равны нулю. Следовательно, если для изучаемого распределения асимметрия и эксцесс имеют небольшие значения, то можно предположить близость этого распределения к нормальному. Напротив, большие значения асимметрии и эксцесса указывают на значительные отклонения от нормального. Коэффициент асимметрии – показатель симметричности распределения частот, вычисляемый для статистического ряда по формуле: x x k A i 1 i n 3 3 ni . (5) Знак коэффициента показывает направление асимметрии: если A 0 , то асимметрия левосторонняя (отрицательная); если A 0 , то асимметрия правосторонняя (положительная). Для оценки так называемой «крутости», т. е. большего или меньшего подъема кривой распределения по сравнению с нормальной кривой, используется числовая характеристика, называемая эксцессом. Эксцесс – это показатель отклонения вершин графика кривой эмпирического распределения вверх или вниз от вершины кривой нормального распределения, вычисляемый по формуле: 72 x x k E i 1 4 i n 4 ni 3. (6) Вычисленное значение эксцесса может оказаться положительным или отрицательным. Если Е 0 , то эмпирическое распределение более плосковершинное; если Е 0 , то распределение более островершинное, чем нормальное. Отличие эксцесса некоторого распределения от нуля означает, что кривая этого распределения отличается от нормальной кривой. Вычисленное значение эксцесса может оказаться положительным или отрицательным: если Е 0 , то распределение более плосковершинное; если Е 0 , то распределение более островершинное, чем нормальное. Положительный эксцесс указывает на более высокую и «острую» вершину», отрицательный эксцесс указывает на более низкую и «плоскую» вершину у графика кривой эмпирического распределения, чем у нормальной кривой. Интервальные оценки параметров распределения Точечной называют оценку, которая определяется одним числом. Все оценки, рассмотренные выше, являются точечными. При выборе малого объема точечная оценка может значительно отличаться от оцениваемого параметра, и ее использование может приводить к грубым ошибкам и ошибочным прогнозам. По этой причине при небольшом объеме выборки следует использовать интервальные оценки. Интервальной называют оценку, которая определяется двумя числами, являющимися концами интервала. Интервальные оценки позволяют установить точность и надежность получаемых оценок. Пусть найденная по данным выборки статистическая характеристика Z * служит оценкой неизвестного параметра Z . Будем считать Z постоянным числом ( Z может быть и случайной величиной). Очевидно, что Z * тем точнее определяет параметр Z , чем меньше абсолютная величина разности Z Z * . Другими словами, если 0 и Z Z * , то чем меньше , тем оценка точнее. Таким образом, положительное число можно использовать в качестве характеристики точности оценки. Поскольку все вычисления проводятся по выборке, применение статистических методов не позволяет категорически утверждать, что оценка Z * удовлетворяет неравенству: Z Z* . (7) Можно лишь говорить о вероятности , с которой это неравенство осуществляется. Надежностью (доверительной вероятностью) оценки Z по Z * называют вероятность , с которой осуществляется неравенство Z Z * . 73 Обычно надежность оценки задается заранее, причем в качестве берут число, близкое к единице. Наиболее часто задают надежность, равную 0,95, 0,99, 0,999. Пусть вероятность того, что имеет место неравенство Z Z * , равна , т. е. P Z Z * . Заменим неравенство (7) равносильным ему двойным неравенством Z Z * или Z * Z Z * . Тогда имеем: P Z * Z Z * . (8) Соотношение (8) следует понимать так: вероятность того, что интервал вида Z ; Z * действительно заключает в себе неизвестный параметр Z , равна . * Доверительным называют интервал Z * ; Z * , который покрывает неизвестный параметр Z с заданной надежностью . Построение доверительного интервала для оценки математического ожидания Пусть количественный признак X генеральной совокупности распределен нормально, причем среднее квадратическое отклонение этого распределения известно. Требуется оценить неизвестное математическое ожидание а по выборочной средней х . Поставим задачу найти доверительные интервалы, покрывающие параметр а с надежностью . Будем рассматривать выборочную среднюю х как случайную величину X (значение х изменяется от выборки к выборке) и выборочные значения признака x1 , x2 , ..., xn – как одинаково распределенные независимые случайные величины X 1 , X 2 , ..., X n (эти числа также изменяются от выборки к выборке). Другими словами, математическое ожидание каждой из этих величин равно а и среднее квадратическое отклонение принимает значение . Примем без доказательства известное из курса математической статистики утверждение: если случайная величина X распределена нормально, то выборочная средняя X , найденная по независимым наблюдениям, также распределена нормально. Параметры распределения X таковы: M X a , X Г , где n – объем n выборки, Г – генеральное среднее квадратическое отклонение. Потребуем, чтобы выполнялось соотношение P X a , где – заданная надежность. 74 Воспользуемся формулой P X a 2Ф , заменив X на X , на n n . 2Ф t , где t Г n Г t Выразив из последнего равенства Г , получим: n t P X a Г 2Ф t . n X Г , получим P X a 2Ф Чтобы получить рабочую формулу, выборочную среднюю вновь обозначим через х . Приняв во внимание, что вероятность P задана и равна , окончательно получим: t t P x Г a x Г n n 2Ф t . Полученное соотношение означает: с надежностью можно утверждать, что доверительный интервал вида: t Г t ;x Г x n n , (9) покрывает неизвестный параметр а. При этом точность оценки вычисляется по формуле: t Г n . (10) Входящее в формулу (10) число t определяется из равенства: 2Ф t или Ф t . 2 (11) По таблице функции Лапласа находят аргумент t , которому соответствует значение функции Лапласа, равное . 2 Итак, поставленная выше задача полностью решена. Оценка вида xa t Г называется классической. n Из формулы (10), определяющей точность классической оценки, можно сделать важные выводы: 1) при возрастании объема выборки n число убывает и, следовательно, точность оценки увеличивается; 2) увеличение надежности оценки 2Ф t приводит к увеличению t , так как функция Лапласа Ф t – возрастающая функция. То есть при увеличении 75 надежности значение тоже растет. В результате обнаруживается обратная зависимость между показателями надежности и точности оценки: увеличение надежности классической оценки влечет за собой уменьшение ее точности. Рассмотрим примеры вычисления доверительных интервалов. Пример 5. Найти доверительный интервал для оценки с надежностью 0,99 неизвестного математического ожидания a нормально распределенного признака X генеральной совокупности, если генеральное среднее квадратическое отклонение Г 3 , выборочная средняя x 24 и объем выборки n 36 . Решение. Найдем t из соотношения 2Ф t 0,99 , Ф t 0, 495 . По таблице функции Лапласа находим t 2,58 . Подставим t 2,58 , x 24 , 3 , n 36 в соотношение x Окончательно 24 t Г t a x Г . n n получим искомый 2,58 3 2,58 3 или 22,71 a 25, 29 . a 24 36 36 доверительный интервал Пример 6. Выборка из большой партии электроламп содержит 100 ламп. Средняя продолжительность горения лампы выборки оказалась равной 1000 ч. Найти с надежностью 0,95 доверительный интервал для средней продолжительности a горения лампы всей партии, если известно, что среднее квадратическое отклонение продолжительности горения лампы Г 40 ч. Предполагается, что продолжительность горения ламп распределена нормально. Решение. Найдем t из соотношения 2Ф t 0,95 , Ф t 0, 475 . По таблице функции Лапласа t 1,96 . n 100 x 1000 , Г 40 , Подставим в соотношение t 1,96 , t t x Г a x Г . n n Окончательно получим искомый доверительный интервал: 1000 1,96 40 1,96 40 или 992,16 a 1007,84 . a 1000 100 100 Пример 7. Станок автомат штампует валики. По выборке объема n 100 вычислена выборочная средняя диаметров изготовленных валиков. Найти с надежностью 0,95 точность , с которой выборочная средняя оценивает математическое ожидание диаметров изготавливаемых валиков, зная, что их среднее квадратическое отклонение Г 2 мм. Предполагается, что диаметры валиков распределены нормально. Решение. Найдем t из соотношения 2Ф t 0,95 , Ф t 0, 475 . По таблице функции Лапласа t 1,96 . Подставим t 1,96 , Г 2 , n 100 в формулу для вычисления точности t Г , окончательно получим точность, с которой выборочная средняя оцеn 76 нивает математическое 1,96 2 0,392 мм. 100 ожидание диаметров изготавливаемых валиков Пример 8. Найти минимальный объем выборки, при котором с надежностью 0,975 точность оценки математического ожидания генеральной совокупности по выборочной средней равна 0,3 . Известно, что в нормально распределенной генеральной совокупности Г 1, 2 . Решение. Воспользуемся формулой, определяющей точность оценки математического ожидания генеральной совокупности по выборочной средней: t 2 Г2 t Г . Выразим из этой формулы объем выборки: n 2 . n 0,975 По условию 0,975 , следовательно, Ф t 0, 4875 . По таблице 2 функции Лапласа находим t 2, 24 . Подставив t 2, 24 , Г 1, 2 и 0,3 , получим искомый объем выборки: n 2, 242 1, 22 80 . 0,32 Построение доверительного интервала для оценки среднего квадратического отклонения Пусть количественный признак X генеральной совокупности распределен нормально. Требуется оценить неизвестное генеральное среднее квадратическое отклонение Г по «исправленному» выборочному среднему квадратическому отклонению s n 1 D . n Поставим задачу найти доверительные интервалы, покрывающие параметр Г с заданной надежностью . Потребуем, чтобы выполнялось соотношение P Г s или P s Г s . Для того чтобы можно было пользоваться готовой таблицей, преобразуем s Г s двойное неравенство в равносильное неравенство s 1 s 1 . Положив q , получим s 1 q Г s 1 q . s s s Остается найти q . С этой целью введем в рассмотрение случайную величину «хи»: Величина S n 1 Г , где n – объем выборки. S 2 n 1 Г2 распределена по закону 2 с ( n 1 ) степенями свободы, поэтому квадратный корень из нее обозначают через . Плотность распределения имеет вид R , n 77 n2 2 e 2 . n 3 n 1 2 2 Г 2 Это распределение не зависит от оцениваемого параметра , а зависит лишь от объема выборки n . Преобразуем неравенство s 1 q Г s 1 q так, чтобы оно приняло вид 1 2 . Вероятность этого неравенства равна заданной вероятности , т. е. 2 R , n d . 1 Предполагая, что q 1 , перепишем неравенство s 1 q Г s 1 q в виде: 1 1 1 . Умножив все элементы неравенства на S n 1 , получим S 1 q Г S 1 q n 1 n 1 n 1 S n 1 n 1 или . 1 q 1 q 1 q Г 1 q Вероятность того, что выполняется это неравенство и равносильное ему неравенство s 1 q Г s 1 q , равна n 1 1 q R , n d . Из этого уравнения по n 1 1 q заданным n и можно найти q . Для нахождения q на практике используется специальная таблица, содержащая значения q q( , n) . Вычислив по выборке значение s и найдя по таблице величину q , получим искомый доверительный интервал вида: s 1 q Г s 1 q , (12) покрывающий генеральное среднее квадратическое отклонение Г с заданной надежностью . Пример 9. Количественный признак X генеральной совокупности распределен нормально. По выборке объема n 25 найдено «исправленное» среднее квадратическое отклонение s 0,8 . Найти доверительный интервал, покрывающий генеральное среднее квадратическое отклонение с надежностью 0,95. Решение. Используя данные 0,95 и n 25 , по таблице, содержащей значения q q( , n) , найдем q 0,32 . Подставляя имеющиеся данные в формулу (12), получим искомый доверительный интервал: 0,8 1 0,32 Г 0,8 1 0,32 или 0,544 Г 1,056 . Пример 10. По данным выборки объема n 16 из генеральной совокупности найдено «исправленное» среднее квадратическое отклонение s 1 нормально распределенного количественного признака. Найти доверительный интервал, покрывающий генеральное среднее квадратическое отклонение Г с надежностью 0,95. Решение. Используя данные 0,95 и n 16 , по таблице, содержащая значения q q( , n) , найдем q 0, 44 . Подставляя имеющиеся данные в формулу (12), определим искомый доверительный интервал: 1 1 0, 44 Г 1 1 0, 44 или 0,56 Г 1, 44 . 78 ТЕМА № 7. КОРРЕЛЯЦИОННО-РЕГРЕССИОННЫЙ АНАЛИЗ Лекция 7.1. Корреляционный анализ В любой отрасли науки и техники приходится изучать зависимости между различными величинами. В реальных условиях явления природы происходят под влиянием многочисленных факторов, влияние каждого из которых ничтожно, а общее число их велико. Во многих практических исследованиях не удается устранить влияние посторонних факторов и приходится ограничиваться наблюдениями в естественных условиях. Так возникают две основные задачи: 1. Определить на основе значительного числа наблюдений, как меняется в среднем результативный признак (функция) в связи с изменением одного или нескольких аргументов, если бы другие аргументы (факторы) не изменялись. Причем задача должна решаться в ситуации, когда прочие аргументы на самом деле изменяются и своей изменчивостью искажают исследуемую зависимость. 2. Определить степень влияния искажающих факторов. Другими словами, требуется определить силу, с которой данная зависимость проявляется среди многообразия нарушающих ее воздействий. Первая задача выражает сущность регрессионного анализа и решается в результате составления уравнения регрессии. Вторая задача относится к корреляционному анализу и решается на основе определения различных показателей тесноты связи. Понятие о статистической и корреляционной связи Современная наука исходит из взаимосвязей всех явлений природы и общества. Невозможно управлять явлениями, предсказывать их развитие без изучения характера, силы и других особенностей действующих связей. Поэтому методы исследования, измерения связей составляют чрезвычайно важную часть методологии научного исследования, в том числе и статистического. Различают два типа связей между различными явлениями и их признаками: функциональную, или жестко детерминированную, с одной стороны, и статистическую (или стохастически, вероятностно детерминированную), с другой. Строго определить различие этих типов связи можно тогда, когда они получают математическую формулировку. Для простоты будем говорить о связи двух явлений или двух признаков, математически отображаемой в форме уравнения связи двух переменных. Если с изменением значения одной из переменных вторая изменяется строго определенным образом, т. е. значению одной переменной обязательно соответствует одно или несколько точно заданных значений другой переменной, связь между ними является функциональной. Функциональная связь двух величин возможна лишь при условии, что вторая из них зависит только от первой. В реальных процессах и явлениях таких 79 связей не существует. Они являются лишь абстракциями, полезными и необходимыми при анализе явлений, но значительно упрощающими реальность. Функциональная зависимость данной величины y от многих факторов возможна только в том случае, если величина y всегда зависит только от перечисленного набора факторов и не зависит от других. Взаимосвязи между явлениями и процессами реального мира гораздо сложнее, и нет такого конечного числа переменных k , которое абсолютно полно определяло бы собой зависимую величину y . Следовательно, множественная функциональная зависимость переменных также является абстракцией, упрощающей реальность. Однако в различных областях науки и практики успешно используется представление связей как функциональных не только в аналитических целях, но нередко и в целях прогнозирования. Это оказывается возможным потому, что в достаточно простых системах интересующая исследователя переменная величина зависит в основном (скажем, на 99% или даже на 99,99%) от немногих других переменных или только от одной переменной, т. е. связь является хотя и не абсолютно функциональной, но практически очень близкой к таковой. Например, длина года (период обращения Земли вокруг Солнца) почти функционально зависит только от массы Солнца и расстояния Земли от него. На самом деле она зависит в очень слабой степени и от масс, и расстояния других планет от Земли, но вносимые ими (и тем более далекими звездами) искажения функциональной связи для всех практических целей, кроме космонавтики, пренебрежимо малы. Возникновение понятия статистической связи обусловливается тем, что зависимая переменная подвержена влиянию ряда неконтролируемых или неучтенных факторов, а также тем, что измерение значений переменных неизбежно сопровождается некоторыми случайными ошибками. Стохастически детерминированная связь не имеет ограничений и условий, присущих функциональной связи. Если с изменением значения одной из переменных вторая может в определенных пределах принимать любые значения с некоторыми вероятностями, но ее среднее значение или иные статистические (массовые) характеристики изменяются по определенному закону, связь является статистической. Иными словами, при статистической связи разным значениям одной переменной соответствуют разные распределения значений другой переменной. В настоящее время наука не знает более широкого определения связи. Все связи, которые могут быть измерены и выражены численно, подходят под определение «статистические связи». Функциональные связи представляют собой частный случай статистических связей, когда значениям одной переменной соответствуют «распределения» значений второй, состоящие из одного или нескольких значений и имеющие вероятность, равную единице. Конечно, качественное различие действительно вероятностных распределений и отдельных значений, имеющих вероятность единицы (достоверных), настолько велико, что хотя функциональные связи и могут рассматриваться как предельный случай статистической связи, все же с полным основанием можно говорить о двух типах связей. 80 В силу неоднозначности статистической зависимости между Х и У для исследователя, в частности, представляет интерес усредненная по x схема зависимости, т. е. закономерность в изменении среднего значения (условного математического ожидания) в зависимости от x . Важнейшим частным случаем статистической связи является корреляционная связь, состоящая в том, что разным значениям одной переменной соответствуют различные средние значения другой. С изменением значения признака x закономерным образом изменяется среднее значение признака y , в то время как в каждом отдельном случае значение признака y (с различными вероятностями) может принимать множество различных значений. Статистическая зависимость между двумя переменными, при которой каждому значению одной переменной соответствует определенное среднее значение, т. е. условное математическое ожидание другой, называется корреляционной. Корреляционная зависимость между двумя переменными представляет собой функциональную зависимость между значениями одной из величин и условным математическим ожиданием другой величины. Если же с изменением значения признака x среднее значение признака y не изменяется закономерным образом, но закономерно изменяется другая статистическая характеристика (показатели вариации, асимметрии, эксцесса и т. п.), то связь не будет корреляционной, но является статистической. Статистическая связь между двумя признаками (переменными величинами) предполагает, что каждый из них имеет случайную вариацию индивидуальных значений относительно средней величины. Если же такую вариацию имеет только один из признаков, а значения другого являются жестко детерминированными, то говорят лишь о регрессии. Например, при анализе динамических рядов можно измерять регрессию уровней ряда урожайности (имеющих случайную колеблемость) на номера лет. При этом нельзя говорить о корреляции между ними и применять показатели корреляции с соответствующей интерпретацией. Термин «корреляция» ввел в статистику английский биолог и статистик Френсис Гальтон в конце XIX в. Выступая 9 февраля 1877 г. с очередным сообщением о наследственности на заседании Королевского научного общества в Лондоне, он несколько раз употребил новый термин «корреляция». Этот день считается днем зарождения нового научного направления – теории корреляции. Еще раньше, в конце XVIII в., этот термин использовал знаменитый французский палеонтолог (специалист по ископаемым останкам животных и растений прошлых эпох) Жорж Кювье. Им также был сформулирован «закон корреляции» частей и органов животных, помогающий восстанавливать по найденным останкам облик всего животного и устанавливать его место в классификационной системе. Так, если при раскопках был найден череп с рогами, то животное являлось травоядным, а его конечности имели копыта. Если же были обнаружены лапы с когтями, то они принадлежали хищному животному без рогов, но с крупными клыками. 81 Студенческий фольклор сохранил поучительный рассказ о Кювье и «законе корреляции». В дни университетского праздника студенты решили подшутить над профессором Кювье. Они вырядили одного из студентов в козлиную шкуру с рогами и копытами и подсадили его в окно спальни Кювье. Ряженый затопал копытами и завопил: «Я тебя съем!» Проснувшийся профессор, увидев силуэт с рогами, спокойно отвечал: «Если у тебя рога и копыта, то по закону корреляции ты травоядное, и съесть меня не можешь. А за то, что не знаешь закона корреляции, получишь двойку!» Выборочный коэффициент корреляции Корреляционная связь между признаками может возникнуть разными путями. Первый важнейший путь возникновения отражает причинную зависимость результативного признака Y от вариации факторного признака Х. Например, если один признак отражает балл оценки плодородия почв, а другой признак – урожайность сельскохозяйственной культуры, то логически очевидно, какой из признаков выступает как независимая переменная (фактор) x , а какой признак является зависимой переменной (результатом) y . Второй путь связан с сопряженностью, возникающей при наличии у признаков общей причины. Известен классический пример, приведенный крупнейшим статистиком России начала XX в. А. А. Чупровым. Если в качестве признака Х взять число пожарных команд в городе, а за признак Y принять суммарные убытки за год в городе от пожаров, то между признаками Х и Y в совокупности городов России существовала прямая корреляция. Получается, что в среднем, чем больше пожарных в городе, тем больше и убытков от пожаров. Уж не занимались ли пожарные поджигательством из боязни потерять работу? Дело в том, что данную корреляцию нельзя интерпретировать как связь причины и следствия. Оба признака являются следствиями, имеющими общую причину, каковой является размер города. Вполне логично, что в крупных городах больше пожарных частей, но больше и пожаров, и убытков от них за год, чем в малых городах. Третий путь возникновения корреляции – взаимосвязь признаков, каждый из которых является и причиной, и следствием одновременно. Такова, например, корреляция между уровнями производительности труда рабочих и уровнем оплаты одного часа труда (тарифной ставкой). С одной стороны, уровень зарплаты является следствием производительности труда: чем она выше, тем выше и оплата. Но, с другой стороны, установленные тарифные ставки и расценки играют стимулирующую роль: при правильной системе оплаты они выступают в качестве фактора, от которого зависит производительность труда. В такой системе признаков допустимы обе постановки задачи, когда каждый признак может выступать в роли независимой переменной x и в качестве зависимой переменной y . Во многих задачах требуется установить и оценить зависимость изучаемой случайной величины от одной или нескольких других величин. Первичный анализ данных в корреляционном анализе связан с построением в прямоугольной декартовой системе координат поля корреляции, наглядно иллюстрирующего наличие и степень статистической связи между двумя признаками (рис. 1). 82 y y 0 x а) y 0 б) x 0 в) x Рисунок 1. Поле корреляции Анализ изображения заданных пар случайных величин показывает, что рис. 1 (а) иллюстрирует наличие тесной статистической связи; на рис. 1 (б) показан случай, когда эта связь слабая; на рис. 1 (в) связь между величинами x и y отсутствует. Построение поля корреляции зависит от объема выборки. Если объем выборочной совокупности небольшой, то вся выборка изображается в виде точек с координатами xi ; yi . Если объем выборки большой, то выборочные данные следует упорядочить, сгруппировав переменные и представив их в виде рядов. Сгруппированные ряды могут быть как дискретными, так и интервальными. В случае дискретных рядов по осям координат откладываются дискретные значения переменных. При построении интервальных рядов по осям координат откладываются интервалы изменения переменных, наносится координатная сетка, все пары переменных из выборки изображаются в виде точек в соответствующих клетках (рис. 2). Y 150 130 110 90 70 50 0 50 70 90 110 Рисунок 2. Поле корреляции 83 130 150 Х Заметим, что по характеру расположения точек на поле корреляции можно сделать предварительный вывод не только о наличии и тесноте корреляционной связи между величинами, но и ее предполагаемой форме и направленности. Для оценки степени связи между признаками x и y служит выборочный коэффициент корреляции, который вычисляется по выборочным данным. Линейный коэффициент корреляции rxy определяется по формуле: x x y y n rху i 1 i x x n i 1 i 2 i y y n i 1 , (1) 2 i где хi , yi – наблюдавшиеся значения признаков; n – объем выборки; x , y – средние арифметические значения. Для обозначения линейного коэффициента корреляции иногда используется символ r. Свойства выборочного коэффициента корреляции. 1. Абсолютная величина коэффициента корреляции не превосходит единицы, т. е. его значения удовлетворяют двойному неравенству: 1 rxy 1 . 2. Чем ближе абсолютное значение rxy к единице, тем сильнее линейная связь между признаками. 3. Если коэффициент корреляции принимает значения 1 rху 0 , то признаки находятся в убывающей зависимости. 4. Если коэффициент корреляции принимает значения 0 rху 1, то зависимость – возрастающая. 5. Если rху 1 , то между признаками существует функциональная зависимость. 6. Если rху 0 , то между признаками X и Y отсутствует линейная корреляционная связь. Для качественной оценки тесноты связи между факторами X и Y можно воспользоваться таблицей шкалы Чеддока: Таблица 1 Диапазон изменения 0,1–0,3 0,3–0,5 0,5–0,7 0,7–0,9 0,9–0,99 Характер тесноты связи слабая умеренная хорошая сильная очень сильная 84 Приведем примеры применения корреляционного анализа к статистическим данным. Пример 1. Изучается зависимость между ценой квартиры ( y – тыс. у. е.) и размером ее жилой площади ( x – кв. м) в 2016 г. по следующим данным: № 1 2 3 4 5 6 7 8 9 10 x 28 25 33 46 32 24 32 24 36 30 y 34 28 38 46 36 26 28 29 30 35 Постройте поле корреляции. Вычислите выборочный коэффициент корреляции и поясните его смысл. Решение. По исходным данным построим поле корреляции, характеризующее зависимость цены квартиры от жилой площади (рис. 3). y 48 46 44 42 40 38 36 34 32 30 28 26 24 0 24 26 28 30 32 34 36 38 40 42 44 46 48 x Рисунок 3. Поле корреляции Сделаем предварительный вывод о наличии достаточно сильной связи между стоимостью и жилой площадью квартиры. Найдем среднюю стоимость квартир и средний размер жилой площади: 28 25 33 46 32 24 32 24 36 30 310 31 , 10 10 34 28 38 46 36 26 28 29 30 35 330 y 33 . 10 10 x 85 Определим выборочный коэффициент корреляции, промежуточные результаты вычислений представим в табл. 2. Таблица 2 x x y y yi y y y 9 1 1 –3 –6 36 –5 25 30 38 2 4 5 25 10 46 46 15 225 13 169 195 5 32 36 1 1 3 9 3 6 24 26 –7 49 –7 49 49 7 32 28 1 1 –5 25 –5 8 24 29 –7 49 –4 16 28 9 36 30 5 25 –3 9 –15 10 30 35 –1 1 2 4 –2 310 330 – 400 – 332 290 № xi yi xi x x x 1 28 34 –3 2 25 28 3 33 4 2 i 2 i Выборочный коэффициент корреляции равен rху i i 290 0,80 . Так как 400 332 выборочный коэффициент корреляции равен 0,8, то между признаками существует сильная зависимость. Так как выборочный коэффициент корреляции больше нуля, то между признаками существует возрастающая зависимость. Пример 2. Установите, есть ли взаимосвязь между оперативными данными МЧС и Рослесхоза за август по количеству природных пожаров. Дата Оперативные данные МЧС 19 Оперативные данные Рослесхоза 58 14.08 34 Оперативные данные Рослесхоза 24 03.08 18 57 22.08 11 3 06.08 29 58 23.08 9 17 07.08 23 56 27.08 2 14 08.08 25 45 28.08 2 16 10.08 26 18 29.08 3 12 13.08 32 20 30.08 4 12 Дата Оперативные данные МЧС 02.08 Решение. Определим выборочный коэффициент корреляции по формуле (1), промежуточные результаты вычислений представим в табл. 3. 86 Таблица 3 x x y y № xi yi xi x x x i yi y y y 1 19 58 2,07 4,29 28,71 824,51 59,48 2 18 57 1,07 1,15 27,71 768,08 29,69 3 29 58 12,07 145,72 28,71 824,51 346,62 4 23 56 6,07 36,86 26,71 713,65 162,19 5 25 45 8,07 65,15 15,71 246,94 126,84 6 26 18 9,07 82,29 –11,29 127,37 –102,38 7 32 20 15,07 227,15 –9,29 86,22 –139,95 8 34 24 17,07 291,43 –5,29 27,94 –90,23 9 11 3 –5,93 35,15 –26,29 690,94 155,84 10 9 17 –7,93 62,86 –12,29 150,94 97,41 11 2 14 –14,93 222,86 –15,29 233,65 228,19 12 2 16 –14,93 222,86 –13,29 176,51 198,34 13 3 12 –13,93 194,01 –17,29 298,80 240,77 14 4 12 –12,93 167,15 –17,29 298,80 223,48 237 410 – 1758,93 – 5468,86 1536,29 2 2 i i i Найдем среднее число пожаров для каждого из признаков: x y r 237 16,93 , 14 410 29, 29 . Вычислим выборочный коэффициент корреляции по формуле (1): 14 1536, 29 0, 495 . 1758,93 5468,86 Так как выборочный коэффициент корреляции равен 0,495, то между признаками наблюдается умеренная связь. Поскольку выборочный коэффициент корреляции больше нуля, то наблюдаемая между признаками связь является возрастающей. Лекция 7.2. Регрессионный анализ Во многих практических исследованиях на производстве, в экономике, социологии, экологии на основе значительного числа наблюдений можно определить, как меняется в среднем результативный признак (функция) в связи с изменением одного или нескольких аргументов, если бы другие аргументы (факторы) не изменялись. Причем задача должна решаться на материале, где прочие 87 аргументы на самом деле изменяются и своей изменчивостью искажают интересующую нас зависимость. Данная задача решается составлением уравнения регрессии и носит название регрессионного анализа. Основные понятия регрессионного анализа Исследуя законы наследственности, Ф. Гальтон собрал определенный статистический материал, иллюстрирующий зависимость роста сыновей от роста отцов. На основании полученных данных им был сделан вывод о том, что в среднем рост сыновей уменьшается по сравнению с ростом отцов («регрессия к среднему»). Он даже вычислил уравнение этой зависимости, которое назвал уравнением регрессии. Отсюда термин «регрессия» и вошел в математику. Надо заметить, что вывод Гальтона об уменьшении роста сыновей не нашел подтверждения в более поздних исследованиях других ученых. Тем не менее, метод, им разработанный, был взят на вооружение и используется всеми, кому приходится заниматься обработкой опытных данных. Регрессия раскрывает форму связи, показывает, как в среднем будет изменяться результативный признак при изменении наблюдавшегося (факторного) признака. Причем «изменение в среднем» следует понимать как изменение условного среднего значения (по аналогии с условным математическим ожиданием). Объектом исследования в регрессионном анализе являются технические, экологические, социальные, экономические и другие системы. Предмет исследования составляют математические модели регрессионного анализа. Цель применения понятий и методов регрессионного анализа заключается в установлении по результатам статистических наблюдений адекватной аналитической зависимости между показателями и факторами, которые характеризуют изучаемые системы. Пусть значения результативного признака Y удалось, в простейшем случае, приближенно представить в виде некоторой функции от одного из наблюдавшихся признаков Х. Регрессионный анализ позволяет установить, как в среднем будет изменяться результативный признак при изменении наблюдавшегося (факторного) признака. Изменение в среднем понимают как изменение условного среднего значения (по аналогии с условным математическим ожиданием). В курсе теории вероятностей условным математическим ожиданием М (Y | Х = х) называется математическое ожидание случайной величины Х, найденное при условии, что случайная величина Y приняла значение х. Аналогично определяется условное математическое ожидание М (Х | Y = у). Корреляционная зависимость между двумя переменными величинами представляет собой функциональную зависимость между значениями одной из величин и условным математическим ожиданием другой. Корреляционную зависимость можно представить в виде: 88 М (Y | X x) ( x) (1) или М ( X | Y y) ( y) . (2) При этом предполагается, что: ( x) const , ( y) const . Если при изменении х или у условные математические ожидания не изменяются, то это означает, что корреляционная зависимость между признаками Х и Y отсутствует. Функция, выражающая корреляционную зависимость между признаками, называется уравнением регрессии. Уравнения (1) и (2) называются уравнениями регрессии соответственно Y по Х и Х по Y. Графики уравнений (1) и (2) задают линии регрессии. Если уравнение связывает лишь два признака (результативный признак Y и наблюдавшийся признак X ), то его называют уравнением парной регрессии. Если уравнение отражает зависимость результативного признака Y от двух и более факторных (наблюдавшихся) признаков, то говорят об уравнении множественной регрессии. Составление уравнения регрессии дает возможность исследователю количественно оценить влияние отобранных факторов на изучаемый показатель, позволяет выбрать наиболее адекватную модель связи между явлениями. Метод наименьших квадратов. Линейное уравнение регрессии Простейшей системой корреляционной связи является линейная связь между двумя признаками, называемая парной линейной корреляцией. Практическое ее значение связано с тем, что во многих системах среди всех факторов, влияющих на результативный признак, можно выделить один важнейший фактор, который в основном определяет вариацию результативного признака. Уравнение парной линейной корреляционной связи называется уравнением парной регрессии и имеет вид y a bx , где y – среднее значение результативного признака y при определенном значении признака x . Построение линейной регрессии сводится к оценке ее параметров – нахождению числовых значений a и b . Классический подход к оцениванию параметров линейной регрессии основан на методе наименьших квадратов (МНК). МНК позволяет получить такие оценки параметров a и b, при которых сумма квадратов отклонений фактических значений результативного признака у от теоретических y будет минимальна: n i 1 yi yi 89 2 min (рис 1). y y a bx xi ; yi yi a bxi х 0 Рисунок 1 x n Обозначим сумму квадратов отклонений y a bx i 1 n i i 2 через S a; b : S a; b yi a bxi . 2 i 1 Как известно из курса математического анализа, чтобы найти минимум данной функции, нужно вычислить частные производные по каждому из параметров a, b, и приравнять их к нулю. Вычислим частные производные по каждому из параметров a, b: n n S S 2 yi a bxi , 2 yi a bxi xi . a b i 1 i 1 Частные производные приравняем к нулю: n 2 yi a bxi 0 i 1 . n 2 y a bx x 0 i i i i 1 Выполним элементарные преобразование системы: n yi a bxi 0 i 1 , n y a bx x 0 i i i i 1 n n n y a bxi 0 i i 1 i 1 i 1 , n n n x y x a bx 2 0 i i i i i 1 i 1 i 1 90 n n y na b xi 0 i i 1 i 1 , n n n 2 x y a x b x 0 ii i i i 1 i 1 i 1 n n na b x yi i i 1 i 1 . n n n 2 a x b x x y i i i i i 1 i 1 i 1 Найдем решение системы: 1 n 1 n a y xi i n b n i 1 i 1 , n n n a x b x 2 x y i i i i i 1 i 1 i 1 1 n 1 n a y b xi i n i 1 n i 1 , n n n n n 1 1 2 yi b xi xi b xi xi yi n n i 1 i 1 i 1 i 1 i 1 1 n 1 n a y b xi i n i 1 n i 1 , n n n n n n 1 1 2 xi xi b xi xi yi xi yi n b i 1 i 1 i 1 i 1 n i 1 i 1 1 n 1 n a y b xi i n n i 1 i 1 , 2 n n n n n b x 2 1 x x y 1 x i i i i n i yi n i 1 i 1 i 1 i 1 i 1 n 1 n a yi b xi n i 1 i 1 n n n 1 xi yi xi yi . n i 1 i 1 i 1 b 2 n 1 n 2 xi xi n i 1 i 1 (3) Полученные формулы (3) используются для вычисления параметров уравнения парной регрессии y a bx . Параметр b называется коэффициентом регрессии Y по Х. Он показывает, на сколько единиц в среднем изменяется Y при увеличении Х на одну единицу. Возможность четкой интерпретации коэффициента регрессии сделала линейное уравнение регрессии достаточно распространенным в исследованиях. 91 Пример 1. Требуется выявить зависимость аварий на дорогах от количества автотранспорта для некоторого региона на основе результатов ежегодных наблюдений, заданных в следующей таблице: Год Количество аварий на дорогах Количество зарегистрированных транспортных средств 2004 2005 2006 2007 2008 2009 2010 2011 2012 2013 2014 166 153 177 201 216 208 227 238 268 268 274 352 373 411 441 462 490 529 577 641 692 743 Решение. Введем необходимые обозначения: yi – количество аварий в год; xi – количество транспортных средств. Определим параметры уравнения линейной регрессии по формулам (3). Промежуточные результаты представим в табл. 1: Таблица 1 хi2 № хi yi хi yi 1 352 166 58432 123904 2 373 153 57069 139129 3 411 177 72747 168921 4 441 201 88641 194481 5 462 216 99792 213444 6 490 208 101920 240100 7 529 227 120083 279841 8 577 238 137326 332929 9 641 268 171788 410881 10 692 268 185456 478864 11 743 274 203582 552049 5711 2396 1296836 3134543 1 5711 2396 1 11 0,31 , a 2396 0,31 5711 55,85 , то Так как b 1 11 3134543 57112 11 уравнение линейной регрессии имеет вид y 55,85 0,31x . 1296836 Полученное уравнение регрессии, в котором коэффициент регрессии равен 0,31, позволяет сделать вывод: при увеличении на одну единицу зарегистрированных транспортных средств число аварий на дорогах увеличивается на 0,31. 92 Пример 2. Администрация компании по продаже легковых автомобилей проводит анализ спроса на различные модели автомобилей некоторой марки в зависимости от их цены. Ниже приводятся данные о ценах и среднемесячных объемах продаж 12 моделей автомобилей данной марки: Модель Цена, тыс. у. е. Количество проданных автомобилей в среднем за месяц, шт. 1 2 3 4 5 6 7 8 9 10 11 12 25 28 29 27 29 28 29 24 25 23 25 28 55 48 40 42 27 35 28 58 54 52 55 48 Определите параметры уравнения линейной регрессии и дайте интерпретацию коэффициента регрессии b . Решение. Найдем параметры уравнения линейной регрессии по формулам (3). Промежуточные результаты представим в табл. 2: Таблица 2 № х y хy х2 1 55 25 1375 3025 2 48 28 1344 2304 3 40 29 1160 1600 4 42 27 1134 1764 5 27 29 783 729 6 35 28 980 1225 7 28 29 812 784 8 58 24 1392 3364 9 54 25 1350 2916 10 52 23 1196 2704 11 55 25 1375 3025 12 48 28 1344 2304 542 320 14245 25744 1 542 320 1 12 0,17 , a 320 0,165 542 34,11 , то уравТак как b 1 12 25744 5422 12 нение линейной регрессии имеет вид y 34,11 0,17 x . 14245 93 Так как b 0,17 , то при увеличении на одну единицу количества машин цена уменьшается на 0,17 тыс. у. е. Пример 3. Для нескольких предприятий решено исследовать наличие зависимости объемов недельных продаж продукции в тыс. у. е. от затрат на рекламу в тыс. у. е. № Затраты на рекламу, тыс. у. е. Объем продаж, тыс. у. е. 1 2 3 4 5 6 7 8 9 10 8 11 9 8 6 12 15 7 6 13 77 81 83 81 73 85 87 70 67 95 Построить поле корреляции. Найти выборочный коэффициент корреляции и параметры уравнения парной линейной регрессии. Построить уравнение парной линейной регрессии. Решение. По исходным данным построим поле корреляции, характеризующее зависимость объема продаж от затрат на рекламу (рис. 2). y 96 93 90 87 84 81 78 75 72 69 66 63 60 0 6 7 8 9 10 11 12 13 14 Рисунок 2. Поле корреляции 94 15 16 17 18 x Определим выборочный коэффициент корреляции по формуле: x n r x n i 1 i x i i 1 x 2 y y i y n i 1 i y . 2 Промежуточные результаты вычислений представим в сводной табл. 3. Таблица 3 x x y y yi y y y 2,25 -2,9 8,41 4,35 1,5 2,25 1,1 1,21 1,65 83 -0,5 0,25 3,1 9,61 -1,55 8 81 -1,5 2,25 1,1 1,21 -1,65 5 6 73 -3,5 12,25 -6,9 47,61 24,15 6 12 85 2,5 6,25 5,1 26,01 12,75 7 15 87 5,5 30,25 7,1 50,41 39,05 8 7 70 -2,5 6,25 -9,9 98,01 24,75 9 6 67 -3,5 12,25 -12,9 166,41 45,15 10 13 95 3,5 12,25 15,1 228,01 52,85 95 799 636,9 201,5 № xi yi xi x x x 1 8 77 -1,5 2 11 81 3 9 4 2 i 86,5 2 i i i Средние затраты на рекламу по 10 предприятиям составляют x 95 9,5 10 799 79,9 тыс. у. е. в год. 10 201,5 0,86 , следоВыборочный коэффициент корреляции равен r 86,5 636,9 тыс. у. е., средний объем продаж – x вательно связь между затратами на рекламу и объемом продаж сильная. Уравнение регрессии будем искать в виде y a bx . Параметры уравнения парной линейной регрессии определим по формулам (3), промежуточные результаты представим в табл. 4. Таблица 4 № 1 2 3 4 5 x 8 11 9 8 6 y 77 81 83 81 73 95 xy 616 891 747 648 438 2 x 64 121 81 64 36 № 6 7 8 9 10 y 85 87 70 67 95 799 x 12 15 7 6 13 95 xy 1020 1305 490 402 1235 7792 x2 144 225 49 36 169 989 1 95 799 1 10 Так как b 2,33 , a 799 2,33 95 57, 77 , то уравнение 1 10 989 952 10 парной линейной регрессии имеет вид y 57,77 2,33x . По величине коэффициен7792 та регрессии сделаем вывод: с увеличением расходов на рекламу на 1 тыс. у. е. объем продаж увеличивается на 2,33 тыс. у. е. Качество уравнения регрессии можно оценить с помощью средней ошибки аппроксимации, которая определяется по формуле: A 1 y y 100 % . n y (4) Качество уравнения регрессии считается хорошим, если ошибка аппроксимации не превышает 5–8%. Пример 4. Оценить качество уравнения регрессии, полученного в примере 3, вычислив среднюю ошибку аппроксимации уравнения. Решение. Для полученного уравнения регрессии по формуле (4) вычислим среднюю ошибку аппроксимации. Промежуточные результаты представим в сводной табл. 5. Таблица 5 № x y y y y 1 2 3 4 5 6 7 8 9 10 8 11 9 8 6 12 15 7 6 13 95 77 81 83 81 73 85 87 70 67 95 799 76,4 83,4 78,7 76,4 71,7 85,7 92,7 74,1 71,7 88,1 798,9 0,6 –2,4 4,3 4,6 1,3 –0,7 –5,7 –4,1 –4,7 6,9 – 96 y y y 0,0077 –0,0296 0,0514 0,0567 0,0172 –0,0085 –0,0657 –0,0582 –0,0708 0,0731 – y y y y y 100 % y 0,0077 0,0296 0,0514 0,0567 0,0172 0,0085 0,0657 0,0582 0,0708 0,0731 – 0,77 2,96 5,14 5,67 1,72 0,85 6,57 5,82 7,08 7,31 43,89 Средняя ошибка аппроксимации равна A 43,89 4,39 % . Так как средняя 10 ошибка аппроксимации не превышает 5–8%, то можно утверждать, что полученное уравнение парной линейной регрессии хорошо описывает исходные статистические данные. Нелинейные функции регрессии Анализ графического изображения наблюдений и знание природы изучаемого процесса может привести к нелинейной относительно переменной x функции регрессии. Многие парные нелинейные уравнения регрессии можно свести к парным линейным, путем соответствующих преобразований переменных и параметров исходных уравнений регрессии. Рассмотрим уравнение парной регрессии в виде степенной функции y axb . Для оценки параметров линеаризуем модель путем логарифмирования: ln y ln axb , ln y ln a ln xb , ln y ln a b ln x . Обозначим y ln y , a ln a , x ln x . Тогда получим линейное уравнение y a bx . Полученное уравнение является уравнением парной линейной регрессии, параметры которого определяются по формулам (3). В табл. 6 приводятся примеры наиболее часто встречающихся при составлении уравнения регрессии нелинейных функций. Таблица 6 № Выражения для величин a и b a b Преобразования переменных Функция y x 1 y axb ln y ln x ln a b 2 y aebx ln y x ln a b 3 y ab x ln y ln a ln b 4 y a x 1 x a b x a b 5 b x 1 y a bx y 1 y Пример 5. Имеются статистические данные о годовой цене программы «Мастер делового администрирования» и числе слушателей в образовательном учреждении. y x 1 8 5 2 5 10 3 4,9 12 4 4 15 5 3,8 20 6 3,5 22 7 3,8 25 8 3,7 30 9 3,6 35 10 3,5 36 11 3,4 40 12 3 50 13 3 60 Задание: 1. Рассчитайте параметры уравнений линейной, степенной, экспоненциальной и обратной парной регрессий. 97 2. Оцените качество уравнений с помощью средней ошибки аппроксимации. 3. Рассчитайте прогнозируемое значение результата по уравнению регрессии, если прогнозируется увеличение значения фактора на 10% от его среднего уровня. Решение. Уравнение парной линейной регрессии будем искать в виде y a bx . Параметры уравнения парной линейной регрессии определим по формулам (3). Промежуточные результаты вычислений представим в табл. 7. Таблица 7 № 1 2 3 4 5 6 7 8 9 10 11 12 13 y 8,0 5,0 4,9 4,0 3,8 3,5 3,8 3,7 3,6 3,5 3,4 3,0 3,0 53,2 x 5 10 12 15 20 22 25 30 35 36 40 50 60 360 xy 40,0 50,0 58,8 60,0 76,0 77,0 95,0 111,0 126,0 126,0 136,0 150,0 180,0 1285,8 x2 25 100 144 225 400 484 625 900 1225 1296 1600 2500 3600 13124 1 360 53, 2 1 13 0, 06 , a 53, 2 0,06 360 5,74 , то уравТак как b 1 13 13124, 0 3602 13 нение линейной регрессии имеет вид y 5,74 0,06 x . 1285,8 Определим среднюю ошибку аппроксимации для линейного уравнения регрессии. Промежуточные результаты представим в табл. 8. Таблица 8 № x y y y y 1 2 3 4 5 6 7 8 9 5 10 12 15 20 22 25 30 35 8,0 5,0 4,9 4,0 3,8 3,5 3,8 3,7 3,6 5,44 5,14 5,02 4,85 4,55 4,43 4,25 3,96 3,66 2,56 -0,14 -0,12 -0,85 -0,75 -0,93 -0,45 -0,26 -0,06 98 y y y 0,3199 0,0287 0,0254 0,2116 0,1972 0,2659 0,1190 0,0690 0,0162 y y y 31,99 2,87 2,54 21,16 19,72 26,59 11,90 6,90 1,62 № x y y y y 10 11 12 13 36 40 50 60 3,5 3,4 3,0 3,0 3,60 3,36 2,77 2,17 -0,10 0,04 0,23 0,83 Средняя ошибка аппроксимации равна A y y y 0,0282 0,0114 0,0777 0,2757 y y y 2,82 1,14 7,77 27,57 164,59 164,59 12, 66% . Ошибка аппрок13 симации выше 8%, поэтому полученное уравнение плохо описывает исходные данные. Уравнение регрессии в виде степенной функции будем искать в виде y аxb . Для оценки параметров данной модели сведем ее к линейной y a bx . Параметры уравнения y a bx определим по формулам (3), промежуточные результаты представим в табл. 9. № 1 2 3 4 5 6 7 8 9 10 11 12 13 x 5 10 12 15 20 22 25 30 35 36 40 50 60 y 8,0 5,0 4,9 4,0 3,8 3,5 3,8 3,7 3,6 3,5 3,4 3,0 3,0 y ln y 2,08 1,61 1,59 1,39 1,34 1,25 1,34 1,31 1,28 1,25 1,22 1,10 1,10 17,85 x ln x 1,61 2,30 2,48 2,71 3,00 3,09 3,22 3,40 3,56 3,58 3,69 3,91 4,09 40,65 xy 3,35 3,71 3,95 3,75 4,00 3,87 4,30 4,45 4,55 4,49 4,51 4,30 4,50 53,73 Таблица 9 x2 2,59 5,30 6,17 7,33 8,97 9,55 10,36 11,57 12,64 12,84 13,61 15,30 16,76 133,02 1 40, 65 17,85 1 13 0,35 , a 17,85 0,35 40,65 2, 47 , то Так как b 1 13 133, 02 40, 652 13 y 2, 47 0,35x или ln y 2, 47 0,35ln x . Потенцируя обе части уравнения, полу53, 73 чим y e2,470,35ln x , y e2,47e 0,35 ln x , y e2,47 x 0,35 , y 11,83x 0,35 . Определим среднюю ошибку аппроксимации для степенной модели, промежуточные результаты представим в табл. 10. 99 Таблица 10 № x y y y y 1 2 3 4 5 6 7 8 9 10 11 12 13 5 10 12 15 20 22 25 30 35 36 40 50 60 8,0 5,0 4,9 4,0 3,8 3,5 3,8 3,7 3,6 3,5 3,4 3,0 3,0 6,72 5,27 4,94 4,57 4,13 4,00 3,82 3,58 3,40 3,36 3,24 3,00 2,81 1,28 -0,27 -0,04 -0,57 -0,33 -0,50 -0,02 0,12 0,20 0,14 0,16 0,00 0,19 Средняя ошибка аппроксимации равна A y y y 0,1595 0,0543 0,0091 0,1431 0,0877 0,1420 0,0057 0,0311 0,0567 0,0393 0,0469 0,0012 0,0631 y y y 15,95 5,43 0,91 14,31 8,77 14,20 0,57 3,11 5,67 3,93 4,69 0,12 6,31 83,98 83,98 6, 46% . Ошибка аппрок13 симации свидетельствует о хорошем подборе уравнения регрессии по исходным данным. Рассчитаем прогнозируемое значение результата по степенному уравнению регрессии. Прогнозируется увеличение значения фактора на 10% от его среднего уровня, т. е. следовательно, xпрогн. 1,1 27,69 30, 46, yпрогн. 11,83 30, 460,35 3,6 . ТЕМА № 8. ОСНОВЫ ТЕОРИИ СТАТИСТИЧЕСКИХ РЕШЕНИЙ Лекция 8.1. Проверка статистических гипотез На практике часто возникают задачи сравнения различных технологических процессов по их производительности, точности или экономичности характеристик каких-либо приборов или изделий. Аналогичные проблемы характерны и для социологической, медицинской или экономической статистики при оценке эффективности лекарственного средства или вносимого удобрения, уровня доходности ценных бумаг и т. д. На математическом языке задачи сравнения формулируются как задачи статистической проверки гипотез относительно параметров распределений, так как именно их изменения характеризуют различия в эффективности обучения или различия технологических процессов, приборов и конструкций. 100 Основные понятия теории проверки статистических гипотез Под статистической гипотезой понимают некоторое предположение о генеральной совокупности, проверяемое по выборочным данным, т. е. по результатам наблюдений. Проверка статистических гипотез используется всякий раз, когда необходим обоснованный вывод о преимуществах того или иного технологического процесса, способа инвестиций, приема измерений, об эффективности нового метода обучения, управления, о пользе лекарственного средства и т. д. Статистические гипотезы разделяют на гипотезы о законах распределения и гипотезы о параметрах распределения. Статистическая гипотеза называется параметрической, если в ней сформулированы предположения относительно значений параметров функции распределения известного вида. Так, например, гипотеза о том, что средние размеры деталей, изготавливаемых на однотипных станках, не различаются между собой, является гипотезой о параметрах распределения. Статистическая гипотеза называется непараметрической, если в ней сформулированы предположения относительно вида функции распределения. Гипотеза о том, что производительность труда рабочих, выполняющих одинаковую работу в одинаковых организационно-технических условиях, имеет нормальный закон распределения, является гипотезой о законе распределения (непараметрической гипотезой). Наряду с выдвинутой гипотезой рассматривают и противоречащую ей гипотезу. Если выдвинутая гипотеза будет отвергнута, то имеет место противоречащая гипотеза. По этой причине эти гипотезы целесообразно различать. Нулевой гипотезой называют основную (выдвинутую) гипотезу и обозначают H 0 . Обычно нулевые гипотезы утверждают, что различие между сравниваемыми величинами (параметрами или функциями распределения) отсутствует, а наблюдаемые отклонения объясняются лишь случайными колебаниями выборки. Альтернативной (конкурирующей) называют гипотезу H1 , которая противоречит нулевой гипотезе, так как является ее логическим отрицанием. Например, если нулевая гипотеза состоит в предположении, что математическое ожидание a нормального распределения равно 10, то конкурирующая гипотеза, в частности, может состоять в предположении, что a 10 . Коротко это записывают так: H 0 : a 10 , H1 : a 10 . Различают гипотезы, которые содержат только одно и более одного предположений. Простой называют гипотезу, содержащую только одно предположение. Например, если – параметр показательного распределения, то гипотеза H 0 : 5 – простая. Сложной называют гипотезу, которая состоит из конечного или бесконечного числа простых гипотез. 101 Например, сложная гипотеза H 0 : 5 состоит из бесчисленного множества простых гипотез вида Hi : bi , где bi – любое число, большее 5. Простая гипотеза, в отличие от сложной, полностью определяет теоретическую функцию распределения случайной величины. Выдвинутая гипотеза может быть правильной или неправильной, поэтому возникает необходимость ее проверки. Поскольку проверку производят статистическими методами, ее называют статистической. В итоге статистической проверки гипотезы в двух случаях может быть принято неправильное решение, т. е. могут быть допущены ошибки двух родов. Ошибка первого рода состоит в том, что будет отвергнута правильная гипотеза. Ошибка второго рода заключается в том, что будет принята неправильная гипотеза. Заметим, что правильное решение также может быть принято в двух случаях: 1) гипотеза принимается, причем и в действительности она правильная; 2) гипотеза отвергается, причем и в действительности она неверна. Вероятность допустить ошибку 1-го рода, т. е. отвергнуть гипотезу H 0 , когда она верна, обозначается через и называется уровнем значимости критерия. Наиболее часто уровень значимости принимают равным 0,05 или 0,01. Если, например, принят уровень значимости, равный 0,05, то это означает, что в пяти случаях из ста имеется риск допустить ошибку первого рода (отвергнуть правильную гипотезу). Вероятность допустить ошибку 2-го рода, т. е. принять гипотезу H 0 , когда она неверна, обозначают . Вероятность P H1 | H1 1 не допустить ошибку 2-го рода, т. е. отвергнуть гипотезу H 0 , когда она неверна, называется мощностью критерия. Возникающие при проверке статистической гипотезы случаи наглядно иллюстрирует табл. 1. Таблица 1 Гипотеза H 0 ВЕРНА НЕВЕРНА ПРИНИМАЕТСЯ ОТВЕРГАЕТСЯ Правильное решение, его ве- Ошибка первого рода, её вероятность P H 0 | H 0 1 . роятность P H1 | H 0 . Ошибка второго рода, её ве- Правильное решение, его вероятность P H 0 | H1 . роятность P H1 | H1 1 . Подчеркнем, что последствия ошибочных статистических решений могут оказаться весьма различными. Например, если отвергнуто правильное решение «продолжать строительство жилого дома», то эта ошибка первого рода повлечет материальный ущерб. Если же принято неправильное решение «продолжать строительство», несмотря на опасность обвала сооружения, то эта ошибка второго рода может повлечь гибель людей. Можно привести примеры, когда ошибка первого рода влечет более тяжелые последствия, чем ошибка второго рода. 102 Соотношение между ошибками первого и второго рода определяется дозволенной степенью риска, которая связана с пренебрежением событиями с малой вероятностью. Эта степень риска зависит от различного рода обстоятельств и, прежде всего, связана с практической важностью последствий, вытекающих из наступления этих ошибок. Например, изготовление на станке-автомате некачественного болта с вероятностью 0,05 вполне может устроить производителя, однако изготовление некачественного парашюта даже с вероятностью 0,01 нельзя считать допустимым. Поскольку последствия статистических ошибок могут быть различными по значимости, в одних случаях стремятся минимизировать значение α, а в других β. Применительно к производству или торговле, например, вероятность α – это риск поставщика, связанный с забраковкой по малой выборке всей партии продукции, удовлетворяющей стандарту. Вероятность β – это риск потребителя, связанный с приемом по выборке всей партии товара, не удовлетворяющей стандарту. Применительно к судебной практике: ошибка первого рода приводит к оправданию виновного, а ошибка второго рода – к осуждению невиновного. В ряде прикладных исследований ошибка первого рода означает вероятность того, что предназначавшийся наблюдателю сигнал не будет им принят, а ошибка второго рода отражает вероятность того, что наблюдатель примет ложный сигнал. Исходя из последствий ошибок, принимают некоторое компромиссное решение относительно выбора величины их вероятностей. Очевидно, что одновременное уменьшение ошибок 1-го и 2-го рода возможно лишь при увеличении объема выборки. Поэтому обычно при заданном уровне значимости α отыскивается критерий с наибольшей мощностью. Основные этапы проверки гипотезы Для проверки нулевой гипотезы используют специально подобранную случайную величину, точное или приближенное распределение которой известно. Эту величину обозначают через U или Z , если она распределена нормально, F или v 2 – по закону Фишера–Снедекора, T – по закону Стьюдента, 2 – по закону «хи-квадрат» и т. д. Далее при рассмотрении основных понятий в целях общности построения теории статистических решений эту величину будем обозначать через K . Статистическим критерием называют случайную величину K , которая служит для проверки нулевой гипотезы. Например, если проверяют гипотезу о равенстве дисперсий двух нормальных генеральных совокупностей, то в качестве критерия K принимают отношение исправленных выборочных дисперсий: F s12 . s22 Эта величина случайная, потому что в различных испытаниях дисперсии принимают различные, наперед неизвестные значения, и распределена по закону Фишера–Снедекора. 103 Для проверки гипотезы по данным выборок вычисляют частные значения входящих в критерий величин и, таким образом, получают частное (наблюдаемое) значение критерия. Наблюдаемым значением называют значение критерия K набл. , вычисленное по выборкам. Например, если по двум выборкам найдены исправленные выборочные дисперсии s12 20 , s22 5 , то наблюдаемое значение критерия F вычисляется так: Fнабл. 20 4. 5 После выбора определенного критерия множество всех его возможных значений разбивают на два непересекающихся подмножества: одно из них содержит только те значения критерия, при которых H 0 отвергается, а другое – при которых H 0 принимается. Критической областью V1 называется совокупность значений критерия, при которых нулевая гипотеза отвергается. Областью допустимых значений V0 (областью принятия гипотезы) называется совокупность значений критерия, при которых нулевая гипотеза принимается. Основной принцип проверки статистических гипотез можно сформулировать так: если наблюдаемое значение критерия принадлежит критической области, то H 0 отвергается, если наблюдаемое значение критерия принадлежит области допустимых значений, то H 0 принимается. Поскольку критерий K представляет собой одномерную случайную величину, то все его возможные значения принадлежат некоторому интервалу. Поэтому критическая область и область принятия гипотезы также являются интервалами и, следовательно, существуют точки, которые их разделяют. Критическими точками (границами) называют точки kкр. , отделяющие критическую область от области принятия гипотезы. Различают одностороннюю (правостороннюю или левостороннюю) и двустороннюю критические области. Различают одностороннюю (правостороннюю или левостороннюю) и двустороннюю критические области. Правосторонней называют критическую область, определяемую неравенством K kкр. , где kкр. – положительное число (рис. 1, а). Левосторонней называют критическую область, определяемую неравенством K kкр. , где kкр. – отрицательное число (рис. 1, б). Односторонними называют правостороннюю или левостороннюю критические области. Двусторонней называют критическую область, определяемую неравенствами K k1 , K k2 , где k2 k1 . В частности, если критические точки симметричны относительно нуля, двусторонняя критическая область определяется неравенствами (в предположении, что kкр. 0 ); K kкр. , K kкр. , или равносильным неравенством K kкр. (рис. 1, в). 104 а) kкр. 0 K 0 K б) kкр. в) kкр. kкр. 0 K Рисунок 1 Обоснование ответа на вопрос о нахождении критической области требует привлечения довольно сложной теории. Ограничимся ее основными положениями. Для определенности начнем с нахождения правосторонней критической области, которая определяется неравенством K kкр. , где kкр. 0 . Очевидно, что для отыскания правосторонней критической области достаточно найти критическую точку. Поэтому проблема сводится к нахождению соответствующей критической точки. Для ее нахождения задается достаточно малая вероятность – уровень значимости . Затем определяется критическая точка kкр. , исходя из требования, чтобы при условии справедливости H 0 вероятность того, что критерий K примет значение, большее kкр. , была равна принятому уровню значимости: P K kкр. . Для каждого критерия имеются соответствующие таблицы, по которым и находят критическую точку, удовлетворяющую этому требованию. После нахождения критической точки по выборочным данным вычисляют наблюдаемое значение критерия. Если окажется, что Kнабл. kкр. , то нулевую гипотезу отвергают; если же Kнаб . kкр. , то нет оснований, чтобы отвергнуть нулевую гипотезу. Отыскание левосторонней и двусторонней критических областей сводится (так же, как и для правосторонней) к нахождению соответствующих критических точек. Левосторонняя критическая область определяется неравенством K kкр. , kкр. 0 . Критическую точку находят исходя из требования, чтобы при справедливости нулевой гипотезы вероятность того, что критерий примет значение, меньшее kкр. , была равна принятому уровню значимости: P K kкр. . Двусторонняя критическая область определяется неравенствами K k1 , K k2 . Критические точки находят исходя из требования, чтобы при справедливости нулевой гипотезы сумма вероятностей того, что критерий примет зна105 чение, меньшее k1 или большее k2 , была равна принятому уровню значимости: P K k1 P K k2 . Очевидно, что критические точки могут быть выбраны бесчисленным множеством способов. Если же распределение критерия симметрично относительно нуля и имеются основания выбрать симметричные относительно нуля точки и то Учитывая kкр. , kкр. kкр. 0 , P K kкр. P K kкр. . P K k1 P K k2 , получим P K kкр. 2 . Это соотношение используется для нахождения критических точек двусторонней критической области. Проверка статистических гипотез основана на реализации следующих последовательных этапов: 1. Формулируется нулевая H 0 и, при необходимости, альтернативная H1 гипотезы. 2. Выбирается уровень значимости . 3. Выбирается статистический критерий значимости K . 4. По данным выборки рассчитываются наблюдаемое значение критерия K набл. . 5. Определяются критические точки kкр. и критическая область V1 . 6. На основе сопоставления значения выборочной статистики K набл. и критической области V1 принимается статистическое решение. Проверка гипотез о числовых значениях параметров нормального распределения Рассмотрим возможности применения теории статистических решений на примере проверки гипотез о числовых значениях параметров нормального распределения. Сравнение выборочной средней с гипотетической генеральной средней нормальной совокупности Для того чтобы при заданном уровне значимости проверить нулевую гипотезу H 0 : a a0 о равенстве генеральной средней a нормальной совокупности с известной дисперсией Г2 гипотетическому (предполагаемому) значению a0 , необходимо вычислить наблюдаемое значение критерия по формуле U набл. x a 0 Г n . Определение критических точек зависит от вида конкурирующей гипотезы: 1. H1 : a a0 . По таблице функции Лапласа определяются критические точ1 ки uдв.кр. двусторонней критической области на основе равенства Ф uкр. . 2 106 2. H1 : a a0 . По таблице функции Лапласа определяется критическая точка uпр.кр. правосторонней критической области из равенства Ф uкр. 0,5 . 3. H1 : a a0 . По таблице функции Лапласа определяется вспомогательная критическая точка uкр. из равенства Ф uкр. 0,5 , а затем находится граница левосторонней критической области uл.кр. uпр.кр. . Пример 1. Из нормальной генеральной совокупности с известным средним квадратическим отклонением Г 5, 2 извлечена выборка объема n 100 и по ней найдена выборочная средняя x 27,56 . Требуется при уровне значимости 0,05 проверить нулевую гипотезу H 0 : a 26 при конкурирующей гипотезе H1 : a 26 . Решение. 1. H 0 : a 26 , H1 : a 26 . 2. 0, 05 . 3. Статистический критерий U . 4. U наб 27,56 26 100 5, 2 3. 5. Для данной альтернативной гипотезы критическая область – двусторонняя. Найдем критическую точку из равенства Ф uкр. 1 1 0, 05 0, 475 . По 2 2 таблице функции Лапласа находим uкр. 1,96 . V1 V0 –1,96 V1 1,96 3 6. Нулевая гипотеза отвергается, так как наблюдаемое значение критерия находится в критической области. Для того чтобы при заданном уровне значимости проверить нулевую гипотезу H 0 : a a0 о равенстве неизвестной генеральной средней a (нормальной совокупности с неизвестной дисперсией Г2 ) гипотетическому (предполагаемому) значению a0 , необходимо вычислить наблюдаемое значение критерия Tнабл. x a 0 s n . Определение критических точек зависит от вида конкурирую- щей гипотезы: H1 : a a0 . По таблице критических точек распределения Стьюдента, 1. по заданному уровню значимости и числу степеней свободы k n 1 определяются критические точки двусторонней критической области: tпр.кр. ; k и t л.кр. tпр.кр. . 107 2. H1 : a a0 . По таблице критических точек распределения Стьюдента, по заданному уровню значимости и числу степеней свободы k n 1 определяется критическая точка правосторонней критической области tпр.кр. ; k . 3. H1 : a a0 . По таблице критических точек распределения Стьюдента, по заданному уровню значимости и числу степеней свободы k n 1 определяется вспомогательная критическая точка tпр.кр. ; k , а затем находится граница левосторонней критической области t л.кр. tпр.кр. ; k . Пример 2. По выборке объема n 16 , извлеченной из нормальной генеральной совокупности, найдены выборочная средняя x 118, 2 и «исправленное» среднее квадратическое отклонение s 3, 6 . Требуется при уровне значимости 0,01 проверить нулевую гипотезу H 0 : a 120 при конкурирующей гипотезе H1 : a 120 . Решение. 1. H 0 : a 120 , H1 : a 120 . 2. 0, 05 . 3. Статистический критерий T . 4. Tнабл. 118, 2 120 16 3, 6 2 . 5. Для данной альтернативной гипотезы критическая область – левосторонняя. По таблице критических точек распределения Стьюдента, по заданному уровню значимости 0,01 и числу степеней свободы k 16 1 15 найдем критическую точку t л.кр 1,75 . V1 –2 V0 –1,75 6. Нулевая гипотеза отвергается, так как наблюдаемое значение критерия находится в критической области. Сравнение исправленной выборочной дисперсии с гипотетической генеральной дисперсией нормальной совокупности Для того чтобы при заданном уровне значимости проверить нулевую гипотезу H 0 : Г2 02 о равенстве неизвестной генеральной дисперсии Г2 гипотетическому (предполагаемому) значению 02 , необходимо вычислить наблюдаn 1 s 2 емое значение критерия . Определение критических точек зависит 2 2 наб 0 от вида конкурирующей гипотезы: 108 1. H1 : Г2 значимости и пр2 .кр. ; k . 2. H1 : Г2 значимости и 02 . По таблице критических точек 2 , по заданному уровню числу степеней свободы k n 1 найти критическую точку 02 . По таблице критических точек 2 , по заданному уровню числу степеней свободы k n 1 найти критические точки 2 ; k , пр ;k . .кр . 2 2 3. H1 : Г2 02 , по таблице критических точек 2 , по заданному уровню л2.кр. 1 значимости и числу степеней свободы k n 1 найти критическую точку л2.кр. 1 ; k . Пример 3. Из нормальной генеральной совокупности извлечена выборка объема n 21 и по ней найдена исправленная выборочная дисперсия s 2 16, 2 . Требуется при уровне значимости 0,01 проверить нулевую гипотезу H 0 : Г2 15 , приняв в качестве конкурирующей гипотезы H1 : Г2 15 . Решение. 1. H 0 : Г2 15 , H1 : Г2 15 2. 0,01 . 3. Статистический критерий 2 . 4. 2 набл . 21 1 16, 2 21, 6 . 15 5. Для данной альтернативной гипотезы критическая область – правосторонняя. По таблице критических точек 2 , по заданному уровню значимости 0,01 и числу степеней свободы k 21 1 20 найти критическую точку пр2 .кр. 0,01;20 37,6 . V0 21,6 V1 37,6 6. Нулевая гипотеза не отвергается, так как наблюдаемое значение критерия находится в области принятия гипотезы. Пример 4. Установлено, что средний вес капсулы лекарственного средства сильного действия должен быть равен a0 0,50 мг. Выборочная проверка 121 капсулы полученной партии лекарства показала, что средний вес капсулы этой партии x 0,53 мг. Требуется при уровне значимости 0,01 проверить нулевую гипотезу H 0 : a 0,50 при конкурирующей гипотезе H1 : a 0,50 . Многократными предварительными опытами по взвешиванию капсул, поставляемых фармацевтическим заводом, было установлено, что их вес распределен нормально, со средним квадратическим отклонением Г 0,11 мг. 109 Решение. 1. H 0 : a 0,50 , H1 : a 0,50 . 2. 0, 01 . 3. Статистический критерий U . 4. U наб 0,53 0,50 0,11 121 3. 5. Для данной альтернативной гипотезы критическая область – правосторонняя. Определим критическую точку из равенства Ф uкр 1 2 0, 01 0, 49 . 2 По таблице функции Лапласа находим uкр 2,34 . V0 V1 2,34 3 6. Нулевая гипотеза отвергается, так как наблюдаемое значение критерия находится в критической области. Средний вес капсулы значимо отличается от допустимого. Пример 5. При уровне значимости 0,05 проверить, обеспечивает ли станок требуемую точность, если точность его работы проверяется по дисперсии контролируемого размера изделий, которая не должна превышать 02 0,1 . В таблице представлены результаты измерений 25 случайно отобранных изделий: xi 3,0 3,5 3,8 4,4 4,5 ni 2 6 9 7 1 Решение. Сначала вычислим средний размер контролируемого размера изделий: x 96,5 3,86 . 25 Вычислим исправленную x x k n s D n 1 2 i 1 2 i n 1 выборочную дисперсию по формуле ni . Для удобства и упрощения вычислений все расчеты сведем в таблицу. xi ni xi ni xi x x x 3,0 3,5 3,8 4,4 4,5 2 6 9 7 1 25 6,0 21,0 34,2 30,8 4,5 96,5 -0,86 -0,36 -0,06 0,54 0,64 0,7396 0,1296 0,0036 0,2916 0,4096 110 2 i x x 2 i 1,4792 0,7776 0,0324 2,0412 0,4096 4,74 ni Исправленная дисперсия равна s 2 4, 74 0, 20 . 24 При уровне значимости 0,05 проверим, обеспечивает ли станок требуемую точность. Для этого реализуем этапы проверки статистической гипотезы, рассмотрев в качестве нулевой гипотезы предположение о том, что станок обеспечивает требуемую точность. По смыслу задачи конкурирующая гипотеза будет состоять в предположении: дисперсия контролируемого размера изделий превышает предельное значение 02 0,1 . 1. H 0 : Г2 0,1, H1 : Г2 0,1 . 2. 0,05 . 3. Статистический критерий 2 . 2 4. набл . 25 1 0, 2 48 . 0,1 5. Для данной альтернативной гипотезы критическая область – правосторонняя. По таблице критических точек 2 , по заданному уровню значимости 0, 05 и числу степеней свободы k 25 1 24 находим критическую точку пр2 .кр. 0,05;24 36, 4 . V0 V1 36,4 48 6. Нулевая гипотеза отвергается. Станок не обеспечивает необходимую точность и требует наладки. Лекция 8.2. Проверка непараметрических гипотез Проверка гипотезы о модели закона распределения Одной из важнейших задач математической статистики является установление теоретического закона распределения случайной величины, характеризующей изучаемый признак по опытному (эмпирическому) распределению. Для решения этой задачи необходимо определить вид и параметры закона распределения. Предположение о виде закона распределения может быть выдвинуто исходя из теоретических предпосылок, опыта аналогичных предшествующих исследований, а также на основании графического изображения эмпирического распределения. Как бы хорошо не был подобран теоретический закон распределения, между эмпирическим и теоретическим распределениями неизбежны расхождения. Естественно, возникает вопрос: объясняются ли эти расхождения только случайными обстоятельствами, связанными с ограниченным числом наблюдений, или они являются существенными и связаны с тем, что теоретический закон распределения подобран неудачно. Для ответа на этот вопрос и служат критерии согласия. 111 Пусть требуется проверить гипотезу H 0 о том, что случайная величина X подчиняется некоторому закону распределения F x (нормальному, биномиальному, показательному и т. д.). Для проверки гипотезы произведем выборку, состоящую из n независимых наблюдений над случайной величиной X . По выборке можно построить эмпирическое распределение F * x исследуемой случайной величины. Сравнение эмпирического F * x и теоретического распределений производится с помощью специально подобранной случайной величины – критерия согласия. Проверка непараметрических гипотез производится на основании вычисления некоторой выборочной статистики (критерия), распределение которой получено в предположении истинности нулевой гипотезы и сравнения наблюдаемого значения этой выборочной статистики с критическим значением. В математической статистике практически применяются различные критерии согласия: 2 Пирсона, Колмогорова, Смирнова и др. 28.2.2. Критерий согласия Пирсона Рассмотрим критерий согласия 2 Пирсона, который является наиболее часто используемым критерием для проверки непараметрических гипотез о законе распределения. Разобьем всю область изменения случайной величины X на k интервалов 1 , 2 , …, k и подсчитаем количество пi вариантов, попавших в каждый из интервалов i . На основании гипотетической (предполагаемой) функции распределения F x вычисляют вероятности попадания случайной величины X в частные интервалы i : pi P xi 1 X xi , i 1, 2,..., k . Умножая полученные вероятности pi на объем выборки n , получают теоретические частоты npi частичных интервалов i , т. е. частоты, которые следует ожидать, если нулевая гипотеза справедлива. Результаты проведенных расчетов объединим в табл. 1. Таблица 1 Интервалы i 1 2 … i … k Эмпирические частоты ni n1 n2 … ni … nk Теоретические частоты ni np1 np2 … npi … npk 112 Если эмпирические частоты сильно отличаются от теоретических, то проверяемую гипотезу H 0 следует отвергнуть. Если отклонения незначимые, то они объясняются недостаточным объемом выборки или случайностью ее состава. В литературе по математической статистике доказывается, что если нулевая гипотеза верна, то при n распределение выборочной статистики: n n i i , 2 k 2 i 1 ni независимо от вида функции F x стремится к распределению «хиквадрат» с числом степеней свободы v k s 1 , где k – число интервалов, s – число параметров гипотетической функции F x , оцениваемых по выборочным данным. Критерий 2 сконструирован так, что чем ближе к нулю наблюдаемое зна- n n чение критерия, вычисленное по формуле i i , тем вероятнее, что 2 k 2 i 1 ni нулевая гипотеза справедлива. Поэтому для проверки нулевой гипотезы применяется критерий 2 с правосторонней критической областью. С помощью таблиц 2 – распределения по заданному уровню значимости и числу степеней свободы v k s 1 находят критическое значение 2 ;v , удовлетворяющее условию: P 2 2 ;v . В результате сравнения наблюдаемого значения выборочной статистики 2 2 ;v принимается статистическое решение: наб . с критическим значением 2 2 1) если набл . ; v , то нулевая гипотеза отвергается, так как считается, что гипотетическая функция не согласуется с результатами эксперимента; 2 2 2) если набл . ; v , то считается, что нет оснований для отклонения нулевой гипотезы, т. е. гипотетическая функция согласуется с результатами эксперимента. Сущность критерия согласия Пирсона состоит в сравнении эмпирических и теоретических частот. Эмпирические частоты находятся на основе выборочных данных. При определении теоретических частот предполагается, что генеральная совокупность распределена нормально. Рассмотрим один из способов нахождения теоретических частот, в соответствии с которым нужно: 1. Нормировать случайную величину X , что означает переход к случайной величине вида U X x . Для этого вычисляют концы интервалов по фор- 113 мулам: ui xi x xi 1 x , причем наименьшее значение U , т. е. u1 , полага ют равным , а наибольшее значение, т. е. us 1 , полагают равным . , ui 1 2. Вычислить теоретические частоты niтеор. nPi , где Pi Ф ui 1 Ф ui – вероятности попадания X в интервалы xi ; xi 1 , Ф U – функция Лапласа. Пример 1. Используя критерий Пирсона, при уровне значимости 0,01 установить, случайно или значимо расхождение между эмпирическими частотами пi и теоретическими частотами niтеор. , которые вычислены, исходя из гипотезы о нормальном распределении признака X в генеральной совокупности: ni 8 16 40 72 36 18 10 теор . i 6 18 36 76 39 18 7 n Решение. Сравним эмпирические и теоретические частоты, используя критерий согласия Пирсона. 1. H 0 : признак X распределен нормально. 2. Уровень значимости 0, 01 . 3. Критерий проверки – критерий согласия Пирсона. 4. Наблюдаемое значение критерия вычисляется по формуле: k 2 набл. n n теор . i n i 1 теор . 2 i i . Вычислим наблюдаемое значение критерия Пирсона. Для удобства и упрощения вычислений все расчеты сведем в табл. 2, объединив малочисленные теоретические и эмпирические частоты. Таблица 2 ni ni теор. ni ni теор. (ni ni теор. )2 8 16 40 72 36 18 10 6 18 36 76 39 18 7 2 –2 4 –4 –3 0 3 4 4 16 16 9 0 9 2 Наблюдаемое значение критерия равно набл . 3, 06 . 114 (ni ni теор. )2 ni теор. 0,67 0,22 0,44 0,21 0,23 0 1,29 3,06 5. По таблице критических точек распределения 2 , по уровню значимости 0, 01 и числу степеней свободы k s 3 7 3 4 находим границу правосторонней критической области кр2 . 0,01;4 13,3 . V0 3,06 V1 13,3 2 2 6. Так как набл . кр. , то для отклонения гипотезы о нормальном распределении генеральной совокупности нет оснований. При практическом применении критерия Пирсона следует помнить, что необходимыми условиями его использования являются требования, предъявляемые к объему выборки и формированию интервалов: 1. Объем выборки должен быть достаточно велик (n 50). 2. В каждом интервале должно быть не менее 5 наблюдений (вариантов). Если количество вариантов в отдельных интервалах мало, то их следует объединить с соседними интервалами, суммируя частоты, что приводит к уменьшению числа интервалов при вычислении числа степеней свободы. 115