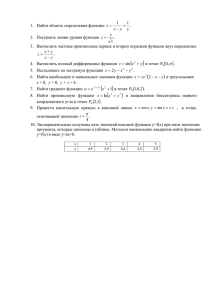

Федеральное агентство по образованию Государственное образовательное учреждение высшего профессионального образования Тульский государственный университет КАФЕДРА ЭЛЕКТРОТЕХНИКИ И ЭЛЕКТРООБОРУДОВАНИЯ В.И. Ловчаков, доктор техн. наук, профессор МЕТОДЫ ОПТИМИЗАЦИИ В ЭЛЕКТРОСНАБЖЕНИИ КОНСПЕКТ ЛЕКЦИЙ для студентов Направление подготовки бакалавров техники и технологии: 140600 – Электротехника, электромеханика и электротехнологии Направление подготовки дипломированных специалистов: 140600 – Электротехника, электромеханика и электротехнологии Специальность подготовки: 140610 – Электрооборудование и электрохозяйства предприятий, организаций и учреждений Специализация подготовки: 14061005 – Электрооборудование и электроснабжение малых предприятий и быта Тула – 2007 2 СОДЕРЖАНИЕ Стр. Лекция 1. Основные понятия и определения теории оптимизации 3 Лекция 2. Задачи условной оптимизации 9 Лекция 3-4. Методы поиска экстремума функции одной переменной 14 Лекция 5-6. Методы поиска экстремума функций многих переменных 25 Лекция 7. Задачи линейного программирования 37 Лекция 8. Задачи нелинейного программирования 43 Лекция 9. Численные методы решения задач нелинейного 51 программирования Литература 58 3 Лекция 1. Основные понятия и определения теории оптимизации План 1. Введение, основные определения. 2. Классические методы оптимизации. Задачи безусловной оптимизации. 3. Примеры. 1. Введение, основные определения В задачах управления различными технологическими процессами, расчётов режимов энергетических установок, выбора условий функционирования тех или иных электротехнических объектов в ряде случаев возникает необходимость определения наилучших в определённом смысле показателей качества работы таких объектов. Поскольку такие показатели зависят, как правило, от целого ряда других факторов, возникает задача определения таких значений этих факторов, которые обеспечивали бы минимальное (максимальное) значение заданного показателя качества. Такая задача называется задачей оптимизации. Приведём пример возникновения задачи оптимизации из теории электрических цепей. Пусть к реальному источнику электрической цепи с ЭДС E и внутренним сопротивлением Rвт подключена нагрузка с сопротивлением Rн. Если сопротивление нагрузки Rн будет незначительным, то и мощность выделяемая в ней, будет небольшой вследствие малости напряжения Uн. Если же сопротивление Rн велико, то и мощность Pн будет тоже небольшой, вследствие малой величины тока в нагрузке. Следовательно, существует некоторое значение сопротивление Rн, при котором мощность Pн ,будет иметь максимальное значение. Произведём формализацию задачи оптимизации. Пусть имеется некоторая функция n переменных f(x1,x2,...,xn), где 4 вектор x является элементом некоторого множества X (xX), называемого областью определения функции f(x) или допустимым множеством. Требуется в заданной области X найти такой вектор x*, который доставлял бы минимум (или максимум) функции f(x). Функцию f(x) часто называют целевой функцией или критерием оптимизации. Итак, задача оптимизации математически может быть записана в следующем виде: f(x*) f(x) xX Другая форма записи задачи оптимизации: x * arg min f (x ) x Рассмотренная задача называется задачей статической оптимизации, поскольку параметры x1,x2,...,xn не зависят от времени. Если же они являются функцией времени, то возникает задача динамической оптимизации, в которой определяется экстремум функционала F(x(t)) на множестве функций x(t). В данном курсе рассматриваются задачи только статической оптимизации. Вектор x, удовлетворяющий условию (1) доставляет слабый глобальный минимум функции f(x) (рис 1). Если в условии (1) поставить строгий знак неравенства, т.е. f(x*)f(x) xX, то будет иметь место сильный глобальный минимум (рис 2). f(x) f(x) x x x* Рис.1 Рис.2 Наряду с понятием глобального минимума, существует понятие локального минимума. Функция f(x) имеет локальный минимум в точке x*, если существует такая окрестность точки x*, что f(x*)f(x) для всех точек этой окрестности. Очевидно, что любой глобальный минимум является и 5 локальным, но не любой локальный являются глобальным. Слабый глобальный минимум допускает неединственность решения задачи оптимизации. В случае, если в постановке задачи оптимизации требуется определить не минимум, а максимум, достаточно вместо функции f(x) рассматривать функцию -f(x) и относительно этой функции решать задачу оптимизации. Точки максимума или минимума функции называют также точками экстремума, а задачи определения этих точек – экстремальными задачами. Задачи оптимизации можно классифицировать по различным признакам. По количеству переменных, т.е. по размерности вектора x различают задачи оптимизации функции одной переменной (одномерная оптимизация) и функции нескольких переменных (многомерная оптимизация). По наличию ограничений задачи оптимизации делят на задачи безусловной оптимизации (ограничения отсутствуют) и задачи условной оптимизации (на элементы вектора x наложены ограничения в виде равенств или неравенств). Для решения задач оптимизации могут использоваться как аналитические методы, так и численные методы. Для широкого класса задач о существовании экстремума говорит теорема Вейерштрасса: если функция f(x) непрерывна и определена на замкнутом ограниченном множестве X, то она имеет экстремум в одной из точек этого множества, которая может быть либо внутренней, либо граничной. Данная теорема даёт только достаточное условие. Это означает, что экстремум может существовать даже если не будет выполнятся условие теоремы. 2. Классические методы оптимизации. Задачи безусловной оптимизации Допустим, что функция f(x) является непрерывной на множестве X и в окрестности исследуемой точки имеет непрерывные производные по всем переменным. Тогда справедлива следующая теорема: для того, чтобы функция 6 f(x) имела локальный экстремум в точке x* необходимо, чтобы все частные производные в этой точке были равны нулю. f(x) /x1 = 0 при x=x*; f(x)/x2 = 0 при x=x* Вектор с элементами, f(x)/x1, f(x)/x2, ... , f(x)/xn называется градиентом функции f(x) и обозначается f ( x ) . Таким образом, необходимые условия оптимальности запишутся в виде: f ( x ) 0 п р и x x * . Данные условия определяют так называемые стационарные точки, однако это не гарантирует наличие в них экстремума. Для определения достаточных условий требуется дополнительно исследовать матрицу вторых производных G, называемую матрицей Гессе. g11 g G 21 ... g n1 g12 g 22 ... g n2 ... g1n ... g 2 n , ... ... ... g nn где gij = f(x)/xixj при x=x*. Если матрица G является положительно определённой, то в стационарной точке x* функция f(x) имеет минимум, а если отрицательно определена, то максимум. Проверку знакоопределённости матрицы можно проверить с помощью критерия Сильвестра. Для положительной определенности матрицы A размером n x n необходимо и достаточно, чтобы n угловых миноров матрицы были положительными, т.е. a11 >0; a11 a12 a 21 a 22 a11 0 ; …, ... a n1 ... a1n ... ... 0 ... a nn Для отрицательной определённости матрицы A размерности n x n необходимо и достаточно, чтобы первый угловой минор был отрицательным, а 7 у остальных знаки чередовались, т.е. a11 <0; a11 a12 a 21 a 22 a11 0 ; …, ( 1 )n ... a n1 ... a1n ... ... 0 . ... a nn Пример 1. Исследовать функцию f(x) = x12 + x22 + x32 - 4x1 - 8x2 - 12 x3 + 100 на наличие экстремумов. Определим стационарные точки из условия: f(x)/x1 = 2x1 -4 = 0 f(x)/x2 = 2x2 - 8 = 0 f(x)/x3 = 2x3 - 12 = 0 Решение записанной системы даёт: x1* = 2; x2* = 4; x3* = 6. Запишем матрицу Гессе (матрицу вторых производных) 2f(x)/x1 2 = 0; 2f(x)/x22 = 2; 2f(x)/x32 = 2; 2f(x)/x1x2 = 0; 2f(x)/x2x3 = 0; 2f(x)/x3x1 = 0; 2 0 0 G 0 2 0 . 0 0 2 Определим знаки угловых миноров: 2 0 0 |2|=2>0; 4 0; 0 2 0 8 0 0 2 0 0 2 2 0 По критерию Сильвестра матрица G положительна определена, следовательно функция f(x) в точке x* = (2,4,6)т достигает минимума. Пример 2. Исследовать на экстремум функцию f(x) = x12 - 2x22 + 6x1 . f(x)/x1 = 2x1+6 = 0; f(x)/x2 = -4x2 = 0 x1* = -3; x2* = 0 2f(x)/x12 = 2; 2f(x)/x22 = -4; f(x)/x1x2 = 0 8 2 0 2 0 ; |2|=2>0; G 80 0 4 0 4 По критерию Сильвестра матрица G является знаконеопределённой, следовательно, в стационарной точке x* она не имеет экстремума.