Оглавление

Теория вероятностей………………………………………………………….

4

1.

Случайные события……………………………………………………

4

1.1.

Алгебра событий………………………………………........................

4

1.2.

Элементы комбинаторики…………………………………….………

6

1.3.

Классическое определение вероятности…………………….….……

7

1.4.

Теоремы сложения и умножения вероятностей………….…….……

9

1.5.

Формула полной вероятности. Формула Байеса…………...………..

13

1.6.

Повторение испытаний……………………………………..…………

15

2.

Случайные величины………………………………………...………..

21

2.1.

Дискретная случайная величина………………………….…..………

21

2.1.1.

Закон распределения дискретной случайной величины……

21

2.1.2.

Функция распределения…………………………..………….

23

2.1.3.

Действия над случайными величинами……………………... 24

2.1.4.

Числовые характеристики дискретной случайной

величины………………………………………………………. 26

2.1.5.

2.2.

Основные законы распределения дискретных случайных

величин………………………………….……………..…..…..

29

Непрерывная случайная величина……………………………..……..

30

2.2.1.

Дифференциальная и интегральная функции

распределения………………………………..………..………. 30

2.2.2.

Числовые характеристики непрерывной случайной

величины……………………………………………..………..

2.2.3.

31

Основные законы распределения непрерывных случайных

величин……………………………...…………………………

32

Математическая статистика………………………………………………….

37

3.

Обработка результатов статистических наблюдений………….……

37

3.1.

Вариационный ряд …………………………………………………….

37

3.2.

Эмпирическая функция распределения………………………………

39

3.3.

Полигон и гистограмма……………………………………………......

40

3.4.

Числовые характеристики статистического

2

распределения………………………………………………………….

41

3.5.

Точечные оценки параметров распределения. Метод моментов…..

41

3.6.

Проверка гипотезы о нормальном распределении генеральной

совокупности. Критерий согласия Пирсона…………….…………… 43

3.7.

Критерий согласия Колмогорова……………………………...……...

3.8.

Интервальные оценки параметров нормально распределенной

46

случайной величины ……………………………………….…………

46

4. Элементы корреляционного анализа…………..…………………….…...

55

4.1.

Корреляционная таблица…………………….………………....…….

55

4.2.

Числовые характеристики…………………………………..…..……

57

4.3.

Выборочный коэффициент корреляции и проверка гипотезы о его

значимости ………………………………………………………….…. 58

4.4.

Уравнение прямой регрессии…………………………...……….……

60

Задачи по теории вероятностей ………………..……….……..

69

Задачи по математической статистике…….………………….

71

Приложения…………………………………………………………………… 75

Список литературы…………………………………………………………… 81

3

ТЕОРИЯ ВЕРОЯТНОСТЕЙ

1. Случайные события

1.1.

Алгебра событий

Теория вероятностей – математическая наука, изучающая закономерности,

присущие массовым случайным явлениям.

В теории вероятностей первичными понятиями являются испытания и

события. Пусть проводится некоторое испытание со случайным исходом.

Множество всех возможных взаимоисключающих исходов данного испытания

называется

множеством

элементарных

событий

подмножество

множества

элементарных

называется

событий.

достоверным

элементарных

событий

Совокупность

событием.

называется

всех

Всякое

случайным

событием.

Различают три типа событий: достоверное, невозможное и случайное.

Событие называется достоверным, если в результате испытания оно

обязательно произойдет. Обозначение достоверного события: .

Событие называется невозможным, если в результате испытания оно никогда

не произойдет. Обозначение: I (impossible) или ∅.

Событие называется случайным, если в результате испытания оно может

произойти, а может и не произойти. Обычно случайные события обозначают

латинскими буквами: А, В, С и т.д.

Например, проводится испытание: подбрасываем одну монету, в результате

этого испытания может быть всего два исхода: выпал герб, выпала решка

(выпадение на ребро достаточно редкий исход, мы такие исходы рассматривать не

будем), т. е. в результате испытания может произойти одно из элементарных

событий: А={выпал герб}, В={выпала решка}.

Например, проводим испытание: случайным образом вынимаем два шара из

ящика, в котором 1 белый и 3 черных шара, тогда событие {вынули хотя бы

один черный шар} является достоверным, потому что двух белых в ящике нет,

событие I {вынули зеленый шар} - невозможным, а событие A {вынули два

разных по цвету шара} - случайным.

4

Суммой двух событий A и B называется такое событие C A B ( или

A B ), которое состоит в наступлении хотя бы одного из событий A или B .

Произведением двух событий A и B называется такое событие C AB (или

A B ), которое состоит в наступлении событий A и B вместе.

События

называются противоположными, если А А ,

и

Очевидно, что события

и

А А I .

несовместны.

Например, проводится испытание: подбрасываем игральную кость, в

результате этого испытания может произойти одно из шести элементарных

={выпало 1 очко}, A2 {выпало 2 очка}, A3 {выпало 3 очка}, A4

событий:

{выпало 4 очка}, A5 {выпало 5 очков}, A6 {выпало 6 очков}, выпадение на

ребро достаточно редкий исход, мы такие исходы рассматривать не будем.

Событие {1, 2, 3, 4, 5, 6} является достоверным. На множестве можно

ввести и другие случайные события: A {выпало нечетное число очков}, B

{выпало четное число очков}, C {выпало простое число очков}, и т.п., но они уже

не являются элементарными событиями, т.к., их можно представить в виде

объединения элементарных событий

=

∪

∪

;

=

∪

∪

;

=

∪

∪

∪

.

Два события называются несовместными, если в результате одного

испытания они не могут произойти одновременно, т.е.

Несколько событий

,

∩

= ∅.

, …., A n называются попарно несовместными,

если каждая пара не может произойти одновременно, т.е. каждое не может

произойти с остальными.

События

,

, …., A n образуют полную группу, если в результате

испытания происходит хотя бы одно из них, и ничего кроме этих событий не может

n

произойти, т.е.

A = Ω.

i

i 1

Пример 1. Проведем испытание: один раз бросаем игральную кость.

Рассмотрим события:

число очков},

={выпало четное число очков},

={выпало три очка} и

5

={выпало нечетное

= {выпало пять очков}. Указать

события,

которые

являются

совместными,

несовместными,

попарно

несовместными и т.п.

Решение.

События

и

являются совместными, т.к. они могут произойти

одновременно, в случае, если выпадет три очка. События

События

,

и

- попарно несовместные. События

попарно несовместными, поскольку, например,

одновременно. События

∪

∪

∪

и

,

,

и

и

и

A4

- не являются

могут произойти

образуют полную группу, поскольку

= Ω = {1, 2, 3, 4, 5, 6}. События

∪

несовместных событий, поскольку

,

- несовместные.

и A2 образуют полную группу

= Ω, а

∩

∪

не образуют полную группу, так как

= ∅. События

∪

,

и

= {2, 3, 4, 5, 6} ≠ Ω,

поскольку может выпасть одно очко.

1.2.

Элементы комбинаторики

Комбинаторика — раздел математики, посвященный решению задач выбора и

расположения

элементов из некоторого множества

элементов в соответствии с

заданными правилами. Ниже будем рассматривать множества, состоящие из

различных элементов.

Перестановками называются комбинации, состоящие из

элементов и

отличающиеся только порядком их расположения. Число перестановок равно

= !,

(1.1)

где ! = 1 ∙ 2 ∙ 3 ∙ … ∙ ( − 1) ∙ , причем принято считать, что 0!=1 (читается «ноль

факториал»).

Сочетаниями называются комбинации, состоящие в выборе

элементов из

элементов ( ≤ ), отличающиеся хотя бы одним элементом. Число сочетаний

равно

С =

!

!∙(

)!

.

(1.2)

Размещениями называются комбинации, состоящие в выборе

элементов из

элементов ( ≤ ), отличающиеся либо составом элементов, либо их порядком.

Число размещений равно

=

∙

=(

6

!

.

)!

(1.3)

Пример 1.2. Имеем множество, состоящее из трех элементов {1, 2, 3}.

Сколько из трех предложенных цифр можно составить различных чисел с

неповторяющимися цифрами: а) трехзначных; б) двузначных?

Решение. а) Количество различных комбинаций из трех цифр вычисляем по

формуле (1.1), т.е.

= 3! = 6. И действительно ровно шесть трехзначных чисел

можно составить: 123, 132, 213, 231, 312, 321.

б) Порядок в выборе двух элементов из трех важен, т.к. 23 и 32 различные

числа, поэтому количество способов выбрать 2 из трех вычисляем по формуле

(1.3). Получаем

=

!

!

= 6. И действительно ровно шесть двузначных чисел

можно составить из трех: 12, 13, 21, 23, 31, 32.

Пример 1.3. Сколько существует способов выбора трех студентов из 10 на

конференцию?

Решение. Порядок в выборе трех элементов из десяти не важен, т.к. делегация

из Иванова, Петрова и Сидорова от делегации Петрова, Иванова и Сидорова не

отличается, поэтому число способов выбора равно числу сочетаний из 10

студентов по 3

C

1.3.

=

10!

= 120.

3! 7!

Классическое определение вероятности

Вероятность события – это число, характеризующее степень возможности

появления события. Вероятность появления события

вычисляется по формуле

( )= .

где

- число исходов, благоприятствующих наступлению события

(1.4)

,

- число

всех возможных исходов.

Свойства вероятности

1. Вероятность случайного события : 0 < ( ) < 1.

2. Вероятность достоверного события (Ω) = 1.

3. Вероятность невозможного события ( ) = 0.

Пример 1.4. Монету бросают один раз. Вычислить вероятность того, что

выпадет герб.

7

Решение. Рассмотрим событие

={выпал герб}. При бросании монеты

возможны два исхода ( = 2): выпал герб и выпала решка, и только первый исход

(

благоприятствует наступлению события

= 1). Тогда по классическому

определению вероятности ( ) = .

Пример 1.5.

Игральную кость

подбрасывают

один

раз.

Вычислить

вероятность того, что выпадет простое число очков.

Решение. Рассмотрим событие

={выпало простое число очков}. При

={выпало

бросании игральной кости всех возможных исходов ровно шесть:

очков}, где - 1,…, 6, т.е.

исхода

(

,

,

и

= 6. Из шести всевозможных исходов только четыре

являются благоприятствующими наступлению события

= 4). Вероятность появления простого числа очков равна ( ) = = .

Пример 1.6. В урне 4 белых и 6 черных шара. Извлекли одновременно 3 шара.

Найти вероятность того, что: а) все шары белые; б) все шары черные; в) один

белый и два черных.

Решение. Будем считать, что все шары разные и пронумерованы 1, 2,…,10.

Пусть первые четыре номера - белые, последние - черные. Тогда количество

всевозможных способов извлечь три шара из десяти равно С

а)

Рассмотрим

событие

= 120.

= {из урны извлекли три белых шара}.

количество способов, благоприятствующих появлению события

Получаем ( ) =

=

Тогда

равно С = 4.

.

б) Рассмотрим событие

= {из урны извлекли три черных шара}. Тогда

количество способов, благоприятствующих появлению этого события равно

С = 20. Получаем ( ) =

= .

в) Рассмотрим событие C= {из урны извлекли один белый и два черных шара}.

Тогда количество способов, благоприятствующих появлению этого события равно

произведению С С = 60. Получаем (С) =

8

= .

Статистическое определение вероятности

Пусть проводятся

испытаний, в результате которых событие

наступает

→ ∞ называется статистической вероятностью.

раз. Тогда отношение , при

Пример 1.7. Изучали вероятность рождения мальчика. Среди 1000

новорожденных

мальчик

появился

в

515

случаях.

Тогда

статистическая

вероятность (относительная частота) рождения мальчика равна

=

=

= 0,515.

Геометрическое определение вероятности

Геометрической вероятностью события

называется отношение меры

области , благоприятствующей появлению события , к мере всей области

( )=

.

(1.5)

Области могут быть одномерными, двумерными, трехмерными.

Пример 8. Пусть в квадрат, со стороной 3 см вписан круг. Найти вероятность

того, что точка, случайным образом брошенная в квадрат, попадет в круг.

Решение. Обозначим событие

={точка попала в круг}. Площадь квадрата

равна 9 см2, а площадь круга радиусом 1,5 см равна 2,25

,

( )=

1.4.

см2. Тогда

= 0,25 .

Теоремы сложения и умножения вероятностей

Теоремы сложения.

Теорема 1. Если события

и

несовместные, то

( + ) = ( ) + ( ).

Теорема 2. Если события

,

, ….,

попарно несовместны, то

n

n

P Ai P Ai .

i 1 i 1

Теорема 3. Если события

,

(1.6)

, ….,

(1.7)

образуют полную группу попарно

несовместных событий, то

n

P A 1 .

i

i 1

9

(1.8)

+ ( ) = 1.

Следствие.

Теорема 4. Если события

и

совместные, то

( + )= ( )+ ( )− (

).

(1.9)

Теоремы умножения.

События

и

называются независимыми, если появление одного из них не

влияет на вероятность появления другого (в противном случае события зависимы).

События

,

, ….,

называются попарно независимыми (или независимыми в

совокупности), если каждые два из них независимы.

Теорема 1. Если события

и

независимые, то

(

Теорема 2. Если события

,

) = ( ) ∙ ( ).

, ….,

(1.10)

попарно независимы, то

n

n

P Ai P Ai .

i 1 i 1

Теорема 3. Если события

(

где

( ) и

и

зависимые, то

)= ( )

( )= ( )

( ) - условные вероятности.

условии, что событие

(1.11)

( ),

(1.12)

( ) - вероятность события

при

( ) есть еще

уже произошло. Для условной вероятности

обозначение P(A/B).

Теорема 4. Вероятность появления хотя бы одного из событий

,

, ….,

независимых в совокупности, равна

P ( A1 A2 ... An ) 1 P ( A1 ) P ( А2 ) ... P An .

(1.13)

Пример 9. Вероятность попадания в мишень при каждом выстреле для

первого стрелка равна 0,7, а для второго – 0,8. Оба они делают по одному выстрелу

по мишени. Найти вероятности событий:

мишени только одна пробоина;

– в мишени две пробоины;

– в

– в мишени хотя бы одна пробоина.

Решение. Введем два события:

={в мишень попал первый стрелок},

=

мишень попал второй стрелок}. Тогда

, события

и

={в

– независимые,

применяя формулу (1.10), находим вероятность события

( )= (

∙

)= (

Теперь найдем вероятность события

)∙ (

) = 0,7 ∙ 0,8 = 0,56.

. В мишени одна пробоина означает,

что попал либо первый, либо второй, т.е. В А1 А2 А1 А2 . Выстрелы производятся

10

независимо, поэтому события

и

– независимые, события

и

– так же

независимые, а два события А1 А2 и А1 А2 - несовместные. Используя теоремы

сложения и умножения, имеем

Р ( В ) Р ( А1 А2 А1 А2 ) Р ( А1 А2 ) Р ( А1 А2 ) 0,7 0, 2 0,3 0,8 0,38.

Вероятность события С находим по формуле (1.13)

Р(С ) 1 Р( А1 ) Р( А2 ) 1 0,3 0,2 0,94.

Пример 1.10. Найти вероятность прохождения тока через цепь при

последовательном соединении, если вероятности исправной работы элементов

равны

и

. Элементы работают независимо друг от друга.

р1

р2

Решение. Введем два события: A1 {первый элемент работает}, A2 {второй

элемент работает}. При последовательном соединении ток пройдет по цепи только

тогда, когда оба элемента работают. Тогда событие C {ток идет по всей цепи}

можно записать в виде

C А1 А2 .

События A1 и A2 независимые, следовательно, по формуле (1.10) имеем

( )=

∙

Пример 1.11. Найти вероятность прохождения тока через цепь при

параллельном соединении, если вероятности исправной работы элементов равны

и

. Элементы работают независимо друг от друга.

р1

р2

Решение. При параллельном соединении ток пройдет по цепи только тогда,

когда хотя бы один из двух элементов работает. Введем два события: A1 {первый

элемент работает}, A2 {второй элемент работает}. Тогда событие C {ток идет по

всей цепи} можно записать в виде

C А1 А2 А1 А2 А1 А2 .

11

Однако противоположное событие С можно представить в более компактном

виде

С А1 А2 .

События A 1 и A2 - независимые. Обозначим Р ( А1 ) q1 Р ( А2 ) q 2 , тогда

Р (С ) Р ( А1 А2 ) Р ( А1 ) Р ( А2 ) q1 q 2 .

По следствию теоремы сложения 3 имеем

Р(C) 1 Р(C ) 1 q1 q2 1 1 p1 1 p2 .

Пример 1.12. Найти вероятность прохождения тока через цепь, если

вероятности исправной работы элементов указаны на схеме. Элементы работают

независимо друг от друга.

Решение. Введем события: A 1 - ток идет по участку АВ, A 2 - ток идет по

участку ВС, A 3 - ток идет по участку СЕ. Согласно примеру 10, вероятность того,

что ток идет по участку СЕ равна

P( A3 ) 0,9 0,8 0,72 .

Следуя примеру 11, вероятность того, что ток по участку ВС не идет равна

P( A2 ) 1 0,9 1 0,81 0,7 0,006 .

Тогда вероятность того, что ток по участку ВС идет равна

P( A2 ) 1 P( A2 ) 0,994 .

Участок АВ состоит из параллельного и последовательного соединения.

Вероятность того, что ток идет по нижнему участку АВ равна

P 0,9 0,8 0,72 .

Тогда вероятность того, что по всему участку АВ ток не идет, вычисляем как для

параллельного соединения (см. пример 11)

P( A1 ) 1 0,91 0,72 0,028 .

А вероятность того, что по участку АВ ток идет равна

12

P( A1 ) 1 0,028 0,972 .

Соединение АВ, ВС, СЕ – последовательное, поэтому вероятность того, что ток

идет по всему участку АЕ равна

P P A1 P A2 P A3 0,972 0,994 0,072 0,696 .

1.5.

Формула полной вероятности. Формула Байеса

Теорема. Если событие A может произойти только при условии появления

одного из попарно несовместных событий (гипотез) В1 , В2 , ... Вn , образующих

полную группу, то вероятность события

A

равна сумме произведений

вероятностей каждого из этих событий (гипотез) на соответствующие условные

вероятности события A

n

P ( A) P ( Bi ) P ( A / Bi ) P ( B1 ) P ( A / B1 ) P ( B 2 ) P ( A / B2 ) ... P ( Bn ) P ( A / Bn ) (1.14)

i 1

Из теоремы умножения (1.12) и формулы полной вероятности (1.14) легко

получить формулу Байеса, которая позволяет «переставить причину и следствие»:

по известному факту события позволяет вычислить вероятность того, что оно было

вызвано данной причиной.

Теорема. Условная вероятность гипотезы Bi , при условии того, что событие

A произошло, вычисляется по формуле Байеса

P( Bi ) P( A / Bi )

P( Bi / A)

n

,

(1.15)

P(B ) P( A / B )

i

i

i 1

где В1 , В2 , ... , Вn - попарно несовместные события, образующие полную группу.

Вероятности Р ( Вi ) называют априорными вероятностями, т.е. вероятностями

событий до выполнения опыта, а условные вероятности этих событий

( / )

апостериорными, т.е. уточненными в результате опыта, исходом которого

послужило появление события А.

Пример 1.13. Имеются две партии однотипных изделий. Первая партия

состоит из 60 изделий, среди которых 10 бракованных, вторая из 40 изделий, среди

которых 5 бракованных. Из первой партии берется случайным образом 25 изделий,

а из второй – 15. Эти изделия смешиваются и образуется новая смешанная партия,

13

из которой берется наугад одно изделие. Найти вероятность того, что оно будет

бракованным.

Решение. Введем события В1 ={извлеченное из смешанной партии изделие

оказалось из первой партии}, В2 ={извлеченное из смешанной партии изделие

оказалось из второй партии}, А={извлеченное из смешанной партии изделие

бракованное}.

Тогда по формуле (1.4) имеем P B1

25

15

, P B2 . Вероятность выбрать

40

40

дефектное изделие из смешанной партии, при условии что осуществилось событие

( /

В1, равна

( /

)=

)=

; а при условии что осуществилось событие В2, равна

. По формуле полной вероятности (1.14) получаем

P ( A)

25 10 15 5

0,1042 .

40 60 40 40

Пример 1.14. Среди поступающих на сборку деталей с I станка 0,1%

бракованных, со II-0,2%; с III- 0,25%, с IV – 0,5%. Производительности их

относятся

соответственно

как

4:3:2:1.

Взятая

наудачу

деталь

оказалась

стандартной. На каком станке вероятнее всего она изготовлена?

Решение. Введем события: А ={взятая деталь стандартная},

={взятая деталь

= 1,2,3,4. Вероятности гипотез

будут равны:

изготовлена на –ом станке},

Р ( В1 )

4

4

3

2

1

, Р( В2 ) , Р ( В3 ) , Р( В4 ) . Условные вероятности:

4 3 2 1 10

10

10

10

P ( A / B1 ) 1

0,1

0,999, P ( A / B 2 ) 0,998,

100

P( A / B3 ) 0,9975, P( A / B4 ) 0,995 .

Тогда по формуле (1.14) найдем вероятность того, что наудачу взятая деталь

оказалась стандартной.

P ( A)

4

3

2

1

0,999 0,998 0,9975 0,995 0,998.

10

10

10

10

14

Применим формулу Байеса (1.15), чтобы найти вероятность того, что

извлеченная деталь, оказавшаяся стандартной, изготовлена на I станке.

4

0,999

P( B1 ) P( A / В1 ) 10

P( B1 / А)

0,4004 .

P( A)

0,998

Аналогично, P( B2 / A) 0,3000, P( B3 / A) 0,1999, P( B4 / A) 0,0997.

Таким образом, вероятнее всего, что деталь изготовлена на первом станке.

1.6.

Повторение испытаний

Пусть проводится конечное число

испытаний, в каждом из которых событие

последовательных независимых

может появиться, а может и не

появиться. Испытания называются независимыми, если вероятность появления

события

в каждом из испытаний не зависит от того, появилось или не появилось

это событие в других испытаниях. Вероятность появления события

испытании одинакова и равна

обозначим через

=

в каждом

, а вероятность противоположного события

=1− .

Теорема. Вероятность того, что в

испытаниях событие

появится ровно

раз вычисляется по формуле Бернулли

Pn ( k ) С nk p k q n k ,

(1.16)

n

где

вычисляется по формуле (1.2). Легко доказать, что

P (k ) 1 .

n

k 0

Замечание. Конечную серию

повторных независимых испытаний с двумя

исходами, вероятности которых равны

Наивероятнейшее число

и , называют схемой Бернулли.

появления события

в

независимых

испытаниях находится по формуле

−

Если

−

≤

≤

+ .

- целое число, то наивероятнейших чисел ровно два:

(1.17)

−

и

+ .

Пример 1.15. Игральную кость подбрасывают 10 раз. Найти вероятность того,

что: а) шесть очков выпадет ровно 3 раза; б) шесть очков выпадет хотя бы один раз.

Решение. Введем событие

очков}. Тогда ( ) =

={в одном испытании выпадет ровно шесть

= , ( )=

=1− = .

15

а) По формуле (1.16) вычисляем вероятность того, что шесть очков выпадет

(3) =

ровно 3 раза из десяти

∙

∙

=

≈ 0.

∙

б) По формуле (1.13) вычисляем вероятность того, что шесть очков выпадет

=1−

хотя бы один раз из десяти

=1−

= 0,8385.

Пример 1.16. В семье 5 детей. Вероятность рождения мальчика считаем

равным 1/2. Найти вероятность того, что в семье ровно три мальчика. Какое

наиболее вероятное количество мальчиков в семье?

Решение. Имеем

= 5,

= 1/2,

= 1/2. Тогда

3

2

5! 1 1

10

Р5 (3) С р q

.

3!2! 2 2

32

3

5

3

2

По формуле (1.17) находим наивероятнейшее число мальчиков в семье из 5

детей

5 1

5 1

k0 ,

2 2

2 2

т.е. наивероятнейшее число равно 2 или 3.

Пример 1.17. Для нормальной работы автобазы на линии должно быть не

менее 8 автомашин, а их имеется 10. Вероятность того, что автомашина на линию

не выйдет равна 0,1. Найти вероятность нормальной работы автобазы в ближайший

день.

Решение. Событие

={автобаза работает нормально}. Для нормальной

работы автобазы на линии должно быть или 8 автомашин, или 9, или 10. Введем

три события

={на линии работает 8 машин},

={ на линии работает 9 машин},

={ на линии работает 10 машин}. Тогда событие А можно представить в виде

объединения трех несовместных событий

=

+

+

.

Используя формулу (1.16), и учитывая, что в нашем случае

= 0,1 , вычисляем

(

(

)=

(8) =

0,9 0,1 = 0,1937,

(

)=

(9) =

0,9 0,1 = 0,3874,

)=

(10) =

16

0,9 0,1 = 0,3487.

= 10,

= 0,9,

Таким образом,

( )= (

)+ (

)+ (

) = 0,9298.

Локальная формула Лапласа

Пользоваться формулой Бернулли (1.16) при больших значениях

достаточно

трудно. Например, для того, чтобы найти вероятность того, что при 30 испытаниях

(10) =

герб выпадет 10 раз, необходимо вычислить

. Первый

сомножитель требует громоздких вычислений.

При большом числе опытов по схеме Бернулли ( ≥ 25) удобнее

пользоваться приближенными формулами.

≥ 10, то вероятность того, что в

Локальная теорема Лапласа. Если

независимых испытаниях событие

наступит

Pn (k )

где x

k np

npq

1

npq

раз, находится по формуле

х ,

, а функция х определяется равенством

(1.18)

( )=

√

(рис.2.1).

Значения функция х можно найти в таблице ( приложение 1).

Свойства функции Гаусса

1). Функция

( ).

( ) - четная, т.е. х = х .

lim х 0 , можно считать х 0

2).

для

x

всех значений | | ≥ 4.

3)

( x)dx 1.

Рис.2.1. Функция Гаусса.

Пример 1.18. Найти вероятность того, что при 600 выстрелах мишень будет

поражена 250 раз, если вероятность поражения мишени при одном выстреле равна

0,4.

17

Решение. Поскольку

= 600 - велико, и

= 144 ≥ 10, то вероятность

будем вычислять по формуле (1.18).

Находим

250 600 0,4

х

600 0,4 0,6

0,833 0,2820 .

Р600 ( 250)

Тогда

10

0,833 .

12

по

По

таблицам

локальной

определяем

теореме

Лапласа

1

0, 2820 0,0235.

12

Формула Пуассона (закон редких событий)

< 10 и

Теорема. Если

независимых испытаниях событие

< 0,1 (p 0 ) , то вероятность того, что в

наступит

раз, находится по формуле

Пуассона

k e

Pn (k )

,

k!

где

=

- среднее число появлений события

в

(1.19)

испытаниях.

Пример 1.19. Завод отправил на базу 5000 доброкачественных изделий.

Вероятность того, что в пути изделие повредится, равна 0,0002. Найти вероятность

того, что в пути будет повреждено: а) 3 изделия; б) не более 3-х изделий; в) более

3-х изделий.

Решение. По условию задачи имеем

и

= 0,9998 < 10,

а)

= 3,

=

= 5000,

= 0,0002. Тогда

= 0,9998

< 0,1.

= 1, тогда по формуле (1.19) вычисляем P5000(3)

e 1

0,0613 .

3!

б) Введем событие В={в пути будет повреждено не более 3-х изделий}. Это

событие равно объединению четырех несовместных событий {в пути повреждено

ровно изделий}, где = 0, 1, 2, 3. Тогда по формулам (1.7) и (1.19) имеем

( ) = ( ≤ 3) =P5000(0)+P5000(1)+P5000(2)+P5000(3)=

е 1 10 е 1 11 е 1 12 е 1 13

1 1

2

8

е 1 (1 1 ) е 1 2 е 1 0,9810 .

0!

1!

2!

3!

2 6

3

3

в) Противоположным событием к событию

является следующее: ={в пути

будет повреждено более 3-х изделий}. Тогда

= ( > 3) = 1 − ( ) = 1 − 0,9810 = 0,0190.

18

Интегральная теорема Муавра-Лапласа

Если

от

≥ 10, то вероятность того, что событие

– большое и

раз до

произойдет

раз вычисляют по интегральной формуле Муавра-Лапласа

Pn 1 к 2 Фх 2 Ф х1 ,

где х 2

k 2 np

npq

х1

,

k1 np

npq

х

1

2

и Ф ( х)

e

t2

2

(1.20)

dt – функция Лапласа (рис.2.2).

0

Таблица значений функции Φ( ) приведена в приложении 2.

Свойства функции Лапласа

1) Φ( ) - нечетная функция, т.е.

Φ(− ) = −Φ( ).

2) Φ( )–возрастающая функция на

всей числовой оси.

3) lim Ф ( х) 0,5 ,

x

можно

считать

Φ( ) ≈0,5, для всех значений

≥ 5.

Рис.2.2. Интегральная

Лапласа.

функция

Пример 1.21. Вероятность того, что деталь не прошла проверку ОТК, равна

р = 0,2. Найти вероятность того, что среди 400 случайно отобранных деталей

окажется непроверенных от 70 до 100 деталей.

Решение.

При

вычислении

предварительно

х1

70 400 0,2

400 0,2 0,8

будем

использовать

вычислив

1,25, х 2

100 400 0,2

400 0,2 0,8

2,5 .

формулу

(1.20),

значения

По приложению 2 находим

Φ(−1,25) = −Φ(1,25) = −0,3944, Φ(2,5) = 0,4938. Тогда

(70,100) = Φ( ) − Φ( ) = Φ(2,5) + Φ(1,25) = 0,8882.

19

Следствия интегральной формулы Муавра-Лапласа

Следствие 1. Вероятность того, что в

независимых испытаниях абсолютная

величина отклонения числа наступления события

появления события

(m) от среднего числа

не превзойдёт положительного числа , находится по

формуле

.

Р m np 2Ф

npq

Следствие 2. Вероятность того, что в

независимых испытаниях абсолютная

величина отклонения относительной частоты

вероятности

(1.21)

наступления события

от его

не более чем на некоторое число , находится по формуле

m

Р p 2Ф

n

n

.

pq

(1.22)

Пример 1.22. Мастерская по гарантийному ремонту телевизоров обслуживает

2000

абонентов.

Вероятность

того,

что

купленный

телевизор

потребует

гарантийного ремонта, равна 0,3. Предполагая, что событие, вероятность которого

0,9973, достоверно, найти границы числа телевизоров, которые потребуют

гарантийного ремонта.

Решение.

= 2000,

= 0,3,

= 0,7,

= 600. По формуле (1.21) находим

0,9973 .

Р2000 m 600 2Ф

2000 0,3 0,7

Ф

0,49865 , по таблицам (приложение 2) находим аргумент

20,49

котором значение функции Φ( ) = 0,49865. Получаем

=3

, при

3

20,49

=61,4762. Следовательно, m np 62 и 538 m 662 .

Пример 1.23. Вероятность поражения мишени при одном выстреле равна 0,6.

Найти такое число выстрелов по мишени, при котором с вероятностью 0,993

можно ожидать, что отклонения относительно частоты попаданий от вероятности

0,6 по абсолютной величине не превзойдет 0,03.

Решение. Имеем

= 0,6,

= 0,03, тогда

20

m

n

0,993 ,

Р 0,6 0,03 2Ф 0,03

0

,

6

0

,

4

n

откуда получаем

Ф(0,0612 n )=0,4965.

По приложению 2 находим аргумент функции Лапласа, при котором ее значение

равно 0,4965.

= 2,7. 0,0612 n =2,7

n 44,09

1944.

2. Случайные величины

Наряду с понятием случайного события и вероятности понятие случайной

величины является важнейшим в теории вероятностей. Случайная величина – это

числовая функция, определенная на множестве элементарных событий Ω, значения

которой есть вещественные числа. Обозначают случайные величины большими

последними буквами латинского алфавита X, Y, Z.

Случайными величинами, например, являются:

при бросании игральной кости,

некоторый промежуток времени,

2.1.

− число выпавших очков

− число вызовов на телефонной станции за

− прибыль или убытки фирмы и т. д.

Дискретная случайная величина

Дискретной называется случайная величина, значения которой образуют

конечную или бесконечную последовательность чисел x1 , x2 ,…, xn ,... Например,

случайная величина X – число дней в году - дискретная (она принимает два

значения 365;366); случайная величина Y – число испытаний, которое надо сделать

до первого попадания в цель (она принимает бесконечное число значений 1, 2, 3 и

т.д.).

2.1.1. Закон распределения дискретной случайной величины

Рассмотрим дискретную случайную величину

,

,

,…,

с возможными значениями

. В результате опыта случайная величина примет только одно из

этих значений. Введем события Ai X xi , образующие полную группу попарно

несовместных событий. Вероятность того, что событие

через рi P X xi .

21

наступит, обозначим

Законом распределения дискретной случайной величины

называется

соотношение между ее возможными значениями xi и их вероятностями рi . Закон

распределения дискретной случайной величины

можно задать в виде формулы,

например, формулы Бернулли, Пуассона и др. Удобнее задавать закон дискретной

случайной величины в виде таблицы

Таблица 2.1. Закон распределения дискретной случайной величины

xi

x1

x2

…

xn

рi

р1

р2

….

рn

Так как события

образуют полную группу попарно несовместных событий,

то по формуле (1.8) имеем

n

р1 р 2 ... р n pi 1 .

(2.1)

i 1

Если случайная величина принимает бесконечное число значений

,

,

,…,

, …, то

p

i

1.

(2.2)

i 1

Графическое представление таблицы 2.1 называется многоугольником

распределения вероятностей: фигуры, состоящей из точек ( ,

), соединенных

отрезками (рис.2.3).

Пример 2.1. Стрелок производит три выстрела в мишень. Вероятность

попадания в цель при каждом выстреле одинакова и равна 0,8. Составить закон

распределения случайной величины X

– число попаданий в цель при 3-х

выстрелах. построить многоугольник распределения вероятностей.

Решение. Случайная величина может принимать четыре значения: 0, 1, 2 и 3.

Вероятности P X xi будем искать по формуле Бернулли (1.16). Имеем

= 0,8, вероятность того, что стрелок промахнулся, равна

=1−

P ( X 0) P3 (0) C 30 p 0 q 3 0,8 0 0,2 3 0,008.

P ( X 1) P3 (1) C 31 p 1 q 2 3 0,81 0,2 2 0,096.

P ( X 2) P3 ( 2) C 32 p 2 q 1 3 0,8 2 0,21 0,384.

P ( X 3) P3 (3) C 33 p 3 q 0 0,8 3 0,2 0 0,512.

22

= 3,

= 0,2. Тогда

xi

0

1

2

3

рi

0,008

0,096

0,384

0,512

0,6

0,4

Контроль:

равенство

(2.1)

0,2

выполняется.

0

0

1

2

Рис.2.3. Многоугольник

вероятностей.

3

4

распределения

2.1.2. Функции распределения

Закон распределения дискретной случайной величины можно задать

функцией распределения

.

Функцией распределения случайной величины

которая для любого вещественного числа

величина

называется функция

,

равна вероятности того, что случайная

примет значение, меньшее х

F ( x ) P ( X x).

(2.3)

Функция распределения дискретной случайной величины – ступенчатая

функция, определенная на всей числовой оси.

Свойства функции распределения

1. Функция распределения принимает значения только из интервала

0 F ( x) 1 .

2. F (x) - неубывающая функция, т.е. если x1 x 2 , то F ( x1 ) F ( x 2 ).

3. Вероятность того, что случайная величина примет значение из интервала

равна P (a X b) F (b) F (a).

4. lim F ( x ) 0, lim F ( x ) 1 .

x

x

5. F (x) - непрерывна слева, т.е. lim F ( x) F ( x0 ).

x x0 0

23

:

Пример 2.2. В условиях задачи 2.1 составить функцию распределения F (x) и

построить её график.

Решение. Очевидно, что вероятность того, что случайная величина примет

значение меньшее, чем 0 равна нулю, F (0) P ( X 0) 0 . Найдем значения

функции F (x) в точках

= 1,

=2и

= 3.

F (1) P ( X 1) 0,008 ;

F ( 2) P ( X 2) Р ( Х 0) Р ( Х 1) 0,008 0,096 0,104 ;

F (3) P ( X 3) Р ( Х 0) Р ( Х 1) Р ( Х 2) 0,008 0,096 0,384 0, 488 .

Тогда функция распределения F (x) имеет вид

при

0,

0,008, при

F ( x ) 0,104, при

0,488, при

1,

при

х 0,

0 х 1,

1 х 2,

2 х 3,

х 3.

Рис.2.4.

Функция

распределения

дискретной случайной величины.

2.1.3. Действия над случайными величинами

Пусть законы распределения двух независимых случайных величин

известны. Пусть случайная величина

= ( =

), а случайная величина

= ( =

).

и

принимает значения

с вероятностями

принимает значения

с вероятностями

Произведением случайной величины

на постоянное число С называется

такая случайная величина , значения которой получаются в результате умножения

всех значений случайной величины

на число С, соответствующие вероятности

при этом не меняются.

Суммой двух случайных величин

и , называется такая случайная величина

, значения которой получаются в результате сложения всех возможных значений

случайной величины

=

+

и всех возможных значений случайной величины

, соответствующие вероятности при этом перемножаются, т.е.

24

, т.е

=

= ( =

Произведением двух случайных величин

величина

)

=

и

.

называется такая случайная

, значения которой получаются в результате произведения всех

возможных значений случайной величины

случайной величины

, т.е.

перемножаются, т.е.

=

=

и всех возможных значений

, соответствующие вероятности при этом

= ( =

)

=

.

Замечание. Если при вычислении получаются одинаковые значения

, то в

таблице записывают только одно, вероятности при этом складываются.

Пример 2.3. Команда состоит из двух стрелков. Первый стрелок выбивает 8,

9, 10 очков с вероятностями 0,1; 0,4; 0,5. Второй стрелок выбивает 9, 10 очков с

вероятностями 0,4; 0,6. Результаты стрельбы одного стрелка не влияют на

результаты стрельбы второго. Составить закон распределения числа очков,

выбиваемых этой командой, если стрелки сделают по одному выстрелу.

Решение. Из условия задачи результаты стрельбы одного стрелка не влияют

на результаты стрельбы второго, следовательно,

и

– независимые случайные

величины. Запишем законы распределения случайных величин

и .

xi

8

9

10

yi

9

10

рi

0,1

0,4

0,5

gi

0,4

0,6

=

Пусть

+ . Тогда по определению суммы двух независимых случайных

величин имеем

zi

17

18

18

19

19

20

Pi

0,04

0,06

0,16

0,24

0,20

0,30

Значение z =18 встречается два раза с вероятностями 0,06 или 0,16, поэтому в

таблицу записываем одно значение z =18, вероятности при этом складываются.

Аналогично запишем z =19 с вероятностью 0,44. Получаем окончательную таблицу

zi

17

18

19

20

Pi

0,04

0,22

0,44

0,30

25

2.1.4. Числовые характеристики дискретной случайной величины

Математическое ожидание случайной величины

произведений всех значений случайной величины

- это число, равное сумме

на соответствующие

xi

вероятности pi

n

M ( X ) xi pi .

(2.4)

i 1

Математическое ожидание определяет среднее значение случайной величины.

Размерность математического ожидания совпадает с размерностью случайной

величины .

Свойства математического ожидания

1.

Математическое ожидание постоянной случайной величины С равно самой

этой постоянной: М (С ) С.

2.

Постоянный множитель можно вынести за знак математического ожидания:

М (СХ ) СМ ( Х ).

3.

Математическое ожидание суммы случайных величин равно сумме их

математических ожиданий: М ( Х Y ) М ( Х ) M (Y ).

4.

Математическое ожидание произведения независимых случайных величин

равно произведению их математических ожиданий: М ( ХY ) М ( Х ) M (Y ).

Дисперсия случайной величины

- это число, равное математическому

ожиданию квадрата отклонения случайной величины от ее математического

ожидания

2

n

2

D ( X ) M X M ( X ) x i M ( X ) pi .

(2.5)

i 1

Дисперсия определяет средний квадрат отклонений случайной величины от

их среднего значения. Размерность дисперсии равна квадрату размерности

случайной величины .

Из формулы (2.5) можно вывести более удобную формулу для вычисления

дисперсии

n

D ( X ) M X 2 M 2 ( X ) xi2 pi M 2 ( X ) .

i 1

26

(2.6)

Свойства дисперсии

1

Дисперсия постоянной случайной величины равна нулю: D (C ) 0.

2

Постоянный множитель можно выносить за знак дисперсии, предварительно

возведя его в квадрат: D(CX ) C 2 D( X ).

3

Дисперсия суммы независимых случайных величин равна сумме их

дисперсий: D ( X Y ) D( X ) D (Y ).

Для того, чтобы размерность степени рассеяния случайной величины

относительно среднего значения совпадала с размерностью самой случайной

величины, вводят среднее квадратическое отклонение

х D( X ) .

(2.7)

Пример 2.4. В условиях примера 2.3. вычислить числовые характеристики

случайных величин ,

и Z X Y .

Решение. Согласно формуле (2.4) имеем

M ( X ) 8 0,1 9 0, 4 10 0,5 9,4 ; M (Y ) 9 0,4 10 0,6 9,6;

M ( Z ) 17 0,04 18 0,22 19 0,44 20 0,30 19 .

Дисперсию вычислим по формуле (2.6)

D( X ) 8 2 0,1 9 2 0,4 10 2 0,5 9,4 2 0,44 ; D(Y ) 9 2 0,4 10 2 0,6 9,6 2 0,24 ;

D(Z ) 17 2 0,04 182 0,22 19 2 0,44 20 2 0,30 192 0,68 .

Из формулы (2.7) находим средние квадратические отклонения

X 0,44 0,663 ;

Y 0,24 0,49 ;

Z 0,68 0,825 .

Т.е. в среднем первый стрелок выбивает 9,4 очка, второй – 9,6 очков, а вместе - 19

очков. По средним значениям можно судить, что второй стрелок более меткий. По

средним квадратическим отклонениям также можно судить, что второй стрелок

лучше стреляет, так как

<

и

<

.

Видно, что свойство математического ожидания

выполнено:

( + ) =19,

случайные величины

=

и

( ) = 9,4,

( + )=

( )+

( )

( ) = 9,6. Кроме того, поскольку

- независимы, то свойство дисперсии ( + ) =

( ) + ( ) - так же имеет место. Этими свойствами можно пользоваться для

контроля вычислений или для нахождения

закона распределения случайной величины

27

( + )и

+ .

( + ) без составления

Пример 2.5. В ящике находятся 5 белых и 15 черных шаров одинаковых на

ощупь. Случайным образом вынули сразу три шара. Найти математическое

ожидание случайной величины величина

- число белых шаров среди трех

отобранных.

Решение. Случайная величина

может принимать четыре значения 0, 1, 2 и

3. Вероятности вычислим по классическому определению вероятности (1.4). Число

всевозможных исходов равно С . Число благопрятствующих появлению события

= {среди трех отобранных шаров ровно k белых шара}

С ∙С

равно

произведению

. Тогда получим

(0) =

=

(2) =

91

;

228

(1) =

=

(3) =

;

=

35

;

76

=

.

Таким образом, закон распределения случайной величины

имеет вид

xi

0

1

2

3

рi

91

228

35

76

5

38

1

114

Для контроля используем формулу (2.1).

В заключение, по формуле (2.4) находим математическое ожидание

( )=0∙

+1∙

+2∙

+3∙

Кроме перечисленных числовых характеристик

= 0,75.

( ),

( ) и

( )

существуют и другие. К таким относятся начальные моменты и центральные

моменты.

Начальным моментом

- того порядка случайной величины

величина равная математическому ожиданию случайной величины

=

(

называется

, т.е.

n

) = xi k pi .

(2.8)

i 1

Из формулы (2.8) следует, что математическое ожидание - это начальный

момент первого порядка.

Центральным моментом

величина

равная

- того порядка случайной величины

математическому

величины в степени ( −

ожиданию

( )) , т.е.

28

центрированной

называется

случайной

=

n

( )) = x i M ( X ) k p i .

( −

(2.9)

i 1

Из формулы (2.9) следует, что дисперсия - это центральный момент второго

порядка.

2.1.5. Основные законы распределения дискретных случайных величин

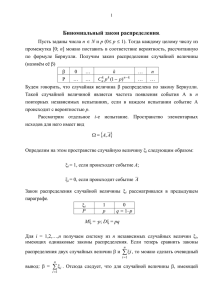

Биномиальный закон распределения

Пусть проводится n независимых испытаний, в каждом из которых событие

A может произойти с одной и той же вероятностью p . Случайная величина

- это

число испытаний, в которых событие A наступило. Вероятность того, что событие

A наступит ровно k раз в n испытаниях вычисляется по формуле Бернулли (1.16).

Биномиальный закон распределения вероятностей случайной величины

имеет

вид

xi

0

1

…

k

…

n

рi

С n0 p 0 q n 0

С n1 p1 q n 1

…

С nk p k q n k

…

С nn p n q 0

Здесь q 1 p .

Математическое ожидание: M ( X ) np . Дисперсия: D ( X ) npq .

Среднее квадратическое отклонение: ( X ) npq .

Биномиальный закон распределения – однопараметрическое распределение,

задаётся параметром p .

Закон распределения Пуассона

Пусть проводится большое количество n независимых испытаний, в каждом

из которых появление события A одинаково и маловероятно ( p 0 ). Случайная

величина

- это число испытаний, в которых событие A наступило. Вероятность

того, что событие A наступит ровно k раз в n испытаниях вычисляется по

формуле Пуассона (1.19). Закон распределения Пуассона имеет вид

xi

0

1

рi

e 0

0!

e 1

1!

29

…

k

…

…

e k

k!

…

Здесь np .

Математическое ожидание: M ( X ) . Дисперсия: D (X ) .

Среднее квадратическое отклонение: ( X ) .

Закон распределения Пуассона задаётся одним параметром .

Геометрический закон распределения

Пусть вероятность появления события A в каждом испытании одинакова и

равна . Вероятность того, что событие A не наступит в каждом испытании так же

= 1 − . Испытания проводятся до первого появления

одинакова и равна

события A . Случайная величина

- это количество проведенных испытаний.

Вероятность того, что событие A наступит с первого раза равна , со второго и т.д. Геометрический закон распределения имеет вид

xi

1

2

3

…

k

…

рi

p

qp

q2 p

…

q k 1 p

…

Математическое ожидание: M ( X )

1

q

. Дисперсия: D( X ) 2 .

p

p

Среднее квадратическое отклонение: ( X )

q

.

p

Геометрический закон распределения задаётся одним параметром p .

2.2.

Непрерывная

Непрерывная случайная величина

случайная

величина

принимает

множество

значений

вещественной прямой.

Закон распределения непрерывной случайной величины задается либо

интегральной функцией распределения, либо дифференциальной функцией

распределения.

2.2.1. Дифференциальная и интегральная функции распределения

Функция распределения непрерывной случайной величины определяется

также как и для дискретной - формулой (2.3). Функция распределения непрерывной

случайной величины – непрерывная.

30

Дифференциальная

функции

распределения

связана

с

интегральной

равенством

f ( x) F х .

(2.10)

И наоборот, если известна дифференциальная функции распределения, то

можно найти интегральную функцию распределения по формуле

x

F ( x)

f (t )dt .

(2.11)

Дифференциальную функцию распределения f (x ) еще называют функцией

плотности вероятности.

Свойства интегральной функции распределения такие же, как и свойства 1-4

для функции распределения дискретной случайной величины.

Свойства дифференциальной функции распределения

1. f x 0 , так как F (x) - неубывающая функция.

2.

f ( x)dx 1 .

b

3. P (a X b) f ( x )dx .

a

2.2.2. Числовые характеристики непрерывной случайной величины

Математическое ожидание

М (X )

хf xdx ;

(2.12)

Дисперсия

2

D X М X М X

( x M ( X ))

2

f ( x )dx .

(2.13)

или после преобразования

2

D X M X 2 M X

x

2

2

f ( x)dx M X .

(2.14)

Среднее квадратическое отклонение

( X ) D( X ) .

31

(2.15)

Свойства математического ожидания, дисперсии и среднего квадратического

отклонения

непрерывных

случайных

величин

аналогичны

свойствам

математического ожидания и дисперсии дискретных случайных величин.

2.2.3

Основные законы распределения непрерывных случайных величин

Равномерный закон распределения

Непрерывная случайная величина

имеет равномерный закон распределения,

на отрезке [a, b], если её плотность вероятности ( ) постоянна на этом отрезке и

равна нулю вне его.

если x a,

0,

1

f x

, если а x b,

в

а

если x b.

0,

(2.16)

Рис.2.4. Дифференциальная функция

распределения случайной величины,

распределенной по равномерному закону.

График дифференциальной функции (2.16) равномерного распределения

изображен на рис. 2.4.

Интегральная функция равномерного распределения задается в виде (2.17), ее

график изображен на рис.2.5.

если x a,

0,

x a

F x

, если а x b,

в

а

если x b.

1,

Рис.2.5.

Интегральная

функция

распределения случайной величины,

распределенной по равномерному закону.

32

(2.17)

Числовые характеристики:

ab

Математическое ожидание: M ( X )

. Дисперсия:

2

Среднее квадратическое отклонение: (х) =

ba

2 3

(b a ) 2

( )=

12

.

Вероятность попадания случайной величины в интервал [ , ] равна

( ≤

≤ ) = ( ) − ( ).

Равномерное распределение имеет 2 параметра - a и b .

Пример 2.5. Цена деления шкалы амперметра равна 0,1 ампера. Показания

амперметра округляют до ближайшего деления. Найти вероятность того, что при

вычислениях будет сделана ошибка, не превышающая по абсолютной величине

0,02 ампера.

Решение. Ошибку округления отсчета можно рассматривать, как случайную

величину

, которая распределена равномерно между двумя соседними цельными

делениями. Все значения случайной величины заключены в интервале [ ; ], где

= −0,05 ,

= 0,05. Используя формулу (2.16), получаем функцию плотности

х 0,05,

0,

(х)= 10,

0,

0,05 х 0,05,

х 0,05.

0 , 02

Тогда Р( х 0,02)

10dx 10 x

0 , 02

0 ,02

0,4.

0 , 02

Показательный (экспоненциальный) закон распределения

Непрерывная

случайная

величина

имеет

(экспоненциальный) закон распределения с параметром

вероятности ( ) задана функцией (2.18).

33

показательный

, если плотность

e х , если

f x

0,

если

x 0,

х 0.

(2.18)

Рис.2.6. Дифференциальная функция

распределения случайной величины,

распределенной

по

показательному

закону.

Интегральная функция распределения имеет вид

если x 0,

0,

F x

x

1 e , если x 0.

(2.19)

Рис.2.7.

Интегральная

функция

распределения случайной величины,

Числовые

характеристики:

распределенной

по

показательному

закону.

Математическое ожидание: M ( X )

1

1

. Дисперсия: D ( X ) 2

Среднее квадратическое отклонение: ( X )

1

.

Вероятность попадания случайной величины в интервал [ , ] равна

( ≤

≤ )= ( )− ( )=

−

Показательный закон распределения имеет 1 параметр - .

34

.

(2.20)

Нормальный закон распределения

Нормальное распределение вероятностей задается функцией плотности

распределения

1

f x

e

2

( xa )2

2 2

(2.21)

.

Рис.2.8. Дифференциальная функция

распределения случайной величины,

распределенной по нормальному закону

при a 2 , 1 .

Числовые характеристики:

Математическое ожидание: M ( X ) a . Дисперсия: D( X ) 2 .

Среднее квадратическое отклонение: .

Нормальный закон распределения имеет два параметра –

Для удобства вычисления значений

и .

( ) ее можно записать через функцию

( ) следующим образом

( )=

,

(2.22)

и использовать таблицы приложения 1.

Интегральная функция распределения имеет вид

1

F ( x)

2

Для вычисления значений

x

e

t a 2

2 2

dt

.

(2.23)

( ) удобнее ее записать через функцию Лапласа

Φ( )

F ( x)

1

xa

Ф(

),

2

(2.24)

и использовать таблицы приложения 2.

Вероятность попадания случайной величины Х, распределенной нормально, в

интервал [ , ], находится по формуле

35

a

a

P ( X ) Ф

Ф

.

(2.25)

Правило «трёх сигм»: практически все значения нормально распределённой

случайной величины лежат в интервале [ − 3 ;

+ 3 ]. Так как по формуле

(2.25) имеем Pa 3 X a 3 0,9973 , поэтому не менее чем с достоверностью

99,7%, все значения нормально распределенной случайной величины лежат в

указанном интервале.

Нормально распределенные случайные величины играют важнейшую роль во

многих областях знаний. Физическая величина часто подчиняется нормальному

распределению, когда она подвержена влиянию значительного числа случайных

помех. Ясно, что такая ситуация крайне распространена, поэтому можно сказать,

что из всех распределений в природе чаще всего встречается именно нормальное

распределение — отсюда и произошло его название.

Пример 2.6.

Закон

дифференциальной

распределения

функцией

f ( x)

случайной

1

3 2

e

величины

задается

x 2 2

.

18

Найти:

а)

числовые

характеристики случайной величины; б) интегральную функцию распределения; в)

интервал, в который с вероятностью 0,96 попадет случайная величина в результате

испытаний.

Решение. а) Сравнивая данную дифференциальную функцию с формулой

(2.21), можно заключить, что случайная величина

распределена по нормальному

закону с математическим ожиданием M ( X ) a 2 , и средним квадратическим

отклонением

= 3. Тогда дисперсия равна ( ) =

= 9.

б) Из (2.23) находим интегральную функцию распределения

1

F ( x)

3 2

x

e

t 2 2

18

dt .

в) По формуле (2.25) находим интервал, в который с вероятностью 0,96

попадет случайная величина. Возьмем в качестве

Тогда (2 − Δ <

= 2Φ

< 2 + Δ) = Φ

−Φ

= 0,96.

36

=

− Δ, а

=Φ

=

+ Δ.

−Φ

=

Откуда Φ

= 0,48. По таблицам приложения 2 по значению функции

Лапласа Φ( ) =0,48 находим

= 1,75. ⟹

= . ⟹ Δ = 3 ∙ 1,75. ⟹ Δ = 5,25.

Окончательно получаем интервал [−3,25; 7,25], в который с вероятностью 0,96

случайная величина

попадет в результате испытания.

МАТЕМАТИЧЕСКАЯ СТАТИСТИКА

Математическая

результатов

статистика

наблюдений

-

массовых

наука,

изучающая

случайных

явлений.

методы

обработки

Основной

целью

математической статистики при решении задач планирования, прогнозирования и

т.д. является сбор статистических данных, их обработка, исследование и принятие

решения.

3. Обработка результатов статистических наблюдений

3.1.

Пусть

требуется

изучить

Вариационный ряд

некоторую

случайную

величину,

закон

распределения которой неизвестен. Требуется приближенно определить этот закон

по опытным данным и проверить гипотезу о том, что случайная величина

подчинена этому закону.

В

результате

случайного

отбора

из

всей

совокупности

объектов

(генеральной совокупности) можно получить выборку (числовые данные).

Количество объектов выборки, называемое объемом выборки, будем обозначать

через . Для того, чтобы по выборке можно было уверенно судить о генеральной

совокупности, выборка должна быть репрезентативной (хорошо отражать

свойства

генеральной

совокупности).

Репрезентативность

улучшается

при

увеличении объема выборки.

Перед обработкой статистических данных, если число значений признака

велико ( ≥ 25), их упорядочивают, группируют и строят интервальный

вариационный ряд. Существует много способов группировки данных.

37

Предложим самый простой. Просматривая данные наблюдений, находят

наименьшее значение выборки

и наибольшее -

. Затем находят размах

варьирования по формуле

=

−

.

(3.1)

Для построения интервального вариационного ряда необходимо весь интервал

[

] разбить на

,

частичных интервалов. Для определения числа

заданному значению объема выборки

по

можно воспользоваться формулой

Стерджеса

= 1 + [3,322 ∙ lg ],

где

квадратные

скобки

-

целая

часть

(3.2)

числа.

ориентировочного значения количества интервалов

Для

нахождения

можно использовать

следующую таблицу

25-30

30-60

60-100

100-125

125-200

5-6

6-7

7-8

8-9

9-10

Считая, что все частичные интервалы имеют одинаковую длину, для

каждого интервала следует установить его верхнюю и нижнюю границы, а затем в

соответствии с полученной упорядоченной совокупностью частичных интервалов

сгруппировать результаты наблюдений.

Длину частичного интервала (шаг) определяем по формуле

ℎ=

.

(3.3)

Промежуточные интервалы получают, прибавляя к концу предыдущего

интервала длину частичного интервала ℎ, обозначим границы интервалов через

=

тогда

=

,

+ ℎ,

=

+ 2ℎ,…,

=

подсчитывают количество наблюдаемых значений (частоту

+

ℎ.

,

Затем

), которые попали в

m

-тый интервал, причем

n

i

n . Все вычисления записывают в виде таблицы.

i 1

Таблица 3.1. Интервальный вариационный ряд

[ ,

]

[

,

]

[

,

]

[

…

38

,

]

Итого

Замечание. Если значения случайной величины

границу интервала [ ,

(варианты) попали на

], то их количество делят пополам и распределяют

половину значений в левый интервал, половину - в правый.

Из таблицы 3.1. можно получить вариационный ряд, если заменить первую

строку на значения середин каждого интервала (обозначим середины через

).

Таблица 3.2. Вариационный ряд

…

Итого

…

3.2.

Эмпирической

Эмпирическая функция распределения

функцией

распределения

(функцией

распределения

выборки) называют функцию F * ( x) , которая равна относительной частоте

появления события { < }, найденную по данной выборке

F ( x)

n x

,

n

(3.4)

где nx - количество вариант, меньших ;

- объем выборки.

Для нахождения эмпирической функции распределения выборки удобнее

сначала вычислить относительные частоты попадания случайной величины в - тый

интервал

= .

(3.5)

Затем вычислить накопленные относительные частоты

относительных частот

+

+ ⋯+

( ) - сумму

. Результаты вычислений записывают в

виде таблицы

Таблица 3.3. Распределение относительных частот

…

m

w

…

i

1

i 1

Накопленные

относительные 0

+

+

частоты ( )

39

+

+

+

+⋯

1, при

>

Из таблицы 3.3 находим эмпирическую функцию распределения

⎧

⎪

⎪

∗(

)=

0,

если ≤ ,

, если

< ≤ ,

+ , если

< ≤ ,

+

+ , если

< ≤ ,

+

+

+ , если

< ≤ ,

⎨

⎪

⎪… … … … … … … … … … … … … … … … … …

⎩

1,

если >

.

(3.6)

Эмпирическая функция распределения обладает теми же свойствами, как и

функция распределения дискретной случайной величины.

3.3.

Полигон и гистограмма

Используя таблицы (3.2) и (3.3) можно построить полигон частот и полигон

относительных частот. Полигоном частот называют ломаную, соединяющую

точки с координатами ( ,

частот – лоианую ( ,

), ( ,

), ( ,

),…,(

),…,(

,

,

), полигоном относительных

).

Гистограммой частот (относительных частот) называют ступенчатую

фигуру, состоящую из прямоугольников, основаниями которых служат частичные

интервалы длины ℎ, а высоты равны отношению

площадь гистограммы частот равна

ni

h

wi

. Очевидно, что вся

h

, а площадь гистограммы относительных

частот равна единице.

Гистограмма относительных частот, построенная на основе выборки, может

служить оценкой неизвестной плотности вероятностей. При увеличении объема

выборки и уменьшении длин интервалов гистограмма относительных частот

приближается к графику неизвестной функции плотности вероятности генеральной

совокупности ( ).

По виду гистограммы или полигона частот можно выдвинуть гипотезу о виде

распределения генеральной совокупности.

40

3.4.

Числовые характеристики статистического распределения

Выборочной средней X В называют среднее арифметическое значений

признака

выборочной

совокупности.

Пусть

получено

статистическое

распределение (табл. 3.2). Тогда выборочное среднее равно

XВ

1 m

xi ni .

n i 1

(3.7)

Выборочная средняя имеет те же единицы измерения, что и варианты

.

Выборочной дисперсией DB называют среднее арифметическое квадратов

отклонения наблюдаемых значений признака от их

среднего

значения

В.

Выборочную дисперсию вычисляется по формуле

DВ

1 m

xi X В 2 ni .

n i 1

(3.8)

Более удобная формула для вычисления выборочной дисперсии

1 m 2

2

DВ xi ni X В .

n i 1

(3.9)

Кроме дисперсии для характеристики рассеяния значений признака

выборочной совокупности вокруг своего среднего значения пользуются средним

квадратическим отклонением.

Выборочное среднее квадратическое отклонение равно

в

=

в.

(3.10)

Выборочное среднее квадратическое отклонение имеет те же единицы измерения,

что и варианты

3.5.

.

Точечные оценки параметров распределения. Метод моментов

Метод моментов точечной оценки неизвестных параметров заданного

распределения

состоит

в

приравнивании

теоретических

моментов

соответствующим эмпирическим моментам того же порядка. Согласно закону

больших чисел, при увеличении объема выборки среднее арифметическое выборки

стремится к математическому ожиданию генеральной совокупности. Поэтому

выборочная

средняя

может

служить

генеральной совокупности.

41

оценкой

математического

ожидания

Если распределение определяется двумя параметрами, то приравнивают два

теоретических момента двум соответствующим эмпирическим моментам того же

порядка. Например, можно приравнять начальный теоретический момент первого

порядка (математическое ожидание) начальному эмпирическому моменту первого

порядка (выборочному среднему) и центральный теоретический момент второго

порядка (дисперсию) центральному эмпирическому моменту второго порядка

(выборочной дисперсии)

( )=

( )=

в.

(3.11)

в

Левые части этих равенств являются функциями от неизвестных параметров,

а правые части – числовые характеристики, которые вычислены в п.3.4, поэтому,

решив систему (3.11) относительно неизвестных параметров, получают их

точечные оценки.

Таким образом, зная числовые характеристики нормального распределения

=

( ),

=

( ), получаем искомые точечные оценки параметров

≥ 25)

нормального распределения (если

=

в,

=

в.

(3.12)

Если объем выборки мал ( < 25), то выборочная дисперсия значительно

отличается от дисперсии генеральной совокупности нормально распределенной

случайной величины, тогда в качестве точечной оценки среднего квадратического

отклонения

генеральной совокупности используют исправленное выборочное

среднее квадратическое отклонение

=

∙

в.

(3.13)

Точечной оценкой параметра экспоненциального распределения является

следующая

=

.

(3.14)

в

И наконец, точечные оценки параметров равномерного распределения

=

в

− √3 в,

42

=

в

+ √3 в .

(3.15)

3.6.

Проверка гипотезы о нормальном распределении генеральной

совокупности. Критерий согласия Пирсона

Критерием

согласия

называют

критерий

проверки

гипотезы

о

предполагаемом законе неизвестного распределения. Есть основные гипотезы и

альтернативные. Альтернативная гипотеза – это гипотеза, которая противоречит

основной.

Например,

основная

гипотеза

-

генеральная

совокупность

распределена по нормальному закону, тогда альтернативная гипотеза

-

генеральная совокупность не распределена по нормальному закону. Основную

гипотезу можно выдвинуть по виду гистограммы частот (или относительных

частот). Если гистограмма куполообразная (рис.3.1), то выдвигают гипотезу

-

генеральная совокупность распределена по нормальному закону с плотностью

распределения (2.21). Если высоты прямоугольников гистограммы приблизительно

на одном уровне (рис.3.2), то проверяют гипотезу

- генеральная совокупность

распределена по равномерному закону с плотностью распределения (2.16). Если

высоты прямоугольников гистограммы резко (экспоненциально) падают с ростом

Х (рис.3.3), то выдвигают гипотезу

- генеральная совокупность распределена по

экспоненциальному закону с плотностью распределения (2.18).

10

40

8

30

6

20

4

10

2

0

0

Рис.3.1. Вид гистограммы частот для

нормального распределения

Рис.3.2. Вид гистограммы частот для

равномерного распределения

43

35

30

25

20

15

10

5

0

Рис.3.3. Вид гистограммы частот для

экспоненциального распределения

Критерий согласия Пирсона: по выборке составляется специальная

характеристика

набл

(читается: «хи-квадрат наблюдаемая») и сравнивается с

табличным критическим значением

уровень значимости,

крит (

, ) (приложение 3). Здесь

- заданный

- число степеней свободы, который можно вычислить по

формуле

=

где

- число интервалов,

− − 1,

(3.16)

- число параметров распределения (для нормального

распределения два параметра: математическое ожидание и среднее квадратическое

отклонение, поэтому

Если

Если

= 2). Затем сравниваются значения

набл< крит (

набл> крит (

набл

и

крит (

, ).

, ), то нет оснований отвергнуть нулевую гипотезу.

, ) , то нулевую гипотезу отвергают и принимают

альтернативную.

Величина

набл

зависит от выборки и поэтому является случайной, причем

распределена она по закону Хи-квадрат. Вычисляют ее по формуле

m

2

набл

n n

ni'

i 1

где

' 2

i

i

.

- эмпирические частоты из таблицы (3.2),

объем выборки,

(3.17)

- теоретические частоты,

–

– число частичных интервалов. Если объем выборки равен

сумме теоретических частот, то формула (3.17) примет вид

2

m

2

набл

n

i' n ,

i 1 ni

44

(3.18)

=

Теоретические частоты вычисляются по формуле

теоретические вероятности попадания случайной величины

= 0, 1, 2, … ,

, где

в интервал [ ,

],

− 1.

Теоретические вероятности нормального распределения можно вычислить

двумя способами.

1. С помощью интегральной функции Лапласа Φ( ) (по формуле (2.25))

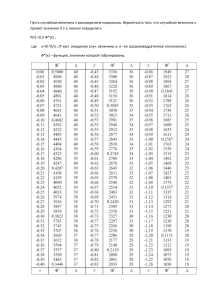

Pi U i 1 U i ,

здесь

в

=

в

=

,

в

в

квадратическое отклонение,

[ ,

в

(3.19)

− 1.

в

- выборочное среднее

– выборочное среднее,

,

- концы интервалов

,

= 0, 1, 2, … ,

] (из таблицы 3.1).

2. С помощью дифференциальной функции Лапласа ( ) (2.22)

=

здесь

=

в

, где

в

∙ ( ),

(3.20)

- середины интервалов (из таблицы 3.2).

в

Чем меньше различаются эмпирические и теоретические частоты, тем меньше

величина критерия, и, следовательно, он в известной степени характеризует

близость эмпирического и теоретического распределения.

Если выдвигается основная гипотеза

- случайная величина распределена по

экспоненциальному закону, то теоретические вероятности вычисляют, используя

формулу (2.20), или в новых обозначениях

=

Здесь

=

;

в

,

−

, = 0, 1, … ,

− 1.

- границы - того интервала.

Замечания.

1. Необходимым условием применения критерия Пирсона является наличие

в каждом из интервалов не менее 5 наблюдений. Интервалы с частотами меньше 5

в таблице (3.1) следует объединять, частоты при этом складываются. При

вычислении числа степеней свободы считать количество интервалов

уже после

объединения.

2. Критерий Пирсона является наиболее состоятельным при большом числе

наблюдений

( ≥ 50).

Он

почти всегда опровергает

45

неверную гипотезу,

обеспечивая минимальную ошибку в принятии неверной гипотезы по сравнению с

другими критериями.

3.7.

Критерий согласия Колмогорова

Критерий согласия Колмогорова является наиболее простым критерием

проверки гипотезы о виде закона распределения. Он связывает эмпирическую

∗

функцию распределения

( ) с теоретической функцией распределения

( )

некоторой случайной величиной (статистика Колмогорова)

= max |

где

∗(

)−

( )| ,

(3.21)

- максимальная разность значений эмпирической и теоретической функций

распределения,

– объем выборки, xi - середины интервалов (из табл. 3.2).

Затем находят критическое значение

Колмогорова.

=

√

, где

находят по таблицам

- это такое значение, при котором функция Колмогорова

равна надежности , т.е. ( ) =

Если

крит

<

крит

=1−

( )

( - уровень значимости).

, то нет оснований отвергнуть нулевую гипотезу, в

противном случае нулевую гипотезу отвергают и принимают альтернативную.

Таблица 3.4. Значения

3.8.

при заданном уровне значимости .

0,20

0,10

0,05

0,02

0,01

0,001

1,073

1,224

1,358

1,510

1,627

1,950

Интервальные оценки параметров нормально распределенной

случайной величины

Интервальное

оценивание

параметров

распределения

генеральной

совокупности состоит в построении доверительных интервалов. Доверительным

интервалом для параметра θ называется интервал (θ , θ ), покрывающий истинное

значение параметра с заданной надежностью γ = 1 − α, здесь α - уровень

значимости. Таким образом,

P(θ <

< θ ) = γ = 1 − α.

46

Оценка математического ожидания генеральной совокупности,

распределенной по нормальному закону

Пусть случайная величина

и

имеет нормальное распределение с параметрами

. Тогда интервальной оценкой при заданном уровне значимости

(с

надежностью ) математического ожидания при неизвестном параметре служит

доверительный интервал

в

где

в

- выборочная средняя,

отклонение (при

(3.13)),

<

ген

<

в

+

√

,

≥ 25 вычисляется по формуле (3.10), а при

заданным значениям

=

√

(3.22)

– исправленное выборочное среднее квадратическое

< 25 - по формуле

= ( , ) находят по таблицам приложения 4 по

- объем выборки,

степеней свободы

−

(или в некоторой литературе по надежности

) и числу

, которое на единицу меньше, чем объем выборки , т.е. равно

− 1.

Замечание. Интервальной оценкой математического ожидания генеральной

совокупности, распределенной по нормальному закону, при заданном уровне

значимости

(с надежностью ) и при известном среднем квадратическом

отклонении служит доверительный интервал (3.22), где

такое значение, при

котором функция Лапласа Φ( ) = , находится по таблицам приложения 2.

Оценка среднеквадратического отклонения генеральной совокупности

нормально распределенной случайной величины.

Интервальной оценкой

(с надежностью

) среднего квадратического

отклонения генеральной совокупности служит доверительный интервал

(1 − ) <

0<

< (1 + ), если

q<1,