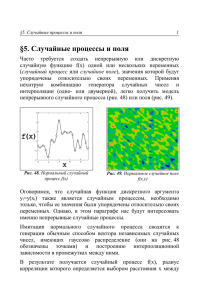

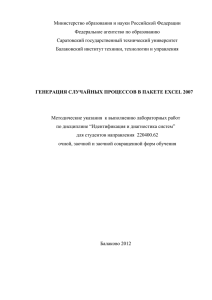

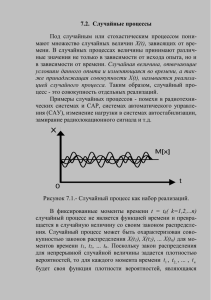

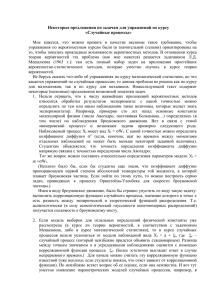

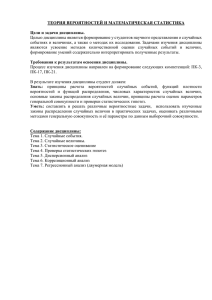

Тема 6. ОПРЕДЕЛЕНИЕ СТАТИСТИЧЕСКИХ ХАРАКТЕРИСТИК СЛУЧАЙНЫХ ПРОЦЕССОВ ИДЕНТИФИЦИРУЕМЫХ ОБЪЕКТОВ СОДЕРЖАНИЕ ТЕМЫ: 1. ПРИМЕНЕНИЕ СЛУЧАЙНЫХ СИГНАЛОВ. 2. СТАТИСТИЧЕСКИЕ ХАРАКТЕРИСТИКИ СЛУЧАЙНЫХ СИГНАЛОВ И ИХ ЛИНЕЙНЫЕ ПРЕОБРАЗОВАНИЯ. 1 ОПРЕДЕЛЕНИЕ СТАТИСТИЧЕСКИХ ХАРАКТЕРИСТИК СЛУЧАЙНЫХ ПРОЦЕССОВ ИДЕНТИФИЦИРУЕМЫХ ОБЪЕКТОВ Ход технологического процесса характеризуется значениями фиксированного числа параметров, большая часть которых непрерывно изменяется относительно своих средних значений. Эти изменения носят случайный характер и называются случайными процессами. Зная ход такого процесса за некоторый промежуток времени Т нельзя предсказать точно, каково будет его поведение в дальнейшем. Однако для некоторого класса случайных процессов можно по информации для достаточно длинного промежутка времени Т определить их статистические характеристики. 2 1. ПРИМЕНЕНИЕ СЛУЧАЙНЫХ СИГНАЛОВ Во многих случаях нарушение нормального функционирования объекта искусственными пробными воздействиями совершенно недопустимо. В этих случаях применяются пассивные методы идентификации, как правило, статистические (например, корреляционные), в которых используются случайные естественные колебания входных сигналов. Для эффективного использования этих методов необходим большой интервал наблюдения, что требует применения вычислительной техники. Отсутствие пробного воздействия устраняет нежелательные влияния аппаратуры идентификации на процесс управления, однако точность идентификации уменьшается. 3 При пассивном эксперименте возникает много трудностей, связанных с нестационарностью рабочих случайных сигналов и с неадекватностью их спектра. Это обстоятельство делает особенно важным применение активных методов, которые в последнее время также в значительной степени принимают статистический характер. Статистические методы позволяют использовать в качестве источника информации случайные естественные сигналы идентифицируемого объекта. Вычисления статистических характеристик существенно упрощаются при некоторых видах пробного сигнала, например, представляющих собой модель белого шума. 4 Определения: Белый шум — это случайный процесс х(t), который характеризуется отсутствием какой-либо взаимной связи между предыдущими и последующими значениями х(t) . Такой случайный называют абсолютно случайным процессом. 5 процесс 2. СТАТИСТИЧЕСКИЕ ХАРАКТЕРИСТИКИ СЛУЧАЙНЫХ СИГНАЛОВ И ИХ ЛИНЕЙНЫЕ ПРЕОБРАЗОВАНИЯ Случайную функцию, зарегистрированную в той или иной форме по результатам опыта, называют реализацией случайной функции. На рисунке показаны графики случайных функций х1(t) … x4(t) . Можно рассмотреть какой-либо определенный момент времени t и определить какая доля из общего числа функций xi(t) имеет в этот момент значение, заключенное между х и х + x . Эта доля зависит от t и пропорциональна x при малых x. p1(х, t)x и называют одномерной плотностью распределения вероятности. Ее обозначают через 6 Графики случайных процессов x1 (t ) t x 2 (t ) t x3 (t ) t x 4 (t ) t t1 t2 7 t3 Если рассматривать возможные пары значений х, наблюдавшиеся в два различных момента времени t1, t2, то долю пар значений х, для которых величина х заключена между (x1, x2 + x1) t = t2, при t = t1 и между (х2, x2 + х2) при отнесенных к общему числу наблюдавшихся пар значений, обозначают через p2(x1t1, x2t2)x1х2 и называют двумерной плотностью распределения вероятности. Этот процесс трехмерную можно и т. д. и вероятности. 8 продолжить и определить n-мерную плотность распределения Считается, что о случайном процессе известно все, если известна функция pk при любом k, т. е. при любой плотности распределения вероятности p1(х, t)x, p2(x1t1, x2t2)x1х2 и т.д. В общем случае для экспериментального определения n-мерных функций плотности вероятности, характеризующих случайный процесс, необходимо располагать значительным числом функций х(t), полученных из большого числа наблюдений над подобными системами, чтобы затем определить вероятность нахождения величины х в любом интервале (х, х + х) в момент времени t. 9 Математическое описание и экспериментальное исследование случайных процессов, на которые не наложено никаких ограничений, представляет значительные трудности. Поэтому обычно рассматривают случайные процессы, удовлетворяющие определенным допущениям. Среди таких процессов большое внимание уделяют так называемым процессам Маркова. Их особенность состоит в том, что в каждый данный момент времени дальнейший ход процесса определяется его состоянием в рассматриваемый момент времени и не зависит от характера течения процесса в предшествовавший период. Процессы такого рода сравнительно легко поддаются математическому описанию. 10 Однако более многочисленными являются такие физические явления, при которых предыдущее течение процесса имеет существенное значение для дальнейшего его протекания. Среди случайных процессов, в которых предыдущее течение процесса в существенной мере определяет те заключения, которые можно сделать о будущем, называются стационарными случайными процессами. Понятие стационарного случайного процесса используют, когда статистические свойства системы, в которой протекает случайный процесс, остаются неизменными во времени, т. е. вид функций распределения вероятности не зависит от смещения начала отсчета вдоль оси времени. 11 Иначе: случайный процесс называют стационарным, если его статистические свойства не зависят от начала отсчета во времени, т.е. когда два процесса х(t) и х(t + ) имеют одинаковые статистические свойства для любого . В более общих случайных процессах функция распределения зависит от момента времени, для которого она определяется. 12 Статистические характеристики случайного процесса находятся посредством усреднения значений случайных величин, зависящих от ординат процесса. Такое усреднение может быть проведено: по времени, если имеется лишь одна реализация процесса; по множеству для фиксированного момента времени, когда в распоряжении исследователя имеется множество независимых реализаций. Случайный процесс, для которого результаты осреднения, тем и другим способом, оказываются одинаковыми, обладает свойством эргодичности. проведенного 13 Определения: Стационарный случайный процесс обладает эргодическим свойством или подчиняется эргодической гипотезе. Случайный процесс х(t) называют эргодическим процессом, если все его статистические свойства могут быть определены по одной - единственной реализации xi (t) . Эргодическим можно также называть такой процесс, для которого среднее значение по времени равно средним значениям по ансамблю. 14 Математическое ожидание В случае стационарного случайного процесса среднее значение или математическое ожидание (момент 1-го порядка) mx для совокупности функций х(t) постоянно, т. е. m x = m x (t ) = x( t ) p ( x, t ) dx , (6.1) где p(х, t) - плотность распределения вероятности. Среднее значение по времени функции x(t) определяют по формуле T 1 = x lim T 2T где -T x(t ) dt = const , T интервал наблюдения. 15 (6.2) Корреляционная функция Автокорреляционной или просто корреляционной функцией R(t1, t2) называют момент 2-го порядка m2x(t1, t2) случайной функции х(t) , т. е. R ( t1 , t 2 ) = x x p ( x , x , t , t ) dx1 dx2 , (6.3) Выражение для корреляционной функции стационарного процесса может быть записано так: R() 1 16 2 1 2 1 2 x (t + τ) x p( x , x , τ)dx dx R( τ) = 1 2 1 2 1 2 = 1 = lim T 2T T T x(t + τ) x(t )dt = x(t + ) x(t ) . 17 (6.4) Физический смысл понятия корреляционной функции состоит в определении вероятности того, что если х(t) в момент t имеет значение x1, то в момент времени t + она имеет значение x2, т.е. характеризует взаимную связь между х(t) и x(t + ) . Если мало по сравнению с постоянным времени системы, то связь между х(t + ) и х(t) велика, а значение R() достигает максимума, т. е. при очень малых вероятность того, что значение функции х(t + ) мало отличается от значения х(t), будет близка к единице и близка к достоверности. случайная функция 18 По мере увеличения составляющая х(t), определяемая начальным значением х(t), при t = 0 затухает, связь между величинами х(t) и х(t + ) ослабевает, они делаются взаимно независимыми, а функция R() 0 . Другими словами, при достаточно больших вероятность того, что величина х(t + ) будет мало отличаться от величины х(t) , практически равна нулю. Вся необходимая для расчетов линейных систем статистическая информация для стационарных процессов x(t) или y(t) , с учетом гипотезы эргодичности, содержится в их корреляционной функции, вычисляемой по формуле: 19 1 Rxx ( ) = lim T 2T Или 1 Ryy ( ) = lim T 2T T (6.5) y (t ) y (t + ) dt. (6.6) T T T Из формул (6.5) и (6.6) корреляционной функции. 20 x(t ) x(t + ) dt следуют основные свойства Свойства корреляционной функции R() 1. Корреляционная функция стремится к нулю, т. е. R() случайной функции при lim R( τ) = R( ) = 0 . T 2. Начальное значение R(0) корреляционной функции равно среднему значению квадрата случайной функции поэтому положительно, т. е. 1 ) = lim R(0) = lim R ( T T 2T R() х(t) и T x(t ) x(t ) dt = x T 2 >0. Эту величину называют дисперсией случайного процесса. 21 3. Корреляционная функцией от , т.е. функция R() является четной R() = R(). 4. Значение корреляционной функции R() при любом может превышать ее начального значения, т. е. не R(0) | R () |. При анализе случайных процессов часто используют понятие нормированной корреляционной функции () = R()/R(0). 22 При рассмотрении связи двух случайных процессов х(t) и y(t) используют взаимную корреляционную функцию Rxy(): 1 Rxy ( ) = lim T 2T T x(t ) y (t + τ)dt . -T (6.8) Взаимная корреляционная функция Rxy() определяет связь различных случайных процессов между собой, т. е. имеется ли между ними статистическая связь. Основные свойства Rxy(): 1. Rxy() = Ryx(), то есть Rxу() не является четной функцией. 2. Rxy() стремится к нулю, когда . 23 Примеры корреляционной функции R() 1. Случайный процесс х(t) – белый шум. Корреляционная функция белого шума равна нулю при всех значениях , кроме = 0, и ее можно представить в виде дельта-функции или практически в виде импульса достаточно малой ширины, площадь которого равна единице ( рисунок а) ). 2. Случайный процесс х(t) содержит постоянную составляющую. Корреляционная функция R() также будет содержать постоянную составляющую ( рисунок б) ). 3. Случайный процесс х(t) содержит периодическую составляющую. Корреляционная функция R() также будет содержать периодическую составляющую, которая имеет тот же период. рисунок в) 24 4. Если стационарный случайный процесс х(t) не имеет постоянной и периодической составляющих. Корреляционная функция R() имеет вид, показанный на рисунке г) . 25 Корреляционные функции случайных сигналов R ( τ) 0 R ( τ) τ 0 а) б) R ( τ) 0 в) 26 τ R ( τ) τ 0 г) τ Если случайный процесс свойством, обладает то корреляционная функция описываться выражением 1 Rxx ( τ) 2T эргодическим сигнала x(t) будет T x(t ) x(t + τ) dt . (6.9) -T На практике корреляционную функцию обычно определяют обработкой экспериментальных данных, представляющих собой запись или реализацию изучаемого случайного процесса на интервале [-T, T]. 27 Спектральная плотность Расчет линейных систем часто проводят, пользуясь преобразованием Фурье и полученными с его помощью частотными характеристиками линейных звеньев. В этом случае вместо корреляционных функций удобнее использовать их преобразования по Фурье спектральную и взаимную спектральную плотности. Спектральная плотность S(), как и корреляционная функция R(), является характеристикой стационарного случайного процесса. Она представляет собой разложение кривой случайного процесса х(t) и связана с корреляционной функцией преобразованием (интегралом) Фурье. 28 Спектральную формуле: плотность сигнала S xx ( ω) = Rxx ( τ) e - Она является четной функцией Для любой частоты Sxx() 0. x(t) определяют jωτ dτ . по (6.10) . Физически величина спектральной плотности для частоты показывает, какая доля мощности случайного процесса приходится на эту частоту. Общая же мощность случайного процесса может быть подсчитана как интеграл его спектральной плотности. 29 Свойство корреляционной функции и спектральной плотности. Из обратного преобразования Фурье следует, что 1 jωτ Rxx ( τ) = Sxx (ω)e dω, 2 π - (6.11) т. е. корреляционная функция и спектральная плотность представляют друг для друга преобразование Фурье, так же как импульсная переходная и передаточная функции системы.!!! 30 Примеры спектральной плотности случайных сигналов 1. Белый шум. Спектральная плотность белого шума представляет собой равномерное распределение энергии по всему спектру частот от 0 до ( рисунок а) ). 2. Случайный процесс содержит постоянную составляющую. Функция спектральной плотности S() имеет импульс в начале координат ( рисунок б)). 3. Случайный процесс содержит гармонический сигнал частоты S(0) . Спектральная плотность имеет пики при частотах 0 и 0 ( рисунок в) ). 4. Если случайный процесс не имеет постоянной и периодической составляющих, то спектральная плотность имеет вид гладкой функции, как показано на рисунке г) . 31 Спектральные плотности случайного сигнала S (ω) S (ω) ω 0 а) б) S (ω) ω0 0 в) 32 ω 0 S (ω) ω0 ω 0 г) ω Преобразование Фурье взаимной корреляционной функции называется взаимной спектральной плотностью: Sxy () = Rxy ( )e j d. (6.12) - Она не является четной функцией частоты и обладает тем свойством, что Sxy() = Syx() . При прохождении случайного сигнала через линейную систему его характеристики изменяются. 33 Формулы связи между характеристиками системы и характеристиками сигнала на ее входе и выходе особенно просты, если пользоваться спектральными плотностями случайных процессов и частотными характеристиками системы. Пусть x(t) и y(t) соответственно случайные процессы на входе и выходе системы с амплитудно-фазовой характеристикой W(j). Тогда Syy() = Sxx()|W(j)|2. 34 (6.13) Среднее значение квадрата сигнала на выходе системы может быть вычислено по формуле 2 1 M [ y (t )] = Sxx () W ( j) d. 2 p - 2 (6.14) Дисперсия входного сигнала x(t) 1 = = D[ x(t )] Rxx (0) Sxx ()d, 2p - (6.15) т. е. равна суммарной мощности случайного процесса. Аналогично определяют и для y(t) . 35 Взаимная спектральная плотность процессов на входе и выходе линейной системы связана со спектральной плотностью процесса на входе и частотной характеристикой системы выражением S yx ( ) = S xx ( )W ( j). (6.16) Взаимная корреляционная функция сигналов на входе и выходе объекта связана с корреляционной функцией входного сигнала и импульсной характеристикой объекта выражением t Ryx (t ) = 36 w(t ) Rxx ( ) d. (6.17) Заключение Уравнения (6.11), (6.12), (6.13) и (6.16), (6.17) служат основой для определения динамических характеристик объекта статистическими методами. 37