Lectures on Probability Theory

реклама

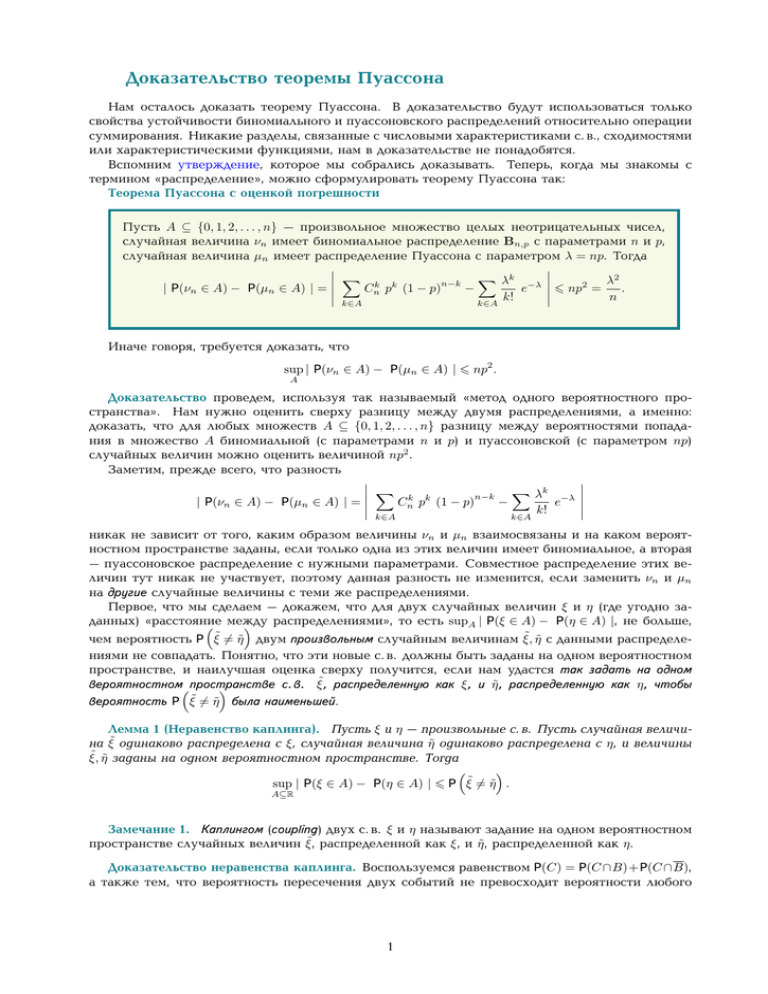

Доказательство теоремы Пуассона

Нам осталось доказать теорему Пуассона. В доказательство будут использоваться только

свойства устойчивости биномиального и пуассоновского распределений относительно операции

суммирования. Никакие разделы, связанные с числовыми характеристиками с. в., сходимостями

или характеристическими функциями, нам в доказательстве не понадобятся.

Вспомним утверждение, которое мы собрались доказывать. Теперь, когда мы знакомы с

термином «распределение», можно сформулировать теорему Пуассона так:

Теорема Пуассона с оценкой погрешности

Пусть A ⊆ {0, 1, 2, . . . , n} — произвольное множество целых неотрицательных чисел,

случайная величина νn имеет биномиальное распределение Bn,p с параметрами n и p,

случайная величина µn имеет распределение Пуассона с параметром λ = np. Тогда

X

X λk

λ2

n−k

k k

−λ Cn p (1 − p)

−

| P(νn ∈ A) − P(µn ∈ A) | = e 6 np2 =

.

k!

n

k∈A

k∈A

Иначе говоря, требуется доказать, что

sup | P(νn ∈ A) − P(µn ∈ A) | 6 np2 .

A

Доказательство проведем, используя так называемый «метод одного вероятностного пространства». Нам нужно оценить сверху разницу между двумя распределениями, а именно:

доказать, что для любых множеств A ⊆ {0, 1, 2, . . . , n} разницу между вероятностями попадания в множество A биномиальной (с параметрами n и p) и пуассоновской (с параметром np)

случайных величин можно оценить величиной np2 .

Заметим, прежде всего, что разность

X

X λk

n−k

Cnk pk (1 − p)

−

e−λ | P(νn ∈ A) − P(µn ∈ A) | = k!

k∈A

k∈A

никак не зависит от того, каким образом величины νn и µn взаимосвязаны и на каком вероятностном пространстве заданы, если только одна из этих величин имеет биномиальное, а вторая

— пуассоновское распределение с нужными параметрами. Совместное распределение этих величин тут никак не участвует, поэтому данная разность не изменится, если заменить νn и µn

на другие случайные величины с теми же распределениями.

Первое, что мы сделаем — докажем, что для двух случайных величин ξ и η (где угодно заданных) «расстояние

распределениями», то есть supA | P(ξ ∈ A) − P(η ∈ A) |, не больше,

между

˜

˜ η̃ с данными распределечем вероятность P ξ 6= η̃ двум произвольным случайным величинам ξ,

ниями не совпадать. Понятно, что эти новые с. в. должны быть заданы на одном вероятностном

пространстве, и наилучшая оценка сверху получится, если нам удастся так задать на одном

˜ распределенную как ξ, и η̃, распределенную как η, чтобы

вероятностномпространстве

с. в. ξ,

˜

вероятность P ξ 6= η̃ была наименьшей.

Лемма 1 (Неравенство каплинга). Пусть ξ и η — произвольные с. в. Пусть случайная величина ξ˜ одинаково распределена с ξ, случайная величина η̃ одинаково распределена с η, и величины

˜ η̃ заданы на одном вероятностном пространстве. Тогда

ξ,

sup | P(ξ ∈ A) − P(η ∈ A) | 6 P ξ˜ 6= η̃ .

A⊆R

Замечание 1. Каплингом (coupling) двух с. в. ξ и η называют задание на одном вероятностном

˜ распределенной как ξ, и η̃, распределенной как η.

пространстве случайных величин ξ,

Доказательство неравенства каплинга. Воспользуемся равенством P(C) = P(C ∩B)+P(C ∩B),

а также тем, что вероятность пересечения двух событий не превосходит вероятности любого

1

из них. Для любого множества A ⊆ R

P(ξ ∈ A) = P ξ˜ ∈ A = P ξ˜ ∈ A, ξ˜ = η̃ + P ξ˜ ∈ A, ξ˜ 6= η̃ =

= P η̃ ∈ A, ξ˜ = η̃ + P ξ˜ ∈ A, ξ˜ 6= η̃ 6

6 P (η̃ ∈ A) + P ξ˜ 6= η̃ = P (η ∈ A) + P ξ˜ 6= η̃ ,

то есть

P(ξ ∈ A) − P (η ∈ A) 6 P ξ˜ =

6 η̃ .

Поменяем местами ξ и η и получим, что для любого множества A ⊆ R

| P(ξ ∈ A) − P(η ∈ A) | 6 P ξ˜ 6= η̃ .

Займемся заданием на одном вероятностном пространстве величин ν̃n и µ̃n , распределенных

как νn и µn , соответственно.

Пусть ξ1 , . . . , ξn — независимые случайные величины, имеющие распределение Бернулли с

параметром p. Тогда их сумма ν̃n = ξ1 +. . .+ξn имеет биномиальное распределение с параметрами

n и p, то есть одинаково распределена с νn .

Пусть η1 , . . . , ηn — независимые случайные величины, имеющие распределение Пуассона

с параметром p. Тогда их сумма µ̃n = η1 + . . . + ηn также имеет распределение Пуассона с

параметром, равным сумме параметров слагаемых, то есть np, и одинаково распределена с µn .

Мы будем считать, что эти наборы с. в. сразу заданы на одном вероятностном пространстве, и

позже построим их.

Тогда, в силу неравенства каплинга,

!

n

n

X

X

ηi .

| P(νn ∈ A) − P(µn ∈ A) | 6 P (ν̃n 6= µ̃n ) = P

ξi 6=

i=1

i=1

Заметим теперь, что если две суммы с неотрицательными слагаемыми не равны друг другу, то

хотя бы одно слагаемое в первой сумме отличается от соответствующего слагаемого в другой

сумме (иначе...). Поэтому

!

!

n

n

n

n

X

X

[

X

| P(νn ∈ A) − P(µn ∈ A) | 6 P

ξi 6=

ηi 6 P

{ξi 6= ηi } 6

P (ξi 6= ηi ) .

(1)

i=1

i=1

i=1

i=1

В последнем неравенстве использовано, что вероятность объединения не превосходит суммы

вероятностей.

Осталось теперь так задать на одном вероятностном пространстве ξi и ηi , чтобы минимизировать P (ξi 6= ηi ).

Пусть множество элементарных исходов Ω есть n-мерный куб, стороны которого — отрезки

[0, 1] на осях координат, вероятность есть просто мера Лебега, заданная на σ-алгебре борелевских множеств.

Вот ровно сейчас тот, кто поленился о них прочитать, должен об этом пожалеть!

То есть мы наудачу выбираем точку ω = (ω1 , . . . , ωn ) в кубе, или, что то же самое, каждую из

координат ωi выбираем наудачу и независимо от других на [0, 1].

Построим для каждого i = 1, . . . , n по ωi случайные величины ξi = ξi (ωi ) и ηi = ηi (ωi ) с нужными распределениями, чтобы они, к тому же, совпадали с большой вероятностью. Положим

(

0, если 0 6 ωi < 1 − p,

ξi (ωi ) =

1, если 1 − p 6 ωi 6 1.

Эта с. в. имеет распределение Бернулли: P(ξi = 0) = P(0 6 ωi < 1 − p) = 1 − p, P(ξi = 1) = P(1 − p 6

ωi 6 1) = p.

Случайная величина ηi должна иметь распределение Пуассона с параметром p, то есть pk =

pk −p

P(ηi = k) =

e при k = 0, 1, 2, . . .. Сумма этих вероятностей равна 1, поэтому можно разбить

k!

тот же самый отрезок [0, 1] на отрезки, длина k-го из которых равна pk при k = 0, 1, 2, . . ., и

2

положить ηi = k, если ωi принадлежит отрезку с номером k:

...

6

3

ηi

2

1

ξi

+

p0

+

p0

если 0 6 ωi < p0 ,

если p0 6 ωi < p0 + p1 ,

если p0 + p1 6 ωi < p0 + p1 + p2 ,

если p0 + . . . +pk−1 6 ωi < p0 + . . . +pk ,

1 ωi

+

p1

p1

p

−

e

=

p0 p

1−

...

0,

1,

2,

ηi (ωi ) =

...

k,

...

-

p2

С очевидностью, получим с. в. с распределением Пуассона:

P(ηi = k) = P(p0 + . . . + pk−1 6 ωi < p0 + . . . + pk−1 + pk ) = pk ,

k = 0, 1, 2, . . . .

6

1@

@

1

e−p

@

−

p

p0 −p

e = e−p . Докажем, что e−p >

Отметим, что p0 =

0!

1 − p при p > 0.

0

@

@

1 @ p

Действительно,

а) при p = 0 значения функций совпадают: e−0 = 1 − 0 = 1;

б) производные в нуле у e−p и 1 − p также совпадают (и равны −1)

в) при p = 1 левая часть больше правой: e−1 > 1 − 1 = 0;

г) функция e−p выпукла (ее производная отрицательна всюду), так что коснувшись однажды

прямой 1 − p, она ее не перекает нигде, оставаясь всегда больше.

Посмотрим, с какой вероятностью с. в. ξi и ηi не совпадают. Это происходит при 1 − p 6

ωi < e−p — на этом интервале ξi = 1, а ηi = 0, а также при ωi > p0 + p1 = e−p + pe−p — на этом

интервале ξi = 1, а ηi > 2. Поэтому

P(ξi 6= ηi ) = P(1 − p 6 ωi < e−p или e−p + pe−p 6 ωi 6 1) =

= e−p − (1 − p) + 1 − e−p + pe−p = p 1 − e−p 6 p2 .

В последнем неравенстве мы снова воспользовались тем, что e−p > 1 − p, или 1 − e−p 6 p.

Итак, при каждом i = 1, . . . , n мы построили пару с. в. ξi , ηi , отличающихся с вероятностью не

более p2 . При разных i эти с. в. независимы, так как построены по независимым координатам

точки, выбранной наудачу в кубе. Окончательно, из неравенства (1) получим:

| P(νn ∈ A) − P(µn ∈ A) | 6

n

X

i=1

3

P (ξi 6= ηi ) 6 np2 .