Коэффициент корреляции

реклама

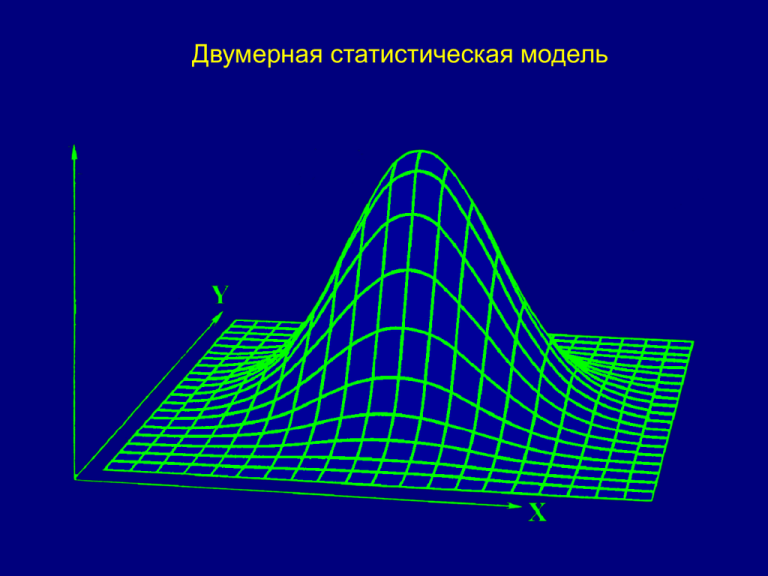

Двумерная статистическая модель

свойство y

свойство x

объект

объект

Двумерная статистическая модель – это

система из n однородных геологических

объектов, у каждого из которых измерены

характеристики двух свойств

( {x1, x2, x3 … xn} {y1, y2, y3 … yn} )

Значения х1, х2, …, хn, и у1, у2, …, уn носят случайный характер.

Значения первого свойства х1, х2, …, хn не зависят между собой,

значения второго свойства у1, у2, …, уn также не зависят между собой

(но могут существовать зависимости между свойствами х и у).

Результаты измерений двумерной случайной величины принято изображать

на графике, где по оси абсцисс откладывают характеристику одного свойства,

а по оси ординат – другого

Hg

Sb

Между двумя случайными величинами проявляются вероятностные (стохастические)

связи, когда заданному значению величины X = x соответствует не определённое

значение величины Y, а некоторый набор значений y1, y2, y3, … yn , каждое из которых

характеризуется своей вероятностью.

Функция распределения набора значений

y1, y2, y3, … yn , соответствующая

значению Х = х , характеризуется

математическим ожиданием и дисперсией,

которые называются

Y

y

условным математическим ожиданием и

условной дисперсией.

x

X

Y

y

x

X

Аналогично, каждому заданному значению величины Y = y

соответствует некоторый набор значений x1, x2, x3, … xn со своим

условным математическим ожиданием и своей условной дисперсией.

Y

линия регрессии X на Y

X

Геометрическое место точек, соответствующих условным математическим ожиданиям Y

(линия, соединяющая эти точки) называется линией регрессии Y на X.

Соответственно геометрическое место точек, соответствующих условным математическим

ожиданиям Х называется линией регрессии X на Y

Если линии регрессии прямые, то регрессия двух величин называется

линейной регрессией, если кривые – нелинейной регрессией.

В прямоугольной системе координат линии регрессии могут быть заданы аналитически.

Для линейной регрессии:

x a2 b2 y

Y

для линейной регрессии Y на Х:

y a1 b1 x

a1 - начальное значение (при х=0)

b1 - угловой коэффициент (тангенс 1 - угла

наклона линии регрессии к оси Х)

для линейной регрессии X на Y:

x a2 b2 y

a2 - начальное значение (при y=0)

a1

1

b2 - угловой коэффициент (тангенс 2 - угла

2

a2

наклона линии регрессии к оси Y)

X

x a2 b2 y

Y

y a1 b1 x

y

Прямые регрессии пересекаются в точке,

координаты которой равны μx и μy –

математическим ожиданиям случайных

величин X и Y.

a1

1

2

x

a2

X

Угол изменяется от 0 до 90º. Чем меньше величина , тем сильнее связь между

величинами X и Y. Если

=0, связь между X и Y становится функциональной.

Уравнения нелинейной регрессии зависят от вида кривой. Например, для

кубического полинома :

Y=11.21-0.67X+0.026X2-0.0004X3

Y

X

Основными числовыми характеристиками двумерного распределения

случайных величин являются показатели их связи:

ковариация (корреляционный момент),

коэффициент корреляции и

корреляционное отношение.

Ковариация cov(x;y) = M[(x-Mx)(y-My)]

представляет собой математическое ожидание произведения отклонений двух

случайных величин (x и y) от их математических ожиданий (Mx,My). Чем

больше ковариация, тем сильнее линейная связь между переменными.

Оценка ковариации по выборке:

Covx , y

1 n

( xi x )( yi y )

n i 1

Коэффициент корреляции

cov( x; y )

x y

cov - ковариация

x y - стандартные отклонения генеральных совокупностей

Оценка по выборке:

cov( x; y )

r

sx s y

s x s.y - выборочные стандартные отклонения

Коэффициент корреляции (полное название – коэффициент линейной корреляции Пирсона)

характеризует силу линейной связи между двумя признаками.

Если оба уравнения регрессии линейные (вида y = a1 + b1x и x = a2 + b2y), то

коэффициент корреляции r b b

1 2

Коэффициент корреляции изменяется от -1 до +1

r = -0.79

P=0.000003

r = -1

r = -0.25

P=0.022

r = -0.52

P=0.0079

r = 0.09

P=0.67

r = 0.54

P=0.0052

r = 0.76

P=0.000004

r = 0.25

P=0.0199

r=1

Значимость выборочного коэффициента корреляции оценивается t-статистикой:

tr

n2

1 r

где r – выборочный коэффициент корреляции; n – объём выборки.

2

или критерием, предложенным Фишером

t

z

где

z

z

1 1 r

ln

arcth(r )

2 1 r

z

1

n3

Когда математическое ожидание выборочного коэффициента корреляции = 0

(т.е. линейная связь между переменными полностью отсутствует),

величина t распределена по закону Стьюдента с n-2 степенями свободы

(нулевая гипотеза H0: r = 0)

При большом объёме выборки (>40) значимый коэффициент корреляции можно рассчитать по

формуле

rзн

t

t2 n

, приняв t =3

Пример оценки значимости коэффициента корреляции r = 0,5:

при n = 10

при n = 20

tрасч.

t0.05

n

tрасч.

t0.05

n

1.633

2.306

10

2.449

2.1

20

1.453

2.265

На величину коэффициента корреляции сильное влияние оказывают

выбросы и неоднородность выборки

ВЫБРОСЫ

r = 0.19

p=0.19

r = 0.62

p=0.0000

Обнаружить выбросы можно построением матричного графика

после удаления выбросов

Неоднородность выборки

R = 0.77

P= 0.0000

R = -0.123

P= 0.081

R = -0.0003

P= 0.996

Условия применения коэффициента корреляции Пирсона.

Рассматриваемые переменные должны быть обязательно получены в

шкале отношений или интервальной шкале

Распределения переменных X и Y должны быть близки к нормальному

Исходная совокупность значений должна быть качественно однородной.

количество варьирующих признаков переменной X должно совпадать с

количеством варьирующих признаков переменной Y

Ранговый коэффициент корреляции.

Если распределение случайных величин существенно отличается от

нормального и его не удаётся преобразовать к нормальному или объём

выборки слишком мал, следует использовать непараметрический аналог –

ранговый коэффициент корреляции.

Наиболее известный из них ранговый коэффициент корреляции Спирмена.

6 d i2

r

n(n 2 1)

где di – разность рангов сопряжённых значений изучаемых величин xi и yi ;

n – количество пар в выборке.

Для проверки значимости рангового коэффициента корреляции Спирмена

используется критическое значение rk, которое рассчитывается по формуле

( p)

rk

n 1

( p) - значение обратной функции нормального распределения при

заданной вероятности p,

n – количество пар в выборке

или таблицы критических значений.

Критические значения рангового коэффициента корреляции Спирмена

n

p

0.05

0.01

5

0.94

-

6

0.85

7

n

p

0.05

0.01

17

0.48

0.62

-

18

0.47

0.78

0.94

19

8

0.72

0.88

9

0.68

10

n

p

0.05

0.01

29

0.37

0.48

0.60

30

0.36

0.47

0.46

0.58

31

0.36

0.46

20

0.45

0.57

32

0.36

0.45

0.83

21

0.44

0.56

33

0.34

0.45

0.64

0.79

22

0.43

0.54

34

0.34

0.44

11

0.61

0.76

23

0.42

0.53

35

0.33

0.43

12

0.58

0.73

24

0.41

0.52

36

0.33

0.43

13

0.56

0.70

25

0.39

0.51

37

0.33

0.43

14

0.54

0.68

26

0.39

0.50

38

0.32

0.41

15

0.52

0.66

27

0.38

0.49

39

0.32

0.41

16

0.50

0.64

28

0.38

0.48

40

0.31

0.40

Ранговый коэффициент корреляции уступает по мощности

параметрическому, но позволяет анализировать выборки малого

размера, нечувствителен к выбросам и форме распределения.

Коэффициенты корреляции Пирсона

с выбросами

без выбросов

Коэффициенты корреляции Спирмена

с выбросами

без выбросов

Ограничения коэффициента ранговой корреляции:

1) по каждой переменной должно быть представлено не менее 5 наблюдений;

2) коэффициент ранговой корреляции Спирмена при большом количестве

одинаковых рангов по одной или обеим сопоставляемым переменным дает

огрубленные значения. В идеале оба коррелируемых ряда должны

представлять собой две последовательности несовпадающих значений.

Коэффициент корреляции (в том числе и ранговый) оценивает степень связи

двух случайных величин только в том случае, если эта связь линейная. Если

подозревается нелинейность связи (характер связи можно оценить по графику

рассеяния), вместо коэффициента корреляции следует использовать

корреляционное отношение.

ssошибки

1

ssобщая

ssобщая ( yi y )2

ssошибки ( yir yi )2

ss м ежгрупповая

ssобщая

- корреляционное отношение

yi - измеренное значение переменной y для объекта с номером i;

yir - предсказанное значение переменной y для объекта с номером i yir f ( xi )

Корреляционное отношение изменяется в интервале [0; +1] и

интерпретируется как доля дисперсии зависимой переменной (y),

объясненная различиями в значениях независимой переменной (x).

Коэффициент корреляции фиксирует только формальную связь между

признаками, но не причинно-следственную.

Коэффициент корреляции (в том числе и ранговый) оценивает степень связи

двух случайных величин только в том случае, если эта связь линейная. Если

подозревается нелинейность связи (характер связи можно оценить по графику

рассеяния), вместо коэффициента корреляции следует использовать

корреляционное отношение.

ss м ежгрупповая(bg )

ssобщая(tot)

k

2

ssbg y j y n j

j 1

2

sstot yij y

k

nj

j 1 i 1

- корреляционное отношение

yij - измеренное значение переменной y для объекта с номером i из группы j;

y j - среднее значение группы j

y - общее среднее значение

k – количество нрупп

Корреляционное отношение изменяется в интервале [0; +1] и

интерпретируется как доля дисперсии зависимой переменной (y),

объясненная различиями в значениях независимой переменной (x).

Коэффициент корреляции фиксирует только

формальную связь между признаками,

но не причинно-следственную.

Регрессионный анализ.

Если для двух величин на основании представительной выборки

доказано наличие корреляционной связи, определён её вид и подобрано

описывающее его уравнение, то создаётся возможность прогноза одной из

случайных величин по значениям другой.

Одна переменная (X) рассматривается, как независимая, а вторая (Y) –

как зависимая от первой и имеющая нормальное распределение с

математическим ожиданием и дисперсией, не зависящими от X.

Регрессионная модель имеет следующий вид:

yi f ( xi ) i

Линейная регрессионная модель

В линейной регрессионной модели

а сама модель имеет следующий вид

f ( xi ) a bxi

yi a bxi i

Уравнение линейной регрессии Y на X

можно рассчитать по формулам:

y yr

sy

sx

(x x)

a

s x , s y - cтандартные отклонения x и y

r

x, y

( yi a bxi )

1

xi yi

n

1

2

xi2 n xi

xi yi

b y ax

- коэффициент корреляции Пирсона

- средние значения x и y

( xi a byi )

Аналогично для линейной регрессии X на Y:

x

x xr

( y y)

y

x y n x y

1

a

i

i

y

i

2

i

1

yi 2

n

i

b x ay

Коэффициенты уравнения регрессии рассчитываются

методом наименьших квадратов (МНК)

Для уравнения Y на Х

Y

y a b x

минимизируются отклонения

по У:

d y min

dx

dy

2

?

Для уравнения X на Y

x a b y

минимизируются отклонения

по X:

X

d

2

x

min

Значимость линейной регрессии проверяется с помощью F-критерия Фишера

отношением дисперсии, «объяснённой» регрессией к дисперсии ошибки.

Вычисления:

Y

i

для каждого наблюдения xi , yi

y a b x

рассчитывается значение y ri

по уравнению yri а bxi

вычисляется ошибка i

i yi yr i

по формуле

yi

рассчитываются суммы квадратов:

y ri

( y y)

ошибки ssd

общая

sst

регрессии

X

xi

2

i

2

i

ssr sst ssr

определяются степени свободы

рассчитываются дисперсии регрессии и ошибки

Схема дисперсионного анализа для оценки значимости линейной регрессии.

Источник изменчивости

Сумма

квадратов

Число степеней

cвободы (df)

Средние квадраты

(дисперсии)

F-критерий

Линейная регрессия

ss r

ssd

sst

1

MSr=SSr/dfr

MSr/MSd

n-2

MSd=SSd/dfd

Отклонение (ошибка)

Общая дисперсия

n-1

Значимость линейной регрессии

Источник изменчивости

Сумма

квадратов

Линейная регрессия

Отклонение (ошибка)

Общая дисперсия

Число степеней

cвободы (df)

Средние квадраты

(дисперсии)

1

MSr=SSr/dfr

n-2

MSd=SSd/dfd

ss r

ssd

sst

F-критерий

MSr/MSd

n-1

Пример таблицы критических значений F-критерия

для уровня значимости 0.05

Число степеней свободы числителя

График плотности вероятности F-распределения

H0: линейная регрессия незначима (регрессия нелинейна)

(дисперсия регрессии не выходит за пределы ошибки)

H0 отвергается, если рассчитанное отношение дисперсии

регрессии к дисперсии ошибки превысит критическое при

данных степенях свободы и выбранном уровне

значимости.

Число степеней свободы знаменателя

0,05

1

2

3

4

5

1

161.45

199.50

215.71

224.58

230.16

2

18.51

19.00

19.16

19.25

19.30

3

10.13

9.55

9.28

9.12

9.01

4

7.71

6.94

6.59

6.39

6.26

5

6.61

5.79

5.41

5.19

5.05

6

5.99

5.14

4.76

4.53

4.39

7

5.59

4.74

4.35

4.12

3.97

8

5.32

4.46

4.07

3.84

3.69

9

5.12

4.26

3.86

3.63

3.48

10

4.96

4.10

3.71

3.48

3.33

11

4.84

3.98

3.59

3.36

3.20

12

4.75

3.89

3.49

3.26

3.11

13

4.67

3.81

3.41

3.18

3.03

14

4.60

3.74

3.34

3.11

2.96

15

4.54

3.68

3.29

3.06

2.90

Значимость коэффициентов линейной регрессии

Помимо значимости регрессии проверяется значимость (отличие от 0)

коэффициентов регрессии:

Н0: a=0

|a|

ta

sa

sy 1 r 2

sa

sx n 2

Н0: b=0

tb

|b|

sb

sb sa sx2 ( x 2 )

количество степеней свободы t-критерия

n-2

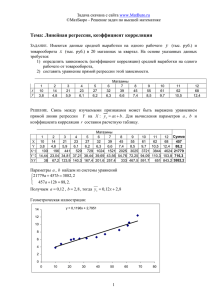

Пример применения регрессионного анализа.

Исходные данные

Задача: определить возможность оценки

содержания Cd по содержанию Zn или Pd

Рассчитываем матрицу парных

корреляций

Выбираем наибольший

Проверяем выборку на однородность

и отсутствие выбросов.

запускаем процедуру множественной регрессии

получаем сводку результатов анализа:

коэффициент корреляции

ss регрессии

ssошибки

R 1

ssобщая

ssобщая

для линейной связи 2-х переменных

равен коэффициенту корреляции Пирсона

коэффициент детерминации

R

2

ss регрессии

ssобщая

характеризует долю дисперссии,

«объяснённую» регрессией

скорректированный коэффициент корреляции:

стандартная ошибка оценки

(стандартное отклонение остатков):

рассчитанное значение F-критерия:

2

Rскоррект

. 1

ssошибки / df ошибки

ssобщая / df общая

2

sошибки ssошибки / df ошибки sошибки

F

ss регрессии / df регрессии

ssошибки / df ошибки

степени свободы числителя и знаменателя F-критерия:

Mss регрессии

Mss ошибки

df регрессии , df ошибки

предельный уровень значимости (вероятность того, что линейной регрессии нет)

свободный член – коэффициент a в уравнении y = a + bx

стандартная ошибка свободного члена

sa s y

x

2

sy

ns x

t-статистика (степени свободы) и соответствующая ей

вероятность для проверки гипотезы о равенстве нулю

свободного члена a в уравнении регрессии

t

ssошибки

df ошибки

sx

ss x

n

a

sa

Бета коэффициент

Бета-коэффициенты являются коэффициентами, которые были бы получены, если бы мы заранее

стандартизовали все переменные, т.е. сделали их среднее равным 0, а стандартное отклонение

равным 1. Одно из преимуществ бета-коэффициентов (по сравнению с в-коэффициентами)

заключается в том, что бета-коэффициенты позволяют сравнить относительные вклады каждой

независимой переменной в предсказание зависимой переменной.

Т.к. у нас одна зависимая переменная, Бета-коэффициент равен коэффициенту корреляции.

Коэффициенты уравнения линейной регрессии:

Cd 0.002930 0.003186 * Zn

y a bx

стандартные ошибки коэффициентов

(позволяют дать интервальную оценку)

sb

t-статистика (степени свободы) и соответствующая ей

вероятность для проверки гипотезы о равенстве нулю

коэффициентов уравнения регрессии

sy

sy

n * sx

ta

b

sa

ssошибки

df ошибки

tb

sx

b

sb

ss x

n

Источник изменчивости

Сумма

квадратов

Линейная регрессия

ss r

ssd

sst

Отклонение (ошибка)

Общая дисперсия

Число степеней

cвободы (df)

Средние квадраты

(дисперсии)

1

MSr=SSr/dfr

n-2

MSd=SSd/dfd

n-1

ssобщая ssрегрессии

(total)

F-критерий

(regress)

+

ssошибки

(deviation)

MSr/MSd

Оценка качества модели.

О качестве модели судят по средней относительной ошибке аппроксимации

1 n | yi yir |

A

*100%

n i 1 | yi |

yi

- наблюдаемое значение

yir

- предсказанное значение

Считается, что ошибка в 4 – 9 %

на контрольной выборке

свидетельствует о хорошем

качестве построенной модели.

Для рассматриваего примера средняя относительная ошибка аппроксимации = 7,54%

следовательно, данное уравнение можно использовать в качестве регрессии.

Cd 0.002930 0.003186 * Zn

Доверительные интервалы для зависимой переменной.

Доверительный интервал для зависимой переменной

при заданном значении независимой переменной x p

( x x p )2

1

t a / 2,n 2 S

n

n

2

(

x

x

)

i

i 1

yp

SSошибки

S

df ошибки

(y y )

i

n2

r

2

Коэффициенты вероятности t распределения Стьюдента

при заданной вероятности и степени свободы k

Вероятность

k

0,10

0,05

0,02

0,01

0,005

0,002

0,001

22

1,717

2,074

2,508

2,819

3,119

3,505

3,792

24

1,711

2,064

2,492

2,797

3,091

3,467

3,745

26

1,706

2,056

2,479

2,779

3,067

3,435

3,707

28

1,701

2,048

2,467

2,763

3,047

3,408

3,674

30

1,697

2,042

2,457

2,750

3,030

3,385

3,646

40

1,684

2,021

2,423

2,704

2,971

3,307

3,551

50

1,676

2,009

2,403

2,678

2,937

3,261

3,496

100

1,660

1,984

2,364

2,626

2,871

3,174

3,390

1,645

1,960

2,326

2,576

2,807

3,090

3,291

Доверительные интервалы для зависимой переменной.

Доверительный интервал для зависимой переменной

при заданном значении независимой переменной x p

( x x p )2

1

t a / 2,n 2 S

n

n

2

(

x

x

)

i

i 1

SSошибки

S

df ошибки

yp

(y y )

i

n2

r

2

Предположения и ограничения линейного регрессионного анализа.

Однородность выборки

Отсутствие выбросов

Линейность связи между переменными

На практике это предположение никогда не может быть подтверждено. Всегда имеет смысл

посмотреть на двумерные диаграммы рассеяния переменных, представляющих интерес. Если

нелинейность связи очевидна, то можно попробовать преобразование переменных

Зависимая переменная должна быть количественной

Независимая переменная должна быть количественной

Наблюдения (и остатки) должны быть независимы друг от друга (проверяется с помощью критерия

Durbin-Watson)

Зависимость между переменными должна быть линейной (проверяется графически путем

построения скаттерограммы)

Остатки должны иметь нормальное распределение (проверяется графически с помощью

гистограмм, квантильных диаграмм, а также с помощью критериев Kolmogorov-Smirnov или

Shapiro-Wilk)

Остатки должны иметь одинаковый разброс на всем протяжении предсказанных значений (или

независимой переменной).

Выборка должна быть репрезентативной

Нелинейное оценивание:

Оценка параметров модели

Дисперсионный анализ