Многомерный регрессионный анализ

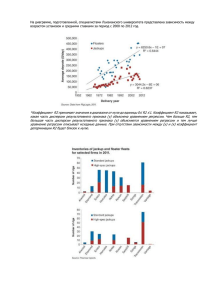

реклама

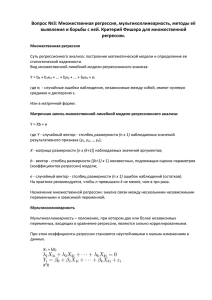

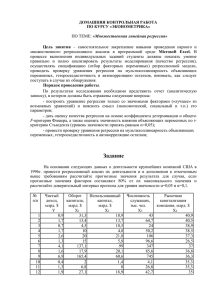

Лекция 7 Многомерный регрессионный анализ Многомерный регрессионный анализ был разработан для прогнозирования экономической активности в различных отраслях экономики (денежные потоки, уровни доходов, банковские ставки, уровень рождаемости, безработицы и т.д.) полезен для прогнозов будущих тенденций и для оценки и корректировки текущей стратегии (оценки настоящего) Многомерная регрессия Для прогноза зависимой переменной используется более одной независимой переменной Признаки хорошей независимой переменной: связанна с зависимой переменной не имеет тесной связи с любой другой независимой переменной Мультиколлинеарность Многомерная регрессия Зависимая переменная – объем продаж молока Независимые переменные: цена за 1 л, расходы на рекламу Многомерная регрессия Корреляционная матрица составляется из коэффициентов корреляции, вычисленных для каждой возможной пары переменных Переменные 1 2 3 r12 = r21 и т. д. r11 = r22 = r33 = 1 1 r11 r21 r31 2 r12 r22 r32 3 r13 r23 r33 Многомерная регрессия Неделя 1 2 3 4 5 6 7 8 9 10 Кол-во молока (тыс. л) 16 20 15 10 12 11 10 5 5 6 1,2 Цена 1 л (руб.) 16 17 18 20 21 23 24 25 26 30 Реклама (руб.) 52 500 73 500 42 000 31 500 35 000 49 000 52 500 17 500 21 000 24 500 1 0,8 0,6 0,4 0,2 0 0 10 25 20 15 10 5 0 0 50 20 30 40 Корреляционная матрица Переменные Продажа Цена Реклама 1 2 3 Продажа 1 1.00 Цена 2 -0.88 1.00 Реклама 3 0.89 -0.67 1.00 Многомерная регрессионная модель Математическое ожидание зависимой величины является линейной функцией всех объясняющих ее переменных Y 0 1 X1 2 X 2 ... k X k Многомерная регрессионная функция генеральной совокупности Многомерная регрессионная модель Статистическая модель многомерной регрессии Y 0 1 X1 2 X 2 ... k X k Метод наименьших квадратов Многомерная регрессионная модель Пример с молоком ^ Y 17.71 0.58 X 1 0.00015 X 2 Интерпретация коэффициентов регрессии b0 – свободный член ^ (значение Y при Х1 и Х2, равных нулю) b1 и b2 – частные или чистые коэффициенты регрессии ^ (среднее изменение Y при единичном изменении соответствующей независимой переменной и постоянных значениях других независимых переменных) Статистический анализ модели многомерной регрессии вычисления проводятся на компьютере SST (Y Y ) ^ SSE (Y Y ) ^ 2 2 SSR ( Y Y ) 2 Статистический анализ модели многомерной регрессии SST df: n-1 = SSR + SSE = k + n-k-1 Стандартная ошибка оценки Стандартная ошибка оценки измеряет отклонение ^ имеющихся данных (Y) от их оценок (Y ) ^ s y* x ' s (Y Y ) 2 SSE MSE n k 1 n k 1 Стандартная ошибка оценки Пример с молоком: • 2 независимые переменные: цена за 1 л и расходы на рекламу стандартная ошибка оценки = 1.42 • 1 независимая переменная: цена 1 л стандартная ошибка оценки = 2.5 Вывод: использование многомерной регрессии позволяет сделать более точный прогноз Значимость регрессии Источник Регрессия Ошибки Общая Сумма квадратов SSR SSE SST Степени свободы k n-k-1 n-1 Среднеквадратичное Отношение F значение MSR=SSR/k F=MSR/MSE MSE=SSE/(n-k-1) Значимость регрессии Гипотезы: H 0 : 1 2 ... k H1 : хоть один j 0 MSR F MSE df=k, n-k-1 H 0 отклоняется, если F F Значимость регрессии Коэффициент детерминации ^ SSR 2 R SST 2 ( Y Y ) 2 ( Y Y ) Многомерный коэффициент корреляции (характеризует корреляцию между зависимой переменной и прогнозом) R R2 Для многомерной регрессии 2 R n k 1 F ( ) 2 1 R k Значимость регрессии Пример с молоком Две независимые переменные SST=SSR+SSE 222=207.86+14.14 R2=0.94 Одна независимая переменная SST=SSR+SSE 222=172.023+49.977 R2=0.77 Отдельные независимые переменные H0 : j 0 Проверочная статистика t t bj sb j df = n-k-1 Прогнозирование будущих значений зависимой переменной Границы интервала прогноза величины Y: ^ Y t / 2 s y x 's Анализ остатков Рычаг – мера влияния i-й точки данных на положение функции регрессии ( X i X )2 1 hii n ( X i X )2 Стандартизированный остаток ei ei sei s y x 's 1 hii Анализ остатков Метки (большие стандартизированные остатки) ei 2 se i Предостережения при прогнозировании • прогнозирование вне допустимого множества • небольшой объем выборки • большое количество независимых переменных • в идеале – 10 наблюдений на одну независимую переменную • вычисление функции регрессии для одной части данных и проверка ее на оставшихся данных • при уровне значимости 0,05 отношение F было хотя бы в 4 раза больше соответствующего критического значения Фиктивные переменные Работник 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 Оценка производительности Y 5 4 3 10 2 7 6 9 9 2 8 6 7 3 6 Данные теста способностей Х1 60 55 35 96 35 81 65 85 99 43 98 91 95 70 85 Пол Х2 0 0 0 0 0 0 0 0 1 1 1 1 1 1 1 Ж Ж Ж Ж Ж Ж Ж Ж М М М М М М М Фиктивные переменные Фиктивные, или индикаторные, переменные используются для определения взаимосвязи между качественными независимыми переменными и зависимой переменной Фиктивные переменные Фиктивные переменные Фиктивные переменные ^ Y 1.96 0.12 X 1 2.18 X 2 0 для женщин Х2 = (фиктивная переменная) 1 для мужчин ^ Y 1.96 0.12 X 1 для женщин ^ Y 4.14 0.12 X 1 для мужчин Применение в менеджменте Маркетинг – вывод нового товара на рынок Агрономы – урожайность Медики – давление крови Менеджеры по персоналу – уровень заработной платы Менеджеры по рекламе – изменение мнения покупателей Руководство компаний – месторасположение розничных магазинов Многомерный регрессионный анализ Мультиколлинеарность Выбор «наилучшего» уравнения регрессии Анализ всех возможных регрессий Пошаговая регрессия Мультиколлинеарность Стоимость дома Год строительства Жилая площадь Кол-во комнат Кол-во продаваемых домов Неточная линейная зависимость – неустойчивость полученных оценок Рассчитанные величины больше ожидаемых Неверный знак отдельных коэффициентов Значимость регрессии по F-тесту при незначимых t-статистиках отдельных коэффициентов Мультиколлинеарность Мультиколлинеарность –линейная зависимость между двумя или более независимыми переменными Степень мультиколлениарности определяется фактором роста дисперсии VIF j 1 , j 1,2,..., k 2 1 Rj R 2j - коэффициент детерминации из регрессии j-й независимой переменной по оставшимся (к-1) независимым переменным VIF близко к 1 – нет проблемы мультиколлинеарности больше 1- оценка коэффициента при этой независимой переменной неустойчива Мультиколлинеарность Стоимость выпуска газеты: тираж, кол-во семей, объем продаж Мультиколлинеарность Мультиколлинеарность При наличии в модели мультиколлинеарности для оценки эффекта одной отдельно взятой независимой переменной можно: 1. Использовать метод, отличный от метода наименьших квадратов 2. Найти и удалить из набора данных одну или более избыточных независимых переменных 3. Представить зависимую переменную Y как линейную комбинацию некоррелирующих между собой независимых переменных Х 4. Тщательно отобрать независимые переменные в начале исследования 5. Создать новые переменные Х посредством масштабирования (нулевое среднее значение и одно и то же выборочное среднеквадратичное отклонение) ~ X ij X ij X j 2 ( X X ) j ij , j 1,2,..., k , i 1,2,..., n Выбор «наилучшего» уравнения регрессии 1. 2. 3. Определение набора возможных независимых переменных Отбор переменных, неадекватных для данному случаю (например, при значительных ошибках измерения; недоступности данных; высокой их стоимости) Сокращение списка независимых переменных (нет «наилучшего» набора переменных, процесс отбора субъективен) Выбор «наилучшего» уравнения регрессии Выбор «наилучшего» уравнения регрессии Выбор «наилучшего» уравнения регрессии 1 шаг – изучение корреляционной матрицы 2 шаг – анализ всех возможных регрессий или пошаговая регрессия Анализ всех возможных регрессий 1этап – все возможные уравнения регрессии ( ) 2 этап – разделение уравнений на множества (по количеству оцениваемых параметров) Анализ всех возможных регрессий Анализ всех возможных регрессий Анализ всех возможных регрессий 3 этап – выбор наилучшей независимой переменной (или переменных) из каждой группы с определенным числом параметров Анализ всех возможных регрессий 4 этап – выбор наилучшего уравнения Желательно иметь наибольшее из возможных значений показателя детерминации, НО максимально простое уравнение регрессии Это уравнение объясняет 89,48% вариации переменной Y Пошаговая регрессия Процедура пошаговой регрессии предусматривает добавление в уравнение отдельных независимых переменных, по одной переменной на каждом этапе 1. Рассматриваются все возможные простые регрессии (наибольшая корреляция с зависимой переменной) 2. Следующая вводимая переменная должна привносить наибольший вклад в регрессионную сумму квадратов (F для включения) 3. Проверка уравнения (проверка на значимость независимой переменной на уровне 5%) , F=4 – критерий для включения или исключения 4. Этапы 2 и 3 повторяются, пока все возможные добавления не окажутся незначимыми, а все возможные удаления – значимыми Результат пошаговой регрессии – регрессионная модель, содержащая только независимые переменные с величинами t, значимыми на указанном уровне Пошаговая регрессия Пример Первая переменная – возраст Вторая переменная – результат теста способностей Тест на тревожность не имеет тесной связи с объемом продаж Потенциально хорошие переменные опыта работы и среднего балла совместно с переменной возраста создают проблему мильтиколлинеарности Упражнения 1. Что измеряет в многомерной регрессии частный или чистый коэффициент? 2. Пусть уравнение регрессии имеет вид: ^ Y 7.52 3 X 1 12.2 X 2 Спрогнозируйте значение У при Х1=20 и Х2=7. Упражнения 3. Объясните каждое из следующих понятий: а) корреляционная матрица б) R2 в) мультиколлинеарность г) остатки д) фиктивная переменная е) пошаговая регрессия