Совместный спектральный радиус матриц: приложения и методы вычисления. В.Ю.Протасов (МГУ)

реклама

В.Ю.Протасов (МГУ)

Совместный спектральный радиус матриц:

приложения и методы вычисления.

A1 , , Am -- линейные операторы в Rd

ˆ ( A1 , , Am ) lim

max

Ad 1 Ad k

1/ k

A2 M

M

k d1 ,..., dk {1,..., m}

Геометрический смысл:

ˆ 1 существует норма

для которой

A1M

в Rd g f

A i 1 при всех i 1, ... , m

Возьмём единичный шар в этой норме:

ˆ 1 существует центрально-симметричное выпуклое тело M R d ,g f

для которого Ai M int M , i 1, ... , m

ˆ inf { 0 | 1 A1 ,

, 1 Am сжатия в некоторой норме}

Геометрический смысл JSR

x

Пусть m 2. Предположим, что семейство A1, A2 неприводимо.

x R dd

произвольная точка ,

Ok ( x) { Ad1

Adk x , d j 1, 2,

max

|u|

A1 x

x 0,

j 1,

A2 x

, k } - орбита точки x.

O1 ( x) , O2 ( x) , O3 ( x) , ...

| u Ok

ˆ k

Приложения:

1960

1988-90

1991

1989-92

Rota, Strang (теория нормированных алгебр)

Барабанов, Козякин (динамическе системы с переключениями)

Daubechies, Lagarias, Cohen, Heil, …. (теория всплесков)

Micchelli, Prautzsch, Dyn, Dahmen, … (уточняющие схемы – теория приближений и

дизайн кривых и поверхностей)

Распределение случайных рядов (теория вероятностей),

Асимптотика бинарной функции разбиения Эйлера (комбинаторика, теория чисел),

Емкость кодов, оценка числа неперекрывающихся слов, теория графов, ....

Основные свойства

m 1. Для одного оператора ˆ (A) = (A) = lim

k

Ak

1/ k

max | j |

j 1,..., d

Если операторы A1 ,... , Am коммутируют, либо их матрицы симметричны,

либо их матрицы -- верхне (нижне) треугольные, то

ˆ ( A1 ,..., Am ) max ( A1 ) ,..., ( Am )

В общем случае, однако ˆ ( A1 ,..., Am ) max ( A1 ) ,..., ( Am )

Всплески с компактным носителем

{ j ,k } j ,kZ полная ортонормированная система (ПОНС) в L2 (R),

j ,k ( x) 2 j / 2 (2 j x k )

Пример 1. Система Хаара (Haar, 1909), ( x)

[0, 1/ 2] [1/ 2, 1]

1, 1

А.Хаар (1909), В.А. Котельников (1933), К.Э.Шеннон (1949),.

1,0

1, 1

1980-90: С.Малла, И.Мейер, И.Добеши, Ч.Чуи, А.Коэн, В.Дамен, и др.

I.Daubechies (1988) – всплески с компактным носителем.

Преимущества всплесков:

Локализация (компактные носители),

Быстрые алгоритмы вычисления коэффициентов,

Характеризация функциональных пространств

..

.

Обработка сигналов

Теория функций, теория приближений

f ( x)

k, j Z

c j,k ( f ,

Диф. Уравнения (Вейвлет-Галёркин метод, и др.)

j,k

c j,k

)

j,k

( x) ,

f ( x)

j,k

( x) d x

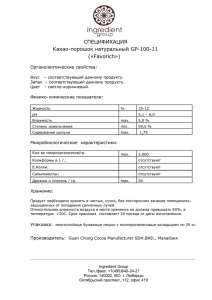

Построение всплесков. Масштабирующие уравнения.

Для построения системы всплесков с компактным носителем нужно решить

масштабирующие уравнение (refinement equation)

– разностное функциональное уравнение со сжатием аргумента.

N

c

( x)

k 0

c0 ,

, cN

k

(2 x k ) ,

- последовательность комплексных коэффициентов.

cN (2 x N )

( x)

c0 (2 x)

c1 (2 x 1)

.......

Это – обычное разностное уравнение, но с двоичным сжатием аргумента.

Когда мастабирующая функция найдена, всплеск-функция

явно выписывается:

( x)

N

k 0

(1) k ck 1 (2 x k ),

где c0 , ... , cN - коффициенты масштабирующего уравнения.

Примеры систем всплесков

1. Всплески Хаара (1909)

Масштабирующее уравнение:

( x) (2 x) (2 x 1)

1

1

1

1

0

0

1

1

2. Всплески Шеннона-Котельникова

( x)

sin x

x

( x)

(1933, 1949)

sin 2 x sin x

x

Носитель некомпактен!

3. Всплески Мейера (1986), Всплески Баттла-Лемарье (1987) Носитель некомпактен!

4. Всплески Добеши (1988)

( x)

2

Второй всплеск Добеши. Масштабирующее уравнение:

1 3

3 3

3 3

1 3

(2 x)

(2 x 1)

(2 x 2)

(2 x 3)

4

4

4

4

2

0

3

3

0

Что известно о масштабирующих уравнениях ?

( x)

N

c

k 0

k

(2 x k ) ,

( x) d x

Если есть решение с компактным носителем, и

N

Обратно, если

c

k 0

k

0

N

то

c

k 0

k

2

2 , то есть решение с компактным носителем. Оно единственно

с точностью о домножения на константу и сосредоточено на отрезке [0, N].

( x)

Но только в обобщённых функциях из

S '(R )

0

ˆ ( )

m( / 2) ˆ ( / 2) ,

ˆ ( )

N

1 N

m( )

c k e 2 i k

2 k 0

m (2

j

)

j 1

Масштабирующая функция не бывает бесконечно-гладкой

C N (R)

Примеры масштабирующих уравнений

Примеры 1. c0 c1 1

Тривиально:

( x) (2 x) (2 x 1)

Пример 2.

Пример 3.

c0

c0

0

1

1

, c1 1 , c 2

2

2

1

3

3

1

, c1 , c 2 , c 3

4

4

4

4

0

1

2

0

3

Решение неустойчиво !

Малые изменения коэффициентов могут приводить к резким изменениям решения:

Пример 4.

c0

1

2

1

Tо же с примером c 0

4

c1 1

3

c1

4

c2

1

2

c2

3

4

чисто сингулярно.

c3

1

4

чисто сингулярно.

Cavaretta, Dahmen and Micchelli (1991)

Описание всех масштабирующих сплайнов с целыми узлами.

Lawton, Lee and Sсhen (1995)

Описание всех масштабирующих сплайнов.

Для любого N существует конечное число масштабирующих сплайнов порядка N

Berg and Plonka (2000), Hirn (2008)

Cклассификация всех кусочно-гладких масштабирующих функций.

Теорема (П. 2005). Если существует 0 для которого гладкость

масштабирующей функции на интервале (0, ) превосходит ее

гладкость на R , то -- масштабирующий сплайн с целыми узлами.

Все кусочно-гладкие масштабирующие функции -- сплайны.

Все они – линейные комбинации целых сдвигов B-сплайна.

“ Типичная ” масштабирующая функция и всплеск-функция

Пример 5

( x)

1

2

1

2

(2 x) (2 x 1) (2 x 2) (2 x 3)

3

3

3

3

( x) log 2 3 1.58...

(максимальная гладкость)

( x)

( x) log 2 1.5 0.58...

(минимальная гладкость)

0

sup 0 |

(изломы во всех двоичнорациональных точках)

3

| ( x h) ( x) | C h for all x, h

показатель гладкости (показатель Гельдера)

log 2 1.5 0.58...

Непрерывна, но не дифференцируема

Тем не менее, она дифференцируема почти всюду

( x) sup 0 |

| ( x h) ( x ) | C h

Локальная гладкость в точке x

Почти во всех точках ( x) log 2 2.25 1.17...

Следовательно, '( x) 0 п.в.

Фрактальная природа всплесков. Переменная локальная гладкость.

Как определить, будет ли масштабирующая функция непрерывной ?

I.Daubechies, D.Lagarias, 1991

C (R) ˆ (T0 , T1 ) 1

A.Cavaretta, W.Dahmen, C.Micchelli, 1991

Более того,

log 2 ˆ (T0 , T1 )

C.Heil, D.Strang, 1994

ˆ ( A0 , A1 ) lim

k

1/ k

max

Ad 1

d1 , , dk

Ad k

Пример.

N 4, c0 , c1 , c2 , c3 , c4

c0

c2

T0

c4

T0 , T1 - N N матрицы (2-блочные тёплицевы матрицы),

0

(T ) c

i

jk

2 j k 1i

c1

c

T1 3

0

0

0

0

c1

c3

0

c0

c2

c4

c0

c2

0

c1

c4

0

c3

0

0

0

c1

c3

0

c0

c2

c4

Если только масштабирцующая функция ( x) -- не сплайн,

она имеет переменную локальную гладкость.

( x)

0

Гладкость почти всюду

min log 2 ˆ

0 log 2 0

Минимальная

локальная гладкость

max log 2

Максимальная

локальная гладкость

1/ k

Совместный спектральный радиус

ˆ ( A0 , A1 ) lim

max

Ad 1

Ad k

Нижний спектральный радиус

( A0 , A1 ) lim

min

Ad 1

Ad k

Показатель Ляпунова

k d1 ,..., dk {0,1}

1/ k

k d1 ,..., dk {0,1}

0 ( A0 , A1 ) lim

Ad 1

k

d1 ,...,dk {0,1}

Ad k

1/ k

1/ 2k

Теорема. Для любого x [0,1] имеем ( x) [ min , max ] .

Для каждого [ min , max ] локальная гладкость = ( x) достигается

на всюду плотном множестве точек x [0,1] .

Для почти всех x [0,1] имеем

( x) 0 log 2 0 .

N

Как вычислить или оценить JSR ?

Перебором ( по определению) Daubechies, Lagarias, Heil, Strang,

Эспоненциальная сложность. Heil, Strang (1994) для вычисления JSR специальных 2 2-матриц

с относительной погрешностью = 0.05 перебрали все произведения до длины k 19.

G.Gripenberg (1996) - ``branch and bound'' алгоритм.

Разумный перебор. Часто очень эфективен. Но теоретически плох.

Сходимость к величине JSR при растущем к чрезвычайно медленная.

Причина медленной сходимости:

1/ k

max

d1 ,..., d k {1,..., m}

Ad 1

Ad k

ˆ ,

k

Выбранная норма в R d d может быть слишком далека

от той, в которой все операторы - сжимающие.

C

, где константа C - отношение двух норм.

k

Она может быть очень велика.

Скорость сходимости

Отрицательные результаты о сложности задачи вычисления JSR:

Blondel, Tsitsiclis (1997-2000).

Задача приближённого вычисления JSR для рациональных матриц NP-сложна.

Задача определения: верно ли, что JSR строго меньше 1

(для рациональных неотрицательных матриц) алгоритмически неразрешима,

начиная с размерноти d = 47.

1

Не существует алгоритма, полиномиального по размерности d и по точности

для приближения JSR с относительной погрешностью

Тем не менее, существуют алгоритмы, полиномиальные

1

(по отдельности) по d и по

(увидим).

Инвариантные нормы

Теорема 1 (Н. Барабанов, 1988)

a) Для неприводимого семейства операторов A1 ,..., Am существует 0

и норма

max

, для которой при любом x R d

A 1 x , ... , A m x

= x

b) Для любой такой нормы имеем ˆ ( A1 ,..., Am ).

Независимо был установлен ‘’двойственный’’ факт:

A 2M

Теорема 2 (A.Дранишников, С.Конягин, В.Протасов, 1996)

M

a) Для неприводимого семейства операторов A1 ,..., Am существует 0

A1M

и симметричное выпуклое тело M (инвариантное тело) такое, что

def

A M Conv ( A1 M ,..., Am M ) M

b) Для любого такого тела ˆ ( A1 ,..., Am ).

def

A M Conv ( A1 M ,..., Am M )

Двойственность: M = B* (поляра к B), где B - единичный шар в Барабановской норме

для сопряженных операторов A1* ,..., Am* (F.Wirth, E.Plishke, 2005)

Пример 1. Матрицы де Рама.

0

1 2

A1

A2

(0, 0.5)

;

,

0

1

2

При 0.25 имеем ˆ = (A1 ) max{ 1 2 , }.

1

При 0.25 имеем ˆ = (A1 A2 ) 4 72 .

2

При всех имеем инвариантный шестиугольник М().

Y

M ()

X

Пример 2. 2n 2n матрицы A1 , A2 функции разбиения Эйлера (теория чисел).

Они состоят из 0 и 1.

Для них ˆ

( A0 A1) при нечетных n, и ˆ ( A1 ) при четных n.

Инвариантная норма строится для всех n 13.

Пример 3. Проблема ёмкости двоиных кодов, избегающих данных запрещенных разностей.

Для любого набора запрещённых разностей ёмкость равна JSR двух 0-1 матриц размерности d 2m1.

При малых m инвариантная норма явно строится и находится значение ёмкости.

Алгоритм приближения инвариантной нормы многогранниками

Qk APk

Берем произвольный начальный многогранник P0 R d

(1 )Qk

центрально-симметричный относительно нуля,

последовательность {Pk } определяется индуктивно:

Pk

Qk 1 A Pk Conv ( A1 , A 2 ). Многогранник Pk 1 приближает Qk 1

A1 Pk

Am Pk

Pk 1

с относительной погрешностью : (1 ) Qk 1 Pk 1 Qk 1

и содержит не более N Cd (1 d ) / 2 вершин.

Pk 2

Если положить Pk 1 A Pk , то многогранник Pm может иметь до 2m вершин,

и сложность будет экспоненциальной.

Не нужно хранить все вершины Pm , можно приближать, Pm Qm .

После С0

1

итераций получим нужное приближение

Общее число операций

Для d=2 число операций:

При

0.0001

( diam Pm )1/ m ˆ

C ( d , A0 , A1 ) ( d 1) / 2

C 3/ 2

требуется

106 операций.

Для d =2 алгоритм был запрограммирован И.Шейпаком в 1998.

При d > 2 непонятно как практически реализовывать

Оценка JSR с помощью тензорных произведений матриц

Протасов (1997),

Zhow (1998),

Blondel, Nesterov (2005)

Алгоритм - полиномиальный по размерности d. Даёт грубые оценки на ˆ.

Lp - спектраьный радиус ( p -радиус),

p [1, ]

k

p ( A1 ,..., Am ) lim m Ad 1

k

d1 , , d k

Определен в 1995 независимо: Y.Wang (p = 1),

1/ pm

p

Adm

ˆ

,

R.Q.Jia (для всех p)

p ˆ m1/ p p

Для любого p имеем:

Для целых четных p 2r значение p вычисляется как обычное собственное значение

матрицы

1

A=

m

m

A

k 1

2r

k

2 r ( A1 ,..., Am )

( A)

1/ 2 r

.

Через A B обозначено тензорное (кронекеровское) пр-е матриц A, B - матрица размера d 2

Для любого r имеем:

Матрица Ak

2r

1/ 2r ( A) ˆ m1/ 2r 1/ 2r ( A)

имеет размерность d

2r

1

матрица A =

m

m

A

k 1

2r

k

имеет размерность d 2 r .

Величина 1/ 2 r ( A) даёт приближени JSR с погрешностью m1/ 2 r 1

ln m

2r

1 m 2

(A), где A = Ak приближает ˆ с = 2 1 41%

m k 1

Пример 1. Для двух d d матриц величина

Размерность матрицы A равна d 2 (можно понизить до d 2 / 2 )

Пример 2. Для двух d d матриц величина

4

1 m 4

(A), где A = Ak приближает ˆ с = 4 2 1 19%

m k 1

Размерность матрицы A равна d 4 (можно понизить до

d 4 / 24)

Идея доказательства. p-инвариантные нормы.

N N (R d ) множество всех норм в R d . N выпуклый невырожденный точечный конус.

Для еприводимого семейства матриц A1 , ... , Am и для p [1, +] рассмотрим оператор

1/ p

1 m

F : N N,

F ( | . | )[u ] | Am u | p , u R d

m j 1

Для любой нормы | . | N функционал F ( | . | ) также норма.

F(N)

f

f

1

| A1u | ... | Amu |

m

F ( | . | )[u ] max | A1u | , ... , | Amu |

Примеры. p =1.

p = .

F ( | . | )[u ]

N

При p = 2 оператор F сохраняет евклидовы нормы (единичный шар - эллипсоид).

Теорема. Для неприводимого семейства { A1 , ... , Am } и любого p [1, ] оператор F

имеет ''собственный вектор'': существует норма | . | N и > 0 , для которых

F ( | . | )[u ] | u | ,

u Rd .

Для любой такой нормы ''собственное значение'' равно p ( A1 , ... , Am ).

F(N2r)

f

f

Следствие. При p 2r (r - целое)

F имеет инвариантный конус

1/ 2 r

2r

N 2 r x (a j , x)

существует инвариантная норма f N 2 r ,

j

соответствующая вектору Перрона-Фробениуса оператора F .

На конусе N 2 r

1

оператор F задаётся матрицей A =

m

2 r ( A1 ,..., Am )

( A)

1/ 2 r

.

m

A

k 1

2r

k

N2r

Алгоритм вычисления JSR поиском лучшей нормы

в определенном семействе норм.

Идея: мы не можем найти инвариантную норму. Тогда приблизим её с помощью

норм из определеннго конечномерного класса.

(стандартный трюк в теории приближений)

(V.Blondel, Yu.Nesterov, J.Theys, 2005)

(V.Protasov, R.Jungers, and V.Blondel, 2010)

Рассмотрим сначала случай неотрицательных матриц

Возьмём класс ``прямоугольных'' норм u

rk

x

max

i 1,...,d

ui

,

xi

u >0.

d

x

min

многогранник с mk гранями

x

subject to:

x 0

Ax

rk x 0 ,

Rd

A Ad 1

Теорема. Для любого k имеем

Ad k

d 1/ k rk

1/ k

ˆ rk

1/ k

Случай произвольных матриц

Берём все ``эллипсоидные'' нормы u

X

( Xu, u), где X - положительно-определённая матрица.

Решаем следующую задачу полуопределённого программирования

с одним (матричным) неизвестным X и mk ограничениями.

X

rk

min

subject to:

X

0

AT X A rk X

0 ,

A Ad 1

Ad k

X

Общая задача полуопределённого программирования:

l0 ( X 1 ,..., X q ) min

X 1 ,..., X q

0

ls ( X 1 ,..., X q ) 0 ,

s 1,..., N

Эффективно решается методом внутренней точки. ЛП-задачи – частный случай.

Теорема. Для любого k имеем

d 1/(2 k ) rk

1/(2 k )

ˆ rk

1/(2 k )

Доказать больше иногда легче.

Джордж Пойа «Математика и правдоподобные рассуждения» (1954)

Если не получается что-то доказать, можно попробовать доказать больше.

Если не получается хорошо приблизить JSR, можно попробовать …

вычислить его точно.

Понятие экстремальной нормы

Определение. Норма

.

является экстремальной, если

Aj

ˆ , j 1,..., m .

Для экстремальной нормы сходимость осуществляется в один шаг:

1/ k

max

d1 ,..., d k {1,..., m}

Ad 1

Ad k

ˆ ,

k

Если M - единичный шар экстремальной нормы, то A j M ˆ M ,

A2 M

A1M

M

j 1,..., m.

Как построить экстремальную норму ?

Пусть m =2. Нормируем матрицы так, чтобы ˆ ( A1 , A2 ) 1

v

( x )

x R dd произвольная точка , x 0,

Ok ( x) { Ad1 Adk x , d j 1, 2, j 1, , k }

( x )

{ y R dd ,

x

{k j } jN , xk j Om j ( x) , lim xk j x}

j

A1 x

- множество частичных пределов (точек накопления) орбиты.

Пусть M ( x) Conv (( x), ( x)); тогда ( x) непусто,

dim M ( x) d и

A1 ( x)

A2 ( x)

(свойство самоподобия A1 K

O1 ( x) , O2 ( x) ,O3 ( x) ,

( x)

A2 K

K)

A2 x

, O( x)

Будем строить единичный шар экстремальной нормы в качестве многогранника M .

Оказывается, что такая норма существует для большинства семейств матриц.

Наблюдение 1. Для приводимого семейства задача вычисления JSR сводится к

Нескольким аналогичным задачам в меньших размерностях. Таким образом,

предполагаем, что семейство неприводимо.

Наблюдение 2. Если произведение П максимальное, то его максимальный

собственный вектор v должен быть крайней точкой множества M.

Если M – многогранник, то v -- его вершина.

Итак, максимальные собственные векторы произведения П и всех его циклических

перестановок -- вершины M.

Qv

Наблюдение 3. Критерий остановки:

Лемма. Пусть ( ) = 1 и

v

v* - максимальный

собственный вектор * . Если существует другое

произведение Q, для которого (v*, Qv) > (v*, v),

то - не максимальное.

v

Qv

Алгоритм точного вычисления JSR (Н.Гуглиелми, В.Протасов, 2011)

Берем максимальный собственный вектор v1 of Ad1

Полагаем v j Ad k j2

j 2,

Adk v1 ,

vk

, k.

…..

Ad 2

Ad1

v1

Adk .

Adk

Adk 2

v2

v3

Ad k 1

vs A j v 1

v p Ai v q

‘’Мертвые’’ ветви

Каждый раз проверяем, будет ли новая точка принадлежать выпуклой оболочке

предыдущих точек (ЛП задача).

Алгоритм завершается, когда не появилось ни одной новой вершины.

Инвариантный многогранник M – выпуклая оболочка всех точек, построенных алгоритмом

Для каждой очередной вершины применяем критерий остановки:

Пусть v*j -- максимальный собственный вектор циклической перестановки *j

такой, что (v*j , v j ) = 1, j 1, ..., k. Тогда:

не является максимальным

Для некоторого j {1, ..., m} и некоторой вершины vs имеем |(v*j , vs ) | 1.

*

k

v

v3*

…..

vk

v1

v1*

*

2

v

v2

v3

vs A j v r

v p Ai v q

Для каждой новой вершины vs все произведения | (v*j , vs ) | , j 1, ... , k ,

не должны превосходить 1. Иначе, -- не максимальный

Пример 1. Задача о плотности единиц в ромбе Паскаля:

(S.Finch, P.Sebah, and Z.-Q.Bai, 2008)

Плотность единиц в ромбе Паскаля порядка n -- между C nlog2 ( A1 , A2 ) и

C nlog2 ˆ ( A1 , A2 ) , где

Известно, что ˆ ( A1 , A2 ) = 2.

Относительно ( A1 , A2 ), выдвинута гипотеза, что он равен

1+ 5

= 1.6180...

2

На самом деле,

( A1 , A2 ) A13 A23

(алгоритм работает несколько секунд)

1/ 6

1.6376...

Выбираем A13 A23

Инвариантный многогранник M1 имеет 8 вершин.

Пример 2. Асимптотика бинарной функции разбиения Эйлера.

Бинарная функция разбиения Эйлера bd (k ) -- это количество разложений

k d0 21 d1 22 d2

2m1 dm1 ,

где d j {0,1,

, d 1}

Как мы знаем, b2 (k ) 1. Для d 3 нужно оценить рост bd (k ) при k .

b2 (k )

1

(L.Euler, 1728)

b3 (k ) s(k 1) (Stern, 1858)

b4 (k )

k / 2 1

(Klosinsky, Alexanderson, Hillman, 1984)

Какова асимптотика величины bd (k ) при k ?

L.Euler (1728), A.Tanturri (1918), K.Mahler (1940), N.de Bruijn (1948)

L.Carlitz (1965), D.Knuth (1966), R.Churchhouse (1969), B.Reznick (1990)

Ответ:

b2 r (k ) C k , где log 2 r

(B.Reznick, 1990)

C k 1

b2 r 1 (k ) C k 2 , где

1 log 2 ( A1 , A2 ), 2 log 2 ˆ ( A1 , A2 ) (V.Protasov, 2000)

A1 , A2 это (d 1) (d 1) матрицы из нулей и единиц:

1, если 2 2k j i d 1

( Ai ) j k

0, иначе.

1

0

A1

0

0

1 1 0

1 1 0

1 1 1

0 1 1

Пример. При d = 5 :

1

1

A2

0

0

Алгоритм вычисляет точные значения для d 100.

Оказывается, что для всех d имеем

либо ˆ

( A 1 A2 ) , ( A1 ) , либо:

( A 1 A2 ) , ˆ ( A1 )

Для размерности 50 программа работает 5 минут,

для размерности 100 -- около 20 минут

1 0 0

1 1 0

1 1 0

1 1 1

Функция разбиения Эйлера для троичного разложения:

Выбираем A1 A3

Экстремальный многогранник M3 имеет 16 вершин.

Пример 3. Асимптотика числа слов двоичного алфавита без перекрытий.

Задача сводится к вычислению JSR и LSR двух 20x20-матриц.

2 (Blerk, 1988) , 2.226 (Kobayashi, 1988)

ˆ 2.584 Этот результат последовательно улучшался: 2.226 ˆ 2.584

Kforu (1988), Kobayashi (1988), Cassaigne (1993), Lepisto (1995)

( A1 A210 )

1/11

2.41756...

;

ˆ ( A1 A2 )

Программа работает 8 минут

1/ 2

2.51793...

Вычисление JSR для случайных пар матриц

Вычисление JSR и LSR для случайных пар булевских матриц размерности d = 100.

Условия конечной сходимости алгоритма

Определение. Произведение Adk

Ad1 называется доминирующим, если ( )=1,

и существует q 1 такое, что () < q для всех остальных произведений Adn

не являющихся степенями , или степенями его циклических перестановок.

доминирующее

максимальное

Теорема 1. Алгоритм сходится за конечное время тогда и только тогда

когда произведение доминирующее.

Ad1 ,

Спасибо!