Медицинская статистика №5 Лукьянова Е.А. Специальность «Фармация»

реклама

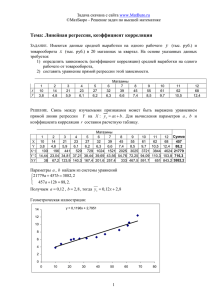

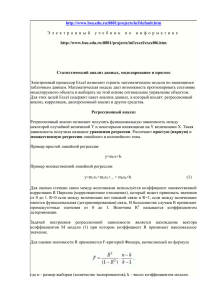

Лукьянова Е.А. Медицинская статистика Специальность «Фармация» №5 Регрессионный анализ Корреляционный анализ Анализ сопряженных признаков 2011 Виды признаков независимые (факторные) - изменяются независимо от других признаков . зависимые (результативные) - признаки, величины которых обусловлены изменением факторных признаков. Один и тот же признак при различной постановке задачи может быть либо факторным либо результативным. Сводная классификация связей Связь По характеру По направлению Функциональная Прямая Статистическая Обратная По кол-ву факторов Однофакторная Многофакторная По аналитическому выражению Линейные Нелинейные Характер связи формы зависимости функциональная статистическая При функциональной зависимости каждому конкретному значению одной величины будет соответствовать определенное значение другой величины. Например, при фиксированной скорости пройденный путь линейно зависит от времени движения При статистической зависимости каждому значению одного признака может соответствовать некоторое количество значений другого признака, варьирующих в определенных пределах. Например, каждому значению роста соответствуют различные значения веса. Количество факторных признаков Связь Однофакторная Многофакторная При классификации взаимосвязей учитывается также число факторных признаков, оказывающих влияние на результативный признак. Если исследуется влияние одного факторного признака, то речь идет об однофакторной связи. Если многих, то - о многофакторной. Направление связи По направлению Прямая Обратная •Если направления факторного и результативного признаков совпадают, то говорят о наличии прямой связи температура тела и скорость движения элементарных частиц •Если направления не совпадают, то связь обратная доза антибиотика - число микробных клеток Аналитическое выражение Аналитическое выражение Линейные Нелинейные При линейной связи зависимость между факторными и результативным признаком описывается уравнением прямой: y=b0+b1x При нелинейной – могут быть использованы модели: гипербола y=k/x парабола y=ax2 + by + c мультипликативная экспоненциальная обратная y b1 x ye y n b0 b1 x 1 b0 b1x Связь переменных Взаимосвязь между: 1.Количественными признаками 1.1. Регрессионный анализ 1.2. Корреляционный анализ 2. Качественными признаками 2.1. Анализ сопряженных признаков Регрессионный анализ Регрессия (regression) – зависимость среднего значения какой-либо случайной величины от некоторой другой величины или от нескольких величин Случайная величина, выполняющая роль независимой переменной в регрессионной модели называется регрессионной переменной или ( регрессором ) Выбор функции (модели), как правило, определяется теоретическими соображениями, а также по распределению экспериментальных значений (x,y) на диаграмме рассеяния. Наиболее важным является случай, когда регрессия является линейной. Линейная регрессия Пусть в ходе исследования были получены следующие пары наблюдений: При нанесении этих результатов на двумерную плоскость координат, получаем диаграмму рассеивания (облако точек).. Как описать такое рассеивание? Пульс Диаграмма рассеяния 160 140 120 100 80 60 40 20 0 35 36 37 38 39 Температура 40 41 Регрессионный анализ – раздел математической статистики, объединяющий практические методы исследования регрессионной зависимости между величинами по статистическим данным Регрессионный анализ решает следующие основные задачи •Выбор модели регрессии; •Оценка параметров выбранной модели методом наименьших квадратов; •Проверка статистических гипотез Регрессионный анализ Регрессионный анализ имеет две основные функции: 1) аналитическая (выявляет характер взаимосвязи) 2) предикторная (позволяет делать прогнозы) Уравнение регрессии () – уравнение, определяющее в терминах условного математического ожидания функцию, с помощью которой осуществляется прогноз значения одного случайного вектора по наблюденному значению другого случайного вектора. Линейная регрессия При обследовании n объектов измерили два параметра и получили набор из n пар значений (xi,yi). Общая задача состоит в подгонке прямой линии к этому набору точек. Уравнение прямой линии имеет вид: Y=b0 +b1X. В зависимости от параметров b0 и b1 эти точки можно описать различными прямыми линиями. Таким образом, задача сводится к подбору наилучших коэффициентов b0 и b1. Метод наименьших квадратов (МНК) Наилучшие оценки коэффициентов b0 и b1 дает МНК Xi X Yi Y b1 2 Xi X b0 y b1 x b1 - коэффициент регрессии; b0 - свободный член уравнения регрессии Y y b1 ( x x ) Направление регрессии Регрессия может быть: прямой (b1>0) обратной (b1<0). Прямая регрессия означает, что при росте одного параметра, значения другого параметра тоже увеличиваются. А обратная, что при росте одного параметра, значения другого параметра уменьшаются. Проверка гипотезы о значимости коэффициента регрессии b1 1. 2. 3. Определим гипотезы H0 и H1: • H0: b1 = 0 (между переменными нет линейной зависимости); • H1: b1 0. Зададим уровень значимости . Статистика критерия F 2 b1 n (xi x ) 2 i1 2 s имеет распределение Фишера с 1 и (n–2) степенями свободы. n (yi y ) 2 2 s i1 n2 n xi x i1 n n yi y i1 n 4. Критические точки и критическая область область F>F,1,n–2. 5. Если F>F,1,n–2, то H 0 отвергается, т.е можно сделать вывод, что линейная зависимость – значима. Если F<F,1,n–2, то у нас нет оснований отвергать H0 , т.е можно сделать вывод, что линейная зависимость – незначима или что наши данные нельзя описать моделью линейной регрессии. Корреляционный анализ Корреляционный анализ Как показано выше, облако точек можно описать двумя линиями регрессии – регрессией X на Y и Y на X. Чем меньше угол между этими прямыми, тем сильнее зависимость между параметрами. Корреляция – зависимость между случайными величинами, не имеющая строго функциональной зависимости. Коэффициент корреляции – числовая характеристика совместного распределения двух случайных величин, выражающая их взаимосвязь. Если случайные величины независимы, то коэффициент корреляции равен нулю (о величинах говорят, что они не коррелированы). Если величины связаны полной функциональной зависимостью, то коэффициент корреляции по модулю равен единице. Корреляционный анализ статистических данных состоит из: Вычисление коэффициентов корреляции Поверка статистической гипотезы о значимости связи Коэффициент корреляции r n (x x )(y y ) i i1 i n n 2 (x x ) * (y y ) 2 i1 i i1 i –1 r +1, Характер и сила связи Характер и сила связи определяются с помощью коэффициента корреляции r. Сила связи Характер связи прямая (+) обратная (-) Полная 1 –1 Сильная [0,7 ; 1) (– 1; –0,7] Средняя (0,3;0,7) (–0,7;– 0,3) Слабая (0; 0,3] [–0,3; 0) Связь отсутствует 0 0 Ранговая корреляция Ранг наблюдения – это тот номер, который получит наблюдение в совокупности всех данных – после их упорядочения по определенному правилу (например, от меньших величин к большим). Процедура перехода от совокупности наблюдений к последовательности их рангов называется ранжированием. Результат ранжирования называют ранжировкой. Ранжирование •Данные выстраиваются в порядке возрастания (или убывания) •Далее им присваивают ранги. •Если отдельные показатели ряда встречаются несколько раз, то каждому из них присваивают одинаковый ранг, равный среднему рангу. Порядковы й номер 1 2 3 4 5 6 7 8 9 Данные 20 21 22 22 23 24 24 24 25 Ранги 1 2 3,5 3,5 5 7 7 7 9 Коэффициент ранговой корреляции Спирмена 6 d 2 1 s 2 nn 1 6 – постоянный коэффициент, d – разность рангов, n –число наблюдений (объем выборки). Проверка гипотезы о значимости коэффициента корреляции 1. Определим гипотезы H0 и H1: Н0: r = 0 (т.е. нет значимой корреляции), H1: r 0. 2. 3. Зададим уровень значимости . r t Статистика критерия 1 r 2 n2 ts s 2 1 s n2 имеет распределение Стьюдента с (n–2) степенями свободы. 4. 5. При |t| t(n–2), гипотеза Н0 отвергается с уровнем значимости . Это значит, что между параметрами существует значимая корреляция. При |t| t(n–2), у нас нет оснований отвергать Н0, т.е. можно утверждать, что между параметрами нет значимой корреляции. Анализ качественных признаков Существует признаки и явления, измерение которых затруднено или невозможно (профессия, вид патологии, образование, диагноз). Цель проведения качественного анализа состоит в определении наличия связи между качественными признаками • • • • влияет ли метод лечения на исход заболевания; влияет ли цвет глаз на генетические нарушения; вид вскармливания на развитие ребенка; пол на курение. Наличие связи между признаками подразумевает, что признаки зависят друг от друга, т.е. являются сопряженными. Алгоритм проведения анализа сопряженных признаков 0. Формулировка целей и задач исследования 1. Построение таблицы наблюдаемых частот 2. Построение таблицы ожидаемых частот 3. Построение таблицы разности частот 4. Проверка статистической гипотезы о значимости разности частот 5. Формулировка вывода о наличии связи между признаками 1. Построение таблицы наблюдаемых частот Пусть имеется два качественных признака: А (пол) и В (курение). Признак А имеет а уровней градаций /2: муж, жен/, Признак В – в уровней / 3: курит, бросил, не курил/. Общее количество наблюдений составляет n. Каждый объект выборки обладает двумя признаками: и А, и В, причем эти признаки могут принимать любые из допустимых значений. (одна единица наблюдения: пол = мужчина, курение = курит, другая единица: пол = женщина, курение = бросила, и т.д.). Таким образом, после сбора первичного материала можно построить таблицу наблюдаемых частот: Таблица наблюдаемых частот Пол Мужской Женский Кур. Курит Бросил(а) Не курил(а) Всего 2. Построение таблицы ожидаемых частот Ожидаемые частоты вычисляются по формуле, полученной из предположения, что признаки не связаны между собой. Признаки А и В называют независимыми, если для всех пар i, j оказываются независимыми события: «признак А принимает значение Аi» и «признак В принимает значение Вj» p(Ai B j ) p(Ai ) p(B j ) Таким образом, ожидаемые частоты подсчитываются по формуле: n. j n nij ni. n.. s n i. n i1 n i2 ... n is ij r j 1 n. j nij n1 j n2 j ... nrj i1 r s r j 1 частота появления события Вj s n.. n i. n. j n ij i1 частота события Аi i1 j 1 общее число наблюдений 3. Построение таблицы разности частот •В ячейки таблицы разности выносят значения разности между соответствующими ячейками таблиц наблюдаемых и ожидаемых частот. •Цель создания таблицы разности - оценить, насколько различаются значения частот в первых двух таблицах. •Если частоты будут отличаться «слишком» сильно, то следовательно предположение, исходя из которого была построена таблица ожидаемых частот, неверно. •Таким образом необходимо статистически проверить, насколько сильно различаются таблицы. 4. Проверка статистической гипотезы о значимости разности частот 1. Формулировка гипотез H0: Признаки не сопряжены . H1: Признаки сопряжены. 2. Определение уровня значимости (=0,05) 3. Критерий Пирсона-Фишера r s 2 i 1 j 1 n ij nij nij 2 сумма берется по всем ячейкам таблицы сопряженности. 2 стремится к распределению хи-квадрат с (r–1)(s–1) степенями свободы. (r-количество уровней признака A, s-количество уровней признака B ) Для зависимых A и B 2 неограниченно возрастает при увеличении n. Поэтому большие для хи-квадрат значения указывают на взаимную зависимость. 4. Сравнение результатов, формулировка выводов H0: отвергается при значениях критерия, которые превосходят критические значения хи-квадрат, соответствующие выбранному уровню значимости. Регрессия (regression) – зависимость среднего значения какой-либо случайной величины от некоторой другой величины или от нескольких величин Можно определить две регрессии Y на x и X на y Наиболее важным является случай, когда регрессия является линейной. Параболическая регрессия степени m y b0 b1 x ... bm x m Коэффициент регрессии – коэффициент при независимой переменной в уравнени регрессии Уравнение регрессии () – уравнение, определяющее в терминах условного математического ожидания функцию, с помощью которой осуществляется прогноз значения одного случайного вектора по наблюденному значению другого случайного вектора. Функция регрессии – зависимость математического ожидания случайной величины Y от значений некоторой (детермированной) величины. Регрессионный анализ – раздел математической статистики, объединяющий практические медоды исследования регрессионной зависимости между величинами по статистическим данным Регрессионный анализ решает следующие основные задачи •Выбор модели регрессии; •Оценка параметров выбранной модели методом наименьших квадратов; •Проверка статистических гипотез Выбор функции (модели), как правило, определяется теоретическими соображениями, а также по распределению экспериментальных значений (x,y) на диаграмме рассеяния. Регрессионная переменная, регрессор – случайная величина, выполняющая роль независимой переменной в регрессионной модели Корреляция – зависимость между случайными величинами, не имеющая строго функциональной зависимости. Коэффициент корреляции – числовая характеристика совместного распределения двух случайных величин, выражающая их взаимосвязь. Если случайные величины независимы, то коэффициент корреляции равен нулю (о величинах говорят, что они не коррелированы). Если величины связаны полной функциональной зависимостью, то коэффициент корреляции по модулю равен единице. Корреляционный анализ статистических данных состоит из: Вычисление коэффициентов корреляции Поверка статистической гипотезы о значимости связи