НОВАЯ МАТЕМАТИЧЕСКАЯ МОДЕЛЬ ЛИНЕЙНОЙ РЕГРЕССИИ МЕЖДУ

реклама

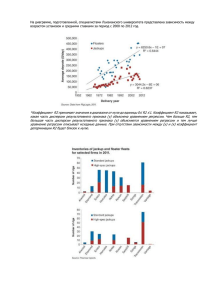

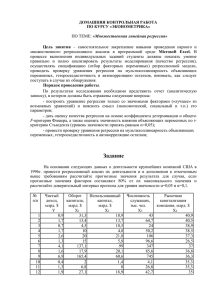

НОВАЯ МАТЕМАТИЧЕСКАЯ МОДЕЛЬ ЛИНЕЙНОЙ РЕГРЕССИИ МЕЖДУ ДВУМЯ ФИЗИЧЕСКИМИ ВЕЛИЧИНАМИ С УЧЕТОМ ИХ СЛУЧАЙНЫХ ПОГРЕШНОСТЕЙ Н.Н. Щелканов Институт оптики атмосферы им. В.Е.Зуева СО РАН, Томск NEW MATHEMATICAL MODEL OF LINEAR REGRESSION BETWEEN TWO PHYSICAL PARAMETERS IN VIEW OF THEIR RANDOM ERRORS N.N. Shchelkanov V.E.Zuev Institute of Atmospheric Optics SB RAS, Tomsk A generalized equation is presented for determination of the regression coefficients of the linear equation Y = K0 + K1 X in the general case, when the point spread in the correlation between X and Y is caused both by random measurement errors and by uncontrollable physical factors. All the known equations for the regression coefficients appeared to be particular cases of the equation obtained. Введение При работе с разными массивами данных часто возникает необходимость нахождения коэффициентов линейной регрессии между двумя случайными физическими величинами. В большинстве случаев коэффициенты регрессии имеют конкретный физический смысл и для корректной интерпретации полученных результатов очень важно найти их значения наилучшим образом. Существует несколько формул для нахождения коэффициентов регрессии [1-3], но не для всех есть общее понимание, в каких случаях их следует использовать. В настоящее время отсутствует единый подход к нахождению коэффициентов линейной регрессии для общего случая, т.е. когда разброс точек в корреляционной связи между двумя величинами обусловлен как их случайными погрешностями измерений, так и неконтролируемыми физическими факторами. Цель настоящей работы заключается в том, чтобы представить обобщенную формулу для вычисления коэффициентов линейной регрессии. Постановка задачи Рассмотрим две случайные физические величины X0 и Y0, между которыми существует статистическая корреляционная связь. Предположим, что эта связь может быть описана линейной зависимостью Y0 = K0 + K1 X0, (1) а требуется найти коэффициенты регрессии K0 и K1, которые наилучшим образом отражают физическую взаимосвязь между ними. Так как X0 и Y0 измеряются со случайными погрешностями, то на практике мы имеем дело с величинами X и Y, для которых уравнение регрессии запишется в виде Y = K0 + K1 X. (2) Запись уравнений (1) и (2) с одинаковыми коэффициентами регрессии говорит о том, что последние не должны зависеть от случайных погрешностей измеренных величин X и Y. В дальнейшем будем говорить о нахождении только коэффициента регрессии K1, так как K0 вычисляется после нахождения K1 по известной формуле K 0 Y K1 X , где X и Y – средние значения X и Y. (3) Новый подход Новый подход к нахождению коэффициента регрессии K1 заключается в следующих двух моментах: 1. Предлагается случайные величины X и Y нормировать соответственно на значения 2X 2X и 2Y 2Y . Здесь X и Y – случайные среднеквадратические погрешности 0 0 измерения X и Y для рассматриваемого массива данных; X0 и Y0 – некоторые величины, характеризующие разброс точек в корреляционной связи физических величин X0 и Y0 за счет неконтролируемых физических параметров. 2. При нахождении коэффициента регрессии K1 используется ортогональная среднеквадратическая регрессия, т.е. минимизируется сумма квадратов отклонений перпендикулярных искомой прямой. Тогда уравнение линейной регрессии запишется в виде Y X (4) K 0 K1 2Y 2Y 2X 2X 0 0 Здесь величины X0 и Y0 находятся из решения системы двух уравнений. Первое уравнение имеет вид X 0 Y0 X 0 Y0 2X 2X 2Y 2Y , 0 0 0 0 (5) где X 0 2X 2X и Y0 2Y 2Y – среднеквадратические отклонения величин X0 и Y0; X и Y – среднеквадратические отклонения величин X и Y; X0Y0 – коэффициент корреляции между X0 и Y0. Коэффициент корреляции X0Y0 находится из известного уравнения [1]: XY X Y =X0Y0 X0 Y0, (6) где XY – коэффициент корреляции между X и Y. Заметим, что из уравнения (6) следует уравнение (5). Второе уравнение запишем в виде X0 Y0 (7) X0 Y0 и назовем условием пропорциональности величин X0, Y0 и X0, Y0. Введение величин X0, Y0 и запись условия (7) являются ключевыми моментами в данной работе, так как это позволило получить обобщенное решение для коэффициентов линейной регрессии уравнения (2). Результаты После решения системы уравнений (5) и (7) получим 2X X 0 X 1 2 X 1 2Y Y0 Y 1 2 Y 1 С учетом (8) и (9) найдем значения , 1 2X 2X 1 2Y 2Y (8) . 1 2X 2X 1 2Y 2Y (9) XY 2X 2X и 0 XY 2Y 2Y в следующем виде: 0 2X 2X X A , 0 (10) 2Y 2Y Y B , 0 (11) где 2 1 2X 2X , A 1 X 0 Y0 (1 X ) 1 XY 2X 1 2Y 2Y B 1 X 0 Y0 (1 2Y 1 2Y 2Y . ) 1 XY 2Y 1 2X 2X С учетом (10) и (11) уравнение линейной регрессии (4) запишется в виде Y X K 0 K1 . Y B X A Уравнение (14) легко привести к виду (2): B Y K 0 Y B K1 Y X K 0 K1 X , X A где (12) (13) (14) (15) K 0 K 0 A Y B , (16) B K1 K1 Y . X A (17) Применяя ортогональную среднеквадратическую регрессию к уравнению (14) и используя соотношение (17), получим выражение для искомого коэффициента регрессии: 2 Y B 1 A B A B 2 (18) K1 4 XY , X A 2 XY B A B A где А и В определяются выражениями (12) и (13). Впервые формула (18) была представлена в [4], а подробно описана в [5]. Анализ Выражение (18) позволяет устанавливать однозначную связь между величинами X и Y и определять условия использования известных типов линейной регрессии. Покажем, что все известные аналитические выражения для коэффициента регрессии K1 уравнения (2) являются частными случаями формулы (18). 4.1. Так, для случая, когда разброс точек в корреляционной связи X и Y обусловлен только их случайными погрешностями, т.е. X0Y0 = 1, получим известное выражение для коэффициента регрессии K1, приведенное в [1]: 2 Y X X Y Y 1 Y X X Y 2 4 XY . (19) K1 X 2 XY X Y Y X X Y Y X 4.1.1. При X0Y0 = 1, X = 0 и Y 0, имеем 2 Y X Y 1 Y X X Y Y X X Y 2 1 4 XY . K1 lim x 0 X 2 XY X Y Y X X Y Y X X Y Разлагая выражение под квадратным корнем в ряд Маклорена [6] и оставляя первые два члена, получим 2 Y X Y Y 1 Y X X Y Y X X Y 2 1 2 XY K1 lim XY . x 0 X 2 XY X Y Y X X Y Y X X X Y (20) Это известная формула для коэффициента K1 уравнения прямой регрессии Y = K0 + K1 X, которая находится путем минимизации суммы квадратов отклонений вдоль оси Y от искомой прямой [2]. 4.1.2. При X0Y0 = 1, Y = 0 и X 0, имеем 2 X Y Y 1 Y X X Y Y X X Y 2 1 4 XY . K1 lim Y 0 X 2 XY X Y Y X X Y Y X Y X Проведя процедуру разложения выражения под квадратным корнем в ряд Маклорена [6] и оставляя первые два члена, получим Y 1 Y0 X 2 XY K1 lim 2 1 . Y X X Y Y X X Y 1 2 2XY X Y Y Y X X Y Y X X XY Y X X Y (21) Формула (21) – также известная формула для коэффициента 1/ K1 уравнения обратной регрессии X K 0 K1 Y , которая получается путем минимизации суммы квадратов отклонений вдоль оси X от искомой прямой [2]. 4.1.3. При X0Y0 = 1 и X = Y 0 получим известную формулу 2 Y X 1 Y X 2 4 XY (22) K1 2 XY X Y X Y для коэффициента K1 уравнения ортогональной регрессии Y = K0 + K1 X, которая находится путем минимизации суммы квадратов отклонений, перпендикулярных искомой прямой [3]. 4.2. Если для массива данных выполняется соотношение X Y , то из выражения X Y (18) вытекает простая формула для коэффициента регрессии K1 Y . (23) X Так как соотношение X Y выполняется для большинства экспериментальных X Y данных, то формулу (23) можно рекомендовать к использованию при отсутствии информации о величинах случайных погрешностей X и Y. Заметим, что формула (23) представляет собой среднее геометрическое формул (20) и (21). Диапазон изменчивости коэффициента регрессии Для случая, когда разброс точек в корреляционной связи величин X и Y обусловлен только их случайными погрешностями, т.е. X0Y0 = 1, коэффициент регрессии будет изменяться в следующих пределах: Y 1 , (24) XY K1 Y X X XY а при X0Y0 < 1 Y 1 XY K1 Y . (25) X X XY Как видно из выражений (24), (25), коэффициенты для прямой и обратной регрессий принимают соответственно минимальное и максимальное значения. Заключение Кратко сформулируем основные результаты. 1. Получена обобщенная формула, позволяющая находить коэффициенты регрессии линейного уравнения Y = K0 + K1 X для общего случая, когда разброс точек в корреляционной связи случайных величин X и Y обусловлен как их случайными погрешностями измерений, так и неконтролируемыми физическими факторами. 2. Все известные выражения для коэффициентов регрессии являются частными случаями полученной формулы. Определены условия использования известных выражений. Обобщенная формула позволяет получать устойчивые, достоверные и физическикорректные коэффициенты регрессии. Формула представляет интерес для специалистов, занимающихся обработкой разных массивов данных, и может быть использовано для их корректной физической интерпретации, независимо от области знания. Список литературы 1. Кендалл М., Стьюарт А. Статистические выводы и связи. М.: Наука. Т.2. 1973. 900 с. 2. Зайдель А.Н. Погрешности измерений физических величин. Л.: Наука. 1985. 112 с. 3. Крамер Г. Математические методы статистики. М.: Мир. 1975. 648 с. 4. Щелканов Н.Н. Построение регрессионной зависимости между аэрозольными оптическими толщами атмосферы с учетом их случайных погрешностей // II Заседание Рабочей группы проекта «Аэрозоли Сибири». Тезисы докладов. Томск. Изд. ИОА СО РАН. 1995. С.16. 5. Щелканов Н.Н. Обобщенный метод построения линейной регрессии и его применение для построения однопараметрических моделей аэрозольного ослабления // Оптика атмосферы и океана. 2005. Т.18. №1-2. С.86-90. 6. Кудрявцев В.А., Демидович Б.П. Краткий курс высшей математики. М.: Наука. 1975. 624с.