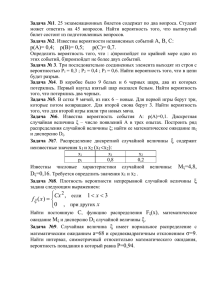

Теория вероятностей и математическая статистика (дневное)

реклама