Министерство образования и науки Российской Федерации

Федеральное государственное бюджетное образовательное

учреждение высшего профессионального образования

«Алтайский государственный технический университет

им. И. И. Ползунова»

В. П. Зайцев

ТЕОРИЯ ВЕРОЯТНОСТЕЙ И

МАТЕМАТИЧЕСКАЯ СТАТИСТИКА

Учебное пособие

Рекомендовано Алтайским техническим университетом

им. И. И. Ползунова в качестве учебного пособия для студентов

АлтГТУ, обучающихся по направлениям и специальностям

в области техники и технологии

Изд-во АлтГТУ

Барнаул 2014

УДК 51(075.8)

Зайцев, В. П. Теория вероятностей и математическая

статистика : учебное пособие / В. П. Зайцев. Барнаул : Изд-во

АлтГТУ, 2014. 268 с.

ISBN 978-5-7568-1047-9

Пособие предназначено для студентов инженерных и

экономических направлений и специальностей всех форм

обучения, изучающих курс теории вероятностей с элементами

математической статистики.

Книга содержит лекционный материал с большим числом

примеров, контрольные вопросы, задачи с решениями,

упражнения для проведения практических занятий и

самостоятельной работы. Для всех упражнений приводятся

ответы. Включены задания двух контрольных работ (по 25

вариантов).

Рекомендовано Алтайским техническим университетом

им. И. И. Ползунова в качестве учебного пособия для студентов

АлтГТУ, обучающихся по направлениям и специальностям в

области техники и технологии. Протокол № 6 НМС АлтГТУ от

20 марта 2013 г.

Рецензент: А. С. Киркинский, к.ф.-м.н., профессор

кафедры «Высшая математика», АлтГТУ.

ISBN 978-5-7568-1047-9

© Зайцев В. П., 2014

© Алтайский государственный технический университет

им. И. И. Ползунова, 2014

СОДЕРЖАНИЕ

Предисловие ............................................................................. 6

1 Случайные события

1.1 Множество элементарных исходов. Понятие случайного

события ..............................................................................7

1.2 Операции над событиями ................................................ 9

1.3 Определения вероятности события.................................12

1.3.1 Статистическое определение вероятности ................12

1.3.2 Классическое определение вероятности ....................13

1.3.3 Геометрические вероятности .....................................14

1.3.4 Аксиоматическое определение вероятности..............15

1.4 Применение комбинаторики к подсчёту вероятностей ..18

1.4.1 Общие вопросы ..........................................................18

1.4.2 Схема выбора без повторений ...................................19

1.4.3 Схема выбора с повторениями ..................................21

1.5 Условные вероятности. Независимость событий ...........24

1.6 Формула полной вероятности и формула Байеса...........30

1.7 Схема Бернулли...............................................................34

1.7.1 Формула Бернулли .....................................................34

1.7.2 Приближённые формулы в схеме Бернулли .............37

1.8 Контрольные вопросы .....................................................42

1.9 Задачи ..............................................................................44

1.9.1 Задачи с решениями...................................................44

1.9.2 Упражнения для самостоятельного решения ............58

1.9.3 Ответы к упражнениям ..............................................64

2 Случайные величины

2.1 Понятие случайной величины. Функция распределения 66

2.2 Дискретные случайные величины ..................................69

2.3 Непрерывные случайные величины................................71

2.4 Числовые характеристики случайной величины.............74

2.4.1 Математическое ожидание ........................................75

2.4.2 Дисперсия...................................................................76

2.5 Примеры распределений случайных величин.................79

3

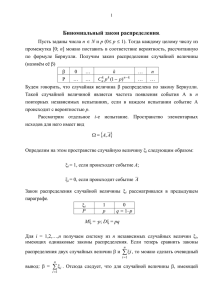

2.5.1 Биномиальное распределение.....................................79

2.5.2 Распределение Пуассона .............................................81

2.5.3 Геометрическое распределение...................................82

2.5.4 Гипергеометрическое распределение..........................83

2.5.5 Равномерное распределение .......................................85

2.5.6 Показательное распределение.....................................88

2.5.7 Нормальное распределение.........................................90

2.6 Функция от случайной величины ....................................93

2.7 Система случайных величин............................................96

2.7.1 Функция распределения.............................................97

2.7.2 Дискретная двумерная случайная величина .............98

2.7.3 Независимость случайных величин ........................102

2.7.4 Корреляционная зависимость..................................103

2.8 Предельные теоремы ......................................................109

2.8.1 Закон больших чисел ................................................109

2.8.2 Центральная предельная теорема .............................115

2.9 Однородные цепи Маркова............................................117

2.9.1 Определение и способ задания цепи Маркова .........117

2.9.2 Нахождение вероятностей перехода за несколько

шагов.........................................................................121

2.9.3 Предельные вероятности...........................................123

2.10 Контрольные вопросы .................................................126

2.11 Задачи ..........................................................................128

2.11.1 Задачи с решениями...............................................128

2.11.2 Упражнения для самостоятельного решения ........149

2.11.3 Ответы к упражнениям ..........................................156

3 Математическая статистика

3.1 Выборка и способы её записи ........................................159

3.1.1 Генеральная и выборочная совокупности ................159

3.1.2 Способы записи и графическое представление

выборки.....................................................................161

3.1.3 Распределение 2 k и распределение Стъюдента.168

3.2 Статистическое оценивание...........................................170

3.2.1 Точечные оценки......................................................170

3.2.2 Интервальные оценки ..............................................176

4

3.3 Проверка статистических гипотез.................................181

3.3.1 Основные понятия ...................................................181

3.3.2 Проверка некоторых параметрических гипотез ......185

3.3.3 Критерий согласия 2 (критерий Пирсона)............. 190

3.4 Статистическое описание результатов наблюдения

двумерной случайной величины ....................................195

3.5 Понятие о регрессии.......................................................202

3.5.1 Определение регрессии .............................................202

3.5.2 Метод наименьших квадратов. Линейная регрессия203

3.6 Контрольные вопросы ...................................................206

3.7 Задачи ............................................................................207

3.7.1 Задачи с решениями................................................207

3.7.2 Упражнения для самостоятельного решения .........219

3.7.3 Ответы к упражнениям ...........................................225

4 Приложения

4.1 Контрольная работа по теме «Теория вероятностей»....227

4.2 Контрольная работа по теме «Математическая

статистика».....................................................................244

4.2.1 Содержание и варианты задания .............................244

4.2.2 Образец выполнения контрольной работы ..............254

4.3 Таблицы..........................................................................264

Список рекомендуемой литературы...................................268

5

ПРЕДИСЛОВИЕ

Теория вероятностей и математическая статистика отличается от других разделов математики большим своеобразием.

Исходными понятиями теории вероятностей являются понятия

случайного события и вероятности случайного события. Долгое

время подход к этим понятиям основывался только на интуитивных соображениях. Аксиоматический подход построения

теории вероятностей, предложенный советским математиком

А. Н. Колмогоровым (1903 1987) в книге «Основные понятия

теории вероятностей», сделал теорию вероятностей математической наукой.

При написании пособия автор старался дать изложение основных разделов теории вероятностей и математической статистики, основанное на обычном курсе математики технического

вуза. Книга состоит из четырёх разделов.

В первом разделе вводятся важнейшие понятия теории вероятностей: множество элементарных исходов в опыте, случайные события и операции над ними, вероятность события (статистическое, классическое, геометрическое), формулируются основные аксиомы теории вероятностей и следствия из них. Рассматривается понятие условной вероятности, зависимости и

независимости событий, схема Бернулли.

Второй раздел посвящён случайным величинам. Приводятся наиболее важные примеры распределений дискретных и непрерывных случайных величин. Изучаются системы случайных

величин, предельные теоремы, однородные цепи Маркова.

В третьем разделе излагаются основные понятия математической статистики: выборочный метод, статистическое оценивание, проверка статистических гипотез, регрессия.

Четвёртый раздел содержит задания контрольной работы по

теме «Теория вероятностей» и контрольной работы по теме

«Математическая статистика» с образцом решения. Приведены

используемые таблицы.

Пособие может быть использовано как учебник, так и как

задачник (приведено 132 примера с решениями и 108 упражнений для самостоятельной работы, ответы к ним указаны).

6

1 СЛУЧАЙНЫЕ СОБЫТИЯ

1.1 Множество элементарных исходов. Понятие

случайного события

На практике часто встречаются такие ситуации, когда результаты проводимого опыта (наблюдения, испытания) нельзя

заранее точно предсказать. Например, в опыте – подбрасывание

монеты, невозможно заранее сказать, что мы увидим на верхней

стороне упавшей монеты: герб или цифру. На исход этого опыта

влияет большое число факторов: начальное положение монеты в

момент броска, начальная скорость, сопротивление воздуха,

особенности поверхности, на которую падает монета и т.д. В

дальнейшем будут рассматриваться только такие опыты, которые можно повторять (воспроизводить) произвольное число раз

(хотя бы теоретически). При этом нас будет интересовать только, какие случайные исходы в опыте могут наблюдаться и что в

результате проведённого опыта действительно наблюдалось.

Отправным пунктом является понятие множества элементарных исходов (будем обозначать ), связанного с данным опытом. Под этим понимают множество всех возможных

взаимоисключающих исходов опыта. Любое подмножество A

множества элементарных исходов интерпретируется как случайное событие. При этом, событие A произошло в опыте (наступило, осуществилось), если результатом этого опыта явился

элементарный исход, принадлежащий A.

Событие, совпадающее с пустым множеством , называется невозможным событием, а событие, совпадающее со всем

множеством , – достоверным событием.

Множество в общем случае может быть дискретным или

непрерывным.

К

первым

относятся

конечные

( , 2 , ..., n ) или счётные ( , 2 , ..., n , ... )

множества элементарных исходов, ко вторым – непрерывные

множества (например, любой конечный или бесконечный интервал на числовой прямой).

Для описания реальной задачи множество выбирается

7

наиболее подходящим образом. Главное, чтобы все наблюдаемые события данного опыта могли быть однозначно описаны на

основе построенного множества . Другими словами, если нас

интересуют наблюдаемые события A, B, C, … в опыте, то

должно состоять из таких исходов, чтобы существовали подмножества, равносильные событиям A, B, C, … .

Рассмотрим ряд примеров, поясняющих выбор .

Пример 1.1. Пусть опыт состоит в подбрасывании один раз

игральной кости (однородного кубика, грани которого помечены

числами от 1 до 6). Требуется описать множество элементарных

исходов и указать состав подмножеств, соответствующих

следующим событиям:

A = {выпало число кратное трём}, B = {выпало чётное число},

C = {выпало число не менее четырёх}, D = {выпало число 0},

E = {выпало положительное число}, F = {выпало число меньше

двух}.

Решение. В качестве множества всех элементарных исходов

можно взять 1, 2, ..., 6 . Все перечисленные события могут

быть описаны как его подмножества. Действительно,

A 3, 6 , B 2, 4 , 6 , C 4 , 5 , 6 ,

D , E 1, 2, ..., 6 , F 1 .

Пример 1.2. Опыт: монета бросается до первого появления

герба. Описать множество элементарных исходов и события

A = {герб впервые появился при третьем бросании монеты},

B = {будет сделано не больше трёх бросаний}.

Решение. Каждый исход опыта можно описать так: n n ,

имея ввиду, что герб появился 1-й раз при n-м бросании. Тогда

= {1, 2, … , n, …}, A = {3}, B = {1, 2, 3}.

Если обозначить n ЦЦ ...Ц Г – исход, заключающийся в

n 1 раз

том, что герб впервые появится при n-м бросании монеты (буква

Ц означает появление цифры, буква Г – появление герба), то

= {1, 2 , … , n , …}, A = {ЦЦГ}, B = {Г, ЦГ, ЦЦГ}.

8

Пример 1.3 (задача о встрече). Два человека M. и N. условились встретиться в определённом месте в интервале времени

[0, T]. Записать множество элементарных исходов и его подмножество, соответствующее случайному событию A = {встреча

произойдёт}, считая, что каждый ожидает другого время, не

больше, чем , где 0 < < T.

Решение. Элементарным исходом опыY

та можно считать пару чисел (x, y), где x –

T

время прихода M., а y – время прихода N.

Тогда

x , y : 0 x T , 0 y T .

A

X

O

T

По условию, эти люди встретятся, если их

время прихода отличается не больше, чем

на , т.е. x y . Поэтому,

A x , y : x y . Множества и A изображены на

рисунке ( – квадрат, A – заштрихованная область).

1.2 Операции над событиями

Поскольку события в опыте отождествляются с подмножествами множества элементарных исходов , то над событиями

возможно осуществлять все операции, присущие операциям над

множествами. Рассмотрим основные из них.

Суммой событий A и B в некотором опыте называется событие A + B, состоящее из тех элементарных исходов, которые

входят или в событие A, или в событие B, или в то и другое.

Можно сказать, что событие A + B состоит в том, что произошло

хотя бы одно из событий A или B (здесь используется не исключающее логическое «или»). Например, пусть в опыте с бросанием игральной кости событие A = {выпало число очков,

кратное двум}, B = {выпало число очков, кратное трём}. Тогда

событие A + B = {выпало число очков, кратное или двум, или

трём}. Так как = {1, 2, 3, 4, 5, 6}, то A = {2, 4, 6}, B = {3, 6},

A + B = {2, 3, 4, 6}.

Аналогично определяется сумма большего числа событий.

Произведением событий A и B называется событие A B ,

состоящее из элементарных исходов, принадлежащих и

9

событию A, и событию B, т.е. общих для A и B. Итак, событие

A B происходит тогда и только тогда, когда одновременно

происходят оба события A и B (логическое «и»).

В разобранном выше примере с бросанием игральной кости

событие A B означает выпадение шести очков, т.е. A B = {6}.

Если же в том же примере рассмотреть события A = {выпадение

чётного числа очков}, B = {выпадение нечётного числа очков},

то A B = , т.е. будет невозможным событием. Напомним, что

в этом случае говорят: события A и B – несовместные события.

Разностью событий A и B называется событие A – B, состоящее из элементарных исходов события A, но не принадлежащих событию B. Это событие состоит в том, что A происходит, а B не происходит.

В опыте с бросанием игральной кости для случайных событий A = {выпало чётное число очков} = {2, 4, 6}, B = {выпало

больше 4-х очков} = {5, 6} имеем A – B = {2, 4}, а B – A = {5}.

Событие A A называется противоположным событию A (дополнительным к A). Событие A означает, что A не

произошло (логическое отрицание).

Два события A и B называются несовместными, если

множества A и B не имеют общих элементов, в этом случае

A B , иначе их называют совместными.

События A1 , A2 , ..., An образуют полную группу событий в

опыте, если выполняются два условия:

Ai A j

i j , т.е. попарно несовместны;

A1 A2 ... An .

Тот факт, что A является подмножеством множества B, означает, что все элементы A являются и элементами B, и обозначают так: A B . Для событий это означает, что из наступления

события A следует наступление события B.

События A и B считаются равными (A = B), если всякий

раз, когда наступает одно из них, наступает и другое.

Для наглядной иллюстрации введённые выше операции

10

над событиями могут быть представлены в виде так называемых

диаграмм Эйлера- Венна (результаты операции изображены на

рисунках ниже в виде заштрихованных фигур).

A+B

A B

A–B

A

A

A

B

A

B

A

B

Для произвольных событий непосредственно из определения легко проверить, что

A A A , A + A = A, A + = A, A A , A A ,

A ,

A + A = ,

A B A B ,

A = A.

Приведём без доказательства следующие важные равенства:

A B A B , A B A B , A B C A C B C .

Итак, с помощью введённых операций можно из простых

событий образовать более сложные. Приведём пример.

Пример 1.4. Произведено три выстрела из орудия по цели

(опыт). Пусть события Ai = {попадание при i-м выстреле}, где

i = 1, 2, 3. Выразить через Ai следующие события: A = {ровно

одно попадание}, B = {ровно два попадания}, C = {ровно три

попадания}, D = {все промахи}, E = {хотя бы одно попадание}, F = {хотя бы один промах}, G = {не меньше двух попаданий}.

Решение. Запишем требуемые события:

A A1 A2 A3 A1 A2 A3 A1 A2 A3 ,

B A1 A2 A3 A1 A2 A3 A1 A2 A3 ,

C A1 A2 A3 ,

D A1 A2 A3 ,

E A1 A2 A3 D ,

F A1 A2 A3 C ,

G A1 A2 A3 A1 A2 A3 A1 A2 A3 A1 A2 A3 B C .

11

1.3 Определения вероятности события

Сравнивая между собой случайные события, отметим, что

одни события наступают довольно часто, другие менее часто

или совсем редко. Мы часто говорим, что одни события более

вероятны (имеют больше шансов наступить, в большей степени

возможны), чем другие. Чтобы придать подобным сравнениям

точный смысл, необходимо с каждым событием связать число

(вероятность случайного события), выражающее количественную меру возможности появления данного события.

1.3.1 Статистическое определение вероятности

Пусть A – случайное событие по отношению к некоторому

опыту. Предположим, что опыт произведён n раз и при этом событие A произошло n A раз или, что тоже, n A – число

опытов, в которых произошло событие A (число «удачных»

опытов для события A). Величину

n A

Pn A

n

называют относительной частотой события A в проведённой

серии из n опытов.

Относительная частота может быть вычислена лишь после

того, как проведена серия опытов и, вообще говоря, относительная частота изменяется, если мы проведём другую серию из n

опытов, или если изменим число n. Однако, природа случайных

событий такова, что на практике наблюдается устойчивость

относительных частот. Суть этой устойчивости в том, что по

мере увеличения числа опытов n относительная частота Pn A

практически перестаёт быть случайной и стабилизируется около

некоторого постоянного числа P A , характерного для данного

события A в данном опыте.

Так, например, пусть много раз бросают симметричную

монету. Тогда, как показывают многочисленные эксперименты,

относительная частота появления герба в длинных сериях опытов мало отличается от числа 0,5 (читатель при желании может

осуществить эти опыты).

12

Если при больших n

Pn A P A ,

то число P A является вероятностью события A (статистическое определение вероятности).

Подчеркнём, что статистическая устойчивость относительной частоты события A и, следовательно, наличие определённой

его вероятности P A является основным, определяющим свойством случайного события. События, не обладающие этим свойством, в теории вероятностей не рассматриваются.

Следует отметить основные недостатки статистического

определения вероятности: вероятность события определяется

после опытов, необходимы большие серии опытов, что часто

бывает осуществить трудно или невозможно.

1.3.2 Классическое определение вероятности

Значительный интерес представляют опыты с конечным

числом одинаково возможных элементарных исходов.

Пусть A – случайное событие в таком опыте, состоящее из

n A элементарных исходов (говорят в этом случае, что событию A благоприятствуют n A элементарных исходов). Тогда

вероятность события A определяется по формуле

P A

n A

n

.

Итак, если в опыте число всевозможных исходов конечно и

сами исходы равновозможны, то вероятность любого случайного события A в таком опыте равна отношению числа n A благоприятствующих исходов для события A к общему числу n

исходов. Это определение вероятности называют классическим.

Пример 1.5. Опыт: симметричная игральная кость бросается дважды. Найти вероятности следующих событий: A = {оба

раза выпало число очков, кратное 3}, B = {оба раза выпало число очков, большее трёх}, C = {оба раза выпало одинаковое

13

число очков}, D = {сумма выпавших очков равна 6}.

Решение. Назовём элементарным исходом пару чисел i , j ,

где i – число выпавших очков при первом бросании, а j – при

втором. Тогда i , j i , j 1, 2 , ..., 6 , все исходы равновозможны, их общее число равно n = 36.

Событие A 3, 3 , 3, 6 , 6 , 3 , 6 , 6 содержит 4 элементарных

исхода

(число благоприятствующих исходов

n A 4 1

n A 4 ). Поэтому P A

.

n

36 9

Событие

B 4 , 4 , 4, 5 , 4, 6 , 5 , 4 , 5 , 5 , 5 , 6 , 6 , 4 , 6 , 5 , 6 , 6 .

n B

9 1

.

n

36 4

Событие C 1, 1 , 2 , 2 , 3, 3 , 4 , 4 , 5 , 5 , 6 , 6 ,

Имеем n B 9 , P B

6 1

.

36 6

Событие D 1, 5 , 5 , 1 , 2, 4 , 4 , 2 , 3, 3 , n D 5 ,

n C 6 , P C

P D

5

.

36

1.3.3 Геометрические вероятности

Пусть множеством элементарных исходов некоторого опыта

служит множество точек M некоторой фигуры , имеющей меру. Под фигурой будем понимать либо отрезок на числовой оси,

либо плоскую область, либо тело в пространстве. Мерой будет

служить соответственно длина отрезка, площадь плоской области, объём тела.

Пример такого опыта: наугад выбирается точка M фигуры

. Наблюдаемый исход – координаты этой точки. Рассмотрим

событие A = {наугад взятая точка M фигуры принадлежит её

части 1 }, т.е. A M 1 . Предположим, что вероятность события A пропорциональна мере 1 и не зависит от

14

местоположения 1 в . Тогда величину

P A

мера 1

мера

называют вероятностью события A (геометрическая вероятность).

Пример 1.6. Стержень длиной L произвольным образом

сломали на три части (опыт). Найти вероятность того, что из

этих трёх частей можно составить треугольник (событие А).

Решение. Обозначим длины двух частей

y

через x и y, тогда длина третьей части будет

L B

L – х – y. Множество элементарных исходов

M

N

состоит из множества точек (x, y) на координатной плоскости Oxy, таких, что 0 x L,

C

0

K

L x 0 y L, 0 x+y L (треугольник ОВС на

рисунке). Любой разлом стержня равнозначен

выбору точки x , y .

Событию А удовлетворяют те точки x , y , для которых будут выполнены условия: сумма длин любых двух частей

больше длины третьей:

x, y x y L x y, x l x y y, y l x y x

x, y x y 0,5L, x 0,5L, y 0,5L .

Множество 1 есть заштрихованный треугольник MNK на

рисунке. Вероятность события А можно найти как отношение

площадей MNK и OBC, поэтому P A 0 ,25 .

1.3.4 Аксиоматическое определение вероятности

Вероятности в статистическом, классическом и геометрическом смыслах имеют некоторые общие свойства, например,

1) 0 P A 1 ;

2) P 1 ;

15

3) P A B P A P B , если A и B – несовместные события в опыте.

Обобщение этих результатов привело к аксиоматическому

определению понятия вероятности. Аксиоматическая теория вероятностей в её современном виде была создана А.Н. Колмогоровым в 1933 г. Сформулируем аксиомы, задающие само понятие вероятности.

Рассмотрим некоторый опыт. Пусть – множество элементарных исходов.

Вероятностью P A события A называется числовая

функция, определённая на и удовлетворяющая трём условиям (аксиомам вероятностей):

аксиома 1 (аксиома не отрицательности)

P A 0 A ;

аксиома 2 (аксиома нормированности)

P 1 ;

аксиома 3 (аксиома аддитивности)

P A B P A P B A, B

A B .

Во многих случаях требуется расширенный вариант аксиомы 3. А именно, аксиома 3 постулирует сложение вероятностей

для конечного числа несовместных событий, в то время как в

расширенном варианте речь идёт о счётном числе несовместных

событий.

аксиома 3 (расширенная аксиома аддитивности)

P Ai P Ai Ai Ai A j , i j .

i 1 i 1

Используя аксиомы, установим некоторые важные свойства вероятности.

1) P 0 . Это следует из равенства , несовместности и и аксиомы 3.

16

Замечание. Иногда ошибочно считают, что событие нулевой вероятности обязательно есть невозможное событие. Это не

так. Например, пусть выбирается наугад число из отрезка 0 , 1 .

и рассмотрим событие A = {слу-

Положим x x 0 , 1

чайно выбранное число равно 0,5}. Для вычисления вероятности события A нельзя применить классическое определение вероятностей (почему?). При использовании геометрической вероятности (так как – непрерывное множество элементарных

исходов) считаем, что мера (длина) отрезка равна 1, а мера

множества A (множество состоит из одной точки) равна 0. Поэтому P A 0 . Однако, событие A может произойти в этом

опыте, оно не является невозможным! А вот событие B 2 в

этом опыте невозможное.

2) P A 1 P A , так как A A и A A .

3) 0 P A 1 , что следует из аксиомы 1 и свойства 2.

4) Если A B , то P A P B . Это следует из равенства

B A A B , несовместности событий A и A B и аксиомы 3.

5) Формула сложения вероятностей

P A B P A P B P A B .

Для доказательства этой формулы рассмотрим соотношения

между событиями (как между подмножествами множества ):

A A B A B , A B B A B (см. рисунок).

AB

AB AB

A

A

B

B

Применяя к обоим равенствам аксиому 3 (ясно, что A B и

A B несовместны, B и A B несовместны), получим два числовых равенства:

17

P A P A B P A B , P A B P B P A B .

Вычитая из последнего равенства предыдущее, приходим к

формуле сложения вероятностей.

Формула сложения вероятностей может быть обобщена на

случай более двух слагаемых. Например,

P A B C P A B C P A B P C P A B C

P A P B P C P A B P A C P B C P A B C .

Аналогично для большего числа слагаемых.

1.4 Применение комбинаторики к подсчёту

вероятностей

1.4.1 Общие вопросы

При подсчёте числа элементарных исходов, составляющих

события в классической схеме, часто используются методы

комбинаторики. Вначале рассмотрим важное правило комбинаторики.

Правило умножения. Если некоторое действие может

быть выполнено m способами, а для каждого из этих способов

некоторое другое действие можно осуществить n способами,

то сложное действие «и , и » можно осуществить m n способами.

Аналогично формулируется правило умножения для большего числа действий.

Пример 1.7. Сколько можно составить четырёхзначных чисел так, чтобы любые две соседние цифры были различны?

Решение. Пусть x1 , x2 , x 3 , x4 – соответственно первая,

вторая, третья и четвёртая цифры числа. Выбор цифры x1 возможен 9 способами (x1 может быть любой из цифр 1, 2, ..., 9).

Если x1 выбрана, то для выбора x2 имеется тоже 9 возможностей

(x2 может быть любой из цифр 0, 1, ..., 9, отличной от x1 ). После

выбора x1, x2 для x3 имеется снова 9 возможностей и т. д.

Применяя правило умножения, находим, что искомое количество чисел равно 9 9 9 9 9 4 .

18

Рассмотрим опыт: выбор наудачу m элементов из n различных элементов исходного множества X x1 , x2 , ..., xn (говорят о выборке объёма m).

Такой опыт может быть организован по-разному. Если выбранные элементы возвращаются в X (т.е. каждый элемент может попасть в выборку несколько раз), то мы получим выборку с

повторениями. Если элементы не возвращаются, то получим

выборку без повторений.

Кроме этого, нужно определить: важен ли порядок элементов в выборке? Если порядок важен, то выборка называется

упорядоченной, или размещением. Если порядок элементов в

выборке не важен, то выборка называется неупорядоченной,

или сочетанием.

1.4.2 Схема выбора без повторений

Рассмотрим вначале размещения в этой схеме (размещения

без повторений из n элементов по m). Число всех таких размещений обозначается символом Anm .

Чтобы найти число Anm , заметим, что на первом месте в

упорядоченной цепочке может оказаться любой из n элементов

множества X. После того, как заполнено первое место, на втором

месте может оказаться любой из оставшихся n – 1 элементов и

т.д. Пользуясь правилом умножения, находим

n!

Anm n n 1 n 2 ... n m 1

.

n m !

В частном случае m = n опыт фактически состоит в произвольном упорядочивании множества X и сводится к случайной

перестановке элементов всего множества (т.е. перестановка n

элементов это размещение из n элементов по n). Число всех перестановок n элементов обозначается символом Pn , при этом

Pn Ann n n 1 n 2 ... 2 1 n! .

19

Пример 1.8. Множество X содержит 6 первых букв русского алфавита. Опыт состоит в выборе без возвращения 3-х

букв и записи слова в порядке поступления букв. Сколько 3-х

буквенных слов может быть получено в данном опыте? Какова

вероятность события A = {наугад составленное слово из 3-х букв

множества X оканчивается буквой а}?

Решение. Множество элементарных исходов данного

опыта – множество всех 3-х буквенных слов, составленных в

результате опыта. Число элементов этого множества равно

n A63 6 5 4 120 . Число элементов множества A равно

числу способов разместить на два оставшихся места по одной

букве из пяти (буква а исключена из рассмотрения, так как её

место уже определено). Таким образом,

n A 20 1

n A A52 5 4 20 , P A

.

n 120 6

Рассмотрим теперь сочетания без повторений из n элементов по m. Число всех таких сочетаний обозначается символом C nm .

Так как из каждого сочетания без повторений можно, переставляя элементы, получить m! размещений, то число размещений в m! раз больше, чем число сочетаний, т.е.

C nm

Anm n n 1 n 2 ... n m 1

n!

.

Pm

m!

n m !m !

Для чисел C nm справедливы свойства, которые следуют из

этой формулы:

C nm C nn m , C nm 1 C nm C nm 1 ,

C nn C n0 1 ,

C n0 C n1 ... C nn 2 n .

Пример 1.9. В урне имеется n шаров, из них n1 белых и

n2 чёрных (n1 + n2 = n). Опыт: наугад извлекаются m шаров (без

возвращения). Найти вероятность события A = {среди выбранных m шаров окажется ровно k белых}.

20

Решение. За элементарные исходы естественно взять сочетания из n элементов (шаров) по m (порядок расположения шаров в выборке не важен!). Поэтому общее число исходов

n C nm C nm1 n2 . Выясним, сколько исходов из общего числа

исходов благоприятствуют событию A, т.е. наличию в выборке

объёма m белых шаров в количестве k. Каждый набор шаров,

соответствующий событию A, состоит из двух частей: k белых

шаров и (m – k) чёрных шаров. Число способов, которыми можно из n1 белых шаров извлечь k штук, равно C nk1 , а число способов выбрать из n2 чёрных шаров (m – k) штук равно C nm2 k . Поэтому, согласно правилу умножения, число исходов, благоприятствующих появлению события A, равно n A C nk1 C nm2 k .

Итак,

P A

n A

n

C nk1 Cnm2 k

C nm1 n2

.

Полученная формула находит широкое применение в дальнейшем.

1.4.3 Схема выбора с повторениями

Рассмотрим вначале размещения в этой схеме (размещения

с повторениями из n элементов по m). Используя правило умножения, легко определить число Anm таких размещений:

Anm n m .

Например, число всех распределений m шаров по n ящикам

(считаем, что шары различимы и ящики различимы, например,

пронумерованы) равно Anm . Действительно, у каждого шара

равная возможность оказаться в любом из n ящиков (n способов). По правилу умножения число способов такого распределения

n

n

...

n n m Anm .

m множителей

21

У этой схемы имеются многочисленные конкретные реализации. Например:

1) распределения дней рождения m человек соответствует

распределению m шаров по n = 365 ящикам;

2) распределение m пассажиров по n вагонам эквивалентно

распределению m шаров по n ящикам (если для каждого пассажира существенным является только номер вагона, а не занимаемое им в вагоне место);

3) при артиллерийском обстреле некоторой местности, например, каждый гектар обстреливаемой территории соответствует ящику, а снаряд – шару.

Пример 1.10. Найти вероятность того, что в группе из m

студентов хотя бы у двух дни рождения совпадают (событие А).

Решение. Будем считать, что у каждого из m студентов день

рождения может быть любым днём года. Тогда число всех элеm

ментарных исходов равно n A365

365 m (размещения с

повторениями из 365 по m). Рассмотрим событие A = {в группе

из m студентов у всех дни рождения различные}. Событию A

m

соответствует n A A365

исходов (размещения без повторений

из

365

по

Имеем

m).

P A 1 P A 1

P A

n A

n

m

A365

365 m

,

значит,

m

A365

.

365 m

Подсчитав P A для различных значений m, можно составить такую таблицу

m

P A

5

0,027

10

0,117

22

0,476

23

0,507

30

0,706

60

0,994

Из неё видно, что если в аудитории на лекции сидит одна

учебная группа, то уже и тогда имеется более половины шансов

22

на то, что хотя бы у двоих из них дни рождения совпадают, а

если две учебные группы, то «почти достоверно».

В рассматриваемой схеме с повторениями можно рассмотреть сочетания (сочетания с повторениями из n элементов по

m). Число таких сочетаний (обозначим C nm ) равно

m

C n Cnm m 1 .

Доказательство этой формулы в пособии не приводится.

Отметим, что число всех распределений m неразличимых

шаров по n ящикам равно C nm .

Пример 1.11. В библиотеке имеются книги по 8 разделам

науки. Поступили очередные 3 заказа на 1 книгу каждый. Считая, что любой состав заказанной литературы равновозможен,

найти вероятности следующих событий: А = {заказаны книги из

разных разделов науки}, В = {заказаны книги одного раздела

науки}.

Решение. Опыт: получение заказа на 3 книги. Элементарный исход: список из трёх разделов науки, по которым заказаны

книги. Порядок этих разделов в списке роли не играет. Число

таких исходов равно числу сочетаний с повторениями из n = 8

3

элементов по m = 3, т.е. n C 83 3 1 C 10

.

Число исходов, благоприятствующих событию А, равно

числу способов отобрать без возвращения четыре элемента из 8,

поэтому

n A C 83

8 7 6

7

.

P A

3

n C 10 10 9 8 15

Число исходов, благоприятствующих событию В, равно

числу способов выбрать один раздел науки из восьми, поэтому

P B

n B

n

C81

3

C10

23

8

1

.

10 9 8 15

1 2 3

1.5 Условные вероятности. Независимость событий

При совместном рассмотрении двух случайных событий A

и B часто возникает вопрос: насколько связаны эти события

друг с другом, в какой мере наступление одного из них влияет

на возможность наступления другого?

Для характеристики зависимости одних событий от других

вводится понятие условной вероятности. Вначале рассмотрим

пример.

Пример 1.12. Дважды брошена симметричная игральная

кость. Рассмотрим события: A = {1-й раз выпало одно очко},

B = {сумма выпавших очков меньше четырёх}. Вычислить вероятность события A, если известно, что произошло событие B.

Решение. Обозначим такую вероятность P A | B . Множество элементарных исходов состоит из 6 6 = 36 исходов и

может быть так записано:

i , j i , j 1, 2 , ..., 6 .

События A и B – это следующие подмножества :

A 1, 1 , 1, 2 , 1, 3 , 1, 4 , 1, 5 , 1, 6 ,

B 1, 1 , 1, 2 , 2, 1 .

Составим ещё событие A B 1, 1 , 1, 2 .

По классической схеме имеем

P A

n A

n

P A B

nB 3

6 1

1

, P B

,

36 6

n 36 12

n A B

n

2

1

.

36 18

Если известно, что событие B произошло, то событие A может появиться, лишь тогда, когда произойдёт исход 1, 1 или

исход 1, 2 . Значит, событию A в данной ситуации будет благоприятствовать n A B 2 исхода из n B 3 исходов. Поэтому естественно считать, что P A | B

24

n A B

nB

2

.

3

Заметим, что полученный результат можно записать в виде:

n A B

1

n

P A B 18 2

.

1 3

n B

P B

12

n

Полученное в данном примере равенство положим в основу

общего определения условной вероятности.

Пусть A и B два случайных наблюдаемых события в некотором опыте, причём

P B 0 . Условной вероятностью

P A | B

P A | B события A при условии, что событие B произошло в

данном опыте, называется величина, определяемая равенством

P A B

P A | B

.

P B

Для краткости условную вероятность P A | B можно называть «вероятностью события A при условии B». Если

P B 0 , то условная вероятность P A | B не определена.

Замечание.

Между

безусловной

P A

и

условной

P A | B вероятностями события A принципиальной разницы

нет. Эти числа определяют вероятности события, наблюдаемого

в двух разных опытах G и G1 соответственно. Если для опыта G

множество элементарных исходов есть множество , то для G1

таким множеством является 1 B .

Пример 1.13. Какова вероятность того, что вытащенная

наугад кость домино окажется «дублем», если известно, что

сумма очков на этой кости является чётным числом?

Решение. Пусть события A = {вытащенная кость –

«дубль»}, B = {сумма очков – чётная}. Имеем

P A B 7 / 28

7

P A | B

.

P B

16 / 28 16

Здесь учтено, что из 28 костей домино 16 костей имеют чётную

25

7

.

28

Из равенства, являющегося определением условной вероятности, следует P A B P B P A | B . Если оба события A и

сумму очков. Заметим, что безусловная вероятность P A

B обладают ненулевой вероятностью, то, поменяв местами эти

события, можно записать

P A B P B P A | B P A P B | A

(формула умножения вероятностей).

Итак, вероятность произведения двух событий равна произведению вероятности одного из этих событий на условную вероятность другого при условии, что первое из них произошло.

Формулу умножения вероятностей легко распространить на

случай произвольного числа событий: так, например, в случае

трёх событий A, B и C имеем

P A B C P A B P C | A B P A P B | A P C | A B ,

а в общем случае P A1 A2 ... An

P A1 P A2 | A1 P A3 | A1 A2 ... P An | A1 A2 ... An 1 .

Пример 1.14. Студент знает 20 из 25 вопросов программы.

Найти вероятность события A = {студент знает предложенные

экзаменатором три вопроса}.

Решение. Рассмотрим события Ai = {студент знает i-й предложенный вопрос, i = 1, 2, 3}. Тогда A A1 A2 A3 , поэтому

P A P A1 A2 A3

20 19 18 57

.

25 24 23 115

Заметим, что вероятность события A можно было найти непосредственно, используя комбинаторику:

20 19 18

3

C 20

20 19 18 20 19 18

P A 3 1 2 3

.

C 25 25 24 23 25 24 23 25 24 23

1 2 3

P A1 P A2 | A1 P A3 | A1 A2

26

Условная вероятность P A | B , как правило, не совпадает

с безусловной вероятностью P A . Однако есть важное исключение, когда условные вероятности совпадают с безусловными.

Событие A называют независимым от события B (при

условии P B 0 , если выполняется равенство:

P A | B P A ,

т. е. вероятность события A не зависит от того, произошло или

не произошло событие B. В случае независимости события A от

события B следует, что

P A B P A P B .

Свойство независимости событий взаимно: если A не зависит от B, то и B не зависит от A. Действительно,

P A B P A P B

P B | A

P B .

P A

P A

Поэтому, в дальнейшем мы можем говорить о независимых

событиях A и B, и условием этого является выполнение равенства . Это равенство ещё называют формулой вероятности

произведения независимых событий.

Пример 1.15. Пусть дважды бросается симметричная монета. Показать, что события A = {1-й раз выпал герб (Г)}, B = {2-й

раз выпала цифра (Ц)} независимы.

Решение. Имеем: = {ГГ, ГЦ, ЦГ, ЦЦ}, A = {ГГ, ГЦ},

B = {ГЦ, ЦЦ}, AB = {ГЦ}.

По классической схеме:

2 1

2 1

1

P A , P B , P A B .

4 2

4 2

4

Итак, P A B P A P B , следовательно события A и B

независимы.

Замечание. Если A и B независимы, то события

A и B , A и B , A и B также независимы.

Действительно, из равенства B A B A B следует

27

P B P A B P A B , так как A B и A B несовместны.

Если A и B независимы, то P A B P B P A B

P B P A P B P B 1 P A P B P A ,

что означает независимость событий A и B.

Аналогично

показывается

независимость

событий

A и B, A и B .

События A1, A2, … , An называются независимыми в совокупности, если для любых k из них (k n) следует равенство

P Ai1 Ai2 ... Aik P Ai1 P Ai2 ... P Aik .

Если это условие выполнено только при k = 2, то события

попарно независимы.

Замечания.

1. Отметим без доказательства, что из независимости в совокупности событий A1, A2, … , An следует, что любое из этих

событий независимо от любой комбинации остальных. Например, в рассмотренном случае будут независимыми события A1 и

A2 + A3, т. е. P A1 A2 A3 P A1 P A2 A3 и т. п.

2. Если события A1, A2, … , An независимы в совокупности,

то вероятность осуществления хотя бы одного из них проще вычисляется не по формуле сложения, а с помощью формулы умножения:

P A1 ... An 1 P A1 ... An 1 P A1 ... P An .

Пример 1.16. Электрическая схема состоит из n блоков:

p1

1)

2)

p1

p2

p2

pn

pn

28

1) соединённых последовательно; 2) соединённых параллельно.

Пусть надёжность (т.е. вероятность безотказной работы)

каждого блока равна соответственно p1, p2, … , pn. Считая выходы из строя различных блоков независимыми событиями, найти

надёжность всей схемы в целом.

Решение. Пусть события Ai = {исправная работа i-го блока,

i = 1, 2, … , n}, A = {исправность схемы в целом}.

В случае 1) событие A осуществляется только тогда, когда

осуществляются все Ai, поэтому A A1 A2 ... An . В силу независимости событий Ai следует

P A P A1 P A2 ...P An p1 p2 ...pn .

В случае 2) событие A = A1 + A2 + … + An. Так как события

Ai могут быть совместными, поэтому воспользоваться формулой

для вероятности суммы событий неудобно. Заметим, что событие A (выход схемы из строя) происходит лишь в том случае,

когда выходят из строя все блоки. Это означает, что

A A1 A2 ... An , и, следовательно,

P A P A1 P A2 ...P An 1 p1 1 p2 ... 1 pn .

Таким образом, надёжность схемы в случае 2) оказывается

равной P A 1 P A 1 1 p1 1 p2 ... 1 pn .

Пример 1.17. Найти надёжность схемы, изображённой на

рисунке.

p2

Решение. Предложенную схему можно расp1

p4

сматривать как результат

p3

последовательного соединения 3-х блоков (на рисунке эти блоки обведены

пунктирами). Поэтому

A A1 A2 A3 , где P A1 p1 ,

P A2 1 1 p2 1 p3 , P A3 p4 . Итак,

P A p1 1 1 p2 1 p3 p4 .

29

1.6 Формула полной вероятности и формула Байеса

В некоторых ситуациях нужно найти вероятность события в

условиях «неполной определённости». Поясним на примере.

Пример 1.18. В классе 3 отличника, 10 «хорошистов», а

всего 20 учеников. Вероятность решить трудную задачу для отличника равна 0,8, для хорошиста – 0,6, для остальных учеников – 0,2. Какова вероятность события А = {задачу решит ученик, выбранный случайным образом}?

Решение. Кто будет решать задачу, кого «выберет случай» –

неизвестно. В такой ситуации нужно сделать предположения,

или гипотезы. В рассматриваемом примере возьмём такие гипотезы: H1 = {выбран отличник}, H2 = {выбран хорошист}, H3 =

{выбран более слабый ученик}. События H 1 , H 2 , H 3 – полная

группа событий, т. е. они несовместны и P H i 1 .

H1

H2

H3

i

A

На

рисунке

видно,

что

A A H 1 A H 2 A H 3 – сумма

несовместных событий. Значит,

P A P A H 1 P A H 2 P A H3 .

Применив понятие условной вероятности, получим:

P A P H 1 P A | H 1 P H 2 A | H 2 P H 3 P A | H 3 .

Это и есть формула полной вероятности (для 3-х гипотез).

В общем случае, когда гипотез n штук, формула имеет вид:

n

P A P H i P A | H i .

i 1

Продолжим решение примера. Чтобы воспользоваться полученной формулой полной вероятности, вычислим вначале

3

10

7

0 ,15 , P H 2

0 ,5 , P H 3

0 ,35 .

20

20

20

Условные вероятности даны в условиях примера:

P H1

P A | H 1 0 ,8 , P A | H 2 0 ,6 , P A | H 3 0 ,2 .

30

Итак, P A 0 ,15 0 ,8 0 ,5 0 ,6 0 ,35 0 ,2 0 ,49 .

Пример 1.19. На предприятии изготавливаются изделия

определённого вида на 3-х поточных линиях. На 1-й линии производится 20% изделий от всего объёма их производства, на 2-й

– 30%, на 3-й – 50%. Каждая из линий характеризуется соответственно следующими процентами годности изделий: 95%, 98%

и 97%. Требуется определить вероятность того, что наугад взятое изделие, выпущенное предприятием, окажется бракованным.

Решение. Обозначим через H1, H2, H3 события, состоящие в

том, что наугад взятое изделие сделано соответственно на 1-й,

2-й, 3-й линиях. Согласно условиям задачи P H 1 0 ,2 ;

P H 2 0 ,3 ; P H 3 0 ,5 и эти события образуют полную

группу событий.

Рассмотрим событие A = {наугад взятое изделие оказалось

бракованным}. Согласно условиям задачи P A | H 1 0 ,05 ;

P A | H 2 0 ,02 ;

P A | H 3 0 ,03 . Используя формулу пол-

ной вероятности, получаем

P A P H1 P A| H1 P H2 P A | H 2 P H3 P A| H 3

= 0,2 0,05 + 0,3 0,02 + 0,5 0,03 = 0,031.

Пример 1.20. Экономист полагает, что вероятность роста

стоимости акций некоторой компании в следующем году будет

равна 0,8, если экономика страны будет на подъёме; и эта же

вероятность будет равна 0,25, если экономика страны не будет

успешно развиваться. По его мнению, вероятность экономического подъёма в новом году равна 0,7. Используя предположения экономиста, оценить вероятность того, что акции компании

поднимутся в цене в следующем году.

Решение. Обозначим события A = {акции компании поднимутся в цене в следующем году}, H1 = {экономика страны будет

на подъёме}, H 2 H 1 = {экономика страны не будет успешно

развиваться}. По условию задачи известны вероятности:

P H 1 0 ,7 , P H 2 1 0 ,7 0 ,3,

31

P A | H 1 0 ,8 , P A | H 2 0 ,25 .

По формуле полной вероятности находим

P A P H1 P A| H1 P H2 P A| H2 0,7 0,8 0,3 0,25 0,635 .

Пусть H1, H2, … , Hn – совокупность гипотез по отношению

к интересующему нас событию A в некотором опыте. Пусть

опыт проведён, и стало известно, что событие A осуществилось.

Сам по себе этот факт ещё не позволяет сказать, какое из событий Hi имело место в проделанном опыте.

Задача 1.1. Найти вероятности P H i | A каждой из гипотез в предположении, что наступило событие A (при этом будем

считать известными вероятности гипотез до опыта P H i и условные вероятности P A | H i ).

Решение. Согласно формуле умножения вероятностей можем записать P A H i P A P H i | A P H i P A | H i ,

отсюда получаем

P Hi P A | Hi

P Hi P A | Hi

P H i | A

n

.

P A

P Hk P A | Hk

k 1

Полученное соотношение называется формулой Байеса и

является решением поставленной задачи.

Итак, формула Байеса позволяет «переоценить» вероятность

каждой из гипотез после поступления новой информации относительно осуществления тех или иных наблюдаемых событий.

Пример 1.21. Из 10 студентов, которые пришли на экзамен

по математике, трое знают все 20 вопросов («отличные» студенты), четверо – 16 вопросов («хорошие» студенты), двое – 10 вопросов («средние» студенты), а один студент – только 5 вопросов («плохой» студент). Каждый студент получает на экзамене

наугад 3 вопроса из 20. Приглашённый наугад студент ответил

на все 3 вопроса (событие А). Какова вероятность, что отвечал

«отличный» студент, «хороший» студент, «средний» студент,

«плохой» студент?

32

Решение. Рассмотрим события, которые можно взять в качестве гипотез: H1 = {на экзамен был приглашён «отличный»

студент}, H2 = {на экзамен был приглашён «хороший» студент},

H3 = {на экзамен был приглашён «средний» студент}, H4 = {на

экзамен был приглашён «плохой» студент}.

Согласно условию задачи

3

4

2

1

P H1

, P H2

, P H3

, P H4

.

10

10

10

10

Нетрудно вычислить вероятность события A для каждой категории студентов (на знание и первого, и второго, и третьего из

предложенных вопросов):

16 15 14

P A | H 1 1, P A | H 2

0 ,49 ,

20 19 18

10 9 8

5 4 3

P A | H3

0 ,11, P A | H 4

0 ,01 .

20 19 18

20 19 18

Вначале найдём по формуле полной вероятности P A , а

затем по формуле Байеса требуемые вероятности P H i | A :

4

P A P H i P A| H i

i 1

0 ,3 1 0 ,4 0 ,49 0 ,2 0 ,11 0 ,1 0 ,01 0 ,52 ;

P H 1 | A

P H 2 | A

P H 3 | A

P H 4 | A

P H1 P A | H1

P A

P H2 P A | H2

P A

P H 3 P A | H3

P A

P H4 P A | H4

P A

33

0 ,3 1

0,58 ;

0 ,52

0 ,4 0 ,49

0 ,38 ;

0 ,52

0 ,2 0 ,11

0 ,04 ;

0 ,52

0 ,1 0 ,01

0 ,002 .

0 ,52

1.7 Схема Бернулли

В теории вероятностей часто встречается так называемая

схема независимых повторных испытаний с двумя исходами

(схема Бернулли). Кратко опишем такую схему.

Пусть A – случайное событие, наблюдаемое в некотором

испытании. Отвлекаясь от возможного разнообразия исходов в

испытании, будем интересоваться лишь тем, произошло событие

A (успех) или не произошло A (неуспех). Пусть P A p , тогда

P A 1 p q .

Допустим теперь, что испытание в неизменных условиях повторяется n раз, в силу чего вероятность P A p остаётся одной и той же в каждом испытании (такие повторные испытания

называют независимыми).

Например, 2 раза (n = 2) бросается игральная кость. Пусть

осуществление события A = {появление шести очков} означает

успех, а осуществление A – неуспех. Множество элементарных

исходов A A, A A, A A, A A состоит из 2 2 4 исходов.

Вероятность

q P A

p P A

успеха

1

,

6

а

неуспеха

5

.

6

Рассмотрим задачу, связанную со схемой Бернулли, которая

играет важнейшую роль для практических применений теории

вероятностей.

1.7.1 Формула Бернулли

Задача 1.2. Пусть производится n независимых испытаний,

в каждом из которых с одной и той же вероятностью p может

наступить некоторое событие A. Требуется найти вероятность

события B = {в n испытаниях событие A наступит ровно k

раз}.

Решение. Событие B может быть представлено в виде суммы несовместных событий, каждое из которых включает k

34

успехов и (n – k) неуспехов. Каждому такому событию в n испытаниях будет соответствовать произведение k букв A и (n – k)

букв A , чередующихся в том порядке, в котором появляются

эти события в n испытаниях. Число таких слагаемых будет равно числу сочетаний C nk (количество способов расставить k букв

A на n мест, остальные (n – k) мест занимаются буквами A )

Вероятность появления каждой такой последовательности,

ввиду независимости испытаний, равна p k 1 p

nk

pk q n k .

Отсюда, вероятность события B будет равна C nk p k q n k .

Чтобы подчеркнуть, что полученная вероятность зависит от

n и k, обозначим P B Pn k . Итак,

Pn k C nk p k q n k .

Полученная формула носит название формулы Бернулли, а сами вероятности Pn k называются биномиальными вероятностями. Такое название связанно с тем, что числа Pn k имеют

непосредственное отношение к формуле бинома Ньютона:

n

n

k 0

k 0

n

Pn k Cnk pk q nk p q 1 .

С точки зрения теории вероятностей это равенство обосновывается тем, что его левая часть определяет вероятность достоверного события, заключающегося в осуществлении события A

при n испытаниях любое число раз от 0 до n.

Пример 1.22. Стрелок стреляет по цели пять раз подряд.

Вероятность поражения цели этим стрелком при каждом выстреле равна 0,8. Какова вероятность того, что цель будет поражена четыре раза?

Решение. Рассматривая каждый выстрел как отдельное испытание, можно сделать вывод, что речь идёт о n = 5 независимых повторных испытаниях с вероятностью успеха (попадания

в цель) p = 0,8, q = 1 – p = 0,2.

Применим формулу Бернулли при k = 4 (число успехов):

35

4

P5 4 C54 p4 q 5 4 C55 4 p 4 q 1 5 0 ,8 0 ,2 0 ,4096 .

Пример 1.23. В люстре 4 электролампочки. Для каждой

лампочки вероятность того, что она останется исправной в тече5

ние года, равна . Какова вероятность того, что в течение года

6

придётся заменить меньше половины лампочек?

Решение. Рассматривая эксплуатацию каждой лампочки в

течение года как отдельное испытание, можно сказать, что проводится n = 4 испытания. Нас интересует событие B = B0 + B1,

где Bk = {придётся заменить k лампочек, k = 0; 1}. Здесь «успехом» следует считать неисправность лампочки, поэтому

5 1

5

p 1 , а q . Итак, P B P4 0 P4 1

6 6

6

0

4

1

3

5 4 4 5 3 125

5

1 5

C 41 4 4

.

144

6

6

6 6

6 6

В схеме Бернулли довольно важной является

1

C 40

Задача 1.3. Какое число k успехов является наиболее вероятным при данном числе испытаний n?

Решение. Задачу можно сформулировать иначе: какое из

чисел Pn 0 , Pn 1 , ..., Pn n является наибольшим? Рассмотрим отношение соседних чисел:

Pn k 1 C nk 1 p k 1 q n k 1 n k p

nk p

1

1

k

k

n

k

Pn k

k1 q

Cn p q

k 1 q

1

ak

, где a = np – q.

k 1 q

Имеем:

Pn k 1 Pn k при k < a,

Pn k 1 Pn k при k > a,

Pn k 1 Pn k при k < a (если a – целое число).

36

Итак, при k < a функция Pn k возрастает, а при значениях k > a убывает. Следовательно, если число a не является целым, то функция Pn k имеет единственный максимум и он

достигается при ближайшем к числу a справа целом значении k,

т.е. при таком целом k , которое заключается между a и a + 1:

a k a 1 np q k np p .

Если же a = np – q – целое число, то два равных между собой максимума достигаются при k = a и k = a + 1.

Итак, если вероятности p и q отличны от нуля, то целое

число k определяется из неравенства

np q k np p .

Пример 1.24. Отдел технического контроля проверяет партию из 10 деталей. Вероятность того, что деталь стандартна,

равна 0,75. Какое наиболее вероятное число деталей будет признано стандартным?

Решение. В данном случае n = 10, p = 0,75, q = 0,25. Определим наивероятнейшее число k :

10 0 ,75 0 ,25 k 10 0 ,75 0 ,75 7 ,25 k 8,25 ,

отсюда единственное целое число k 8 .

1.7.2 Приближённые формулы в схеме Бернулли

В приложениях часто приходится вычислять вероятности

Pn k при больших значениях n. В этом случае вычисления по

формуле Бернулли становятся затруднительными. Поэтому при

больших n пользуются приближёнными формулами для вычисления вероятностей Pn k , а также для сумм вида

k2

Pn k .

k k1

Укажем формулы такого рода.

Пусть число испытаний n велико, а вероятности p и q не

малы (обычно достаточно выполнения условия npq 10), тогда

биномиальную вероятность Pn k можно приближённо найти

по локальной формуле Лапласа:

37

1

Pn k

x ,

npq

где x

k np

npq

x

,

1

2

e

x2

2 .

k2

В этих же условиях вероятность Pn k1 k k2 Pn k

k k1

можно приближённо найти по интегральной формуле Лапласа

Pn k1 k k 2 x2 x1 ,

где xi

ki np

npq

x

, i 1, 2 , а x t dt

0

1

x

e

2 0

t2

2 dt

–

функция Лапласа.

Замечания.

1) Обоснование приведённых формул приводится в следующем разделе данного пособия.

2) Функция (x) – чётная функция, т.е. (–x) = (x), а функция Ф(x) – нечётная функция, т.е. Ф(–x) = – Ф(x). Для этих

функций составлены таблицы (в данном пособии – это таблица

1, расположенная на с. 264).

3) Точность приближённых формул улучшается с ростом

величины npq. Отсюда следует, что чем ближе одно из чисел p

или q к нулю (другое число в этом случае близко к единице), тем

большим следует брать n. Поэтому в случае близости одной из

величин p или q к нулю формулами Лапласа обычно не пользуются, для этого случая более точными являются приближённые

формулы Пуассона, которые рассмотрим ниже.

Рассмотрим задачу, которую можно решить с помощью интегральной формулы Лапласа.

Задача 1.4. Определить вероятность того, что в n независимых повторных испытаниях отклонение относительной частоты

38

k

появления успеха от вероятности p успеха в одном испытаn

нии не превысит заданного числа 0 , т.е. найти

k

P p .

n

Решение. Преобразуем неравенство в равносильное

k

p n k np n np n k np n .

n

Применяя

интегральную

формулу

Лапласа

при

k1 np n , k2 np n , получим

np n np

np n np

k

n

P p Ф

Ф

2Ф

.

pq

npq

npq

n

Пусть теперь n велико, а p или q является малым числом.

Будем считать для определённости, что мало p (в случае малого

q нужно просто изменить обозначения и вместо события А рассмотреть событие A , при этом числа p и q поменяются ролями).

Такая ситуация возникает, когда имеем дело с редко происходящими событиями. Примеры таких событий: совпадение дней

рождения у нескольких человек, достижение столетнего возраста, рождение трёх близнецов и т.п.

nk

Выражение Pn k C nk p k 1 p

представляет собой

функцию трёх переменных: n, p и k. Предположим, что k зафиксировано, а n и p изменяются следующим образом: при возрастании n вероятность p появления интересующего нас события

убывает, притом так, что величина = np остаётся постоянной.

Рассмотрим, как ведут себя биномиальные вероятности при

n , p 0 , np .

Согласно формуле Бернулли и условия p имеем

n

39

Pn k C nk p k 1 p

nk

nk

n n 1 ... n k 1 k

1

k!

n

nk

n

n n 1 n k 1 k

...

1 1

n n

n

k!

n

n

Поэтому, lim Pn k

k

.

n

n

k

1 k 1

k

lim 1 1 ...1

lim lim 1

lim 1

n

n

n

n n k! n n

n

k

k

1

e 1

e

(здесь был использован

k!

k!

1

второй замечательный предел lim 1 e ).

0

Итак, при больших n и малых p (обычно p < 0,1; npq < 10)

справедливы приближённые равенства (формулы Пуассона)

Pn k

k

e , np .

k!

k2

k2

k

e .

k k1 k !

Pn k1 k k2 Pn k

k k1

Замечание. Особенностью формул Пуассона является то,

что для вычисления вероятности того или иного числа успехов

вовсе не требуется отдельно знать n и p. Всё определяется в конечном счёте числом = np (средним числом успехов).

Приведём примеры применения рассмотренных приближённых формул.

Пример 1.25. Вероятность рождения мальчика равна 0,51.

Найти вероятность того, что среди 100 новорождённых окажется

ровно 50 мальчиков.

Решение. Имеем по условию n = 100, k = 50, p = 0,51,

q = 0,49, поэтому npq = 24,99 > 10.

Воспользуемся локальной формулой Лапласа:

40

P100 50

50 100 0,51 1 1 1

0,39 0,078 .

24,99

24,99 5 5 5

1

Пример 1.26. Какова вероятность того, что при 200кратном бросании монеты число k появлений герба удовлетворяет неравенству 95 k 105?

Решение. Здесь n = 200, p = q = 1/2 , k1 = 95, k2 = 105.

1 1

Так как n велико и npq = 200 50 10 , то можно приме2 2

нить интегральную формулу Лапласа:

k np 95 200 0,5

x1 1

0,707 ,

npq

200 0,5 0,5

x2

k 2 np

npq

105 200 0 ,5

200 0 ,5 0 ,5

0 ,707 ,

P200 95 k 105 Ф 0,707 Ф 0,707 2Ф 0,707 0 ,522 .

Значение функции Лапласа взято из таблицы 1 (с. 265).

Пример 1.27. Пусть событие А = {выпадение шести очков

при одном бросании игральной кости}. Найти вероятность события В = {относительная частота появления события А при 300

бросаниях игральной кости будет отличаться от вероятности

события А не более чем на 0,01}.

Решение. Пусть k – число появлений события А (число успехов) при n = 300 бросаниях кости, тогда относительная частоk

та появления события А будет равна

. Вероятность появле300

ния события А при одном бросании (вероятность успеха) оче1

видно равна . Тогда событие В заключается в том, что число k

6

k

1

удовлетворяет неравенству

0 ,01 . Воспользуемся ре300 6

шением задачи 1.4 при 0 ,01 :

41

k 1

300

P

0,01 2 0,01

2 0,46 2 0,177 0,354 .

1 5

300 6

6 6

Пример 1.28. Какова вероятность того, что среди 500 наугад выбранных человек двое родились 18 мая?

Решение. Будем считать, что день рождения наугад взятого

человека может быть с равной вероятностью любым из 365 дней

1

года. Имеем n = 500, k = 2, p

. Так как n велико, а p мало

365

500

1,37 , то воспользуемся формулой Пуассона:

np

365

2 1,37 2 1,37

P500 2

e

e

0 ,24 .

2!

2

Замечание. От схемы независимых повторных испытаний с

двумя исходами (схема Бернулли, или биномиальная схема)

можно перейти к полиномиальной схеме, т.е. к схеме повторных

независимых испытаний, в каждом из которых возможны m исходов (m > 2) с вероятностями p1 , p2 , ..., pm , при условии, что

m

0 pi 1, pi 1 . Тогда вероятность того, что в таких n исi 1

пытаниях 1-й исход появится n1 раз, 2-й исход n2 раз, ..., m-й

исход nm раз ( n1 n2 ... nm n ) равна

Pn n1 , n2 , ..., nm

n!

nm

p1n1 p2n2 ... pm

.

n1 ! n2 ! ... nm !

1.8 Контрольные вопросы

1. Что понимается под множеством элементарных исходов,

связанного с данным опытом? Приведите пример.

2. Что называется случайным событием в опыте? Чем характеризуется невозможное и достоверное событие?

3. Что такое сумма, произведение, разность двух событий?

42

Какое событие называется противоположным событию А?

Приведите примеры.

4. Что называется относительной частотой события? Как определяется вероятность события статистически?

5. Как определяется вероятность события в опытах с конечным числом одинаково возможных исходов (классическое определение вероятности)?

6. Как определяется вероятность события в опытах с непрерывным множеством исходов (геометрическая вероятность)?

Дайте геометрическое определение вероятности события.

7. Как определяется вероятность события аксиоматически?

8. Чему равна вероятность суммы 2-х событий в двух случаях: а) события несовместны; б) события совместны?

9. Как вычисляется число размещений из n элементов по m

а) без повторений; б) с повторениями?

10. Как вычисляется число сочетаний из n элементов по m

а) без повторений; б) с повторениями?

11. Что называется условной вероятностью события А при

выполнении события В?

12. Что означает независимость 2-х случайных событий; независимость в совокупности и попарная независимость для событий A1, ..., An?

13. Чему равна вероятность произведения 2-х событий в

двух случаях: а) события независимы; б) события зависимы?

14. Что называется полной группой событий в опыте?

15. В чём состоит формула полной вероятности?

16. В чём состоит формула Байеса?

17. Что понимается под схемой Бернулли независимых повторных испытаний? Запишите формулу Бернулли для вычисления величин Pn(k).

18. Запишите локальную приближённую формулу Лапласа.

В каком случае её применяют для вычисления Pn(k)?

19. Запишите интегральную приближённую формулу Лапласа. В каком случае её применяют для вычисления Pn(k1 k k2)?

20. Запишите приближённую формулу Пуассона. В каком

случае её применяют для вычисления Pn(k)?

43

1.9 Задачи

1.9.1 Задачи с решениями

1. Три шара а, b, с наугад распределяются по двум ящикам

(ящик № 1 и ящик № 2). Наблюдаемый результат – состав шаров в ящиках. Построить множество элементарных исходов и

подмножества, соответствующие указанным событиям:

А = {существует пустой ящик}; В = {ящик № 1 не пуст};

С = {нет пустых ящиков}; D = {в ящике № 2 только один шар};

Е = {в ящике № 2 не более двух шаров}; F = {шар а не попал в

ящик № 1}; G = {шары a и b не попали в один ящик}.

Решение. Множество элементарных исходов удобно описать таблицей:

Наблюдаемый

исход

ящик №1

ящик №2

1

2

3

4

5

6

7

8

abc

abc

ab

c

c

ab

ac

b

b

ac

bc

a

a

bc

Итак, = {1, 2, ..., 8} (общее число исходов равно 8). Тогда

А = {1, 2}, B = {1, 3, 4, 5, 6, 7, 8} = – {2},

C = {3, 4, 5, 6, 7, 8}, D = {3, 5, 7},

E = {1, 3, 4, 5, 6, 7, 8} = B, F = {2, 4, 6, 7 },

G = {5, 6, 7, 8 }.

2. Опыт – два человека X и Y одновременно показывают

друг другу либо 1, либо 2, либо 3 пальца на руке. Наблюдаемый

результат – пара чисел (x, y), где x – количество пальцев, показанных человеком X, а y – количество пальцев, показанных Y.

Описать множество элементарных исходов и события:

А = {показано одинаковое количество пальцев}, В = {общее

число показанных пальцев больше трёх}, С = {у одного человека число показанных пальцев больше на один, чем у другого}.

Решение. Множество элементарных исходов

= {(1, 1), (1, 2), (1, 3), (2, 1), (2, 2), (2, 3), (3, 1), (3, 2), (3, 3)}

состоит из 9 исходов. Все перечисленные события могут быть

описаны как подмножества : A = {(1, 1), (2, 2), (3, 3)};

44

B = {(1, 3), (2, 2), (2, 3), (3, 1), (3, 2), (3, 3)};

C = {(1, 2), (2, 1), (2, 3), (3, 2)}.

3. Из полной колоды карт (52 карты) вынимается наугад

одна карта. Рассмотрим события A = {появления туза}, B = {появление карты красной масти}, C = {появление карты чёрной

масти}. Указать, в чём состоят события:

1) A + B; 2) A B ; 3) B + C; 4) B C ; 5) A + C; 6) A C .

Решение. 1) Из определения суммы событий следует, что

A + B = {взятая карта или туз, или красной масти};

2) событие A B состоит в том, что одновременно происходит и событие A и событие B, т.е. A B = {взятая карта – туз

красной масти};

3) B + C = {появление карты или красной, или чёрной масти} = ;

4) B C = – невозможное событие, так как карта одновременно не может быть красной и чёрной;

5) A + C = {карта или туз, или чёрной масти};

6) A C = {карта – туз чёрной масти}.

4. На отрезке [a, b] наугад ставится точка. Пусть х – координата этой точки. Затем на отрезке [a, х] наугад ставится ещё

одна точка с координатой y. Наблюдаемый результат – пара чисел (x, y). Построить множество элементных исходов и события А = {расстояние между точками x и y меньше половины

длины отрезка [a, b]}, В = {1-я точка ближе ко 2-й, чем к правому концу отрезка [a, b]}, С = {2-я точка ближе к правому концу отрезка [a, b], чем к левому}.

Решение. Множество

x , y a x b, a y x ,

подмножества, равносильные событиям А, В и С, имеют вид:

ba

x , y x y

,

2

B x , y x y b x y 2 x b ,

a b

C x , y b y y a y

.

2

45

Все множества изображены на рисунке.

y

b

b

y

b

A

a

b

b

y

C

B

a

a

y

x

a

x a

a ab b

a ab b

2

2

x

a

b

5. Два баскетболиста по очереди бросают мяч в корзину до

1-го попадания (1-й баскетболист бросает первым). Выигрывает

тот, кто первым забросит мяч. Рассмотрим события:

Ak = {1-й баскетболист попадает при своём k-м броске},

Bk = {2-й баскетболист попадает при своём k-м броске}. Записать множество элементарных исходов и события A = {выигрывает 1-й баскетболист}, В = {выигрывает 2-й баскетболист},

используя события Ak и Bk.

Решение. Пусть Х – число бросаний мяча до первого попадания (включительно). Тогда элементарные исходы этой игры

i можно записать так: i X i , i . Выразим i через

Ak, Bk: 1 A1 , 2 A1 B1 , 3 A1 B1 A2 , 4 A1 B1 A2 B2 , ... .

Итак, 1 , 2 ,... – счётное множество элементарных исходов, события A 1 , 3 , 5 , ... , B 2 , 4 , 6 , ... .

6. Оценить вероятности угадать на одну карточку игры

«Спортлото 5 из 36» ровно 3, 4, 5 номеров.

Решение. Участник лотереи из 36 номеров отмечает 5 номеров. После того как участник сдал карточку, проводится выборка пяти номеров. Множеством элементарных исходов будет

множество неупорядоченных выборок 5-ти номеров из 36. Число

5

таких выборок n C 36

. Пусть Ak = {k номеров, отмеченных

участником лотереи, попало в выборку}, где k = 3, 4, 5. Число

исходов, благоприятствующих событию Ak, подсчитаем так:

представим множество 36-ти чисел как сумму двух множеств.

Первое состоит из 5-ти выигравших, а второе из 31 не выигравших. Событие Ak можно выполнить так: из первого множества

46

берём k номеров наугад ( C 5k способов), а из второго множества

5k

берём (5 – k) оставшихся номеров ( C 31

способов). Поэтому, по

5 k

правилу умножения, n Ak C 5k C 31

. Так как все исходы равновозможные, то используем классическое определение вероят5 k

n Ak C 5k C 31

ности: P Ak

(см. пример 1.9).

5

n

C 36

Итак, вероятность выигрыша 3-х номеров

5 4 3 31 30

2

C 53 C 31

1

2

3

1 2

P A3

0 ,012 ;

5

36 35 34 33 32

C 36

1 2 34 5

вероятность выигрыша 4-х номеров

5 31

1

C 54 C 31

1 1

P A4

0 ,0004 ;

5

36 35 34 33 32

C 36

1 2 3 4 5

вероятность выигрыша 5-ти номеров

0

C55C31

1

P A5 5

3 106 .

36

35

34

33

32

C36

1 2 3 4 5

7. Ребёнок играет с 10-ю буквами разрезной азбуки а, а, а,

е, и, к, м, м, т, т. Найти вероятность того, что, расположив их

в ряд в случайном порядке, он получит слово «математика» (событие А).

Решение. Для удобства будем считать все рассматриваемые

буквы различимыми, например, занумеровав повторяющиеся

буквы: а1, а2, а3, е, и, к, м1, м2, т1, т2. Тогда число всех элементарных исходов n будет равно числу перестановок десяти

элементов (букв): n P10 10 ! . Число исходов n A , благоприятствующих появлению события А, можно подсчитать так:

слово «математика» не изменяется при возможных перестановках его трёх букв а между собой. Число таких перестановок

47

равно P3 3! . Аналогично и для повторяющихся букв м и т.

Поэтому, n A P3 P2 P2 , значит

P A

n A

n

3! 2! 2!

1

.

10 !

151200

8. Имеем 10 букв разрезной азбуки а, а, а, б, б, б, б, о, о, о.

Найти вероятность того, что, вынув наугад последовательно 6

букв, получим слово «баобаб» (событие A).

Решение. Как и в предыдущем примере считаем повторяющиеся буквы различимыми. Число всех элементарных исходов

n равно числу размещений (важен порядок) из 10 букв по 6,

6

т.е. n A10

(здесь исходами являются 6-ти буквенные сло-

ва). Число исходов n A , благоприятствующих появлению события А, можно подсчитать так: слово «баобаб» не изменится,

если его три буквы б выбирать из четырёх данных букв б

( A43 способов, так как порядок по-прежнему важен), две буквы а

из 3-х данных букв а ( A32 способов), одну букву о из 3-х данных

букв о ( A31 способов). Согласно правилу умножения имеем

n A A43 A32 A31 . Поэтому,

P A

n A

n

A43 A32 A31

6

A10

4 3232 3

1

.

10 9 8 7 6 5 350

9. За круглым столом имеются N мест и случайным образом рассаживаются N человек (N > 2). Найти вероятность того,

что два фиксированных лица X и Y окажутся рядом (событие А).

Решение. Множеством элементных исходов является

множество всех перестановок N человек по N местам, поэтому

число исходов n N ! .Определим число перестановок, в

которых данные два человека X и Y окажутся рядом. Могут

быть следующие случаи: X сидит на 1-м месте, а Y на 2-м; X на

2-м, а Y на 3-м, ... Таких парных мест за круглым столом будет

N штук. Кроме того, X и Y можно поменять местами, и, следовательно, существует 2N способов размещения X и Y. Каждому из

48

этих способов соответствуют (N–2)! перестановок других лиц

на оставшиеся N–2 мест.

Итак, по правилу умножения имеем n A 2 N N 2 ! ,

поэтому

P A

n A

n

2 N N 2 !

N!

2 N N 2 !

N 2 ! N 1 N

2

.

N 1

Замечание. Если стол прямоугольный и N человек рассаживаются случайно по N местам вдоль одной из сторон, то

2 N 1 N 2 ! 2 N 1 ! 2

P A

.

N!

N!

N

10. Из последовательности чисел {1, 2, ..., n} наугад берут

два числа. Какова вероятность события A = {одно из чисел

меньше k, а другое больше k}, где k – натуральное число, такое

что 1 < k < n .

Решение. Множеством элементарных исходов является

множество сочетаний из n чисел по 2 (порядок не важен), поэтому, n C n2 . Подсчитаем число исходов n(A), благоприятствующих событию A. Чисел, меньших k, в данной последовательности (k –1) штук, а чисел, больших k будет (n – k) штук,

поэтому, по правилу умножения n(A) = (k – 1)(n – k). Вероятность события A:

n A k 1 n k 2 k 1 n k

P A

.

n

n n 1

C n2

11. В лифт семиэтажного дома на первом этаже вошли 3

человека. Пусть каждый из них с одинаковой вероятностью выходит на любом из этажей, начиная со второго. Найти вероятности событий: А = {все пассажиры выйдут на седьмом этаже};

B = {все пассажиры выйдут одновременно}; C = {все пассажиры выйдут на разных этажах}.

Решение. Наблюдаемый результат – номера этажей выхода