Использование регуляризации Elastic Net для моделей с большим количеством признаков

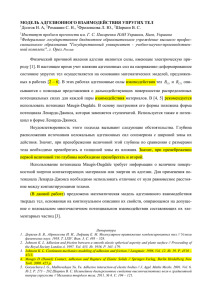

реклама

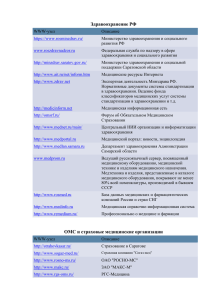

Министерство науки и высшего образования Российской Федерации НАЦИОНАЛЬНЫЙ ИССЛЕДОВАТЕЛЬСКИЙ ТОМСКИЙ ГОСУДАРСТВЕННЫЙ УНИВЕРСИТЕТ (НИ ТГУ) Институт прикладной математики и компьютерных наук Кафедра теоретических основ информатики РЕФЕРАТ по дисциплине «Введение в интеллектуальный анализ данных» на тему «Использование регуляризации Elastic Net для моделей с большим количеством признаков» Выполнил: студент группы №932335 ______________ Н.В. Билинский подпись Проверил: Преподаватель ______________ С.В. Карев подпись _______________________ зачтено / не зачтено Томск – 2023 Оглавление Введение .........................................................................................................................................3 Основная часть...............................................................................................................................4 1 Регуляризация и её виды ........................................................................................................4 2 Применение Elastic Net к моделям с большим количеством признаков ...........................8 Заключение...................................................................................................................................10 Список использованных источников и литературы .................................................................11 2 ВВЕДЕНИЕ С ростом сложности моделей машинного обучения и увеличением количества доступных данных, возникают две ключевые проблемы: переобучение и избыточность признаков. Проблема переобучения заключается в том, что модель слишком тщательно подстраивается под тренировочные данные, вплоть до заучивания шума в них, вместо обобщения общих закономерностей. Это приводит к потере способности модели к адаптации к новым данным и, следовательно, к неверным прогнозам. При наличии переобучения модели машинного обучения показывают отличную эффективность на обучающем наборе данных, но не справляются с новыми, неизвестными данными. Подобно педантичному учёному, модель, столкнувшаяся с переобучением, «застревает» на мельчайших деталях, упуская из виду глобальную картину [1]. С переобучением сталкиваются особенно сложные модели с большим количеством параметров, которые имеют потенциал "запоминать" тренировочные данные вместо извлечения оттуда общие закономерности. Вторая проблема — избыточность признаков — возникает, когда количество использованных в модели признаков превышает количество действительно информативных переменных (особенно ярко данная проблема проявляется, когда количество признаков в дата-сете превышает число доступных наблюдений). Избыточные (redundant) признаки не привносят дополнительной информации относительно существующих [2]. Избыточность признаков приводит к усложнению модели, увеличивая ее размер и требования к вычислительным ресурсам, при этом не всегда улучшая ее предсказательные способности. Это особенно актуально в случаях, когда признаки взаимосвязаны, что может вызвать коллинеарность и затруднить интерпретацию модели. Для борьбы с данными проблемами существует достаточно много методов. Так, с переобучением помогают справится: регуляризация, увеличение набора данных, прореживание (dropout), кросс-валидация и ранняя остановка [1]. Для выявления и избавления от избыточных признаков используется регуляризация (только L1 и Elastic Net), корреляционный анализ, понижение размерности, методы вложенного отбора. Далее остановимся только на регуляризации, так как именно она помогает решать проблемы избыточности признаков и переобучения, и более подробно рассмотрим Elastic Net, как наиболее оптимальный метод регуляризации для моделей с большим количеством признаков. 3 ОСНОВНАЯ ЧАСТЬ 1 Регуляризация и её виды Регуляризация – это способ борьбы с переобучением модели машинного обучения, который заключается в накладывании «штрафов» (коэффициентов) на большие веса, которые и приводят модель к избыточной сложности и переобучению. Существует несколько способов регуляризации: L1 (Lasso) регуляризация, L2 (Ridge) регуляризация и Elastic Net (эластичная сеть, комбинация L1 и L2 регуляризаций). Математически эти виды регуляризаций определяются следующим образом: 𝐿1 = ∑ ||𝑦 − 𝑋𝑤 ||22 + 𝜆1 ∑||𝑤|| → 𝑚ⅈ𝑛 1 Где, ‖𝑦 − 𝑋𝑤‖22 – квадратичная ошибка (MSE), а 𝜆1 ||𝑤||1 – абсолютный регуляризатор с параметром регуляризации 𝜆1 . Сумма квадратичной ошибки и абсолютного регуляризатора должна стремится к минимальному значению. 2 𝐿2 = ∑ ||𝑦 − 𝑋𝑤 ||22 + 𝜆2 ∑||𝑤|| → 𝑚ⅈ𝑛 2 Где, ‖𝑦 − 𝑋𝑤‖22 – квадратичная ошибка (MSE), а 𝜆2 ||𝑤||22 – квадратичный регуляризатор с параметром регуляризации 𝜆2 . Сумма квадратичной ошибки и квадратичного регуляризатора должна стремится к минимальному значению [3]. Elastic Net = ∑ ||𝑦 − 𝑋𝑤 ||22 + 𝛼 𝜆1 ∑||𝑤|| 1 2 + (1 − 𝛼) 𝜆2 ∑||𝑤|| → 𝑚ⅈ𝑛 Где, ‖𝑦 − 𝑋𝑤‖22 – квадратичная ошибка (MSE), 𝜆1 ||𝑤||1 2 – абсолютный регуляризатор с параметром регуляризации 𝜆1 , 𝜆2 ||𝑤||22 – квадратичный регуляризатор с параметром регуляризации 𝜆2 , а 𝛼 – параметр, который называется параметром смешивания, изменяется от 0 до 1, где 0 соответствует L2 регуляризации без L1, а 1 соответствует L1 регуляризации без L2. Сумма квадратичной ошибки, абсолютного и квадратичного регуляризаторов должна стремится к минимальному значению [4]. Регуляризация L1, которая генерирует разреженные решения и основана на абсолютных значениях параметров модели, полезна для выбора объектов. В отличие от этого, регуляризация L2 дает не разреженные решения и основана на квадратах параметров модели, что делает ее полезной для построения более простых моделей. Разберёмся более детально в разнице между L1 и L2 регуляризациями [5]: 4 Регуляризация L1 Регуляризация L2 Штрафной коэффициент основан на Штрафной коэффициент термин основан абсолютных значениях параметров на квадратах параметров модели. модели. Дает разреженные решения (некоторые Дает не разреженные решения (все избыточные параметры сокращаются до параметры остаются для использования нуля). моделью). Чувствительна к выбросам. Устойчива к выбросам. Выбирает подмножество наиболее важных Все функции используются моделью. функций. Оптимизация невыпуклая. Оптимизация является выпуклой. Штрафной коэффициент менее Штрафной коэффициент более чувствителен к коррелированным чувствителен к коррелированным признакам. признакам. Полезна при работе с многомерными Полезна при работе с многомерными данными со многими коррелированными данными со многими коррелированными характеристиками. характеристиками и когда цель состоит в том, чтобы иметь менее сложную модель. Наиболее наглядно и понятно объяснить почему L1 и L2 регуляризаторы ведут так себя по-разному можно графическим способом (рисунок 1). Рисунок 1 – Пересечение множества функции потерь с множествами различных регуляризаторов в 2-мерном признаковом пространстве [6] 5 Рассмотрим для простоты 2-мерное признаковое пространство с весовыми коэффициентами ɵ1 и ɵ2. Область с ɵOpt обозначает значения коэффициентов весов, где функция потерь достигает минимума, куда и стремится значение антиградиента. Когда модель обучается без регуляризации, то именно центр этой области со значением минимальной функции потерь функция пытается обнаружить. При добавлении же регуляризации к обучению модели добавляются дополнительное условие со множеством точек удовлетворяющих регуляризатору. L1 регуляризатор изображается в виде ромба, так как при его расчёте используется невыпуклая функция модуля, а множество точек для L2 регуляризатора представляет собой круг, так как при его расчёте используется выпуклая квадратическая функция. Нетрудно догадаться, что геометрия признакового пространства Elastic Net (L1 + L2) представляет собой что-то среднее между признаковым пространством L1 и L2, причём чем больше в эластичной сети преобладание L1 регуляризатора над L2, тем более угловатой и невыпуклой она будет. В итоге суммируя множество функции потерь и множество функции регуляризации, получается более сложная форма поверхности оптимизируемой функции в пространстве признаков с новой точкой минимума, которая находится на пересечении кривых уровня этих двух составляющих, благодаря чему градиентный алгоритм устремляется именной к этой новой точке минимума. При L1 регуляризаторе вероятность соприкоснуться области функции потерь с одним из углов множества регуляризатора (которое имеет форму ромба) гораздо выше, чем с её гранью. При этом, в таком случае, один из двух признаков будет строго ненулевой, а один строго нулевой. Именно поэтому и происходит явное обнуление неинформативных признаков при L1-регуляризации. При использовании L2 регуляризатора множество точек имеет форма круга, и результирующая точка минимума не лежит строго на одной из координатных осей, соответствующих признаковому пространству, и обнуление менее значимого признака здесь уже не происходит. Стоит помнить, что L1 регуляризатор не полностью гарантирует обнуление всех незначимых признаков. Этот эффект проявляется лишь с некоторой большой вероятностью, но вполне может получится так, что область функции потерь может соприкоснуться со множеством регуляризатора не на углу, а на грани, в таком случае линейно-зависимые признаки не обнулятся, и вероятность такого события и не велика, но и не равно нулю [7]. Использование Elastic Net позволяет достаточно виртуозно комбинировать основные плюсы от L1 и L2 регуляризаторов: занулять незначимые признаки от L1 регуляризации и более лучше нормировать веса от L2 регуляризации. Elastic Net 6 регуляризация добавляет к функции потерь сумму абсолютных значений весов и сумму квадратов весов с различными коэффициентами. Это позволяет модели одновременно отбирать наиболее значимые признаки и сглаживать веса [8]. Преимущества применения метода Elastic Net в регуляризации моделей заключаются в его способности обрабатывать коллинеарные переменные, сохранять интерпретируемость модели и обеспечивать устойчивость в случае наличия большого числа предикторов. Кроме того, данный метод позволяет эффективно работать с выбросами и улучшает качество моделей при наличии зависимых переменных. Алгоритм Elastic Net оказывается особенно полезным в случае, когда имеется большое количество коррелирующих предикторов. Он выбирает наиболее значимые переменные, сокращая количество признаков и улучшая качество модели [9]. 7 2 Применение Elastic Net к моделям с большим количеством признаков Ранее были рассмотрены преимущества применения метода Elastic Net по сравнению с L1 и L2 регуляризациями. Использование метода Elastic Net является эффективным инструментом для регуляризации моделей в задачах с большим количеством признаков и потенциальной мультиколлинеарностью [8]. В современном мире, где объемы данных постоянно увеличиваются, становится необходимым извлекать ценную информацию и закономерности из комплексных и многомерных данных. Однако с ростом числа признаков модель становится сложнее, что может привести к утрате обобщающей способности и переобучению. Также обработка больших объемов данных со множеством признаков требует значительных вычислительных ресурсов, что вынуждает достаточно быстро и эффективно избавляться от ненужных и неинформативных признаков, не потеряв при этом ценной информации. И как раз одним из ключевых преимуществ Elastic Net является его способность обрабатывать высокомерные наборы данных. Одним из преимуществ Elastic Net по сравнению с регрессией Lasso и регрессией Ridge является то, что она может быть более стабильной и давать лучшие результаты в случаях, когда количество признаков намного больше, чем количество наблюдений или, когда отношения между признаками сложны. Однако Elastic Net также более чувствителен к выбору силы регуляризации λ и параметра смешивания α и может потребовать дополнительной настройки для получения хороших результатов. Важно отметить, что Elastic Net не ограничивается линейной регрессией и может применяться к другим типам моделей, таким как логистическая регрессия, обобщенные линейные модели, модели SVM и нейронные сети [10]. Традиционные методы регрессии часто испытывают затруднения при работе с данными с большим количеством признаков из-за проблемы размерности. Elastic Net может эффективно обрабатывать эти высокомерные наборы данных, автоматически выбирая значимые признаки и уменьшая коэффициенты незначимых. Это означает, что данный регуляризатор может выбрать одну из коррелирующих переменных, уменьшая коэффициенты остальных, что приводит к более стабильной и понятной модели. Elastic Net решает также проблему мультиколлинеарности, вводя штрафной термин, который способствует проредению модели. Для оптимизации предиктивных моделей с использованием Elastic Net важно правильно обработать данные. Это включает работу с отсутствующими значениями, масштабирование признаков и адекватное кодирование категориальных переменных. 8 Предварительная обработка гарантирует, что данные имеют подходящий формат для Elastic Net и помогает улучшить производительность модели. Поскольку Elastic Net автоматически выбирает значимые признаки, важно правильно идентифицировать наиболее информативные. Это можно сделать с помощью таких техник, как унивариативный отбор признаков, рекурсивное исключение признаков или даже с помощью предметных знаний. Выбрав правильный набор признаков можно повысить точность и интерпретируемость результатов регуляризации обучаемой модели [11]. Регуляризация Elastic Net активно применяется для улучшения качества моделей задач регрессии и классификации с большим количеством признаков и активно находит своё отражения в научных статьях. Регуляризация Elastic Net автоматически выполняет отбор признаков и способствует тому, что сильно коррелированные признаки отбираются или удаляются вместе. Благодаря этому свойству она широко применяется для решения высокоразмерных задач статистического обучения, особенно для решения задач отбора генов при классификации данных микрочипов [12]. В методологии исследования влияния экологических и демографических факторов на успеваемость детей в округе Лос-Анджелес используется обобщенная линейная модель с эластичной чистой регуляризацией, которая обеспечивает баланс как строгих, так и гибких подходов к исключению коррелированных переменных-предикторов [13]. Эластичная сетевая регрессия смогла представить более упорядоченную модель для выявления изменения в гражданских целях в период становления взрослой жизни [14]. 9 ЗАКЛЮЧЕНИЕ В рассмотренном реферате были выделены и исследованы ключевые аспекты применения метода Elastic Net в контексте моделей машинного обучения с большим количеством признаков. На основе проведенного анализа можно сделать несколько важных выводов. Во-первых, Elastic Net действительно проявляет свою эффективность в регуляризации моделей, особенно в условиях, когда количество признаков существенно превышает количество наблюдений. Этот метод предлагает баланс между L1 и L2 регуляризацией, что позволяет справляться с проблемами переобучения и избыточности признаков. Во-вторых, Elastic Net может быть более стабильным и эффективным по сравнению с регрессиями Lasso и Ridge в случаях, когда количество признаков существенно превышает количество наблюдений или когда взаимосвязи между признаками сложны. Однако следует отметить, что правильный выбор параметров регуляризации (сила регуляризации и соотношение типов L1 и L2 ) имеет критическое значение для достижения хороших результатов. В-третьих, Elastic Net не ограничивается применением в линейной регрессии, и может успешно применяться к различным типам моделей. Это расширяет область применения метода и делает его универсальным инструментом в машинном обучении. Однако следует отметить, что Elastic Net требует внимательной настройки параметров для достижения оптимальных результатов. Кроме того, для оптимизации моделей с использованием Elastic Net важно правильно обрабатывать данные, включая работу с отсутствующими значениями, масштабирование признаков и адекватное кодирование категориальных переменных. В целом, метод Elastic Net представляет собой отличный инструмент для регуляризации моделей с большим количеством признаков, и его применение демонстрирует значительный потенциал для повышения производительности и обобщающей способности моделей в условиях современных объемов и сложности данных. 10 СПИСОК ИСПОЛЬЗОВАННЫХ ИСТОЧНИКОВ И ЛИТЕРАТУРЫ Интернет-ресурсы: Переобучение модели: сущность и влияние на результаты // DECOsystems 1. URL: https://www.decosystems.ru/pereobuchenie-modeli-v-mashinnom-obuchenii/ (дата обращения: 26.12.2023). Выбор 2. признаков // ifmo.ru URL: https://neerc.ifmo.ru/wiki/index.php?title=Выбор_признаков (дата обращения: 26.12.2023). L1 3. и L2 регуляризация // Python School URL: https://python- school.ru/blog/regularization-l1-l2/ (дата обращения: 26.12.2023). Линейная регрессия и её регуляризация в Scikit-learn // Teletype URL: 4. https://teletype.in/@pythontalk/linreg_regularisation#vAvQ (дата обращения: 26.12.2023). 5. Difference between L1 and L2 regularization? // tutorialspoint URL: https://www.tutorialspoint.com/difference-between-l1-and-l2-regularization (дата обращения: 26.12.2023). 6. L1-Norm-Lasso // mavink.com URL: https://mavink.com/post/B53337B5F16F0A20B307D99075A7D14D69AM621DA2/l1-normlasso (дата обращения: 26.12.2023). 7. L1-регуляризатор. Отличия между L1- и L2-регуляризаторами // ProProprogs.ru URL: https://proproprogs.ru/ml/ml-l1-regulyarizator-otlichiya-mezhdu-l1-i-l2regulyarizatorami (дата обращения: 26.12.2023). Основы сетей регуляризации: защита нейронных сетей от переобучения // 8. Научные Статьи.Ру URL: https://nauchniestati.ru/spravka/seti- regulyarizaczii/#Elastic_Net_регуляризация (дата обращения: 27.12.2023). Как использовать ElasticNet для регуляризации модели // nasmorku-net.ru 9. URL: https://nasmorku-net.ru/kak-ispolzovat-elasticnet-dlya-regulyarizacii-modeli/ (дата обращения: 27.12.2023). 10. Elastic Net? что это такое? И почему вы должны его использовать? // scine.ru URL: https://skine.ru/articles/675092/ (дата обращения: 27.12.2023). 11. Оптимизация предиктивных моделей при помощи AI ElasticNet: техники и лучшие практики // Ts2 Space URL: https://ts2.space/ru/оптимизация-предиктивныхмоделей-пр/#gsc.tab=0 (дата обращения: 27.12.2023). 11 Опубликованная литература: 12. Rongmei Liang, Xiaofei Wu, Zhimin Zhang: Linearized alternating direction method of multipliers for elastic-net support vector machines // 2023 13. Bita Minaravesh, Orhun Aydin: Environmental and demographic factors affecting childhood academic performance in Los Angeles County: A generalized linear elastic net regression model // 2023 14. Hyemin Han, Kelsie J. Dawson: Applying elastic-net regression to identify the best models predicting changes in civic purpose during the emerging adulthood // Программа педагогической психологии, Университет Алабамы, США. – 2021 12