Корреляционный анализ

реклама

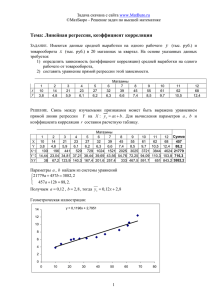

Корреляционный анализ • Пусть у нас имеются n серии значений двух параметров X и Y: (x1;y1),(x2;y2),...,(xn;yn). Подразумевается, что у одного и того же объекта измерены два параметра. Нам надо выяснить есть ли значимая связь между этими параметрами. • Как известно, случайные величины X и Y могут быть либо зависимыми, либо независимыми. Существуют следующие формы зависимости – функциональная и статистическая. В математике функциональной зависимостью переменной Y от переменной Х называют зависимость вида y=f(x), где каждому допустимому значению X ставится в соответствие по определенному правилу единственно возможное значение Y. • Например, в функции Y = 2X каждому значению X соответствует в два раза большее значение Y. В функции Y = 2X2 каждому значению Y соответствует 2 определенных значения X. • Однако, если X и Y случайные величины, то между ними может существовать зависимость иного рода, называемая статистической. Дело в том, что на формирование значений случайных величин X и Y оказывают влияние различные факторы. Под воздействием этих факторов и формируются конкретные значения X и Y. Допустим, что на Х и У влияют одни те же факторы, например Z1, Z2, Z3, тогда X и Y находятся в полном соответствии друг с другом и связаны функционально. Предположим теперь, что на X воздействуют факторы Z1, Z2, Z3, а на только Y и Z1, Z2. Обе величины и X и Y являются случайными, но так как имеются общие факторы Z1 и Z2, оказывающие влияние и на X и на Y, то значения X и Y обязательно будут взаимосвязаны. • И связь это уже не будет функциональной: фактор Z3, влияющий лишь на одну из случайных величин, разрушает прямую (функциональную) зависимость между значениями X и Y, принимаемыми в одном и том же испытании. Связь носит вероятностный случайный характер, в численном выражении меняясь, от испытания к испытанию, но эта связь определенно присутствует и называется статистической. При этом каждому значению X может соответствовать не одно значение Y, как при функциональной зависимости, а целое множество значений. • Зависимость случайных величин называют статистической, если изменения одной из них приводит к изменению закона распределения другой. • Если изменение одной из случайных величин влечет изменение среднего другой случайной величины, то статистическую зависимость называют корреляционной. Сами случайные величины, связанные корреляционной зависимостью, оказываются коррелированными. • Существует два базовых инструмента, с помощью которых анализируются двухмерные данные: корреляционный анализ и регрессионный анализ, который показывает, как можно предсказать поведение одной из двух переменных или управлять ею с помощью другой. • Задача корреляционного анализа сводится к установлению направления и формы связи между признаками, измерению ее тесноты и к оценке достоверности выборочных показателей корреляции. • Корреляционная связь между признаками может быть линейной и криволинейной (нелинейной), положительной и отрицательной. Прямая корреляция отражает однотипность в изменении признаков: с увеличением значений первого признака увеличиваются значения и другого, или с уменьшением первого уменьшается второй. • Обратная корреляция указывает на увеличение первого признака при уменьшении второго или уменьшение первого признака при увеличении второго. • Примерами коррреляционной зависимости являются: зависимость массы от роста: - каждому значению роста (X) соответствует множество значений массы (Y), причем, несмотря на общую тенденцию, справедливую для средних, большему значению роста соответствует и большее значение массы – в отдельных наблюдениях субъект с большим ростом может иметь и меньшую массу. - зависимость заболеваемости от воздействия внешних факторов, например, запыленности, уровня радиации, солнечной активности и т.д. - количество (X) вводимого объекту препарата и его концентрация в крови (Y). - между показателями уровня жизни населения и процентом смертности; - между количеством пропущенных студентами лекций и оценкой на экзамене. Именно корреляционные зависимости наиболее часто встречаются в природе в силу взаимовлияния и тесного переплетения огромного множества самых различных факторов, определяющих значения изучаемых показателей. Коэффициент корреляции • Коэффициент корреляции — это показатель взаимного вероятностного влияния двух случайных величин. Коэффициент корреляции R может принимать значения от -1 до +1. Если абсолютное значение находится ближе к 1, то это свидетельство сильной связи между величинами, а если ближе к 0 — то, это говорит о слабой связи или ее отсутствии. Если абсолютное значение R равно единице, то можно говорить о функциональной связи между величинами, то есть одну величину можно выразить через другую посредством математической функции. • На практике, для вычисления коэффициента корреляции чаще используется формула ( 1.4 ) т.к. она требует меньше вычислений. Однако если предварительно была вычислена ковариация cov(X,Y), то выгоднее использовать формулу ( 1.1 ), т.к. кроме собственно значения ковариации можно воспользоваться и результатами промежуточных вычислений. • Величина cov(X,Y) называется ковариацией случайных величин X и Y или корреляционным моментом. Коэффициент ковариации характеризует степень линейной зависимости двух случайных величин Х и Y и вычисляется по формуле: • Для независимых случайных величин ковариация будет равна нулю. Однако равенство cov(X, Y) = 0 не означает в общем случае полной независимости величин X и Y, т.е. оно является необходимым, но не достаточным условием для независимости признаков. • Величина ковариации зависит от единиц измерения (изменяется, например, при переходе от метров к сантиметрам). Поэтому на практике чаще используют другой показатель — коэффициент корреляции, который является величиной безразмерной. Свойства коэффициента корреляции. 1. Модуль |г| не меняется от прибавления к X и Y постоянных слагаемых и от умножения X и Y на положительные числа, т.е. при линейных преобразованиях случайных величин: образом, .Таким коэффициент корреляции не зависит от выбора начала отсчета и единиц измерения. 2. Если одну из величин умножить на -1, то коэффициент корреляции поменяет знак. 3. Коэффициент значения в интервале корреляции принимает Коэффициент корреляции может быть равен -1 или 1, только если X и Y линейно зависят друг от друга, т.е. если существует функциональная связь у(х) = Ь0 + Ь1х. Величина |г|, близкая к 1, указывает, что зависимость между данными случайными величинами почти линейная. Значения |г|, близкие к нулю, означают, что связь между случайными величинами либо слабая, либо не носит линейного характера. Таким образом, можно сделать вывод, что коэффициент корреляции характеризует степень приближения зависимости между случайными величинами к линейной функциональной зависимости. Если распределение величин X и Y близко к нормальному, то корреляция между ними линейная и выборочный коэффициент корреляции r является надежной оценкой генерального (теоретического) коэффициента ρ. Если r > 0, то связь между переменными положительная (прямая). Иначе говоря, можно утверждать, что с точностью до случайных погрешностей величины X и Y одновременно возрастают или убывают. При r < 0 связь отрицательная (обратная), т.е. с возрастанием одной величины другая имеет устойчивую тенденцию к убыванию. Коэффициент корреляции часто используют и при связях, отличающихся от линейных. Если |г| =0,8...0,9, то, независимо от реального вида связи, можно утверждать, что она достаточно тесна для того, чтобы можно было исследовать ее форму с помощью коэффициента корреляции. Отсутствует Слабая Умеренная Значительная Сильно выраженная Очень сильная Прямая Обратная 0 (0; 0,3) [0,3; 0,5) [0,5; 0,7) 0 (0; -0,3) [-0,3; -0,5) [-0,5; -0,7) [0,7; 0,9) [-0,7; -0,9) [0,9; 1] [-0,9; -1] Ошибка при интерпретации (даже еще при подсчете) коэффициента корреляции может быть допущена и в том случае, когда выборке присутствуют аномальные значения (очевидно большие или очевидно низкие). Они могут возникать, во-первых, из-за неоднородности исследуемых элементов выборки. Вовторых, - из-за ошибок. Например, снятые показания какого-либо прибора: 0 4 2 6 6 2 9 8 25 3 8 9 1 0 5 2 4 6 35 1 Одной такой ошибки оказывается достаточно для того, чтобы коэффициент корреляции очень существенно увеличился. 4. Ложная корреляция может также возникать при неслучайном отборе наблюдений для подсчета. Этот пункт некоторым образом противоположен предыдущему (первой части). Если там утверждалось, что аномальные значения желательно исключать из рассмотрения, то этот пункт предлагает делать это с осторожностью, чтобы своим умышленным влиянием не исказить подлинное положение вещей. xk yk хk2 yk2 хkyk 1 25.2 30.8 635.04000 948.64000 776.16000 2 26.4 29.4 696.96000 864.36000 776.16000 3 26.0 30.2 676.00000 912.04000 785.20000 4 25.8 30.5 665.64000 930.25000 786.90000 5 24.9 31.4 620.01000 985.96000 781.86000 6 25.7 30.3 660.49000 918.09000 778.71000 7 25.7 30.4 660.49000 924.16000 781.28000 8 25.7 30.5 660.49000 930.25000 783.85000 9 26.1 29.9 681.21000 894.01000 780.39000 10 25.8 30.4 665.64000 924.16000 784.32000 11 25.9 30.3 670.81000 918.09000 784.77000 12 26.2 30.5 686.44000 930.25000 799.10000 13 25.6 30.6 655.36000 936.36000 783.36000 14 25.4 31 645.16000 961.00000 787.40000 15 26.6 29.6 707.56000 876.16000 787.36000 16 26.2 30.4 686.44000 924.16000 796.48000 17 26 30.7 676.00000 942.49000 798.20000 18 22.1 31.6 488.41000 998.56000 698.36000 19 25.9 30.5 670.81000 930.25000 789.95000 20 25.8 30.6 665.64000 936.36000 789.48000 21 25.9 30.7 670.81000 942.49000 795.13000 22 26.3 30.1 691.69000 906.01000 791.63000 23 26.1 30.6 681.21000 936.36000 798.66000 24 26 30.5 676.00000 930.25000 793.00000 25 26.4 30.7 696.96000 942.49000 810.48000 26 25.8 30.8 665.64000 948.64000 794.64000 k 32 31.5 31 30.5 30 29.5 29 22 23 24 25 26 27 Полученный в примере коэффициент корреляции является выборочным, так как он определен для выборок из соответствующих генеральных совокупностей. Поэтому всегда существует ошибка коэффициента корреляции. Эта ошибка - расхождение между коэффициентом корреляции выборки объемом и коэффициентом корреляции для генеральной совокупности - определяется формулами: при ;и при . Оценка достоверности коэффициента линейной корреляции осуществляется с помощью -критерия Стьюдента: . В данном случае критерий служит для проверки нулевой гипотезы о том, что значение коэффициента корреляции для генеральной совокупности равно нулю, т.е. в генеральной совокупности отсутствует корреляция. Альтернативной является гипотеза . Критическое значение определяется по таблице Стьюдента. Число степеней свободы связано с объемом выборки формулой: . Если , то нуль-гипотеза отвергается, то есть вычисленный коэффициент корреляции значимо отличается от нуля с вероятностью • Пример. Коэффициент корреляции между показателями "Толчок штанги" и "Прыжок в высоту с места" для 13 тяжелоатлетов равен 0,855. Требуется оценить достоверность коэффициента корреляции Задача 1. Оценить значимость полученного коэффициента корреляции Таблица 2 t-распределение Число степеней свободы (n-2) α = 0.1 α = 0.05 α = 0.02 α = 0.01 α = 0.002 α = 0.001 1 6.314 12.706 31.821 63.657 318.31 636.62 2 2.920 4.303 6.965 9.925 22.327 31.598 3 2.353 3.182 4.541 5.841 10.214 12.924 4 2.132 2.776 3.747 4.604 7.173 8.610 5 2.015 2.571 3.365 4.032 5.893 6.869 6 1.943 2.447 3.143 3.707 5.208 5.959 7 1.895 2.365 2.998 3.499 4.785 5.408 8 1.860 2.306 2.896 3.355 4.501 5.041 9 1.833 2.262 2.821 3.250 4.297 4.781 10 1.812 2.228 2.764 3.169 4.144 4.587 11 1.796 2.201 2.718 3.106 4.025 4.437 12 1.782 2.179 2.681 3.055 3.930 4.318 13 1.771 2.160 2.650 3.012 3.852 4.221 14 1.761 2.145 2.624 2.977 3.787 4.140 15 1.753 2.131 2.602 2.947 3.733 4.073 16 1.746 2.120 2.583 2.921 3.686 4.015 17 1.740 2.110 2.567 2.898 3.646 3.965 18 1.734 2.101 2.552 2.878 3.610 3.922 19 1.729 2.093 2.539 2.861 3.579 3.883 20 1.725 2.086 2.528 2.845 3.552 3.850 21 1.721 2.080 2.518 2.831 3.527 3.819 22 1.717 2.074 2.508 2.819 3.505 3.792 23 1.714 2.069 2.500 2.807 3.485 3.767 24 1.711 2.064 2.492 2.797 3.467 3.745 25 1.708 2.060 2.485 2.787 3.450 3.725 26 1.706 2.056 2.479 2.779 3.435 3.707 27 1.703 2.052 2.473 2.771 3.421 3.690 28 1.701 2.048 2.467 2.763 3.408 3.674 29 1.699 2.045 2.462 2.756 3.396 3.659 30 1.697 2.042 2.457 2.750 3.385 3.646 40 1.684 2.021 2.423 2.704 3.307 3.551 60 1.671 2.000 2.390 2.660 3.232 3.460 120 1.658 1.980 2.358 2.617 3.160 3.373 ∞ 1.645 1.960 2.326 2.576 3.090 3.291 Задача: Имеется связанная выборка из 11 пар значений (хk,yk): Требуется вычислить - коэффициент ковариации; - коэффициент корреляции; - проверить гипотезу зависимости случайных величин X и Y, при уровне значимости α = 0.05 k 1 2 3 4 5 xk 51.00000 13.00000 50.00000 15.00000 48.00000 13.00000 51.00000 16.00000 46.00000 12.00000 yk k 6 7 8 9 10 11 xk 47.00000 14.00000 49.00000 12.00000 60.00000 10.00000 51.00000 18.00000 52.00000 10.00000 56.00000 12.00000 yk Регрессионный анализ • Основная особенность регрессионного анализа: при его помощи можно получить конкретные сведения о том, какую форму и характер имеет зависимость между исследуемыми переменными. • Последовательность этапов регрессионного анализа • Рассмотрим кратко этапы регрессионного анализа. • Формулировка задачи. На этом этапе формируются предварительные гипотезы о зависимости исследуемых явлений. • Определение зависимых и независимых (объясняющих) переменных. • Сбор статистических данных. Данные должны быть собраны для каждой из переменных, включенных в регрессионную модель. • Формулировка гипотезы о форме связи (простая или множественная, линейная или нелинейная). • Определение функции регрессии (заключается в расчете численных значений параметров уравнения регрессии) • Оценка точности регрессионного анализа. • Интерпретация полученных результатов. Полученные результаты регрессионного анализа сравниваются с предварительными гипотезами. Оценивается корректность и правдоподобие полученных результатов. • Предсказание неизвестных значений зависимой переменной. • При помощи регрессионного анализа возможно решение задачи прогнозирования и классификации. Прогнозные значения вычисляются путем подстановки в уравнение регрессии параметров значений объясняющих переменных. Решение задачи классификации осуществляется таким образом: линия регрессии делит все множество объектов на два класса, и та часть множества, где значение функции больше нуля, принадлежит к одному классу, а та, где оно меньше нуля, - к другому классу. • Задачи регрессионного анализа • Рассмотрим основные задачи регрессионного анализа: установление формы зависимости, определение функции регрессии, оценка неизвестных значений зависимой переменной. • Установление формы зависимости. • Характер и форма зависимости между переменными могут образовывать следующие разновидности регрессии: • положительная линейная регрессия (выражается в равномерном росте функции); • положительная равноускоренно возрастающая регрессия; • положительная равнозамедленно возрастающая регрессия; • отрицательная линейная регрессия (выражается в равномерном падении функции); • отрицательная равноускоренно убывающая регрессия; • отрицательная равнозамедленно убывающая регрессия. • Однако описанные разновидности обычно встречаются не в чистом виде, а в сочетании друг с другом. В таком случае говорят о комбинированных формах регрессии. Определение функции регрессии. Вторая задача сводится к выяснению действия на зависимую переменную главных факторов или причин, при неизменных прочих равных условиях, и при условии исключения воздействия на зависимую переменную случайных элементов. Функция регрессии определяется в виде математического уравнения того или иного типа. Оценка неизвестных значений зависимой переменной. Решение этой задачи сводится к решению задачи одного из типов: Оценка значений зависимой переменной внутри рассматриваемого интервала исходных данных, т.е. пропущенных значений; при этом решается задача интерполяции. Оценка будущих значений зависимой переменной, т.е. нахождение значений вне заданного интервала исходных данных; при этом решается задача экстраполяции. Обе задачи решаются путем подстановки в уравнение регрессии найденных оценок параметров значений независимых переменных. Результат решения уравнения представляет собой оценку значения целевой (зависимой) переменной. • Рассмотрим некоторые предположения, на которые опирается регрессионный анализ. • Предположение линейности, т.е. предполагается, что связь между рассматриваемыми переменными является линейной. Так, в рассматриваемом примере мы построили диаграмму рассеивания и смогли увидеть явную линейную связь. Если же на диаграмме рассеивания переменных мы видим явное отсутствие линейной связи, т.е. присутствует нелинейная связь, следует использовать нелинейные методы анализа. • Предположение о нормальности остатков. Оно допускает, что распределение разницы предсказанных и наблюдаемых значений является нормальным. Для визуального определения характера распределения можно воспользоваться гистограммами остатков. • При использовании регрессионного анализа следует учитывать его основное ограничение. Оно состоит в том, что регрессионный анализ позволяет обнаружить лишь зависимости, а не связи, лежащие в основе этих зависимостей. • Регрессионный анализ дает возможность оценить степень связи между переменными путем вычисления предполагаемого значения переменной на основании нескольких известных значений.