СПЕЦИФИКАЦИЯ ПЕРЕМЕННЫХ РЕГРЕССИИ

реклама

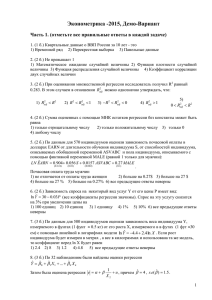

СПЕЦИФИКАЦИЯ ПЕРЕМЕННЫХ РЕГРЕССИИ • Определение последствий включения или невключения объясняющих переменных в регрессионную модель • Включение замещающих переменных в модель Вопросы неправильной спецификации регрессионной модели. 1 СПЕЦИФИКАЦИЯ ПЕРЕМЕННЫХ РЕГРЕССИИ Последствия некорректной спецификации модели Истинная модель Оцененная модель Y 1 2 X 2 u Y 1 2 X 2 3 X 3 u Yˆ b1 b2 X 2 Yˆ b1 b2 X 2 b3 X 3 Корректная спецификация, нет проблем Несмещенность коэффициентов. Корректность стандартных ошибок Коэффициенты смещены (как правило). Стандартные ошибки некорректны. Корректная спецификация, нет проблем • Невключение существенных переменных ведет к смещенности оценок коэффициентов и некорректности расчетов стандартных ошибок. • Лишние переменные приводят к неэффективности несмещенных оценок. 2 СПЕЦИФИКАЦИЯ ПЕРЕМЕННЫХ РЕГРЕССИИ: ОТСУТСТВИЕ ПЕРЕМЕННОЙ Y 1 2X 2 3X 3 u Y 1 2X 2 u Yˆ b1 b2 X 2 Cov( X 2 , X 3 ) E (b2 ) 2 3 Var( X 2) Предположим, что опущена переменная X3, которая не считается существенной. Если истинно первое уравнение, то b2 является оценкой 2,. Эта оценка будет смещенной на 3 Cov(X2, X3)/Var(X2) ≠ 0. 3 СПЕЦИФИКАЦИЯ ПЕРЕМЕННЫХ РЕГРЕССИИ: ОТСУТСТВИЕ ПЕРЕМЕННОЙ Y 1 2 X 2 3 X 3 u Yˆ b1 b2 X 2 Cov( X 2 , X 3 ) E (b2 ) 2 3 Var( X 2) Y Эффект X3 Эффект X2, при неизменности X3 X2 2 3 Кажущийся эффект X2, в качестве заменителя X3 X3 Переменная X2 в отсутствие X3 будет играть двойную роль: кажущаяся способность X2 объяснять поведение X3 и влияние X3 на Y, определяемую коэффициентом 3.. 4 СПЕЦИФИКАЦИЯ ПЕРЕМЕННЫХ РЕГРЕССИИ: ОТСУТСТВИЕ ПЕРЕМЕННОЙ Y 1 2 X 2 3 X 3 u Yˆ b1 b2 X 2 E (b2 ) 2 3 Cov( X 2 , X 3 ) Var( X 2) Y Эффект X3 Эффект X2, при неизменности X3 2 X2 3 Кажущийся эффект X2, в качестве заменителя X3 X3 Возможность X2 замещать X3 определяется углом наклона регрессии X3=g+hX2, которая равна Cov(X2, X3)/Var(X2). Прямое влияние X3 на Y определяется β3. 5 СПЕЦИФИКАЦИЯ ПЕРЕМЕННЫХ РЕГРЕССИИ: ОТСУТСТВИЕ ПЕРЕМЕННОЙ Y 1 2 X 2 3 X 3 u Yˆ b1 b2 X 2 b2 Cov( X 2 , Y ) Cov( X 2 , [ 1 2 X 2 3 X 3 u]) Var( X 2) Var( X 2) Cov( X 2 , 1 ) Cov( X 2 , 2 X 2 ) Cov( X 2 , 3 X 3 ) Cov( X 2 , u) Var( X 2) 0 2Cov( X 2 , X 2 ) 3Cov( X 2 , X 3 ) Cov( X 2 , u) Var( X 2) Cov( X 2 , X 3 ) Cov( X 2 , u) 2 3 Var( X 2) Var( X 2) Для парной регрессии (в отсутствие b3 ) оценка b2 складывается из 3-х компонент. 6 СПЕЦИФИКАЦИЯ ПЕРЕМЕННЫХ РЕГРЕССИИ: ОТСУТСТВИЕ ПЕРЕМЕННОЙ Y 1 2 X 2 3 X 3 u Yˆ b1 b2 X 2 b2 Cov( X 2 , X 3 ) Cov( X 2 , u) Cov( X 2 ,Y ) 2 3 Var( X 2) Var( X 2) Var( X 2) Cov( X 2 , X 3 ) Cov( X 2 , u) E (b2 ) E 2 3 Var ( X ) Var ( X ) 2 2 Cov( X 2 , X 3 ) Cov( X 2 , u) E( 2 ) E 3 E Var( X 2) Var( X 2) Cov( X 2 , X 3 ) 2 3 Var( X 2) Поскольку 2 и 3 – константы, а X2 и X3 так же имеют неслучайные значения, то 3-е слагаемое равно 0. Таким образом при коррелированности X2 и X3 b2 – 7 а смещенная оценка, что приводит к невозможности использовать t и F-тесты, так же к некорректности расчетов стандартных ошибок. СПЕЦИФИКАЦИЯ ПЕРЕМЕННЫХ РЕГРЕССИИ: ОТСУТСТВИЕ ПЕРЕМЕННОЙ . reg S ASVABC SM Source | SS df MS ---------+-----------------------------Model | 1230.2039 2 615.101949 Residual | 2224.04347 567 3.92247526 ---------+-----------------------------Total | 3454.24737 569 6.07073351 . cor SM ASVABC Number of obs = 570 (obs=570) F( 2, 567) = 156.81 Prob 0.0000 | > F SM = ASVABC R-squared = 0.3561 --------+-----------------Adj SM| R-squared 1.0000 = 0.3539 Root MSE 1.9805 ASVABC| 0.3819 = 1.0000 -----------------------------------------------------------------------------S | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------ASVABC | .1381062 .0097494 14.166 0.000 .1189567 .1572556 SM | .154783 .0350728 4.413 0.000 .0858946 .2236715 _cons | 4.791277 .5102431 9.390 0.000 3.78908 5.793475 ------------------------------------------------------------------------------ S 1 2 ASVABC 3 SM u Cov( ASVABC , SM ) E (b2 ) 2 3 Var( ASVABC ) Предположим в регрессионной зависимости отброшена переменная SM. Попытаемся предсказать изменение оценки коэффициента для ASVABC. β3 – положительно. 8 Корреляция – положительная. Т.е. смещение ожидается положительное. СПЕЦИФИКАЦИЯ ПЕРЕМЕННЫХ РЕГРЕССИИ: ОТСУТСТВИЕ ПЕРЕМЕННОЙ . reg S ASVABC SM -----------------------------------------------------------------------------S | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------ASVABC | .1381062 .0097494 14.166 0.000 .1189567 .1572556 SM | .154783 .0350728 4.413 0.000 .0858946 .2236715 _cons | 4.791277 .5102431 9.390 0.000 3.78908 5.793475 -----------------------------------------------------------------------------. reg S ASVABC -----------------------------------------------------------------------------S | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------ASVABC | .1545378 .0091559 16.879 0.000 .1365543 .1725213 _cons | 5.770845 .4668473 12.361 0.000 4.853888 6.687803 ------------------------------------------------------------------------------ Сравнение расчетных коэффициентов подтверждает положительность смещения ASVABC при отбрасывании SM. 9 СПЕЦИФИКАЦИЯ ПЕРЕМЕННЫХ РЕГРЕССИИ: ОТСУТСТВИЕ ПЕРЕМЕННОЙ . reg S SM Source | SS df MS ---------+-----------------------------Model | 443.110436 1 443.110436 Residual | 3011.13693 568 5.30129742 ---------+-----------------------------Total | 3454.24737 569 6.07073351 Number of obs F( 1, 568) Prob > F R-squared Adj R-squared Root MSE = = = = = = 570 83.59 0.0000 0.1283 0.1267 2.3025 -----------------------------------------------------------------------------S | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------SM | .3445198 .0376833 9.142 0.000 .2705041 .4185354 _cons | 9.506491 .4495754 21.145 0.000 8.623458 10.38952 ------------------------------------------------------------------------------ S 1 2 ASVABC 3 SM u Cov( ASVABC , SM ) E (b3 ) 3 2 Var( SM ) Предположим, что ASVABC исключается из модели. Можно ожидать смещения b3 . Можно ожидать, что оно положительно, поскольку 2 и ковариация – положительны. 10 СПЕЦИФИКАЦИЯ ПЕРЕМЕННЫХ РЕГРЕССИИ: ОТСУТСТВИЕ ПЕРЕМЕННОЙ . reg S ASVABC SM -----------------------------------------------------------------------------S | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------ASVABC | .1381062 .0097494 14.166 0.000 .1189567 .1572556 SM | .154783 .0350728 4.413 0.000 .0858946 .2236715 _cons | 4.791277 .5102431 9.390 0.000 3.78908 5.793475 -----------------------------------------------------------------------------. reg S SM -----------------------------------------------------------------------------S | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------SM | .3445198 .0376833 9.142 0.000 .2705041 .4185354 _cons | 9.506491 .4495754 21.145 0.000 8.623458 10.38952 ------------------------------------------------------------------------------ В этом случае ситуация гораздо хуже: коэффициент при SM практически удвоился. (Причина столь большого эффекта в малом значении Var(SM) << Var(ASVABC) ). 11 СПЕЦИФИКАЦИЯ ПЕРЕМЕННЫХ РЕГРЕССИИ: ОТСУТСТВИЕ ПЕРЕМЕННОЙ . reg S ASVABC SM Source | SS df MS ---------+-----------------------------Model | 1230.2039 2 615.101949 Residual | 2224.04347 567 3.92247526 ---------+-----------------------------Total | 3454.24737 569 6.07073351 Number of obs F( 2, 567) Prob > F R-squared Adj R-squared Root MSE = = = = = = 570 156.81 0.0000 0.3561 0.3539 1.9805 . reg S ASVABC Source | SS df MS ---------+-----------------------------Model | 1153.80864 1 1153.80864 Residual | 2300.43873 568 4.05006818 ---------+-----------------------------Total | 3454.24737 569 6.07073351 Number of obs F( 1, 568) Prob > F R-squared Adj R-squared Root MSE = = = = = = 570 284.89 0.0000 0.3329 2.0125 . reg S SM Source | SS df MS ---------+-----------------------------Model | 443.110436 1 443.110436 Residual | 3011.13693 568 5.30129742 ---------+-----------------------------Total | 3454.24737 569 6.07073351 Number of obs F( 1, 568) Prob > F R-squared Adj R-squared Root MSE = = = = = = 570 83.59 0.0000 0.1283 0.1267 2.3025 0.3340 В итоге оценим, как изменяется R2 при отбрасывании переменных. В парной регрессии S от ASVABC, R2 = 0.33, а в регрессии S от SM - 0.13. Свидетельствует ли это о том, что S объясняется SM на 13%? Нет, в силу эффекта замещения одной переменной при отбрасывании другой переменной. R2 отражает объединенную 12 объясняющую способность каждой из переменных с учетом их корреляции. СПЕЦИФИКАЦИЯ ПЕРЕМЕННЫХ РЕГРЕССИИ: ОТСУТСТВИЕ ПЕРЕМЕННОЙ . reg LGEARN S MALE Source | SS df MS ---------+-----------------------------Model | 28.951332 2 14.475666 Residual | 124.850561 567 .220194992 ---------+-----------------------------Total | 153.801893 569 .270302096 . cor S MALE Number of obs = 570 (obs=570) F( 2, 567) = 65.74 Prob 0.0000 | > F S = MALE R-squared = 0.1882 --------+-----------------Adj S| R-squared 1.0000 = 0.1854 Root -0.0581 MSE =1.0000 .46925 MALE| -----------------------------------------------------------------------------LGEARN | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------S | .0818944 .0079976 10.240 0.000 .0661858 .097603 MALE | .2285156 .0397695 5.746 0.000 .1504021 .3066291 _cons | 1.19254 .1134845 10.508 0.000 .9696386 1.415441 ------------------------------------------------------------------------------ LGEARN 1 2 S 3 MALE u Cov( S , MALE ) E (b2 ) 2 3 Var( S ) Всегда ли R21+ R22 > R2с ? Нет, как видно из примера логарифмической зависимости часовой платы от S и MALE (пол), связанных отрицательной корреляционной зависимостью. 13 СПЕЦИФИКАЦИЯ ПЕРЕМЕННЫХ РЕГРЕССИИ: ОТСУТСТВИЕ ПЕРЕМЕННОЙ . reg LGEARN S MALE -----------------------------------------------------------------------------LGEARN | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------S | .0818944 .0079976 10.240 0.000 .0661858 .097603 MALE | .2285156 .0397695 5.746 0.000 .1504021 .3066291 _cons | 1.19254 .1134845 10.508 0.000 .9696386 1.415441 . reg LGEARN S -----------------------------------------------------------------------------LGEARN | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------S | .0792256 .0082061 9.655 0.000 .0631077 .0953435 _cons | 1.358919 .1127785 12.049 0.000 1.137406 1.580433 . reg LGEARN MALE -----------------------------------------------------------------------------LGEARN | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------MALE | .2048652 .0431797 4.744 0.000 .1200538 .2896767 _cons | 2.313324 .032605 70.950 0.000 2.249282 2.377365 В результате коэффициенты при S и MALE имеют отрицательное смещение. Они меньше, чем в множественной регрессии. 14 СПЕЦИФИКАЦИЯ ПЕРЕМЕННЫХ РЕГРЕССИИ: ОТСУТСТВИЕ ПЕРЕМЕННОЙ . reg LGEARN S MALE Source | SS df MS ---------+-----------------------------Model | 28.951332 2 14.475666 Residual | 124.850561 567 .220194992 ---------+-----------------------------Total | 153.801893 569 .270302096 Number of obs F( 2, 567) Prob > F R-squared Adj R-squared Root MSE = = = = = = 570 65.74 0.0000 0.1882 0.1854 .46925 . reg LGEARN S Source | SS df MS ---------+-----------------------------Model | 21.681253 1 21.681253 Residual | 132.12064 568 .23260676 ---------+-----------------------------Total | 153.801893 569 .270302096 Number of obs F( 1, 568) Prob > F R-squared Adj R-squared Root MSE = = = = = = 570 93.21 0.0000 0.1410 0.1395 .48229 . reg LGEARN MALE Source | SS df MS ---------+-----------------------------Model | 5.86288165 1 5.86288165 Residual | 147.939011 568 .260456005 ---------+-----------------------------Total | 153.801893 569 .270302096 Number of obs F( 1, 568) Prob > F R-squared Adj R-squared Root MSE = = = = = = 570 22.51 0.0000 0.0381 0.0364 .51035 Сравнение R2 показывает, что для множественной модели R2 больше суммы R2 в парных моделях. 15 СПЕЦИФИКАЦИЯ ПЕРЕМЕННЫХ: ОТСУТСТВИЕ ПЕРЕМЕННОЙ Последствия некорректной спецификации модели Истинная модель Оцененная модель Y 1 2 X 2 u Y 1 2 X 2 3 X 3 u Yˆ b1 b2 X 2 Yˆ b1 b2 X 2 b3 X 3 Корректная спецификация, нет проблем Несмещенность коэффициентов. Корректность стандартных ошибок Коэффициенты смещены (как правило). Стандартные ошибки некорректны. Корректная спецификация, нет проблем Включение лишних переменных приводит к неэффективности в общем случае несмещенных оценок. 16 СПЕЦИФИКАЦИЯ ПЕРЕМЕННЫХ РЕГРЕССИИ: ОТСУТСТВИЕ ПЕРЕМЕННОЙ Y 1 2 X 2 u Yˆ b1 b2 X 2 b3 X 3 Y 1 2 X 2 0 X 3 u Cov( X 2 , X 3 ) E (b2 ) 2 3 Var( X 2) Добавив в модель X3 в качестве объясняющей переменной с истинным коэффициентом =0. Следовательно оценка b2 будет несмещенной оценкой 2 , а b3 будет несмещенной 17 оценкой 0. 3 НЕВЕРНАЯ СПЕЦИФИКАЦИЯ: ВКЛЮЧЕНИЕ ЛИШНЕЙ ПЕРЕМЕННОЙ Y 1 2 X 2 u Yˆ b1 b2 X 2 b3 X 3 Y 1 2 X 2 0 X 3 u 2 1 2 u выборочная дисперсия b2 b2 nVar ( X 2 ) 1 rX2 2 ,X 3 Выборочная дисперсия оценки b2 будет тем больше, чем больше корреляция переменных. Таким образом оценка будет тем менее эффективна, чем более коррелированны переменные. Замена дисперсии ее оценкой при вычислении стандартной ошибки не приводит к потере ее корректности. 18 НЕВЕРНАЯ СПЕЦИФИКАЦИЯ: ВКЛЮЧЕНИЕ ЛИШНЕЙ ПЕРЕМЕННОЙ Y 1 2 X 2 u Yˆ b1 b2 X 2 b3 X 3 Y 1 2 X 2 0 X 3 u population variance of b2 2 b2 u2 1 nVar( X 2 ) 1 rX22 , X 3 Стандартные ошибки коэффициентов будут значимыми, по причине формальной корректности модели, но значения оценок будет больше (потеря эффективности). 19 НЕВЕРНАЯ СПЕЦИФИКАЦИЯ: ВКЛЮЧЕНИЕ ЛИШНЕЙ ПЕРЕМЕННОЙ . reg LGEARN S ASVABC Source | SS df MS ---------+-----------------------------Model | 25.9166749 2 12.9583374 Residual | 127.885218 567 .225547121 ---------+-----------------------------Total | 153.801893 569 .270302096 Number of obs F( 2, 567) Prob > F R-squared Adj R-squared Root MSE = = = = = = 570 57.45 0.0000 0.1685 0.1656 .47492 -----------------------------------------------------------------------------LGEARN | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------S | .0544266 .0099018 5.497 0.000 .034978 .0738753 ASVABC | .0114733 .0026476 4.333 0.000 .0062729 .0166736 _cons | 1.118832 .124107 9.015 0.000 .8750665 1.362598 ------------------------------------------------------------------------------ Иллюстрация влияния лишней переменной на примере полулогарифмической зависимости LGEARN от S и ASVABC. 20 НЕВЕРНАЯ СПЕЦИФИКАЦИЯ: ВКЛЮЧЕНИЕ ЛИШНЕЙ ПЕРЕМЕННОЙ . reg LGEARN S ASVABC SM SF Source | SS df MS ---------+-----------------------------Model | 26.3617806 4 6.59044515 Residual | 127.440112 565 .22555772 ---------+-----------------------------Total | 153.801893 569 .270302096 Number of obs F( 4, 565) Prob > F R-squared Adj R-squared Root MSE = = = = = = 570 29.22 0.0000 0.1714 0.1655 .47493 -----------------------------------------------------------------------------LGEARN | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------S | .0511811 .0101812 5.027 0.000 .0311835 .0711788 ASVABC | .010444 .0027481 3.800 0.000 .0050463 .0158417 SM | .0071835 .0102695 0.699 0.485 -.0129876 .0273547 SF | .004794 .0076389 0.628 0.531 -.0102101 .0197981 _cons | 1.073972 .1324621 8.108 0.000 .8137933 1.33415 ------------------------------------------------------------------------------ Добавим в качестве объясняющих образовательный ценз родителей SM и SF. Они имеют косвенное отношение к величине платы, но не очевиден их прямой эффект. T-статистика показывает их возможную незначимость. 21 НЕВЕРНАЯ СПЕЦИФИКАЦИЯ: ВКЛЮЧЕНИЕ ЛИШНЕЙ ПЕРЕМЕННОЙ . reg LGEARN S ASVABC . cor S ASVABC SM SF (obs=570) -----------------------------------------------------------------------------| S ASVABC SM SF LGEARN | Coef. Std. Err. t P>|t| [95% Conf. Interval] --------+--------------------------------------------+-------------------------------------------------------------------S| 1.0000 S | .0544266 .0099018 5.497 0.000 .034978 .0738753 ASVABC| 0.5779 1.0000 ASVABC | .0114733 .0026476 4.333 0.000 .0062729 .0166736 SM| 0.3582 0.3819 1.0000 _cons | 1.118832 .124107 9.015 0.000 .8750665 1.362598 SF| 0.4066 0.4179 0.6391 1.0000 -----------------------------------------------------------------------------. reg LGEARN S ASVABC SM SF -----------------------------------------------------------------------------LGEARN | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------S | .0511811 .0101812 5.027 0.000 .0311835 .0711788 ASVABC | .010444 .0027481 3.800 0.000 .0050463 .0158417 SM | .0071835 .0102695 0.699 0.485 -.0129876 .0273547 SF | .004794 .0076389 0.628 0.531 -.0102101 .0197981 _cons | 1.073972 .1324621 8.108 0.000 .8137933 1.33415 ------------------------------------------------------------------------------ Стандартные ошибки больше в плохо специфицированной модели с избыточными переменными. Потеря эффективности не очень велика. Образование родителей 22 коррелированно и с S и c ASVABC не очень сильно. ЗАМЕЩАЮЩИЕ ПЕРЕМЕННЫЕ Переменная-заместитель вводится при невозможности точного определения какого-либо показателя. Например, для оценки общего социально-экономического благополучия можно использовать сильно коррелированный с ним показатель дохода населения. Введение замещающих переменных позволяет: • Устранить смещенность оценок, возникающих при отсутствии определяющей переменной в модели; • Получить косвенную информацию о замещенной переменной по результатам оценки регрессии с замещающей переменной. 23 ЗАМЕЩАЮЩИЕ ПЕРЕМЕННЫЕ Y 1 2 X 2 3 X 3 ... k X k u Предположим, что Y гипотетически зависит от набора объясняющих переменных X2, ..., Xk ,как показано выше, и предположим, что по каким-то причинам мы не можем получить данных по X2. Регрессия без этой переменной приводит к смещенности оценок и недостоверности тестов. 24 ЗАМЕЩАЮЩИЕ ПЕРЕМЕННЫЕ Y 1 2 X 2 3 X 3 ... k X k u X 2 Z Y 1 2 ( Z ) 3 X 3 ... k X k u ( 1 2 ) 2 Z 3 X 3 ... k X k u Предположим, что имеется другая переменная Z, связанная с X2 сильной функциональной связью. Тогда регрессионная модель может быть переписана, как показано выше. В результате получается модель со всеми наблюдаемыми переменными. Невозможно оценить величины λ и μ посредством регрессионного анализа поскольку неизвестны значения X2. 25 ЗАМЕЩАЮЩИЕ ПЕРЕМЕННЫЕ Y 1 2 X 2 3 X 3 ... k X k u X 2 Z Y 1 2 ( Z ) 3 X 3 ... k X k u ( 1 2 ) 2 Z 3 X 3 ... k X k u 1. Оценки коэффициентов при X3, ..., Xk ,, их t-статистики и стандартные ошибки будут теми же самыми, что и для полной регрессии Y от X2, ..., Xk. 2. R2 будет таким же, как и в случае использования X2 вместо Z. 3. Коэффициент при Z будет оценкой величины β2μ, поэтому невозможно получить оценку β2 если неизвестна оценка μ. 4. Тем не менее t-статистика для Z будет такой же, как для X2 поэтому можно оценить значимость X2 даже не зная значение коэффициента. 5. Невозможно получить оценку β1 поскольку постоянный член равен β1 + β2 λ, но обычно постоянный член представляет меньший интерес с любой точки зрения. 26 ЗАМЕЩАЮЩИЕ ПЕРЕМЕННЫЕ Y 1 2 X 2 3 X 3 ... k X k u X 2 Z Y 1 2 ( Z ) 3 X 3 ... k X k u ( 1 2 ) 2 Z 3 X 3 ... k X k u 1. Поскольку регрессионное соотношение между исходной и замещающей переменной носит приблизительный характер, то такой же характер будут иметь и приведенные выше утверждения. 2. При низкой корреляции между исходной и замещающей переменной при оценке коэффициентов можно получить совсем плохие результаты, так как здесь суммируются два эффекта: добавление лишней переменной, приводящее к неэффективности, и отбрасывание существенной переменной, приводящее к 27 смещенности оценок. ЗАМЕЩАЮЩИЕ ПЕРЕМЕННЫЕ S 1 2 ASVABC 3 INDEX u INDEX 1 SM 2 SF Пример, зависимость образовательного уровня от интеллектуальных способностей и «семейного фона». ASVABC - измеримый параметр. Как измерить такой параметр, как «семейный фон» так же влияющий на мотивацию человека? Для его оценки можно 28 использовать значения образовательного уровня родителей SM и SF. ЗАМЕЩАЮЩИЕ ПЕРЕМЕННЫЕ S 1 2 ASVABC 3 INDEX u INDEX 1 SM 2 SF S 1 2 ASVABC 3 ( 1 SM 2 SF ) u ( 1 3 ) 2 ASVABC 3 1 SM 3 2 SF u Получается функциональная зависимость S от ASVABC, SM и SF. 29 ЗАМЕЩАЮЩИЕ ПЕРЕМЕННЫЕ . reg S ASVABC SM SF Source | SS df MS ---------+-----------------------------Model | 1278.24153 3 426.080508 Residual | 2176.00584 566 3.84453329 ---------+-----------------------------Total | 3454.24737 569 6.07073351 Number of obs F( 3, 566) Prob > F R-squared Adj R-squared Root MSE = = = = = = 570 110.83 0.0000 0.3700 0.3667 1.9607 -----------------------------------------------------------------------------S | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------ASVABC | .1295006 .0099544 13.009 0.000 .1099486 .1490527 SM | .069403 .0422974 1.641 0.101 -.013676 .152482 SF | .1102684 .0311948 3.535 0.000 .0489967 .1715401 _cons | 4.914654 .5063527 9.706 0.000 3.920094 5.909214 ------------------------------------------------------------------------------ Параметры регрессионной модели. 30 ЗАМЕЩАЮЩИЕ ПЕРЕМЕННЫЕ . reg S ASVABC Source | SS df MS ---------+-----------------------------Model | 1153.80864 1 1153.80864 Residual | 2300.43873 568 4.05006818 ---------+-----------------------------Total | 3454.24737 569 6.07073351 Number of obs F( 1, 568) Prob > F R-squared Adj R-squared Root MSE = = = = = = 570 284.89 0.0000 0.3340 0.3329 2.0125 -----------------------------------------------------------------------------S | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------ASVABC | .1545378 .0091559 16.879 0.000 .1365543 .1725213 _cons | 5.770845 .4668473 12.361 0.000 4.853888 6.687803 ------------------------------------------------------------------------------ Зависимость S только от ASVABC. 31 ЗАМЕЩАЮЩИЕ ПЕРЕМЕННЫЕ . reg S ASVABC SM SF . cor ASVABC SM SF -----------------------------------------------------------------------------(obs=570) S | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------| ASVABC SM SF ASVABC | .1295006 .0099544 13.009 0.000 .1099486 .1490527 --------+--------------------------SM | .069403 .0422974 1.641 -.013676 .152482 ASVABC|0.101 1.0000 SF | .1102684 .0311948 3.535 SM|0.000 .0489967 .1715401 0.3819 1.0000 _cons | 4.914654 .5063527 9.706 SF|0.000 3.920094 5.909214 0.4179 0.6391 1.0000 -----------------------------------------------------------------------------. reg S ASVABC -----------------------------------------------------------------------------S | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------ASVABC | .1545378 .0091559 16.879 0.000 .1365543 .1725213 _cons | 5.770845 .4668473 12.361 0.000 4.853888 6.687803 ------------------------------------------------------------------------------ Сравнение результатов показывает смещенность коэффициента при ASVABC в простой модели. Поскольку мать и отец одинаково влияют на образовательные установки, то все переменные коррелированны между 32 собой. ЗАМЕЩАЮЩИЕ ПЕРЕМЕННЫЕ . reg S ASVABC SM SF LIBRARY SIBLINGS Source | SS df MS ---------+-----------------------------Model | 1285.58208 5 257.116416 Residual | 2168.66529 564 3.84515122 ---------+-----------------------------Total | 3454.24737 569 6.07073351 Number of obs F( 5, 564) Prob > F R-squared Adj R-squared Root MSE = = = = = = 570 66.87 0.0000 0.3722 0.3666 1.9609 -----------------------------------------------------------------------------S | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------ASVABC | .1277852 .010054 12.710 0.000 .1080373 .147533 SM | .0619975 .0427558 1.450 0.148 -.0219826 .1459775 SF | .1045035 .0314928 3.318 0.001 .042646 .166361 LIBRARY | .1151269 .1969844 0.584 0.559 -.2717856 .5020394 SIBLINGS | -.0509486 .039956 -1.275 0.203 -.1294293 .027532 _cons | 5.236995 .5665539 9.244 0.000 4.124181 6.349808 ------------------------------------------------------------------------------ Добавим еще 2 переменные: LIBRARY (фиктивная переменная равная 1 если кто-то в семье записан в библиотеку) и SIBLINGS (число братьев и сестер), которые так же могут характеризовать семейный фон. Чтение может свидетельствовать о повышенном интересе к образованию (положительная корреляция LIBRARY с S). Чем больше детей, тем меньше возможности выучить всех (отрицательная корреляция SIBLINGS с S). Есть и другие характеристики семейного фона: этнические х-ки и регион проживания. 33 ЗАМЕЩАЮЩИЕ ПЕРЕМЕННЫЕ Непреднамеренное использование замещающих переменных: вместо одной замещающей переменной используется другая, не имеющая прямого отношения к модели. Если корреляция невысока, то ошибку можно обнаружить. Если нет, то ошибку обнаружить трудно. Возможные последствия: • в модели используемой для предсказания это не критично; • в модели, используемой для экономического управления с помощью изменения значения определяющих переменных последствия могут оказаться катастрофическими. Если нет сильной функциональной зависимости между истинной и замещающей переменной, то изменение определяющей переменной не будет оказывать никакого влияния на результат. Пример: регрессионные модели динамических рядов. Падение рождаемости в зависимости от уменьшения численности аистов или зайцев. 34 ПРОВЕРКА ЛИНЕЙНОГО ОГРАНИЧЕНИЯ S 1 2 ASVABC 3 SM 4 SF u Уменьшение числа переменных при мультколлинеарности модели приводит к улучшению оценок. Задача проверки значимости вводимых ограничений. 35 ПРОВЕРКА ЛИНЕЙНОГО ОГРАНИЧЕНИЯ . reg S ASVABC SM SF Source | . corSSSM SF df MS ---------+-----------------------------(obs=570) Model | 1278.24153 3 SM426.080508 | SF Residual | 2176.00584 566 3.84453329 --------+--------------------------+-----------------------------SM| 1.0000 Total | 3454.24737 569 6.07073351 SF| 0.6391 1.0000 Number of obs F( 3, 566) Prob > F R-squared Adj R-squared Root MSE = = = = = = 570 110.83 0.0000 0.3700 0.3667 1.9607 -----------------------------------------------------------------------------S | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------ASVABC | .1295006 .0099544 13.009 0.000 .1099486 .1490527 SM | .069403 .0422974 1.641 0.101 -.013676 .152482 SF | .1102684 .0311948 3.535 0.000 .0489967 .1715401 _cons | 4.914654 .5063527 9.706 0.000 3.920094 5.909214 ------------------------------------------------------------------------------ Коэффициент для образования матери SM оказывается незначимым. Имеется сильная корреляционная связь между SM и SF. Сильная мультиколлинеарность модели. 36 ПРОВЕРКА ЛИНЕЙНОГО ОГРАНИЧЕНИЯ S 1 2 ASVABC 3 SM 4 SF u 4 3 S 1 2 ASVABC 3 ( SM SF ) u 1 2 ASVABC 3 SP u SP SM SF Устранение мультиколлинеарности за счет объединения двух переменных в одну SP с помощью ограничения равенства вкладов в образование обоих супругов. 37 ПРОВЕРКА ЛИНЕЙНОГО ОГРАНИЧЕНИЯ . g SP = SM + SF . reg S ASVABC SP Source | SS df MS ---------+-----------------------------Model | 1276.73764 2 638.368819 Residual | 2177.50973 567 3.84040517 ---------+-----------------------------Total | 3454.24737 569 6.07073351 Number of obs F( 2, 567) Prob > F R-squared Adj R-squared Root MSE = = = = = = 570 166.22 0.0000 0.3696 0.3674 1.9597 -----------------------------------------------------------------------------S | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------ASVABC | .1295653 .0099485 13.024 0.000 .1100249 .1491057 SP | .093741 .0165688 5.658 0.000 .0611973 .1262847 _cons | 4.823123 .4844829 9.955 0.000 3.871523 5.774724 ------------------------------------------------------------------------------ Регрессионная модель с SP вместо SM и SF. Высокая значимость коэффициента. Насколько достовена гипотеза о равном влиянии обоих 38 супругов? ПРОВЕРКА ЛИНЕЙНОГО ОГРАНИЧЕНИЯ . reg S ASVABC SM SF -----------------------------------------------------------------------------S | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------ASVABC | .1295006 .0099544 13.009 0.000 .1099486 .1490527 SM | .069403 .0422974 1.641 0.101 -.013676 .152482 SF | .1102684 .0311948 3.535 0.000 .0489967 .1715401 _cons | 4.914654 .5063527 9.706 0.000 3.920094 5.909214 -----------------------------------------------------------------------------. reg S ASVABC SP -----------------------------------------------------------------------------S | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------ASVABC | .1295653 .0099485 13.024 0.000 .1100249 .1491057 SP | .093741 .0165688 5.658 0.000 .0611973 .1262847 _cons | 4.823123 .4844829 9.955 0.000 3.871523 5.774724 ------------------------------------------------------------------------------ Сравнение показывает, что в объединенной модели меньше значения стандартных ошибок и лучше t-статистика. Объединенная модель лучше, но при условии истинности введенного ограничения. Как проверить значимость введенного ограничения? Если оно неверно, то оценки смещенные. Проблема в том, что значения коэффициентов в регрессионной модели и их стандартные ошибки сильно 39 различаются, что не подтверждает априори гипотезу. ПРОВЕРКА ЛИНЕЙНОГО ОГРАНИЧЕНИЯ S 1 2 ASVABC 3 SM 4 SF u 4 3 S 1 2 ASVABC 3 ( SM SF ) u 1 2 ASVABC 3 SP u SP SM SF H 0 : 4 3 , H1 : 4 3 Нуль-гипотеза состоит в том, что значения коэффициентов одинаковые. 40 ПРОВЕРКА ЛИНЕЙНОГО ОГРАНИЧЕНИЯ . reg S ASVABC SM SF Source | SS df MS ---------+-----------------------------Model | 1278.24153 3 426.080508 Residual | 2176.00584 566 3.84453329 ---------+-----------------------------Total | 3454.24737 569 6.07073351 Number of obs F( 3, 566) Prob > F R-squared Adj R-squared Root MSE = = = = = = 570 110.83 0.0000 0.3700 0.3667 1.9607 Number of obs F( 2, 567) Prob > F R-squared Adj R-squared Root MSE = = = = = = 570 166.22 0.0000 0.3696 0.3674 1.9597 . reg S ASVABC SP Source | SS df MS ---------+-----------------------------Model | 1276.73764 2 638.368819 Residual | 2177.50973 567 3.84040517 ---------+-----------------------------Total | 3454.24737 569 6.07073351 Для проверки статистической значимости улучшения качества регрессии используют изменение значения RSS, как показателя объясняющей силы модели. Если удельное изменение RSS есть малое случайное число (как в данном примере), то гипотеза о значимости ограничения верна. 41 ПРОВЕРКА ЛИНЕЙНОГО ОГРАНИЧЕНИЯ S 1 2 ASVABC 3 SM 4 SF u 4 3 S 1 2 ASVABC 3 ( SM SF ) u 1 2 ASVABC 3 SP u SP SM SF H 0 : 4 3 , H1 : 4 3 ( RSS R RSSU ) / 1 2177.51 2176.01 F (1, n k ) 0.39 RSSU /( n k ) 2176.01 / 566 Проверка значимости ограничения основана на F тесте. Поскольку F-статистика не может быть меньше 1, то это свидетельствует о том, что нулевая гипотеза не может 42 быть отвергнута при любом уровне значимости. ПРОВЕРКА ЛИНЕЙНОГО ОГРАНИЧЕНИЯ S 1 2 ASVABC 3 SM 4 SF u S 1 2 ASVABC 3 SP u 0 3 SM 4 SF 3 SP 3 SM 4 SF 3 ( SM SF ) ( 4 3 ) SF S 1 2 ASVABC 3 SP ( 4 3 ) SF u H 0 : 4 3 0, H 1 : 4 3 0 Для оценки значимости гипотезы можно использовать и t-тест. Найдем, чем отличаются обе модели и добавим разницу к модели с ограничением. Для этого вычтем второе уравнение из первого. Добавим разницу к модели и проверим значимость этого слагаемого. Нуль гипотеза состоит в том, что коэффициент в преобразованном уравнении равен 0. 43 ПРОВЕРКА ЛИНЕЙНОГО ОГРАНИЧЕНИЯ . reg S ASVABC SP SF Source | SS df MS ---------+-----------------------------Model | 1278.24153 3 426.080508 Residual | 2176.00584 566 3.84453329 ---------+-----------------------------Total | 3454.24737 569 6.07073351 Number of obs F( 3, 566) Prob > F R-squared Adj R-squared Root MSE = = = = = = 570 110.83 0.0000 0.3700 0.3667 1.9607 -----------------------------------------------------------------------------S | Coef. Std. Err. t P>|t| [95% Conf. Interval] ---------+-------------------------------------------------------------------ASVABC | .1295006 .0099544 13.009 0.000 .1099486 .1490527 SP | .069403 .0422974 1.641 0.101 -.013676 .152482 SF | .0408654 .0653386 0.625 0.532 -.0874704 .1692012 _cons | 4.914654 .5063527 9.706 0.000 3.920094 5.909214 ------------------------------------------------------------------------------ В вычисленной регрессионной модели коэффициент при SF не существенно отличается о 0 и не противоречит нулевой гипотезе. 44