а также энтропию и

реклама

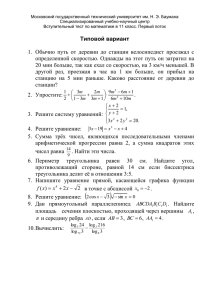

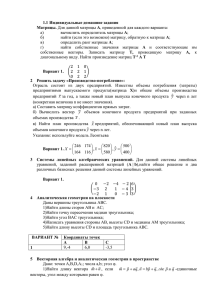

Министерство образования Российской Федерации Федеральное государственное автономное образовательное учреждение высшего образования «СЕВАСТОПОЛЬСКИЙ ГОСУДАРСТВЕННЫЙ УНИВЕРСИТЕ» Кафедра информатики и управления в технических системах ИССЛЕДОВАНИЕ ИСТОЧНИКА СООБЩЕНИЙ. ЭНТРОПИЯ ИСТОЧНИКА. КАНАЛЬНАЯ МАТРИЦА Методические указания к лабораторным работам по дисциплине «Теория информация и кодирования» Севастополь 2015 УДК 519.7 Исчисление количества информации: Методические указания к лабораторным работам / Сост.: В.В. Альчаков. ‒ Севастополь.: СевГУ, 2015. ‒ 16с. Рассмотрены основные методы расчета энтропии источника сообщений. Исследуются свойства канальной матрицы. Даны общие рекомендации по решения практических задач. Приведены варианты заданий к курсовой работе по дисциплине «Теория информации и кодирования». Методические указания предназначены для студентов специальности 27.03.04 ‒ «Управление в технических системах». Методические указания рассмотрены на заседании кафедры технической кибернетики СГТУ № ___ от « ___ » _____________________ 2015 г. Одобрено методической комиссией института Информационных технологий и управления в технических системах. Рецензенты: В.А. Крамарь, докт. техн. наук, проф. каф. ИУТС СевГУ В.А. Карапетьян, канд. техн. наук, доц. каф. ИУТС СевГУ Составитель: В.В. Альчаков, канд. техн. наук, доц. каф. ИУТС СевГУ © СГТУ, 2014 Методические указания составлены в соответствии с рабочей программой дисциплины «Теория информации и кодирования» учебного плана специальности 27.03.04 ‒ «Управление в технических системах». 1 ОБЩИЕ ПОЛОЖЕНИЯ ... 2 ЗАДАНИЕ НА РАБОТУ Исследовать канальную матрицу источника сообщений, осуществляющего передачу четырех символов алфавита. Исследовать методы расчета энтропии сообщений. 1. Построить канальную матрицу P b , описывающую источник a сообщения со стороны входа. 2. Построить матрицу Pa, b . 3. Найти вероятности P bi . 4. Построить канальную матрицу P a , описывающую источник b сообщений со стороны выхода. b a 5. Найти частные условные энтропии H j и H i . b1 a1 6. Найти полные условные энтропии H B и H A . A B 7. Найти энтропию объединения H A, B . 8. Найти количество информации на выходе канала связи I A, B , а также энтропию H A и H B . 3 ХОД РАБОТЫ 3.1 Построить канальную матрицу P b , описывающую a источник сообщения со стороны входа Исходя из условия задания, источник сообщений состоит из четырех символов. Следовательно, размерность матрицы равна 4×4. Элементы, расположенные на главной диагонали, определяют вероятность правильного приема. Все остальные ‒ вероятность ложного приема. Начинать заполнение матрицы нужно именно с вероятностей, которые определяют ложный прием. При этом на соответствующих позициях должны быть вписаны вероятности, соответствующие вероятностям букв, образующих ФИО студента. Пример заполнения матрицы представлен ниже. Шаг 1. Заполняются ячейки, соответствующие неверному приему. Заполняются слева направо, сверху вниз. Вероятности правильного приема заполняются нулями. b P b1 P b2 P 3 P b4 a1 a1 a1 a1 b b b b P 1 P 2 P 3 P 4 a2 a2 a2 ‒ Общий вид a2 Pb a b P b1 P b2 P 3 P b4 a3 a3 a3 a3 b P b1 P b2 P 3 P b4 a4 a4 a4 a4 канальной матрицы, характеризующей источник сообщений со стороны входа. 0 P А P Л P Ь PЧ 0 P А P К Pb a PО PВ 0 PВ P А PС PИ 0 Шаг 2. Вместо буквенных обозначений вписываются численные значения вероятностей для букв русского алфавита. 0 0,062 0,035 0,014 0,012 0 0,062 0,028 Pb a 0,09 0,038 0 0,038 0,062 0,045 0,062 0 Шаг 3. Для определения диагональных элементов необходимо воспользоваться свойством канальной матрицы, описывающей со стороны входа. Сумма элементов в каждой строке такой матрицы равна 1. 0,889 0,012 Pb a 0,09 0,062 0,062 0,898 0,038 0,045 0,035 0,062 0,834 0,062 0,014 0,028 0,038 0,831 3.2 Построить матрицу Pa, b При построении матрицы Pa, b необходимо прежде всего выбрать вероятности появления символов Pa1 Pa2 P a3 Pa4 . Выбор значений вероятностей определяется условием 4 Pai 1 . i 1 Например, Pa1 0,1; Pa2 0,2 ; Pa3 0,3 ; Pa4 0,4 . Элементы матрицы Pa, b могут быть вычислены с помощью соотношения b P j ai P ai , b j Pai Pai , b j (3.1) Pa1 , b1 Pa1 , b2 Pa1 , b3 Pa1 , b4 Pa2 , b1 Pa2 , b2 Pa2 , b3 Pa2 , b4 Pa3 , b1 Pa4 , b1 Pa3 , b2 Pa4 , b2 Pa3 , b3 Pa4 , b3 Pa3 , b4 Pa4 , b4 (3.2) 0,0889 0,0062 0,0024 0,1796 P ai , b j 0,027 0,0114 0,0248 0,018 Матрица (3.2) обладает 0,0035 0,0124 0,2502 0,0248 0,0014 0,0056 0,0114 0,3324 замечательным свойством Pai , b j Pai . Проверим это свойство 4 j 1 Pa1 P a1 , b j Pa1 , b1 Pa1 , b2 Pa1 , b3 Pa1 , b4 4 j 1 0,0889 0,0062 0,0035 0,0014 0,1 Аналогичные проверки необходимо выполнить для Pa2 P a3 Pa4 . 3.3 Найти вероятности P bi Для вычисления вероятностей P bi необходимо воспользоваться другим замечательным свойством матрицы Pai , b j , а именно Pai , b j Pb j 4 i 1 В результате расчётов получим Pb1 0,1431; Pb2 0,2152 ; Pb3 0,2909 ; Pb4 0,3508. Следует также проверить свойство Pb j 1. 4 j 1 b , 3.4 Построить канальную матрицу P a описывающую источник сообщения со стороны выхода Для расчета канальной воспользуемся соотношением матрицы a Pai , b j P i Pb j bj P a1 b1 a P 2 b1 Pa b a P 3 b1 P a4 b1 канальной матрицы, стороны выхода. P a1 P a1 b2 b3 a a P 2 P 2 b2 b3 a a P 3 P 3 b2 b3 P a4 P a4 b2 b3 характеризующей со стороны выхода (3.3) P a1 b4 a P 2 b4 ‒ Общий вид a P 3 b4 P a4 b4 источник сообщений со В результате вычислений получим 0,6212 0,0168 Pa b 0,1887 0,1733 0,0288 0,8346 0,0530 0,0836 0,0120 0,0426 0,8601 0,0853 0,0040 0,0160 0,0325 0,9475 Далее необходимо проверить, чтобы сумма элементов по столбцам полученной канальной матрицы равнялась 1. Для 4 P i 1 ai первого столбца 0,6212 0,0168 0,1887 0,1733 1. Условие выполняется. b1 Аналогичные проверки нужно сделать для 4 P ai i 1 4 a P i b3 , i 1 4 P ai i 1 b2 , b4 . b a 3.5 Найти частные условные энтропии H j и H i b1 a1 Неопределенность отправителя о правильности получения информации можно выразить частной условной энтропией вида 4 b bj b H P j log P j . a1 a1 a1 j 1 Аналогично неопределенность получателя о том, что он получил правильный символ, выражается частной условной энтропией вида a a a H i P i log P i . b1 b1 b1 i 1 4 Подставляя численные значения для вероятностей, получим b1 P b1 P b2 log P b2 P log a a a a1 1 1 1 bj H a 1 P b3 log P b3 P b4 log P b4 a a a a1 1 1 1 бит 0,65512 . симв Аналогично 4 бит ai a a H P i log P i 0,68261 . b b b1 1 1 симв i 1 A и H A B 3.6 Найти полные условные энтропии H B Полная условная энтропия (или общая условная энтропия) характеризует неопределенность получателя в правильности приема любого из переданных символов. Для ее оценки используются соотношения A Pa P b a log P b a H B 4 4 i i 1 j j i j 1 i B Pb P a b log P a b H A 4 4 j j 1 i i 1 i j j Подставляя численные значения для вероятностей, получим бит бит A 0,8225 симв , H A B 0,74225 . симв HB 3.7 Найти энтропию объединения H A, B Энтропия объединения должна быть рассчитана с помощью трех соотношений H A, B Pai , b j logPai , b j ; 4 4 i 1 j 1 A, где H A Pa logPa ; H A, B H A H B 4 i 1 i i B, где H B Pb logPb . H A, B H B H A 4 j 1 i j Подставив численные значения параметров получим бит H A, B Pai , b j logPai , b j 2,6689 симв i 1 j 1 4 4 бит H A 1,8464 симв бит A 2,6689 симв H A, B H A H B бит H B 1,9267 симв бит B 2,6689 симв H A, B H B H A Полученные значения для H A, B должны совпадать с точностью до второго знака. 3.8 Найти количество информации на выходе канала связи I A, B , а также энтропию H A и H B Количество информации на выходе канала связи может быть найдено тремя различными способами I A, B H A H B H A, B 1,8464 1,9267 2,6689 1,1042 бит I A, B H A H A 1,8464 0,74225 1,1042 бит B I A, B H B H B 1,9267 0,8225 1,1042 бит A Если предыдущие вычисления сделаны верно, то результаты по всем трем формулам должны приблизительно совпадать. Приложение 1 Исходный код m-файла для решения задания в пакете Matlab