Рязанов В., Зуева И.

advertisement

9

ОБ ОДНОЙ ГИБРИДНОЙ МОДЕЛИ КЛАССИФИКАЦИИ ТИПА

АЛГОРИТМОВ ВЫЧИСЛЕНИЯ ОЦЕНОК 1

В.В. Рязанов 2, И.В. Зуева 2

2

ВЦ РАН, Россия, 119991, Москва, ул.Вавилова, 40, e-mail: rvv@ccas.ru

Предложена модификация модели вычисления оценок, основанной на

голосовании по системам логических закономерностей классов.

Предложен

подход к построению линейных решающих правил, основанный на поиске

максимального зазора для оценок эталонных объектов за классы и аппроксимации

логических закономерностей классов гладкими ядерными функциями.

эталонов

класса.

эвристическая степень

1. Введение

В настоящей работе предлагается развитие

одного

логического

алгоритма

распознавания с использованием идей

метода опорных векторов.

Рассматривается

модель

алгоритмов

распознавания, основанная на голосовании

по системам логических закономерностей

классов

[1-4].

По

обучающей

непротиворечивой выборке для каждого

класса объектов Ki находятся такие

нерасширяемые прямые координатные

области (называемые интервалами) в

пространстве

признаковых

описаний,

которые содержат максимальное число

объектов обучения, принадлежащих только

Ki. Характеристическая функция P,c,d (x)

подобного

интервала

называется

логической закономерностью класса Ki

(здесь x R n - вектор значений признаков,

{1,2,..., n}

определяет признаковое

подпространство, вектора c, d R n задают

левые и правые границы интервала

N ( P,c,d ) ). Для каждого класса Ki

находится

система

логических

,c,d

i {P

(x)} ,

закономерностей

интервалы которых покрывают множество

(оценка)

j (S)

Вычисляется

принадлежности

( P ,c,d )P ,c,d (S),

P,c,d j

j 1,2,..., l , объекта S к классу Kj и S

относится в класс с максимальной оценкой

( ( P ,c,d )

веса

логических

закономерностей). Используются и более

общие схемы голосования. Расположение

S внутри N ( P,c,d ) или его удаленность

от N ( P,c,d ) не учитываются в настоящей

модели. Для поиска значений неизвестных

параметров необходимо решать сложные

оптимизационные задачи с использованием

контрольной

выборки

или

схем

скользящего контроля.

В

настоящей

работе

предлагается

следующая модификации данной модели

распознавания. Вычисляются множества

логических закономерностей i [3,4].

Оценки j (S) вычисляются в виде

( P ,c,d ) f ,c,d (S) .

j (S)

P

, c, d

Здесь

j

параметры

находятся как

( P ,c,d )

решения специальной задачи линейного

программирования

(реализуется

идея,

_______________________________________

Работа выполнена при поддержке проектов РФФИ №05-01-00332, 06-01-08045 офи, №05-07-90333, №06-0100492 , Целевой программы № 14 Президиума РАН, Целевой программы №2 Отделения математических наук

РАН

10

аналогичная

поиску

«максимального

зазора» между классами в методе опорных

векторов [5]), а функции

f ,c,d (S)

являются гауссовскими аппроксимациями

соответствующих P,c,d (S) [6].

Рассматривается

стандартная

задача

распознавания по прецедентам с n

признаками

x1 , x2 ,..., xn ,

l

непересекающимися классами K1 , K 2 ,..., Kl

и

эталонными

объектами

m

~

~ ~

S {S1 , S 2 ,..., S m } ,

Ki S Ki , i 1,2,..., l ,

~

Ki , i 1,2,..., l . Произвольный объект

S Ki

отождествляется

со

своим

описанием в виде числового

S ( x1 (S), x2 (S),..., xn (S)) ,

S t (at1 , at 2 ,..., atn ), atj x j (S t ) .

вектора

i 1

c ,d j

Пусть

Pj j

1, c j x d j ,

,

( x)

иначе

0,

где

c j R, d j R, j 1,2,..., n , {1,2,..., n} .

Определение. Предикат

c j ,d j

P ,c,d (x)

& Pj

j

(1)

(x j )

называется логической закономерностью

класса K , 1,2,..., l , если

~

1. S t K : P ,c,d (St ) 1,

~

2. S t K , P,c,d (St ) 0,

3. F ( P ,c,d (x))

F ( P *,c*,d* (x)) ,

extr

{P

*,c*,d*

( x)}

где

F (P

,c,d

~

(x)) {Si : Si K , P ,c,d (Si ) 1} -

критерий качества предиката.

Множество

N (P

,c,d

) {x R : c j x j d j , j }

n

будем называть интервалом предиката

(аналог

интервалов

P,c,d (x)

элементарных конъюнкций в алгебре

логики).

Два

P2 2 ,c 2 ,d 2 (x)

эквивалентными,

Два

N ( P11 ,c1 ,d1 ) ,

интервала

N ( P2 2 , c 2 , d 2 )

эквивалентными,

называются

если

~

~

N ( P11 ,c1 ,d1 ) S = N ( P2 2 ,c 2 ,d 2 ) S .

2. Основные определения

l

P11, c1 , d1 (S t ) = P2 2 ,c 2 ,d 2 (S t ), t 1,2,..., m .

предиката

P11 ,c1 ,d1 (x) ,

будем

называть

если

Далее

мы не будем различать эквивалентные

логические закономерности (интервалы).

Под экстремумами критерия F ( P,c,d (x))

понимаются

локальные

экстремумы.

,c,d

Допустимый предикат P

(x) является

локально-оптимальным

по

критерию

если

не

существует

F ( P,c,d (x)) ,

допустимый P11 ,c1 ,d1 (x) :

N ( P11,c1 ,d1 (x)) N ( P,c,d (x))

для которого

F ( P ,c,d (x)) < F ( P11 ,c1 ,d1 (x)) .

В работах [3,4] приведены алгоритмы

поиска множеств {P ,c,d (x)} , причем

для

каждого

предиката

подсистема

признаков

несократимой.

P ,c,d (x)

является

3. Алгоритмы распознавания,

основанные на голосовании по системам

логических закономерностей классов

Пусть для каждого класса K найдено

множество ЛЗ {P ,c,d (x)} , при этом

множество

интервалов

~

,c,d

,c,d

{N ( P

):P

} покрывает K .

Рассмотрим следующую гибридную схему

модели вычисления оценок.

1. Вычисление оценок:

( P ,c,d ) f ,c,d (S) ,

j (S)

P

, c, d

(2)

j

где f ,c,d (S) - потенциальная функция,

связанная

функция

,c,d

с

P,c,d (S)

f ,c,d (S)

(в

частности,

может совпадать с

P

(S) ).

2. Решающее правило:

1, j j (S) i i (S), i j,

Aj (S)

иначе,

0,

11

где j , j 1,2,.., l , - неотрицательные

нормировочные параметры классов.

Рассмотрим вопросы выбора неизвестных

параметров и потенциальных функций в

(2), (3).

1.

Поиск

весов

логических

закономерностей.

Пусть множество найденных ЛЗ классов

перенумеровано:

{P1(x), P2 (x),..., Pk (x)} .

1,2,...l

Рассмотрим следующую задачу линейного

программирования:

(4)

max ,

, c, d

i f i (S j ) , j 1,2,..., m, (5)

Pi P

k

i k , i 0, i 1,2,..., k ,

(6)

i 1

i ( Pi ) .

Аналогично, поиск параметров решающего

правила (3) сведем к решению задачи

(7)

max ,

~

j j (Si ) , i 1,2,..., m, S i K j , (8)

l

j l , j 0, j 1,2,..., l,

(9)

j 1

(предполагается,

~

S i K j ).

что

j (S i ) 0, при

Данные постановки являются аналогами

«максимального зазора» между классами в

методе опорных векторов [5].

Пусть a i min~ i (St ) , тогда система (8)

St K i

эквивалентна системе (10)

j a j , j 1,2,..., l ,

(10)

Нетрудно убедиться, что задача (7),(9),(10)

(а значит и задача 7-9) имеет аналитическое

решение

l

l

i 1

i 1

1 /( 1 / ai ) , j 1 /( a j 1 / ai ) .

2. Выбор потенциальных функций.

Использование

вместо

предикатов

аппроксимирующих

их

P,c,d (S)

«классических» потенциальных функций

[8,9] позволяет распространить «зону

,c,d

влияния» ЛЗ за пределы N ( P

) при

решении задач распознавания, и более

объективно численно оценивать факт

P,c,d (S) 1 для различных объектов.

Данный момент может быть особенно

существенным

при

малом

числе

,c,d

«голосующих» предикатов P

(S) .

Для аппроксимации P,c,d (S) будем

использовать функции следующего вида:

1

1) f (x) exp( ( xi bi ) / i 2 ) ,

2 i

1

2) f (x) exp( ( xi bi ) / i 2 ) , где

2 i

, i , bi - параметры аппроксимирующей

функции.

Обозначим i (di ci ) / 2 и положим

bi (di ci ) / 2, i . Рассмотрим примеры

возможных аппроксимаций предикатов

с

дополнительными

P,c,d (S)

ограничениями i 2i .

а. Выбор из условия минимума критерия

, c, d

(x)) 2 dx для функции 1)

( f (x) P

при ограничении i 2i и независимой

аппроксимации

каждой

функции

c j ,d j

Pj

( x), j

приводит

к

задаче

1

2 2 1 min ,

2

имеющей приближенное решение 0.4 ,

2

i 0.8i

(здесь

x

2

x t

e 2

2 0

dt

-

функция Лапласа).

б. Для критерия

max f (x) P ,c,d (x)

min

x

основная задача поиска параметров

i , i сводится к решению уравнения

1

1 exp (i / i ) 2

2

i

.

1

max exp (i / i ) 2 .

i

2

При

и

i 2i

k 1

0.5, i i .

x ~

x

1

i~ i

2 i i

в. f ,c,d (S) e

выборочные средние

имеем

2

~ xi ,

, где ~

i

и выборочные

12

средние

квадратические

оцениваемые

по

~

,c,d

Si N ( P

) K .

отклонения,

объектам

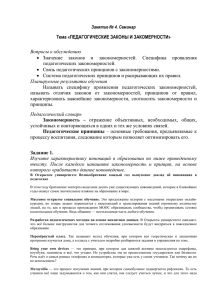

4. Практические эксперименты

Сравнительные эксперименты выполнены

для трех задач из области медицины,

физики и бизнеса (задача Ech - прогнозе по

данным

эхокардиограмм

состояния

пациентов [7], задача Houm - оценка

стоимости жилья в пригородах Бостона [8],

задача

Ion

распознавание

типа

радиосигнала [9]).

Результаты

экспериментов

(процент

правильно распознанных контрольных

объектов) приведены в Таблице. Колонка

«голосование» соответствуют вычислению

оценок

согласно

(2),

в

которой

и

f ,c,d (S) P,c,d (S)

( P,c,d ) 1 ,

решающему

правилу

(3)

при

Колонка

№1

j 1, j 1,2,.., l.

соответствует тому же алгоритму, но с

поиском

оптимальных

значений

,c,d

параметров ( P

) . В колонке №4

приведены

результаты,

аналогичные

алгоритму колонки «Голосование», с

использованием в (2) потенциальной

функции d). Жирным шрифтом отмечены

результаты

распознавания

модифицированными

алгоритмами,

превосходящие

исходный

алгоритм

голосования

по

логическим

закономерностям (колонка «голосование»).

Задача

“Ech”

“Ion”

“Houm”

Голосование

57.7

91.8

61.7

1

60.6

92.3

61.0

2

76.1

66.5

69.3

5. Заключение

В рассмотренной модели распознавания

для каждого класса и точки признакового

пространства вычисляются информативные

подмножества признаков и интервалы их

изменения (логические закономерности).

Для классификации новых объектов на базе

найденных логических закономерностей

предложен новый подход к взвешиванию

ЛЗ, являющийся аналогом максимальному

зазору в методе опорных векторов. При

этом в качестве гладких аппроксимаций ЛЗ

используются

хорошо

изученные

и

надежные ядерные функции.

Список литературы

1. Ю.И.Журавлев, Об алгебраическом подходе к

решению

задач

распознавания

или

классификации. Проблемы кибернетики. М.:

Наука, 1978. Вып.33. С.5-68.

2. Ю.И. Журавлёв. Об алгоритмах распознавания с

представительными наборами (о логических

алгоритмах)

//

Журнал

вычислительной

математики и математической физики, 2002, Т.

42, №9, С. 1425-1435

3. Ryazanov V.V., Vorontchikhin V.A. Discrete

Approach for Automatic Knowledge Extraction

from Precedent Large-scale Data, and Classification.

Proceedings of the 16th International Conference on

Pattern Recognition. Quebec, Canada, 2002, 11-15

August.

4. Ю.И.Журавлев,

В.В.Рязанов,

О.В.Сенько.

РАСПОЗНАВАНИЕ. Математические методы.

Программная

система.

Практические

применения. Изд.во «ФАЗИС», Москва, 2006,

178 стр.

5. Christopher J.C. Burges. A Tutorial on Support

Vector Machines for Pattern Recognition, Appeared

in: Data Mining and Knowledge Discovery 2, 121167, 1998.

6. Айзерман М.А., Браверманн Э.М., Розоноэр Л.И.

Метод потенциальных функций в теории

обучения машин. - М.: Наука, 1970.-384 с.

7. Salzberg, S. (1988). Exemplar-based learning:

Theory and implementation (Technical Report TR10-88). Harvard University, Center for Research in

Computing Technology, Aiken Computation

Laboratory (33 Oxford Street; Cambridge, MA

02138).

8. Harrison, D. and Rubinfeld, D.L. Hedonic prices and

the demand for clean air, J. Environ. Economics &

Management, vol.5, 81-102, 1978.

9. Sigillito, V. G., Wing, S. P., Hutton, L. V., \&

Baker, K. B. (1989). Classification of radar returns

from the ionosphere using neural networks. Johns

Hopkins APL Technical Digest, 10, 262-