ПРОБЛЕМА ВЫБОРА ЯДРА В МЕТОДЕ ОПОРНЫХ ВЕКТОРОВ

advertisement

220

УДК 519.7

ПРОБЛЕМА ВЫБОРА ЯДРА В МЕТОДЕ

ОПОРНЫХ ВЕКТОРОВ

А.Н. Будынков

Институт проблем управления им. В.А. Трапезникова РАН

Россия, 117997, Москва, Профсоюзная ул., 65

E-mail: v1925@mail.ru

О.А. Коршунова

Институт проблем управления им. В.А. Трапезникова РАН

Россия, 117997, Москва, Профсоюзная ул., 65

E-mail: v1925@mail.ru

Ключевые слова: SVM, опорные вектора, ядро, энтропия.

В работе рассмотрен вариант метода опорных векторов (support vector machines – SVM),

применяющийся, когда недоступен достаточный объем данных для классификации

анормальных режимов работы технологических объектов. Исследовались три процедуры оценки параметра специальной функция (называемой ядром), две известные по литературе: перекрестной проверки; максимума дисперсии, и так же, предложенная нами

модификация последней процедуры, когда минимизировался функционал энтропии для

матрицы ядра.

THE PROBLEM OF SELECTING KERNEL IN THE VECTOR SUPPORT METHODS

A.N. Budynkov

V.A. Trapeznikov Institute of Control Sciences of the Russian Academy of Sciences

Russia, 117997, Moscow, Profsoyuznaya Street, 65

E-mail: v1925@mail.ru

O.A. Korshunova

V.A. Trapeznikov Institute of Control Sciences of the Russian Academy of Sciences

Russia, 117997, Moscow, Profsoyuznaya Street, 65

E-mail: v1925@mail.ru

Ключевые слова: SVM, support vectors, kernel, entropy.

In the paper, a variant of the support vector method (support vector machines – SVM) is considered, applied when enough size of data for classification of abnormal modes of technical

plant performance is not available. Three procedures of the estimate of a special function (referred as the kernel) parameter were investigated, two ones known in the literature: cross validation, variance maximum, as well as proposed by the authors a modification of the latter procedure, when an entropy functional was minimized for the kernel matrix.

Труды X Международной конференции «Идентификация систем и задачи управления» SICPRO ‘15 Москва 26-29 января 2015 г.

Proceedings of the X International Conference “System Identification and Control Problems” SICPRO ‘15 Moscow January 26-29, 2015

221

1. Введение

Для многих современных технологических объектов, например, авиационных двигателей, актуальна проблема оценки состояния и выявление анормальности их поведения. В большинстве случаев достаточен сам факт обнаружения анормальности, в независимости от причины появления, что позволяет избежать разрушения объекта и сохранить его для дальнейшего анализа причины анормального поведения. Оценка состояния объекта всегда основана на сравнении текущего состояния объекта с эталонным, установленным из некоторой модели. Испытание опытных образцов технологических объектов имеют особенности, состоящие в том, что, например, из-за уникальности

объекта прямое преобразование знаний об объекте испытаний в модель в виде формальной модели или экспертных заключений не всегда возможно. Препятствием может

служить сложность и недостаточная изученность объекта испытаний, закрытие информации разработчиком из-за ее конфиденциальности. В этих случаях часто применяют

информационно-ориентированные методы, которые синтезируют модель на основе

данных, собранных в течение предыдущей работы объекта для выявления анормальности поведения в настоящее время. Обзор и анализ таких алгоритмов можно найти в работах [1-4 и др.]. Все алгоритмы требуют обучающей последовательности, на которых

строится модель, используемая для проверки гипотезы о нормальности тестируемых

данных.

В работе рассмотрен вариант метода опорных векторов (support vector machines –

SVM) [5], применяющийся, когда недоступен достаточный объем данных для классификации анормальных режимов работы. В этом случае для построения модели поведения используется обучающая последовательность, большинство точек из которой полагаются нормальными, за исключением некоторого числа точек, называемых выбросами

(одноклассовый метод опорных векторов 1-SVM).

Характерной чертой 1-SVM является применение специальной функции (называемой ядром) для преобразования обучающей последовательности данных из исходного

пространства в более многомерное или, возможно, бесконечномерное пространство

признаков и построения линейной модели (разделяющей гиперплоскости) в этом пространстве признаков, что позволяет практически всем нормальным данным быть с одной стороны и быть отделенными от анормальных данных, если такие имеются. 1-SVM

чувствителен к выбору ядра, используемого при построении классификатора в случае,

если функция задана с точностью до параметра, то к выбору параметров функции. Выбор зависит от входных данных и знания доли выбросов в обучающей последовательности. В работе рассмотрены аспекты выбора ядра, исследуются конкретные процедуры по выбору параметров. Процедуры верифицировались на тестовых данных, традиционно используемых для оценки качества классификации, а также на данных отражающих прогнозируемые типичные реальные данные, получаемые от объекта. Алгоритм опорных векторов реализован с использованием свободной библиотеки [6], которая уже применялась для решения аналогичной задачи диагностики сложных экспериментальных объектов [7, 8].

Труды X Международной конференции «Идентификация систем и задачи управления» SICPRO ‘15 Москва 26-29 января 2015 г.

Proceedings of the X International Conference “System Identification and Control Problems” SICPRO ‘15 Moscow January 26-29, 2015

222

2. Постановка задачи

Пусть обучающая последовательность имеет вид: {( x1 , y1 ), ( xi , yi ).....( xl , yl )} , где

вектора xi R n и где y i – метка, которая принимает значение 1 или −1 в зависимости

от того, принадлежит или нет точка классу.

Задачей является построение классификатора F : X Y , сопоставляющего класс y

произвольному вектору x.

Решение задачи сводится к оптимизации функционала [9]:

l

1

min T C i

(1)

, , 2

i 1

при условии T ( xi ) i , где – обобщенный портрет, i 0 веса, характеризующие величину ошибки для { x1 ,.. xi ,..... xl } , С – константа регуляризации, обычно вы1

бираемая C , – максимальная доле точек в обучающей последовательности, коl

торые могут быть выбросами [10], ( xi ) – функция отображения вектора xi в расширенное пространство, где обеспечивается линейная разделимость классов, –параметр

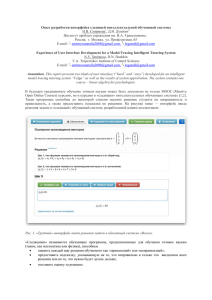

метода. На рис. 1 приведена графическая иллюстрация метода. Незаполненными точками показаны векторы в обучающей последовательности, не использованные при построении разделяющей плоскости, заполненные точки означают опорные вектора, звездочками обозначены вектора в обучающей последовательности, которые классифицировались как выбросы, не принадлежащие классу. Величина

ние по нормали

определяет расстоя

от точки начала отсчета O, которая для 1-SVM является единст

венной точкой изначально не принадлежащей классу, до разделительной гиперплоскости ( ).

i

O

Рис. 1. Геометрическая иллюстрация 1-SVM.

Соответствующая задаче (1) двойственная задача оптимизации имеет вид:

Труды X Международной конференции «Идентификация систем и задачи управления» SICPRO ‘15 Москва 26-29 января 2015 г.

Proceedings of the X International Conference “System Identification and Control Problems” SICPRO ‘15 Moscow January 26-29, 2015

223

1

min Q T ,

2

где Q – положительно определенная центрсимметричная матрица ядра с элементами

(2)

Qi , j K ( xi , x j ) ( xi )T ( xi ) , K ( xi , x j ) – ядро, при условии

'

l

i 1, и 0 i

i 1

1

l

Методу 1-SVM соответствует решающее правило:

l

t ( x * , ) sgn( i K ( x * , xi ) )

i 1

3. Теория

От выбора K ( xi , x j ) существенно зависит качество классификатора. Существует

большое множество процедур для выбора ядра, однако все они основаны на некоторых

эмпирических предпосылках, что приводит к субъективному характеру получаемых

результатов. В работе [11] введено понятие выравнивания ядра, как меры сходства между двумя ядрами или между ядром и целевой функцией, которая может быть использована для выбора ядер.

Выравнивание между ядрами K1 и K 2 определяется как косинус угла между центрсимметричными матрицами ядра Q1 и Q2 .

Q1 , Q2 F

,

(3)

A( K1 , K 2 ) :

Q1 F Q2 F

где

Q1 , Q2

: i , j 1 K1 ( xi , x j ) K 2 ( xi , x j ) и

l

F

K

F

: K , K

1/ 2

F

являются скалярным

произведением и нормой Фробениуса соответственно. Выравнивание (3) может быть

использовано как для сравнения ядра, так и для выбора оптимальных параметров ядра

[12]. Обычно в качестве Q2 используется идеальное ядро Q 2 yy T , где вектор меток

yi li 1 .

Тогда, выравнивание измеряет степень пригодности ядра для классификации

образцов

K ( xi , x j )

xi , yi li 1 .

yi y j

Фактически, при выборе ядра стремятся обеспечить, чтобы

K ( xi , x j )

yi y j

. Однако, данная процедура мало пригодна для 1-SVM,

где в наличии имеется только обучающая последовательность, принадлежащая одному

классу. Несколько облегчает ситуацию то, что в большинстве случаев [6] можно ограничиться в качестве ядра радиальной базисной функцией Гаусса (RBF)

K ( xi , x j ) e

xi x j

2

.

Функция RBF (4) широко применяется для классификации методом опорных векторов и имеет ряд преимуществ [13], но даже если зафиксировать вид функции, тогда

остается проблема выбора параметра ядра . В работе [14] отмечено, что большие значения приводят к переобучению, малые значения препятствуют способности

классификатора обнаруживать нетривиальные образцы, так как ядро постепенно сводится к постоянной функции. В работе [15] для 1- SVM показано, что для RBF если параметр велик и K (i, j ) 0, i j , то оптимальное решение для в уравнении (2) яв(4)

Труды X Международной конференции «Идентификация систем и задачи управления» SICPRO ‘15 Москва 26-29 января 2015 г.

Proceedings of the X International Conference “System Identification and Control Problems” SICPRO ‘15 Moscow January 26-29, 2015

224

ляется i 1 / N и значение целевой функции (2) будет равно 1 / N , если слишком

мало и K (i, j ) 1 , то оптимальным решением является все допустимое множество для

и значение целевой функции будет стремиться к 1 и выбор существенно влияет на

положение решения в границах [1 / N ,1] .

Для выбора значения параметра может быть применена оптимизационная процедура перекрестной проверки [16], когда исходная обучающая последовательность

разбивается на несколько выборок меньшего размера, которые используются для обучения и контрольной классификации. Оптимизация проводится для фиксированного

набора значений и выбирается наименьшее такое, что назначенная доля точек

классифицируется как выбросы.

Данная процедура успешно применялась нами в некоторых случаях, но она очевидно чувствительна к параметру . Доля выбросов не всегда может быть оценена исходя из условий эксперимента, в частности это затруднительно для данных, представляющих собой параметры меняющиеся во времени, когда каждый вектор xi является

временным срезом диагностируемого процесса.

Для случая, когда ядра задано в виде RBF и не известно, в работе [14] предложена другая процедура выбора . В качестве индикатора оптимальности выбора параметра служит величина дисперсии s 2 не диагональных элементов ядра K (i, j ) | i j

для матрицы Q , нормированные на среднее значение Q , оптимальным считается ядро,

s2

.

Q

Этот подход использует преимущество поведения 1-SVM с ядром RBF.

Было показано, что для ядер с большей дисперсией получаются лучшие результаты

по классификации. Можно предположить, что результат является следствием, что более

разряженному вектору в уравнения (2), который отвечает матрице ядра Q с большей

дисперсией, соответствует меньшее количество точек обучающей последовательности,

отобранных в качестве опорных векторов, что улучшает качество классификации.

В дополнение к процедуре [14] нами предложена другая эвристическая процедура,

основанная на сходных предпосылках о необходимости обеспечения разреженности

вектора . В качестве меры разреженности матрицы ядра Q использовался функционал энтропии E ln K (i, j ) [17], и решалась задачи оптимизации:

при котором достигается max

i, j

(5)

max E .

Решение (5) для существует и единственно, т.к. Q положительно определенная

матрица и E выпуклая функция.

4. Результаты экспериментов и обсуждение результатов

Некоторые результаты моделирования приведены в таблице 1 и таблице 2 для трех

процедур: 1 (перекрестной проверки) 2 (максимума дисперсии) и 3 (максимума энтропии). Расчеты проводились с использованием свободной библиотеки опорных векторов

[6]. В таблице 1, для моделирования по процедуре (1) для стабилизирующего параметра

задавалось реальное значение доли выбросов в обучающей последовательности. В таб-

Труды X Международной конференции «Идентификация систем и задачи управления» SICPRO ‘15 Москва 26-29 января 2015 г.

Proceedings of the X International Conference “System Identification and Control Problems” SICPRO ‘15 Moscow January 26-29, 2015

225

лице 2 эксперимент повторен для случая, когда не известно и оно выбиралось фиксированным.

Таблица 1. Результаты моделирования, при известном

Источник данных

Объем данных

www.cs.wisc.edu/~olvi/data/check1.txt

([18])

http://www.csie.ntu.edu.tw/~cjlin/libsvmt

ools/datasets/binary.html#australian

http://www.csie.ntu.edu.tw/~cjlin/libsvmt

ools/datasets/binary.html#fourclass

Источник данных

Размер a (%),

вектора По значению

данных 0.1

1

2

3

2

62 64 61

2

580

2

600

14

62

64

62

2

862

2

56

55

55

Таблица 2. Результаты моделирования, для

www.cs.wisc.edu/~olvi/data/chec

k1.txt ([18])

http://www.csie.ntu.edu.tw/~cjlin

/libsvmtools/datasets/binary.html

#australian

http://www.csie.ntu.edu.tw/~cjlin

/libsvmtools/datasets/binary.html

#fourclass

.

0.01

Объем

данных

a (%),

По значению 0.1

1

2

3

50

51

50

2

580

Размер

вектора

данных

2

2

600

14

56

49

55

2

862

2

51

52

54

Точность классификации оценивалось по формуле:

A F AI

| 100% ,

a 1 |

B

где A – общее число точек классифицированных в тестовом примере, как относящееся к

классу, F – число точек классифицированных в тестовом примере, как относящееся к

классу, но не принадлежащее ему; B – число точек в тестовой последовательности; AI

– число точек, принадлежащее к классу в тестовой последовательности.

При применении процедуры перекрестной проверки, результат в значительной степени зависит от возможности оценить значение доли выбросов, когда это возможно,

процедура обеспечивала приемлемое качество классификации (для тестовых примеров

>50%, кроме отдельных точек для процедуры 1). Для фиксированного , очевидно

ухудшение точности классификации для всех процедур оценки , из-за неправильного

выбора стабилизирующего параметра. В экспериментах наблюдалось спорадически

проявляющееся резкое изменение качества классификации при незначительном изменении числа выбросов в обучающей последовательности.

Процедуры 2 и 3 обеспечивали сравнимое с процедурой 1 качество классификации

и плавное ухудшение точности классификации с ростом числа выбросов в обучающей

Труды X Международной конференции «Идентификация систем и задачи управления» SICPRO ‘15 Москва 26-29 января 2015 г.

Proceedings of the X International Conference “System Identification and Control Problems” SICPRO ‘15 Moscow January 26-29, 2015

226

последовательности. Оценка процедуры 2 имела тенденцию к переобучению (большие значения параметра ), процедура 3 наоборот, обеспечивала меньшее значение

параметра .

На рис. 2 приведен пример данных, использовавшихся для верификации процедур

(тестовые данные [18]) и результат классификации для 5 . На рис. 2 незаполненные

треугольники обозначают обучающую последовательность, принадлежащую одному

классу, заполненные круги обозначают данные из тестовой последовательности, классифицированные как относящиеся к классу, незаполненные круги обозначают данные

из тестовой последовательности, классифицированные как не относящиеся к классу,

заполненные треугольники обозначают опорные вектора.

Рис. 2. Расположение точек тестовой и обучающей последовательности.

На рис. 3 приведена зависимость точности классификации для примера [18] в зависимости от доли выбросов в обучающей последовательности, считалось точно известным. На рис. 3 использованы обозначения указанные в таблице 1. На рис. 4 показаны результаты моделирования, идентичные результатам на рис. 3, за исключением того, что параметр считался неизвестным и был задан фиксированным.

Таблица 3. Обозначения на рис. 3 и 4.

Обозначение на

графике

Cross

fCross

Var

fVar

Название параметра

Доля точек в тестовой последовательности принадлежащих к

классу, отнесенных к классу (процедура 1)

Точность классификации (процедура 1)

Доля точек в тестовой последовательности принадлежащих к

классу, отнесенных к классу (процедура 2)

Точность классификации (процедура 2)

Труды X Международной конференции «Идентификация систем и задачи управления» SICPRO ‘15 Москва 26-29 января 2015 г.

Proceedings of the X International Conference “System Identification and Control Problems” SICPRO ‘15 Moscow January 26-29, 2015

227

Обозначение на

графике

E

fE

Название параметра

Доля точек в тестовой последовательности принадлежащих к

классу, отнесенных к классу (процедура 3)

Точность классификации (процедура 3)

Рис. 3. Зависимость точности классификации от доли выбросов в обучающей последовательности, для известного .

Рис. 4. Зависимость точности классификации от доли выбросов в обучающей последовательности, для фиксированного 0.01 .

5. Выводы и заключение

Метод опорных векторов показал свою практическую пригодность для оценки

состояния объекта и обнаружения изменения характера процесса. Однако метод является чувствительным как к выбору ядра, так и к выбору его параметров. Во многих

практических случаях можно использовать в качестве ядра радиальную базисную

функцию Гаусса (RBF), однако остается проблема выбора параметра ядра.

Нами исследовались три процедуры оценки параметра, известные по литературе:

перекрестной проверки; максимума дисперсии и так же, предложенная нами модификация последней процедуры, когда минимизировался функционал энтропии для

матрицы ядра.

Проведены эксперименты, как на модельных данных, так и данных реальных

объектов (использовались записи параметров авиационных двигателей), которые ук-

Труды X Международной конференции «Идентификация систем и задачи управления» SICPRO ‘15 Москва 26-29 января 2015 г.

Proceedings of the X International Conference “System Identification and Control Problems” SICPRO ‘15 Moscow January 26-29, 2015

228

ладываются в следующую картину. При применении процедуры перекрестной проверки, результат в значительной степени зависит от возможности оценить значение

доли выбросов в обучающей последовательности, если это возможно, то процедура

обеспечивала хорошее качество классификации (в среднем более 60%, точно классифицируемых точек на тестовых примерах для небольшой доли выбросов – менее

10% в обучающей последовательности). Отметим наблюдавшееся резкое изменение

качества классификации при незначительном изменении входных параметров.

Процедуры оценки параметра по максимуму дисперсии и максимуму энтропии в

случае малого количества выбросов в обучающей последовательности, дают несколько худшее качество (по нашей оценке менее 5%) и относительно плавное, без

резких флуктуаций, ухудшение точности классификации с ростом числа выбросов в

обучающей последовательности. Оценка по максимуму дисперсии имела тенденцию

к переобучению, процедура оценки по максимуму энтропии наоборот, обеспечивала

меньшее значение параметра ядра RBF и была более близкой по качеству классификации к процедуре перекрестной проверки. Независимость процедур по максимуму

дисперсии и энтропии от наличия оценки количества выбросов в обучающей последовательности является как достоинством, так и недостатком. С одной стороны, позволяя оценить параметры ядра без наличия информации о доли выбросов в обучающей последовательности, с другой стороны несколько ухудшая качество классификации.

Список литературы

1.

2.

3.

4.

5.

6.

7.

8.

9.

10.

11.

12.

13.

14.

Вапник В.Н., Червоненкис А.Я. Теория распознавания образов. М.: Наука, 1974.

Chandola V., Banerjee A., Kumar V. Anomaly Detection: A Survey // ACM Computing Surveys. 2009.

Markou M., Singh S., Novelty Detection: A Review. Part 1: Statistical Approaches // Signal Processing.

2003. Vol. 83. P. 2481-2497.

Markou M., Singh S. Novelty Detection: A Review. Part 2: Neural Network Based Approaches // Signal

Processing. 2003. Vol. 83. P. 2499-2521.

Scholkopf B, Platt J., Shawe-Taylor J., Smola A, and Williamson R. Estimating the support of a highdimensional distribution. Technical report, Microsoft Research, MSR-TR-99-87, 1999.

Chang

C.,

Lin

C.

LIBSVM:

a

Library

for

Support

Vector

Machines

//

http://www.csie.ntu.edu.tw/∼cjlin/libsvm/.

Iverson D., Martin R., Schwabacher M., Spirkovska L, Mackey R., Castle P., et al. General Purpose DataDriven System Monitoring for Space Operations // AIAA Infotech@Aerospace Conference. AIAA, Washington, DC, 2009. AIAA paper 2009-1909.

Schwabacher M., Oza N., Matthews B. Unsupervised Anomaly Detection for Liquid-Fueled Rocket Propulsion Health Monitoring // Journal of Aerospace Computing, Information, and Communication 2009. Vol. 6.

No. 7. P. 464-482.

Scholkopf B., Smola A.J. Learning with Kernels: Support Vector Machines, Regularization, Optimization,

and Beyond. Cambridge, MA: MIT Press, 2002.

Scholkopf B., Smola A., Williamson R.C., Bartlett P.L. New support vector algorithms // Neural Computation. 2000. Vol. 12. P. 1207-1245.

Cristianini N., Kandola J., Elisseeff A., Shawe-Taylor J. On kernel-target alignment // In: Dietterich T.G.,

Becker S., and Ghahramani Z., editors / Advances in Neural Information Processing Systems. MIT Press,

2002. Vol. 14. P. 367-373.

Lanckriet G.R.G., Cristianini N., Bartlett P. et. al. Learning the Kernel Matrix with Semidefinite Programming // Journal of Machine Learning Research. 2004. Vol. 5. P. 27-72.

Lin H.-T., Lin C.-J. A study on sigmoid kernels for SVM and the training of non-PSD kernels by SMO-type

methods. Technical report. Department of Computer Science, National Taiwan University, 2003. URL

http://www.csie.ntu.edu.tw/~cjlin/papers/tanh.pdf.

Shawe-Taylor J. Cristianini N. Kernel Methods for Pattern Analysis. Cambridge University Press, 2004.

Труды X Международной конференции «Идентификация систем и задачи управления» SICPRO ‘15 Москва 26-29 января 2015 г.

Proceedings of the X International Conference “System Identification and Control Problems” SICPRO ‘15 Moscow January 26-29, 2015

229

15. Evangelista P.F., Embrechts M.J., Szymanski B.K. Some Properties of the Gaussian Kernel for One Class

Learning // Proceedings International Conference on Artificial Neural Networks ICANN '07. Portugal, September, 2007. Lecture Notes in Computer Sciences. Springer, 2007. Vol. 466. Part 1. P. 269-278.

16. Runarsson R.T., Unnthorsson R., Johnson T. M. Model Selection in One Class Nu-SVMS using RBF Kernels // 16th Conference on Condition Monitoring and Diagnostic Engineering Management, 2003.

17. Smylie D., Clarke G., Ulrych T., Analysis of irregularities in the Erath’s rotation. Methods in Computational

Physics. R. Alder et. al. v. 13 p 391-430 Academic Press Inc new York , 1973

18. Chessboard www.cs.wics.edu/~olvi/data/check1.txt.

Труды X Международной конференции «Идентификация систем и задачи управления» SICPRO ‘15 Москва 26-29 января 2015 г.

Proceedings of the X International Conference “System Identification and Control Problems” SICPRO ‘15 Moscow January 26-29, 2015