Вычислительные стратегии

реклама

ГЛАВА

1.

КЛАСС

ЗАДАЧ

ВЫЧИСЛИТЕЛЬНЫМИ

ОПТИМАЛЬНОГО

ОСОБЕННОСТЯМИ

УПРАВЛЕНИЯ

И

МЕТОДЫ

С

ИХ

РЕШЕНИЯ

1.1. Задача оптимального управления

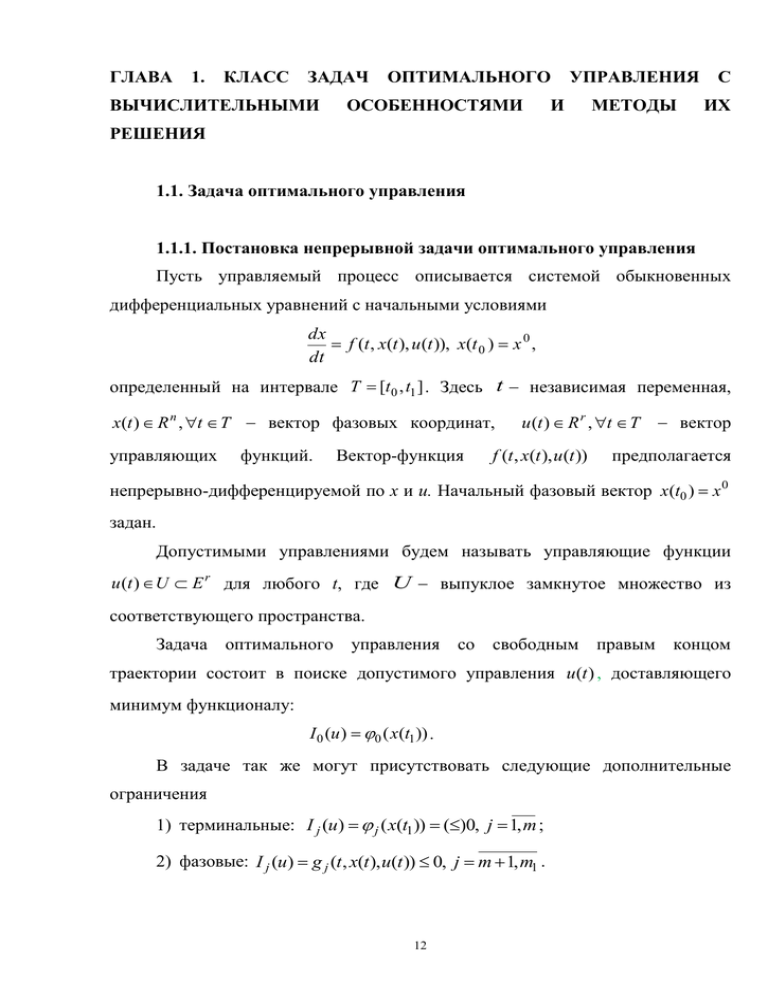

1.1.1. Постановка непрерывной задачи оптимального управления

Пусть управляемый процесс описывается системой обыкновенных

дифференциальных уравнений с начальными условиями

dx

f (t , x(t ), u (t )), x(t 0 ) x 0 ,

dt

определенный на интервале T [t0 , t1 ] . Здесь t независимая переменная,

x(t ) R n , t T вектор фазовых координат,

управляющих

функций.

Вектор-функция

u (t ) R r , t T

f (t , x(t ), u (t ))

вектор

предполагается

непрерывно-дифференцируемой по x и u. Начальный фазовый вектор x(t0 ) x 0

задан.

Допустимыми управлениями будем называть управляющие функции

u (t ) U E r для любого t, где U выпуклое замкнутое множество из

соответствующего пространства.

Задача оптимального управления со свободным правым концом

траектории состоит в поиске допустимого управления u (t ) , доставляющего

минимум функционалу:

I 0 (u ) 0 ( x(t1 )) .

В задаче так же могут присутствовать следующие дополнительные

ограничения

1) терминальные: I j (u) j ( x(t1)) ()0, j 1, m ;

2) фазовые: I j (u) g j (t , x(t ), u(t )) 0, j m 1, m1 .

12

Функции j ( x(t1)), j 0, m и g j (t , x(t ), u(t )), j m 1, m1 предполагаются

непрерывно-дифференцируемыми по всем аргументам.

При реализации программных средств для решения ЗОУ удобнее

рассматривать несколько другой вид оптимизационной модели. В качестве

базовой (стандартной, канонической) рассматривается задача:

dx

f (t , x(t ), u(t ), p), t [t0 , t1] ;

dt

ul u (t ) u g ;

I 0 (u ) 0 ( x(t1 ), p) min ;

I j (u) j ( x(t1), p) ()0, j 1, m ;

I j (u) g j (t , x(t ), u(t ), p) 0, j m 1, m1 ,

где ul , u g R r вектора параллелепипедных ограничений на управление,

p R l вектор постановочных параметров – констант, присутствующих в

модели, но не изменяемых в процессе оптимизации.

1.1.2. Численные методы решения ЗОУ

Задачи

оптимального

управления,

возникающие

в

практической

деятельности, и различные подходы к их исследованию привели к созданию

различных численных методов, которые условно можно разбить на группы.

Первую группу составляют методы градиентного типа [Шатровский,

1962; Келли, 1965; Энеев, 1966; Брайсон, Хо Ю-Ши, 1972; Кротов, Гурман,

1973; Сеа, 1973; Полак, 1974; Федоренко, 1978; Васильев О.В., 1994; Васильев

О.В., Аргучинцев, 1999]. Ограничения на управление и фазовые переменные в

градиентных методах первого порядка преодолевались путем соответствующей

модификации алгоритмов. Некоторые модификации связаны с методом

штрафных функций [Гермейер, 1971], другие это методы спуска в

пространстве

управлений,

представляющие

собой

аналоги

методов

конечномерной оптимизации: условного градиента, проекции градиента

13

[Демьянов, Рубинов, 1968; Федоренко, 1975], возможных направлений

[Зойтендейк, 1963; Гюрджиев, 1980]; сопряженных градиентов [Брайсон, Хо

Ю-Ши, 1972; Федоренко, 1978; Полак, 1983].

Вторую группу составляют методы, основанные на применении

известных алгоритмов нелинейного программирования к конечномерным

представлениям задач оптимального управления [Пшеничный, Данилин, 1975;

Моисеев, 1975; Мордухович, 1980; Евтушенко, 1982].

Третью группу сотавляют методы вариаций в фазовом пространстве

[Моисеев, 1964, 1966, 1975; Федоренко, 1978; Васильев Ф.П., 1980] и его

разновидности: метод локальных вариаций [Крылов, Черноусько, 1966;

Черноусько, Баничук, 1973] и метод блуждающей трубки [Моисеев, 1966].

В четвертой группе для построения вычислительных методов решения

ЗОУ

широко

используется

принцип

максимума,

предложенный

Л.С.

Понтрягиным [Моисеев, 1975; Черноусько, Колмановский, 1977; Федоренко,

1978; Васильев Ф.П., 1980, 1981; Васильев О.В., Тятюшкин, 1981, 1983;

Любушин, Черноусько, 1983; Срочко, 1989; Васильев О.В., Срочко В.А.,

Терлецкий, 1990; Бельтюков, Терлецкий, 1991;

Васильев О.В., 1994;

Аргучинцев, Васильев О.В., 1996; Васильев О.В., Васильев О.В., Надежкина,

1996]. Наиболее полное отражение этих работ можно найти в монографии В.А.

Срочко [Срочко, 2000]. Одним из первых был предложен алгоритм [Крылов,

Черноусько, 1962], предусматривающий последовательное интегрирование

исходной и сопряженной систем и выбор управления из условия максимума

функции Понтрягина. В первоначальном виде метод не гарантировал

сходимости, однако его последующие модификации приобрели это свойство

[Крылов, Черноусько, 1972; Цирлин, Балакирев, Дудников, 1976; Любушин,

1979, 1982].

Пятая группа методов – это метды, основанные на принципе расширения

и сформулированных с помощью него достаточных условиях оптимальности

[Кротов]. Функция Кротова (Кротова-Беллмана), присутствующая в этих

14

условиях, может определяться неединственным способом, что обусловило

возможность создания целого ряда алгоритмов. Первые такие алгоритмы

описаны в работах [Кротов, 1962-1965, 1975; Кротов, Букреев, Гурман, 1969;

Кротов, Гурман, 1973]. Впоследствии, В.И. Гурманом и его учениками были

созданы алгоритмы последовательных улучшений, в которых используется

тейлоровское

разложение

функции

Кротова

в

окрестности

текущего

приближения с точностью до первого или второго порядка [Гурман, Расина,

1979; Гурман, Батурин, Расина, 1983; Батурин, Урбанович, 1997; Гурман, 1997].

Для обеспечения адекватности приближения функции Кротова в этих

алгоритмах в дальнейшем стали применяться специальные регуляторы

близости: в [Гурман, Батурин, Расина, 1983] аддитивный квадратический

функционал с регулируемым весом, в [Батурин, Урбанович, 1997]

вспомогательный

и

функционал,

состоящий

из

суммы

исходного

квадратического функционалов, умноженных на весовые коэффициенты. Такие

алгоритмы получили название «сильного» (требование малого изменения

только по траектории) и «слабого» (требование малого изменения как по

траектории, так и по управлению) улучшения. Для алгоритмов сильного и

слабого улучшения второго порядка характерна возможность улучшения любой

неоптимальной в локальном смысле программы управления, в том числе и

экстремали Понтрягина.

Среди методов, основанных на принципе расширения, справедливо

выделить

отдельную

группу

методов,

основанных

на

локальных

аппроксимациях множества достижимости управляемой динамической системы

[Гурман, Константинов, 1981; Константинов, 1983; Гурман, Батурин, 1985;

Батурин, Гончарова, 1999; Гончарова, Гуркало, 2004].

Также, на основе принципа расширения создано немало методов для

решения вырожденных задач оптимального управления [Гурман, 1967, 1977;

Гурман, Расина, 1979; Гурман, Батурин, 1980, 1981; Казаков, Кротов, 1987;

Дыхта, 1991, 1994; Колокольникова, 1992; Дыхта, Деренко, 1994; Дыхта,

15

Самсонюк, 2000; Baturin, Verkhozina, 2003].

Такие методы эффективны в

задачах, для которых в силу тех или иных причин (например, множественность

решений, отвечающих необходимым условиям или неприменимость известных

достаточных условий) иные методы не подходят.

Нельзя не отметить и особый класс алгоритмов, носящих название

мультиметодных. Еще в 70-е годы 20 века специалистами в области

оптимального управления был осознан тот факт, что для эффективного

решения практических нелинейных задач оптимизации динамических систем

одного выделенного метода явно недостаточно. Предлагалось на различных

этапах вычислительного процесса использовать наиболее подходящие для этих

этапов методы, что формировало для каждой конкретной задачи свой особый

мульти-алгоритм [Тятюшкин, 1992].

Позднее, в работах В.И. Гурмана и Д.В.

Белышева [Гурман, Белышев, 2002,2003] были предложенны «многометодные

интеллектуальные

процедуры

поиска

оптимального

управления»,

где

предлагалась декомпозиция методов на отдельные подзадачи и выбор способа

решения каждой подзадачи путем организации «конкурса алгоритмов».

1.1.3. Программные комплексы для решения ЗОУ

Создание программных средств для решения задач оптимального

управления началось с первыми успехами теоретических разработок еще в 60-х

годах 20 века и велось параллельно в нескольких организациях. К сожалению,

большинство предлагаемых методов были реализованы в виде научноисследовательских прототипов программ, так и не пройдя требуемых этапов

доведения до уровня отчуждаемого программного продукта.

Отечественные разработки. Одним из первых отечественных пакетов

программ для ЗОУ был создан программный комплекс CONTROL (Федоренко

Р.П., Попов В.С., ИПМ АН СССР им. М.В.Келдыша), ставший в то время

уникальным средством для практического исследования ЗОУ.

16

Методы редукции к задаче математического программирования были

реализованы в виде блока «Оптимальное управление» в «Диалоговой Системе

Оптимизации» (Евтушенко Ю.Г., Грачев Н.И., ВЦ АН СССР), содержащей

помимо непосредственно вычислительных процедур еще и механизмы

интерактивного взаимодействия с пользователем.

Ряд методов редукции к задаче математического программирования был

реализован также в пакете программ КОНУС «Комплексная оптимизация

нелинейных управляемых систем» (А.И. Жолудев, А.И. Тятюшкин, ИрВЦ СО

РАН)

Методы, глубоко учитывающие специфику линейных ЗОУ легли в основу

пакета прикладных программ (ППП) ЛЗОУ (А.И.Тятюшкин, ИрВЦ СО РАН).

Диалоговая технология решения нелинейных ЗОУ нашла свое развитие в

рамках программного проекта МАПР «Математическое программирование в

многомерных задачах» (А.И.Тятюшкин, А.Ю. Горнов, ИрВЦ СО РАН),

который был использован при решении значительного числа прикладных задач.

Параллельно в ИрВЦ СО РАН велась разработка «ППП для ЗОУ»

(Гурман В.И., Батурин В.А.), включавшая реализации методов, основанных на

достаточных условиях оптимальности. Данный пакет активно применялся при

решении практических задач из области экологии, экономики и управления

движением летательных аппаратов.

Более 15 лет используются в практических приложениях результаты

программного проекта OPTCON (А.Ю. Горнов, ИрВЦ СО РАН), реализующего

мультиметодную технологию решения ЗОУ и включающего развитые средства

интерактивного взаимодействия с пользователем. В рамках данного проекта

были созданы также вычислительный сервер OPTCON-2(?) (А.Ю. Горнов, Л.В.

Массель, Д.В. Подкаменный, ИДСТУ СО РАН, ИСЭМ СО РАН) и

вычислительное ядро OPTCON-III (А.Ю. Горнов, Т.С. Зароднюк, ИДСТУ СО

РАН), реализующее технологии поиска глобального экстремума.

17

Зарубежные разработки. Обзор зарубежных программных средств

решения ЗОУ можно начать с комплекса PDECON (K. Schittkowski, University

of Bayreuth, Germany), реализующий оригинальные методы последовательного

квадратичного программирования. Комплекс является, пожалуй, самым

мощным в своем классе и допускает исследование динамических моделей, как в

классических постановках ЗОУ, так и в постановках с применением систем

дифференциальных

уравнений

в

частных

производных

и

алгебро-

дифференциальных систем.

Еще одной успешной разработкой является SOCS «Sparse Optimal

Control Software» (J.Betts), разрабатываемый службой Boeing Computer Services

известной авиастроительной корпорации Boeing. В основе данного комплекса

тоже лежат алгоритмы последовательного квадратичного программирования.

Комплекс обладает развитой программной технологией и успешно применяется

к решению прикладных задач из области робототехники и навигации.

Около 15 лет развивается программный комплекс MISER3 (K.L. Teo, C.J.

Goh, Hong Kong Polytechnic University), реализующий в значительной степени

как

методы

теории

оптимального

управления,

так

и

классической

конечномерной оптимизации.

Методы

редукции

к

задаче

математического

программирования

реализованы в пакете DIRCOL (O. von Stryk, Darmstadt University, Germany),

успешно применяющемся для решения прикладных задач из области

навигации, робототехники, биологии и экономики.

Расширенный интерфейс между задачей и известными пакетами

конечномерной оптимизации (MINOS, SNOPT и др.) предоставляет комплекс

MINOPT (C. Schweiger, C. Floudas, Princeton University).

В качестве приложения к знаменитому комплексу MATLAB реализован

модуль RIOTS «Recursive Integration Optimal Trajectory Solver» (Schwartz A.,

Polak E., Chen Y.). К сожалению, никаких результатов серьезного тестирования

18

или применения реализованной в RIOTS технологии к решению практических

задач в научной литературе не приводится.

1.2. Проблемы численного решения ЗОУ

В процессе численного решения ЗОУ с использованием любого

современного программного комплекса исследователь неизбежно сталкивается

с рядом проблем, обусловленных четырьмя основными факторами:

спецификой

модели

и

поставленной

на

ее

основе

ЗОУ,

как

самостоятельной задачи оптимизации;

использованием аппарата дифференциальных уравнений при описании

модели;

наличием дополнительных ограничений;

спецификой «дискретной» архитектуры ЭВМ.

В следующих параграфах приводится краткое описание некоторых часто

встречающихся проблем.

1.2.1. Специфика ЗОУ

Нелинейность. Большинство реальных процессов, а, следовательно, и

соответствующие

им

математические

модели

являются

нелинейными.

Линейные же модели описывают, как правило, некоторые частные случаи и

служат лишь для построения начальных приближений [?Самарский, с. 23].

Необходимость расчета нелинейных моделей, в свою очередь, неизбежно

приводит к значительному ограничению числа математических подходов,

применяемых для конструирования алгоритмов.

Многоэкстремальность. Практически все рассматриваемые методы

оптимизации носят локальный характер и при выполнении ряда условий

гарантируют лишь достижение локального экстремума. Тогда, как правило, при

рассмотрении практических задач имеют место ситуации, схематически

19

представленные на рис. 1.1. Успешное решение задач, обладающих таким

свойством, возможно лишь при удачном выборе начального приближения или

при наличии принципиально новых алгоритмов, учитывающих специфику

таких задач. Методы поиска глобального экстремума в ЗОУ пока находятся в

стадии теоретической разработки. В настоящее время, для преодоления

проблемы

многоэкстремальности,

при

решении

каждой

конкретной

практической задачи применяется технология глобализации, основанная на

идее случайного мультистарта [?Горнов], снискавшей популярность в задачах

математического программирования [?].

Рис. 1.1. Явление многоэкстремальности.

Овражность является одной из самых неприятных особенностей ЗОУ.

Определение овражной функции опирается на свойства ее гессиана:

0 min i ( x) 1 ( x) , i 1, n , где i (x) - собственные числа матрицы Гессе(?),

упорядоченные в точке x по убыванию модулей,

характеризуется числом S

1

min i

.

степень овражности

Овражные функционалы возникают в

ЗОУ, как правило, вследствие применения методов последовательной

безусловной минимизации, в которых достижение требуемой точности

достигается за счет увеличения штрафных коэффициентов. Причем, степень

овражности при приближении к оптимуму растет, что, в свою очередь, влечет

прогрессирующее увеличение погрешностей решения вспомогательных задач

20

и, в конечном итоге, приводит к неверному результату. В целях преодоления

этой

особенности

эффективно

использовать

алгоритмы,

имеющие

сверхлинейную скорость сходимости. К такого рода алгоритмам относятся,

например, алгоритмы класса сопряженных градиентов. Несмотря на это,

проблема разработки специализированных схем оптимизации овражных

функционалов в настоящее время остается открытой.

Плохая обусловленность.

Данная проблема является следствием

вырождения гессиана аппроксимирующей задачи на оптимальном управлении

и выражается в появлении «зоны нечувствительности» большой мощности в

окрестности оптимума. (?)Иными словами, условия оптимальности, на которых

основываются методы численной оптимизации, не обеспечивают желаемой

скорости сходимости в окрестностях решения. Результат, выдаваемый

алгоритмом, при решении задач с такого рода спецификой, сильно зависит от

начального приближения и направления спуска. Для выявления и преодоления

данной требуется применение более точных алгоритмов а, иногда и методов

регуляризации(?).

Нефизичность. Проявление неадекватности модели в

некоторых

областях вариабельного множества. В силу специфики каждой конкретной

решаемой задачи, возникают ситуации, когда, в случае неудачно заданного

начального управления, зачастую на первой же итерации, траектории системы

попадают в области «нефизичности» области фазового пространства, в

которых разрядная сетка ЭВМ уже не в состоянии адекватно представлять

переменные задачи. Если системы попадают в такую область, программные

комплексы вынуждены аварийно завершать свою работу. Если же начальное

управление задано удачно, процесс решения задачи проходит в штатном

режиме. Такая ситуация, в случае задачи с двумя фазовыми переменными,

схематически представлена на рис. 1.2. На нем представлена фазовая плоскость

в момент времени t1 . Стрелками указаны направления, в которых движутся

концы

траекторий

по

ходу

21

итерационного

процесса.

x1s (t1 ), x s2 (t1 ), x s3 (t1 ), x s4 (t1 ), s 1,2,... последовательности концов траекторий в

четырех различных итерационных процессах, отличающихся друг от друга

лишь выбором начального приближения. Звездочкой обозначена точка,

соответствующая оптимальной траектории в момент времени t1 . S1 и S 2 области, при попадании в которые дальнейший ход итерационного процесса

приводит к затягиванию системы в область «нефизичности» и последующему

«АВОСТу». Для недопущения в процессе решения ухода траекторий системы в

область нефизичности применяются варианты методов продолжения по

параметру, более подробно описанные далее в данной работе. В комплексе с

данным методом эффективно применение какого-либо варианта ограничения

вариаций управления (например, сужение допустимого параллелепипеда или

прокси-метод(?)).

S1

xs2(t1)

xs1(t1)

x2(t1)

xs3(t1)

xs4(t1)

S2

x1(t 1)

Рис 1.2. Явление «нефизичности».

1.2.2. Аппарат дифференциальных уравнений

В настоящее время дифференциальные уравнения являются одним из

самых популярных инструментов для создания математических моделей

процессов и явлений, а, следовательно, все проблемы, связанные с данным

22

направлением

в

математике,

автоматически

переходят

и

на

задачи

оптимального управления. Спектр таких проблем очень широк. Ниже

приводятся лишь некоторые из них.

Жесткость. Явление жесткости динамической системы хорошо описано

в теории дифференциальных уравнений [g230, g284]. Данная проблема

примечательна тем, что специалисты в этой области до сих пор не пришли к

единому мнению относительно ее точного определения. Как правило, явление

жесткости связано с большим разбросом собственных чисел якобиана правых

частей системы. Данный критерий можно считать характеристикой степени

жесткости.

Для слабожестких систем (со степенью жесткости 10 3 10 4 )

удается создать вычислительные схемы за счет применения неравномерной

сетки

дискретизации

ЗОУ

и

использования

адаптивных

методов

интегрирования. Для систем с большей жесткостью обычно используются либо

преобразование задачи с целью улучшения ее свойств, либо применение

специальных методов интегрирования, а также разработка алгоритмов

оптимизации, учитывающих специфику этой задачи.

Вырожденность и скользящие режимы. Как правило, вырожденность

задачи

определяется

неявным

присутствием

в

интегральных многообразий и является следствием

динамической

системе

проблем, не решенных

достаточно адекватно при создании модели. Эта проблема может приводить к

неинформативности условий оптимальности, заложенных в конструкции

алгоритмов и, как следствие, к потере их работоспособности. Для задач такого

типа разработано много теоретических подходов и основанных на них

алгоритмов [g82,g83]. Факт диагностики данного явления требует либо

преобразования задачи, либо применения специальных алгоритмов решения

ЗОУ.

Проблемы устойчивости. Нарушение устойчивости траекторий системы

может быть следствием неадекватности модели. В теории устойчивости

существует множество методов ее оценки [g173]. Существует мнение

23

[?Горнов], что в ЗОУ данная проблема может быть устранена путем

применения более точных методов интегрирования. Но существует и гипотеза,

что попадание системы в оптимальное состояние значительно улучшает ее

свойства

[?Дмитриев],

последовательности

однако

в процессе

улучшающих

управлений

поиска

и

решения

элементы

соответствующих

им

траекторий могут являться неустойчивыми.

1.2.3. Наличие дополнительных ограничений

В сложных прикладных задачах оптимальное управление и траектория

должны, помимо всего прочего, обеспечивать выполнение ряда ограничений

различного типа. Такая задача может быть решена многими способами,

например, конструированием вспомогательных функционалов (метод штрафов

[g217], метод модифицированных функций Лагранжа [?]) или модификацией

схем

численного

интегрирования

c

использованием

вспомогательных

управлений (метод нелинейного приведенного градиента [?]). Усложнение

постановки задачи в этом случае приводит к появлению характерных проблем.

Разномасштабность критериев. Функционалы, оценивающие качество

управления, как по основному функционалу, так и по ограничениям, могут

оказывать совершенно различное влияние на задачу. Эта особенность обычно

выражается в том, что все усилия алгоритма направлены на удовлетворение

одного из критериев, а все остальные в процессе итераций меняются

хаотически. В простых случаях

для решения данной проблемы можно

обойтись масштабированием критериев с помощью весовых коэффициентов, в

сложных неизбежна коррекция модели.

Явление «тугих ограничений». Данная проблема является следствием

конфликта некоторых ограничений задачи друг с другом. Такая особенность

может послужить причиной появления других негативных явлений, таких, как,

например, многоэкстремальность. Одним из способов преодоления этой

24

проблемы может быть

использование метода нелинейного приведенного

градиента, специализированного для конкретной задачи.

Сингулярная мера при выходе траекторий на фазовые ограничения.

Для фазовых ограничений характерно, также, возникновение сингулярной меры

при выходе траекторий на ограничения [?Милютин]. В интуитивном

восприятии такая особенность проявляется в наличии свойства инерционности,

присущего исследуемой модели. Оптимальные траектории в такой задаче

должны задолго до момента касания с ограничением начать изгибаться и

плавно выходить на него по касательной. Основным способом борьбы с этой

особенностью остаются длительные расчеты.

1.2.4. Специфика архитектуры ЭВМ

Особенности машинного представления float-чисел. Программы для

ЭВМ представляют собой довольно сложный для строгого математического

анализа объект. Одной из основных причин такой ситуации являются

некоторые особенности float-арифметики, которая с математической точки

зрения не выдерживает никакой критики, подрывая всю

привычную

аксиоматику [g3,g13,g54,g115,g282]. Например:

1. существуют float-числа A, B, такие, что A B B A ;

2. существует float-число X 0 , такое, что 1 X 1 и X X 0 ;

3. существуют вещественные числа, которые вообще не могут быть

представлены во float-арифметике.

Лишним доказательством последнему утверждению служит рис. 1.3,

взятый из Руководства по архитектуре процессоров Intel для разработчика (Intel

Architecture Software Developers Manual, Vol.1: Basic Architecture, p. 7-3),

авторство которого принадлежит инженерам Intel.

25

Рис. 1.3. Иллюстрация Intel.

Шаг интегрирования. Алгоритмы получения численного решения задач

оптимального управления требуют многократного численного интегрирования

систем

дифференциальных

уравнений

(основной

и

сопряженной

(вспомогательной )). Основным параметром схем численного интегрирования

является шаг. При его задании необходимо учитывать зависимость между

шагом интегрирования и невязками, возникающими в процессе работы

численного метода, выявленную на практике. На рис 1.4 схематически

представлена эта зависимость. Невязка понимается в смысле

N 1

x( i ) xi ,

i 0

где x ( i ) - реальное значение функции в i , а xi - значение, найденное

алгоритмом. Увеличение невязки при h h1 объясняется быстрым ростом

ошибок округления, который в свою очередь является следствием чрезмерного

увеличения числа арифметических операций. При использовании шага

26

интегрирования

h h2

увеличение невязки объясняется

ошибками

дискретизации. Оптимальным будет шаг, попадающий в интервал h1 , h2 .

Рис. 1.4. Зависимость точности вычислений от шага интегрирования.

Несмотря

на

сложность

и

разнообразие

негативных

явлений,

возникающих при численном решении ЗОУ в каждом конкретном случае,

путем глубокого анализа рассматриваемого прецедента, можно выявить

природу особенности и найти пути ее преодоления.

1.3.

Задача

оптимального

управления

с

вычислительными

особенностями

1.3.1. Класс ЗОУ с вычислительными особенностями

Под

задачей

оптимального

управления

с

вычислительными

особенностями (ЗОУВО) будем понимать ЗОУ, которая:

1. Имеет решение (множество допустимых не пусто);

2. Имеет хотя бы одно управление, при котором в динамической системе

нарушаются

«условия

роста»

[Филлипов]

гарантирующие

существование решения на всем промежутке времени, либо нарушаются

области

определения

элементарных

входящих в правую часть системы;

27

математических

функций,

При решении такого класса задач с использованием программных

комплексов в улучшающей последовательности xs (t ), u s (t ) D , генерируемой

алгоритмом оптимизации, зачастую появляется элемент, использование

которого в последующих процедурах вычислительного метода приводит к

аварийному завершению работы («АВОСТу»). Это, очевидно, обусловлено

следующими тремя причинами:

генерируемые в процессе работы программного комплекса улучшающие

управления и соответствующие им траектории выводят динамическую

систему на так называемые режимы с обострениями [t3/Курдюмов]

появляются уходящие «в бесконечность» траектории (разрушающиеся

решения);

генерируемые

улучшающие

управления

и

соответствующие

им

траектории на некоторых участках отрезка времени не принадлежат

области определения элементарных функций, входящих в правую часть

системы дифференциальных уравнений;

генерируемые алгоритмом траектории имеют участки со значениями,

выходящими за границы машинного представления чисел с плавающей

точкой.

1.3.2. Подходы к решению ЗОУВО

Общим подходом, позволяющим успешно решать задачи оптимального

управления с вычислительными особенностями можно назвать метод

продолжения по параметру, идея которого принадлежит У.Леверье (1886) и

А.Пункаре (1892). Данный метод эффективно применяется к самому широкому

спектру задач, начиная от решения обыкновенных алгебраических уравнений,

их систем [t4/Лаэй] и задач линейной алгебры [t5,15/Давиденко] и заканчивая

различного сорта задачами оптимизации [t6-t10/Жулин и Ко]

В нашем случае этот метод будет подразумевать ввод в задачу вектора

постановочных параметров, изменяющего постановку задачи и погружающих

28

ее в семейство аппроксимирующих вспомогательных задач. Будем так же

предполагать, что каждый компонент вектора постановочного параметра pi в

зависимости

от

типа

параметризации

может

принимать

значения

из

определенного интервала Pi [ piL , piR ] или полуинтервала Pi ( piL , piR ] . Мы

ограничимся рассмотрением следующих 3 классов параметризаций:

1. Параметризация системы дифференциальных уравнений.

Вариант 1.1 («pf-параметризация»). Вместо исходной динамической

системы рассматривается система

dx

p f (t , x(t ), u (t )), x(t 0 ) x0 , t [t 0 , t1 ] ,

dt

где p { p i } - векторный параметр, p i 0,1, i 1, n , n - размерность фазового

пространства. Очевидно, что при p1 p 2 ... p n 1 система

полностью

идентична исходной. На практике, обычно, рассматривается частный случай

построения вектора параметра, когда p1 p 2 ... p n p .

Здесь и далее значение параметра p , при котором соответствующая ему

задача идентична исходной, будем обозначать p * .

Вариант

1.2

(управление

отрезком

времени,

подкласс

«pf-

параметризации»). Вместо исходной динамической системы рассматривается

система

dx

p f (t , x(t ), u (t )), x(t0 ) x0 , t [0,1] ,

dt

где

p { pi }

векторный

параметр,

pi 0, t1 , i 1, n .

При

p1 p 2 ... p n p * t1 система эквивалентна(?) исходной. Данный тип

параметризации позволяет решать ЗОУВО на «сокращенном» отрезке времени

в случае невозможности ее решения на всем T.

29

Вариант 1.4

(изменение начальных условий

задачи Коши, «x0-

параметризация»). В качестве начальных условий в задаче Коши используются

условия x(t0 ) x 0 p . Здесь pi [0, pi ] , i 1, n . В этом случае, очевидно,

p* 0 .

Вариант 1.5 (управление «сдвигом/расширением» областей определения,

«pD-параметризация»). Данный вид параметризации нацелен на ЗОУВО,

характерной

улучшающей

особенностью

которых

последовательности

является

областей

нарушение

определения

элементами

элементарных

математических функций, входящих в правую часть динамической системы.

Ниже приводится таблица, содержащая описание

способов параметризации

рассматриваемого класса в зависимости от конкретного вида функции правых

частей.

f (t,x,u)

p, p*

f (t,x,u,p)

f (t , x, u, arcsin( g (t , x, u )))

f (t , x, u, arcsin( pg(t , x, u)))

f (t , x, u, arccos(g (t , x, u)))

f (t , x, u, arccos(pg(t , x, u)))

f (t , x, u, tg ( g (t , x, u)))

f (t , x, u, tg ( pg(t , x, u)))

f (t , x, u, g (t , x, u) )

f (t , x, u, p g (t , x, u) )

f (t , x, u, ln( g (t , x, u)))

f (t , x, u, ln( p g (t , x, u)))

f (t , x, u, log 10 ( g (t , x, u )))

f (t , x, u, log 10 ( p g (t , x, u )))

pi (0,1]; i 1, n ;

p* 1 .

pi [0, pi ]; i 1, n ;

p* 0 .

2. Ограничение вариации управления

Вариант 2.1 («uf-параметризация»). Вместо исходной динамической

системы рассматривается система:

dx

f ( x(t ), pu(t ), t ) , x (t 0 ) x 0 , t [t0 , t1 ] .

dt

Здесь pi 0,1, i 1, n , n , а p * 1.

30

Вариант

2.2

параметризация»).

(управление

В

качестве

параллелепипедом

ограничений,

параллелепипедных

«uBox-

ограничений

на

управляющую функцию используется следующая конструкция:

uil pil ui (t ) uig pig ,

pil , pig {(a, b) : a, b [0, uig uil ), a b uig uil }

Здесь uig и u il компоненты векторов u g и ul исходной задачи

соответственно. В этой параметризации p * 0 .

Оба приведенных способа ограничения вариации управления эффективно

применять совместно с методами параметризации динамической системы при

подходе программного комплекса к «АВОСТу».

3. Параметризация целевого функционала

Вариант

3.1

(стабилизация

фазовых

траекторий,

«stab-

параметризация»). Такая параметризация является одним из способов

получения начального управления, предотвращающего резкий рост значений

фазовых переменных на заданном

отрезке времени на начальных этапах

решения ЗОУВО. При применении данного метода параметризации в качестве

целевого функционала берется функционал

t1 n

I p 0 ( x(t1 )) (1 p) ( xi xi 0 ) 2 dt

t0 i 1

Вариант 3.2 (альтернативная форма

«stab-параметризации»). В

качестве целевого функционала берется функционал

t1 n

I p 0 ( x(t1 )) (1 p) f i 2 (t , x, u )dt

t0 i 1

В этих вариантах параметризации целевого функционала p [0,1]

скалярный параметр и p* 1 .

31

Остается заметить, что все три представленные класса параметризации

являются далеко не исчерпывающими, а также могут быть применимы как по

отдельности, так и в комбинациях друг с другом.

Применительно к ЗОУВО далее будем использовать

следующие

обозначения:

Z {u 0 } исходная задача оптимального управления с вычислительной

особенностью с заданным начальным управлением u 0 ;

u * оптимальное управление в исходной задаче, если оно существует;

Zp

аппроксимирующее

параметрическое

семейство

задач

оптимального управления;

Z { p, u 0p }

задача оптимального управления из параметрического

семейства Z p со значением параметра

p p

и некоторым начальным

управлением u 0p ;

Z{ p, u 0p } u*p обозначение факта успешного нахождения программным

комплексом оптимального управления u *p в задаче Z { p, u 0p } ;

Z{()} обозначение факта возникновения нештатной ситуации при

численном решении задачи Z{()} .

Для ЗОУВО сделаем следующие предположения:

1. Z {u 0 } исходная ЗОУВО с исходным начальным управлением

при

численном

решении

вызывает

аварийный

останов

программного

комплекса;

2. Z{ p* , u 0p * } Z{u 0p* } задача

Z{ p, u 0p } Z p при значении параметра

p p* и с некоторым начальным управлением u 0p* эквивалентна исходной с

32

тем же начальным управлением, то есть их численные решения (найденные по

одной и той же схеме оптимальные управления) совпадают;

Приведем общую схему итерационного метода нахождения оптимального

управления в исходной задаче на основе решений серии параметризованных

задач.

1.

Зададим некоторое начальное значение параметра

p p0 p *

и

0

обозначим через Z { p 0 , u p0 } соответствующую ему задачу оптимального

0

управления, где u p0 u 0 начальное управление в исходной задаче.

Значение p 0

0

выбирается таким образом, чтобы задача Z { p 0 , u p0 }

решалась программным комплексом в штатном режиме. Обозначим через

0

u *p0 полученное на выходе оптимальное управление, Z { p0 , u p0 } u*p0 .

2.

Пусть проведено k итераций метода, т. е. получено u *pk (t ) при некотором

p p k . Зададим приращение pk 1 : p * ( pk pk 1 ) p * pk таким

образом, чтобы задача оптимального управления Z { pk p k 1 , u *pk (t )}

решалась программным комплексом в штатном режиме. Обозначим через

u *pk 1 полученное на выходе оптимальное управление.

3.

Положим p k 1 p k p k 1 и продолжим процесс с пункта 2. Процесс

продолжается до тех пор, пока при некотором k * не выполнится условие

p k * p * . Управление u *pk * (t ) u *p* , полученное при решении задачи

Z { p k * 1 p k * , u *p * (t )} , является оптимальным управлением исходной

k 1

задачи.

Основной сложностью этого метода является подбор приращений

параметра. При выборе слишком маленького значения процесс счета сильно

33

замедляется, при выборе слишком большого параметризованная задача сама

переходит в класс задач с вычислительными особенностями.

Справедливо

будет

сказать,

что

данный

итерационный

метод

математически строго не гарантирует нахождение оптимального управления в

исходной задаче. Этот метод, в совокупности со всеми представленными выше

способами параметризации, правильнее рассматривать, как своего рода

«вычислительный эксперимент» над конкретной моделью, позволяющий путем

исследования ряда «близких» моделей делать некоторые выводы об исходной.

Полученные в результате такого исследования данные ( функции управления) и

знания (качественные характеристики модели) позволяют успешно решать

большинство задач рассматриваемого класса.

Серьезным ограничением при использовании данного метода в рамках

программных комплексов для решения ЗОУ является необходимость наличия у

пользователей достаточного уровня математической и программистской

квалификации, а также приобретенных навыков применения такого подхода.

В заключение заметим, что применение метода параметризации вполне

соответствует методологическим принципам математических исследований,

сформулированным Д. Пойа [t26]:

1) «Если вы не в состоянии решить предложенную задачу, то попробуйте

найти близкую к ней более легкую задачу»;

2) «использовать накопленную ранее информацию как оперативную базу

для получения дальнейшей информации».

34