Теория статистики Выборочное наблюдение и статистический вывод Часть 2.

advertisement

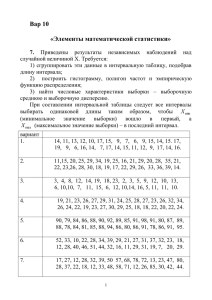

Теория статистики Выборочное наблюдение и статистический вывод Часть 2. 1 Вероятностная выборка • Виды случайной выборки: Простая Систематическая Расслоенная Кластерная Многоэтапная/кластерная 2 Простая случайная выборка • Выборка из генеральной совокупности объема (N), при которой любое подмножество элементов объема (n) может быть отобрано с равной вероятностью, называется простой • План простой случайной выборки: 1 C n , если объем s n p( s ) N 0, в противном случае 3 Алгоритм отбора простой случайной выборки 1) Отобрать первый элемент из совокупности N элементов с вероятностью равной 1/N 2) Отобрать второй элемент из оставшихся элементов с вероятностью равной 1/(N-1) ... n) Отобрать n-ый элемент из оставшихся элементов с вероятностью 1/(N-n+1) 4 Отбор простой случайной выборки с помощью таблицы случайных чисел 1) Нужно отобрать 3 единицы из 10 2) Нужно отобрать 5 единиц из 80 • Фрагмент таблицы случайных чисел: s1 1;7;8 s2 10;19;53;57;69 5 Вероятности отбора элементов • Равные вероятности извлечения любого элемента: n 1 k U CN 1 n Pr( k s ) k n CN N • Для любой пары единиц генеральной совокупности имеем k , l U (k l ) Pr( k , l s ) kl CNn 22 n(n 1) n CN N ( N 1) 6 Формулы оценивания • Оценка суммарного показателя: yk N ˆ Y yk n ks ks k • Оценка дисперсии оценки суммы: 2 n s ˆ ˆ V Y (1 ) N n 1 2 s ( y y ) k n 1 ks 2 7 Пример • Нужно оценить среднее число незанятых пассажирами мест на N = 4500 авиарейсах по данным выборки n = 225, если y 11.6 • s 4.1 Построим 90%-ый доверительный интервал для оценки среднего n s2 225 4.12 y z0.9 (1 ) 11.6 1.64 (1 ) N n 4500 225 11.6 0.44 Y (11.16;12.04) 8 Пример • Оценим общее количество незанятых мест с помощью 90%-го доверительного интервала: Ny z 0 .9 2 n s N 2 (1 ) N n 2 225 4 . 1 4500 11.6 1.64 45002 (1 ) 4500 225 52200 1972 Y [50227;54172] 9 Оценка доли и ее точность • Для доли (Pd) и объема области (Nd) имеем: nd ˆ Pd pd n • N ˆ N d N pd nd n Оценка дисперсии оценок (по выборке): n pd (1 pd ) ˆ V ( pd ) (1 ) N n 1 n pd (1 pd ) 2 ˆ ˆ V ( N d ) N (1 ) N n 1 10 Пример • При доле p = 0.5 и 95%-ой доверительной вероятности можно получить приблизительное соотношение между объемом выборки (n) и предельной ошибкой выборки (L) (пренебрегая поправкой на конечность (1-n/N): n p(1 p ) 1 1 L 1.96 (1 ) n 2 N n 1 L n 11 Пример 12 Определение объема выборки • Предельная ошибка выборки (L): L z1 / 2 • 2 n s (1 ) N n Разрешив относительно (n), получим n0 z12 / 2 s 2 n , где n0 2 n0 L 1 N 13 Пример • Определим необходимый объем выборки, для которого с 90%-ой доверительной вероятностью ошибка оценки истинного среднего значения числа свободных мест на авиарейсах не превышала бы 0,1: 2 2 2 2 Z s 1.64 4.1 n0 2 4521.2176 2 L 0.1 n0 4521.2176 n 2255.3 n 2256 n0 4521.2176 1 1 N 4500 14 Определение объема выборки • В случае оценки доли имеем L z1 / 2 • n p(1 p) (1 ) N n 1 Разрешив относительно (n), получим 1 n0 z12 / 2 p(1 p ) n , где n0 2 n0 L 1 N 15 Расслоенная случайная выборка • • Пусть до проведения обследования для всех единиц имеется базовая информация - значения некоторого признака размера: x x1,..., xk ,..., xN Тогда можем расслоить основу выборки и в каждом слое отобрать простую случайную выборку 16 Оценивание при расслоенном плане выборки • Имеем несмещенные оценки: 1 ˆ Yst N • Yˆst N h yh N h yh h h Оценка дисперсии оценок имеет вид: Nh 2 ˆ ˆ V Yst N h N Nh ˆ ˆ V Yst h N 2 2 nh sh2 1 N h nh nh sh2 1 N h nh 17 Пример: в совокупности 5 элементов • В ранее рассмотренном примере: • Характеристики слоев: N1 3;Y1 15; S12 4 N 2 2;Y2 27.5; S22 12.5 • Пусть объем выборки: n = 2 (из каждого слоя выбираем по одному элементу) 18 Пример: в совокупности 5 элементов • Всего возможно извлечь 6 выборок: 19 Пример: в совокупности 5 элементов • Дисперсия расслоенной оценки среднего: 2 2 N n S V (Yˆ ) h (1 h ) h N nh h N 2 3 2 1 4 2 1 12.5 ( ) 1 1 1,96 5 3 1 5 2 1 • Коэффициент вариации расслоенной оценки: ˆ CV y V (Y ) Y 100% 1,96 100% 7% 20 20 Пример: в совокупности 5 элементов • В случае простой случайной выборки • Дисперсия оценки среднего: n S 2 2 52 V ( y ) (1 ) 1 15,6 N n 5 2 • Коэффициент вариации оценки: CVy V ( y) Y 15,6 100% 100% 19,7% 20 21 Этапы реализации схемы расслоенной случайной выборки 1. Какую переменную взять в качестве расслаивающей? 2. Каким должно быть количество слоев? 3. Как осуществить расслоение по количественной переменной? 4. Каким должен быть общий объем выборки и его размещение по слоям? 22 1. Какую переменную взять в качестве расслаивающей? 2. Сколько слоев? • В расслоении: Сначала качественные переменные для обеспечения представительности выборки Потом количественные переменные для включения в слои близких по размеру единиц • Число слоев по количественной переменной не более 5-6 23 Как осуществить расслоение по количественной переменной? Правило Экмана (1959г.) выбора границ минимизируют дисперсию оценки: Границы слоев выбираются такими, чтобы • N h (ch ch 1 ) const ch , h 1,..., H - границы слоев c0 xmin , cH xmax 24 Пример: в совокупности 5 элементов • В ранее рассмотренном примере: • Имеем • N1 (c1 c0 ) 3(19.8 13) 20.4 N 2 (c2 c1 ) 2(30 19.8) 20.4 Следовательно c0 xmin 13; c1 19.8; c2 xmax 30 25 4. Каким должен быть общий объем выборки и его размещение по слоям? • Общий объем выборки: бюджет обследовагния стоимость одного интервью • Пропорциональное размещение объема выборки по слоям: nh N h nh n h 1...H const n N Nh N 26 4. Каким должен быть общий объем выборки и его размещение по слоям? • Оптимальное размещение объема выборки N h Sh по слоям: h 1...H nh n • H N i Si Если затраты на i 1 обследование можно H представить в виде: C n h ch c0 h 1 то оптимальным размещением N h Sh C с фиксированными n h H ch затратами будет c N S h 1 h h h 27 Кластерная случайная выборка: пример Периодическое издание выписывают 40000 (N) подписчиков • Тестируется востребованность нового приложения (кросс-продажы), для чего: Подписчиков распределили по 4000 (M) кластеров по принципу близости проживания (экономия транспортных расходов интервьюеров) Отобрали случайную выборку объема 80 (m) кластеров и провели опрос • 28 Кластерная случайная выборка: пример • Результаты проведения опроса: кластер 1: 1 положительный отклик кластер 2: 2 положительных отклика ..... кластер 8: 8 положительных откликов кластер 9: 1 положительный отклик Кластер 10: 2 положительных отклика ..... 29 Кластерная случайная выборка: пример • По данным опроса получаем: 80 80 i 1 i 1 Yi 360; Yi 2040 2 Оценка числа согласных на приложение: M ˆ Ycl m m 4000 Yi 360 18000 80 i 1 что составляет 45% от 40000 подписчиков 30 Кластерная случайная выборка: пример Среднее квадратическое отклонение: m m 1 1 ˆ ˆ 2 2 2 2 sYi (Yi Y ) Yi m(Y ) m 1 i 1 m 1 i 1 2 1 360 2040 80 5,32 80 1 80 Оценка дисперсии оценки: m 1 2 2 ˆ ˆ V (Ycl ) M (1 ) sYгр 1042720 (1021) 2 M m 31 Кластерная случайная выборка: пример 95%-ый доверительный интервал: 18000 1.96 2001 18000 2001 или 45% 5.0% Если считать, что случайно отобрали n = 800 подписчиков из N = 40000, то n 1 2 ˆ ˆ ˆ ˆ V ( p ) (1 ) p(1 p ) (0,017420) N n 1 95%-ый доверительный интервал: 45% 3,4% 32 Кластерный эффект • Эффект плана сложной выборки: Vˆ (Yˆcompl ) 0.06517 DEFF 1.87 0.03484 Vˆ (Yˆsrs ) • В случае кластерной/многоэтапной выборки из-за различия кластеров точность оценивания обычно ниже, чем при простой случайной выборке 33