Статистич. изучен. взаимосвязи соц.

реклама

Г. А. Машенцева

МИНОБРНАУКИ РОССИИ

ФЕДЕРАЛЬНОЕ ГОСУДАРСТВЕННОЕ БЮДЖЕТНОЕ ОБРАЗОВАТЕЛЬНОЕ

УЧРЕЖДЕНИЕ ВЫСШЕГО ПРОФЕССИОНАЛЬНОГО ОБРАЗОВАНИЯ

«ВОЛГОГРАДСКИЙ ГОСУДАРСТВЕННЫЙ ТЕХНИЧЕСКИЙ УНИВЕРСИТЕТ»

КАМЫШИНСКИЙ ТЕХНОЛОГИЧЕСКИЙ ИНСТИТУТ (ФИЛИАЛ)

ФЕДЕРАЛЬНОГО ГОСУДАРСТВЕННОГО БЮДЖЕТНОГО ОБРАЗОВАТЕЛЬНОГО

УЧРЕЖДЕНИЯ ВЫСШЕГО ПРОФЕССИОНАЛЬНОГО ОБРАЗОВАНИЯ

«ВОЛГОГРАДСКИЙ ГОСУДАРСТВЕННЫЙ ТЕХНИЧЕСКИЙ УНИВЕРСИТЕТ»

Г. А. Машенцева

СТАТИСТИКА.

СТАТИСТИЧЕСКОЕ ИЗУЧЕНИЕ ВЗАИМОСВЯЗИ

СОЦИАЛЬНО-ЭКОНОМИЧЕСКИХ ЯВЛЕНИЙ

Учебное пособие

Волгоград

2011

1

ББК 60.6я73

М 38

Рецензенты: д. э. н., профессор Т. М. Садыкова; коллектив кафедры «Экономика и право» Камышинского филиала НОУ ВПО

«Волгоградский институт бизнеса»

Машенцева, Г. А. СТАТИСТИКА. СТАТИСТИЧЕСКОЕ ИЗУЧЕНИЕ

ВЗАИМОСВЯЗИ СОЦИАЛЬНО-ЭКОНОМИЧЕСКИХ ЯВЛЕНИЙ: учеб. пособие / Г. А. Машенцева. – Волгоград: ИУНЛ ВолгГТУ, 2011. – 72 с.

ISBN 978-5-9948-0687-6

Рассмотрены вопросы статистического изучения взаимосвязи

социально-экономических явлений. Учебный материал формирует

системное представление о возможностях и особенностях применения богатого статистического инструментария для выявления

закономерностей развития различных социально-экономических

явлений, способствует развитию навыков и компетенций применения статистических методов для решения задач на начальных этапах экономического анализа информации.

Предназначено для студентов начальных курсов высших

учебных заведений экономических факультетов, аспирантов и

преподавателей вузов, а также всех интересующихся вопросами

статистики.

Ил. 7.

Табл. 15.

Библиогр.: 11 назв.

Печатается по решению редакционно-издательского совета

Волгоградского государственного технического университета

Волгоградский

государственный

технический

университет, 2011

ISBN 978-5-9948-0687-6

2

СОДЕРЖАНИЕ

1. Понятие, виды и формы взаимосвязи между явлениями……………………………………………………………

1.1. Взаимосвязи общественных явлений и необходимость их

статистического изучения………………………

1.2. Виды и формы взаимосвязи между явлениями..…

2. Основные приемы и методы изучения взаимосвязей....

2.1. Метод сопоставления параллельных рядов……...

2.2. Графический метод………………...………………

2.3. Метод аналитических группировок……………….

2.4. Дисперсионный анализ……………………………

2.5. Основные понятия и задачи корреляционного анализа……………………………………………………..

3. Корреляционно-регрессионный анализ…………….…

3.1. Парная линейная корреляции……………….……

3.2. Статистическая оценка надежности параметров парной

корреляции…………………………………………

3.3. Множественное уравнение регрессии……….……

3.4. Теснота связи и простейшие методы ее измерения…………………………………………………………...

4. Непараметрические методы изучения связи……….…

4.1. Коэффициент корреляции знаков (коэффициент Фехнера)……………………………………………….……

4.2. Ранговые коэффициенты связи (коэффициенты Спирмена, Кенделла, конкордации)…………….………...

4.2.1. Коэффициент корреляции рангов Спримена…

4.2.2. Коэффициент корреляции рангов Кендалла (τ)...

4.2.3. Множественный коэффициент ранговой корреляции

(коэффициент конкордации) (W)…………………

4.3. Анализ взаимосвязи между двумя дихотомическими переменными

(коэффициенты

ассоциации,

контингенции)…………………………………………..……

4.4. Коэффициенты оценки связи качественных признаков,

представленных несколькими градациями (коэффициенты сопряженности Пирсона и Чупрова)………

5. Выводы и вопросы для самоконтроля…………………

3

5

5

6

12

12

14

19

20

25

28

31

40

42

44

47

47

49

51

53

55

58

59

62

Приложение 1. Значение интеграла вероятностей………

Приложение 2. Значение t-критерия Стьюдента при уровне значимости 0,10, 0,05, 0,01…………..……………

Приложение 3. Значение F-критерия Фишера при уровне значимости 0,05………………………………….…..…

Приложение 4. Критическое значение корреляционного отношения η2 и коэффициента детерминации R2 ……..…

Приложение 5. Критические значения F-критерия………

Приложение 6. Критерии выбора метода вычисления корреляции …………………………………………………

Список использованной и рекомендованной литературы..

4

64

65

66

67

68

69

70

Независимо от того, в какой отрасли

знания получены числовые данные, они обладают определенными свойствами, для выявления которых может потребоваться особого рода научный метод обработки. Последний известен как статистический метод или, короче, статистика.

Дж. Юл., М. Кендалл

Есть три вида лжи: обычная ложь,

наглая ложь и статистика.

Б. Дизраэль

1. Понятие, виды и формы взаимосвязи между явлениями

1.1. Взаимосвязи общественных явлений и необходимость

их статистического изучения

Известно, что все явления и процессы, происходящие в природе и обществе, так или иначе связаны между собой, зависят друг

от друга. Так, результаты деятельности промышленности зависят

от работы других отраслей народного хозяйства: энергетики, сельского хозяйства, транспорта и др. В свою очередь результаты деятельности того же сельского хозяйства в значительной степени зависят от промышленности, снабжающей его машинами, удобрениями, средствами защиты растений и т. д. Взаимосвязь и взаимозависимость проявляются и в работе любого предприятия,

организации или учреждения. Без изучения взаимосвязей, их характера, силы и других особенностей, невозможно управлять явлениями и прогнозировать их развитие. Поэтому одной из важнейших задач анализа статистических данных является задача

установления и объяснения взаимосвязей, их измерения и количественного выражения.

Экономисту в процессе своей деятельности практически постоянно приходится иметь дело с взаимосвязанными показателями. Так, например, он должен изучать динамику зарплаты в связи

с динамикой производительности труда, динамику производительности труда в связи с динамикой себестоимости продукции, а динамику себестоимости в зависимости от объема продукции и т. д.

Причем, основная задача экономиста – не в том, чтобы просто

проиллюстрировать различные сферы деятельности предприятия

(организации) при помощи цифр. Он должен посредством анализа

5

цифровых показателей выявить «узкие места» в работе предприятия, вскрыть причины и условия, оказывающие влияние на результаты работы.

Экономический анализ зависимости процессов и явлений позволит наметить необходимые меры для улучшения тех или иных

сторон деятельности предприятия. Только в этом случае работа

экономиста не будет выглядеть простой констатацией имеющихся

фактов.

Изучение явлений в их взаимосвязи означает, прежде всего,

изучение причинно-следственной зависимости между ними. Потому что одно явление всегда представляет собой причину, а другое – следствие, т. е. результат действия этой причины. Соответственно и признаки, характеризующие явление причины, называются факторными (независимыми) признаками, а признаки, характеризующие явление следствия – результатными (зависимыми).

Между причиной и следствием часто существует взаимодействие, то есть следствие может, в свою очередь, оказывать влияние

на причину.

НАПРИМЕР, производство – необходимая предпосылка для потребления, а

потребление – следствие производства. Потребление же, в свою очередь, оказывает определенное влияние на производство, определяя его объем, ассортимент

и качество продукции.

1.2. Виды и формы взаимосвязи между явлениями

Различают два типа связей между различными явлениями и их

признаками: функциональную или жестко детерминированную, с

одной стороны, и статистическую или стохастически детерминированную – с другой. Строго определить различие этих типов связи можно тогда, когда они получают математическую формулировку. Для простоты будем говорить о связи двух явлений или

двух признаков, математически отображаемой в форме уравнения

связи двух переменных.

Итак, по характеру зависимости между факторными и результатными признаками связи подразделяются на:

функциональные или строго детерминированные (от латинского determinatio – ограничение, определение), т. е. строгие,

полные;

стохастические, т. е. вероятностные, нестрогие.

6

Функциональные – это связи, при которых каждому значению факторного признака (аргумента) соответствует одно или

несколько строго определенных значений результатного признака

(функции). При функциональной связи изменение значения результатного признака полностью зависит от изменения значения

факторного признака.

Такие связи наблюдаются преимущественно в точных науках:

математике, физике, химии, астрономии, они свойственны, в основном, физическим и химическим явлениям.

НАПРИМЕР, площадь круга (S = πR2) и длина окружности (L = 2πR) полностью зависят от изменения радиуса, скорость падения – от высоты и т. д. Или,

если y x, то значению х = 9 соответствуют два строго определенных значения: y1 = 3; y2 = -3.

Стохастически детерминированная связь не имеет ограничений и условий, присущих функциональной связи. Если с изменением значения одной из переменных вторая может в определенных

пределах принимать любые значения с некоторыми вероятностями, но ее среднее значение или иные статистические (массовые)

характеристики изменяются по определенному закону – связь является статистической. Иными словами, при статистической связи разным значениям одной переменной соответствуют разные

распределения значений другой переменной.

В настоящее время наука не знает более широкого определения связи. Все

связи, которые могут быть измерены и выражены численно, подходят под определение «статистические связи», в том силе и функциональные.

Частным случаем стохастических связей являются корреляционные (статистические). Это связи, при которых каждому значению факторного признака (x) соответствует среднее значение

результативного признака (y). Т. е. корреляционная связь проявляется в виде тенденции (общего направления) изменений средних

значений результативного признака в зависимости от изменений

факторного признака.

Статистическая связь между двумя признаками (переменными величинами) предполагает, что каждый из них имеет случайную вариацию индивидуальных значений относительно средней величины. Если же такую вариацию имеет лишь один из признаков,

а значения другого являются жестко детерминированными, то говорят лишь о регрессии, но не о статистической (тем более корреляционной) связи. Например, при анализе

динамических рядов можно измерять регрессию уровней ряда урожайности (имеющих

случайную колеблемость) на номера лет. Но нельзя говорить о корреляции между ними

и применять показатели корреляции с соответствующей им интерпретацией.

7

Именно такого рода связи преобладают в социально-экономических явлениях и процессах. В них, как правило, нет строгой зависимости между причиной и результатом. Это связано с тем, что

социально-экономические явления представляют собой результат

одновременного воздействия множества причин и условий. Поэтому при изучении этих явлений необходимо выявлять основные

из этих причин, абстрагируясь от малозначимых, второстепенных.

НАПРИМЕР, количество деталей, выработанных рабочим на станке, зависит от многих причин: квалификации рабочего, наладки станка и его степени износа, дисциплинированности и самочувствия рабочего, организации труда и т. д.

Само слово «корреляция» ввел в статистику английский биолог и статистик Фрэнсис Гальтон в конце XIX века. В переводе с

английского оно означает «соответствие, соотношение». Причем

под этим понималась не просто связь – (relation), а как бы связь

(orrelation), т. е. связь, но не в привычной функциональной форме.

Фрэнсис Гальтон, Карл Пирсон и Дж. Юл считаются основоположниками теории корреляции.

В науке вообще, а именно в палеонтологии, термин «корреляция» применил

еще раньше, в конце XVI1I в., знаменитый французский палеонтолог (специалист

по ископаемым останкам животных и растений прошлых эпох) Жорж Кювье. Он

ввел даже «закон корреляции» частей и органов животных. «Закон корреляции»

помогает восстановить по найденным в раскопках черепу, костям и т. д. облик

всего животного и его место в системе: если череп с рогами, то это было травоядное животное, а его конечности имели копыта; если же лапа с когтями – то хищное животное без рогов, но с крупными клыками.

Известен следующий рассказ о Кювье и «законе корреляции». В дни университетского праздника студенты решили подшутить над профессором Кювье.

Они вырядили одного из студентов в козлиную шкуру с рогами и копытами и

подсадили его в окно спальни Кювье. Ряженый загремел копытами и завопил: «Я

тебя съем!». Кювье проснулся, увидел силуэт с рогами и спокойно отвечал: «Если

у тебя рога и копыта, то по закону корреляции ты травоядное и съесть меня не

можешь. А за то, что не знаешь закона корреляции, получишь двойку!».

В связи с тем, что функциональные связи в социальноэкономических явлениях встречаются редко, а преобладают, как

подчеркивалось выше, корреляционные, то именно их изучением и

занимается статистика.

Корреляционная связь между признаками может возникать

разными путями:

1. Важнейший путь – причинная зависимость результативного признака (его вариации) от вариации факторного призна8

ка. Например, признак х – балл оценки плодородия почв, признак

у – урожайность сельскохозяйственной культуры.

2. Совершенно иная интерпретация необходима при изучении

корреляционной связи между двумя следствиями общей причины. Известен классический пример, приведенный крупнейшим

статистиком России начала XX в. А. А. Чупровым: если в качестве

признака х взять число пожарных команд в городе, а за признак у –

сумму убытков за год в городе от пожаров, то между признаками х

и у в совокупности городов России – существенная прямая корреляция; в среднем, чем больше пожарников в городе, тем больше и

убытков от пожаров! Уж не занимались ли пожарники поджигательством из боязни потерять работу? Но дело в другом. Данную

корреляцию нельзя интерпретировать как связь причины и следствия; оба признака – следствия общей причины: размера города.

Вполне логично, что в крупных городах больше пожарных частей, но

больше и пожаров и убытков от них за год, чём в мелких городах.

3. Третий путь возникновения корреляции – взаимосвязь

признаков, каждый из которых и причина, и следствие.

Например, корреляция между уровнем производительности труда

рабочих и оплатой труда. С одной стороны, уровень зарплаты –

следствие производительности труда. Но с другой стороны, уровень

оплаты труда (установленные тарифные ставки и расценки) играет

стимулирующую роль. В такой системе признаков допустимы обе

постановки задачи; каждый признак может выступать и в роли независимой переменной х, и в качестве зависимой переменой у.

Корреляционные связи являются нестрогими, неполными,

вероятностными и проявляются только в средних величинах при

наличии следующих условий:

1. Если имеются данные по достаточно большой совокупности явлений.

По отдельным явлениям можно получить совершенно превратное представление о связи признаков, ибо в каждом отдельном явлении значения признаков, кроме закономерной составляющей, имеют случайное отклонение (вариацию). Например, сравнивая два хозяйства, одно из которых имеет лучшее качество почв, по уровню урожайности, можно обнаружить, что урожайность

выше в хозяйстве с худшими почвами. Ведь урожайность зависит от сотен

факторов и при том же самом качестве почв может быть и выше, и ниже. Но

если сравнивать большое число хозяйств с лучшими почвами и большое число – с

худшими, то средняя урожайность в первой группе окажется выше и станет

возможным измерить достаточно точно параметры корреляционной связи.

9

Какое именно число явлений достаточно для анализа корреляционной и вообще статистической связи, зависит от цели анализа,

требуемой точности и надежности параметров связи, от числа факторов, корреляция с которыми изучается. Обычно считают, что

число наблюдений должно быть не менее чем в 5–6, а лучше не

менее чем в 10 раз больше числа факторов. Еще лучше, если число

наблюдений в несколько десятков или в сотни раз больше числа

факторов, тогда закон больших чисел, действуя в полную силу,

обеспечивает эффективное взаимопогашение случайных отклонений от закономерного характера связи признаков.

2. Если закономерность, проявляющаяся в данном явлении,

надежно выражена в средней величине.

Кроме уже указанного большого числа единиц совокупности, для этого

необходима достаточная качественная однородность совокупности. Нарушение

этого условия может извратить параметры корреляции. Например, в массе

зерновых хозяйств уровень продукции с гектара растет по мере концентрации

площадей, т. е. он выше в крупных хозяйствах. В массе овощных и овощемолочных хозяйств (пригородный тип) наблюдается та же прямая связь уровня продукции с размером хозяйства. Но если соединить в общую неоднородную совокупность те и другие хозяйства, то связь уровня продукции с размером площади

пашни (или посевной площади) получится обратной. Причина в том, что овощные и овощемолочные хозяйства, имея меньшую площадь, чем зерновые, производят больше продукции с гектара ввиду большей интенсивности производства в

данных отраслях, чем в производстве зерна.

3. Если распределение совокупности по результативному и

факторным признакам подчиняется нормальному закону распределения вероятностей.

Это условие связано с применением метода наименьших квадратов (МНК)

при расчетах параметров корреляции: только при нормальном распределении

МНК дает оценку параметров, отвечающую принципам максимального правдоподобия.

На практике эта предпосылка чаще всего выполняется приближенно, но и

тогда метод наименьших квадратов дает неплохие результаты. Однако при значительном отклонении распределений признаков от нормального закона нельзя

оценивать надежность выборочного коэффициента корреляции, используя параметры нормального распределения вероятностей или распределения Стьюдента.

Корреляционные связи по направлению бывают прямыми и

обратными. Прямой называется связь, при которой с увеличением факторного признака увеличивается и результативный. Пример

прямой связи: при уменьшении расхода электроэнергии на едини10

цу продукции снижается себестоимость продукции. Обратной

называется связь, при которой с увеличением факторного признака

результативный уменьшается. Пример обратной связи: при снижении себестоимости продукции прибыль на предприятиях увеличивается. Такие связи также можно назвать соответственно положительными и отрицательными.

По аналитическому выражению корреляционные связи подразделяются на прямолинейные (линейные) и нелинейные (криволинейные). Линейной называется связь, которую можно приближенно выразить уравнением прямой линии. Нелинейной является

связь, которая может быть выражена уравнением какой-либо кривой линии (параболы, гиперболы, показательной, степенной функции и др.).

Существует еще одна достаточно важная характеристика связей с точки зрения взаимодействующих факторов. Если характеризуется связь двух признаков, то ее принято называть парной. Если

изучаются более чем две переменные – множественной.

Корреляционные связи могут быть также различной степени

тесноты. Если значению факторного признака (x) соответствуют

близкие друг другу (тесно расположенные около своей средней)

значения результативного признака (y) – связь является тесной.

Если же значения результативного признака при одном и том же

значении факторного варьируют (изменяются) значительно – связь

менее тесная. Количественные критерии оценки тесноты связи

представлены в табл. 1.

Таблица 1

Количественные критерии оценки тесноты связи

Величина коэффициента корреляции

До ±3

±0,5 - ±0,7

±3 - ±0,5

±0,7 - ±1,0

Сила связи

Практически отсутствует

Умеренная

Слабая

Сильная

Указанные выше классификационные признаки наиболее часто встречаются в статистическом анализе. Но кроме перечисленных относительно типа соединений явлений, различают также

непосредственные, косвенные и ложные связи.

1. Непосредственная регрессия. В этом случае явления соединены непосредственно между собой (прибыль и затраты).

11

2. Косвенная регрессия. Имеет место, если факторная и результативная переменная не состоят непосредственно в причинно-следственных отношениях и факторная переменная через какую-то другую переменную действует на результативную переменную (число

пожаров и урожайность зерновых (метеорологические условия)).

3. Ложная или абсурдная регрессия. Возникает при формальном подходе к исследуемым явлениям. В результате можно прийти к ложным и даже бессмысленным зависимостям (число импортируемых фруктов и рост дорожно-транспортных происшествий со

смертельным исходом).

Для исследования функциональных связей применяются балансовый и индексный методы. Для изучения стохастических связей используют методы:

сопоставления параллельных рядов;

графический;

аналитических группировок;

корреляционно-регрессионного анализа (КРА).

Рассмотрим суть каждого из них.

2. Основные приемы и методы изучения взаимосвязей

2.1. Метод сопоставления параллельных рядов

Простейшим приемом обнаружения связей является сопоставление двух параллельных рядов. Сущность метода состоит в том,

что сначала показатели, характеризующие факторный признак,

ранжируются, а затем параллельно им располагаются соответствующие показатели результативного признака. Сравнение построенных таким образом рядов дает возможность не только подтвердить само наличие связи, но и выявить ее направление.

Пример:

Х

У1

У2

1

3

20

2

6

17

3

4

10

4

10

4

5

17

6

6

20

3

где Х – разряд рабочего; У1 – выработка, У2 – количество времени, затрачиваемого на производство 1-й детали.

Сопоставляя показатели, видим, что с увеличением факторного признака (Х), значения результативного признака (У1) также

12

возрастают. Следовательно, имеет место прямая связь между двумя этими показателями.

Когда сравниваемые ряды состоят из большого числа единиц,

направление связи для разных единиц может оказаться различным.

В этом случае целесообразнее воспользоваться корреляционными

таблицами или решетками.

Корреляционная решетка представляет собой комбинационную таблицу, в подлежащем которой располагаются значения одного признака, как правило, факторного, а в сказуемом – другого,

результативного. В клетках, образовавшихся на пересечении строк

и граф, указываются частоты, т. е. число случаев, в которых одни

значения сочетаются с другими.

Пример. Имеются данные о количестве внесенных удобрений

(в пересчете на действующие вещества) и урожайности зерновых

культур по 240 фермерским хозяйствам области. Чтобы изучить

связь между количеством внесенных удобрений (х) и урожайностью зерновых (у), составим корреляционную таблицу. Цифры,

стоящие на пересечении строк и граф, показывают связь количества фермерских хозяйств с данным количеством внесенных удобрений и урожайностью.

Таблица 2

Зависимость урожайности фермерских хозяйств области

от количества внесенных удобрений

Внесено удобрений

(х), кг/га

До 50

50–75

75–100

100–125

125–150

150 и выше

Всего

16

5

7

6

18

18

6

12

18

21

5

18

36

19

78

Урожайность (y), ц/га

25

26

30

12

18

30

6

66

10

14

12

36

8

10

6

24

всего

16

37

82

71

28

6

240

y

18,3

21,4

21,7

24,7

27,2

30,0

22,7

По корреляционной таблице можно сделать некоторые выводы о форме и направлении связи, о степени тесноты связи. Если

значения х и у расположены в возрастающем порядке, то сосредоточение частот около диагонали таблицы, идущей с левого верхнего угла в правый нижний, свидетельствует о прямой связи между

13

изучаемыми признаками, а с правого верхнего угла в левый нижний – об обратной связи, причем связь будет тем теснее, чем плотнее концентрируются частоты у диагонали. Если частоты расположены по всей таблице равномерно, то это говорит о слабой связи между признаками или об отсутствии ее.

Данные корреляционной таблицы можно также изобразить

графически. Для этого результаты группировки единиц совокупности по факторному признаку и средние значения результативного признака по каждой группе наносятся на график в виде

точек, которые затем соединяются, в результате чего получают

ломаную линию, как это показано на рис. 1 (средние значения результативного признака у даны в последней графе). Полученная

ломаная линия называется эмпирической линией регрессии.

Рис. 1. Зависимость урожайности фермерских хозяйств от количества внесенных

удобрений

2.2. Графический метод

Графический метод позволяет выявить наличие связи двух

признаков при помощи построения и анализа поля корреляции.

Для этого в системе координат на оси абсцисс откладываются

значения факторного признака, а на оси ординат – результативного. Получим некоторое рассеивание множества точек – так называемое корреляционное поле.

По расположению точек в корреляционном поле можно сделать вывод о наличии связи, ее направлении и тесноте.

14

Рис. 2. Пример прямой связи

Рис. 3 Пример обратной связи

Если точки расположены снизу, направо, вверх – связь прямая

(рис. 2). Если же сверху от оси ординат, направо, вниз – связь обратная (рис. 3).

При отсутствии тесных связей наблюдается беспорядочное

рассеивание точек на графике. Чем сильнее связь между признаками, тем теснее будут располагаться точки корреляционного поля

вокруг определенной линии, выражающей форму связи (рис. 2).

Однако возможности графического метода ограничены выявлением зависимости лишь между двумя признаками.

Когда исследуется корреляция между количественными признаками, значения которых можно точно измерить в единицах

метрических шкал (метры, секунды, килограммы и т. д.), то очень

часто принимается модель двумерной нормально распределенной

генеральной совокупности. Такая модель отображает зависимость

между переменными величинами xi и yi графически в виде геометрического места точек в системе прямоугольных координат. Эту

графическую зависимость называют также диаграммой рассеивания или корреляционным полем.

Данная модель двумерного нормального распределения (корреляционное поле) позволяет дать наглядную графическую интерпретацию коэффициента корреляции, т. к. распределение в совокупности зависит от пяти параметров: mx, my – средние значения

(математические ожидания); sx, sy – стандартные отклонения случайных величин Х и Y; р – коэффициент корреляции, который является мерой связи между случайными величинами Х и Y.

Если р = 0, то значения, xi, yi, полученные из двумерной нормальной совокупности, располагаются на графике в координатах х, у

15

в пределах области, ограниченной окружностью (рис. 4, а). В этом

случае между случайными величинами Х и Y отсутствует корреляция и они называются некоррелированными. Для двумерного нормального распределения некоррелированность означает одновременно и независимость случайных величин Х и Y.

Рис. 4. Графическая интерпретация взаимосвязи между показателями

16

Если р = 1 или р = -1, то между случайными величинами Х и Y

существует линейная функциональная зависимость (Y = c + dX). В

этом случае говорят о полной корреляции. При р = 1 значения xi, yi

определяют точки, лежащие на прямой линии, имеющей положительный наклон (с увеличением xi значения yi также увеличиваются), при р = -1 прямая имеет отрицательный наклон (рис. 4, б).

В промежуточных случаях (-1 < p < 1) точки, соответствующие значениям xi, yi, попадают в область, ограниченную некоторым эллипсом (рис. 4, в, г), причем при p > 0 имеет место положительная корреляция (с увеличением xi значения yi имеют тенденцию к возрастанию), при p < 0 корреляция отрицательная. Чем

ближе р к ±1, тем уже эллипс и тем теснее экспериментальные

значения группируются около прямой линии.

Здесь же следует обратить внимание на то, что линия, вдоль

которой группируются точки, может быть не только прямой, а

иметь любую другую форму: парабола, гипербола и т. д. В этих

случаях мы рассматривали бы так называемую нелинейную (или

криволинейную) корреляцию (рис. 4, д).

Таким образом, визуальный анализ корреляционного поля помогает выявить не только наличие статистической зависимости

(линейную или нелинейную) между исследуемыми признаками, но

и ее тесноту и форму. Это имеет существенное значение для следующего шага в анализе выбора и вычисления соответствующего

коэффициента корреляции.

Корреляционную зависимость между признаками можно описывать разными способами. В частности, любая форма связи может быть выражена уравнением общего вида Y = f(X), где признак

Y – зависимая переменная или функция от независимой переменной X, называемой аргументом. Соответствие между аргументом и

функцией может быть задано таблицей, формулой, графиком и т. д.

Пример. Определить форму и направление взаимосвязи между

показателями пульса покоя и абсолютными значениями пробы

PWC170 у 13 исследуемых с помощью построения графика корреляционного поля, если данные выборок таковы:

xi, уд/мин. ~ 80; 72; 71; 80; 84; 82; 78; 70; 83; 72; 72; 73; 81;

yi, кГм/мин. ~ 858; 979; 1071; 920; 982; 1000; 1004; 1022; 807;

099; 817; 879; 982.

17

Решение

1. Построим график данного корреляционного поля, отложив

на оси Х в порядке возрастания показатели пульса покоя, на оси Y

– абсолютные значения пробы PWC170.

2. Сделаем вывод о форме и направлении взаимосвязи между

исследуемыми показателями.

Вывод: график данного корреляционного поля позволяет

предположить, что, возможно, между показателями пульса покоя и

абсолютными значениями пробы PWC170 у исследуемой группы

наблюдается не прямая, а обратная зависимость, т. е. со снижением показателя пульса покоя происходит увеличение абсолютных

значений PWC170.

Задачи для самостоятельного решения:

Задача 1. Определить форму и направление взаимосвязи между результатами в беге на первой и второй половине дистанции

400 м у 13 исследуемых с помощью построения графика корреляционного поля, если данные выборок таковы:

xi, с ~ 25,2; 26,4; 26,0; 25,8; 24,9; 25,7; 25,7; 25,7; 26,1; 25,8;

25,9; 26,2; 25,6 (первые 200 м);

yi, с ~ 30,8; 29,4; 30,2; 30,5; 31,4; 30,3; 30,4; 30,5; 29,9; 30,4;

30,3; 30,5; 30,6 (последние 200 м).

18

Задача 2. Определить форму и направление взаимосвязи между результатами в толчке штанги и прыжка в высоту с места у 12

тяжелоатлетов весовой категории до 60 кг с помощью построения

графика корреляционного поля, если данные выборок таковы:

результат в толчке: xi, кг ~ 107,5; 110; 110; 115; 115; 107,5;

107,5; 120; 122,5; 112,5; 120; 110;

прыжок в высоту с места: yi, см ~ 57; 60; 58; 61; 63; 58; 55; 64;

65; 64; 66; 61.

Задача 3. Определить форму и направление взаимосвязи между результатами кистевой динамометрии правой и левой рук у 7

школьников с помощью построения графика корреляционного поля, если данные выборок таковы:

правая рука: xi, кГ ~ 14,0; 14,2; 14,9; 15,4; 16,0; 17,2; 18,1;

левая рука: yi, кГ ~ 12,1; 13,8; 14,2; 13,0; 14,6; 15,9; 17,4.

2.3. Метод аналитических группировок

Метод аналитических группировок схематично можно представить следующим образом.

1. Вначале все единицы совокупности разбивают на определенные группы по возрастанию факторного признака, т. е. признака, положенного в основу группировки.

2. Затем по каждой группе рассчитывается средняя величина

результативного признака.

3. Если с увеличением факторного признака, при переходе от

группы к группе, происходит возрастание или убывание результативного признака, значит можно сделать вывод о наличии связи и

ее направлении.

Пояснить изложенное можно на примере изучения связей

между стажем работы и часовой зарплатой в коллективе рабочих

одной профессии из 10 человек.

Таблица 3

Распределение рабочих по стажу и зарплате

№ рабочего

Стаж, лет

Зарплата, тыс. руб.

1

2,0

10

2

3,5

10

3

4,0

12

4

5,2

11

5

5,8

13

6

6,1

12

7

7,0

14

8

7,5

13

9

7,8

14

Определим размер группового интервала и число групп:

10 2 8

h

2, произведем группировку (табл. 4).

h

4

19

10

10,0

14

Таблица 4

Аналитическая группировка рабочих по стажу и зарплате

Группы рабочих по стажу

2–4

4–6

6–8

8–10

Итого

Кол-во

рабочих

2

3

4

1

10

Средняя зарплата, тыс. руб.

10

12

13

14

12

Результаты группировки свидетельствуют, что между производственным стажем рабочих и их зарплатой имеется прямая связь.

Сгруппировав рабочих по стажу работы и рассчитав среднюю

часовую зарплату по каждой из групп, можно сделать вывод о

наличии связи между стажем и часовой зарплатой. Мы видим, что

с увеличением стажа соответственно увеличивается и средняя часовая зарплата от группы к группе.

После установления наличия связи закономерно возникает вопрос: насколько существенна эта связь, насколько она тесная? (Вышеперечисленные методы дают возможность определить направление и характер влияния отдельных факторов на общий результат, но

не позволяют количественно измерить эту зависимость, рассчитать

степень тесноты связи между взаимосвязанными явлениями). Ответ

на этот вопрос можно получить при помощи методов корреляционного и дисперсионного анализа, поэтому они занимают в настоящее

время ведущее место среди названных выше методов.

2.4.

Дисперсионный анализ

Дисперсионной анализ дает, прежде всего, возможность определить роль систематической и случайной вариации в общей вариации и, следовательно, установить роль изучаемого фактора в изменении результативного признака. Для этого пользуются правилом

сложения дисперсий, согласно которому общая дисперсия равна

сумме двух дисперсии: средней из внутригрупповых и межгруппо2

2

2

вой .

.

Для характеристики тесноты корреляционной связи между признаками в аналитических группировках межгрупповую дисперсию

20

сопоставляют с общей. Это отношение называется корреляционным и обозначается 2

2

.

2

Оно характеризует долю вариации результативного признака,

вызванного воздействием факторного признака, положенного в основание группировки. Корреляционное отношение по своему

абсолютному значению колеблется в пределах от 0 до 1. Чем

ближе корреляционное отношение к 1, тем большее влияние

оказывает факторный признак на результативный.

Если же факторный признак не влияет на результативный,

то вариация, обусловленная им, будет равна нулю (2 = 0) и корреляционное отношение также равно нулю (2 = 0), что свидетельствует о полном отсутствии связи.

И наоборот, если результативный признак изменяется только

под воздействием одного факторного признака, то вариация, обусловленная этим признаком, будет равна общей вариации (2 = 2)

и корреляционное отношение будет равно единице (2 = 1), что говорит о наличии полной связи.

Пример. Определить при помощи корреляционного отношения

тесноту связи между числом обслуживаемых станков и средней

выработкой одной ткачихи (табл. 5).

Таблица 5

Дневная выработка ткачих (м)

Фамилия,

инициалы

ткачихи

Дневная выработка ткачихи

На 32

станках

Егоорова Н. С.

40

Жихарева Ю. А.

48

Петрова А. А.

43

Кротова Д. Н.

45

Сергеева З. Ю.

44

Итого

220

Средняя

44

выработка

Отклонение индивидуальных значений признака от

общей средней

(x ~

x)

i

На 48

станках

62

66

60

68

64

320

64

На 32

станках

-14

-6

-11

-9

-10

-

21

На 48

станках

+8

+12

+6

+14

+10

-

Квадраты отклонений индивидуальных

значений признака

от общей средней

2

( xi ~

x)

На 32

На 48

станках

станках

196

64

36

144

121

36

81

196

100

100

534

540

-

Общая средняя выработка ткачих равна:

220 320

X

54 м. Вычислим общую дисперсию, характе10

ризующую общую вариацию под влиянием всех факторов:

x

n

x

2

534 540

107,4 м.

n

10

Межгрупповая дисперсия, характеризующая факторную вариацию, т. е. различия в выработке, обусловленные неодинаковым

числом обслуживаемых станков, определяется по формуле:

n

x i x 2 44 542 64 542

2

i 1

100 м.

n

2

Рассчитаем корреляционное отношение:

2 100

2 2

0,931 или 93,1 %.

107,4

Следовательно, 93,1 % всей вариации объясняется тем, что

часть ткачих работала на 32 станках, а часть – на 48 и только 6,9 %

вариаций является результатом действия прочих случайных факторов, не положенных в основание группировки.

Дисперсионный анализ позволяет не только определить

роль случайной и систематической вариации, но и оценить достоверность вариации, обнаруженной методом аналитических

группировок. Определение достоверности вариации дает возможность с заданной степенью вероятности установить, чем вызвана

межгрупповая вариация: признаком, положенным в основание

группировки, или является результатом действия случайных причин. Для оценки существенности корреляционного отношения пользуются критическими значениями корреляционного отношения η2

при разных уровнях вероятности или значимости а. Уровень значимости – это достаточно малое значение вероятности, отвечающее событиям, которые в данных условиях исследования

будут считаться практически невозможными. Появление такого

события является указанием на неправильность начального предположения. Чаще всего пользуются уровнями а = 0,05 или а = 0,01.

Критические значения корреляционного отношения содержатся в

специальных таблицах (см. приложение 4).

22

2

i 1

i

В этих таблицах распределение η2 при случайных выборках

зависит от числа степеней свободы факторной и случайной дисперсии. Число степеней свободы факторной дисперсии R1 = т - 1,

где т – число групп, а для случайной дисперсии R2 = п – т, где n –

число вариант, m – число групп.

В нашем примере 10 ткачих сгруппированы в две группы по

числу обслуживаемых станков. Поэтому R1 = 2 – 1 = 1, a R2 = 10 – 2

= 8. По таблице приложения 4 находим критическое значение η2,

соответствующее R1 = 1 и R2 = 8 для уровней значимости а = 0,05,

которое равно: η2(0,05) = 0,399. Это значит, что только в пяти случаях из 100 может случайно возникнуть корреляционное отношение,

превышающее 0,399, а в 95 случаях из 100 корреляционное отношение не может быть больше 0,399.

Теперь фактическое значение корреляционного отношения

надо сравнить с критическим, табличным. Если оно окажется

больше критического, то связь между результативным и факторным признаками считается существенной, если же фактическое

значение корреляционного η2 меньше табличного, то связь между

указанными признаками считается несущественной.

В рассматриваемом нами примере фактическое значение корреляционного отношения η2 = 0,93 больше табличного η2(0,05)=

0,399. Поэтому связь между числом обслуживаемых станков и выработкой является существенной.

При проверке существенной связи чаще пользуются критерием Фишера, потому что при больших числах степеней свободы его

табличные значения мало изменяются, в отличие от корреляционного отношения, которое требует более громоздких таблиц. Критерий Фишера представляет собой отношение межгрупповой дисперсии к средней из среднегрупповых дисперсий, исчисленных с

учетом числа степеней свободы:

2 nm

F

.

m 1

Для этих отношений Фишер (отсюда название «критерий Фишера») составил таблицы, по которым можно определить, какая

величина F при данном числе степеней свободы по факторной вариации (R1) и остаточной вариации (R2) дает основание утверждать

2

23

с определенной вероятностью (например 0,95 × 0,399), что положенный в основание группировки признак является несущественным (см. приложение 5).

2

F

2

2

= 107,4, = 100. По правилу сложения дисперсий

2

2

107,4 100 7,4 . Исчислим F:

В нашем примере

2 n m 100 10 2

108,1.

2 m 1 7,4 2 1

При уровне значимости а = 0,05, R1 = 1 и R2 = 8 критическое

табличное значение F = 5,32. Значит, уже при значении F = 5,32

можно с вероятностью 0,95 утверждать, что группировочный признак (число обслуживаемых станков) является весьма существенным. В нашем примере F = 108,1. Тем более есть основания считать, что полученные в результате группировки данные являются

вполне достоверными.

Зная корреляционное отношение, можно определить критерий Фишера по

2

nm

.

следующей формуле: F

1 2 m 1

В нашем примере F

2

1

2

nm

m 1

0,931

1 0,931

10 2

2 1

106,3.

Мы рассмотрели схему дисперсионного анализа при группировке по одному

факторному признаку. Аналогично проводится анализ при комбинационной

группировке по двум и более факторам. В этих случаях необходима оценка достоверности влияния не только каждого положенного в основание группировки

фактора в отдельности, но и результата их взаимодействия. Последний определяется как разность между эффектом совместного влияния двух группировочных признаков и суммой эффектов влияния каждого из этих факторных признаков, взятых в отдельности. Это осложняет расчеты суммы квадратов отклонений

и числа свободы вариации. Но сам принцип дисперсионного анализа, заключающийся в сопоставлении факторной дисперсии со случайной для оценки достоверности результатов статистической группировки, неизменен при любом числе признаков группировки.

Как показатель тесноты связи корреляционное отношение

имеет более универсальный характер, чем линейный коэффициент

корреляции, поскольку его использование не ограничивается случаями линейной связи, а факторный признак может быть не количественным, а ранговым и даже номинальным.

24

2.5. Основные понятия и задачи корреляционного анализа

Надо производить опыты, изменяя

обстоятельства, пока не извлечем из них

общее правило, потому что опыт доставляет истинное правило.

Л. да Винчи

Корреляционный анализ – метод математической статистики, изучающий корреляционные (статистические) связи.

Корреляция – это статистическая зависимость между случайными величинами, не имеющими строго функционального характера, при которой изменение одной из случайных величин приводит к изменению математического ожидания другой.

Абстрактно-математическую сторону его более глубоко и детально изучают в курсе математической статистики. Мы же рассмотрим применение методов корреляционного анализа в изучении связей социально-экономических явлений.

В статистике различают следующие варианты корреляционных связей.

1. Парная корреляция, т. е. зависимость между двумя признаками – результативным и факторным (или двумя факторными).

2. Частная корреляция – зависимость между результативным и одним факторным признаками при фиксированном значении других факторных признаков.

3. Множественная корреляция – зависимость между результативным и

двумя и более факторными признаками.

В теории статистики наиболее разработанной является методология парной

корреляции, овладение которой позволяет познать методику изучения других вариантов корреляционных связей. Поэтому мы и остановимся прежде всего на

рассмотрении парной корреляционной зависимости.

Необходимо отметить, что при изучении корреляционных связей статистика, наряду с корреляционным, использует и регрессионный анализ. Поэтому корректнее было бы сказать о применении

методов КРА в изучении корреляционных связей, но для краткости говорят просто – корреляционный анализ.

Эти два метода решают разные задачи, но в целом служат

единой цели: изучению взаимосвязей социально-экономических

явлений, их измерению и количественному выражению.

Итак, при помощи методов КРА решаются две основные задачи1.

1 Необходимо сказать и о других задачах применения КРА, имеющих не

формально математический, а содержательный характер [4, с. 200].

25

1. Определение формы связи и параметров уравнения связи

(это задача регрессионного анализа). Первая задача решается

подбором математической формулы (уравнения связи), выражающей зависимость результативного и факторного признаков.

Основным методом решения задачи нахождения параметров

уравнения связи является метод наименьших квадратов (МНК),

разработанный К. Ф. Гауссом (1777–1855). Он состоит в минимизации суммы квадратов отклонений фактически измеренных значений зависимой переменной у от ее значений, вычисленных по

уравнению связи с факторным признаком (многими признаками) х.

Следует заметить, что традиционные методы корреляции и регрессии широко представлены в разного рода статистических пакетах программ для ЭВМ. Исследователю остается только правильно подготовить информацию, выбрать удовлетворяющий требованиям анализа пакет программ и быть готовым к интерпретации полученных результатов. Алгоритмов вычисления параметров связи существует множество, и в настоящее время вряд ли целесообразно проводить такой

сложный вид анализа вручную. Вычислительные процедуры представляют самостоятельный интерес, но знание принципов изучения взаимосвязей, возможностей и ограничений тех или иных методов интерпретации результатов является

обязательным условием исследования.

2. Измерение тесноты связи (задача корреляционного анализа). Это задача решается с помощью различных показателей,

характеризующих тесноту связи между признаками (коэффициента корреляции, корреляционного отношения и др.).

Поясним на графике (см. рис. 5, а и б) различия между корреляцией и регрессией.

Рис. 5. Регрессия при разной интенсивности корреляции: а – тесная корреляция,

б – слабая корреляция

26

Угол наклона линии регрессии относительно оси абсцисс один

и тот же на рис. 5, а и б. Однако на рис. 5, а точки корреляционного

поля концентрируются около линии регрессии, тогда как на рис. 5, б

точки поля корреляции разбросаны. Очевидно, что теснота связи,

т. е. мера корреляции между х и у, в случае а будет высокой, а в

случае б – низкой. Следовательно, уравнение регрессии в случае а

будет статически значимо, а в случае б может быть статически незначимо. Таким образом случаи а и б различаются величиной коэффициентов корреляции, но в то же время будут иметь одинакоa ryx б ryx ;

вые коэффициенты регрессии:

a byx б byx .

Для изучения корреляционных связей статистиками разработаны разные методы, каждый из которых решает свои конкретные

задачи. Одни коэффициенты связи пригодны для измерения взаимосвязей качественных признаков, другие – для качественных и

количественных, третьи – для количественных.

Методы оценки тесноты связи подразделяются на корреляционные (параметрические) и непараметрические. Методы корреляционного и дисперсионного анализа не универсальны: их можно

применять, если все изучаемые признаки являются количественными. При использовании этих методов нельзя обойтись без вычисления основных параметров распределения (средних величин,

дисперсий), поэтому они получили название параметрических

методов.

Параметрические методы основаны на использовании, как правило, оценок

нормального распределения и применяются в случаях, когда изучаемая совокупность состоит из величин, которые подчиняются закону нормального распределения. На практике это положение чаще всего принимается априори. Собственно, эти методы – параметрические – и принято называть корреляционными.

Между тем в статистической практике приходится сталкиваться

с задачами измерения связи между качественными признаками (такими признаками, как пол, образование, занятие, семейное положение человека, отрасль, форма собственности предприятия, т. е.

признаками, не имеющими количественного выражения), к которым параметрические методы в обычном виде не применимы. Статистической наукой разработаны методы, с помощью которых

можно измерить связь между явлениями, не используя при этом

27

количественные значения признака, а значит, и параметры распределения. Такие методы получили название непараметрических.

Непараметрические методы не накладывают ограничений на закон распределения изучаемых величин. Данные коэффициенты исчисляются при условии,

что исследуемые признаки подчиняются различным законам распределения. Их

преимуществом является и простота вычислений.

3. В заключение проводятся оценка и анализ полученных результатов при помощи специальных показателей корреляционного метода (коэффициентов детерминации, линейной и множественной корреляции и т. д.), а также проверка существенности

связи между изучаемыми признаками.

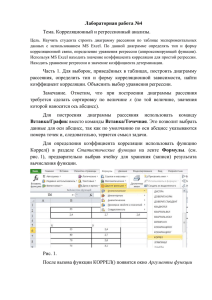

3. Корреляционно-регрессионный анализ

Если все кажется легким – это безошибочно доказывает, что работник весьма мало искусен и что работа выше его разумения.

Л. да Винчи

Схематично КРА можно представить в виде следующих основных этапов:

1) установление наличия связи между изучаемыми признаками

при помощи указанных выше методов;

2) отбор наиболее существенных факторов для анализа;

3) выявление характера связи, ее направления и формы, т. е.

подбор математического уравнения, выражающего зависимость

между (y) и (x);

4) определение параметров уравнения и показателей тесноты

связи;

5) статистическая оценка показателей тесноты связи.

Наиболее сложным и ответственным этапом КРА является

подбор уравнения, характеризующего сущность связи. При парной

корреляции уравнение связи может быть установлено с помощью

построения корреляционного поля, составления корреляционных

таблиц, пересмотра различных функций.

На практике выработался определенный критерий, позволяющий установить оптимальное соотношение между числом факторных признаков, включаемых в модель, и объемом исследуемой

совокупности. Согласно данному критерию, число факторных

28

признаков {к} должно быть в 5–6 раз меньше объема изучаемой

совокупности.

Общая блок-схема реализации корреляционного и регрессионного методов анализа представлена на рис. 6.

Если объем исследуемой совокупности не очень большой, то

целесообразно построить корреляционное поле, общий вид которого укажет характер связи, ее направление и форму.

В зависимости от характера изменения факториального и результативного признака различают прямолинейную и криволинейную корреляционную связь.

Матрица исходных данных

Построение матрицы парных коэффициентов корреляции

Проверка связей между признаками на наличие мультиколлинеарности

Отбор факторных признаков

Оценка статистической значимости уравнения регрессии и коэффициентов

регрессии

Расчет и анализ доп. показателей для расширения экономической интерпретации

уравнения регрессии

Экономическая интерпретация, формулировка выводов и предложений

Рис. 6. Схема проведения корреляционно-регрессионного анализа

При прямолинейной корреляционной зависимости с ростом факториального

признака происходит возрастание или убывание результата в среднем на определенную величину, т. е. между двумя переменными величинами устанавливается

постоянное соотношение. Примерами такой связи может быть зависимость

розничного товарооборота от денежных доходов населения, уровня издержек

обращения от объема розничного товарооборота и т. п.

При криволинейной зависимости между переменными величинами устанавливается меняющееся соотношение. Криволинейная зависимость принимает различное математическое выражение в виде параболы, гиперболы и других кривых.

То есть, по общему расположению точек корреляционного поля можно установить форму зависимости и выразить ее соответствующим уравнением:

29

линейную форму – уравнением прямой линии: yx a bx,

нелинейную форму – уравнениями различного рода кривых

линий:

параболы 2-го

порядка

y x a bx cx 2

или

высших порядков

гиперболы

b

yx a

x

Примерами такой связи может быть зависимость себестоимости перевозок от мощности автохозяйств, себестоимости продукции от стоимости ОПФ и т. д.

30

показательной

функции y x ab x

степенной

функции:

y = axn, где a,

n – постоянные

3.1. Парная линейная корреляция

Простейшей системой корреляционной связи является линейная связь между двумя признаками – парная линейная корреляция.

Практическое значение ее заключается в том, что есть системы, в которых среди всех факторов, влияющих на результативный

признак, выделяется один важнейший фактор, который в основном

определяет вариацию результативного признака. Измерение парных корреляций составляет необходимый этап в изучении сложных многофакторных связей. Есть такие системы связей, при изучении которых следует предпочесть парную корреляцию. Внима31

ние к линейным связям объясняется ограниченной вариацией переменных и тем, что в большинстве случаев нелинейные формы

связей для выполнения расчетов преобразуются в линейную форму.

Уравнение парной линейной корреляционной связи называется уравнением парной регрессии и имеет вид:

y a bx,

(1)

где y – среднее значение результативного признака при определенном значении факторного признака х; a – свободный член

уравнения; b – коэффициент регрессии, измеряющий среднее отношение отклонения результативного признака от его средней величины к отклонению факторного признака от его средней величины на одну единицу его измерения – вариация у, приходящаяся

на единицу вариации х.

Коэффициент регрессии (b) всегда число именованное.

Если b > 0, то связь прямая;

b < 0 – связь обратная;

b = 0 – связь отсутствует.

Что касается термина «регрессия», его происхождение таково:

создатели корреляционного анализа Ф. Гальтон (1822–1911) и

К. Пирсон (1857–1936) интересовались связью между ростом отцов и их сыновей. Ф. Гальтон изучил более 200 семей и обнаружил, что в группе семей с высокорослыми отцами сыновья в среднем ниже ростом, чем их отцы, а в группе семей с низкорослыми

отцами сыновья в среднем выше отцов. Таким образом, отклонение роста от средней в следующем поколении уменьшается – регрессирует. Причина в том, что на рост сыновей влияет не только

рост отцов, но и рост матерей и много других факторов развития

ребенка, и эти факторы, случайно направленные как в сторону

увеличения, так и снижения роста, приближают рост сыновей к

среднему росту. В целом же вариация роста, конечно, не уменьшается, а в наше время «акселерации» сам средний рост увеличивается из поколения в поколение.

Уравнение (1) определяется по данным о значениях признаков х

и у в изучаемой совокупности, состоящей из п единиц. Параметры

уравнения а и b находятся методом наименьших квадратов.

Суть его в том, что на поле корреляции определяется такая

теоретическая линия регрессии, которая по сравнению с множе32

ством других линий наиболее близко расположена к точкам поля

(изображающим фактические данные). То есть эта линия дает

наименьшую сумму квадратов отклонений фактических значений

результатного признака от выровненных (теоретических) значений: f a, b

y a bx

2

i

i

min .

Для отыскания значений параметров а и b, при которых f(a, b)

принимает минимальное значение, частные производные функции

приравниваем к нулю и преобразуем получаемые уравнения, которые называются нормальными уравнениями МНК для прямой. Система нормальных уравнений для парной линейной связи имеет вид:

na b x y

(2)

,

2

a

x

b

x

xy

где n – количество элементов факторного признака X .

Нормальные уравнения МНК для прямой линии регрессии являются системой двух уравнений с двумя неизвестными а и b. Все

остальные величины, входящие в систему, определяются по исходной информации. Таким образом, однозначно вычисляются

при решении этой системы уравнений оба параметра уравнения

линейной регрессии.

a bx y , откуда a y bx.

(3)

Параметры a и b искомой прямой можно определить и по другим формулам:

b

xy x y

,

x 2 ( x )2

a y bx.

(4)

Коэффициент парной линейной регрессии, обозначенный b,

имеет смысл показателя силы связи между вариацией факторного

признака х и вариацией результативного признака у. Он измеряет

среднее по совокупности отклонение у от его средней величины

при отклонении признака х от своей средней величины на принятую единицу измерения.

Например, по данным табл. 6 при отклонении затрат на 1 корову от средней величины на 1 руб. надой молока на корову отклоняется от своего среднего значения на 3,47 кг в среднем по со33

вокупности. При отклонении фактора на xi x результативный

признак отклоняется в среднем на yi y.

Теснота парной линейной корреляционной связи, как и любой

другой, может быть измерена корреляционным отношением η.

Кроме того, при линейной форме уравнения применяется другой показатель тесноты связи – коэффициент корреляции rxy. Он

представляет собой стандартизованный коэффициент регрессии,

т. е. коэффициент, выраженный не в абсолютных единицах измерения признаков, а в долях среднего квадратического отклонения

результативного признака:

(5)

Коэффициент корреляции был предложен английским статистиком и философом Карлом Пирсоном (1857–1936). Его интерпретация такова: отклонение признака-фактора от его среднего

значения на величину своего среднего квадратического отклонения в среднем по совокупности приводит к отклонению признакарезультата от своего среднего значения на rxy его среднего квадратического отклонения.

В отличие от коэффициента регрессии b коэффициент корреляции не зависит от принятых единиц измерения признаков, а стало быть, он сравним для любых признаков.

Обычно считают связь сильной, если r ≥ 0,7; средней тесноты

– при 0,5 ≤ r ≤ 0,7; слабой – при r < 0,5. Не следует, особенно работая с ЭВМ, гнаться за большим числом знаков коэффициента

корреляции. Во-первых, исходная информация редко имеет более

34

трех значащих точных цифр, во-вторых, оценка тесноты связи не

требует более двух значащих цифр.

Квадрат коэффициента корреляции называется коэффициентом детерминации:

2

rxy

n

( xi x )( yi y )

i 1

n

(x

i 1

i

x)

n

2

(y

i 1

i

2

y)

2

n

b ( xi x )( yi y )

i 1

(y

i 1

(6)

.

n

i

y)

2

Эта формула понадобится при анализе множественной корреляции. Умножив числитель и знаменатель на

n

(x

i 1

i

x ) 2 , полу-

n

чим:

rxy2

b 2 ( xi x ) 2

i 1

n

( yi y )2

.

i 1

n

Поскольку b( xi x ) yˆi y , имеем: r

2

xy

( yˆ

i

y )2

(y

i

y)

i 1

n

i 1

,

(7)

2

где ŷi – индивидуальные значения у по уравнению связи.

Это выражение соответствует выражению η2. Тождество коэффициента детерминации и квадрата корреляционного отношения служит основанием для интерпретации величины rxy2 как доли

общей дисперсии результативного признака у, которая объясняется вариацией признака-фактора х (и связью между вариацией обоих признаков). Собственно говоря, основным показателем тесноты связи и следовало бы считать коэффициент детерминации (для линейной формулы связи) или квадрат корреляционного отношения. Но исторически раньше был введен коэффици35

ент корреляции, который долгое время и рассматривался как основной показатель.

Аналогично разным «рабочим» формулам для вычисления коэффициента регрессии можно получить разные «рабочие» формулы коэффициента корреляции.

Разделив числитель и знаменатель формулы (5) на n, получим:

n

( xi x )( yi y ) : n xy x y

(8)

rxy i 1

.

x y

x2 y2

Эта формула соответствует формуле (4) для коэффициента регрессии.

Средние квадратические отклонения можно выразить через

средние величины признака:

x x 2 ( x )2 ; y y 2 ( y )2 .

Подставив эти выражения в (8), получим:

rxy

x

xy x y

2

( x )2 y 2 ( y )2

.

(9)

Эта формула (9) удобнее для расчетов, если средние величины

признаков и средние квадраты индивидуальных величин вычислены ранее. Смысл же коэффициента корреляции раскрывается исходной формулой (5). В преобразованных формулах этот смысл не

столь ясен.

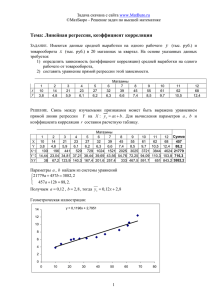

Рассмотрим фактический пример анализа корреляционной

парной линии связи по данным 16 сельхозпредприятий о затратах

на 1 корову и о надое молока на корову. Ограниченный объем совокупности принят только в учебных целях, чтобы избежать приведения громоздких таблиц (табл. 6).

25678

Средние значения признаков: x

1605 руб.;

16

563,2

y

35,2 ц/голов.

16

Сопоставляя знаки отклонений признаков x и у от средних величин, видим явное преобладание совпадающих по знакам пар отклонений: их 14 и только 2 пары несовпадающих знаков.

36

Таблица 6

Корреляция между затратами на корову и надоем молока в среднем от коровы

Расчетные

значения

надоя, ц

~y

37

Номера

единиц

совокупности

Затраты на 1

корову,

руб./голов

xi

Надой

от одной

коровы, ц

yi

xi ~

x

yi ~

y

1

2

3

4

5

6

7

8

9

10

1602

1199

1321

1678

1600

1355

1413

1490

1616

1693

34,2

19,6

27,3

32.5

33,2

31,8

30,7

32,6

26,7

42,4

-3

-406

-283

+73

-5

-250

-192

-115

+11

+88

-1,0

-15,6

-7,9

-2,7

-2,0

-3,4

-4,5

-2,6

-5,5

+7,2

+3,0

+6333,6

+2235,7

-197,1

+10,0

+850,0

+864,0

+299,0

-60,5

+633,6

9

164836

80089

5329

25

62500

36864

13225

121

7744

1,00

243,36

62,41

7,29

4,00

11,56

20,25

6,76

30,25

51,84

35,1

21,1

25,3

37,7

35,0

26,5

28,5

31,2

35,6

38,2

11

12

13

1665

1666

1628

37,9

36,6

38,0

+60

+61

+23

+2,7

+1,4

+2,8

+162,0

+85,4

+64,4

3600

3721

529

7,29

1,96

7,84

37,3

37,3

36,0

14

15

16

∑

1604

2077

2071

25678

32,7

51,7

55,3

563,2

-1

+472

+466

-

-2,5

+16,5

+20,1

-

+2,5

+7788

+9366,6

+28440,2

1

222784

217156

818533

6,25

272,25

404,01

1138,32

35,2

51,6

51,4

563,0

( xi ~

x ) ( yi ~

y)

( xi ~

x)

2

2

( yi ~

y)

i

37

Немецкий психиатр Г. Т. Фехнер (1801–1887) предложил меру

тесноты связи в виде отношения разности числа пар совпадающих

и несовпадающих пар знаков к сумме этих чисел:

С H 14 2

K Фехнера

0,75.

C H 14 2

Конечно, коэффициент Фехнера очень грубый показатель тесноты связи, не учитывающий величину отклонений признаков от

средних значений, но он может служить некоторым ориентиром в

оценке интенсивности связи. В данном случае он указывает на

тесную связь признаков.

Вычислим на основе итоговой строки табл. 6 параметр парной

линейной корреляции:

28473,7

b

0,0347.

818533

Он означает, что в среднем по изучаемой совокупности отклонение затрат на 1 корову от средней величины на 1 руб. приводило

к отклонению с тем же знаком среднего надоя молока на 0,0347 ц,

т. е. на 3,47 кг на корову. При нестрогой интерпретации говорят:

«С увеличением затрат на корову на 1 руб. в среднем надой молока

возрастал на 3,47 кг». Поскольку и до начала резкой инфляции

стоимость 3,47 кг молока значительно превосходила рубль, увеличение затрат на корову было экономически целесообразным.

Свободный член уравнения регрессии вычислим по формуле:

а = 35,2 - 0,0347 × 1605 = - 20,49.

Уравнение регрессии в целом имеет вид:

~

y 0,0347 x 20,49.

Отрицательная величина свободного члена уравнения означает,

что область существования признака у не включает нулевого значения признака и близких значений. Можно рассчитать минимально

возможную величину фактора х, при которой обеспечивается

наименьшее значение признака у (разумеется, положительное).

xmin a : b 20,49 : 0,0347 590,5 руб./голов

– это наименьшая сумма затрат на 1 корову, при которых корова способна давать молоко. Если же область существования результативного признака включает нулевое значение признака38

фактора, то свободный член является положительным и означает

среднее значение результативного признака при отсутствии данного фактора, например среднюю урожайность картофеля при отсутствии органических удобрений.

Графическое изображение корреляционной связи по данным

табл. 6 приведено на рис. 7.

Рис. 7. Корреляция затрат на корову с продуктивностью

Коэффициент корреляции, рассчитанный на основе таблицы 6:

28440,2

rxy

0,932.

818533 1138,32

Полученное значение гораздо больше коэффициента Фехнера.

Квадрат коэффициента корреляции, т. е. коэффициент детерминации

составил 0,869 или 86,9 %. Вариации надоев молока на корову связаны с вариацией затрат в хозяйствах, произведенных в среднем на

1 корову.

Для интерпретации коэффициента корреляции необходимо

знать область его существования 0 r 1. Как ясно из формулы

(5), минимальное, именно нулевое значение коэффициента корреляции может быть достигнуто, если положительные и отрицатель39

ные произведения отклонений признаков от их средних величин в

числителе полностью уровновесят друг друга. Это свидетельствовало бы о полном отстутствии связи, но вероятность такого

абсолютно точного взаимопогашения крайне мала для любой

реальной, не бесконечно большой совокупности. Поэтому и при

отстутствии реальной связи коэффициент корреляции на практике

не равен нулю.

Максимально тесная связь – это связь функциональная, когда

каждому индивидуальному значению результативного признака уi

может быть однозначно поставлено в соответствие значение хi,

например, когда уi = хi × с, где с – константа. Подставив это

выражение уi в формулу коэффициента корреляции (5), получим:

.

Если связь обратная и уi = -схi то коэффициент корреляции

будет равен минус единице. Чем ближе коэффициент корреляции к

единице, тем ближе связь к функциональной. Полученное в

примере значение +0,932 свидетельствует об очень тесной связи

надоев молока с затрами в расчете на 1 корову. Это можно увидеть

на рис. 7, где реальные значения для отдельных хозяйств (точки

корреляционного поля) близко расположены к линии регрессии,

выражающей среднюю закономерность связи.

3.2. Статистическая оценка надежности параметров парной

корреляции

Показатели корреляционной связи, вычисленные по ограниченной совокупности (по выборке), являются лишь оценками той

или иной статистической закономерности, поскольку в любом параметре сохраняется элемент не полностью погасившейся случайности, присущей индивидуальным значениям признаков. Поэтому

необходима статистическая оценка степени точности и надежности параметров корреляции. Под надежностью здесь понимается

вероятность того, что значение проверяемого параметра не равно

нулю, не включает в себя величины противоположных знаков.

40

Вероятностная оценка параметров корреляции производится

по общим правилам проверки статистических гипотез, разработанным математической статистикой, в частности путем сравнения

оцениваемой величины со средней случайной ошибкой оценки.

Для коэффициента парной регрессии b средняя ошибка оценки

вычисляется как

n

mb

(y

i 1

i

yˆ i ) 2 : (n 2)

,

n

(x

i 1

i

x)

(10)

2

где ŷi – расчётные значения результативного признака; n – 2 –

число степеней свободы.

Числитель подкоренного выражения есть остаточная дисперсия результативного признака.

В примере по данным табл. 6 средняя ошибка оценки коэффициента регрессии

195,4 : 14

mb

0,00413.

818533

Зная среднюю ошибку оценки коэффициента регрессии, можно вычислить вероятность того, что нулевое значение коэффициента входит в интервал возможных с учетом ошибки значений. С

этой целью находится отношение коэффициента к его средней

ошибке, т. е. t-критерий Стьюдента:

b

0,0347

t

8,4.

mb 0,00413

Табличное значение t-критерия Стьюдента при 16 - 2 степенях

свободы и уровне значимости 0,01 составляет 2,98 (см. приложение 2). Полученное значение критерия много больше, следовательно, вероятность нулевого значения коэффициента регрессии

менее 0,01. Гипотезу о несущественности этого коэффициента

можно отклонить: данные табл. 6 надежно говорят о влиянии вариации затрат на корову на вариацию надоя молока от коров. Расчет критерия Стьюдента для коэффициентов регрессии входит в

программы ЭВМ и ПЭВМ для корреляционного анализа, например «Mikrostat», MAKR-4, «Statgraphics» и др.

41

3.3. Множественное уравнение регрессии

Проблемы множественного корреляционно-регрессионного

анализа и моделирования подробно изучаются в специальном курсе того же названия. В курсе «Общая теория статистики» рассматриваются только самые общие вопросы этой сложной проблемы и

дается начальное представление о методике построения уравнения

множественной регрессии и показателей связи.

Рассмотрим линейную форму многофакторных связей не только как наиболее простую, но и как форму, предусмотренную пакетами прикладных программ для ПЭВМ. Если же связь отдельного

фактора с результативным признаком не является линейной, то

производят линеаризацию уравнения путем замены или преобразования величины факторного признака.

Общий вид многофакторного уравнения регрессии имеет вид:

k

yˆ a b1x1 ... bk xk a b j x j ,

(11)

j i

где k – число факторных признаков.

Чтобы упростить систему уравнений МНК, необходимую для

вычисления параметров уравнения (11), обычно вводят величины

отклонений индивидуальных значений всех признаков от средних

величин этих признаков.

yi yi y; x ji x ji x j .

(12)

Получаем систему k уравнений МНК:

n

n

i 1

i 1

n

n

b1 2 x1i b2 x1i x2i bk x1i xki yi x1i ,

n

i 1

n

i 1

n

n

b1 x1i x2i b2 2 x 2i bk x2i xki yi x2i ,

i 1

i 1

∙

∙

∙

i 1

∙

∙

∙

i 1

∙

∙

∙

∙

∙

∙

n

n

n

n

i 1

i 1

i 1

i 1

b1 x1i xki b2 x2i xki bk 2 xki yi xki .

42

Решая эту систему, получаем значения коэффициентов условно-чистой регрессии bj Свободный член уравнения вычисляется по

формуле

k

a y bj x j .

(13)

j 1

Термин «коэффициент условно-чистой регрессии» означает,

что каждая из величин bj измеряет среднее по совокупности отклонение результативного признака от его средней величины при

отклонении данного фактора хj от своей средней величины на единицу его измерения и при условии, что все прочие факторы, входящие в уравнение регрессии, закреплены на средних значениях, не

изменяются, не варьируют.

Таким образом, в отличие от коэффициента парной регрессии

коэффициент условно-чистой регрессии измеряет влияние фактора, абстрагируясь от связи вариации этого фактора с вариацией

остальных факторов. Если было бы возможным включить в уравнение регрессии все факторы, влияющие на вариацию результативного признака, то величины bj можно было бы считать мерами

чистого влияния факторов. Но так как реально невозможно включить все факторы в уравнение, то коэффициенты bj не свободны от

примеси влияния факторов, не входящих в уравнение.

Включить все факторы в уравнение регрессии невозможно по

одной из трех причин или сразу по ним всем, так как:

1) часть факторов может быть неизвестна современной науке,

познание любого процесса всегда неполное;

2) по части известных теоретических факторов нет информации либо таковая ненадежна;

3) численность изучаемой совокупности (выборки) ограничена, что позволяет включить в уравнение регрессии ограниченное

число факторов.

Коэффициенты условно-чистой регрессии bj являются именованными числами, выраженными в разных единицах измерения, и

поэтому несравнимы друг с другом. Для преобразования их в

сравнимые относительные показатели применяется то же преобразование, что и для получения коэффициента парной корреляции.

43

Полученную величину называют стандартизованным коэффициентом регрессии или β-коэффициентом.

j bj

x

j

y

(14)

.

β-коэффициент при факторе хj, определяет меру влияния вариации фактора хj на вариацию результативного признака у при отвлечении от сопутствующей вариации других факторов, входящих

в уравнение регрессии.

Коэффициенты условно-чистой регрессии полезно выразить в

виде относительных сравнимых показателей связи, коэффициентов

эластичности:

e j bj

xj

y

.

(15)

Коэффициент эластичности фактора хj говорит о том, что при

отклонении величины данного фактора от его средней величины на

1 % и при отвлечении от сопутствующего отклонения других факторов, входящих в уравнение, результативный признак отклонится

от своего среднего значения на ej процентов от y. Чаще интерпретируют и применяют коэффициенты эластичности в терминах динамики: при увеличении фактора х на 1 % его средней величины.

3.4. Теснота связи и простейшие методы ее измерения

Оценка тесноты связи между признаками предполагает определение меры соответствия вариации результативного признака и

факторного (или нескольких факторных при множественной корреляции).

В случае линейной зависимости тесноту связи можно измерить при помощи линейного коэффициента корреляции (ЛКК),

который еще называют коэффициентом Пирсона:

r b

x

,

y

где b – коэффициент регрессии; σх – среднее квадратическое

отклонение факторного признака; σy – среднее квадратическое отклонение результативного признака;

y y 2 ( y )2 .

x x 2 (x ) 2 ;

44

Линейный коэффициент корреляции можно определить и по

иной формуле:

r

( x x ) ( y y)

( x x ) ( y y)

2

или r

2

xy x y

.

x y

Линейный коэффициент корреляции может принимать значения от 0 ± 1 (знак (+) при прямой зависимости, (-) при обратной).

На практике руководствуются следующими оценками тесноты

связи: при r < 0,3 связь слабая;

r = 0,3 ÷ 0,7 – средняя;

r > 0,7 – сильная;

r = 0 – связь отсутствует;

r = 1 – связь функциональная.

Значимость ЛКК проверяется на достоверность (надежность). Считается, что корреляционная связь является достоверной лишь при достаточном числе наблюдений (не менее 20–30).

Проверка надежности коэффициента корреляции осуществляется с

помощью критерия надежности по формуле:

tr

r

r

,