Статистические зависимости

реклама

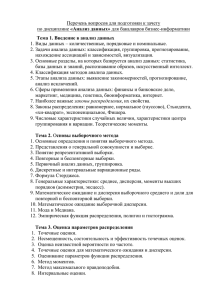

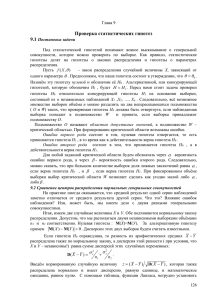

Материал по курсу «Математика» для специальности «Социология» ЧЕРНОВИК Караваев Артём Михайлович Характеристики Для кого: 4 семестр (II курс). Продолжительность: около 30 часов лекций и 30 часов практик. Темы Математическая статистика: основные понятия, точечные оценки, проверка гипотез, статистические зависимости (регрессия), дисперсионный анализ. Цели Научить студентов проводить простейшие статистические расчеты (оценивать математическое ожидание, дисперсию, корреляцию), строить гистограммы, определять статистические зависимости (линейная регрессия, дисперсионный анализ), проверять гипотезы. Содержание Вводная часть. 1) Задачи математической статистики; 2) понятие «выборка»; 3) понятие «отбор»; 4) полигон и гистограмма. Точечные статистические оценки параметров распределения. 1) Смещённые и несмещенные, генеральные и выборочные оценки; 2) математическое ожидание; 3) дисперсия и среднеквадратическое отклонение; 4) доверительный интервал. Статистические зависимости. 1) Функциональная, статистическая и корреляционная зависимости; 2) линейная регрессия; 3) коэффициент корреляции. Проверка статистических гипотез. 1) Понятие «статистической гипотезы», ошибки первого, второго рода; 2) статистический критерий, критическая область; 3) уровень значимости, односторонние, двусторонние области; 4) разнообразные примеры гипотез. Дисперсионный анализ. 1) Общие представления о дисперсионном анализе; 2) однофакторный дисперсионный анализ. Вводная часть Задачи математической статистики Массовые случайные явления часто подчиняются некоторым закономерностям, которые можно выявлять и изучать методом теории вероятностей. Математическая статистика возникла в XVII в. вместе с теорией вероятности и развивалась параллельно ей. Математическая статистика решает следующие задачи, перечисленные ниже. 1. Указание способов сбора и группировки полученных в ходе исследования или наблюдения данных. 2. Разработка методов анализа данных, исходя из поставленных целей. a. Оценка вероятности события b. Оценка функции или параметров распределения. c. Оценка зависимости случайной величины от одной или нескольких случайных величин. Таким образом, задача математической статистики состоит в создании методов сбора и обработки статистических данных для получения научных и практических выводов. Понятие «Выборка» При исследовании какого-либо качественного или количественного признака совокупности объектов можно исследовать каждый объект из всей совокупности. Однако на практике объектов может быть слишком много или исследование объекта сопряжено с его уничтожением. Поэтому для исследования выбирают лишь некоторые объекты из всей совокупности. Таким образом, «выборка» – это множество случайно выбранных объектов. Генеральной совокупностью называется совокупность объектов, из которых производится выборка. Объем выборки – количество элементов в ней. Например, из 1000 деталей для исследования выбрали 100. Исходные 1000 деталей – это генеральная совокупность, а 100 деталей – это выборка генеральной совокупности объемом 100. Часто объем выборки обозначают буквой n . Выборка может быть повторной и бесповторной. В первом случае отобранный объект сразу после исследования возвращается в генеральную совокупность. Затем он случайно может быть выбран снова. Во втором случае объект не возвращается и повторно быть выбранным не может. Выборка называется репрезентативной (представительной), если её объем достаточен для того, чтобы уверенно судить об интересующем нас признаке. То есть количество элементов, отобранных для исследования, должно быть достаточно для того, чтобы они правильно представляли всю генеральную совокупность. Понятие «отбор» Отбор – это процесс выбора случайных элементов из генеральной совокупности. Два основных вида отбора: простой случайный и групповой. Простой случайный отбор может быть повторным и бесповторным (каждый выбранный объект либо может быть исследован повторно, либо не может быть исследован повторно). Случайность достигается с помощью генератора или таблиц случайных чисел. Групповой отбор подразумевает деление генеральной совокупности на группы по какому-либо критерию, а затем выбор одной из групп в качестве выборки. Например, если детали изготавливаются на разных станках, то выборкой могут быть детали только с одного станка. Или, например, можно выбирать для исследования каждую 10-ю деталь с каждого станка, это тоже будет групповой выбор. Статистическое распределение выборки Пусть из генеральной совокупности извлечена выборка. Причем x1 наблюдалось n1 раз, x 2 наблюдалось n 2 раз, и т. д. xk наблюдалось nk раз. Сумма n1 n2 nk n – объем выборки. Наблюдаемые значения xi называются вариантами. Последовательность вариантов, записанных в возрастающем порядке, называется вариационным рядом. Например, пусть выборка состоит из чисел: 1, 2, 3, 1, 2, 5, 2, 3, 5, 5, 7, 2. Тогда объем выборки n 12 . Вариационный ряд – это записанный по возрастанию варианты: 1, 2, 3, 5, 7. Эти варианты встречаются, соответственно, n1 2 , n2 4 , n3 2 , n4 3 , n5 1 раз (здесь k 5 – всего 5 различных элементов). Числа n1 , …, nk называются частотами. Числа pi ni / n называются относительными частотами. Относительные частоты – это аналог вероятности. Относительные частоты в нашем примере равны (после округления) p1 0.17 , p 2 0.33 , p3 0.17 , p4 0.25 , p5 0.08 . Для контроля нужно проверить, чтобы сумма относительных частот была примерно равна 1 (примерно – из-за ошибок округления при делении). Статистическое распределение выборки – это таблица, в которой указаны все варианты и частоты их появления. В нашем примере это таблица x p 1 2 3 5 7 0.17 0.33 0.17 0.25 0.08 Полигон и гистограмма Для наглядности удобно строить статистические графики. Рассмотрим полигон и гистограмму. Полигон – это ломанная линия, которая соединяет точки координатной плоскости ( x1 , n1 ) , ( x2 , n2 ) , …, ( xk , nk ) . Например, пусть информация о выборке записана в таблице x 1 2 3 5 7 n 2 4 2 3 1 Тогда полигон выглядит следующим образом 5 4 3 2 1 0 1 2 3 5 7 Полигон можно построить и по относительным частотам, в этом случае он будет называться полигон относительных частот. Гистограмма – ступенчатая фигура, состоящая из прямоугольников. Высота прямоугольника равна числу попаданий вариантов в ту область, которую покрывает прямоугольник. В нашем примере договоримся, что прямоугольники будут иметь ширину 1. Тогда гистограмма выглядит следующим образом: 5 4 3 2 1 0 1 2 3 5 7 В общем случае гистограмма удобнее полигона, когда варианты могут принимать случайный значения из непрерывного диапазона (например, могу быть не целыми). В таком случае нужно разбить весь интервал значений на несколько равных частей и смотреть, сколько раз элемент выборки попал в каждый интервал. Например, пусть мы находимся на уроке физвоспитания и замеряем время, с которым студенты пробегают 100 м, Пусть у нас получились следующие измерения (время в секундах): 12.6, 11.9, 13.5, 13.4, 12.4, 14.3, 12.3, 11.8, 12.9, 13.1, 14.0, 13.2. Всего получилось 12 измерений. Разобьем интервал времени на части: [11,12), [12,13), [13,14) и [14,15). В каждый интервал попали 2, 4, 4, 2 студентов соответственно. Получаем следующую гистограмму: 5 4 3 2 1 0 11-12 Точечные 12-13 13-14 статистические 14-15 оценки параметров распределения Смещённые и несмещенные, генеральные и выборочные оценки Обычно в распоряжении исследователя имеются лишь данные выборки, полученные, например, в ходе нескольких наблюдений (мы предполагаем, что наблюдения независимы). Элементы выборки являются случайными величинами (подчиняющимися какому-то теоретическому распределению), поэтому для их характеристики или, скажем, для предсказания их поведения может понадобиться знание параметров распределения этих величин, таких, например, как математическое ожидание и дисперсия. Статистической оценкой неизвестного параметра теоретического распределения называют функцию он наблюдаемых случайных величин. Статистические оценки неизвестных параметров должны удовлетворять ряду требований (чтобы считаться хорошими). Допустим, что по выборке из n элементов мы оценили неизвестный параметр (это греческая заглавная буква «тета») и получили его значение, равное 1* . Повторим опыт. Получим значение *2 . Будем повторять опыт k раз и получим столько же вообще говоря различных оценок одного и того же параметра: 1* , *2 ,, *k . Таким образом, можно считать, что – это случайная величина, а значения 1* , *2 ,, *k – это её возможные значения. Предположим, что большая часть всех значений * даёт значение с избытком, то есть наблюдаемые значения больше истинного значения (которое мы все ещё не знаем). В этом случае математическое ожидание E* больше чем . Аналогично, наши наблюдения могут оказаться меньше, чем точное значение . В этом случае E* меньше . Понятно, что для избегания систематических ошибок (ошибок одного знака) было бы неплохо, чтобы E* – в этом случае ошибки разных знаков будут встречаться «одинаково часто». Такая оценка, математическое ожидание которой равно значению самого оцениваемого параметра, называется несмещенной (то есть она не даёт смещения ни в лево, ни в право от оцениваемого параметра). Другие оценки называют смещёнными. Другое качество оценки – эффективность. Дело в том, что нет никакого смысла в несмещенной оценке, если разброс случайно величины очень велик. Например, если мы наблюдаем 2 показания датчика 100 , то 100 , то несмещенное среднее значение равно 0, однако было бы ошибкой считать, что мы наблюдаем нулевое показание. То есть когда дисперсия велика, оценка неэффективна. Эффективной называется такая оценка, которая имеет наименьшую возможную дисперсию. Последнее качество (но не последнее по значению ) – состоятельность. Оценка называется состоятельной, если при увеличении числа наблюдений она стремится к оцениваемому параметру. Например, в нашем случае с датчиком, продолжая наблюдения, возможно, мы увидим, что следующие 98 наблюдаемых значений равны каким-то другим числам, и наблюдаемый параметр описывается более точно. То есть когда большее число наблюдений не ухудшает качество оценивания, а улучшает его, оценку называют состоятельной. Генеральная оценка – это оценка, сделанная по генеральной совокупности. Выборочная оценка – это оценка, сделанная по выборке из этой генеральной совокупности. Часто генеральную оценку нельзя посчитать (например, в связи с тем, что объем слишком велик, или оценивание приводит к уничтожению объекта), в этом случае берут выборочную оценку на основе репрезентативной выборки. Математическое ожидание Задана выборка генеральной совокупности x1 , x2 ,, xn . Статистическая оценка математического ожидания (или будем просто говорить «математическое ожидание», или «выборочное среднее») есть величина x x1 x2 xn 1 n xi . n n i 1 Черта наверху означает «среднее». Обычно так и говорят « x среднее». Если вместо выборки задан вариационный ряд x1 , x2 ,, xk и указаны частоты n1 , n2 ,, nk появления каждого варианта, то выборочное среднее вычисляется по формуле: n1 x1 n1 x2 nk xk 1 k x ni xi . n n i 1 Если присмотреться, обе эти формулы – одно и то же, только в первой варианты могут повторяться, а во второй уже учтено, сколько раз повторяется каждый из них. Давайте убедимся, что выборочное среднее – это несмещенная оценка математического ожидания. Для этого нужно показать, что математическое ожидание выборочных средний равно математическому ожиданию случайно величины, которая порождает всю генеральную совокупность. Пусть x1 , x 2 ,, x m – средние значения разных выборок одной и той же генеральной совокупности. Пусть x1 состоит из k1 элементов, x 2 состоит из k 2 элементов, …, x m состоит из k m элементов. Все средние одинаково распределены с элементами генеральной совокупности, поэтому их характеристики равны, а значит среднее этих средних x x1 x 2 x m m равно математическому ожиданию каждой из участвующих в сумме выборок. Иными словами, «среднее от средних равно среднему» – это и означает, что оценка несмещенная. Можно также показать, что оценка является состоятельной. Дисперсия и среднеквадратическое отклонение Оценка дисперсия (или просто дисперсия) определяется как средний квадрат отклонения. То есть: ( x1 x) 2 ( x2 x) 2 ( xn x) 2 1 n Dx ( xi x) 2 . n n i 1 Если вместо выборки задан вариационный ряд, то формула перепишется в виде n1 ( x1 x) 2 n2 ( x2 x) 2 nk ( xk x) 2 1 k Dx ni ( xi x) 2 n n i 1 Среднеквадратическое отклонение есть квадратный корень из дисперсии: x Dx . Вычисление дисперсии по предложенной в определении формуле несколько неудобно. Выведем другую, более удобную формулу: 1 n 1 n 2 2 Dx ( xi x) xi 2 xi x x n i 1 n i 1 2 2 2 1 n 2 2x n 1 n 2 xi xi x n i 1 n i 1 n i 1 2 x2 2 x x x2 x . То есть дисперсия – это «среднее квадратов минус квадрат среднего». Например, пусть задана выборка 1, 2, 3, 2, 4, 1, 5, 4, 7, 6. Считаем среднее: x 1 2 3 2 4 1 5 4 7 6 3,5. 10 Считаем среднее квадратов: 12 2 2 32 2 2 4 2 12 52 4 2 7 2 6 2 x 16,1. 10 2 Таким образом, дисперсия равна 2 Dx x 2 x 16.1 3.5 2 3.85 . А среднеквадратическое отклонение равно x 3.85 1.96 . Часто вместо « » пишут просто « », если ошибка округления роли не играет. Приведённая в определении оценка дисперсии не является несмещенной. Не будем выводить строго, а просто приведём формулу для несмещенной оценки: Dx ( x1 x) 2 ( x2 x) 2 ( xn x) 2 1 n ( xi x) 2 . n 1 n 1 i 1 Разница только в знаменателе. При достаточно больших значениях n эта разница несущественна, поэтому на практике часто применят исходное определение смещенной оценки – оно удобнее. Доверительный интервал Оценка может быть точной и неточной. Точность оценки * параметра (значение которого мы не знаем) характеризуется размером интервала ( , ) . Причем – это некоторая величина, которая чем меньше, тем точнее оценка. Любая оценка может быть надёжной и ненадёжной. Надёжностью оценки называют вероятность , с которой оценка попадает в заданный интервал ( , ) . Часто надёжность берут равной 0.95, 0.99 или даже 0.999. Доверительным называют интервал, который покрывает оценку с заданной надёжностью. То есть это погрешность, за пределы которой мы не уйдем с вероятностью . Для математического ожидание нормального распределения доверительный интервал берут равным так называемой «стандартной ошибке». Она равна n . В этот интервал оценка попадает с вероятностью около 0,67. Есть другие интервалы: 2 ( 0.95 ) и 3 ( 0.99 ). Статистические зависимости Функциональная, статистическая и корреляционная зависимости Часто требуется установить зависимость наблюдаемой случайной величины от некоторых факторов (других случайных величин). Случайные величины могут быть связаны либо функциональной зависимостью, либо статистической, либо быть независимыми. Функциональная зависимость, когда одна величина зависит от другой по строгому закону, в статистике встречается редко, поскольку на все явления так или иначе накладывается случайный фактор. Статистическая зависимость – когда изменение одной величины влечёт изменение распределения другой (например, среднее число покупок какой-то модели телефона может зависеть от наличия на складе другой модели, более популярной). Когда одна величина влияет на среднее значение другой, тогда зависимость называется корреляционной. Другой пример: пусть Y – урожай зерна, а X – количество удобрений. При равных количествах удобрений с одинаковых по площади участков снимают разный урожай – то есть Y от X не зависит функционально. Однако вместе с тем, средний урожай выше тогда, когда положено больше удобрений. То есть величины связаны корреляционной зависимостью. Линейная регрессия Под регрессией здесь следует понимать зависимость одной случайной величины от другой. Линейная регрессия – прямо пропорциональная зависимость. Пусть у нас есть множество наблюдений за двумя случайными величинами сразу: x1 , x2 ,, xn и y1 , y 2 ,, y n . То есть мы наблюдали пары ( x1 , y1 ), ( x2 , y 2 ),, ( xn , y n ) . Эти пары чисел можно представить как точки на координатной плоскости: y kx b y отклонение x Иногда, если посмотреть на эти точки, можно обнаружить, что они располагаются около какой-то одной прямой линии. То есть между ними есть «несильная», но пропорциональная зависимость. Возникает задача – отыскать коэффициенты k и b этой прямой, а затем построить саму прямую. Поле этого можно предсказывать, какие примерно значения y можно наблюдать при таких-то значениях x . Коэффициент k называют выборочным коэффициентом регрессии. Мы хотим построить такую прямую, ближе всего к которой лежат точки на плоскости. Что означает, что «точки лежат ближе всего»? Назовем отклонением величину Yi yi (разница между ординатой точки i и точкой с такой же абсциссой на прямой. Потребуем, чтобы сумма квадратов отклонений была минимальной: n (Yi yi ) 2 min . i 1 или, что то же, n (kxi b yi ) 2 min . i 1 Не будем выполнять строгий вывод, а запишем ответ. Минимум этой функции достигается тогда, когда k n xy x y n x 2 x 2 , x 2 y x xy . b 2 n x 2 x Рассмотрим пример. Пусть мы наблюдаем следующие значения x и y : x 1 3 4 5 y 1 2 3 3 x 1 3 4 5 13, y 1 2 3 3 9, xy 1 1 3 2 4 3 5 3 34, x 2 1 9 16 25 51, 4 34 13 9 19 0.54, 35 4 51 13 2 51 9 13 34 17 b 0.49. 35 4 51 13 2 k Нарисуем точки и линию регрессии: y x По рисунку хорошо видно, что точки довольно «послушно» укладываются около найденной прямой. Можно «предсказать», что при наблюдении x 6 значение y ожидается равным около 4. Коэффициент корреляции Иногда одни и те же пары чисел xi , y j наблюдают несколько раз. Данные такого рода записывают в таблицу, где по строчкам указаны значения x , по столбцам – значения y (или наоборот), а на пересечении строки x i и столбца y j записано количество раз, которое наблюдалась пара xi , y j . Это количество будем обозначать числом nij . Например, допустим, что мы наблюдали возраст x студентов и курс y , на котором они учатся, и записывали данные в таблицу (пустые клетки – нули): y 1 2 17 10 2 18 3 15 1 2 10 3 3 8 1 2 9 x 19 20 21 22 3 4 5 1 Количество наблюдений – 70 ( n 70 ). Количество различных значений параметра x – 6 (обозначим n x 6 ). Количество различных значений параметра y – (обозначим n y 5 ). Теперь мы хотим ответить на вопрос, связаны ли между собой величины x и y статистической зависимостью? Или же данные параметры (возраст и курс) никак не связаны. Для ответа на этот вопрос вычисляется коэффициент корреляции. nij xi y j n x y rxy ij n x y . Этот коэффициент может принимать значения между 1 и 1 . Если величины x и y независимы, то rxy 0 . Чем ближе абсолютное значение коэффициента корреляции к 1, тем больше зависимость. Рассчитаем корреляцию для нашего примера. Первая сумма – это сумма по всем парам, нужно перемножить значение x i на значение y j и на число nij , равное числу раз, которое наблюдалась пара xi , y j . Считаем: nij xi y j 17 1 10 17 2 2 18 1 3 18 2 15 18 3 1 19 2 2 19 3 10 ij 19 4 3 20 3 3 20 4 8 20 5 1 21 4 2 21 5 9 22 5 1 3903. Теперь нужно посчитать среднее значение x . Для этого нужно найти сумму произведений всех значений x i на количество раз, которое это x i встречается, а затем поделить результат на n 70 : x 17 12 18 19 19 15 20 12 21 11 22 1 18.91 . 70 Аналогично вычисляем y : y 1 13 2 19 3 14 4 13 5 11 2.86 . 70 Теперь посчитаем среднеквадратическое отклонение для x : 17 2 12 18 2 19 19 2 15 20 2 12 212 11 22 2 1 x 18.912 1.37 . 70 и для y – x 12 13 2 2 19 32 14 4 2 13 52 11 2.26 2 1.34 . 70 В итоге, rxy 3903 70 18.91 2.86 0.91. 70 1.37 1.34 Значение коэффициента корреляции близко к 1, и это означает, что связь между возрастом и курсом, на котором учатся студенты, весьма существенная. Однако не стоит впадать в заблуждение, что связь между наблюдениями может быть прямой и столь же очевидно, как получается в нашем примере. Классический пример, который предотвращает от заблуждений, заключается в следующем: будем измерять длину стопы человека и его уровень интеллекта. При это корреляция будет сильной – это факт, но зависимости здесь, очевидно, прямой нет. Дело в том, что дети (у которых длина стопы меньше, чем у взрослых) в среднем хуже отвечают на вопросы тестов на интеллект, чем взрослые (для которых эти тесты обычно и делают). Поэтому величины связаны статистически, но вовсе не напрямую. Таким образом, корреляционный анализ важно правильно применить, доказав, в первую очередь, что связь между величинами прямая, а не косвенная. Проверка статистических гипотез Понятие «статистической гипотезы», ошибки первого, второго рода Пусть имеется некоторая генеральная совокупность. Нам нужно узнать закон её распределения. В этом случае делают предположение: элементы распределены по закону «A». Это и есть статистическая гипотеза, в данном случае – это предположение о распределении генеральной совокупности. Иногда мы знаем закон распределения, но не знаем параметров этого закона (например, не знаем математического ожидания или дисперсии и не можем найти их для всей генеральной совокупности). В этом случае, мы можем выдвинуть гипотезу о том, что неизвестный параметр равен «Б». Это тоже статистическая гипотеза. Вообще, статистическая гипотеза – это предположение о виде распределения или о параметрах известного распределения. Поэтому, например, «на Марсе есть жизнь» не является гипотезой, так как нигде не идет речь о предположении относительно каких-то распределений или их параметров. Нулевой (основной) гипотезой называют выдвинутую в первую очередь гипотезу H 0 . Конкурирующей (альтернативной) называют любую другую гипотезу, противоречащую нулевой. Конкурирующих гипотез может быть несколько: H 1 , H 2 , … Например, если нулевая гипотеза состоит из предположения, что «математическое ожидание равно 10», то альтернативными могут быть: «математическое ожидание меньше 10» или «математическое ожидание больше 10». Гипотеза называется простой, если она содержит только одно предположение, например, « a 10 », сложная гипотеза состоит из нескольких предположений, например, « 9 a 11 » (здесь указано бесчисленной множество значений между 9 и 11). Выдвинутая гипотеза может оказаться правильной или неправильной. Поэтому гипотезу нужно проверить. Делается это статистическими методами (поэтому называется «статистическая гипотеза»). После проверки возможны четыре ситуации: мы примем правильную гипотезу, не примем правильную гипотезу, примем неправильную гипотезу и не примем неправильную гипотезу. В двух из этих случаев мы сделаем ошибку. Ошибка первого рода – это отвержение правильной гипотезы. Ошибка второго рода – принятие неправильной гипотезы. Обе ошибки могут иметь катастрофические последствия. Например, если в результате проверки гипотезы принято неправильное решение (ошибка II рода) «продолжать строить дом», то могут пострадать люди, которые в нём поселятся. Если не принята правильная гипотеза (ошибка I рода) о том, что «у пациента аппендицит» и не делать операцию, то пациент может умереть. Статистический критерий, критическая область Для проверки статистического критерия используют специально подобранную случайную величину, распределение которой известно. Все такие специальные величины имеют специальные названия и обозначения. Например, U или Z – нормальное распределение, F или v 2 – распределение по закону Фишера. T – закон Стьюдента, 2 – закон «хи-квадрат». Поскольку нам сейчас не важно, какую из этих величин мы будем использоваться, давайте обозначим её через K . Статистическим критерием называется случайная величина, распределённая по закону K , которая служит для проверки нулевой гипотезы. Например, когда проверяют гипотезу о равенстве дисперсий двух генеральных совокупностей, то в качестве критерия K принимают отношение исправленной (несмещенной) и выборочной дисперсии: s12 K 2. s2 Эта величина действительно случайно, так как разные опыты дают разную дисперсию. Распределение этой величины, оказывается, подчиняется закону Фишера (но об это позже). Наблюдаемое значение критерия – обозначается K íàáë – это значение, полученное по выборкам. Например, если в нашем примере, для двух генеральных совокупностей мы сделали две выборки и получили выборочные несмещенные дисперсии s12 20 и s22 5 , то K íàáë s12 20 4. s 22 5 Посчитав значение критерия, нужно определиться, принимаем ли мы нулевую гипотезу или отвергаем. При некоторых значениях критерия гипотеза принимается, а при других – отвергается. Критической областью называют совокупность значений критерия, при которых нулевую гипотезу отвергают. Область принятия гипотезы – это совокупность значений критерия, при которых нулевую гипотезу принимают. Основной принцип проверки гипотез – вычислить значение критерия и определить область, в которую попало это значение. Критическая область и область принятия гипотезы – это интервалы. Они разделены точками, которые называются критическими. Рассмотрим, как устроены области. Бывают односторонние и двусторонние области. Уровень значимости, односторонние, двусторонние области Итак, критические области бывают двух типов: односторонние (правосторонние и левосторонние) и двусторонние. Правосторонняя область: когда критическая область определяется неравенством K k êð , где kêð – критическая точка (положительное число): Критическая область 0 Левосторонняя область: когда K k êð критическая область определяется неравенством K k êð , где kêð – критическая точка (отрицательное число): Критическая область k êð 0 K Двустороння область определяется неравенствами K k1 и K k 2 , где k1 и k 2 – критические точки, причем k1 k 2 : Критическая область Критическая область k1 0 k2 K На самом деле, поиск критической области – одна из самых сложных задач. Для её решения используют специальный параметр – уровень значимости . Критическую точку выбирают так, чтобы нулевая гипотеза (при условии её справедливости) будет отвергнута с вероятностью . Рассмотрим простой пример. Пусть область у нас правосторонняя. Пусть уровень значимости мы выбрали равным 0.05 . Теперь нужно отыскать k êð таким образом, чтобы вероятность того, что K k êð была равна 0.05 : P( K k êð ) 0.05 . То есть этим равенством мы требуем, чтобы вероятность ошибки I рода при проверки гипотезы была равна 5%. При каких k êð это происходит? Все зависит от распределения критерия K , существуют специальные таблицы, в которых написано, при каких уровнях значимости какие нужно выбирать k êð и в каком случае. Мощность критерия – это вероятность не совершить ошибку II рода. Обозначается . Это вероятность, что мы отвергнем нулевую гипотезу, когда справедлива конкурирующая. Пример проверки гипотезы Будем проверять гипотезу о равенстве дисперсий двух генеральных совокупностей. Такая задача возникает, когда нужно сравнить точность вычислений приборов и выбрать тот, который даёт наименьшее рассеяние при измерениях (наименьшую дисперсию). Пусть генеральные выборки X и Y распределены нормально. Извлечём из этих генеральных совокупностей небольшие выборки из n1 и n 2 элементов. Найдем исправленные выборочные дисперсии s X2 и sY2 . Выдвигаем нулевую гипотезу (дисперсии генеральных совокупностей равны): H 0 : D X DY В качестве критерия проверки нулевой гипотезы берут критерий Фишера со степенями свободы k1 n1 1 и k 2 n2 1 : отношение большей дисперсии к меньшей – 2 S áîëüøàÿ F 2 . S ìåíüøàÿ Критическая область вычисляется в зависимости от вида конкурирующей гипотезы. Если конкурирующая гипотеза H 1 : D X DY , то строят правостороннюю область, если H 1 : D X DY , то левостороннюю. В первом случае, если F k êð , то нулевую гипотезу отвергают. Во втором случае её отвергают, когда F k êð . Есть третий случай, когда H1 : D X DY , в этом случае нужно строить двустороннюю область. Такие примеры будут рассмотрены на уроках практики. Пример. n1 12 , n2 15 , s X2 11.41 , sY2 6.52 . Пусть уровень значимости 0.05 . Проверим гипотезу H 0 : D X DY при конкурирующей гипотезе H 1 : D X DY . Вычисляем наблюдаемое значение критерия: 2 S áîëüøàÿ 11.41 F 2 1.75 . 6.52 S ìåíüøàÿ Конкурирующая гипотеза говорит о том, что дисперсия X больше, значит критическая область правосторонняя. В таблице распределения Фишера указано, что при 0.05 и при k1 11 , k 2 14 критическая точка равна k êð 2.56 . У нас получается, что F k êð , значит нет оснований отвергать нулевую гипотезу. Дисперсионный анализ Общие представления о дисперсионном анализе Пусть имеется несколько генеральных совокупностей X 1 , X 2 , …, X p . Пусть они распределены нормально и имеют одинаковую (возможно, неизвестную) дисперсию. Математические ожидания также неизвестны, но могут быть различными. Требуется при заданном уровне значимости проверить гипотезу H 0 : EX1 EX 2 EX p о равенстве всех математических ожиданий. Когда p не очень велико, проблем нет – можно сравнивать совокупности по парам (каждую с каждой), однако при большом количестве генеральных совокупностей, увеличивается разброс средних значений, поэтому для таких гипотез используют сравнение дисперсий. Поэтому такое название – дисперсионный анализ. На практике дисперсионный анализ применяют, когда хотят определить, влияет ли некоторых качественных фактор F (например, характеристика мобильного телефона), который имеет p уровней (например, цвет, вес, толщина), на изучаемую величину X (например, уровень продаж телефонов). Основная идея состоит в сравнении факторной дисперсии (порождаемой фактором) и остаточной дисперсии (порождаемой случайными причинами). Если различие между этими дисперсиями значимо, то фактор оказывает существенное влияние; в этом случае средние наблюдаемые значения на каждом уровне сильно различаются. Если разница небольшая, то все влияния считаются случайными. Однофакторный дисперсионный анализ Пусть на количественный признак X воздействует фактор F , имеющий p уровней. Пусть проведено q испытаний на каждом уровне. Для испытания номер i на уровне j было получено xij значений. Эти данные записываются в таблицу: № испытания Уровни фактора 1 2 … p 1 x11 x12 … x1 p 2 x21 x21 … x2 p … … … … … q xq1 xq1 … x qp x ãð,1 x ãð, 2 … x ãð, p Групповое среднее В последней строке записаны средние значения по столбцам – групповые средние. Всего в таблице n pq элементов. Введем общую дисперсию: q p Dîáù ( xij x) 2 , i 1 j 1 где x – это общее среднее (среднее всех чисел xij в таблице). Факторная дисперсия – это суммарное отклонение групповой средней от общей средней: p Dôàêò q ( xãð, j x) 2 . j 1 Остаточная дисперсия вычисляется по формуле Dîñò Dîáù Dôàêò . Метод дисперсионного анализ состоит в том, чтобы проверить гипотезу о равенстве факторной и остаточной дисперсии . Для этого, вычисляют 2 sôàêò Dôàêò p 1 è 2 sîñò Dîñò . p (q 1) и считают отношение Fíàáë 2 sôàêò 2 sîñò . Критическую область на заданном уровне значимости выбирают из таблицы распределения Фишера. Экзаменационные вопросы Готовятся… Список использованных источников [1] Гмурман В. Е. Теория вероятностей и математическая статистика. М. : «Высшая школа», 2003.