ТМ к лекции 14 (Корреляционный анализ)

advertisement

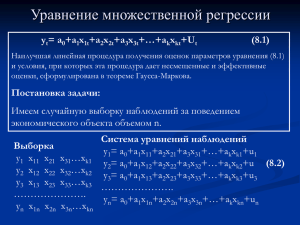

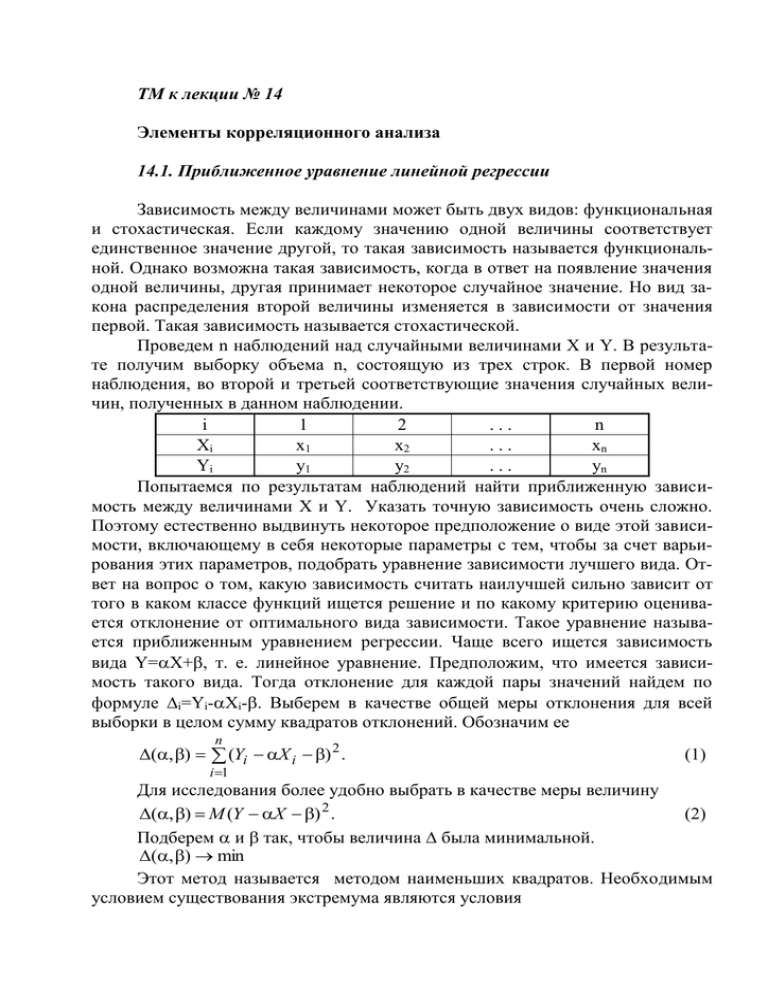

ТМ к лекции № 14 Элементы корреляционного анализа 14.1. Приближенное уравнение линейной регрессии Зависимость между величинами может быть двух видов: функциональная и стохастическая. Если каждому значению одной величины соответствует единственное значение другой, то такая зависимость называется функциональной. Однако возможна такая зависимость, когда в ответ на появление значения одной величины, другая принимает некоторое случайное значение. Но вид закона распределения второй величины изменяется в зависимости от значения первой. Такая зависимость называется стохастической. Проведем n наблюдений над случайными величинами X и Y. В результате получим выборку объема n, состоящую из трех строк. В первой номер наблюдения, во второй и третьей соответствующие значения случайных величин, полученных в данном наблюдении. i 1 2 ... n Xi x1 x2 ... xn Yi y1 y2 ... yn Попытаемся по результатам наблюдений найти приближенную зависимость между величинами X и Y. Указать точную зависимость очень сложно. Поэтому естественно выдвинуть некоторое предположение о виде этой зависимости, включающему в себя некоторые параметры с тем, чтобы за счет варьирования этих параметров, подобрать уравнение зависимости лучшего вида. Ответ на вопрос о том, какую зависимость считать наилучшей сильно зависит от того в каком классе функций ищется решение и по какому критерию оценивается отклонение от оптимального вида зависимости. Такое уравнение называется приближенным уравнением регрессии. Чаще всего ищется зависимость вида Y=X+, т. е. линейное уравнение. Предположим, что имеется зависимость такого вида. Тогда отклонение для каждой пары значений найдем по формуле i=Yi-Xi-. Выберем в качестве общей меры отклонения для всей выборки в целом сумму квадратов отклонений. Обозначим ее n (, ) (Yi X i ) 2 . (1) i 1 Для исследования более удобно выбрать в качестве меры величину (2) (, ) M (Y X ) 2 . Подберем и так, чтобы величина была минимальной. (, ) min Этот метод называется методом наименьших квадратов. Необходимым условием существования экстремума являются условия (, ) 0, (3) (, ) 0. Запишем условия (3) (, ) (4) 2M (Y X ) X 0. (, ) (5) 2M (Y X ) 0. Из уравнения (5) находим =MY-MX Из уравнения (4) получим M(XY)-MX2-( MY-MX)MX=0. Или M(XY)- MY MX-(M(X2)-( MX)2)=0. Откуда находим Cov(X,Y)- DX=0. Следовательно rXYXY- X2=0. Получаем rXY Y . X И приближенное линейное уравнение регрессии Y на X Y X X MY MX . Или Y MY rXY Y ( X MX ). (6) X Аналогично, приближенное линейное уравнение регрессии X на Y X MX rXY X (Y MY ). (7) Y Замечание. Уравнение (7) не равносильно уравнению (6). Они задают разные линии. При практических исследованиях для построения уравнения (6) используют статистические числовые характеристики. Y (8) Y M Y rXY ( X M X ). X Причем в качестве статистической числовой оценки для ковариации используем 1 n (( X i M X )(Yi M Y )). n 1 i 1 Коэффициент корреляции показывает меру линейной зависимости между случайными величинами X и Y. Cov ( X , Y ) 14.2. Множественная регрессия Пусть дана система случайных величин X1,X2,...,Xk,Y. Попытаемся отыскать зависимость вида Y 1 X 1 2 X 2 ... k X k . (9) Найдем математическое ожидание от обеих частей уравнения (9) MY 1 MX 1 2 MX 2 ... k MX k . (10) Вычтем Y MY 1 ( X 1 MX 1 ) 2 ( X 2 MX 2 ) ... k ( X k MX k ). (11) Введем меру отклонения M (1 ( X 1 MX1 ) 2 ( X 2 MX 2 ) ... k ( X k MX k ) (Y MY )) 2 . (12) Предположим, что знак математического ожидания и дифференцирования можно менять местами. После дифференцирования получим систему 1M ( X 1 MX 1 ) 2 2 M ( X 2 MX 2 )( X 1 MX 1 ) ... k M ( X k MX k )( X 1 MX 1 ) M (Y MY )( X 1 MX 1 ). 1 M ( X 1 MX 1 )( X 2 MX 2 ) 2 M ( X 2 MX 2 ) 2 ... k M ( X k MX k )( X 2 MX 2 ) M (Y MY )( X 2 MX 2 ). . . . . . . . . . . . (13) 1M ( X 1 MX1 )( X k MX k ) 2 M ( X 2 MX 2 )( X k MX k ) ... k M ( X k MX k ) 2 M (Y MY )( X k MX k ). Мы получили систему из k уравнений с k неизвестными. Матрица коэффициентов системы называется ковариционной матрицей. Если каждый коэффициент матрицы разделить на произведение соответствующих среднеквадратичных отклонений, то получим корреляционную матрицу. Решим систему (13) и найдем коффициенты при неизвестных равенства (9). Подставим найденные значения в (10) и найдем . А затем построим зависимость (9). Уравнение (9) называется уравнением множественной регрессии, Для статистического исследования системы случайных величин X1,X2,...,Xk,Y. Проведем n наблюдений над случайными величинами. В результате получим выборку объема n, которую удобно представить в виде таблицы i X1 X2 . . . Xk Y 1 X11 X12 . . . X1k Y1 2 X21 X22 . . . X2k Y2 . . . . . . . . . . . . . . . . . . n Xn1 Xn2 . . . Xnk Yn Построим по этой таблице ковариации величин системы (13) и найдем уравнение множественной регрессии. 14.3. Приближенное полиномиальное уравнение регрессии Часто требуется зависимость зависимости между случайными величинами X и Y в виде некоторого полинома (многочлена) вида Y=a0+a1X+a2X2+... + anXn. Этот случай сводится к рассмотренной схеме множественной регрессии с помощью следующего приема. Вводится система величин X0 =X0, X1 =X1, X2 =X2,..., Xn =Xn. После этого проводим корреляционный анализ по схеме множественной регрессии и находим коэффициенты многочлена.