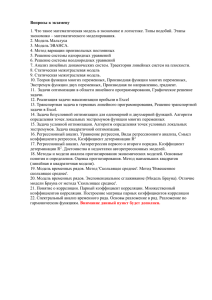

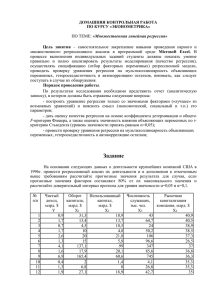

Математико-статистические методы обработки информации

реклама