Содержание - Группа моделирования в нелинейной динамике

реклама

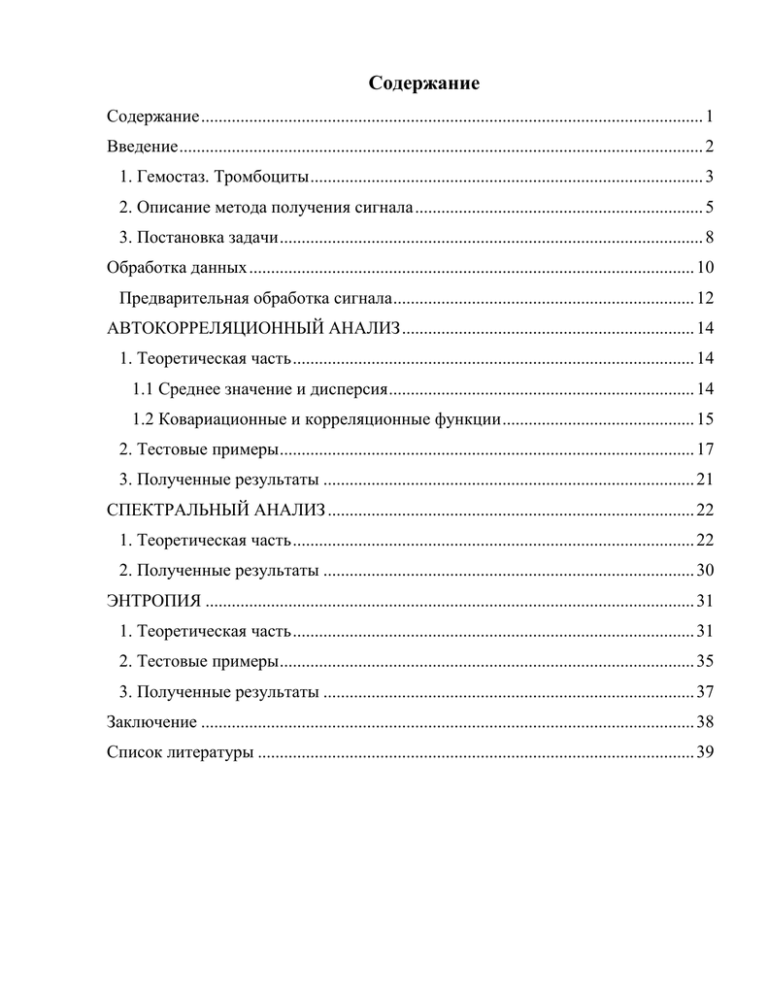

Содержание

Содержание ................................................................................................................... 1

Введение ........................................................................................................................ 2

1. Гемостаз. Тромбоциты .......................................................................................... 3

2. Описание метода получения сигнала .................................................................. 5

3. Постановка задачи ................................................................................................. 8

Обработка данных ...................................................................................................... 10

Предварительная обработка сигнала ..................................................................... 12

АВТОКОРРЕЛЯЦИОННЫЙ АНАЛИЗ ................................................................... 14

1. Теоретическая часть ............................................................................................ 14

1.1 Среднее значение и дисперсия ...................................................................... 14

1.2 Ковариационные и корреляционные функции ............................................ 15

2. Тестовые примеры ............................................................................................... 17

3. Полученные результаты ..................................................................................... 21

СПЕКТРАЛЬНЫЙ АНАЛИЗ .................................................................................... 22

1. Теоретическая часть ............................................................................................ 22

2. Полученные результаты ..................................................................................... 30

ЭНТРОПИЯ ................................................................................................................ 31

1. Теоретическая часть ............................................................................................ 31

2. Тестовые примеры ............................................................................................... 35

3. Полученные результаты ..................................................................................... 37

Заключение ................................................................................................................. 38

Список литературы .................................................................................................... 39

Введение

Заболевания сердечно сосудистой системы лидируют среди причин

инвалидности и смертности населения. При этом одним из основных факторов

риска являются тромбозы различных сосудов: от самых малых капилляров до

крупных артерий и вен. Объектом рассмотрения данной работы является

динамика агрегации тромбоцитов in vitro. Исходя из того, что организм — это

очень сложная система, сам процесс агрегации тромбоцитов требует детального

анализа.

Среди

причин

возникновения

тромбозов

находятся

повреждения

сосудистой стенки, сужение просвета сосудов, изменение состава плазмы и ряд

других. В настоящее время разработано множество подходов к диагностике

тромбозов. Однако наряду с классическими и повсеместно используемыми

методиками внедрение новых цифровых методов сбора и обработки данных

позволит

получить

дополнительную

информацию

о

механизмах

тромбообразования, что позволит более эффективно лечить и предотвращать

тромбозы на ранней стадии.

Имея совершенные методы диагностики, можно будет бороться с данной

проблемой на более высоком уровне.

2

1. Гемостаз. Тромбоциты

Гемостаз — это сложная биологическая система приспособительных

механизмов, которые обеспечивают с одной стороны поддержание жидкого

состава крови в сосудистом русле, а с другой — остановку кровотечения из

поврежденных сосудов за счет быстрого их тромбирования.

В настоящее время принято различать сосудисто-тромбоцитарный и

гемокоагуляционный механизмы гемостаза.

Сосудисто-тромбоцитарный

механизм

осуществляется

преимущественно при повреждении сосудов микроциркуляторного русла, т.к.

они характеризуются малым диаметром и низкой скоростью кровотока.

Остановка кровотечения происходит за счет трех механизмов:

1. Образования тромбоцитарной пробки (так называемый белый тромб);

2. Рефлекторного спазма сосудов;

3. Сочетания первых двух механизмов.

Что касается гемокоагуляционных механизмов гемостаза, то они

осуществляются при повреждении более крупных сосудов за счет свертывания

крови при переходе растворимого белка плазмы крови фибриногена в

нерастворимое состояние — фибрин. Последний образует плотную сеть, в

которую попадают форменные элементы (преимущественно эритроциты).

Полноценная гемостатическая функция организма возможна только в

условиях взаимодействия сосудисто-тромбоцитарного и гемокоагуляционного

механизмов гемостаза.

Огромное значение в механизмах гемостаза играют тромбоциты.

Тромбоциты (кровяные пластинки) — мельчайшие клетки крови,

лишённые ядра, чаще имеющие форму диска, в большом количестве

циркулирующие в крови.

3

Тромбоциты обладают следующими свойствами:

1. Легкая разрушаемость;

2. Фагоцитоз;

3. Амебовидная подвижность;

4. Адгезия — способность прилипать к чужеродной поверхности;

5. Агрегация — способность тромбоцитов склеиваться между собой;

Адгезия является пассивным процессом, т.е. идущим без затраты энергии.

В качестве чужеродной поверхности часто выступает собственная измененная

сосудистая стенка. Это специфический процесс осуществляется за счет

рецепторов мембраны тромбоцитов, чувствительных к фибронектину и

факторам фон Веллибрандта.

Агрегация — напротив активный процесс с затратой энергии. Процесс

агрегации проходит в несколько фаз, в совокупности которых освобождаются

тромбоцитарные факторы, запускающие свертывание крови. В конечном итоге

происходит образование белого тромба.

В организме существуют механизмы рассасывания тромбов, которые

делятся на благоприятные и неблагоприятные. К благоприятным можно отнести

замещение сгустка соединительной тканью (в случае повреждения стенки

сосуда) или такой процесс, как васкуляризация, то есть прорастание тромба

сосудами. К неблагоприятным относятся отрыв тромба, что чревато закупоркой

просвета сосуда или рассасывание тромба при участии микроорганизмов, что

грозит сепсисом и кровотечением.

Как видно, агрегация тромбоцитов играет большую роль в процессе

тромбообразования, поэтому важным является ее детальное изучение.

4

2. Описание метода получения сигнала

Тромбоциты играют важную роль в пусковых механизмах гемостаза. Их

способность агрегировать после действия физиологических агентов является

объектом

многочисленных

исследований.

В

настоящее

время

широко

применяется оптический метод, основанный на изменении светопропускания

суспензии тромбоцитов в плазме крови, предложенный в работе [1]. Метод

основан на анализе флюктуаций светопропускания образца суспензии,

вызванных изменением числа частиц в оптическом канале устройства.

Для проведения эксперимента у крыс проводится забор венозной крови

непосредственно из правых полостей сердца. В качестве антикоагулянта

используется гепарин (40 Ед/мл). Затем центрифугированием при 1000 об/мин в

течение 7 минут получают обогащенную тромбоцитами плазму (ОТП),

начальное светопропускание которой принимается за 0%. В этот момент

времени тромбоциты в плазме крови находятся во взвешенном состоянии (как

бы по одному). Для этого в пробирку добавляют этилендиаминтетрауксусную

кислоту (ЭДТА). Светопропускание бедной тромбоцитами плазмы (БТП)

принимается

за 100%,

что

соответствует

ситуации,

когда

свободные

(непроагрегировавшие) тромбоциты в плазме отсутствуют. БТП получают

центрифугированием при 3000 об/мин в течение 7 минут.

Для реализации метода используется анализатор агрегации модели 230LA,

разработанный НПФ «Биола» — микропроцессорный прибор, предназначенный

для исследования агрегации кровяных пластинок (тромбоцитов) и других

клеток в суспензии.

Основные компоненты лазерного анализатора показаны на рисунке 1.

5

Рис.1: Блок-схема лазерного анализатора агрегации тромбоцитов.

Кювета с плазмой 3 устанавливается в термостатируемый блок 4.

Электромагниты 5 создают вращающееся магнитное поле. Полупроводниковый

лазер 1 с коллимирующей линзой 2 дает узкий пучок света, так что оптический

канал занимает малую часть образца. Мощность лазера поддерживается на

постоянном уровне высокостабильной электронной схемой. Таким образом,

интенсивность

света,

падающего

на

фотодиод

6

пропорциональна

светопропусканию образца, которое, в свою очередь, зависит от концентрации

тромбоцитов, от количества и размеров агрегатов. Ток фотодиода преобразуется

в напряжение усилителем 7. Это напряжение подается на входы фильтра низких

частот 8 и фильтра высоких частот 9. Фильтр низких частот выделяет медленно

меняющуюся компоненту оптического сигнала I. Фильтр высоких частот

выделяет флуктуации светопропускания, вызванные «случайным» изменением

числа частиц в оптическом канале. Сигнал с фильтра высоких частот поступает

на

выпрямитель 10,

выходное напряжение которого

пропорционально

среднеквадратическому отклонению светопропускания σ. Как I, так и σ

преобразуются в цифровую форму 8-и разрядным АЦП с частотою 0,33 Гц и

обрабатываются встроенным микроконтроллером (11), после чего полученный

сигнал подаётся в компьютер.

Использовали две сопоставимые группы нелинейных крыс с условными

названиями «стресс» и «контроль», насчитывавшие 27 и 58 самцов

6

соответственно. В каждую группу входили здоровые половозрелые самцы

приблизительно одного возраста и массы (180 – 220 гр). Забор крови

проводился при идентичных внешних условиях: температуре, давлении,

времени суток и времени года. Всё это позволяет говорить об обеспечении

достаточной степени повторяемости результатов, а значит, о возможности

рассмотрения набора данных как ансамбля реализаций одного процесса. У

первой группы кровь забиралась после трехчасовой иммобилизации на спине.

Примеры кривых светопропускания для обеих групп на Рис.2.

Рис.2. Сверху кривая светопропускания самца контрольной группы, снизу — стрессовой.

7

3. Постановка задачи

Агрегационные кривые могут дать некоторую картину свойств образца

плазмы. До настоящего момента существует методика, в соответствии с которой

по виду кривой определяются агрегационные свойства тромбоцитов. Однако

быстрая компонента сигнала при этом в расчёт не принимается совсем,

поскольку считается шумовым сигналом, обусловленным влиянием многих

случайных факторов, а главное — равенством скорости агрегации и

дезагрегации. В то же время, на наш взгляд, эта «бахрома» на кривой

светопропускания может иметь существенный интерес, поскольку, возможно,

отражает не только случайные колебания, но и содержит детерминированную

компоненту, на основе которой можно выявить дополнительную информацию о

характере наблюдаемого сигнала и, как следствие, лежащих в основе процессов.

Рис.3. На графике светопропускания выделена часть кривой,

содержащая быструю компоненту динамики.

8

Задача состоит в том, чтобы выяснить: отражение это какой-либо

динамики

или

это

абсолютно

случайный

несовершенствами метода.

9

процесс,

связанный

с

Обработка данных

В процессе выполнения эксперимента были получены данные, для

предварительной обработки которых была написана программа для расчета и

отображения графически автокорреляционной функции, работающая по

следующему алгоритму:

1. Читает из текстового файла данные и записывает их в массив чисел;

2. Строит график светопропускания суспензии тромбоцитов в плазме

крови;

3. Высчитывает среднее значение в скользящем окне светопропускания,

вычитает

его

из

соответствующей

кривой

(производит

детрендирование), записывает значения в текстовой файл и строит

график без линейного тренда;

4. Считает для быстрой компоненты автокорреляционную функцию для

сдвига , записывает значения в текстовой файл и строит график;

Для проверки значений автокорреляционной функции и проведения

спектрального анализа, в частности построение периодограмм, использовался

стандартный пакет алгоритмов.

Также была написана программа для вычисления значения энтропии,

работающая по следующему алгоритму:

1. Читает из текстового файла данные и записывает их в массив чисел;

2. Строит функцию распределения, для чего сортирует массив чисел по

возрастанию;

3. Используя

отсортированный

массив,

распределения;

4. Производит расчет значения энтропии;

10

строит

график

плотности

Основной проблемой при проведении данных методов анализа являлись

короткие временные реализации. В связи с этим возникла необходимость

систематизировать данные. Для наглядности и простоты их дальнейшего

использования данные были представлены набором графиков.

В результате данной систематизации были отобраны временные ряды с

наибольшей продолжительностью, которые далее и использовались.

11

Предварительная обработка сигнала

На первом этапе необходимо переписывать значения светопропускания в

текстовый файл в столбец, т.к. программа, производившая запись и оцифровку,

записывала их в строку, что неудобно при работе с графическими

приложениями. Для этого была написана программа, которая переписывает

значения светопропускания в столбец и строит соответствующий график. Как

правило, кривую характеризует наличие резкого подъема, фазы плато, которая и

представляет интерес, и плавный спад.

Наблюдаемый динамику светопропускания, представленную измеренным

временным рядом, можно достаточно чётко разделить на две компоненты:

медленную, отражающую процесс агрегации и дезагрегации тромбоцитов в

среднем в макрообъеме и быструю, характеризующую более тонкие механизмы

и имеющую существенно меньшую амплитуду. Поскольку нас интересует

именно эта вторая низкоамплитудная компонента, процесс агрегации в среднем

рассматривался нами в качестве тренда.

Под трендом, как правило, подразумевается непереодическое изменение

среднего, например его линейный рост. Таким образом, детрендирование (т.е.

удаление тренда) — это приведение сигнала к стационарному в смысле его

среднего (при этом сигнал может остаться нестационарным относительно

моментов высших порядков).

Для того чтобы избавится от медленно меняющейся компоненты и

оставить быструю компоненту сигнала, новый сигнал ζ строится путем

вычитания из старого η скользящего среднего, построенного на промежутке

T

2

[ t ;t

T

]:

2

n n

1 n L / 2

i

L 1 i n L / 2

Результат вычитания линейного тренда имеет характерный вид,

представленный на рисунке 4.

12

(1)

Рис.4: Вычитание линейного тренда (контрольный самец 2)

13

АВТОКОРРЕЛЯЦИОННЫЙ АНАЛИЗ

1. Теоретическая часть

1.1 Среднее значение и дисперсия

Средним значением случайного процесса X(t) называется интеграл

x E X xp ( x)dx .

(2)

Дисперсией случайного процесса X(t) называется интеграл

E ( X x ) ( x x ) 2 p( x)dx .

2

x

2

(3)

Среднее значение и дисперсию вычислить несложно. Однако при

проведении вычислений на компьютере иногда возникают неожиданные

проблемы. Кроме того, на практике обычно неизвестна плотность вероятности

p(x) и, следовательно, расчет по формулам (2) и (3) невозможен.

Среднее значение можно оценить простым усреднением всех значений

временного ряда:

1 N

xi .

N i 1

(4)

Здесь N – количество независимых наблюдений (размер выборки).

Оценку

дисперсии

чаще

всего

производят

по

формуле

расчёта

выборочной дисперсии:

1 N 1

( xi ) 2 ,

N 1 i 0

2

(5)

которая является наименее чувствительной к ошибке округления, поскольку

даёт асимптотически несмещённую оценку.

14

1.2 Ковариационные и корреляционные функции

Ковариацией случайных величин X и Y, которые соответственно могут

принимать значения x и y, называется интеграл

R E XY

xyp( x, y)dxdy.

(6)

Если средние значения случайных величин отличны от нуля, то

вычисления удобнее проводить, предварительно перейдя к центрированным

случайным величинам. В этом случае пользуются понятием корреляции.

Корреляцией двух центрированных случайных величин (X–E[X]) и

(Y–T[Y]) называется интеграл

C E( X EX )(Y EY )

( x x )( y y ) p( x, y)dxdy .

(7)

Корреляция (или ковариация) двух случайных величин показывает

степень линейной зависимости этих величин друг от друга. С практической

точки зрения отличие этих характеристик лишь в том, что ковариация содержит

полную информацию о средней энергии процесса, тогда как корреляция теряет

часть информации при удалении среднего значения.

Если в качестве случайных величин выбрать два значения одного

процесса в различные моменты времени, то эти значения будут сильно

коррелированны, когда моменты времени очень близки друг к другу, поскольку

случайная величина не может за короткое время существенно измениться.

Корреляция между двумя величинами в далеко отстоящие друг от друга

моменты времени мала, так как за такое время случайные величины могут

претерпевать практически любые изменения.

Для

случайных

процессов

вводят

понятия

корреляционных

и

ковариационных функций, аргументом которых в случае стационарных

случайных процессов является временной интервал , разделяющий два

15

выборочных значения случайных процессов. Если случайные величины

являются значениями одного и того же случайного процесса, например,

процесса X(t), то указанная функция называется автокорреляционной. Она

рассчитывается по формуле:

C xx ( ) E( X 1 E X )( X 2 EX )

( x1 x )( x2 x ) p( x1 , x2 , )dx1dx2 (8)

В подавляющем большинстве практических случаев автокорреляционная

функция не может быть вычислена по формуле (8).

Пусть случайный процесс X(t) наблюдается в течение интервала времени

от 0 до T секунд, т.е. имеется выборка x(t). Тогда корреляционную функцию

можно оценить по формуле:

1

C xx ( )

T

T

( x(t ) x )( x(t ) x )dt ,

(9)

0

в которых 0 T . Время усреднения равно T , а не Т, поскольку

выборочная

функция

охватывает

только

часть

наблюдаемых

данных,

включающих как x(t), так и x(t+ ). Итак, чтобы оценить, например,

ковариационную функцию, следует сдвинуть реализацию на время ,

перемножить исходную и сдвинутую реализации и усреднить полученное

произведение по всей реализации или по некоторому её отрезку. Эта процедура

выполняется для всех требуемых значений сдвига времени .

На практике выполнить интегрирование в формуле (9) невозможно, т.к.

математическое выражение для x(t) обычно неизвестно. В этом случае интеграл

аппроксимируют суммой выборок из непрерывной функции в определенные

моменты времени. Таким образом, если выборки из исследуемой реализации

x(t) соответствуют моментам времени 0, t ,2t ,..., Nt и если их значения равны

x0 , x1 , x2 ,..., x N , то дискретным эквивалентом выражения (9) будет следующая

формула:

N n

1

С xx (nt )

( xk x )( xk n x ) ,

N n 1 k 0

Здесь n=0,1,2,…,M; M<<N.

16

(10)

2. Тестовые примеры

1) В качестве примера использовался ряд синусоиды. Аналитически

можно показать, что автокорреляционной функцией для синуса будет

косинус. Численный расчет, показанный на рис.5 дает такой же

результат.

Одно из свойств автокорреляционной функции состоит в том, что если

исходный временной ряд является периодическим случайным процессом

(содержит периодическую составляющую), то автокорреляционная функция так

же будет периодической функцией с таким же периодом.

Рис.5: График временного ряда синусоиды (верхний рис.) График

автокорреляционной функции этой синусоиды (нижний рис.).

17

18

2) Еще одним примером послужил ряд синусоиды с добавлением

нормального белого шума. На графике автокорреляционной функции

видно вначале резкое спадание до значения 0,5, а потом колебания

косинусоидальной формы (рис.6.).

Рис.6: График временного ряда синусоиды с добавлением шума (верхний рис.)

График автокорреляционной функции этой синусоиды (нижний рис.).

19

3) В качестве ещё одного примера использовался нормальный шум. Т.к.

на графике исходного временного ряда наблюдается непериодический

процесс, то автокорреляционная функция для этого временного ряда

быстро спадает до нуля.

Рис.7: График временного ряда нормального шума (верхний рис.)

График автокорреляционной функции исходного ряда (нижний рис.).

20

3. Полученные результаты

В большинстве случаев

при расчете автокорреляционной функции,

которая показывает степень линейной зависимости двух случайных величин

одного процесса, были получены схожие результаты среди отобранного

количества самцов. Характерным является быстрый спад c последующим

проявлением периодичности.

Таким образом, наблюдаемый процесс, по крайней мере, с точностью,

определяемой разрешением прибора, имеет периодическую (регулярную)

линейную компоненту, т.е. явно отличен от шума.

Рис.8: Графики значений автокорреляционной функции для

самцов из двух групп (пояснения в тексте).

21

СПЕКТРАЛЬНЫЙ АНАЛИЗ

1. Теоретическая часть

Спектр мощности

С помощью спектрального анализа можно охарактеризовать частотный

состав исследуемого временного ряда. Математической основой, которая

связывает временной сигнал с его представлением в частотной области,

является преобразование Фурье.

Преобразование Фурье сигнала x(t ) имеет вид:

S ( f ) F [ x(t )]

x(t )e

j 2 f t

dt .

(11)

Для восстановления x(t ) по S ( f ) используется преобразование, которое так и

называется: обратное преобразование Фурье:

1

x(t ) F [ S ( f )]

S ( f )e

j 2 f t

dt .

(12)

На практике всегда имеют дело с дискретными временными рядами

конечной длины. Будем считать, что анализируемый временной ряд {xi }

эквидистантный.

Эквидистантными называют временные ряды, у которых интервалы

между последовательными выборками одинаковы.

Для рассмотрения таких данных в частотной области пользуются

дискретным преобразованием Фурье (ДПФ):

2

Sˆ ( f h )

N

N 1

x e

i 0

i

j 2 f h t i

,

(13)

22

где {xi } - анализируемый временной ряд длины N, i Z - безразмерное

дискретное время, ti , © — дискретное время, f h , (Гц) — дискретная частота.

Обратное преобразование имеет вид:

xi

M 1

Sˆ ( f

h 0

h

) e j 2 f h t i ,

(14)

где h Z называют номером гармоники, M- число гармоник, определяемое

длиной реализации:

N

, N 2n, n Z ,

2

M

N 1, N 2n 1, n Z ,

2

где оператор ... означает взятие целой части числа.

Гармоникой называют дискретную составляющую в спектре.

Используя формулу Эйлера:

z ae j a(cos j sin ) ,

(15)

преобразуем выражение (10):

2

Sˆ ( f h )

N

2

N

N 1

N 1

xi e j 2fhti

i 0

2

N

2

xi cos( 2f h t i ) j

N

i 0

N 1

x [cos( 2f t ) j sin( 2f t )]

i

i 0

h i

h i

(16)

N 1

x sin( 2f t ).

i 0

i

h i

Такая запись компактна и удобна для аналитических выкладок, но

вычисления на ЭВМ удобнее осуществлять с вещественными числами. Кроме

того, для решения ряда практических задач, оказывается, удобно раздельно

хранить в памяти ЭВМ действительную и мнимую части Sˆ ( f h ) , поэтому,

формулу (16) часто переписывают в виде:

23

Sˆ ( f h ) a f h jb f h ,

2

a f h Re Sˆ ( f h )

N

N 1

x

i 0

2

b f h Im Sˆ ( f h )

N

i

cos( 2f h t i ),

(17)

N 1

x sin( 2f t ).

i 0

i

h i

Выражения для действительной и мнимой частей можно упростить:

ah

N 1

2

N

x

i 0

2

bh

N

i

cos( 2f h t i )

2

N

N 1

x

i 0

N 1

2

xi sin( 2f h t i )

N

i 0

Таким

i

cos( 2h

1

2

it )

Nt

N

N 1

x

i 0

N 1

1

2

xi sin( 2h

it )

Nt

N

i 0

образом,

ДПФ

сводится

i

cos( 2hi / N ),

(18)

N 1

x

i 0

к

i

sin( 2hi / N ), h 0, M 1.

вычислению

действительных

коэффициентов a h и bh по формуле (17) или (18).

Используя введенные обозначения, обратное ДПФ можно записать, как:

xi

M 1

M 1

M 1

M 1

h 0

h 0

h 1

h 1

ah cos(2hi / N ) bh sin( 2hi / N ) a0 ah cos(2hi / N ) bh sin( 2hi / N ) (19)

Формула (19) позволяет выразить смысл ДПФ следующим образом: ДПФ

позволяет представить анализируемый ряд, в общем случае, сложной формы, в

виде конечной суммы гармонических функций.

Спектр мощности вычисляется по следующей формуле:

2

Sˆ ( f h ) a 2f h b 2f h .

(20)

Оценка спектра мощности по конечному дискретному временному ряду

(вместо бесконечного непрерывного сигнала) приводит к ряду проблем:

2. Конечная спектральная разрешающая способность.

Это расстояние в спектре по частоте между ближайшими гармониками.

Значения из временного ряда известны в дискретные моменты времени:

ti i t ,

(21)

где t , (с) — интервал дискретизации. Очевидно, что, анализируя временной

ряд конечной длительности N, снятый при конечной фиксированной частоте

24

дискретизации Fsamp 1t , различить 2 расположенные бесконечно близко

частоты в спектре, в отличие от непрерывного случая, невозможно. Более

того, можно показать, что для таких данных расстояние между ближайшими

частотами в спектре будет составлять:

f

Fsamp

N

1

.

N t

(22)

Соответственно, гармоники в дискретном преобразовании будут иметь

дискретные частоты:

f h h f .

(23)

Понятно, что чем меньше f , тем лучше спектральное разрешение. Из

формулы (22) видно, что спектральное разрешение улучшается, с

увеличением времени наблюдения, поэтому, в общем случае, анализ сигналов

стараются осуществлять по как можно более длинной реализации.

Рассмотрим временной ряд, состоящий из значений гармонической

функции xi A0 sin( 2if ) , А0 = 1; ∆t = 1/256 с; ν = 1 Гц.

По формуле (22) рассчитаем спектральное разрешение для временного

ряда длиной 0,7T, T, 10T, 10,25T, где T – характерный период синусоиды, T =

256. Получаются следующие значения:

Δf(0,7T) = 1,43 Гц; Δf(T) = 1 Гц; Δf (10T) = 0,1 Гц; Δf(10,25T) = 0,098 Гц.

Именно этим значением разрешающей способности объясняется ширина

столбца на периодограмме на рис.9. Видно, что на рис.1,б столбик шире, чем на

рис.9,в, это происходит из-за того, что Δf(T) = 1 Гц, а Δf (10T) = 0,1 Гц, т.е.

разрешающая способность лучше для временной реализации, длиной 10T.

25

Рис.9 Графики временных рядов и спектров мощности для рядов длительностью

а) меньше периода; б) ровно один период; в) десять периодов; г) 10,25 периода.

26

2. Эффект утечки является следствием конечности анализируемой

временной реализации. Рассматриваем тот же временной ряд.

Из рис.9 видно, что если на длине ряда укладывается целое число

периодов гармонических составляющих, то размывание спектра отсутствует.

На графиках спектров временных рядов, длительностью не кратной целому

числу периодов, появляются новые спектральные составляющие, а высота

пиков на частоте 1 Гц уменьшается.

При расчетах спектров используют, в основном, два способа борьбы с

эффектом утечки: специальный выбор частоты дискретизации и длины

обрабатываемого участка ряда и использование оконных преобразований.

Выбор частоты дискретизации и длины ряда должен обеспечивать целое

число

отсчетов

на

период

сигнала

и

целое

число

периодических

составляющих на длину ряда. Понятно, что на практике эти условия часто

выполнить затруднительно, а для непериодических (хаотических или

содержащих шум) сигналов невозможно. Поэтому, наиболее широкое

распространение получил метод оконных преобразований.

Суть метода очень проста: для уменьшения разрывов на краях ряда с

целью ослабления утечки нужно уменьшить амплитуду сигнала возле краев.

Такое масштабирование осуществляется в ходе умножения реализации на

окно специальной формы:

xiw xi W (i ) .

(24)

При теоретическом исследовании свойств оконных преобразований

принято считать, что анализируемая реализация длиной N получена

путем умножения исходной реализации на прямоугольное окно:

1, i [0, N 1),

W (i)

.

0, i (, 0) [ N , ).

(25)

27

Поэтому, упоминание в литературе сопоставления различных оконных

функций с прямоугольным окном подразумевает сопоставление реализаций,

умноженных на указанные окна, с исходной реализацией. Т.е. тот спектр

мощности, который мы строим, это не совсем спектр синусоиды, это свертка

сигнала и функции с прямоугольным окном. Сверткой двух (в общем случае,

бесконечных) временных рядов {hi } и {xi } называют операцию вида:

yi hi xi hk xik .

(26)

k 0

3. Эффект подмены (отражения, маскировки) частот является следствием

конечной частоты дискретизации цифрового сигнала и принципиально не

наблюдается для непрерывных во времени сигналов.

Максимальная частота, которую можно разрешить в спектре цифрового

сигнала не превышает частоты Найквиста Fн

дискретизации.

Существование

такой

частоты

1

, где ∆t – интервал

2t

следует

из

теоремы

Котельникова. Она гласит, что непрерывный сигнал x(t ) может быть

восстановлен по его бесконечному временному ряду {xi } однозначно только в

случае, если спектральный состав x(t ) ограничен, причем максимальная

частота в спектре сигнала не превышает Fн . В противном случае, возникают

ошибки маскировки частот, ведущие к неоднозначности.

В ДПФ (12) дискретные значения частот обозначим следующим образом: fk =

bk, где b 1 Nt . Спектр мощности для (12) имеет симметрию относительно

k

N

. Это определяется из условия fk = Fн:

2

k

1

N

или k .

Nt 2t

2

28

Отсюда следует, что частота Найквиста соответствует середине

последовательности Sˆ ( f h ) . Это означает, что значениям индексов k в

промежутке 0,…, N 2 соответствуют частоты, не превосходящие частоту

Найквиста. Величинам Sˆ ( f h ) при k N 2 соответствуют отрицательные

частоты. Покажем это, заменив индекс k на –p:

N 1

Sˆ ( p) t xi e j 2 i ( p ) / N .

(27)

i 0

Далее умножим экспоненту на единицу, записанную в виде e j 2iN / N :

N 1

N 1

i 0

i 0

Sˆ ( p) t xi e j 2 i ( p ) / N e j 2iN / N t xi e j 2 i ( N p ) / N Sˆ ( N p), т.е.

Sˆ ( p) Sˆ ( N p) .

(28)

Таким образом, при вычислении ДПФ в спектре появятся отрицательные

частоты, которые, однако, отсутствуют в реальном спектре. Поэтому для N

значений данных получается примерно вдвое меньше значений спектральных

составляющих.

ДПФ является периодическим. Докажем это, предположив, например, что

i pN q, p, q – целые числа, причем 0 q N 1 . Подставим новое значение i

в выражение (12):

xi x pN q

M 1

Sˆ ( f h )e j 2 k ( pN q ) / N

h 0

M 1

Sˆ ( f

h 0

h

)e j 2 kq / N e j 2 kpN / N x q .

(29)

Последнее в этом выражении равенство обусловлено тем, что множитель

e j 2 kpN / N равен единице. Таким образом, если пытаться продолжить

вычисление индексов k N , то полученные значения полностью повторят уже

имеющиеся: Sˆ (k N ) Sˆ (k ).

Исходя из вышеперечисленных свойств ДПФ, на графике есть смысл

выводить только часть спектра до частоты Найквиста.

29

2. Полученные результаты

Для исследования спектрального состава выделенных быстрых

колебаний мы построили периодограммы сигналов с помощью дискретного

преобразования Фурье.

В ходе эксперимента от некоторых самцов было получено количество

плазмы, которого хватило для построения 2 – 3 агрегатограмм. Для

контрольного самца №15 было построено 4 агрегатограммы, обладающих

наибольшей длиной. После получения оценки спектральной плотности

мощности для каждого отдельного временного ряда произведено усреднение

(на рис 10 жирная линия).

Рис.10. Периодограммы колебаний быстрой компоненты для контрольного самца №15

Построенный спектр мощности наряду с «шумовым пьедесталом» имеет

периодическую

(регулярную)

составляющую

(или

даже

несколько),

специфичную для каждого животного. В частности, как видно из рис. 10, один

из пиков расположен в районе 0.02 Гц. Это также подтверждает выводы,

полученные в результате автокорреляционного анализа о существовании в

наблюдаемом процессе динамической (не шумовой) составляющей.

30

ЭНТРОПИЯ

1. Теоретическая часть

Основоположник

теории

информации

Клод

Шеннон

определил

информацию, как снятую неопределенность. Точнее сказать, получение

информации

—

необходимое

условие

для

снятия

неопределенности.

Неопределенность возникает в ситуации выбора. Задача, которая решается в

ходе снятия неопределенности — уменьшение количества рассматриваемых

вариантов

(уменьшение

соответствующего

разнообразия),

ситуации

варианта

и

из

в

числа

итоге

выбор

одного

возможных.

Снятие

неопределенности дает возможность принимать обоснованные решения и

действовать. В этом управляющая роль информации.

Ситуация

максимальной

неопределенности

предполагает

наличие

нескольких равновероятных альтернатив (вариантов), т.е. ни один из вариантов

не является более предпочтительным. Причем, чем больше равновероятных

вариантов наблюдается, тем больше неопределенность, тем сложнее сделать

однозначный выбор и тем больше информации требуется для этого получить.

Для N вариантов эта ситуация описывается следующим распределением

вероятностей: {1/N, 1/N, … 1/N}.

Минимальная неопределенность равна 0, т.е. эта ситуация полной

определенности, означающая что выбор сделан, и вся необходимая информация

получена. Распределение вероятностей для ситуации полной определенности

выглядит так: {1, 0, …0}.

Величина, характеризующая количество неопределенности в теории

информации обозначается символом H и имеет название энтропия, точнее

информационная энтропия.

31

Энтропия (от греч. entropía — поворот, превращение) — мера

неопределенности, выраженная в битах. Так же энтропию можно рассматривать

как меру равномерности распределения случайной величины.

Рис. 11 Поведение энтропии для случая двух альтернатив.

На рисунке 11 показано поведение энтропии для случая двух альтернатив,

при изменении соотношения их вероятностей (p,(1-p)).

Максимального значения энтропия достигает в данном случае тогда,

когда обе вероятности равны между собой и равны ½, нулевое значение

энтропии соответствует случаям (p0=0, p1=1) и (p0=1, p1=0).

Количество информации I и энтропия H характеризуют одну и ту же

ситуацию, но с качественно противоположенных сторон. I – это количество

информации, которое требуется для

снятия

неопределенности

H. По

определению Леона Бриллюэна информация есть отрицательная энтропия

(негэнтропия).

Когда неопределенность снята полностью, количество полученной

информации I равно изначально существовавшей неопределенности H.

32

При частичном снятии неопределенности, полученное количество

информации и оставшаяся неснятой неопределенность составляют в сумме

исходную неопределенность. Ht + It = H.

Монета, имеющая равновероятные исходы при подбрасывании, имеет

энтропию, равную одному биту. Однако, если исходы не равновероятны, то её

неопределённость ниже (если бы надо было держать пари на исход бросания

такой монеты, то мы бы предпочли держать пари на более частый исход), и

таким

образом

энтропия

Шеннона

также

ниже.

Длинная

вереница

повторяющихся знаков имеет энтропию 0, так как каждый знак предсказуем.

Энтропия английского текста лежит между 1.0 и 1.5 битами на букву, или ещё

ниже от 0.6 до 1.3 битов на букву, согласно оценкам Шеннона, основанным на

экспериментах с людьми.

В общем случае, энтропия H и количество получаемой в результате

снятия неопределенности информации I зависят от исходного количества

рассматриваемых вариантов N и априорных вероятностей реализации каждого

из них P: {p0, p1, …pN-1}, т.е. H=F(N,P). Расчет энтропии в этом случае

производится по формуле, которая была предложена Клодом Шенноном в его

фундаментальной

работе

"Математические

основы

теории

связи"

опубликованной в 1948г в которой были заложены основы современной ТИ.

В частном случае, когда все варианты равновероятны, остается

зависимость только от количества рассматриваемых вариантов, т.е. H=F(N). В

этом случае формула Шеннона значительно упрощается и совпадает с

формулой Хартли, которая впервые была

предложена американским

инженером Ральфом Хартли в 1928 году, т.е. не 20 лет раньше.

Формула Шеннона имеет следующий вид:

N 1

N 1

1

H pi log 2 ( pi ) pi log 2

i 0

i 0

pi

33

(30)

Знак минус в формуле (30) не означает, что энтропия — отрицательная

величина. Объясняется это тем, что pi≤1 по определению, а логарифм числа

меньшего единицы — величина отрицательная. По свойству логарифма

1

log( a ) log , поэтому эту формулу можно записать и во втором варианте, без

a

минуса перед знаком суммы.

1

log 2 интерпретируется как частное количество информации Ii, получаемое в

pi

случае реализации i-ого варианта. Энтропия в формуле Шеннона является

средней характеристикой — математическим ожиданием распределения

случайной величины {I0, I1, … IN-1}.

34

2. Тестовые примеры

1) В качестве тестового временного ряда была выбрана синусоида с 20

характерными периодами. Затем на каждом следующем шаге длина временного

ряда уменьшалась на 1 характерный период.

При построении плотности распределения весь объем данных нужно

разбить

на

бины,

т.е.

сгруппировать

близкие

значения

вместе

Значение количества бинов при построении плотности распределения

выбирается из расчета L N , где L — количество бинов, N — количество

точек. При уменьшении количества характерных периодов уменьшается и

количество бинов, вследствие чего увеличивается и оценка энтропии (Рис. .)

Для устранения этого эффекта при проведении обработки данных

количество бинов фиксировалось.

Оценка значения энтропии синусоиды с 20 характерными периодами при

фиксированном количестве бинов, равным 100, составила 0,08778 ≈ 0,088.

Уменьшение длины ряда на целое количество периодов существенно не влияет

на меру неопределенности.

Рис.12: Увеличение оценки энтропии при уменьшении

количества характерных периодов синусоиды.

35

2) В качестве ещё одного примера оценивалось значение энтропии

нормального шума при фиксированном количестве бинов, но разной длине

ряда. Т.к. все значения равновероятны, то изменение длины ряда не должно

существенно изменить оценку энтропии.

На практике от ряда длиной 10 тыс. точек с каждым шагом отрезали по

500 точек при постоянном количестве бинов, равным 100 (Рис.13.).

Оценка значения энтропии временного ряда нормального шума при

фиксированном количестве бинов, равным 100, составила 0,04599 ≈ 0,046.

Уменьшение

длины

ряда

также

существенно

не

влияет

на

неопределенности.

Рис.13: Изменение оценки энтропии при уменьшении длины ряда.

36

меру

3. Полученные результаты

Рис.14: Изменение оценки энтропии.

Информационный анализ на основе вычисления энтропии Шеннона

показывает определённое отличие между самцами стрессорной и контрольной

групп. В частности, самцы стрессорной группы характеризуются более высоким

уровнем энтропии (т.е. меньшей степенью упорядоченности в сигнале), а также

более низкой вариабельностью величины энтропии от особи к особи, что

наталкивает на мысль, что энтропия способна характеризовать степень

нарушения физиологических процессов регуляции в живом организме,

вызванных стрессом.

37

Заключение

Проведенные исследования показывают, что итоговые результаты

самцов из контрольной группы и самцов, подвергавшихся стрессу, носят

неслучайный характер. По-видимому, высокочастотная компонента сигнала

светопропускания может отражать некие физиологические процессы.

Основываясь на выводах, сделанных по итогам автокорреляционного

анализа, можно сказать, что наблюдаемый процесс, по крайней мере, с

точностью,

определяемой

разрешением

прибора,

имеет

периодическую

(регулярную) линейную компоненту, т.е. явно отличен от шума.

Спектральный анализ подтверждает выводы, полученные в результате

автокорреляционного анализа о существовании в наблюдаемом процессе

динамической (не шумовой) составляющей. Построенные периодограммы

имеют периодическую (регулярную) составляющую (или даже несколько),

специфичную для каждого животного.

Вычисление энтропии Шеннона показало, что самцов стрессорной

группы характеризует более высокий уровень энтропии, а также более низкая

вариабельность величины энтропии от особи к особи. Вероятно, энтропия

способна характеризовать степень нарушения физиологических процессов

регуляции в живом организме, вызванных стрессом.

На данном этапе это можно расценивать как побуждающий фактор к

дальнейшему изучению интересующей нас области.

Для

более

четкого

понимания

происхождения

этой

быстрой

компоненты необходимо обработать большее количество сигналов уже

использованными методами, а именно автокорреляционной функцией и

спектральным анализом. Также необходимо использовать дополнительные

методы, которые помогут с другой стороны посмотреть на интересующий нас

процесс.

38

Список литературы

1. З.А. Габбасов, Е.Г. Попов, И.Ю. Гаврилов, Е.Я. Позин, Р.А. Маркосян.

Новый высокочувствительный метод анализа агрегации тромбоцитов //

Лабораторное дело. — 1989. — №10. С. 15–18.

2. О.Ю. Ефимова. Численное моделирование процесса свертывания крови в

сосудах // Доклады научной сессии МИФИ–2005, т.7., 2005. – С. 111–112.

3. W.J.H. Stortelder, P.W. Hemker, H.C. Hemker. Mathematical Modelling in

Blood Coagulation; Simulation and Parameter Estimation // MAS-R9720

September 30, 1997. ISSN 1386-3703.

4. Безручко Б.П., Смирнов Д.А., Математическое моделирование и

хаотические временные ряды. Саратов: ГосУНЦ «Колледж», 2005.

5. S.D. Bungay. A mathematical model of thrombin generation in vascular and

avascuar systems. Dissretation in partial fulfilment of requirements for the

degree of Doctor of Phylosophy. University of Guelph, December, 2003. – 166

p.

6. А. Л. Чуличков, А. В. Николаев, А. И. Лобанов, Г. Т. Гурия, “Пороговая

активация свертывания крови и рост тромба в условиях кровотока,

Матем. моделирование, 12:3 (2000), 75–96

7. А.П. Гузеватых, А.И. Лобанов, Г.Т. Гурия. Активация внутрисосудистого

тромбообразования вследствие развития стеноза // Математическое

моделирование. — 2000. — т. 12, №4. С. 40–59.

8. Киричук В.Ф. Физиология крови // СГМУ; Саратов, 2005. – С. 189.

39