7.2 Лабораторная работа по статистике №2

реклама

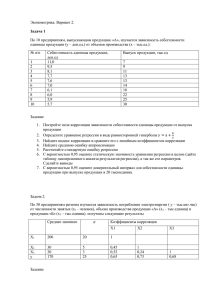

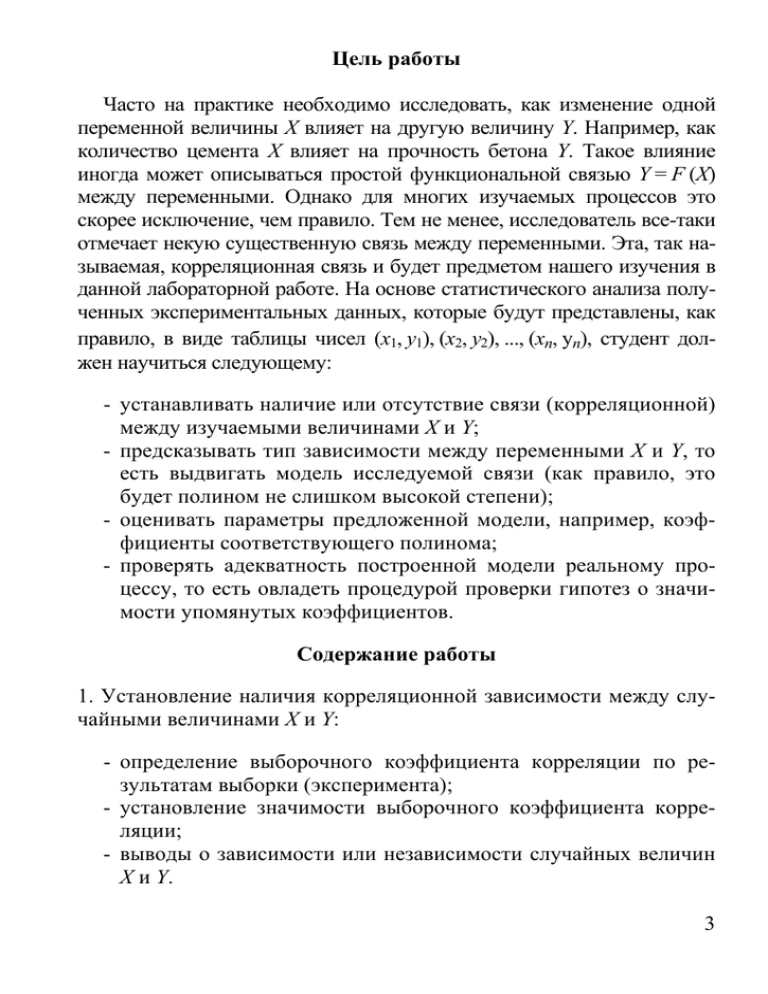

Цель работы Часто на практике необходимо исследовать, как изменение одной переменной величины X влияет на другую величину Y. Например, как количество цемента X влияет на прочность бетона Y. Такое влияние иногда может описываться простой функциональной связью Y = F (X) между переменными. Однако для многих изучаемых процессов это скорее исключение, чем правило. Тем не менее, исследователь все-таки отмечает некую существенную связь между переменными. Эта, так называемая, корреляционная связь и будет предметом нашего изучения в данной лабораторной работе. На основе статистического анализа полученных экспериментальных данных, которые будут представлены, как правило, в виде таблицы чисел (x1, y1), (x2, y2), ..., (xn, yn), студент должен научиться следующему: - устанавливать наличие или отсутствие связи (корреляционной) между изучаемыми величинами X и Y; - предсказывать тип зависимости между переменными X и Y, то есть выдвигать модель исследуемой связи (как правило, это будет полином не слишком высокой степени); - оценивать параметры предложенной модели, например, коэффициенты соответствующего полинома; - проверять адекватность построенной модели реальному процессу, то есть овладеть процедурой проверки гипотез о значимости упомянутых коэффициентов. Содержание работы 1. Установление наличия корреляционной зависимости между случайными величинами X и Y: - определение выборочного коэффициента корреляции по результатам выборки (эксперимента); - установление значимости выборочного коэффициента корреляции; - выводы о зависимости или независимости случайных величин X и Y. 3 2. Выбор регрессионной модели и ее статистический анализ: - выбор уравнения регрессии; - оценка коэффициентов регрессионного уравнения по методу наименьших квадратов; - проверка точности оценки регрессии и установление адекватности выбранной модели изучаемому процессу. Порядок проведения работы - Изучить теоретический материал. - По данным выборки найти выборочный коэффициент корреляции rXY . - Установить значимость отличия от нуля rXY . - Если сделан вывод о том, что между X и Y существует корреляционная связь, выбрать уравнение линии (модель) регрессии Y на X. - Оценить параметры выбранной модели по результатам выборки. - Проверить точность оценки регрессии, то есть найти доверительные интервалы для параметров регрессии. - Провести расчеты на ПЭВМ. - Сделать основные выводы. - Составить отчет о выполнении работы. Требования к отчету Отчет о выполнении работы должен состоять из следующих разделов: Постановка задачи. Анализ решения задачи. Результаты счета на ПЭВМ. Основные выводы и рекомендации. 4 1. УСТАНОВЛЕНИЕ НАЛИЧИЯ ЗАВИСИМОСТИ МЕЖДУ ДВУМЯ СЛУЧАЙНЫМИ ВЕЛИЧИНАМИ ПО РЕЗУЛЬТАТАМ ИХ ВЫБОРОК В предыдущей лабораторной работе мы изучали одну случайную величину X, ее вероятностные и статистические характеристики, полученные на основе имеющейся выборки значений этой случайной величины. Большой интерес для широкого класса научных и инженерных задач представляет обнаружение взаимных связей между двумя и более случайными величинами. Например, существует ли связь между курением и ожидаемой продолжительностью жизни, или между умственными способностями и успеваемостью. Очевидно, что привычной для нас строгой функциональной зависимости, когда каждому значению X по определенному правилу соответствует значение Y, то есть Y = f (X), здесь мы установить не можем. Слишком много самых различных случайных факторов влияют как на величину X, так и на величину Y. Тем не менее, зачастую невооруженным глазом видно, что какая-то зависимость между изучаемыми величинами X и Y существует. Например, вес и рост человека, естественно, тесно связаны между собой, но они не определяют друг друга однозначно. Точно так же прочность бетона, очевидно, зависит от количества цемента, но эта зависимость явно не функциональная. Рассмотрим задачу о том, как сделать надежный вывод о наличии или отсутствии зависимости между двумя случайными величинами на основе экспериментальных данных. Слово «надежный» означает (как и в лабораторной работе №1), что вероятность истинности сделанного вывода должна быть близка к единице. Для исследования такой зависимости во второй половине XIX века английский ученый Фрэнсис Гальтон (двоюродный брат Чарльза Дарвина) и его ученики (например, Карл Пирсон) ввели такие важные понятия, как корреляция и регрессия, которые стали основными понятиями в теории вероятностей и математической статистике, а также в связанных с ними научных дисциплинах. При этом саму зависимость между случайными величинами назвали корреляционной. 5 1.1. Коэффициент корреляции В инженерных приложениях упомянутая выше задача о наличии зависимости между двумя случайными величинами обычно сводится к установлению связи между некоторыми предполагаемыми возбуждениями-факторами x1, x2, .., xn и наблюдаемым откликом y изучаемой системы (рис. 1.1). x1 x2 y xn Рис. 1.1 Рассмотрим вначале взаимосвязь между одним фактором x и откликом y, то есть взаимосвязь между двумя случайными величинами X и Y. В теории вероятностей для установления степени зависимости между двумя случайными величинами вводится числовая характеристика, которая называется коэффициентом корреляции или просто корреляцией. При этом такую зависимость называют корреляционной зависимостью. Для двух случайных величин X и Y коэффициент корреляции определяется следующим образом: ρ X Y = ρ ( X ,Y ) = M [( X − M X ) (Y − M Y )] , σ X σY (1.1) где M X , σ X и M Y , σY – математическое ожидание и среднеквадратическое отклонение случайных величин X и Y соответственно. Величину, которая стоит в числителе правой части этой формулы, называют ковариацией и часто обозначают C ( X , Y ) : C ( X , Y ) = M [( X − M X ) (Y − M Y )] . Легко увидеть, что если X = Y, то C ( X , X ) = σ 2X , C (Y , Y ) = σY2 . 6 При этом выполняется неравенство | C ( X , Y ) | ≤ σ X σY . Это означает, что коэффициент корреляции заключен между −1 и 1: − 1 ≤ ρ( X , Y ) ≤ 1 . Формулу для коэффициента корреляции (1.1) легко преобразовать в более наглядную и удобную с точки зрения вычислений. Учитывая, что M [( X − M X ) (Y − M Y )] = M [ XY − XM X − YM Y + M X M Y ] = = M ( XY ) − M X M Y − M Y M X + M X M Y = M ( XY ) − M X M Y , получаем формулу: ρ ( X ,Y ) = M ( XY ) − M X M Y . σ X σY Если случайные величины X и Y – независимы, то коэффициент корреляции ρ ( X , Y ) = 0 , так как M ( X ⋅ Y ) = M ( X ) ⋅ M (Y ) . Обратное утверждение, вообще говоря, неверно, то есть, некоррелированные случайные величины не обязательно независимы. Определенный выше коэффициент корреляции принадлежит к числу наиболее трудных для понимания числовых характеристик случайных величин. Если такие характеристики, как частота, вероятность, математическое ожидание, дисперсия, стандартное отклонение, осознаются достаточно легко, то термин "коэффициент корреляции" оказывается сложным для понимания. Это объясняется в первую очередь сложностью математического выражения для этого коэффициента и отсутствием соответствующего понятия в повседневной жизни. Поэтому напомним здесь основные свойства коэффициента корреляции: 1. Коэффициент корреляции ρ ( X , Y ) симметричен относительно X и Y и может изменяться в пределах от −1 до 1. 7 2. Равенство | ρ ( X , Y ) | = 1 указывает на наличие точной лиσ нейной связи вида y = ρ σ Y ( x − M X ) + M Y между рассматриX ваемыми величинами X и Y, возможные значения которых в этом случае расположены на одной прямой. 3. При значениях ρ ( X , Y ) , по модулю близких к единице, точки с координатами X и Y с большой вероятностью располагаются в окрестностях некоторой прямой, непараллельной ни одной из осей координат. По мере уменьшения | ρ ( X , Y ) | эта вероятность падает, и при ρ ( X , Y ) , близком к нулю, такая прямая вообще не может быть обнаружена. Однако это не исключает возможности нелинейной связи между рассматриваемыми величинами. Таким образом, коэффициент корреляции является характеристикой степени зависимости между двумя случайными величинами. В заключение отметим, что - при | ρ ( X , Y ) | = 1 величины X и Y являются полностью коррелированными; при | ρ ( X , Y ) | , близком к единице; – сильно коррелированными; при ρ ( X , Y ) , близком к нулю; – слабо коррелированными и при ρ ( X , Y ) = 0 – некоррелированными; - при ρ ( X , Y ) > 0 корреляционная связь между величинами X и Y – положительная; при ρ ( X , Y ) < 0 – отрицательная. При этом в первом случае возрастанию X с большой вероятностью соответствует возрастание Y, а во втором – убывание. 1.2. Представление исходных данных Приступая к анализу экспериментальных данных, мы не имеем сведений о наличии корреляционной связи между случайными величинами X и Y. Поэтому первая задача, которую необходимо решить, – это сделать обоснованный вывод о наличии этой зависимости или об отсутствии таковой. Как и в случае исследования одной случайной величины, материалом, на базе которого мы решаем эту задачу, является выборка значений случайных величин X и Y. 8 Пусть в результате n экспериментов (проведенных в одних и тех же условиях) зафиксированы n пар значений (x1, y1), (x2, y2),..., (xn, yn), где xi – значение, которое приняла случайная величина X в i-м эксперименте, а yi – значение, которое приняла случайная величина Y в этом же эксперименте. Этот набор данных называется выборкой объема n пары случайных величин. В случае большого объема выборки (n – достаточно велико) и частого повторения в выборке некоторых значений xi и yi ее удобно представлять в виде корреляционной таблицы X\Y y1 y2 … yl x1 m11 m12 … m1l mX1 x2 … xk m21 … mk 1 m22 … mk 2 … m2l mX 2 … … mkl … mX k m Y1 m Y2 … m Yl Здесь mij – частота появления пары значений ( xi , y j ) в выборке; x1 < x2 < ... < xk – различные значения, которые приняла случайная величина X; m X 1 ,..., m X k – частоты появления этих значений в выk борке ( ∑ m X i = n) . Аналогично, y1 < y2 < ... < yl – различные знаi =1 чения, которые приняла случайная величина Y; mY1 ,..., mYl – частоl ты появления этих значений в выборке ( ∑ mYi = n) . i =1 Если при большом объеме выборки велико также и число различных значений xi и yi , то таблицу имеет смысл представить в виде интервальной корреляционной таблицы (аналог группированного статистического ряда, см. лабораторную работу №1) 9 X\Y [ x0 , x1 ) [ y0 , y1 ) [ y1 , y2 ) … [ yl −1, yl ] m11 m12 … m1l [ x1 , x2 ) … [ xk −1 , xk ] m21 … mk1 m22 … mk 2 … m2l … mkl … Здесь частота mij – количество пар значений ( xζ , yθ ) выборки, для которых значение xζ попадает в интервал [ xi −1 , xi ) , а значение yθ – в интервал [ y j −1 , y j ) . Количество интервалов, их длина, а также граничные значения x0 , y0 , xk , yl определяются так же, как и для группированного статистического ряда (см. лабораторную работу №1, с. 22–23). Замечание. Следует отметить, что часто информация для статистического исследования сразу поступает в виде интервальной корреляционной таблицы. Для дальнейших вычислений информацию, представленную в виде интервальной корреляционной таблицы, надо преобразовать в обычную корреляционную таблицу, взяв в качестве значений вариант середины соответствующих интервалов, X\Y y1* y2* … yl* x1* m11 m12 … m1l x2* … xk* m21 … mk1 m22 … mk 2 … m2l … … mkl xi + xi −1 * y j + y j −1 , yj = . 2 2 Разберем сказанное на примере. Пусть получена выборка случайных величин X и Y (X – рост студента в см, Y – его масса в кг). Здесь xi* = 10 Таблица. Данные о росте и массе студентов (X –рост в см, Y – масса в кг): X 178 188 178 165 175 185 183 175 183 Y 63 95 67 66 83 75 70 77 79 X 193 188 183 173 178 180 173 185 Y 70 84 84 75 100 84 82 77 X 165 185 188 163 183 183 170 185 Y 61 79 82 68 77 75 66 77 Объем выборки n = 25. Найдем количество интервалов по формуле k ≥[log 2 n]+1 (см. лабораторную работу №1, с.33), k ≥[log 2 25]+1= 4+1=5 . Итак, можно взять k = 5. Так как x min =163 и x max =193 , то длина интервала для случайной величины X будет равна hx = x5 = 193 . Аналогично, ymin =61, ymax =100, hy = 193−163 5 100 −61 5 =6 , x0 = 163 , =7,8 . Округлим h y до 8 и возьмем y 0 =60 , y5 =100 . Построим интервальную корреляционную таблицу X\Y [163;169) [169;175) [175;181) [181,187) [187,193] [60;68) 2 [68;76) 1 1 3 3 1 [76;84) [84;92) [92;100] 1 2 5 1 1 1 1 1 1 Преобразуем ее в обычную корреляционную таблицу X\Y 166 172 178 184 190 mX i 64 2 72 1 1 3 5 3 1 6 80 1 2 5 1 9 88 1 1 1 3 96 1 1 2 mY j 3 2 7 9 4 25 11 Пустые клетки означают, что соответствующая им частота равна 0. Для большей наглядности исходные данные представляют в виде так называемого корреляционного поля (рис. 1.2). Y 96 88 80 72 64 X 0 166 172 178 184 190 Рис. 1.2 Для этого в системе координат xOy строят точки ( xi , y j ) , причем их количество соответствует частоте из корреляционной таблицы. При частоте, большей единицы, изображается облако близко расположенных друг к другу точек с соответствующими координатами. 1.3. Оценка коэффициента корреляции по результатам эксперимента Пусть имеется выборка значений пары случайных величин X и Y, которая представлена в виде набора (x1, y1), (x2, y2),..., (xn, yn) или в виде корреляционной таблицы. По аналогии с оценками математического ожидания и дисперсии будем утверждать, что достаточно хорошей оценкой коэффициента корреляции ρ( X , Y ) будет выборочный коэффициент корреляции r ( X , Y ) , определяемый формулой n ∑ ( xi − X ) ( yi − Y ) ∧ r ( X ,Y ) = ρ ( X ,Y ) = n n [ ∑ ( xi − X ) ∑ ( yi − Y ) ] i =1 12 i =1 2 i =1 2 1/ 2 . Заметим, что rXY – случайная величина, которая принимает конкретное значение при некоторой реализации совокупности (X, Y): (x1, y1), ...,(xn, yn). Для вычисления выборочного коэффициента корреляции rXY удобно использовать формулу rXY = XY = где ∧ σX = 1 XY − X ⋅ Y ∧ ∑ xi yi , X = n i =1 n , σ X σY n 1 ∧ 1 n ∑ xi , Y = n i =1 ∧ 2 ∑ xi2 − X , σY = n i =1 1 1 n ∑ yi , n i =1 n 2 ∑ yi2 − Y , n i =1 или, если исходные данные представлены в виде корреляционной таблицы, XY = ∧ 1 k l 1 n i =1 j =1 σX = k 1 l n j =1 ∑ ∑ mij xi* y*j , X = ∑ m X i xi* , Y = ∑ mY j y*j , 1 k n i =1 2 ∧ ∑ m X i ( xi* )2 − X , σY = n i =1 1 n l 2 ∑ mY j ( y*j ) 2 − Y . j =1 Как и ρ ( X , Y ) , выборочный коэффициент корреляции лежит между −1 и 1 и принимает одно из граничных значений только при наличии идеальной линейной связи между наблюдениями. Нелинейная связь и/или разброс данных, вызванный ошибками измерения или же неполной коррелированностью случайных величин, приводит к уменьшению абсолютного значения rXY . Характерные виды корреляционных полей для различных значений коэффициента корреляции приведены на рисунке (рис. 1.3). 13 Y _ r XY = 1 Y r XY ≈ 0,8 X Y r XY ≈ _ 0,5 X Y X r XY = 0 X Рис. 1.3 1.4. Проверка значимости выборочного коэффициента корреляции По методике, изложенной в предыдущем разделе, используя выборочные значения совокупности случайных величин (X, Y): (x1, y1), ..., (xn, yn) можно найти выборочный коэффициент корреляции rXY . Так как выборка отобрана случайно, то можно утверждать, что rXY лишь приближенно представляет коэффициент корреляции ρ ( X , Y ) случайных величин X и Y. Но, в конечном итоге, нас интересует именно коэффициент ρ ( X , Y ) , поэтому хотелось бы знать, насколько можно доверять полученной оценке. Другими словами, ставится задача о значимости найденного выборочного коэффициента корреляции. Эту задачу можно сформулировать следующим образом: 14 необходимо при заданном уровне значимости α , проверить нулевую гипотезу Н0: ρ ( X , Y ) = ρ0 против альтернативной гипотезы Н1: ρ ( X , Y ) ≠ ρ0 , если известно, что выборочный коэффициент корреляции rXY принял значение, не равное нулю. На практике чаще всего приходится встречаться с проверкой этой гипотезы при ρ0 = 0 . Эта задача связана с решением вопроса о зависимости или независимости случайных величин X и Y. Действительно, если гипотеза Н0: ρ ( X , Y ) = 0 – отвергается, то это значит, что выборочный коэффициент корреляции значимо отличается от нуля, и можно сделать вывод, что между X и Y существует статистически значимая корреляционная связь. Если же нулевая гипотеза будет принята, то выборочный коэффициент корреляции незначим, а X и Y некоррелированы. Итак, решается задача в следующей постановке: проверить нулевую гипотезу Н0: ρ ( X , Y ) = 0 против альтернативной гипотезы Н1: ρ ( X , Y ) ≠ 0 . Для проверки этой гипотезы, как и ранее, используется t-распределение (распределение Стьюдента). r (сравним с ранее расРассмотрим случайную величину t = 1 − r2 n−2 смотренной случайной величиной t = X −a при a = 0 и S = 1 − r 2 ). S n −1 Оказывается, во-первых, что эта случайная величина имеет распределение Стьюдента с k = n − 2 степенями свободы. Во-вторых, легко понять, почему эта случайная величина хорошо отражает изменения r : если r → 0 , то t → 0 , а если | r | → 1 , то t → ∞ . Таким образом, можно сказать, что гипотеза Н0 будет верна с вероятностью p =1 − α , если P (| t | < t γ ) = 1 − α . Графически наблюдаемое значение должно попасть в область принятия гипотезы (рис. 1.4). 15 f(t) область принятия гипотезы площадь равна 1-α t t -γ tγ tнабл. Рис. 1.4 Как и ранее, после несложных преобразований, можно показать, что tγ находится по таблицам распределения Стьюдента из равенства P(t < t γ ) = f (t γ ) = 1 − α , 2 где f(t) – распределение Стьюдента с n − 2 степенями свободы. Таким образом, порядок шагов таков: вычисляем по результатам выборки значение rXY tнабл. = n−2 2 1 − rXY и сравниваем его с квантилью t γ (n − 2) , найденной по таблицам распределения Стьюдента по вероятности γ = 1 − α2 и числу степе- ней свободы k = n − 2. Если | tнабл. | > t γ (n − 2) , то гипотеза Н0 отвер- гается, то есть, считается, что ρ ≠ 0 , а X и Y коррелированы. Если | tнабл. | < t γ (n − 2) , то нет оснований отвергнуть гипотезу Н0, то есть гипотезу о некоррелированности случайных величин. 1.5. Пример вычисления коэффициента корреляции Вернемся к данным о росте и массе студентов, приведенным в п. 1.2. Есть ли основание считать, что рост и масса студентов корре16 лированы при уровне значимости α = 0,05? Вычисляем следующие величины: 25 25 25 ∑ xi yi = 344493, ∑ xi2 = 806105, ∑ yi2 = 148918, i =1 i =1 i =1 25 X = rXY = ∑ xi i =1 n 25 = 4485 25 ∑ yi = 179,4 , Y = i =1 n = 1916 25 = 76,64, 344493 − 25 ⋅ 179, 4 ⋅ 76,64 2 2 (80610 − 25 ⋅ 179,4 )(148918 − 25 ⋅ 76,64 ) = 0,43. По таблицам t-распределения при уровне значимости α = 0,05 и числу степеней свободы k = n − 2 = 23 находим квантиль t0,975 (23) = 2,069 . Вычисляем tнабл. = r ⋅ n − 2= 0,43 ⋅ 23 = 2,29 . Так как 1− r2 1 − 0,432 tнабл. > t0,975 (23) , то гипотеза H0 должна быть отвергнута с уровнем значимости 5%. Следовательно, есть основания считать, что между ростом и массой студентов существует значимая корреляция. 2. ОСНОВЫ РЕГРЕССИОННОГО АНАЛИЗА Корреляционный анализ позволяет установить степень взаимосвязи двух случайных величин. В случае, когда коэффициент корреляции ρ ( X , Y ) ≠ 0 , то есть между X и Y существует значимая корреляционная связь, желательно иметь модель этой связи, которая дала бы возможность предсказывать значения одной случайной величины Y по конкретным значениям другой X (или наоборот – X по Y). Например, корреляционный анализ данных, приведенный в предыдущем разделе, установил значимую линейную связь между ростом и массой студентов. Логичен следующий шаг: конкретизировать эту связь так, чтобы по данному росту можно было бы предсказать массу студента. Методы решения подобных задач изучает регрессионный анализ. 17 Коэффициент корреляции описывает зависимость между двумя случайными величинами одним числом, а регрессия выражает эту зависимость в виде функционального соотношения, и, как следствие, дает более полную информацию. Так, регрессией является средний вес тела человека как функция от его роста. Слово "регрессия" в статистику ввел, как мы уже упоминали, Френсис Гальтон, один из создателей математической статистики. Сопоставляя рост детей и их родителей, он обнаружил, что соответствие между ростом отцов и детей слабо выражено, оно оказалось меньшим, чем он ожидал. Однако Гальтон объяснил это явление наследственностью не только от родителей, но и от более отдаленных предков: по его предположениям, то есть по его математической модели, рост определяется наполовину родителями, на четверть дедом и бабкой, на одну восьмую прадедом и прабабкой и т.д. Мы не знаем, прав ли Гальтон, но он обратил внимание на движение назад по генеалогическому дереву и назвал это явление регрессией, заимствовав понятие движения назад, противоположное прогрессу – движению вперед. Впоследствии слово «регрессия» заняло в статистике заметное место, хотя, как это часто бывает в любом языке, в том числе и в языке науки, в него теперь вкладывают другой смысл – оно означает функциональную статистическую связь между случайными величинами. 2.1. Функции и линии регрессии Что же понимают под словом "регрессия" или "функциональная статистическая связь" между случайными величинами в теории вероятностей? Пусть при каждом фиксированном значении случайной величины X = х случайная величина Y имеет определенное распределение вероятностей с условным математическим ожиданием, которое является функцией х: M (Y / X = x) = f ( x, θ), где через θ обозначим совокупность (θ1 , θ2 ,..., θk ) параметров, определяющих функцию f. Так, в случае линейной зависимости θ = (a, b), f ( x, a, b) = ax + b . Определение. Зависимость f (x, θ), где х – независимая переменная, называется регрессией или функцией регрессии случайной 18 величины Y на случайную величину X. График функции f (x, θ) называется линией регрессии Y на X. Точность, с которой линия регрессии передает изменение Y в среднем при изменении X, измеряется дисперсией величины Y, вычисляемой для каждого значения х: D (Y / X = x) = σ 2 ( x) . Линии регрессии обладают следующим замечательным свойством: среди всех действительных функций f (x) минимум математического ожидания M [(Y − f ( x))2 ] достигается для функции регрессии f ( x, θ) = M (Y / X = x) , то есть регрессия Y на X дает наилучшее (в указанном смысле) представление величины Y. Пусть f (x, θ) – функция регрессии Y на X. Тогда зависимость между исследуемыми признаками (случайными величинами) Y и X запишем в виде y = f (x, θ) + ε , где ε – случайная величина, которую иногда называют ошибкой эксперимента, причем M (ε) = 0, D(ε) = σ 2 ( x) . В дальнейшем будем рассматривать модели с постоянной дисперсией: D(ε) = σ 2 = const . К сожалению, на практике законы распределения X и Y неизвестны, и функция регрессии определяется приближенно по экспериментальным данным методом регрессионного анализа. Цель регрессионного анализа состоит в определении общего вида уравнения регрессии, построении оценок неизвестных параметров, входящих в уравнение регрессии, и проверке статистических гипотез, связанных с регрессией. 2.2. Модель линейного регрессионного анализа Статистический подход к задаче построения (точнее, восстановления) функциональной зависимости Y от X основывается на предположении, что нам известны некоторые исходные (экспериментальные) данные (xi, yi), i = 1, 2, ..., n, где yi – значения Y при заданном значении xi – независимой переменной X, влияющей на значения Y. Пару значений (xi, yi)часто называют результатом одного из19 мерения, а n – числом измерений; Y – откликом, а X – фактором, влияющим на отклик. Предположим, что наблюдаемое в опыте значение отклика Y можно мысленно разделить на две части: одна закономерно зависит от X, то есть является функцией X, другая – случайна по отношению к X. Обозначим, как и ранее, первую часть через f (x, θ), вторую – через ε и представим отклик в виде Y = f (x, θ) + ε , где ε – случайная величина (ошибка эксперимента или измерения). Применяя это соотношение к имеющимся у нас исходным данным, получим yi = f ( xi , θ) + ε i , i = 1, 2, ..., n. Разделение yi на закономерную и случайную составляющую можно провести только мысленно. Реально ни f ( xi ) , ни εi в отдельности нам не известны, из опыта мы узнаем только их сумму – yi. В связи с этим нам необходимо сделать определенные уточнения относительно величин εi . В классической модели регрессионного анализа предполагается, что: - все опыты были проведены независимо друг от друга в том смысле, что случайности, вызвавшие отклонение отклика от закономерности в одном опыте, не оказывали влияния на подобные отклонения в других опытах; - статистическая природа этих случайных составляющих оставалась неизменной во всех опытах. Из этих предположений, очевидно, вытекает, что величины εi , i = 1, 2, ..., n характеризуют ошибки, независимые при различных измерениях и одинаково распределенные с нулевым средним и постоянной дисперсией. 2.3. Общая схема решения регрессионных задач Самый простой случай регрессионных задач – это исследование связи между одной независимой переменной Х и одной зависимой переменной (откликом) Y. Эта задача носит название простой регрессии. Исходными данными этой задачи являются два набора наблюдений: х1, х2, ..., хn – значения Х и y1, y2, ...., yn – соответствую20 щие значения Y. Перечислим основные этапы при решении задач простой регрессии. Первым шагом решения задачи являются предположения о возможном виде функциональной связи между Х и Y. Примерами таких возможных видов функциональных связей могут являться зависимости: y = a + bx, y = a + bx + cx 2 , y = e a + bx , y = 1 /(a + bx) и т.д., где a, b, c – неизвестные параметры, которые надо определить по исходным данным. Для подбора вида зависимости между Х и Y полезно построить и изучить картину расположения точек с координатами (x1, y1), ...., (xn, yn). Иногда примерный вид зависимости бывает известен из теоретических соображений или предыдущих исследований, аналогичным данным. Важно выбрать функцию f ( x, θ1 ,..., θk ) так, чтобы она не просто хорошо описывала закономерную часть отклика, но и имела "физический" смысл, то есть открывала какую-то объективную закономерность. Впрочем, полезны бывают и чисто эмпирические, "подгоночные" формулы, поскольку они позволяют в сжатой форме приближенно выразить зависимость Y от Х. 3. ОЦЕНКА ПАРАМЕТРОВ МОДЕЛИ После того как общий вид регрессионной функции выбран – f ( x, θ1 , θ 2 ,..., θk ) , нужно подобрать оценки θˆ 1 , θˆ 2 ,..., θˆ k соответствующих параметров таким образом, чтобы величины ˆ ˆ ˆ ri = yi − f ( xi , θ1 , θ 2 ,..., θk ) в совокупности были близки к нулю. Величины ri называются остатками или отклонениями наблюденных значений yi от предсказанных yˆi = f ( xi , θˆ 1 , θˆ 2 ,..., θˆ k ) . Меру близости к нулю совокупности этих величин можно выбирать поразному (например, максимум модулей, сумма модулей остатков и т.д.). Но наиболее простые формулы расчета получаются, если в качестве этой меры выбрать сумму квадратов остатков (отклонений). 21 Если обозначим n S (θ1 , θ 2 ,..., θk ) = ∑ [ yi − f ( xi , θ1 , θ2 ,..., θk )]2 , то i =1 оценки параметров θˆ 1 , θˆ 2 ,..., θˆ k выбираются из условия минимума суммы ∂S ∂S ∂S квадратов остатков min S (θ1 , θ2 ,..., θ k ) или = 0, = 0,..., = 0. θ ∂θ1 ∂θ2 ∂θk Этот метод носит название метода наименьших квадратов. Определение. Методом наименьших квадратов называется способ подбора параметров регрессионной модели, исходя из минимизации суммы квадратов остатков. Сам по себе метод наименьших квадратов не связан с какимилибо предположениями о распределении случайных ошибок ε1 , ε 2 ,..., ε n , он может применяться и тогда, когда мы не считаем эти ошибки случайными (например, в задачах сглаживания экспериментальных данных). Определив оценки параметров θˆ 1 , θˆ 2 ,..., θˆ k , мы тем самым определяем случайную величину Yˆ = f ( X , θˆ , θˆ ,..., θˆ ) , которая называ1 2 k ется среднеквадратической регрессией Y на Х, а соответствующие уравнение y = f ( x, θˆ 1 , θˆ 2 ,..., θˆ k ) называется выборочным уравнением функциональной регрессии Y на Х. Замечание 1. Уравнение регрессии Y на Х позволяет предсказывать значения Y согласно выборочному уравнению регрессии y = f ( x, θˆ 1 , θˆ 2 ,..., θˆ k ) . Если в исходных данных какому-либо значению xi соответствует несколько значений Y, например, y1, y2, ..., ym, то f ( xi , θˆ 1 , θˆ 2 ,..., θˆ k ) ≈ M (Yˆ / X = xi ) = y x = xi . Поэтому выборочное уравнение регрессии Y на Х записывают иногда в виде y x = f ( x, θˆ 1 , θˆ 2 ,..., θˆ k ) . Замечание 2. Если в вышеприведенных распределениях случайные величины Х и Y поменять местами, то аналогичные рассуждения приведут к уравнению регрессии Х на Y x y = g ( y, θˆ 1 , θˆ 2 ,..., θˆ k ) . 22 Замечание 3. Широко распространенная в практических задачах ситуация, когда функция регрессии f ( x, θ1 , θ 2 ,..., θk ) линейно зависит от параметров θ1 , θ 2 , ..., θ k , носит название линейного регрессионного анализа. Например, f ( x, a0 , a1 , ..., a k ) = a0 + a1 x + ... + a k x k . Замечание 4. Ситуация, в которой экспериментатор может выбрать значения факторов xi по своему желанию и таким образом планировать будущие эксперименты, называется активным экспериментом. В этом случае значения факторов xi обычно рассматриваются как неслучайные. Более того, сообразуясь с целями эксперимента, экспериментатор может выбрать его план наилучшим образом (планирование эксперимента). В отличие от этой ситуации в пассивном эксперименте значения фактора складываются вне воли экспериментатора, под действием других обстоятельств. Поэтому значения xi приходится толковать как случайные величины, что накладывает особые черты на интерпретацию результатов. Сама же математическая обработка совокупности (xi, yi), i = 1, 2, ..., n от этого не меняется. 3.1. Анализ адекватности модели После подбора регрессионной модели и нахождения ее параметров желательно выяснить, насколько хорошо выбранная модель описывает имеющиеся данные. К сожалению, общего правила для этого нет. На практике первое впечатление о правильности подобранной модели может дать изучение некоторых числовых характеристик, например, доверительных интервалов для оценок параметров модели. Однако эти показатели скорее позволяют отвергнуть совсем неудачную модель, чем подтвердить правильность выбора функциональной зависимости. Более обоснованные решения можно принять, сравнив имеющиеся значения yi со значениями ŷi , полученными с помощью подобранной функции регрессии yˆ = f ( x , θˆ ) , то есть провести анализ i i остатков ri = yi − yˆi i = 1, 2, ..., n . 23 Исследование остатков полезно начинать с изучения их графика, который может показать наличие какой-то зависимости, не учтенной в модели. Скажем, при подборе простой линейной зависимости между х и y график остатков может показать необходимость перехода к нелинейной модели (квадратичной, полиномиальной, экспоненциальной). Для проверки нормальности распределения остатков чаще всего используется график плотности нормального распределения или критерии хи-квадрат, Колмогорова и др. 3.2. Простейшая линейная регрессия Проиллюстрируем изложенные выше идеи обработки регрессионного эксперимента на примере простой линейной регрессии. Допустим, что на первом этапе на основе анализа данных эксперимента, с учетом физических, экономических и других аспектов, а также из прошлого опыта мы выбрали в качестве модельного уравнения регрессии прямую линию f ( x, a, b) = a + bx , (3.1) то есть в качестве модели регрессии между исследуемыми величинами Х и Y берется линейная зависимость Y = a + bX + ε . Тогда для данного xi соответствующее значение yi определяется равенством yi = a + bxi + εi , i = 1, 2, ..., n . Здесь x1, x2, ..., xn – заданные числа (значения фактора); y1, y2, ..., yn – наблюденные значения отклика, ε1, ε2,…, εn – ошибки эксперимента, то есть некоторые значения независимых, одинаково распределенных случайных величин. Кроме этого, далее мы будем рассматривать классическую модель регрессионного анализа, так называемую Гауссовскую модель, в которой дополнительно к вышесказанному предполагается, что величины εi распределены по нормальному закону N (0; σ 2 ) с некоторой неизвестной дисперсией σ2. Отметим, что предложенный вид зависимости и сделанные предположения насчет распределения остатков εi – это модель, которой мы задаемся, но это не значит, что она верна на самом деле. Начав с предположения, что эта модель установлена, на последующих ста24 диях анализа мы будем проверять, так ли это на самом деле, то есть проверять адекватность модели реальному процессу, реальным данным, полученным в процессе наблюдения. Естественно, если факты будут против выбранной нами модели, то мы должны ее отклонить и попытаться разработать (выдвинуть) уже с учетом имеющейся информации другую модель и провести ее проверку. На втором этапе анализа по результатам n экспериментальных данных (наблюдений) пары величин (X,Y): (x1, y1), (x2, y2),..., (xn,yn) мы должны оценить параметры выдвинутой нами модели. В случае прямолинейной регрессии это a и b. Для более наглядной интерпретации результатов и некоторого упрощения расчетных формул немного преобразуем модельное уравнение регрессии, введя новый неизвестный параметр A = a + b X . Уравнение (3.1) примет вид f ( x, A, b) = A + b( x − X ) , и тогда предполагаемая связь между xi и yi запишется в виде yi = A + b( xi − X ) + ε i , i = 1, 2, ..., n, где X = 1 n ∑ xi . То есть, фактически, мы ищем уравнения прямой n i =1 регрессии в форме y − y0 = k ( x − x0 ) . Таким образом, наша задача найти оценки параметров A и b: α = Â, β = b̂ , наилучшие в смысле метода наименьших квадратов. Это вполне естественно, поскольку "истинная" линия регрессии, как мы упоминали выше, минимизирует математическое ожидание квадрата отклонения [Y − f ( X , θ)]2 . Теперь эмпирическое (выборочное) уравнение прямой регрессии Y на Х запишем в виде yˆ = α + β( x − X ) . Левая часть равенства, которую мы обозначили ŷ , является оценкой (приближенным значением) математического ожидания M (Y) 25 при заданном значении x. Поэтому выборочные уравнения прямой регрессии Y на X записывается иногда в виде yˆ x = α + β( x − X ) . Полученное уравнение можно использовать как предсказывающее уравнение: подстановка в него значения x позволяет «предсказать» среднее значение Y для этого x. Если данные связаны идеальной линейной зависимостью (|rXY| = 1), то предсказанные значения Y будут в точности равняться наблюдаемому значению y при данном x. Однако, на практике обычно отсутствует идеальная линейная зависимость между данными, и внешние случайные воздействия приводят к разбросу данных. Тем не менее, если все же предположить существование линейной связи и наличие неограниченной выборки, то можно подобрать такие значения α и β, которые дадут возможность предсказать ожидаемое значение Y для любого значения x. Это означает, что ŷ не обязательно совпадает с наблюдаемым значением Y, соответствующим данному x, однако оно будет равно среднему значению всех таких наблюдаемых значений. Таким образом, на втором этапе исследования перед нами стоит задача: используя метод наименьших квадратов получить расчетные формулы для оценки параметров А и b прямолинейной регрессии. Замечание. При изложении темы регрессионного анализа, как вы уже успели заметить, встает проблема в обозначениях: когда писать x или X, y или Y, и т.п. Как и ранее, когда речь идет о вычислительных процедурах, обработке данных, линиях регрессии, изучении функциональной зависимости мы, как правило, обозначаем переменные через x, y, yˆ , например, yˆ = α + β( x − x) . Если же нам надо провести статистический анализ этого соотношения, то мы его записываем Yˆ = Aˆ + bˆ( X − X ) , то есть речь идет о соотношении, связывающим случайные величины. При изложении материала мы не оговариваем каждый раз, какие обозначения применяются, но, надеемся, что из контекста это совершенно ясно. 26 3.3. Определение параметров прямолинейной регрессии методом наименьших квадратов Суть метода наименьших квадратов состоит в том, что оценки Â и b̂ параметров А и b в предлагаемой линии регрессии f ( x, A, b) = A + b( x − x) подбирают таким образом, чтобы минимизировать сумму квадратов отклонений n n i =1 i =1 S ( A, b) = ∑ εi2 = ∑ [ yi − A − b( xi − x)]2 . Данная функция принимает минимальное значение в точке, где обе частные производные обращаются в ноль: ∂S = 0, ∂A ∂S = 0. ∂b После дифференцирования получим систему n ∂S ⎧ 2 [ yi − A − b( xi − x)] = 0, = − ∑ ⎪⎪ ∂A i =1 ⎨ ∂S n ⎪ = −2 ∑ ( xi − x)[ yi − A − b( xi − x)] = 0. ⎪⎩ ∂b i =1 После несложных преобразований имеем систему двух линейных уравнений n n ⎧ An b ( x x ) yi , + − = ∑ ∑ i ⎪⎪ i =1 i −1 ⎨ n n n ⎪ A∑ ( xi − x) + b ∑ ( xi − x) 2 = ∑ ( xi − x) yi , ⎪⎩ i =1 i =1 i =1 решение которой и даст искомые оценки Â и b̂ : n 1 n Aˆ = y = ∑ yi ; bˆ = n i =1 ∑ ( xi − x) ( yi − y ) i =1 n ∑ ( xi − x) . 2 i =1 27 Полученные оценки обладают следующими важными свойствами: 1. M ( Aˆ ) = A, M (bˆ) = b . −1 ⎞ ⎛n 2. D ( Aˆ ) = σ 2 / n, D (bˆ) = σ 2 ⎜ ∑ ( xi − x) 2 ⎟ . ⎠ ⎝ i =1 3. C ( A, b) = 0 . 4. Случайные величины Â и b̂ распределены по нормальному закону. 5. Â и b̂ независимы как случайные величины. Доказательства утверждений 1–3 могут быть получены прямыми вычислениями, причем эти свойства не используют предположения о нормальном характере ошибок. Свойство 4 верно только в рассматриваемой нами Гауссовской модели. Свойство 5 есть естественное следствие нормальности ошибок и свойства 3. Независимость оценок Â и b̂ заметно упрощает дальнейший анализ. Замечание 1. Полученные формулы для оценок Â и b̂ легко преобразовать к виду, более удобному для вычислений и анализа: 1 n xy − x ⋅ y 1 n 1 n , где Aˆ = y = ∑ yi , bˆ = x = x , y = ∑ ∑ yi , i n i =1 n i =1 n i =1 σx2 xy = 1 ∑ xi yi , σ2x = ∑ xi2 − (x ) = x 2 − (x ) . n n i =1 1 n 2 2 n i =1 Замечание 2. Уравнение регрессии Y на X записывается в виде yˆ = y + bˆ( x − x). Если X и Y – случайные величины, то, поменяв в наших выкладках местами X и Y, получим прямую регрессии X на Y xˆ = x + bˆ1 ( y − y ). n где xy − x ⋅ y bˆ1 = , σ 2y = 2 σy ∑y i =1 n 2 i () 2 () 2 − y = y2 − y . Заметим, что обе прямые регрессии проходят через точку ( x, y ) . Угловые коэффициенты наклона прямых связаны с выборочным ко28 эффициентом корреляции соотношением rXY = bˆ ⋅ bˆ1 . Если, кроме bˆ σ 2x = , то можно получить выражение для оценок b̂ этого, учесть bˆ σ 2 1 y и b̂1 через выборочный коэффициент корреляции и выборочные σy σ дисперсии bˆ = rXY , bˆ1 = x rXY . σx σy Часто эти оценки называют выборочными коэффициентами регрессии Y на X и X на Y соответственно и обозначают ρ Y / X и ρ X / Y , то есть σy σ ρ Y / X = bˆ = rXY , ρ X / Y = bˆ1 = x rXY . σy σx Замечание 3. Легко увидеть, что прямые регрессии Y на X и X на Y совпадают только в том случае, когда | rXY |= 1 , то есть X и Y связаны линейной зависимостью. Действительно, оба уравнения в y− y x−x этом случае преобразовываются к виду . = σy σx 3.4. Доверительные интервалы для параметров линейной регрессии Свойства 1–4 оценок Â и b̂ параметров линейной регрессии показывают, что случайные величины Â и b̂ распределены по нор⎞ ⎛ ⎟ ⎜ 2⎞ 2 ⎛ σ σ ˆ ˆ ⎟ , где ⎜ ⎜ ⎟ мальному закону, причем A ≅ N ⎜ A, ⎟, b ≅ N ⎜ b, n ⎟ n 2 ⎝ ⎠ ⎜ ∑ ( xi − x) ⎟ ⎠ ⎝ i =1 2 2 σ σ D ( Aˆ ) = σ 2Aˆ = , D (bˆ) = σb2ˆ = n , M ( Aˆ ) = A, M (bˆ) = b . n ∑ ( xi − x) 2 i =1 29 Этот факт дает возможность применить к построению доверительных интервалов ту же методику, что и при построении доверительных интервалов для неизвестного математического ожидания в главе 1. 1. Если дисперсия ошибок эксперимента σ 2 известна (что бывает крайне редко, и этот случай представляет собой больше теоретический интерес), то рассматриваем случайные величины u Aˆ = Aˆ − A bˆ − b , ubˆ = , σ Aˆ σbˆ которые имеют нормальное распределение N(0;1). Для данного уровня значимости α получаем P (| u |< u1− α / 2 ) = 1 − α . Из последнего соотношения находится u1− α / 2 – квантиль нормального распределения, тогда | Aˆ − A | | bˆ − b | < u1− α / 2 , < u1− α / 2 . σ Aˆ σbˆ При этом доверительные интервалы будут следующими: σ σ Aˆ − u1− α / 2 < A < Aˆ + u1− α / 2 , n n σ bˆ − u1− α / 2 < b < bˆ + n ∑ ( xi − x) σ n ∑ ( xi − x) 2 i =1 u1− α / 2 . 2 i =1 2. Пусть теперь σ 2 – неизвестна, что чаще всего бывает на практике. В таком случае естественно воспользоваться какой-то оценкой σ̂ 2 . Ключ к оцениванию σ 2 дает остаточная сумма квадратов n n n i =1 i =1 i =1 [ ] ∑ εi2 = ∑ ( yi − yˆi ) 2 = ∑ yi − Aˆ − bˆ( xi − x) 2 . Можно доказать, что в рассматриваемой нами Гауссовской модели эта сумма не зависит от Â и b̂ , и имеет распределение σ 2χ 2n − 2 , где 30 χ 2n − 2 – распределение хи-квадрат с n – 2 степенями свободы. Благода- ря этому свойству для σ 2 можно построить несмещенную оценку S yx : 2 S yx = [ 1 n ∑ yi − Aˆ − bˆ( xi − x) n − 2 i =1 ] 2 . Aˆ − A 2 не зависит от Â и b̂ , то статистики t Aˆ = n и Поскольку S yx S yx bˆ − b n tbˆ = ∑ ( xi − x)2 имеют распределение Стьюдента с n − 2 степеS yx i =1 нями свободы. Тогда для данного уровня значимости α и по числу степеней свободы n − 2 по таблицам квантилей распределения Стьюдента находим квантиль порядка 1 − α2 , то есть t1− α / 2 (n − 2) . Доверительные интервалы для Â и b̂ запишутся в той же форме, что и при известном σ 2 : S yx Aˆ − t1− α / 2 (n − 2) < A < Aˆ + n S yx bˆ − t1− α / 2 (n − 2) < b < bˆ + n ⋅ σx S yx t1− α / 2 (n − 2) , n S yx t1− α / 2 (n − 2) . n ⋅ σx Замечание. Полученные выражения для доверительных интервалов можно записать в другой форме. Путем несложных преобраσy rXY , Aˆ = y , остаточная сумма зований, с учетом того, что bˆ = σx квадратов запишется в виде n n n i =1 i =1 i =1 [ ] 2 ). ∑ εi2 = ∑ ( yi − yˆi )2 = ∑ yi − Aˆ − bˆ( xi − x) 2 = n ⋅ σ 2y (1 − rXY ∧ 1 n 2 ) . Кроме того, так как σ x = ∑ ( xi − x) 2 , Тогда S yx = σ y n −n 2 (1 − rXY n i =1 31 ∧ σy = 1 n ∑ ( yi − y ) 2 , то доверительные интервалы имеют вид: n i =1 2 2 1 − rXY 1 − rXY Aˆ − σ y t1− α / 2 (n − 2) < A < Aˆ + σ y t1− α / 2 (n − 2) , (3.2) n−2 n−2 2 2 σ y 1 − rXY σ y 1 − rXY t1− α / 2 (n − 2) . (3.3) t1− α / 2 (n − 2) < b < bˆ + bˆ − σx n − 2 σx n − 2 Последние формулы наиболее удобны для вычислений. Пример. Определить по данным, приведенным в п. 1.5, прямую регрессии, задающую линейный прогноз средней массы студента по его росту. Найти 95%-й доверительный интервал для параметров прямой регрессии. Решение. С учетом вычислений, проделанных в п. 1.5., имеем, 344493 − 25 ⋅ 179, 4 ⋅ 76,64 =0,51 . что при n = 25, α = 0,05: Aˆ = y =76,64, bˆ = 2 806105 − 25 ⋅ 179, 4 Следовательно, прямая регрессии, оценивающая среднюю массу студента по его росту, имеет вид yˆ = 76,64 + 0,51 ⋅ ( x − 179,4) . Для построения доверительных интервалов оценок Â и b̂ вычислим () = 806105 () = 148918 σx = x2 − x σy = y2 − y 2 2 25 25 − (179,4) 2 = 7,736 , − (76,64) 2 = 9,1121 , 2 S yx = σ y n −n 2 (1 − rXY ) = 8,5763 . Квантиль распределения Стьюдента с числом степеней свободы n − 2 = 23, порядка 1 − α 2 равна t0,975 (23) = 2,069 . После подстановки в формулы (3.2) и (3.3) получим доверительные интервалы 73,0899 < A < 80,190, 0,0511 < b < 0,9689. 32 4. МНОЖЕСТВЕННАЯ ЛИНЕЙНАЯ РЕГРЕССИЯ При решении инженерных задач часто требуется найти зависимость между случайной величиной η и переменными величинами ξ1 , ξ 2 , ..., ξ m , значения которых x1 , x 2 ,..., x m задаются заранее при планировании эксперимента. Однако при проведении n экспериментов эти значения x1 j , x 2 j , ..., x mj ( j = 1, n) обычно измеряются с некоторыми малыми ошибками (погрешности приборов и т.п.). Неизвестные значения ξ1 , ξ 2 , ..., ξ m могут иметь случайную вариацию, а значения x1 , x2 , ..., x m не являются случайными, так как они заданы заранее. При таком подходе величины xi (i = 1, m) называют контролируемыми переменными. Так как переменные xi не коррелированы с ошибками измерений, то для получения зависимости между xi и у, где у – значение случайной величины η , можно использовать обычный метод наименьших квадратов, как и ранее, при рассмотрении случая линейной регрессии двумерного случайного вектора. Заметим, что переменная η является случайной величиной, так как при проведении эксперимента невозможно учесть все факторы, оказывающие влияние на эту переменную, в том числе ошибки измерений. При исследовании взаимосвязи между случайной величиной η и переменными ξ1 , ξ 2 , ..., ξ m обычно рассматриваются следующие вопросы: - выбор модели регрессии; - нахождение оценок параметров выбранного уравнения и построение доверительных интервалов параметров уравнения по заданному уровню значимости α ; - проверка согласованности выбранной модели с экспериментальными данными и уточнение вида полученного уравнения. Выбор модели регрессии производится обычно из эмпирических соображений. Эту задачу здесь мы рассматривать подробно не будем ввиду ее сложности. Далее рассматриваются две задачи: 33 - построение линейного уравнения регрессии и доверительных интервалов для его параметров; - проверка согласованности полученной модели с экспериментальными данными наиболее простыми способами. 4.1 Нахождение оценок параметров линейного уравнения регрессии Ограничимся построением линейного уравнения регрессии η = α*0 + α1*ξ1 + α*2ξ 2 + ... + α*m ξm . Другими словами будем искать наилучшее приближение функции η функцией вида ϕ( x1 , ..., x m , a 0 , a1 , ..., a m ) = a 0 + a1 x1 + ... + a m x m . Пусть в j-м эксперименте величины ξ1 , ξ 2 , ..., ξ m приняли значения x1 j , x 2 j , ..., x m j , а случайная величина η – значения y j ( j = 1, n) . Согласно методу наименьших квадратов в качестве оценок параметров α*0 , α1* , ..., α*m принимаются значения a0* , a1* , ..., a m* , при которых достигает минимума функция n Φ ( a 0 , a1 , ..., a m ) = ∑ ( y j − a0 − a1 x1 j − ...a m x m j ) 2 . j =1 Из необходимых условий экстремума функции Φ ( a 0 , a1 , ..., a m ) следует, что параметры a0 , a1 , ..., a m являются решениями системы ∂Φ ( a 0 , a1 , ..., a m ) = 0, i = 0, 1, ..., m ∂ai Введем следующие обозначения: X – n × (m + 1) -мерная матрица наблюдений контролируемых переменных, в которую введен дополнительно первый столбец, состоящий из единиц; Y – n-мерный вектор-столбец наблюдаемых значений случайной величины η ; 34 A – (m + 1) -мерный столбец параметров ai (i = 0, 1, ..., m ) : ⎛ 1 x11 ⎜ ⎜ 1 x12 X =⎜ ... ... ⎜ ⎜1 x 1n ⎝ xm1 ⎞ ⎛ y1 ⎞ ⎜ ⎟ ⎟ ... xm 2 ⎟ ⎜ y2 ⎟ Y , = ⎜ ... ⎟, ... ... ⎟ ⎜ ⎟ ⎟ ⎜y ⎟ ... xmn ⎟⎠ ⎝ n⎠ ... ⎛ a0 ⎞ ⎜ ⎟ ⎜a ⎟ A=⎜ 1⎟. ... ⎜ ⎟ ⎜a ⎟ ⎝ m⎠ В матричных обозначениях эта система примет вид ( X T X ) A = X TY , здесь X T – матрица, транспонированная к матрице X. Решение этой системы находим по формуле A = ( X T X ) −1 X T Y , где ( X T X ) −1 – матрица, обратная матрице ( X T X ) . Искомое выборочное уравнение регрессии имеет вид: y = a0 + a1x1 + ... + am xm . При большом числе переменных задача нахождения вектора решается на ЭВМ с помощью стандартных программ. 4.2 Построение доверительных интервалов параметров уравнения регрессии Построение доверительных интервалов параметров ai (i =0, 1, ..., m ) легко проводится в случае, если остатки ε j = y j − y j ( j = 1, n) распределены по нормальному закону с параметрами M (ε) = 0, D (ε) = σ 2 . Здесь y j – наблюдаемое в j-м эксперименте значение η , y j – значение y, полученное из уравнения регрессии при подстановке значений x1 j , x 2 j , ..., x m j , заданных в j-м эксперименте. При малом числе опытов (n < 50) применяют приближенные методы проверки нормального распределения остатков. Можно считать, что остатки 35 ε j распределены по нормальному закону, если не менее 95% из них лежат в интервале ( − 2 Sε , 2 Sε ) , где Sε = n ∑ ε 2j /(n − m + 1) – j =1 оценка дисперсии. Случай, когда остатки ε j не подчиняются нормальному закону распределения, рассматривать не будем ввиду его сложности. Для построения 100 ⋅ (1 − α)% -х доверительных интервалов для α*j ( j = 0, 1, ..., m ) по таблице распределения Стьюдента по заданному уровню значимости α и числу степеней свободы ν = n − m − 1 находим критическое значение статистики t α (ν) . Доверительные 1− 2 интервалы имеют вид ai − t 1− α (ν ) ⋅ S a i 2 < α*i < ai + t 1− α (ν ) ⋅ S a i 2 , где S a = S ε ai(+−11,)i +1 , i = 0,1,..., m . i Здесь S a i – средние квадратические ошибки коэффициентов ai , Sε – вычисленная выше оценка дисперсии, ai(+−11,)i +1 – диагональный элемент матрицы (X T X ) −1 размера (m + 1)×(m + 1) , соответствующий переменной xi . 4.3 Проверка согласованности модели с экспериментальными данными Если в уравнении регрессии какая-то из контролируемых переменных xi незначимо влияет на переменную у, то эту переменную xi следует исключить из уравнения регрессии. Выявление статистически незначимых переменных xi можно рассматривать как проверку гипотезы H 0 : α*i = 0 (i = 1, m) , то есть η не коррелирована с ξi . 36 Если остатки ε j распределены по нормальному закону, то гипоa теза H 0 может быть проверена с помощью статистик ti = i , i = 1, m . S ai Эти статистики имеют распределение Стьюдента с ν = n − m − 1 степенями свободы при условии справедливости гипотезы H 0 . По таблицам распределения Стьюдента находим критическое значение t α (ν) , где α – выбранный уровень значимости. Если 1− 2 выполняется условие | ti | > t 1− α (ν ) , 2 то нулевая гипотеза отвергает- ся, то есть следует считать, что проверяемый коэффициент уравнения регрессии α*i существенно отличен от нуля или, что то же самое, контролируемая переменная xi оказывает значимое влияние на переменную у. Если последнее неравенство не выполняется, то переменная xi влияет незначимо на переменную y. В этом случае уравнение регрессии нужно строить заново, учитывая в нем все переменные, кроме xi . Построение линейной регрессионной модели, у которой все факторы xi существенно влияют на переменную у, может закончиться не на первом, а на втором, третьем и т. д. этапе. На каждом из них заново проводится оценка коэффициентов регрессии и анализ влияния каждой переменной. Если несмещенная оценка среднего квадратического отклонения Sε , вычисляемого по приведенной выше формуле, допустима для данной задачи, то считаем, что модель хорошо согласуется с экспериментом. Обычно, в практических задачах требуют, чтобы Sε не превышало 10% абсолютной величины наименьшего значения случайной величины η . Если Sε велико, то модель регрессии нужно уточнить, то есть взять большее число опытов и произвести все вычисления заново. Если и это не поможет, то можно сделать вывод о том, что выбран- 37 ная модель плохо согласуется с экспериментом. В этом случае нужно выбирать другой вид зависимости. Пример. Произведено 10 измерений прочности строительного материала у при равном содержании в нем некоторых компонент ξ1 , ξ 2 . Заданные при проведении эксперимента значения x1 j , x2 j компонент ξ1 , ξ 2 и полученные значения y j прочности η ( j = 1,10) сведены в таблицу. N x1 x2 y 1 0 2 1 3 2 4 3 5 4 6 5 17,5 13,7 10,8 8,5 5,2 5 7 6 8 7 4,95 4,92 9 8 10 9 4,9 4,89 13,25 15,95 17,63 18,63 19,2 19,37 19,5 19,6 19,67 19,7 Предполагая, что зависимость между величиной η и величинами ξ1 , ξ 2 линейная: 1) найти оценки a0 , a1 , a2 параметров α*0 , α1* , α*2 уравнения регрессии; 2) найти 95%-e доверительные интервалы параметров α*0 , α1* , α*2 ; 3) проверить согласованность полученной модели регрессии с экспериментом. Решение. 1. Для нахождения оценок a0 , a1 , a2 коэффициентов выборочного уравнения регрессии y = a0 + a1 x1 + a2 x2 необходимо решить систему алгебраических уравнений вида. Матрица коэффициентов X T X этой системы и матрица-столбец свободных членов X T Y записываются следующим образом: ⎛ n ⎜ X T X = ⎜ ∑ x1 ⎜∑ x 2 ⎝ ∑ x1 ∑ x2 ⎞ ⎟ ∑ x12 ∑ x1x2 ⎟ , X T Y ∑ x1x2 ∑ x22 ⎟⎠ В нашем случае вычисления дают 38 ⎛ ∑y ⎞ ⎜ ⎟ = ⎜ ∑ x1y ⎟ . ⎜∑ x y⎟ 2 ⎠ ⎝ 45 80,36 ⎞ ⎛ 10 ⎛ 182,5 ⎞ ⎜ ⎜ ⎟ ⎟ T 285 253,95 ⎟ , X Y = ⎜ 869,61 ⎟ . X X = ⎜ 45 ⎜ 80,36 253,95 831,501⎟ ⎜1381,512 ⎟ ⎝ ⎠ ⎝ ⎠ T Решая систему ( X T X ) A = X T Y линейных алгебраических уравнений третьего порядка, находим ⎛ a0 ⎞ ⎛ 22,3634 ⎞ ⎜ ⎟ ⎜ ⎟ A = ⎜ a1 ⎟ = ⎜ − 0,0473 ⎟ . ⎜ a ⎟ ⎜ − 0,4854 ⎟ ⎝ 2⎠ ⎝ ⎠ Значит, выборочное уравнение регрессии имеет вид y = 22,3634 − 0,0473 x1 − 0,4854 x2 . (4.1) 2. Прежде, чем находить доверительные интервалы параметров уравнения регрессии, убедимся, что остатки α*0 , α1* , α*2 ε j = y j − y j ( j = 1, 10) распределены по нормальному закону. Так как число опытов мало, применим приближенный метод проверки. Для удобства вычислений составим таблицу N yj 1 2 3 4 5 6 7 8 9 10 13,25 15,95 17,63 18,63 19,2 19,37 19,5 yj 13,869 15,666 17,027 18,096 19,65 19,7 19,677 19,644 19,607 19,564 εj −0,619 0,234 0,603 0,534 −0,45 −0,33 −0,177 −0,044 0,063 0,136 19,6 19,67 19,7 Значения y j вычисляются, исходя из уравнения регрессии (4.1). n Используя данные таблицы, находим ∑ε j =1 2 j = 1,4805 . Средняя квад- ратическая ошибка Sε = 1,4805 / 7 = 0,4599 . Так как в интервал ( − 2 Sε , 2 Sε ) попадают все остатки ε j , то можно считать, что остатки распределены по нормальному закону. 39 В этом случае для нахождения доверительных интервалов вычислим ( −1) ( −1) ( −1) диагональные элементы a11 , a22 , a33 матрицы ( X T X ) −1 10 det( X X ) = T 45 80,36 45 285 253,95 = 37297,5 , 80,36 253,95 831,501 a11( −1) = 285 253,95 1 = 4,6246 , T det( X X ) 253,95 831,501 ( −1) a 22 = 10 80,36 1 = 0,0498 , T det( X X ) 80,36 831,501 ( −1) a33 = 10 45 1 = 0,0221. T det( X X ) 45 285 Далее находим средние квадратические ошибки параметров ai ( −1) ( −1) ( −1) S a0 = Sε a11 =0,989, S a1 = Sε a22 =0,1026, S a 2 = Sε a33 =0,0684 . По заданному уровню значимости α = 1 − p = 1 − 0,95 = 0,05 и числу степенней свободы ν = n − m −1=7 находим критическое значение t 1− α (ν ) 2 = t0,975 (7) = 2,365 . Доверительные интервалы параметров α*0 , α1* , α*2 имеют вид 22,3634 − 2,365 ⋅ 0,989 < α*0 < 22,3634 + 2,365 ⋅ 0,989 , − 0,0473 − 2,365 ⋅ 0,1026 < α1* < −0,0473 + 2,365 ⋅ 0,1026 , − 0,4854 − 2,365 ⋅ 0,0684 < α*2 < −0,4854 + 2,365 ⋅ 0,0684 . Окончательно получаем 20,024 < α*0 < 24,702 ; − 0,289 < α1* < 0,195 ; − 0,647 < α*2 < −324 . 40 Данные доверительные интервалы накрывают точные параметры уравнения регрессии с вероятностью p = 1 − α = 0,95 . α*0 , α1* , α*2 3. Так как остатки ε j = y j − y j , ( j = 1, 10) распределены по нормальному закону, то выявление статистически незначимых переменных, то есть проверку гипотезы H 0 : α*i = 0 можно произвести с a помощью статистик ti = i , i = 1, 2 : S ai t1 = 0,0473 0,1026 = 0,461 , t2 = 0,4854 0,0684 = 7,96 . Сравним полученные значения ti , i = 1, 2 с критическим значением t0,975 (7) = 2,365 . Видно, что полученное значение статистики t2 превосходит критическое значение, значит, коэффициент a2 отличен от нуля с вероятностью 0,95, то есть переменная x2 оказывает влияние на у. Значение t1 меньше критического, значит, коэффициент a1 незначимо отличается от нуля. Об этом свидетельствует и тот факт, что доверительный интервал для α1* накрывает нуль. Следовательно, переменная x1 незначимо влияет на у, и ее из выражения регрессии следует исключить. Уравнение регрессии должно иметь вид η = β*0 + β*2ξ 2 . Для построения выборочного уравнения регрессии используем табличные значения x2 и у. Пример. Задача ставится теперь так: 1) найти выборочный коэффициент корреляции и оценить его значимость; 2) построить уравнение регрессии y = b0* + b2* x2 и найти 95%-e доверительные интервалы параметров β*0 и β*2 . Решение. 1. Так же, как и ранее, находим ρ = − 0,981, σ x2 = 4,5427, σ y = 2,1208, x22 = 83,1501 . 41 Для проверки значимости коэффициента корреляции находим tнабл.= 0,981 ⋅ 8 1 − (0,981) 2 ≈ 14,29 . По уровню значимости α = 0,05 и числу степеней свободы ν = n − m − 1 = 10 − 1 − 1 = 8 находим критическое значение t γ (ν) = t0,975 (8) = 2,306 , где γ = 1 − α / 2 = 1 − 0,05 / 2 = 0,975 . Видно, что tнабл.> t γ (ν) . Значит, с вероятностью р = 0,95 можно утверждать, что ρ ≠ 0 , то есть случайные величины ξ2 и η не являются независимыми. 2. Находим оценки b0* и b2* коэффициентов β*0 и β*2 соответственно уравнения регрессии случайной величины η на ξ2 b0* = 21,9302, b2* = −0,458 . Выборочное уравнение регрессии имеет вид: y = 21,9302 − 0,458 x2 . Находим 95%-е доверительные интервалы его коэффициентов 5427 21,39302 − 2,31 ⋅ 42,,1208 1− ( − 0 , 981) 2 8 − 0,458 − 2,31 ⋅ 42,,1208 5427 ⋅ 83,1501 < β*0 < 21,9302 + 2,31 ⋅ 1,3397 , 1− ( − 0 , 981) 2 8 < β*2 < −0,458 + 2,31 ⋅ 0,03202 , или, после преобразований, 18,836 < β*0 < 25,025 ; − 0,5319 < β*2 < −0,384 . 42 Литература 1. Герасимович А.И. Математическая статистика. – Мн.: Выш. школа, 1983. 2. Колде Я.К. Практикум по теории вероятностей и математической статистике. – М.: Статистика, 1975. 3. Львовский Е.Н. Статистические методы построения эмпирических формул. – Мн.: Выш. школа, 1988. 4. Сборник задач по математике для втузов: Специальные курсы / Под редакцией А.В.Ефимова. – М.: Наука, 1984. 5. Хольд А. Математическая статистика с техническими приложениями. – М.: Иностранная литература, 1956. 43 Содержание Цель работы… … … … . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . Содержание работы… … … … . . . . . . . . . . . . . . . . . . . . . . . . . . . Порядок проведения работы… … … … . . . . . . . . . . . . . . . . . . Требования к отчету… … … … . . . . . . . . . . . . . . . . . . . . . . . . . . 1. УСТАНОВЛЕНИЕ НАЛИЧИЯ ЗАВИСИМОСТИ МЕЖДУ ДВУМЯ СЛУЧАЙНЫМИ ВЕЛИЧИНАМИ ПО РЕЗУЛЬТАТАМ ИХ ВЫБОРОК… … … … . . . . . . . . . 1.1. Коэффициент корреляции… … … … . . . . . . . . . . . . . . . . . 1.2. Представление исходных данных… … … … . . . . . . . . . 1.3. Оценка коэффициента корреляции по результатам эксперимента… … … … . . . . . . . . . . . . . 1.4. Проверка значимости выборочного коэффициента корреляции… … … … . . . . . . . . . . . . . . . 1.5. Пример вычисления коэффициента корреляции… . . 2. ОСНОВЫ РЕГРЕССИОННОГО АНАЛИЗА… … … . . 2.1. Функции и линии регрессии… … … … . . . . . . . . . . . . . 2.2. Модель линейного регрессионного анализа… … … 2.3. Общая схема решения регрессионных задач… … . . 3. ОЦЕНКА ПАРАМЕТРОВ МОДЕЛИ… … … … … … 3.1. Анализ адекватности модели… … … … … … … … 3.2. Простейшая линейная регрессия… … … … … … . . 3.3. Определение параметров прямолинейной регрессии методом наименьших квадратов… … … 3.4. Доверительные интервалы для параметров линейной регрессии… … … … … … . . 4. МНОЖЕСТВЕННАЯ ЛИНЕЙНАЯ РЕГРЕССИЯ… 4.1 Нахождение оценок параметров линейного уравнения регрессии… … … … … … . . 4.2 Построение доверительных интервалов параметров уравнения регрессии… … … … … … . 4.3 Проверка согласованности модели с экспериментальными данными… … … … … … . Литература… … … … . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 44 3 3 4 4 5 6 8 12 14 16 17 18 19 20 21 23 24 27 29 33 34 35 36 43 Аннотация Учебно-методическое пособие содержит теоретический материал, необходимый для выполнения лабораторной работы «Установление зависимости между двумя случайными величинами по результатам их выборок». Четвертый раздел издания содержит дополнительный материал по теме «Множественная линейная регрессия». УДК 519.216 (075.8) ББК 22.1 я 7 В-31 45 f(t) область принятия гипотезы t t -γ 46 tнабл. tγ